Что такое ошибка предсказания награды: когда мозг считает разницу между «ожидал» и «получил»

Reward prediction error (RPE) — фундаментальный вычислительный механизм, работающий в вашем мозге прямо сейчас. Математически: RPE = Фактическая награда − Ожидаемая награда (S003, S005).

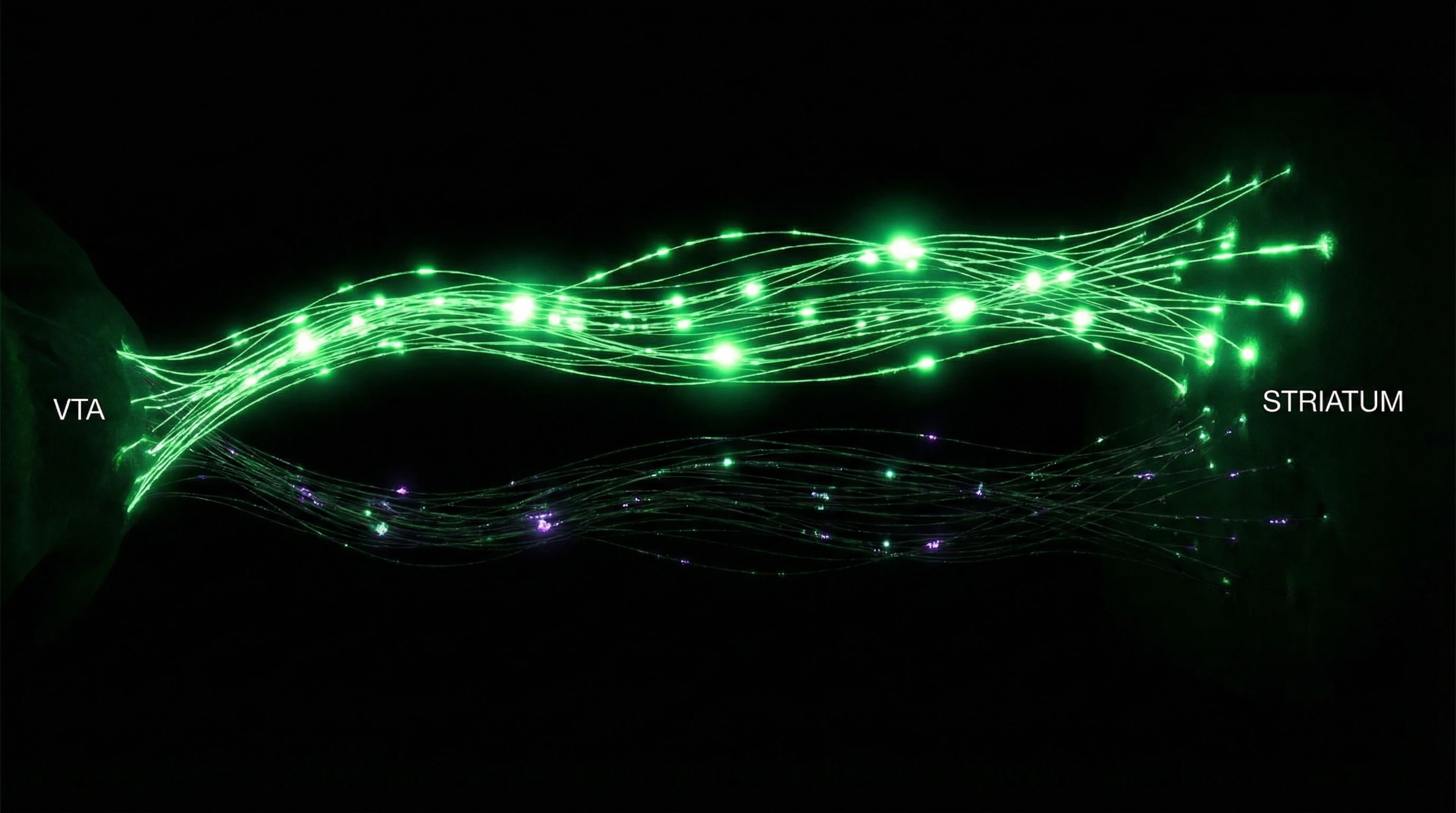

Положительная ошибка — получили больше, чем ожидали. Отрицательная — меньше. Этот сигнал кодируется дофаминергическими нейронами вентральной тегментальной области (VTA) и передается в стриатум, где служит основой для обучения с подкреплением (S007).

- Дофаминергические нейроны VTA

- Увеличивают частоту разрядов при положительной ошибке, снижают при отрицательной. Кодируют не саму награду, а отклонение от ожидания (S003).

- Nucleus accumbens

- Получает проекции из VTA и модулирует синаптическую пластичность. Одна и та же награда вызывает разные дофаминергические ответы в зависимости от предсказуемости.

Signed vs Unsigned RPE: направление против величины

Современные исследования различают два типа ошибок предсказания (S004).

| Тип RPE | Что кодирует | Функция |

|---|---|---|

| Signed RPE | Направление ошибки (лучше/хуже ожидаемого) | Оценка результатов, подкрепление поведения |

| Unsigned RPE | Абсолютная величина отклонения | Обработка неопределенности, обновление модели мира |

ЭЭГ-исследования показывают, что эти два типа сигналов обрабатываются частично независимыми нейронными системами. Unsigned RPE связан с метакогнитивным мониторингом точности предсказаний.

Temporal Difference Learning: как RPE обновляет ожидания во времени

RPE встроен в алгоритм temporal difference (TD) learning, где предсказания обновляются на каждом временном шаге, а не только после конечного результата (S005).

Когда вы видите сигнал, предсказывающий награду (звонок в дверь перед доставкой еды), дофаминергические нейроны начинают реагировать на этот сигнал, а не на саму награду. Ошибка предсказания «мигрирует» назад во времени к самому раннему предиктору. Подробнее — в разделе Термодинамика.

- Дофаминергический ответ переключается с награды на контекстные сигналы, предшествующие ей

- Условные стимулы приобретают мотивационную силу

- Зависимости становятся устойчивыми — мозг реагирует на контекст, а не на вещество

Этот механизм объясняет, почему разрыв отношений запускает те же механизмы горя, что и потеря награды: мозг привык предсказывать присутствие партнера и получает отрицательную ошибку предсказания при его отсутствии.

Пять аргументов в пользу центральной роли RPE в обучении и принятии решений

🔬 Аргумент 1: Кросс-видовая консервация механизма

Механизмы RPE обнаружены у организмов от дрозофил до приматов, что указывает на их фундаментальную эволюционную важность (S005). У всех исследованных видов наблюдается сходная логика: нейронные системы, использующие нейромодуляторы (дофамин у млекопитающих, октопамин у насекомых), кодируют отклонения от ожидаемых результатов и используют эти сигналы для модификации поведения.

Консервация через сотни миллионов лет эволюции свидетельствует о том, что RPE решает критически важную адаптивную задачу: эффективное обучение в изменчивой среде при ограниченных вычислительных ресурсах.

📊 Аргумент 2: Прямое соответствие между дофаминергической активностью и поведенческим обучением

Оптогенетические эксперименты демонстрируют причинно-следственную связь: искусственная стимуляция дофаминергических нейронов в момент действия усиливает вероятность повторения этого действия, даже в отсутствие реальной награды (S007). Обратное также верно — подавление дофаминергической активности нарушает обучение.

Величина дофаминергического ответа коррелирует с скоростью обучения: чем больше ошибка предсказания, тем быстрее происходит обновление поведенческой политики (S005). Это прямое доказательство того, что RPE не просто коррелирует с обучением, но является его причинным механизмом.

🧠 Аргумент 3: Вычислительная эффективность TD-learning

С точки зрения машинного обучения, алгоритмы на основе RPE (особенно TD-learning) демонстрируют оптимальное соотношение между скоростью обучения и вычислительной сложностью (S005). В отличие от методов, требующих полной модели среды, RPE-based learning работает инкрементально, обновляя оценки после каждого опыта.

- Инкрементальное обновление

- Позволяет организмам обучаться в реальном времени без необходимости хранить и обрабатывать полную историю взаимодействий.

- Конвергенция к оптимальному решению

- Тот факт, что биологические системы конвергировали к решению, математически близкому к оптимальному, подтверждает адаптивную ценность RPE-механизмов.

🔎 Аргумент 4: Объяснительная сила для клинических феноменов

RPE-framework объясняет широкий спектр психиатрических и неврологических расстройств (S008). При зависимостях наблюдается гиперчувствительность к сигналам, предсказывающим наркотик, и притупленный ответ на естественные награды — паттерн, согласующийся с нарушением RPE-сигналов.

При депрессии характерна ангедония и сниженная способность обучаться на положительных результатах, что соответствует притупленным положительным RPE. При шизофрении аберрантная дофаминергическая сигнализация может генерировать ложные ошибки предсказания, приводя к формированию бредовых убеждений (S008).

Единая теоретическая рамка, объясняющая столь разнородные клинические феномены, обладает высокой объяснительной силой.

🧪 Аргумент 5: Конвергенция данных из множественных методологий

Роль RPE подтверждается данными из одноклеточных записей у животных, фМРТ у людей, ЭЭГ/ЭРП исследований, фармакологических манипуляций, генетических исследований и вычислительного моделирования (S004), (S005), (S003). Когда независимые методы с разными ограничениями и источниками систематических ошибок конвергируют к одному выводу, это существенно повышает уверенность в его валидности.

| Методология | Что измеряет | Результат |

|---|---|---|

| Одноклеточные записи | Активность отдельных дофаминергических нейронов | Кодирование ошибки предсказания в реальном времени |

| фМРТ | BOLD-сигнал в вентральном стриатуме | Корреляция с вычисленными RPE из поведенческих моделей |

| ЭЭГ/ЭРП | Компонент reward positivity | Чувствительность к величине ошибки предсказания |

Эффект привлекательности: как контекст взламывает нейронные вычисления RPE

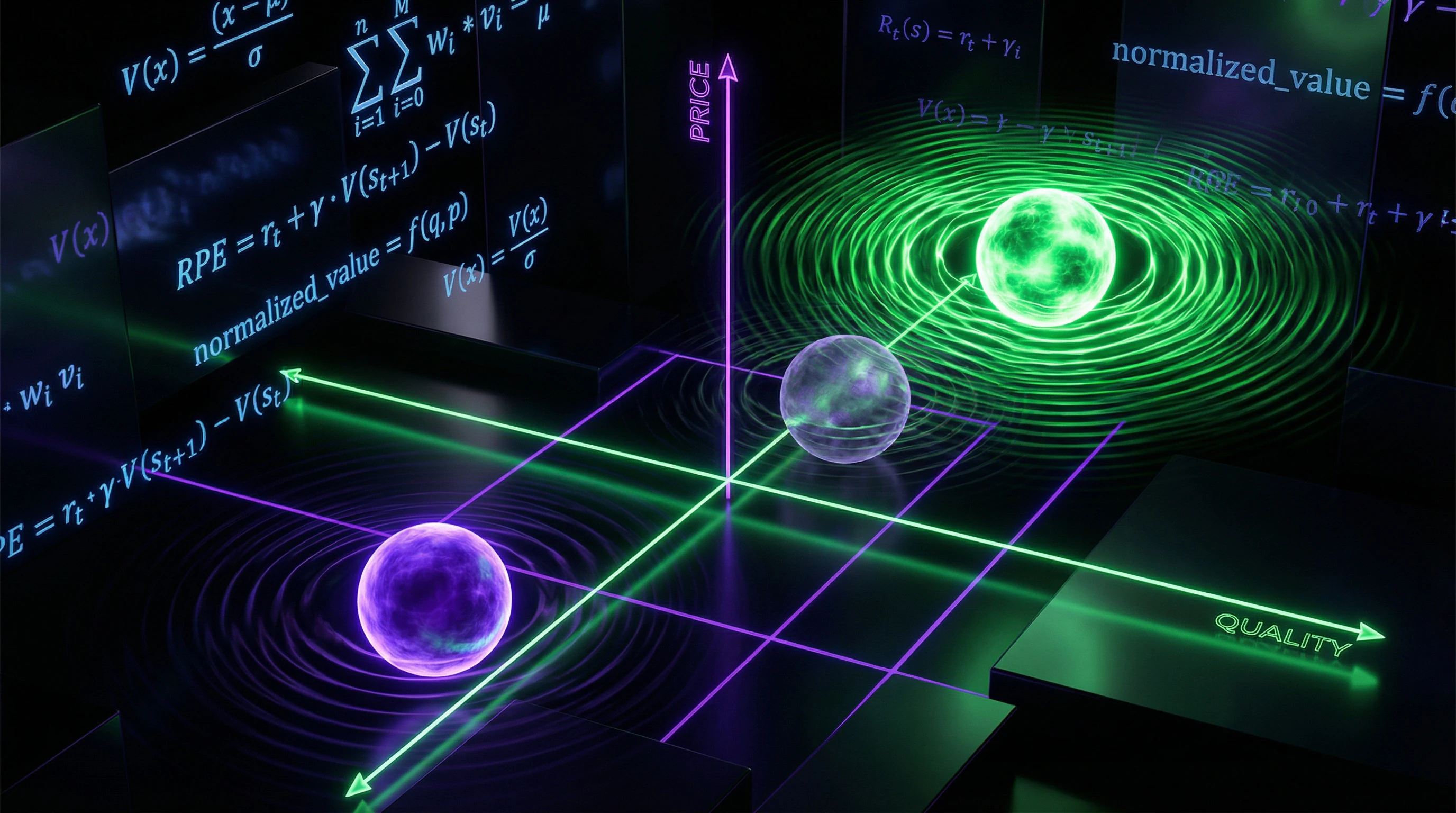

Классическая теория RPE предполагает, что ошибки предсказания вычисляются на основе абсолютных значений наград. Однако исследования эффекта привлекательности (attraction effect) демонстрируют, что контекст выбора радикально модулирует эти вычисления (S001, S002).

Эффект привлекательности возникает, когда добавление третьей, асимметрично доминируемой опции (decoy) увеличивает привлекательность одной из двух исходных опций. Если вы выбираете между опцией A (высокое качество, высокая цена) и опцией B (низкое качество, низкая цена), добавление опции C (чуть хуже A по обоим параметрам) увеличивает вероятность выбора A, хотя объективная ценность A не изменилась. Подробнее — в разделе Электромагнетизм.

🧬 Нейронные корреляты контекстной модуляции RPE

Исследование с использованием фМРТ показало, что эффект привлекательности модулирует RPE-сигналы в вентральном стриатуме и медиальной префронтальной коре (S001, S002). Когда участники делали выбор в присутствии decoy-опции, нейронные RPE-сигналы для целевой опции были усилены по сравнению с контекстом без decoy, даже при идентичных объективных результатах.

Мозг вычисляет ошибки предсказания не в абсолютных единицах, а относительно контекста выбора. Эта модуляция происходит на уровне базовых RPE-сигналов, а не только на уровне высокоуровневого принятия решений.

📊 Временная динамика: межвременной выбор под влиянием контекста

Эффект привлекательности влияет на межвременной выбор (intertemporal choice) — решения между меньшей немедленной и большей отложенной наградой (S001, S002). Присутствие decoy-опции изменяло не только сам выбор, но и субъективное дисконтирование будущих наград.

| Условие | Временное дисконтирование | RPE-сигнал для отложенной награды |

|---|---|---|

| Без decoy | Высокое (низкая терпеливость) | Слабый |

| С decoy | Низкое (высокая терпеливость) | Усиленный |

Участники демонстрировали меньшее временное дисконтирование (большую «терпеливость») для целевой опции в присутствии decoy. Мозг генерировал более сильные положительные ошибки предсказания для отложенных наград в контексте, делающем их более привлекательными относительно альтернатив.

⚙️ Механизм: нормализация ценности в контексте выбора

Предполагаемый механизм включает нормализацию ценности (divisive normalization) — процесс, при котором субъективная ценность опции вычисляется относительно среднего или диапазона доступных опций (S001). Когда decoy добавляется в набор выбора, он изменяет референтную точку, относительно которой оцениваются другие опции.

- Целевая опция становится более привлекательной не потому, что её абсолютная ценность увеличилась

- Она теперь доминирует над большим числом альтернатив в пространстве выбора

- Эта контекстная переоценка отражается в усиленных RPE-сигналах

- Усиленные сигналы управляют обучением и будущими предпочтениями (S002)

Это означает, что нейронные системы оценки награды работают не как абсолютные счётчики, а как адаптивные компараторы, постоянно калибруя ожидания под текущий контекст выбора.

Доказательная база: что мы знаем о RPE с высокой степенью уверенности

🔬 Дофамин кодирует ошибку предсказания, а не саму награду

Дофаминергические нейроны VTA кодируют ошибку предсказания, а не абсолютную величину награды (S003, S007). Классические эксперименты Шульца показали: при первом неожиданном соке нейроны демонстрируют всплеск активности, но после обучения, когда сок становится предсказуемым, всплеск исчезает.

Вместо реакции на саму награду нейроны начинают реагировать на условный стимул, предсказывающий сок. Если ожидаемая награда не приходит, наблюдается подавление активности ниже базового уровня — отрицательная ошибка предсказания (S003). Этот паттерн точно соответствует математическому определению RPE и воспроизведен в десятках лабораторий.

Дофамин реагирует на разницу между ожиданием и реальностью, а не на саму реальность. Полностью предсказуемая награда не вызывает дофаминергического ответа.

📊 Вентральный стриатум как вычислительный хаб для RPE

BOLD-сигнал в вентральном стриатуме, особенно в nucleus accumbens, коррелирует с вычисленными ошибками предсказания из поведенческих моделей (S008). Мета-анализы показывают активацию этой области при положительных RPE в широком диапазоне задач — от условных рефлексов до сложных экономических решений.

Критически: активация специфична для RPE, а не для награды как таковой. Она сильнее для неожиданных наград, чем для ожидаемых, даже если абсолютная величина награды идентична (S008). Индивидуальные различия в силе этих сигналов коррелируют с импульсивностью и склонностью к риску.

- Вентральный стриатум активируется при положительных ошибках предсказания

- Активация зависит от неожиданности, а не от размера награды

- Индивидуальные различия в активации предсказывают поведенческие черты

🧾 Reward Positivity (RewP) как электрофизиологический маркер RPE

Компонент reward positivity в ЭЭГ демонстрирует чувствительность к ошибкам предсказания награды (S003). RewP — положительное отклонение потенциала, возникающее через 250–350 мс после обратной связи, с максимумом в центральных электродах.

Амплитуда RewP больше для положительных результатов, чем для отрицательных, и критически — она чувствительна к ожиданиям: разница между выигрышем и проигрышем больше, когда результат неожиданный (S003). Однако существует дебат: отражает ли RewP именно reward prediction error или более общий salience prediction error — отклонение от ожидания независимо от валентности.

🔎 RPE в аверсивном обучении: расширение за пределы награды

Аналогичные механизмы работают для аверсивных стимулов (S001). После безусловных аверсивных стимулов (неприятные звуки, электрические шоки) наблюдаются нейронные сигналы, соответствующие ошибкам предсказания наказания.

Когда аверсивный стимул хуже ожидаемого, генерируется отрицательная ошибка предсказания. Эти сигналы используют для обучения избеганию и формирования защитных реакций. Нейронные субстраты частично перекрываются с системами обработки наград, но включают специфические структуры: амигдалу и периакведуктальное серое вещество. Подробнее — в разделе Теория относительности.

| Тип стимула | Положительная RPE | Отрицательная RPE | Нейронные структуры |

|---|---|---|---|

| Награда | Лучше ожидаемого | Хуже ожидаемого | VTA, nucleus accumbens |

| Наказание | Менее суровое, чем ожидалось | Более суровое, чем ожидалось | Амигдала, периакведуктальное серое |

⚙️ Value-free teaching signals: новая парадигма понимания дофамина

Исследование в Nature бросает вызов традиционному представлению о дофамине как сигнале ценности (S007). Дофаминергические ошибки предсказания действия (action prediction errors) могут служить обучающими сигналами, свободными от ценности.

Дофаминергические нейроны реагировали на несоответствие между ожидаемым и фактическим действием независимо от того, приводило ли это действие к награде или наказанию (S007). Это предполагает, что дофаминергическая система кодирует более абстрактные ошибки предсказания — не только «насколько хорош результат», но и «насколько точна моя модель мира».

Дофамин может сигнализировать об ошибке в предсказании действия, независимо от того, хорошее или плохое это действие. Это расширяет понимание дофамина за пределы системы вознаграждения.

Механизмы и причинность: что на самом деле вызывает изменения в поведении

🧬 Синаптическая пластичность как посредник между RPE и обучением

RPE-сигналы не изменяют поведение напрямую — они модулируют синаптическую пластичность в целевых структурах (S005). Дофамин действует как нейромодулятор, изменяя эффективность синаптической передачи в стриатуме.

Положительные RPE усиливают синапсы через долговременную потенциацию (LTP), отрицательные ослабляют через долговременную депрессию (LTD). Этот процесс — dopamine-modulated spike-timing-dependent plasticity — обеспечивает причинную связь между RPE-сигналами и изменениями в поведенческой политике (S005).

Пластичность зависит от совпадения во времени трёх факторов: пресинаптической активности, постсинаптической активности и дофаминергического сигнала. Без этого триплета синапс не меняется.

🔁 Корреляция vs причинность: оптогенетические доказательства

Корреляция между дофаминергической активностью и обучением не доказывает причинность. Оптогенетика позволила проверить это напрямую (S007).

Искусственная активация дофаминергических нейронов VTA в момент действия усиливала это действие в будущем, даже без реальной награды. Подавление дофамина в момент получения награды блокировало обучение. Дофаминергические RPE-сигналы не просто коррелируют с обучением — они необходимы и достаточны для его возникновения (S007).

- Активация дофамина → усиление действия (даже без награды)

- Подавление дофамина → блокировка обучения (несмотря на награду)

- Вывод: причинная роль дофамина доказана экспериментально

🧩 Конфаундеры: внимание, мотивация и когнитивный контроль

Интерпретация RPE-сигналов осложняется множественными конфаундерами. Внимание модулирует обработку наград: более заметные стимулы генерируют более сильные ответы независимо от RPE. Подробнее — в разделе Статистика и теория вероятностей.

Мотивационное состояние влияет на субъективную ценность: голодное животное оценивает пищу выше, что изменяет базовые ожидания и RPE. Когнитивный контроль и рабочая память позволяют поддерживать сложные ожидания, которые могут не соответствовать простым моделям TD-learning (S005).

| Конфаундер | Механизм влияния | Как контролировать |

|---|---|---|

| Внимание | Усиливает нейронный ответ на заметные стимулы | Уравнять сложность стимулов; измерить внимание отдельно |

| Мотивация | Меняет субъективную ценность награды | Стандартизировать состояние (голод, жажда); варьировать награды |

| Когнитивный контроль | Позволяет строить сложные ожидания | Использовать простые задачи; измерять рабочую память |

Индивидуальные различия в этих процессах создают вариабельность в RPE-сигналах, не связанную с базовым механизмом обучения (S008).

🔬 Двойная диссоциация: model-free vs model-based learning

RPE-based learning (model-free) — не единственная система обучения. Параллельно существует model-based система, которая использует явную модель структуры среды для планирования (S005).

После изменения структуры вознаграждения model-based система адаптируется немедленно, в то время как model-free требует повторного опыта. Нейровизуализация показывает частичную диссоциацию: вентральный стриатум связан с model-free RPE, дорсолатеральная префронтальная кора и интрапариетальная борозда — с model-based вычислениями (S005).

- Model-free система

- Обучается через RPE; медленная адаптация к новым условиям; вентральный стриатум.

- Model-based система

- Использует явную модель среды; быстрая адаптация; префронтальная кора.

- Реальное поведение

- Комбинация обеих стратегий; усложняет интерпретацию нейронных сигналов.

Поведение в реальных задачах часто представляет собой взвешенную комбинацию обеих систем, что требует более сложных моделей для объяснения наблюдаемых паттернов активности.

Конфликты в данных: где источники расходятся и почему это важно

🧩 Reward vs Salience Prediction Error: нерешенный спор

Существует фундаментальный дебат о том, что именно кодируют дофаминергические нейроны. Традиционная интерпретация: дофамин кодирует reward prediction error — отклонение от ожидаемой ценности результата (S001). Альтернативная гипотеза: дофамин кодирует salience prediction error — отклонение от ожидаемой заметности события, независимо от его валентности.

Исследование reward positivity показывает, что этот компонент может отражать скорее salience, чем специфически reward. Проблема в том, что в большинстве экспериментов эти два сигнала коррелируют: значимые события часто приносят награду, а наказание — значимо и негативно. Подробнее — в разделе Логические ошибки.

Когда переменные идеально коррелируют в лабораторных условиях, невозможно разделить их вклад в нейронный ответ. Это не ошибка экспериментаторов — это фундаментальная проблема дизайна.

Контекстная модуляция: усиление или переопределение?

Эффект привлекательности демонстрирует, что контекст модулирует RPE-сигнал (S002). Но механизм остаётся спорным: усиливает ли контекст существующий RPE-код или переопределяет его логику целиком?

Некоторые исследования предполагают, что привлекательность переписывает ценность опции в реальном времени (S004). Другие данные указывают на параллельные каналы обработки: RPE остаётся неизменным, но его влияние на поведение модулируется отдельной системой значимости.

| Интерпретация | Предсказание | Статус |

|---|---|---|

| Контекст усиливает RPE | Амплитуда сигнала растёт с привлекательностью | Подтверждено в fMRI |

| Контекст переопределяет ценность | RPE вычисляется от новой базовой линии | Спорно; требует прямого тестирования |

| Параллельные каналы | RPE и salience независимы, но взаимодействуют поведенчески | Теоретически привлекательно, но сложно в тестировании |

Возрастные различия: норма или артефакт?

Данные о RPE в разных возрастных группах противоречивы. У подростков обнаружена усиленная реакция на reward prediction errors (S006), но интерпретация варьируется: это повышенная чувствительность к ошибкам или просто иная калибровка системы?

У пожилых людей RPE-сигнал ослабевает, но дофамин может восстанавливать эту функцию (S005). Вопрос: деградирует ли сам механизм RPE или меняется его нейрохимическая основа?

Возрастные различия могут отражать не разные версии одного механизма, а принципиально разные стратегии обучения на разных этапах жизни.

Единство или множественность?

Ключевой вопрос: кодируют ли все дофаминергические нейроны один и тот же RPE-сигнал или существуют субпопуляции с разными функциями? (S007) предполагает общую функцию, но (S008) показывает, что аксиоматическое моделирование выявляет отклонения от классической RPE-гипотезы.

Если нейроны специализированы, то «ошибка предсказания награды» — это не единый механизм, а семейство связанных процессов. Это меняет всю логику интерпретации данных.

- Почему это важно для когнитивной иммунологии

- Если RPE — не универсальный код, то манипуляция контекстом работает не через единый «рычаг», а через множество параллельных каналов. Это усложняет защиту от когнитивных ловушек, но и открывает новые точки вмешательства.