Qué es el error de predicción de recompensa: cuando el cerebro calcula la diferencia entre «esperaba» y «obtuve»

El Reward prediction error (RPE) es un mecanismo computacional fundamental que opera en tu cerebro ahora mismo. Matemáticamente: RPE = Recompensa real − Recompensa esperada (S003, S005).

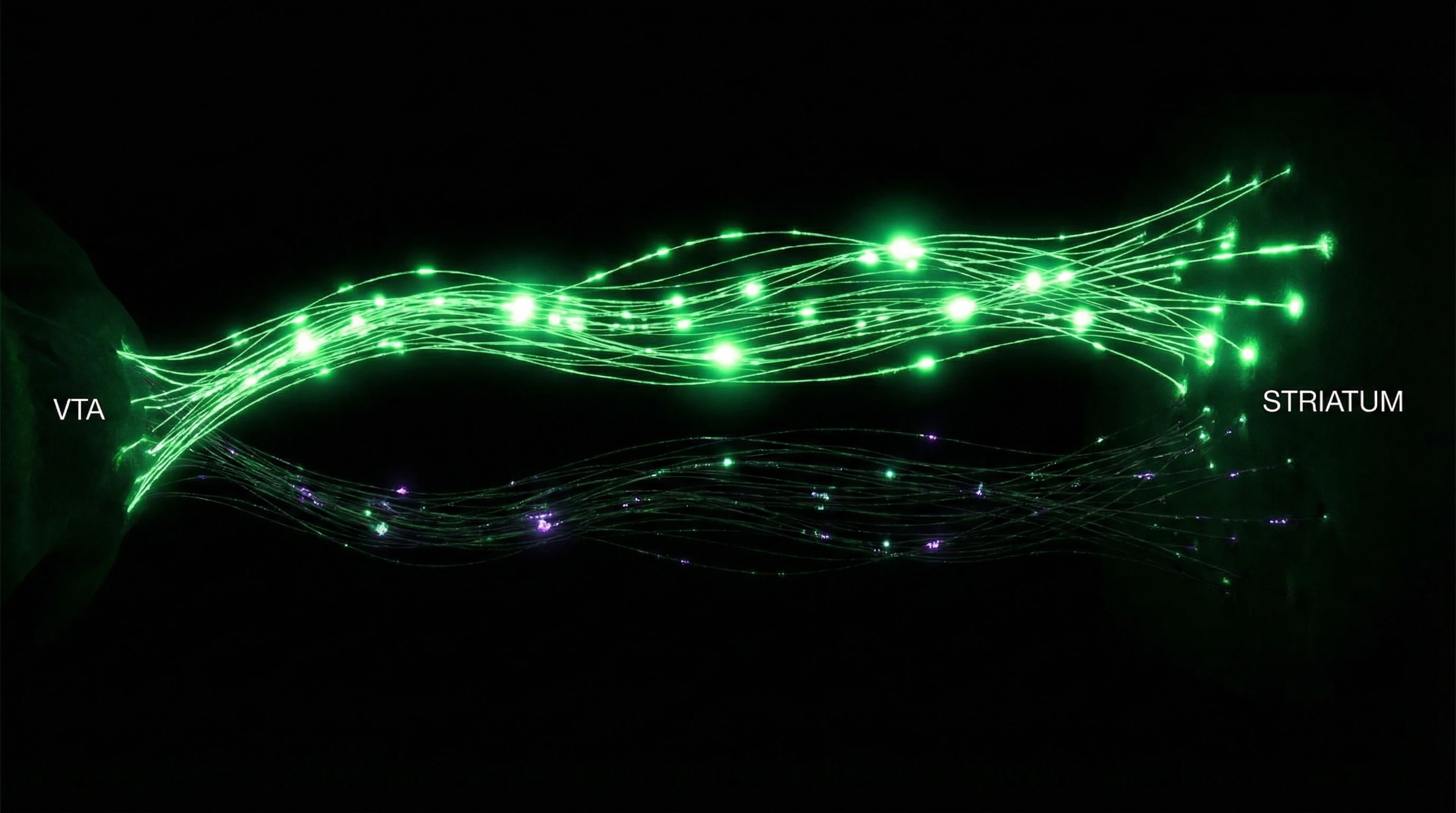

Error positivo — obtuviste más de lo esperado. Negativo — menos. Esta señal es codificada por neuronas dopaminérgicas del área tegmental ventral (VTA) y transmitida al estriado, donde sirve como base para el aprendizaje por refuerzo (S007).

- Neuronas dopaminérgicas del VTA

- Aumentan la frecuencia de descarga ante error positivo, la reducen ante error negativo. Codifican no la recompensa en sí, sino la desviación de la expectativa (S003).

- Nucleus accumbens

- Recibe proyecciones del VTA y modula la plasticidad sináptica. Una misma recompensa genera respuestas dopaminérgicas diferentes según su predictibilidad.

Signed vs Unsigned RPE: dirección contra magnitud

Las investigaciones actuales distinguen dos tipos de errores de predicción (S004).

| Tipo de RPE | Qué codifica | Función |

|---|---|---|

| Signed RPE | Dirección del error (mejor/peor de lo esperado) | Evaluación de resultados, refuerzo del comportamiento |

| Unsigned RPE | Magnitud absoluta de la desviación | Procesamiento de incertidumbre, actualización del modelo del mundo |

Estudios con EEG muestran que estos dos tipos de señales son procesados por sistemas neuronales parcialmente independientes. El Unsigned RPE está vinculado al monitoreo metacognitivo de la precisión de las predicciones.

Temporal Difference Learning: cómo el RPE actualiza expectativas en el tiempo

El RPE está integrado en el algoritmo de temporal difference (TD) learning, donde las predicciones se actualizan en cada paso temporal, no solo tras el resultado final (S005).

Cuando ves una señal que predice recompensa (el timbre antes de la entrega de comida), las neuronas dopaminérgicas comienzan a reaccionar a esa señal, no a la recompensa misma. El error de predicción «migra» hacia atrás en el tiempo hasta el predictor más temprano. Más detalles en la sección Termodinámica.

- La respuesta dopaminérgica se desplaza de la recompensa a las señales contextuales que la preceden

- Los estímulos condicionados adquieren fuerza motivacional

- Las dependencias se vuelven resistentes — el cerebro reacciona al contexto, no a la sustancia

Este mecanismo explica por qué la ruptura de una relación activa los mismos mecanismos de duelo que la pérdida de una recompensa: el cerebro se acostumbró a predecir la presencia de la pareja y recibe un error de predicción negativo ante su ausencia.

Cinco argumentos a favor del papel central del EPR en el aprendizaje y la toma de decisiones

🔬 Argumento 1: Conservación del mecanismo entre especies

Los mecanismos de EPR se han encontrado en organismos desde las moscas de la fruta hasta los primates, lo que indica su importancia evolutiva fundamental (S005). En todas las especies estudiadas se observa una lógica similar: sistemas neuronales que utilizan neuromoduladores (dopamina en mamíferos, octopamina en insectos) codifican desviaciones de los resultados esperados y utilizan estas señales para modificar el comportamiento.

La conservación a través de cientos de millones de años de evolución demuestra que el EPR resuelve una tarea adaptativa crítica: aprendizaje eficiente en entornos cambiantes con recursos computacionales limitados.

📊 Argumento 2: Correspondencia directa entre actividad dopaminérgica y aprendizaje conductual

Los experimentos optogenéticos demuestran una relación causal: la estimulación artificial de neuronas dopaminérgicas en el momento de una acción aumenta la probabilidad de repetir esa acción, incluso en ausencia de recompensa real (S007). Lo contrario también es cierto: la supresión de la actividad dopaminérgica interrumpe el aprendizaje.

La magnitud de la respuesta dopaminérgica se correlaciona con la velocidad de aprendizaje: cuanto mayor es el error de predicción, más rápido se actualiza la política conductual (S005). Esta es una prueba directa de que el EPR no solo se correlaciona con el aprendizaje, sino que es su mecanismo causal.

🧠 Argumento 3: Eficiencia computacional del TD-learning

Desde la perspectiva del aprendizaje automático, los algoritmos basados en EPR (especialmente TD-learning) demuestran una relación óptima entre velocidad de aprendizaje y complejidad computacional (S005). A diferencia de los métodos que requieren un modelo completo del entorno, el aprendizaje basado en EPR funciona de forma incremental, actualizando estimaciones después de cada experiencia.

- Actualización incremental

- Permite a los organismos aprender en tiempo real sin necesidad de almacenar y procesar un historial completo de interacciones.

- Convergencia hacia la solución óptima

- El hecho de que los sistemas biológicos hayan convergido hacia una solución matemáticamente cercana a la óptima confirma el valor adaptativo de los mecanismos de EPR.

🔎 Argumento 4: Poder explicativo para fenómenos clínicos

El marco del EPR explica un amplio espectro de trastornos psiquiátricos y neurológicos (S008). En las adicciones se observa hipersensibilidad a señales que predicen la droga y una respuesta atenuada a recompensas naturales, un patrón consistente con la alteración de las señales de EPR.

En la depresión es característica la anhedonia y la capacidad reducida para aprender de resultados positivos, lo que corresponde a EPR positivos atenuados. En la esquizofrenia, la señalización dopaminérgica aberrante puede generar errores de predicción falsos, llevando a la formación de creencias delirantes (S008).

Un marco teórico unificado que explica fenómenos clínicos tan heterogéneos posee un alto poder explicativo.

🧪 Argumento 5: Convergencia de datos de múltiples metodologías

El papel del EPR está respaldado por datos de registros unicelulares en animales, fMRI en humanos, estudios de EEG/ERP, manipulaciones farmacológicas, investigaciones genéticas y modelado computacional (S004), (S005), (S003). Cuando métodos independientes con diferentes limitaciones y fuentes de error sistemático convergen hacia una misma conclusión, esto aumenta sustancialmente la confianza en su validez.

| Metodología | Qué mide | Resultado |

|---|---|---|

| Registros unicelulares | Actividad de neuronas dopaminérgicas individuales | Codificación del error de predicción en tiempo real |

| fMRI | Señal BOLD en el estriado ventral | Correlación con EPR calculados a partir de modelos conductuales |

| EEG/ERP | Componente reward positivity | Sensibilidad a la magnitud del error de predicción |

Efecto de atracción: cómo el contexto modifica los cálculos neuronales del RPE

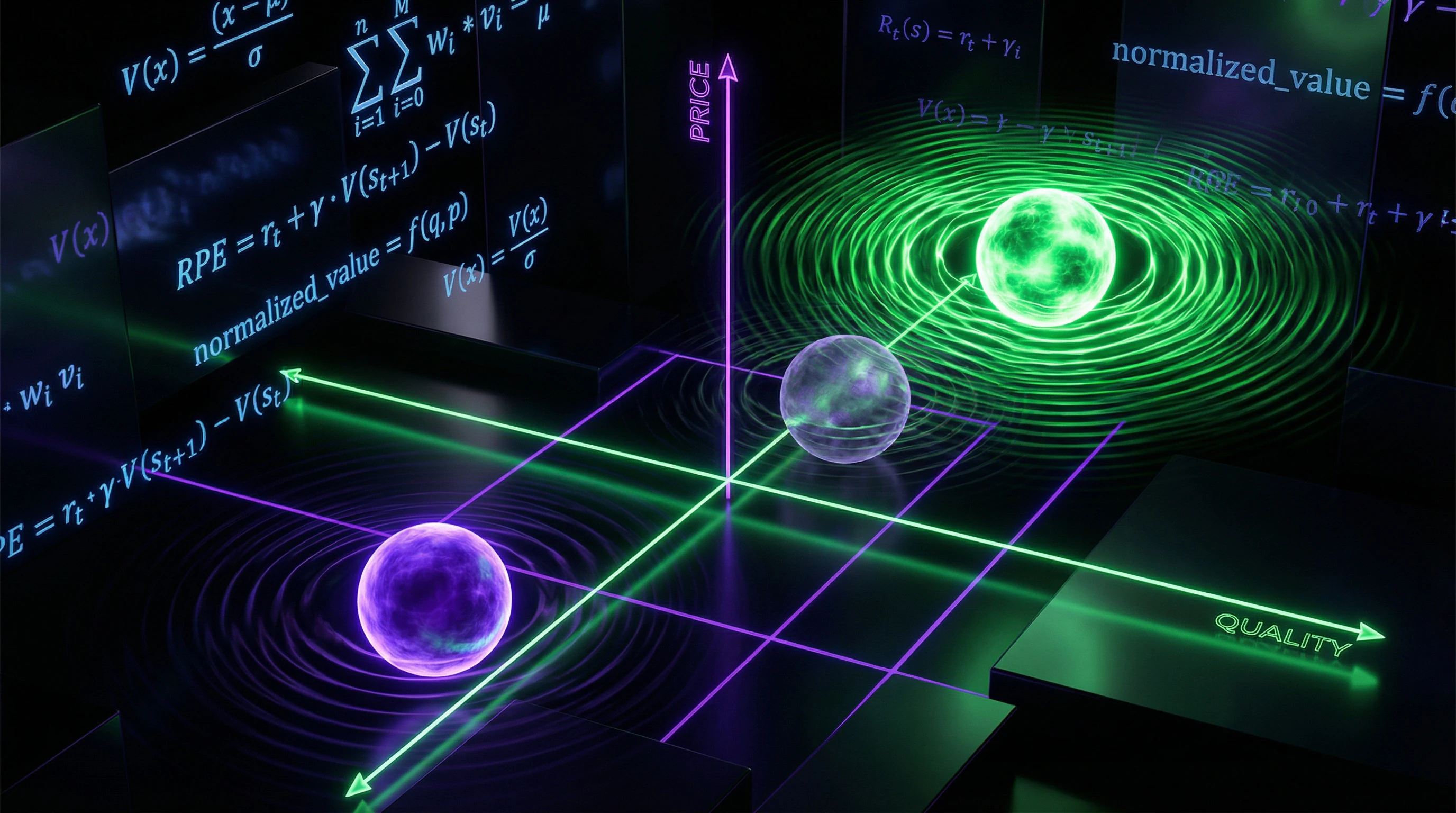

La teoría clásica del RPE asume que los errores de predicción se calculan basándose en valores absolutos de recompensas. Sin embargo, las investigaciones sobre el efecto de atracción (attraction effect) demuestran que el contexto de elección modula radicalmente estos cálculos (S001, S002).

El efecto de atracción surge cuando la adición de una tercera opción asimétricamente dominada (decoy) aumenta el atractivo de una de las dos opciones originales. Si eliges entre la opción A (alta calidad, precio alto) y la opción B (baja calidad, precio bajo), añadir la opción C (ligeramente peor que A en ambos parámetros) aumenta la probabilidad de elegir A, aunque el valor objetivo de A no haya cambiado. Más detalles en la sección Electromagnetismo.

🧬 Correlatos neuronales de la modulación contextual del RPE

Un estudio mediante fMRI mostró que el efecto de atracción modula las señales de RPE en el estriado ventral y la corteza prefrontal medial (S001, S002). Cuando los participantes tomaban decisiones en presencia de una opción decoy, las señales neuronales de RPE para la opción objetivo se intensificaban en comparación con el contexto sin decoy, incluso con resultados objetivos idénticos.

El cerebro calcula los errores de predicción no en unidades absolutas, sino en relación al contexto de elección. Esta modulación ocurre a nivel de las señales básicas de RPE, no solo en el nivel superior de toma de decisiones.

📊 Dinámica temporal: elección intertemporal bajo influencia contextual

El efecto de atracción influye en la elección intertemporal (intertemporal choice) — decisiones entre una recompensa inmediata menor y una recompensa diferida mayor (S001, S002). La presencia de una opción decoy modificaba no solo la elección en sí, sino también el descuento subjetivo de recompensas futuras.

| Condición | Descuento temporal | Señal RPE para recompensa diferida |

|---|---|---|

| Sin decoy | Alto (baja paciencia) | Débil |

| Con decoy | Bajo (alta paciencia) | Intensificada |

Los participantes demostraban menor descuento temporal (mayor «paciencia») para la opción objetivo en presencia del decoy. El cerebro generaba errores de predicción positivos más fuertes para recompensas diferidas en un contexto que las hacía más atractivas en relación a las alternativas.

⚙️ Mecanismo: normalización del valor en el contexto de elección

El mecanismo propuesto incluye la normalización del valor (divisive normalization) — un proceso mediante el cual el valor subjetivo de una opción se calcula en relación a la media o rango de opciones disponibles (S001). Cuando se añade un decoy al conjunto de elección, modifica el punto de referencia respecto al cual se evalúan las demás opciones.

- La opción objetivo se vuelve más atractiva no porque su valor absoluto haya aumentado

- Ahora domina sobre un mayor número de alternativas en el espacio de elección

- Esta reevaluación contextual se refleja en señales de RPE intensificadas

- Las señales intensificadas dirigen el aprendizaje y las preferencias futuras (S002)

Esto significa que los sistemas neuronales de evaluación de recompensas no funcionan como contadores absolutos, sino como comparadores adaptativos, calibrando constantemente las expectativas según el contexto actual de elección.

Base de evidencia: qué sabemos sobre RPE con alto grado de certeza

🔬 La dopamina codifica el error de predicción, no la recompensa en sí

Las neuronas dopaminérgicas del ATV codifican el error de predicción, no la magnitud absoluta de la recompensa (S003, S007). Los experimentos clásicos de Schultz demostraron: ante el primer zumo inesperado, las neuronas muestran un pico de actividad, pero tras el aprendizaje, cuando el zumo se vuelve predecible, el pico desaparece.

En lugar de reaccionar a la recompensa misma, las neuronas comienzan a responder al estímulo condicionado que predice el zumo. Si la recompensa esperada no llega, se observa una supresión de la actividad por debajo del nivel basal: un error de predicción negativo (S003). Este patrón corresponde exactamente a la definición matemática de RPE y ha sido reproducido en decenas de laboratorios.

La dopamina reacciona a la diferencia entre expectativa y realidad, no a la realidad misma. Una recompensa completamente predecible no genera respuesta dopaminérgica.

📊 El estriado ventral como centro computacional para RPE

La señal BOLD en el estriado ventral, especialmente en el nucleus accumbens, se correlaciona con los errores de predicción calculados a partir de modelos conductuales (S008). Los metaanálisis muestran activación de esta área ante RPE positivos en un amplio rango de tareas, desde reflejos condicionados hasta decisiones económicas complejas.

Críticamente: la activación es específica para RPE, no para la recompensa como tal. Es más intensa para recompensas inesperadas que para esperadas, incluso si la magnitud absoluta de la recompensa es idéntica (S008). Las diferencias individuales en la intensidad de estas señales se correlacionan con impulsividad y propensión al riesgo.

- El estriado ventral se activa ante errores de predicción positivos

- La activación depende de lo inesperado, no del tamaño de la recompensa

- Las diferencias individuales en activación predicen rasgos conductuales

🧾 Reward Positivity (RewP) como marcador electrofisiológico de RPE

El componente reward positivity en EEG demuestra sensibilidad a los errores de predicción de recompensa (S003). RewP es una desviación positiva del potencial que surge entre 250–350 ms después del feedback, con máximo en electrodos centrales.

La amplitud de RewP es mayor para resultados positivos que para negativos, y críticamente, es sensible a las expectativas: la diferencia entre ganar y perder es mayor cuando el resultado es inesperado (S003). Sin embargo, existe debate: ¿refleja RewP específicamente el reward prediction error o un salience prediction error más general, es decir, desviación de la expectativa independientemente de la valencia?

🔎 RPE en aprendizaje aversivo: expansión más allá de la recompensa

Mecanismos análogos funcionan para estímulos aversivos (S001). Tras estímulos aversivos incondicionados (sonidos desagradables, descargas eléctricas) se observan señales neuronales correspondientes a errores de predicción de castigo.

Cuando un estímulo aversivo es peor de lo esperado, se genera un error de predicción negativo. Estas señales se utilizan para aprender evitación y formar respuestas defensivas. Los sustratos neuronales se solapan parcialmente con los sistemas de procesamiento de recompensas, pero incluyen estructuras específicas: la amígdala y la sustancia gris periacueductal. Más detalles en la sección Teoría de la relatividad.

| Tipo de estímulo | RPE positivo | RPE negativo | Estructuras neuronales |

|---|---|---|---|

| Recompensa | Mejor de lo esperado | Peor de lo esperado | ATV, nucleus accumbens |

| Castigo | Menos severo de lo esperado | Más severo de lo esperado | Amígdala, sustancia gris periacueductal |

⚙️ Value-free teaching signals: nuevo paradigma de comprensión de la dopamina

Una investigación en Nature desafía la representación tradicional de la dopamina como señal de valor (S007). Los errores de predicción de acción dopaminérgicos (action prediction errors) pueden servir como señales de aprendizaje libres de valor.

Las neuronas dopaminérgicas reaccionaban a la discrepancia entre la acción esperada y la real, independientemente de si esa acción conducía a recompensa o castigo (S007). Esto sugiere que el sistema dopaminérgico codifica errores de predicción más abstractos: no solo "qué tan bueno es el resultado", sino también "qué tan preciso es mi modelo del mundo".

La dopamina puede señalizar un error en la predicción de la acción, independientemente de si esa acción es buena o mala. Esto amplía la comprensión de la dopamina más allá del sistema de recompensa.

Mecanismos y causalidad: qué causa realmente los cambios en el comportamiento

🧬 Plasticidad sináptica como mediador entre RPE y aprendizaje

Las señales RPE no cambian el comportamiento directamente — modulan la plasticidad sináptica en estructuras objetivo (S005). La dopamina actúa como neuromodulador, alterando la eficacia de la transmisión sináptica en el estriado.

Los RPE positivos fortalecen las sinapsis mediante potenciación a largo plazo (LTP), los negativos las debilitan mediante depresión a largo plazo (LTD). Este proceso — plasticidad dependiente del tiempo de disparo modulada por dopamina — proporciona el vínculo causal entre señales RPE y cambios en la política conductual (S005).

La plasticidad depende de la coincidencia temporal de tres factores: actividad presináptica, actividad postsináptica y señal dopaminérgica. Sin este triplete, la sinapsis no cambia.

🔁 Correlación vs causalidad: evidencia optogenética

La correlación entre actividad dopaminérgica y aprendizaje no prueba causalidad. La optogenética permitió verificar esto directamente (S007).

La activación artificial de neuronas dopaminérgicas del VTA en el momento de la acción reforzaba esa acción en el futuro, incluso sin recompensa real. La supresión de dopamina en el momento de recibir la recompensa bloqueaba el aprendizaje. Las señales RPE dopaminérgicas no solo correlacionan con el aprendizaje — son necesarias y suficientes para su aparición (S007).

- Activación de dopamina → refuerzo de la acción (incluso sin recompensa)

- Supresión de dopamina → bloqueo del aprendizaje (a pesar de la recompensa)

- Conclusión: el papel causal de la dopamina está probado experimentalmente

🧩 Confusores: atención, motivación y control cognitivo

La interpretación de señales RPE se complica por múltiples confusores. La atención modula el procesamiento de recompensas: estímulos más salientes generan respuestas más fuertes independientemente del RPE. Más detalles en la sección Estadística y teoría de probabilidades.

El estado motivacional influye en el valor subjetivo: un animal hambriento valora más la comida, lo que cambia las expectativas base y el RPE. El control cognitivo y la memoria de trabajo permiten mantener expectativas complejas que pueden no corresponder a modelos simples de TD-learning (S005).

| Confusor | Mecanismo de influencia | Cómo controlarlo |

|---|---|---|

| Atención | Amplifica la respuesta neuronal a estímulos salientes | Igualar complejidad de estímulos; medir atención por separado |

| Motivación | Cambia el valor subjetivo de la recompensa | Estandarizar estado (hambre, sed); variar recompensas |

| Control cognitivo | Permite construir expectativas complejas | Usar tareas simples; medir memoria de trabajo |

Las diferencias individuales en estos procesos crean variabilidad en las señales RPE no relacionada con el mecanismo básico de aprendizaje (S008).

🔬 Doble disociación: aprendizaje model-free vs model-based

El aprendizaje basado en RPE (model-free) no es el único sistema de aprendizaje. Paralelamente existe un sistema model-based que utiliza un modelo explícito de la estructura del entorno para planificar (S005).

Tras cambios en la estructura de recompensas, el sistema model-based se adapta inmediatamente, mientras que el model-free requiere experiencia repetida. La neuroimagen muestra disociación parcial: el estriado ventral está vinculado al RPE model-free, la corteza prefrontal dorsolateral y el surco intraparietal a cálculos model-based (S005).

- Sistema model-free

- Aprende mediante RPE; adaptación lenta a nuevas condiciones; estriado ventral.

- Sistema model-based

- Utiliza modelo explícito del entorno; adaptación rápida; corteza prefrontal.

- Comportamiento real

- Combinación de ambas estrategias; complica la interpretación de señales neuronales.

El comportamiento en tareas reales a menudo representa una combinación ponderada de ambos sistemas, lo que requiere modelos más complejos para explicar los patrones de actividad observados.

Conflictos en los datos: dónde divergen las fuentes y por qué es importante

🧩 Reward vs Salience Prediction Error: un debate sin resolver

Existe un debate fundamental sobre qué codifican exactamente las neuronas dopaminérgicas. La interpretación tradicional: la dopamina codifica el reward prediction error — la desviación del valor esperado del resultado (S001). La hipótesis alternativa: la dopamina codifica el salience prediction error — la desviación de la prominencia esperada del evento, independientemente de su valencia.

La investigación sobre reward positivity muestra que este componente puede reflejar más bien salience que específicamente reward. El problema es que en la mayoría de los experimentos estas dos señales correlacionan: los eventos significativos a menudo traen recompensa, y el castigo es significativo y negativo. Más detalles en la sección Falacias lógicas.

Cuando las variables correlacionan perfectamente en condiciones de laboratorio, es imposible separar su contribución a la respuesta neuronal. Esto no es un error de los experimentadores — es un problema fundamental de diseño.

Modulación contextual: ¿amplificación o redefinición?

El efecto de atractivo demuestra que el contexto modula la señal RPE (S002). Pero el mecanismo sigue siendo controvertido: ¿amplifica el contexto el código RPE existente o redefine completamente su lógica?

Algunos estudios sugieren que el atractivo reescribe el valor de la opción en tiempo real (S004). Otros datos apuntan a canales paralelos de procesamiento: el RPE permanece inalterado, pero su influencia en el comportamiento es modulada por un sistema de prominencia separado.

| Interpretación | Predicción | Estado |

|---|---|---|

| El contexto amplifica el RPE | La amplitud de la señal aumenta con el atractivo | Confirmado en fMRI |

| El contexto redefine el valor | El RPE se calcula desde una nueva línea base | Controvertido; requiere pruebas directas |

| Canales paralelos | RPE y salience son independientes, pero interactúan conductualmente | Teóricamente atractivo, pero difícil de probar |

Diferencias por edad: ¿norma o artefacto?

Los datos sobre RPE en diferentes grupos de edad son contradictorios. En adolescentes se ha encontrado una respuesta amplificada a los reward prediction errors (S006), pero la interpretación varía: ¿es una mayor sensibilidad a los errores o simplemente una calibración diferente del sistema?

En personas mayores la señal RPE se debilita, pero la dopamina puede restaurar esta función (S005). La pregunta: ¿se degrada el mecanismo RPE en sí o cambia su base neuroquímica?

Las diferencias por edad pueden reflejar no versiones diferentes de un mismo mecanismo, sino estrategias de aprendizaje fundamentalmente distintas en diferentes etapas de la vida.

¿Unidad o multiplicidad?

La pregunta clave: ¿codifican todas las neuronas dopaminérgicas la misma señal RPE o existen subpoblaciones con funciones diferentes? (S007) sugiere una función común, pero (S008) muestra que el modelado axiomático revela desviaciones de la hipótesis clásica del RPE.

Si las neuronas están especializadas, entonces el "error de predicción de recompensa" no es un mecanismo único, sino una familia de procesos relacionados. Esto cambia toda la lógica de interpretación de los datos.

- Por qué es importante para la inmunología cognitiva

- Si el RPE no es un código universal, entonces la manipulación del contexto no funciona a través de una única "palanca", sino a través de múltiples canales paralelos. Esto complica la defensa contra las trampas cognitivas, pero también abre nuevos puntos de intervención.