🧠 Neurociencia

🧠 NeurocienciaEl estándar de oro en la síntesis de evidencia científica en medicinaλ

Las revisiones sistemáticas y los metaanálisis representan el nivel más alto de evidencia científica, integrando resultados de múltiples estudios mediante protocolos transparentes y reproducibles para obtener recomendaciones clínicas fiables.

Overview

Las revisiones sistemáticas y los metaanálisis son herramientas fundamentales de la medicina basada en la evidencia, que permiten identificar, seleccionar, evaluar críticamente y sintetizar de forma sistemática todos los estudios relevantes sobre una cuestión específica. A diferencia de las revisiones narrativas, siguen protocolos predeterminados, minimizando los sesgos sistemáticos y garantizando la reproducibilidad de los resultados. El metaanálisis como método estadístico combina datos cuantitativos de estudios independientes, aumentando la potencia estadística y resolviendo contradicciones entre trabajos individuales. Los estándares actuales, como PRISMA 2020, garantizan la transparencia y exhaustividad del reporte en todas las etapas de la revisión.

🛡️ Protocolo Laplace: La calidad de un metaanálisis está determinada por la calidad de los estudios incluidos: combinar trabajos débiles no genera evidencia sólida. La evaluación crítica de la metodología, el análisis de heterogeneidad y los sesgos de publicación son obligatorios para una interpretación correcta de los resultados.

Reference Protocol

Base Científica

Marco basado en evidencia para análisis crítico

Navigation Matrix

Subsecciones

[abiogenesis]

Abiogénesis

Teoría científica sobre el origen natural de la vida a partir de compuestos químicos simples hace más de 3.500 millones de años mediante evolución química gradual

Explorar

[cell-biology]

Biología celular

La célula es la unidad viva más pequeña que contiene todas las moléculas de la vida. Desde organismos unicelulares hasta los billones de células del cuerpo humano: estudiamos la estructura, funciones y comportamiento de la base de todo lo vivo.

Explorar

[evolution-genetics]

Evolución y genética

La evolución biológica es el proceso de desarrollo y cambio de la naturaleza viva a lo largo de millones de años, gracias al cual surgió toda la diversidad de vida en nuestro planeta.

Explorar

[neuroscience]

Neurociencia

Ciencia interdisciplinaria que estudia la estructura, funciones y desarrollo del sistema nervioso, desde los mecanismos moleculares hasta el comportamiento y la cognición humana.

Explorar

Protocol: Evaluation

Ponte a Prueba

Cuestionarios sobre este tema próximamente

Sector L1

Artículos

Materiales de investigación, ensayos y profundizaciones en los mecanismos del pensamiento crítico.

🧠 Neurociencia

🧠 Neurociencia 🧬 Evolución y genética

🧬 Evolución y genética 🧠 Neurociencia

🧠 Neurociencia 🧬 Evolución y genética

🧬 Evolución y genética 🧬 Evolución y genética

🧬 Evolución y genética 🧬 Evolución y genética

🧬 Evolución y genética 🧠 Neurociencia

🧠 Neurociencia 🧬 Evolución y genética

🧬 Evolución y genética 🧠 Neurociencia

🧠 Neurociencia 🧠 Neurociencia

🧠 Neurociencia 🧠 Neurociencia

🧠 Neurociencia 🧬 Evolución y genética

🧬 Evolución y genética⚡

Más Información

Metodología de revisiones sistemáticas: del caos bibliográfico al protocolo reproducible

Las revisiones sistemáticas constituyen el nivel más alto en la jerarquía de evidencia científica. Se distinguen de las revisiones narrativas por su metodología rigurosa: registro prospectivo del protocolo, búsqueda exhaustiva en múltiples bases de datos, documentación transparente de cada decisión.

La diferencia clave: minimización de sesgos sistemáticos mediante criterios explícitos de inclusión y exclusión establecidos antes de iniciar la búsqueda. Esto previene la selección subjetiva de fuentes, inevitable en las revisiones bibliográficas tradicionales.

Protocolos y registro: PRISMA-P como salvaguarda contra manipulaciones post hoc

El registro prospectivo del protocolo en registros como PROSPERO es un mecanismo crítico para prevenir el reporte selectivo. PRISMA-P 2015 proporciona una lista de verificación de 17 puntos para desarrollar el protocolo antes de iniciar la revisión: pregunta de investigación, criterios de selección, estrategia de búsqueda, métodos de síntesis.

El registro crea un rastro público de las intenciones de los investigadores, imposibilitando cambios ocultos en los resultados primarios o criterios de inclusión tras conocer los hallazgos.

PRISMA 2020 amplió la lista a 27 puntos: requisitos específicos para resúmenes, diagramas de flujo, enmiendas al protocolo, evaluación de certeza de la evidencia y transparencia en la financiación. El cumplimiento de PRISMA no garantiza calidad, pero asegura transparencia mínima para la evaluación crítica del rigor metodológico.

Estrategias de búsqueda: desde el inicio hasta el último byte

Una estrategia de búsqueda integral requiere cobertura sistemática de múltiples bases de datos. Un protocolo típico incluye CENTRAL, MEDLINE y Embase con búsqueda desde la creación de la base hasta una fecha determinada.

- Transparencia de términos de búsqueda

- Cadenas de búsqueda completas para cada base de datos, operadores booleanos, filtros: todo debe publicarse para garantizar reproducibilidad.

- Búsqueda ampliada

- Revisión manual de listas de referencias de artículos clave, contacto con expertos, búsqueda de datos no publicados para minimizar el sesgo de publicación.

La búsqueda sistemática trasciende las bases de datos electrónicas. Es un enfoque combinado donde cada fuente se documenta y justifica en el protocolo.

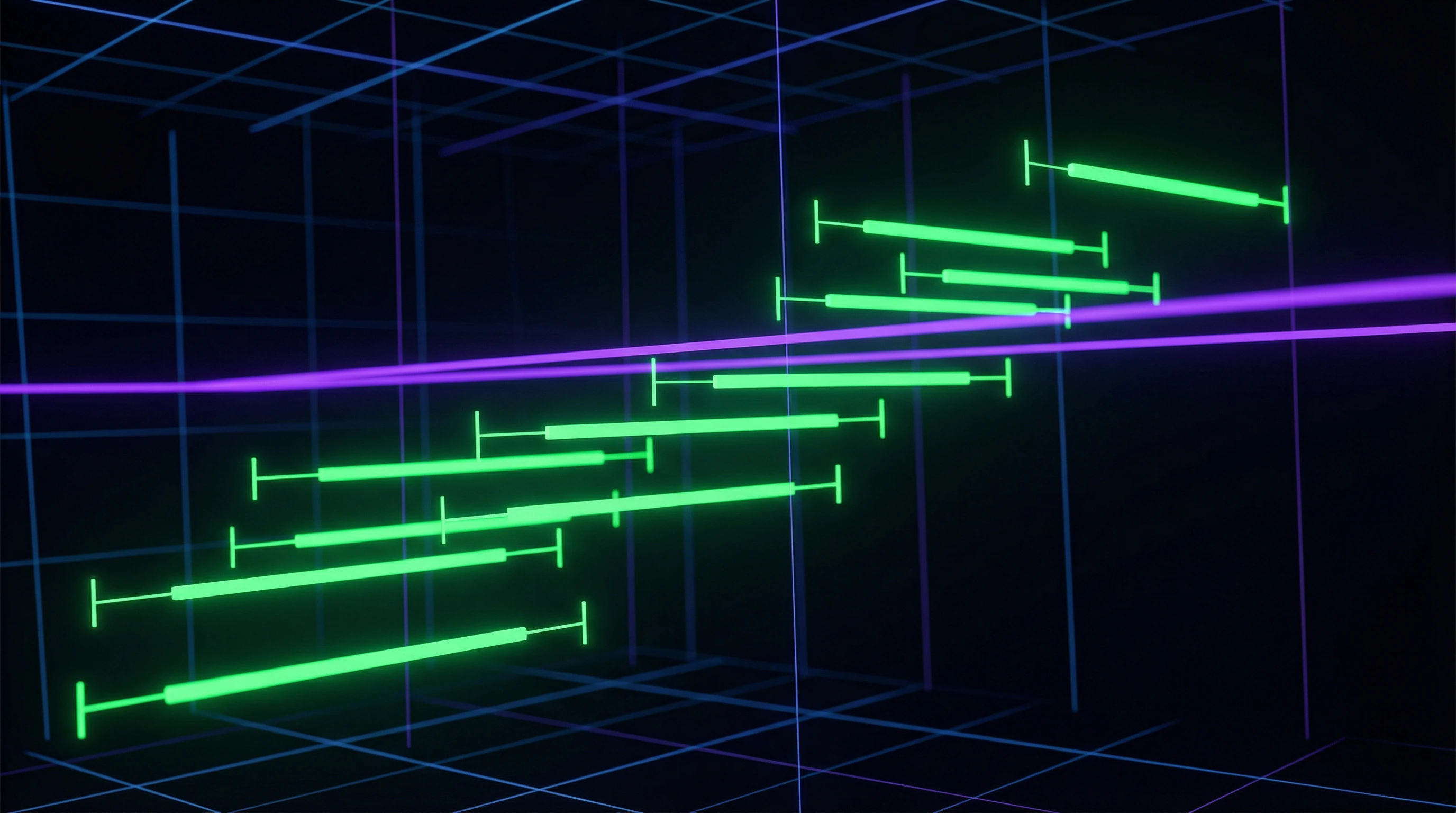

Meta-análisis y síntesis estadística: cuando las cifras hablan más que las palabras

El meta-análisis es una técnica estadística que combina datos cuantitativos de múltiples estudios independientes para obtener una estimación única del efecto con mayor poder estadístico. A diferencia de la revisión sistemática, que puede ser cualitativa, el meta-análisis es siempre cuantitativo y requiere datos numéricos aptos para la agrupación estadística.

Ventaja crítica: resolver incertidumbres cuando estudios individuales se contradicen entre sí, y detectar efectos imperceptibles en muestras pequeñas.

Modelos de efectos fijos y aleatorios: la filosofía de la variabilidad

El modelo de efecto fijo asume que todos los estudios incluidos estiman un único efecto verdadero, y las diferencias entre ellos se deben únicamente al error aleatorio de muestreo. El modelo de efectos aleatorios admite que el efecto verdadero varía entre estudios debido a diferencias en poblaciones, intervenciones o diseño.

| Modelo | Supuesto | Intervalo de confianza |

|---|---|---|

| Efecto fijo | Un único efecto verdadero; variación = error aleatorio | Más estrecho con heterogeneidad |

| Efectos aleatorios | El efecto verdadero varía entre estudios | Más amplio; refleja incertidumbre adicional |

El meta-análisis de la relación entre IMC y riesgo de cáncer de mama reveló efectos opuestos al estratificar por estado menopáusico: aumento del riesgo en mujeres posmenopáusicas y reducción en premenopáusicas. El estudio de educación neurocientífica sobre dolor mostró que la duración de la intervención influye significativamente en el tamaño del efecto, explicando parte de la heterogeneidad entre estudios.

Heterogeneidad y sesgos de publicación: trabajo detectivesco con datos

El estadístico I² cuantifica la proporción de variabilidad entre estudios atribuible a heterogeneidad verdadera: valores de 25%, 50% y 75% se interpretan como heterogeneidad baja, moderada y alta respectivamente. La alta heterogeneidad no descalifica el meta-análisis, pero requiere investigación mediante análisis de subgrupos y moderadores.

- Identificar fuentes de variabilidad entre estudios

- Realizar análisis de sensibilidad excluyendo trabajos con alto riesgo de errores sistemáticos

- Verificar la robustez de las conclusiones respecto a la calidad metodológica

El sesgo de publicación surge cuando estudios con resultados positivos se publican con mayor frecuencia que aquellos con resultados negativos, distorsionando la estimación agrupada del efecto hacia la exageración. Los gráficos de embudo visualizan la asimetría en la distribución de tamaños de efecto, mientras que las pruebas estadísticas de Egger y Begg verifican formalmente la presencia de sesgo.

La inclusión de datos no publicados mediante contacto con investigadores y búsqueda en registros de ensayos clínicos mitiga parcialmente el sesgo de publicación, pero eliminarlo por completo es imposible.

Metanálisis en red: partida de ajedrez multidimensional de intervenciones

El metanálisis en red amplía el metanálisis tradicional por pares, permitiendo comparar simultáneamente múltiples intervenciones incluso en ausencia de comparaciones directas head-to-head entre todos los pares. La metodología utiliza tanto evidencia directa de estudios que comparan directamente dos intervenciones, como evidencia indirecta a través de un comparador común, creando una red coherente de comparaciones.

La ventaja crítica es la posibilidad de clasificar todas las intervenciones disponibles por eficacia y seguridad, informando decisiones clínicas en contextos de múltiples opciones terapéuticas.

Comparaciones indirectas y transitividad: lógica de inferencias transitivas

La comparación indirecta de intervenciones A y C a través de un comparador común B se basa en el supuesto de transitividad: si A supera a B, y B supera a C, entonces A debe superar a C. La validez de las comparaciones indirectas depende críticamente de la similitud de los estudios en cuanto a modificadores del efecto: características que pueden influir en la eficacia relativa de las intervenciones.

La violación de transitividad ocurre cuando los estudios que comparan A con B difieren sistemáticamente de los estudios que comparan B con C en población, dosificación o intervenciones concomitantes.

- Estadística de inconsistencia

- Verifica el supuesto de transitividad mediante la evaluación de la coherencia entre evidencia directa e indirecta. Una discrepancia significativa señala posibles violaciones.

- Análisis de sensibilidad

- Excluye nodos de la red con alto riesgo de violación de transitividad, verificando la robustez de la clasificación de intervenciones.

El protocolo RAIN (systematic Review and Artificial Intelligence Network meta-analysis) para COVID-19 demuestra la aplicación del metanálisis en red a una base de evidencia en rápida evolución con múltiples candidatos terapéuticos.

Clasificación de intervenciones: de probabilidades a decisiones clínicas

El metanálisis en red genera una clasificación probabilística de intervenciones mediante SUCRA (Surface Under the Cumulative Ranking curve): una métrica donde un valor del 100% indica la mayor probabilidad de ser la mejor intervención, y 0% la peor. La clasificación considera no solo las estimaciones puntuales del efecto, sino también la incertidumbre: una intervención con efecto moderado e intervalo de confianza estrecho puede clasificarse más alto que otra con mayor efecto pero intervalo amplio.

La intervención óptima en promedio para la red puede no ser óptima para un subgrupo específico de pacientes. La estratificación por características clínicas es crítica para traducir la clasificación en acción.

El metanálisis de terapias anti-VEGF para degeneración macular ilustra el valor clínico: la clasificación por eficacia y seguridad simultáneamente informa la elección entre aflibercept, ranibizumab y bevacizumab.

La integración de inteligencia artificial en el metanálisis en red, como se propone en el protocolo RAIN, automatiza la extracción de datos y la evaluación del riesgo de sesgos sistemáticos, acelerando la síntesis de evidencia en condiciones de pandemia. El estudio de inositol en SOP demuestra la importancia de la estratificación: el mio-inositol mostró superioridad sobre el D-quiro-inositol para resultados reproductivos, pero la combinación resultó óptima para parámetros metabólicos.

Estándares de reporte PRISMA 2020: del checklist a la transparencia de la síntesis

PRISMA 2020 — conjunto actualizado de recomendaciones que reemplazó la versión de 2009. El checklist de 27 puntos abarca todas las etapas: desde la formulación de la pregunta según la estructura PICO hasta la interpretación de resultados considerando las limitaciones.

Diferencia clave: requisitos ampliados para describir los métodos de búsqueda, evaluar la certeza de la evidencia y reportar la síntesis de datos. Esto aumenta la reproducibilidad y permite al lector verificar cada paso de la lógica de los autores.

Checklist de 27 puntos y diagramas de flujo de datos

El checklist está estructurado por secciones: título, resumen, introducción, métodos, resultados, discusión, financiamiento. Cada sección contiene requisitos específicos de reporte.

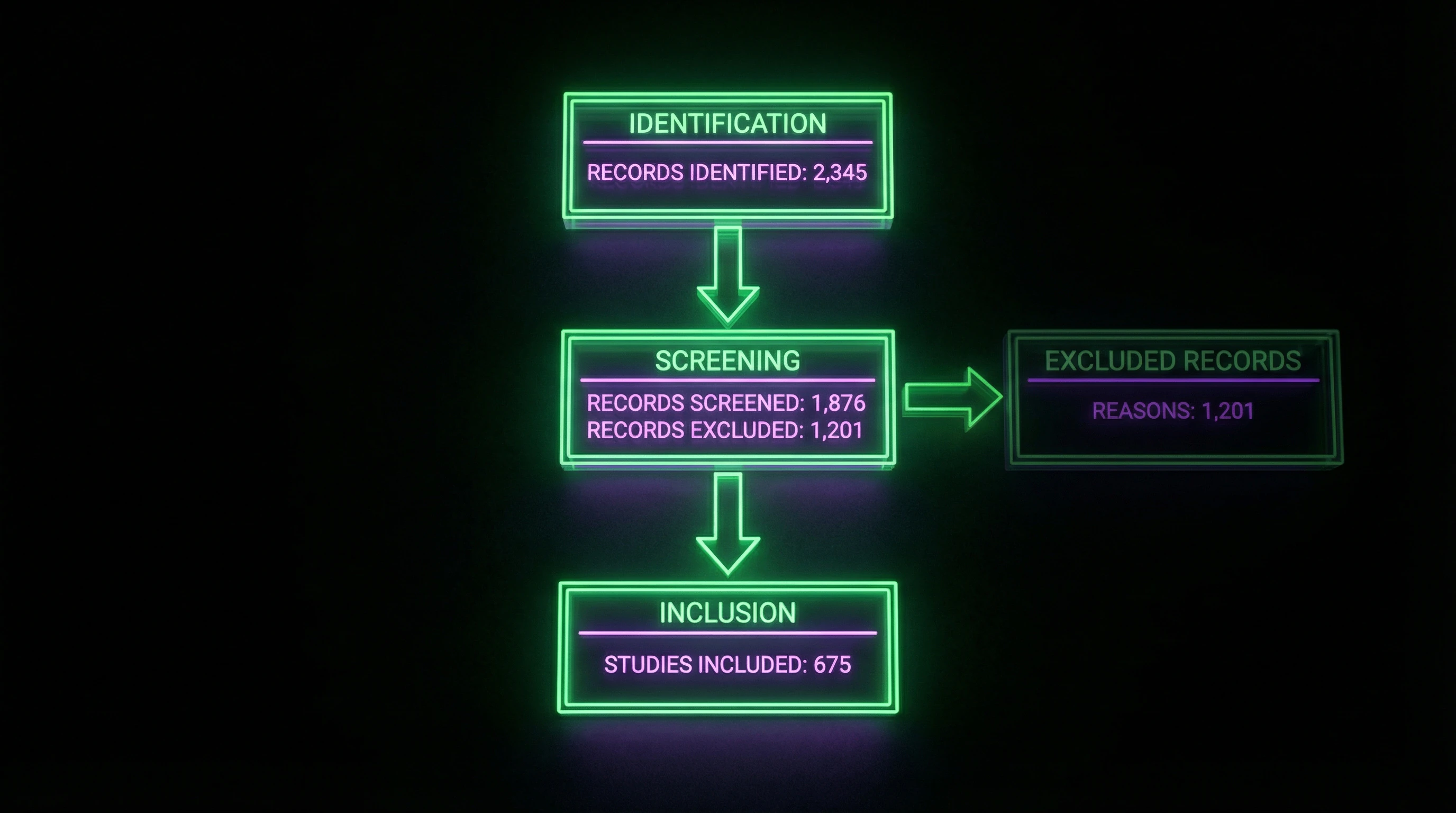

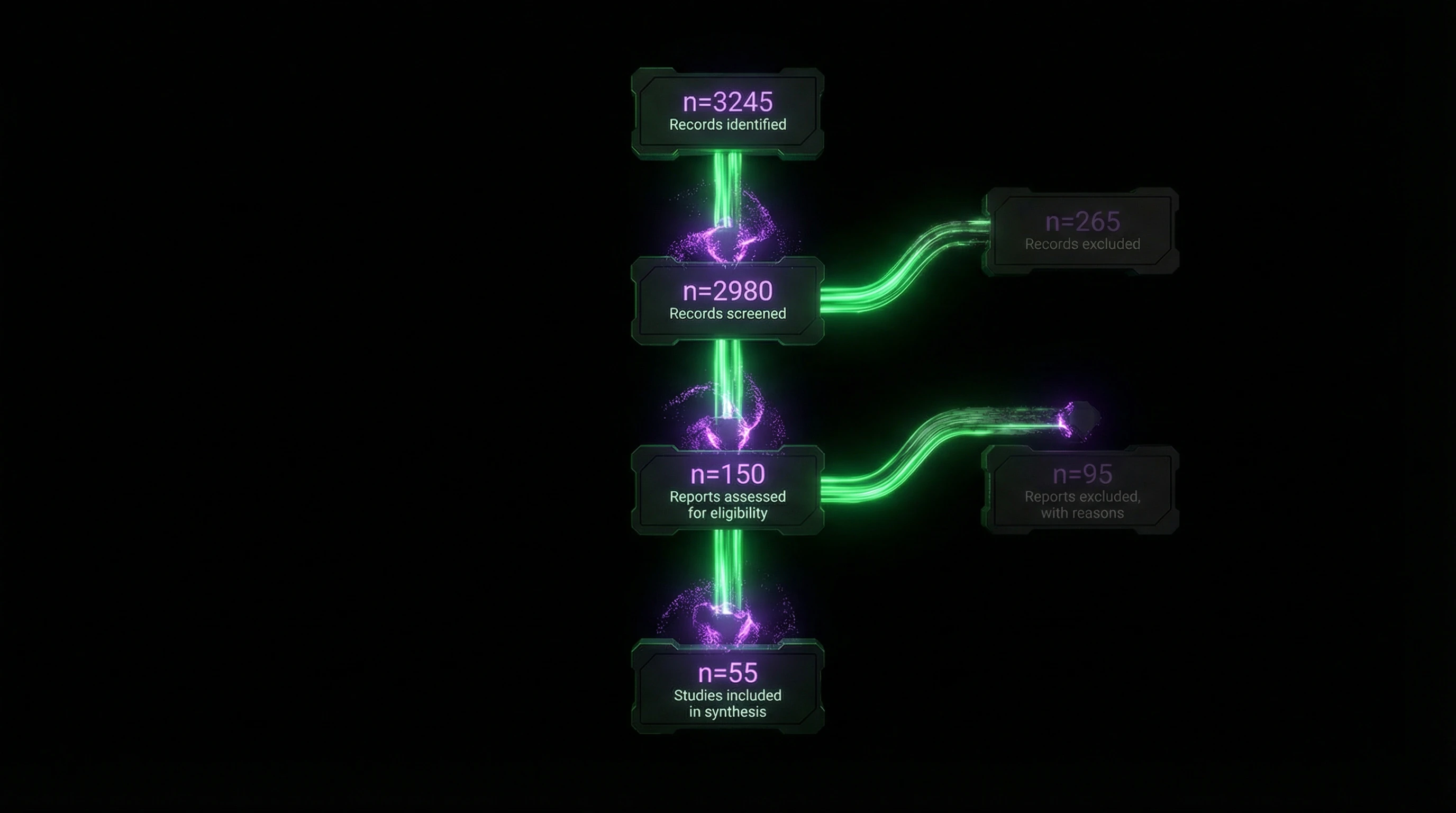

El diagrama de flujo visualiza el proceso de selección: número de registros identificados a través de bases de datos → excluidos en el cribado → evaluados para elegibilidad → finalmente incluidos en la síntesis. Ejemplo: una revisión sobre neurociencia del dolor comenzó con 6850 registros, pero solo 37 estudios cumplieron los criterios de inclusión.

El diagrama de flujo no es un adorno. Es un protocolo de verificación: el lector ve dónde y por qué se descartaron estudios, y puede evaluar si se perdieron trabajos relevantes.

Un checklist separado para resúmenes asegura una presentación breve pero completa de los elementos clave de la revisión en formato estructurado — crítico para el cribado rápido por parte del lector.

Diferencias con PRISMA 2009 y requisitos ampliados

PRISMA 2020 requiere las estrategias de búsqueda completas para todas las bases de datos y la fecha de la última búsqueda — esto no existía en 2009. Esto permite a otro investigador reproducir la búsqueda o actualizar la revisión.

- Evaluación del riesgo de sesgos

- Ahora es obligatorio especificar las herramientas y métodos utilizados para la evaluación crítica, con presentación de resultados para cada estudio incluido. En 2009 esto se describía a menudo de forma vaga.

- Certeza de la evidencia (GRADE)

- La nueva versión requiere indicación explícita del sistema de evaluación (por ejemplo, GRADE) y discusión de limitaciones a nivel de estudios individuales y de la revisión en su conjunto.

- PRISMA-P 2015

- Complementa el checklist principal con una guía de 17 puntos para protocolos. Enfatiza la importancia del registro previo de la metodología en bases como PROSPERO — esto previene el p-hacking y el reporte selectivo.

El registro del protocolo antes de iniciar la revisión no es burocracia. Es la garantía de que los autores no reescribieron los métodos a posteriori para ajustarlos a los resultados.

Evaluación del riesgo de sesgos sistemáticos: de las herramientas a la interpretación

La combinación de datos de baja calidad no produce evidencia de alta calidad. El riesgo de sesgos sistemáticos se evalúa en múltiples dominios: aleatorización, ocultamiento de la asignación, cegamiento de participantes y evaluadores de resultados, integridad de los datos y notificación selectiva.

En la revisión sobre educación en neurociencia del dolor, el 78% de los estudios presentaban alto riesgo de sesgos sistemáticos debido a la imposibilidad de cegamiento en intervenciones educativas. La documentación sistemática de la evaluación para cada estudio permite a los lectores juzgar la fiabilidad de las conclusiones.

Herramientas de evaluación crítica y dominios de riesgo

Cochrane Risk of Bias (RoB 2) estructura la evaluación de ensayos controlados aleatorizados en cinco dominios: proceso de aleatorización, desviaciones de las intervenciones planificadas, datos de resultados faltantes, medición de resultados y notificación selectiva.

| Herramienta | Tipo de estudios | Dominios clave |

|---|---|---|

| RoB 2 | Controlados aleatorizados | Aleatorización, cegamiento, integridad de datos, notificación selectiva |

| ROBINS-I | No aleatorizados | Distorsión de confusores, selección de participantes, clasificación de intervenciones |

Cada dominio se evalúa como riesgo bajo, moderado o alto basándose en preguntas señalizadoras, con una evaluación general que refleja el peor dominio. Para estudios no aleatorizados, ROBINS-I considera fuentes adicionales de sesgos sistemáticos.

Interpretación de resultados considerando la calidad metodológica

La alta heterogeneidad entre estudios a menudo se explica por diferencias en la calidad metodológica. El análisis de sensibilidad excluyendo estudios de alto riesgo revela si los efectos están sobreestimados.

En el metaanálisis sobre educación en neurociencia del dolor, el efecto sobre la intensidad del dolor se mantuvo solo al incluir estudios de bajo riesgo de sesgos sistemáticos, indicando una sobreestimación del efecto en estudios de baja calidad.

El sistema GRADE (Grading of Recommendations Assessment, Development and Evaluation) integra la evaluación del riesgo de sesgos sistemáticos con inconsistencia, evidencia indirecta, imprecisión y sesgos de publicación para determinar la certeza global de la evidencia.

- Evaluar el riesgo de sesgos sistemáticos por dominios (aleatorización, cegamiento, integridad de datos)

- Realizar análisis de sensibilidad excluyendo estudios de alto riesgo

- Aplicar GRADE para integrar la calidad con otros factores de incertidumbre

- Documentar limitaciones para clínicos y desarrolladores de guías

Aplicación práctica y limitaciones: de la estadística a la clínica

La significación estadística en el metaanálisis no siempre corresponde a la significación clínica. La combinación de muestras grandes puede revelar efectos mínimos sin valor práctico.

En una revisión sobre educación en neurociencia del dolor, la diferencia estandarizada de medias de −0,26 para la intensidad del dolor fue estadísticamente significativa, pero no alcanzó el umbral de diferencia mínima clínicamente importante de 1,5 puntos en una escala de 10 puntos.

La duración de la intervención influyó significativamente en el tamaño del efecto: los programas de más de 30 minutos mostraron una reducción clínicamente significativa del dolor, mientras que las intervenciones breves no lo hicieron.

Esto subraya la necesidad de interpretar los resultados en el contexto de las diferencias mínimas clínicamente importantes, específicas para cada resultado y población.

Significación clínica versus significación estadística

Los intervalos de confianza de las estimaciones del efecto combinado informan sobre la precisión y la interpretación clínica. Los intervalos amplios que cruzan el umbral de significación clínica indican incertidumbre sobre el valor práctico de la intervención.

En un metaanálisis en red sobre inositol en el síndrome de ovario poliquístico, el mio-inositol mostró una odds ratio de 2,38 (IC 95% 1,43–3,95) para la restauración de la ovulación en comparación con placebo, una mejora tanto estadística como clínicamente significativa.

| Resultado | Intervención | Efecto | Interpretación |

|---|---|---|---|

| Restauración de la ovulación | Mio-inositol vs placebo | OR 2,38 (IC 95% 1,43–3,95) | Estadística y clínicamente significativo |

| Resultados metabólicos | Mio- + D-quiro-inositol (40:1) | Superioridad confirmada | Requiere estratificación por tipos de resultados |

La heterogeneidad de los efectos entre subgrupos (I² > 50%) requiere cautela al generalizar los resultados y puede indicar la necesidad de un enfoque individualizado del tratamiento.

Papel de la inteligencia artificial en la automatización de la síntesis de evidencia

La integración de la inteligencia artificial en las revisiones sistemáticas automatiza etapas laboriosas: cribado de títulos y resúmenes, extracción de datos y evaluación del riesgo de sesgos sistemáticos. El aprendizaje automático puede reducir el tiempo de cribado en un 30–70% manteniendo una sensibilidad superior al 95%.

La automatización requiere validación: los algoritmos se entrenan con datos existentes y pueden reproducir sesgos sistemáticos de los conjuntos de entrenamiento u omitir estudios con terminología no estándar.

En un metaanálisis diagnóstico sobre identificación de glándulas paratiroides asistida por IA, la sensibilidad combinada fue del 93,8%, pero la heterogeneidad entre estudios (I² = 89%) indicaba variabilidad de los algoritmos y necesidad de estandarización.

- Las revisiones sistemáticas vivas, actualizadas continuamente mediante monitorización por IA de nuevas publicaciones, representan el futuro de la síntesis de evidencia en áreas de rápido desarrollo.

- Se requiere información transparente sobre el papel de la automatización en cada etapa del proceso.

- Crítico para la síntesis rápida de evidencia en condiciones de pandemia y otras situaciones de crisis.

Knowledge Access Protocol

FAQ

Preguntas Frecuentes

Una revisión sistemática es un estudio que utiliza métodos rigurosos y predefinidos para buscar, seleccionar y analizar todas las investigaciones relevantes sobre una pregunta específica. A diferencia de las revisiones narrativas, sigue protocolos claros (como PRISMA), minimiza la subjetividad y garantiza la reproducibilidad de los resultados. Esto convierte a las revisiones sistemáticas en el nivel más alto de evidencia en medicina.

Un metaanálisis es un método estadístico que combina datos cuantitativos de varios estudios independientes para obtener una estimación única del efecto. Aumenta el poder estadístico y ayuda a resolver contradicciones entre estudios individuales. Se aplica en medicina clínica, epidemiología y neurociencias para obtener conclusiones más precisas.

PRISMA 2020 es el estándar actualizado para reportar revisiones sistemáticas, que incluye una lista de verificación de 27 puntos, lista para resúmenes y diagramas de flujo. Reemplazó la versión de 2009 y garantiza transparencia, exhaustividad y reproducibilidad de las publicaciones. El cumplimiento de PRISMA mejora la calidad y confianza en los resultados de las revisiones.

No, las revisiones sistemáticas pueden contener sesgos sistemáticos a pesar de su metodología rigurosa. Los sesgos de publicación, la baja calidad de los estudios incluidos y la búsqueda incompleta de literatura pueden distorsionar las conclusiones. Por ello, la evaluación crítica del riesgo de sesgo y el análisis de sensibilidad son obligatorios para una interpretación correcta.

La alta heterogeneidad entre estudios requiere una interpretación cautelosa. Los análisis de moderadores y subgrupos ayudan a identificar fuentes de diferencias (como dosis, duración, características de la población). Si la heterogeneidad es inexplicable, combinar los datos puede ser incorrecto y conviene limitarse a una síntesis cualitativa.

El registro prospectivo del protocolo (por ejemplo, en PROSPERO) previene la publicación selectiva de resultados y cambios metodológicos a posteriori. Esto aumenta la transparencia y reduce el riesgo de manipulación de datos. PRISMA-P 2015 enfatiza la necesidad de desarrollar el protocolo antes de iniciar la revisión para garantizar el rigor científico.

Es necesario buscar sistemáticamente en múltiples bases de datos (MEDLINE, Embase, CENTRAL) desde su inicio hasta una fecha determinada. Las estrategias de búsqueda deben documentarse de forma transparente, incluyendo palabras clave y filtros. Adicionalmente, se revisan las listas de referencias de los artículos encontrados y la literatura gris para garantizar la exhaustividad.

Un metaanálisis en red permite comparar simultáneamente múltiples intervenciones, incluso en ausencia de comparaciones directas entre ellas. Utiliza comparaciones indirectas a través de un comparador común y permite jerarquizar tratamientos. Se aplica para optimizar la elección terapéutica cuando existen múltiples opciones disponibles.

Se utilizan herramientas estandarizadas de evaluación crítica para identificar limitaciones metodológicas (aleatorización, cegamiento, completitud de datos). La evaluación del riesgo de sesgo informa la interpretación de resultados y ayuda a determinar la fiabilidad de las conclusiones. Los estudios con alto riesgo pueden excluirse en análisis de sensibilidad.

El modelo de efectos fijos asume un único efecto verdadero en todos los estudios, mientras que el modelo de efectos aleatorios permite variabilidad de efectos entre estudios. En presencia de heterogeneidad, el modelo de efectos aleatorios es más conservador y proporciona intervalos de confianza más amplios. La elección del modelo depende de las pruebas estadísticas de heterogeneidad.

No, un metaanálisis no siempre equivale a un ECA grande. Combina datos con diferentes protocolos, poblaciones y calidad, lo que puede introducir errores sistemáticos. Un estudio grande bien diseñado suele ser preferible, especialmente cuando hay alta heterogeneidad o baja calidad de los datos disponibles.

No, la significación estadística no garantiza relevancia clínica. El gran tamaño muestral en un metaanálisis puede detectar efectos mínimos sin importancia práctica. Es necesario evaluar la magnitud del efecto, los intervalos de confianza y el contexto clínico para determinar el beneficio real.

La IA automatiza etapas laboriosas: cribado de títulos, extracción de datos, evaluación del riesgo de sesgo. Esto acelera el proceso y reduce errores humanos, pero requiere validación. Los ejemplos incluyen identificación asistida por IA de glándulas paratiroides y análisis automático de precisión diagnóstica.

El análisis de moderadores investiga cómo la magnitud del efecto depende de las características de los estudios (dosis, duración, población). Por ejemplo, el efecto de la educación en neurociencia del dolor puede variar según la duración de la intervención. Esto ayuda a optimizar las guías clínicas y comprender las fuentes de heterogeneidad.

Técnicamente es posible, pero requiere precaución debido a las diferencias en el riesgo de sesgo entre diseños (ECA vs observacionales). Generalmente es preferible combinar estudios del mismo tipo, y analizar diferentes diseños por separado o en subgrupos. La mezcla puede aumentar la heterogeneidad y dificultar la interpretación.

El sesgo de publicación (publicación preferencial de resultados positivos) puede sobrestimar los efectos. Se utilizan gráficos en embudo, pruebas de Egger y métodos de corrección (trim-and-fill). Ante sesgo significativo, las conclusiones deben formularse con cautela, indicando la posible sobreestimación del efecto.