📊 Fundamentos del aprendizaje automático

📊 Fundamentos del aprendizaje automáticoPrincipios y conceptos fundamentales del aprendizaje automático para principiantesλ

Estudie los algoritmos fundamentales, las bases matemáticas y los métodos prácticos del aprendizaje automático que forman la base de la inteligencia artificial moderna y el análisis de datos

Overview

El aprendizaje automático es la capacidad de un sistema para encontrar patrones en los datos y aplicarlos a nuevas tareas, sin necesidad de programar reglas rígidas. Las matemáticas aquí 🧩 no son decoración: el álgebra lineal describe espacios de características, la teoría de probabilidades maneja la incertidumbre, y la optimización busca los mejores parámetros. Dominando estos tres bloques, obtendrás las herramientas para comprender cualquier algoritmo, desde la regresión lineal hasta los transformers.

🛡️

Protocolo Laplace: Los fundamentos del aprendizaje automático no son simplemente un conjunto de algoritmos, sino un enfoque sistemático para extraer conocimiento de los datos, que requiere comprensión de estadística, álgebra lineal y optimización para construir modelos predictivos confiables.

Reference Protocol

Base Científica

Marco basado en evidencia para análisis crítico

Protocol: Evaluation

Ponte a Prueba

Cuestionarios sobre este tema próximamente

Sector L1

Artículos

Materiales de investigación, ensayos y profundizaciones en los mecanismos del pensamiento crítico.

📊 Fundamentos del aprendizaje automático

📊 Fundamentos del aprendizaje automático⚡

Más Información

Fundamentos matemáticos del aprendizaje automático: tres pilares sin los cuales los algoritmos no funcionan

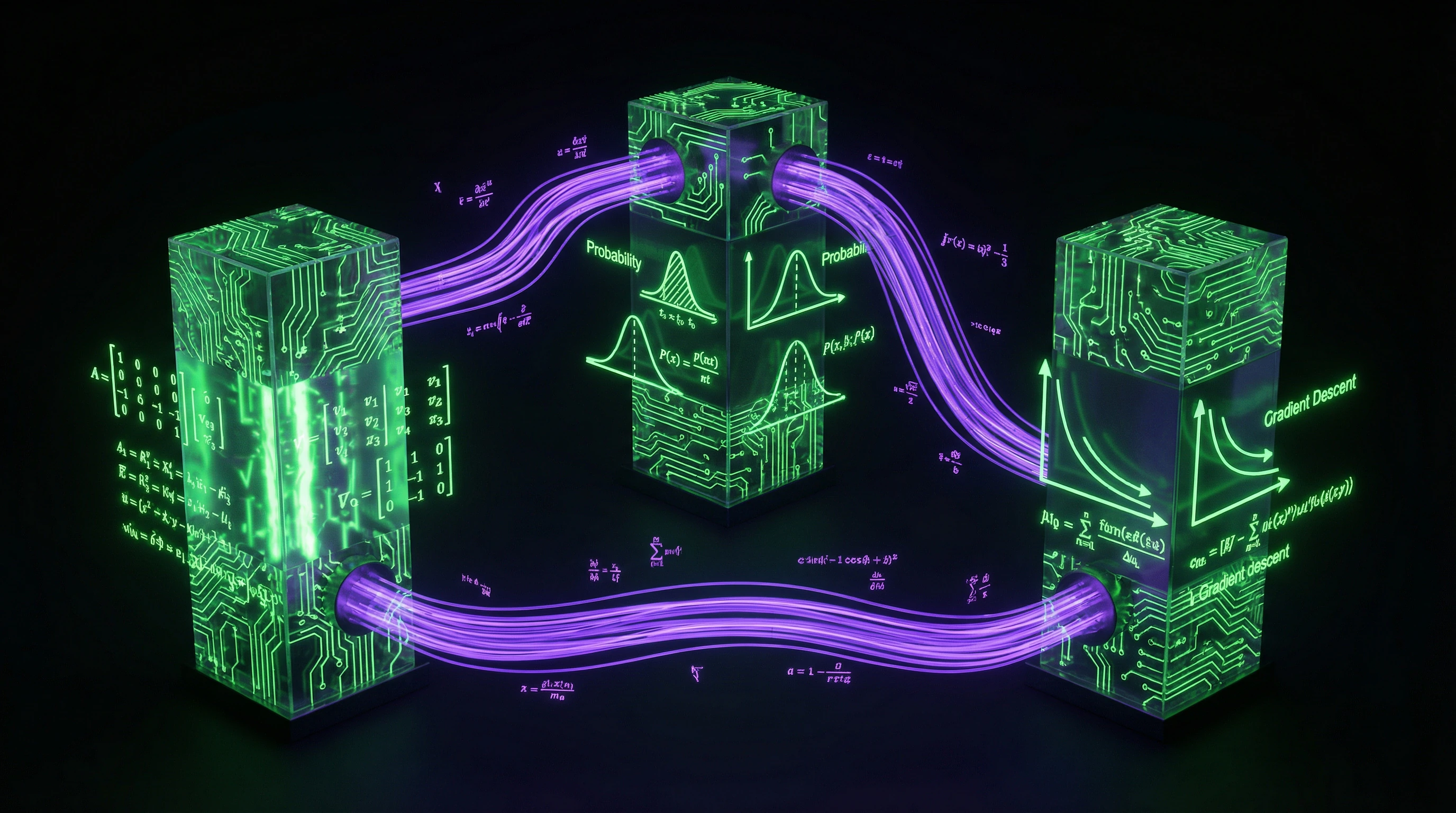

El aprendizaje automático se construye sobre tres disciplinas matemáticas. Cada una resuelve una tarea concreta: el álgebra lineal representa datos en estructuras multidimensionales, la teoría de probabilidades trabaja con la incertidumbre, los métodos de optimización buscan los mejores parámetros del modelo.

Sin comprender estos fundamentos es imposible crear nuevos algoritmos ni aplicar correctamente los existentes.

Álgebra lineal y espacios vectoriales

Cada objeto de datos en aprendizaje automático es un vector en un espacio multidimensional, donde cada dimensión corresponde a una característica. Las operaciones sobre matrices (multiplicación, transposición, vectores propios) constituyen la base de las redes neuronales: cada capa realiza una transformación lineal de los datos de entrada seguida de la aplicación de una función de activación no lineal.

- Producto escalar

- Mide la similitud entre vectores — crítico para clasificación y clustering.

- Descomposición de matrices (SVD, PCA)

- Reduce la dimensionalidad de los datos y extrae las características más significativas.

Teoría de probabilidades y estadística

Los modelos probabilísticos son la base de los métodos bayesianos, donde cada predicción va acompañada de una estimación de la confianza del modelo. La probabilidad condicional, el teorema de Bayes y las distribuciones de probabilidad son necesarios para construir modelos generativos y trabajar con datos incompletos.

| Herramienta | Aplicación |

|---|---|

| Pruebas estadísticas (t-test, chi-cuadrado) | Evaluación de la significancia de características y calidad de modelos |

| Máxima verosimilitud | Entrenamiento de modelos paramétricos (regresión logística, clasificador bayesiano ingenuo) |

Métodos de optimización y descenso de gradiente

El entrenamiento del modelo se reduce a buscar parámetros que minimicen la función de pérdida sobre los datos de entrenamiento. El descenso de gradiente es un algoritmo iterativo que se mueve en la dirección de mayor descenso de la función, calculando derivadas parciales para cada parámetro.

- Descenso de gradiente estocástico (SGD) — actualiza parámetros en cada ejemplo, más rápido pero más ruidoso.

- Adam — tasa de aprendizaje adaptativa con momento, a menudo converge más rápido.

- RMSprop — adapta la tasa de aprendizaje para cada parámetro por separado.

Comprender la convexidad de las funciones y las condiciones de convergencia es crítico para elegir la estrategia de optimización y los hiperparámetros de entrenamiento.

Tipos de tareas y algoritmos de aprendizaje: cómo elegir el enfoque correcto

El aprendizaje automático se divide según el tipo de datos y la naturaleza de la tarea. El aprendizaje supervisado utiliza datos etiquetados — para cada ejemplo se conoce la respuesta correcta. El aprendizaje no supervisado trabaja con datos sin etiquetar y busca patrones ocultos.

La elección del enfoque depende no solo de la disponibilidad de etiquetas, sino también del objetivo empresarial, el volumen de datos y los requisitos de interpretabilidad.

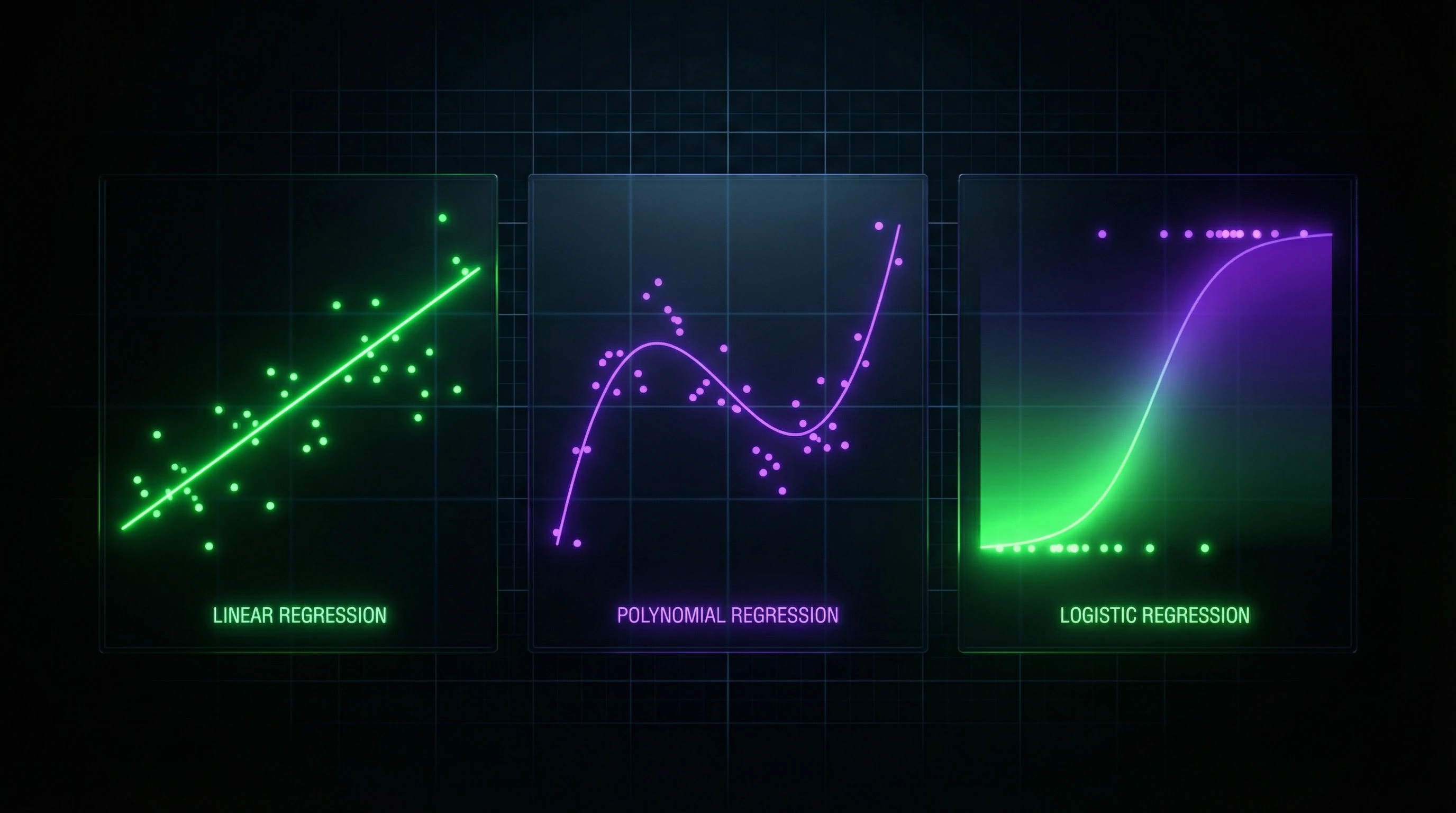

Aprendizaje supervisado: clasificación y regresión

La clasificación predice una etiqueta discreta — spam o no spam, gato o perro. La regresión predice un número continuo — precio, temperatura, volumen de ventas.

| Tipo de tarea | Ejemplos de algoritmos | Métricas de calidad |

|---|---|---|

| Clasificación | Regresión logística, árboles de decisión, SVM, redes neuronales | Accuracy, precision, recall, F1-score |

| Regresión | Regresión lineal, modelos polinómicos, gradient boosting | MSE, RMSE, MAE |

Cada algoritmo tiene sus ventajas dependiendo del tamaño de los datos y la complejidad de la frontera entre clases o la naturaleza de la distribución de valores.

Aprendizaje no supervisado: clustering y reducción de dimensionalidad

El clustering agrupa objetos por similitud sin categorías previas — segmenta clientes, detecta anomalías, organiza grandes volúmenes de datos. K-means, clustering jerárquico y DBSCAN difieren en la forma de determinar la similitud y la forma de los clusters.

Los métodos de reducción de dimensionalidad — PCA, t-SNE, UMAP — proyectan datos desde un espacio de alta dimensión a un espacio de menor dimensión, preservando la información importante y permitiendo visualizar la estructura.

Estas técnicas son críticas para trabajar con datos que contienen cientos o miles de características, donde el análisis directo es imposible.

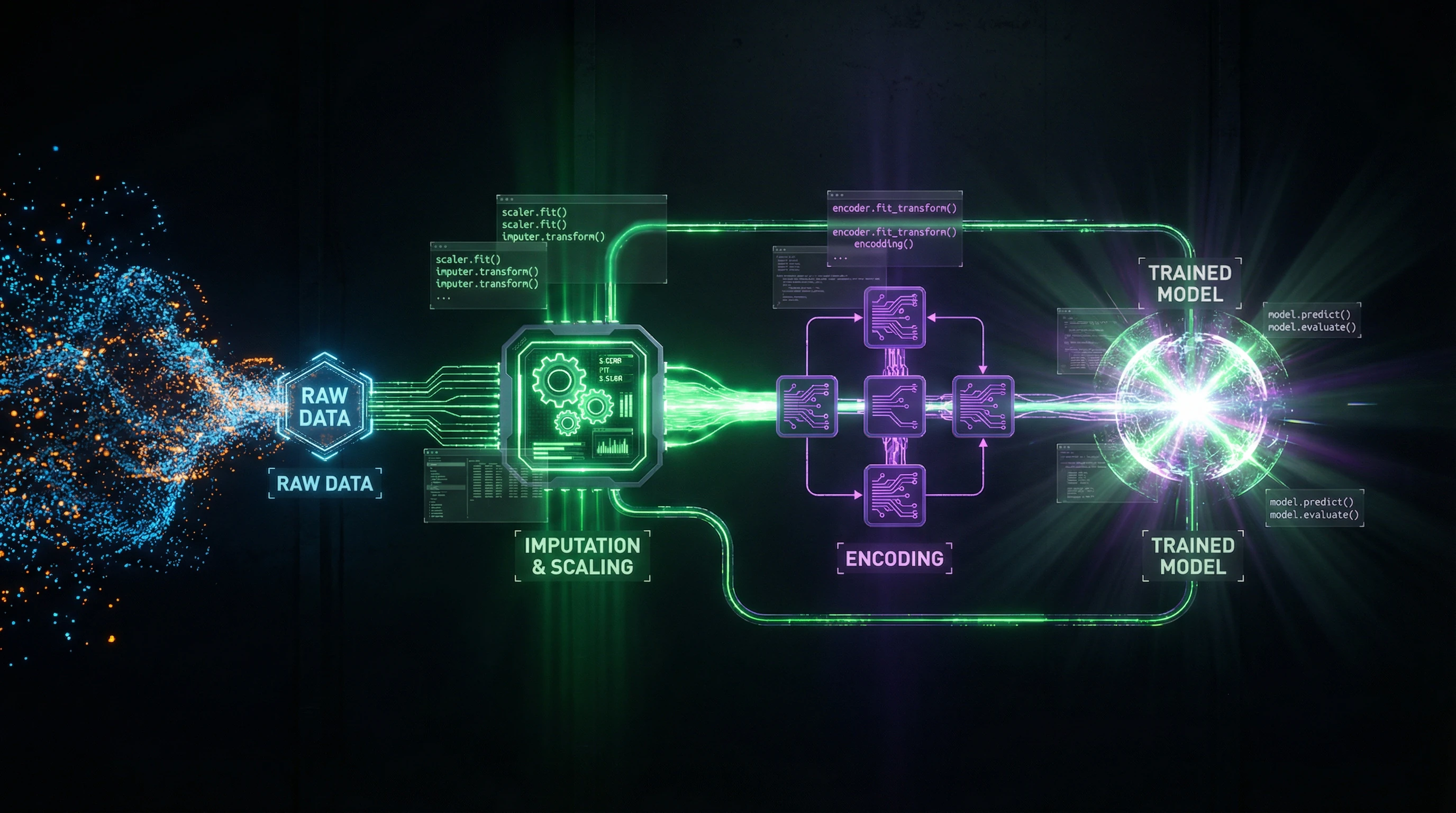

Preparación y procesamiento de datos: el 80% del trabajo que determina el éxito del modelo

La calidad de los datos determina directamente la calidad del modelo entrenado — incluso el algoritmo más sofisticado no podrá extraer patrones útiles de datos ruidosos, incompletos o mal preparados. Este trabajo ocupa la mayor parte del tiempo en proyectos reales de aprendizaje automático, pero es precisamente lo que determina si el modelo funcionará en producción.

Limpieza y normalización de datos

Los datos reales contienen valores faltantes, duplicados, valores atípicos y errores de entrada que deben procesarse antes de comenzar el entrenamiento. Las estrategias para trabajar con valores faltantes incluyen eliminar filas, rellenar con valores medios o medianos, o usar métodos más complejos de imputación basados en otras características.

| Método de normalización | Fórmula/rango | Cuándo usar |

|---|---|---|

| Min-Max scaling | [0, 1] | Cuando se necesita un rango fijo |

| Estandarización (Z-score) | Media 0, varianza 1 | Para algoritmos sensibles a la escala (descenso de gradiente, KNN) |

| Logaritmización | log(x) | Para distribuciones exponenciales y grandes rangos de valores |

El tratamiento de valores atípicos requiere un equilibrio entre eliminar valores anómalos y preservar casos raros pero importantes.

Extracción e ingeniería de características

La ingeniería de características — proceso de crear nuevas características informativas a partir de datos existentes basándose en conocimiento del dominio y análisis de datos. Una ingeniería de características de calidad a menudo proporciona mayor mejora en la calidad del modelo que cambiar a un algoritmo más complejo.

Para series temporales esto puede ser la extracción de tendencias, estacionalidad y retardos; para textos — creación de n-gramas, pesos TF-IDF o embeddings; para imágenes — extracción de texturas, bordes y formas.

Las transformaciones de características incluyen características polinómicas para capturar dependencias no lineales y one-hot encoding para variables categóricas.

División de datos y validación cruzada

La división correcta de datos en conjuntos de entrenamiento, validación y prueba previene el sobreajuste y proporciona una evaluación honesta de la calidad del modelo con datos nuevos.

- Proporción estándar: 60–70% para entrenamiento, 15–20% para validación, 15–20% para prueba final (se realiza una sola vez)

- La validación cruzada divide los datos en k partes y entrena k modelos, usando cada vez diferentes partes para entrenamiento y validación

- Para series temporales se utiliza una estrategia especial que preserva el orden temporal

- Para clases desbalanceadas se aplica división estratificada, preservando las proporciones de clases en todos los conjuntos

La validación cruzada proporciona una evaluación más confiable de la calidad con volumen limitado de datos.

Algoritmos básicos de aprendizaje automático: de la regresión a los ensambles

La regresión lineal modela la dependencia de la variable objetivo como una suma ponderada de características más un término independiente, minimizando el error cuadrático medio entre las predicciones y los valores reales.

El método de mínimos cuadrados encuentra los pesos óptimos analíticamente a través de la matriz pseudoinversa, lo que hace que el entrenamiento sea rápido, pero requiere una relación lineal entre las características y el objetivo. La regresión logística aplica una función sigmoide a la combinación lineal de características, transformando el resultado en una probabilidad de pertenencia a la clase.

A pesar de su nombre, la regresión logística resuelve problemas de clasificación, no de regresión, y es especialmente efectiva para clasificación binaria con clases linealmente separables.

Regresión lineal y logística

La regularización añade una penalización por valores grandes de los pesos en la función de pérdida. La regularización L1 (Lasso) utiliza la suma de valores absolutos de los pesos y conduce a soluciones dispersas con coeficientes nulos, realizando efectivamente una selección de características.

La regularización L2 (Ridge) utiliza la suma de cuadrados de los pesos y reduce uniformemente todos los coeficientes. Elastic Net combina ambos enfoques, equilibrando entre selección de características y estabilidad de la solución mediante dos hiperparámetros.

- Regresión polinómica

- Extiende el modelo lineal creando nuevas características como potencias y productos de las originales. Permite modelar dependencias no lineales, pero aumenta drásticamente el riesgo de sobreajuste con grados elevados.

- Estandarización de características

- Es críticamente importante para modelos regularizados, ya que las penalizaciones por pesos deben ser comparables en escala.

Árboles de decisión y bosques aleatorios

El árbol de decisión divide recursivamente el espacio de características en regiones rectangulares, eligiendo en cada paso la característica y el umbral que maximizan la reducción de incertidumbre en los nodos hijos, medida mediante entropía para clasificación o varianza para regresión.

El algoritmo construye el árbol de forma voraz de arriba hacia abajo, deteniéndose al alcanzar la profundidad máxima, el número mínimo de objetos en la hoja o cuando la división adicional no mejora la calidad. Los árboles son interpretables, trabajan con características categóricas sin codificación y realizan automáticamente selección de características.

Los árboles son propensos al sobreajuste e inestables: un pequeño cambio en los datos puede alterar radicalmente la estructura del árbol.

El bosque aleatorio entrena múltiples árboles sobre submuestras aleatorias de datos (bagging) con aleatorización adicional mediante la selección de un subconjunto aleatorio de características en cada nodo. La predicción final se obtiene promediando para regresión o votando para clasificación.

Esta estrategia reduce radicalmente el sobreajuste y la varianza de las predicciones, manteniendo el bajo sesgo de los árboles, lo que hace de los bosques aleatorios uno de los algoritmos de propósito general más confiables. El gradient boosting construye árboles secuencialmente, cada uno corrigiendo los errores de los anteriores, entrenándose sobre los gradientes de la función de pérdida.

- Proporciona la mayor precisión entre los métodos basados en árboles

- Requiere ajuste cuidadoso del learning rate y número de árboles

- Necesita protección contra sobreajuste mediante parada temprana

Máquinas de vectores de soporte

SVM busca un hiperplano que maximice el margen (margin), la distancia a los objetos más cercanos de diferentes clases, llamados vectores de soporte. Esto proporciona mejor capacidad de generalización en comparación con la simple separación de clases.

Para datos linealmente no separables se introduce una variable slack, permitiendo que algunos objetos violen el margen con una penalización controlada mediante el parámetro C, que equilibra entre la amplitud del margen y el número de errores.

El kernel trick mapea implícitamente los datos a un espacio de alta dimensionalidad mediante funciones kernel, donde las clases se vuelven linealmente separables, sin calcular explícitamente las coordenadas en el nuevo espacio.

El kernel RBF crea un espacio de características de dimensión infinita y es especialmente efectivo para fronteras no lineales complejas, pero requiere ajustar el parámetro gamma, que controla el radio de influencia de cada objeto.

Evaluación de la calidad de modelos: métricas y estrategias de validación

Métricas de clasificación y regresión

Para clasificación, accuracy mide la proporción de predicciones correctas, pero es inútil con clases desbalanceadas — un modelo que predice solo la clase mayoritaria obtendrá alta accuracy sin utilidad real.

Precision muestra la proporción de verdaderos positivos entre todos los predichos como positivos (crítica cuando los falsos positivos son costosos). Recall — proporción de positivos encontrados entre todos los positivos reales (crítica cuando las omisiones son peligrosas). F1-score — su media armónica, balanceando ambos indicadores.

| Métrica | Qué mide | Cuándo usar |

|---|---|---|

| ROC-AUC | Capacidad de clasificar objetos en todos los umbrales (0.5 = aleatorio, 1.0 = ideal) | Cuando el umbral de clasificación es desconocido de antemano |

| MAE | Desviación media en unidades originales, robusta ante outliers | Regresión con interpretabilidad |

| MSE / RMSE | Penaliza errores grandes; RMSE devuelve la escala | Regresión cuando los outliers son críticos |

| R² | Proporción de varianza explicada (1 = ideal, 0 = media, <0 = peor que trivial) | Regresión, comparación de modelos |

| MAPE | Error en porcentaje de valores reales | Interpretabilidad, pero indefinido con ceros |

Sobreajuste y subajuste

El sobreajuste surge cuando el modelo memoriza ruido y patrones aleatorios del conjunto de entrenamiento en lugar de dependencias verdaderas. Resultado: excelente calidad en train, mala en test — signo de alta varianza.

El subajuste se manifiesta en baja calidad en ambos conjuntos debido a complejidad insuficiente del modelo. El modelo no logra capturar los patrones verdaderos — problema de alto sesgo.

Las curvas de aprendizaje (métricas en train y validation según tamaño de muestra) muestran el diagnóstico: con sobreajuste las curvas divergen con gran brecha; con subajuste ambas permanecen en nivel bajo; con complejidad óptima convergen en alta calidad.

Regularización y selección de hiperparámetros

La regularización controla la complejidad del modelo mediante penalizaciones en la función de pérdida (L1/L2), restricciones en profundidad de árboles, dropout en redes neuronales o early stopping al monitorear validación.

- Grid search: prueba todas las combinaciones de hiperparámetros de una cuadrícula definida, garantizando el óptimo en espacio discreto, pero requiere número exponencial de entrenamientos al crecer los parámetros.

- Random search: muestrea aleatoriamente combinaciones de distribuciones, a menudo encuentra buenas soluciones más rápido que grid search, especialmente cuando algunos parámetros son más importantes que otros.

- Bayesian optimization: construye un modelo probabilístico de la dependencia de calidad respecto a hiperparámetros e iterativamente selecciona el siguiente punto, balanceando exploración y explotación, minimizando el número de entrenamientos costosos.

Aplicación práctica y herramientas de aprendizaje automático

Bibliotecas Python para ML: scikit-learn, pandas, numpy

NumPy proporciona arrays multidimensionales y operaciones vectorizadas que se ejecutan órdenes de magnitud más rápido que los bucles de Python gracias a su implementación en C. Pandas construye sobre NumPy estructuras DataFrame para datos tabulares con columnas nombradas, índices y herramientas de filtrado, agrupación y combinación.

Scikit-learn implementa decenas de algoritmos de aprendizaje automático con una API uniforme: todos los modelos tienen métodos fit() para entrenamiento y predict() para predicciones, lo que permite experimentar con diferentes algoritmos cambiando una sola línea de código.

- Matplotlib y seaborn visualizan datos y resultados de modelos

- Jupyter Notebook combina código, visualizaciones y texto en un único documento

- Módulos de scikit-learn: preprocessing para escalado, model_selection para validación cruzada, metrics para evaluación de calidad, pipeline para combinar pasos

Construcción de pipelines de procesamiento de datos

Pipeline aplica secuencialmente transformaciones de datos y el modelo final, garantizando el mismo procesamiento de datos train y test y previniendo fugas de información.

ColumnTransformer aplica diferentes transformaciones a diferentes subconjuntos de características: las numéricas se escalan con StandardScaler, las categóricas se codifican con OneHotEncoder, las textuales se vectorizan con TfidfVectorizer — todo en un único objeto.

Pipeline se integra con GridSearchCV, permitiendo ajustar hiperparámetros tanto de transformaciones como del modelo a través de una interfaz única con validación cruzada automática en cada combinación de parámetros.

FeatureUnion aplica en paralelo varias transformaciones a los mismos datos y concatena los resultados, permitiendo combinar diferentes representaciones de características.

Los custom transformers se crean heredando de BaseEstimator y TransformerMixin, implementando los métodos fit() y transform(). La serialización mediante joblib o pickle guarda el pipeline entrenado completo, incluyendo todos los parámetros de transformaciones y pesos del modelo, asegurando reproducibilidad y despliegue sencillo en producción.

Knowledge Access Protocol

FAQ

Preguntas Frecuentes

El aprendizaje automático es una rama de la inteligencia artificial donde el ordenador aprende a resolver tareas basándose en datos, sin programar explícitamente cada paso. Los algoritmos encuentran patrones en los ejemplos y los utilizan para hacer predicciones sobre datos nuevos. Por ejemplo, un sistema de reconocimiento facial aprende con miles de fotografías y luego identifica personas en imágenes nuevas.

La base es álgebra lineal (matrices, vectores), teoría de probabilidades y estadística matemática. También son importantes los métodos de optimización, especialmente el descenso de gradiente para entrenar modelos. Para principiantes es suficiente comprender los conceptos básicos; el conocimiento profundo se necesita para desarrollar nuevos algoritmos.

En el aprendizaje supervisado, el modelo aprende con datos etiquetados con respuestas conocidas (por ejemplo, fotos con etiquetas «gato» o «perro»). El aprendizaje no supervisado trabaja con datos sin etiquetar, encontrando estructuras ocultas: clústeres de objetos similares o patrones. El primer tipo se usa para clasificación y regresión; el segundo, para segmentación y reducción de dimensionalidad.

Es un mito: el volumen de datos depende de la tarea y el algoritmo. Los modelos simples (regresión lineal, árboles de decisión) funcionan eficazmente con cientos de ejemplos. Las redes neuronales profundas sí requieren millones de muestras, pero técnicas como transfer learning y data augmentation permiten entrenar modelos con datasets más pequeños con buena calidad.

El sobreajuste ocurre cuando el modelo funciona excelentemente con los datos de entrenamiento pero mal con datos nuevos, «memorizando» ruido en lugar de patrones. Se evita con regularización (L1/L2), validación cruzada, aumento del volumen de datos y simplificación del modelo. La división correcta de datos en train/validation/test es obligatoria para controlar el sobreajuste.

Comienza con Python y las bibliotecas numpy, pandas para trabajar con datos. Luego aprende scikit-learn: contiene algoritmos listos para usar y documentación clara. Practica con datasets simples (Iris, Titanic), estudiando gradualmente la teoría de regresión lineal, árboles de decisión y métricas de calidad.

Las métricas principales son: accuracy (proporción de respuestas correctas), precision (precisión), recall (exhaustividad) y F1-score (su media armónica). Para clases desbalanceadas, accuracy es engañosa: es mejor observar precision/recall. ROC-AUC muestra la calidad de separación de clases con diferentes umbrales de probabilidad.

Feature engineering es la creación de nuevas características a partir de datos originales para mejorar la calidad del modelo. Por ejemplo, de una fecha se puede extraer el día de la semana, mes o festivo. La ingeniería correcta de características suele ser más importante que la elección del algoritmo, especialmente para métodos clásicos de ML que no extraen dependencias complejas automáticamente.

La regresión predice valores numéricos continuos (precio de vivienda, temperatura); la clasificación predice categorías o clases (spam/no spam, tipo de animal). Para regresión se usan métricas MSE, RMSE, MAE; para clasificación, accuracy, F1-score. Algunos algoritmos (árboles de decisión, redes neuronales) resuelven ambas tareas con pequeñas modificaciones.

En la mayoría de los casos sí, pero no siempre. El bosque aleatorio promedia las predicciones de múltiples árboles, reduciendo el sobreajuste y la varianza. Sin embargo, es más difícil de interpretar, funciona más lento y requiere más memoria. Para tareas simples con pocos datos, un solo árbol puede ser suficiente y más comprensible.

La validación cruzada divide los datos en K partes (folds), entrena el modelo en K-1 partes y lo prueba en la restante, repitiendo el proceso K veces. La evaluación final es el promedio de todos los folds, lo que proporciona una estimación fiable de la calidad. La elección estándar es 5 o 10 folds, un equilibrio entre precisión de la evaluación y coste computacional.

La normalización lleva las características a una escala común, lo cual es crítico para algoritmos sensibles a la escala (SVM, redes neuronales, k-NN). Sin ella, una característica con valores grandes (por ejemplo, ingresos en euros) dominará sobre las pequeñas (edad). La estandarización (z-score) y el escalado min-max son los métodos de normalización más populares.

Existen plataformas no-code (Google AutoML, Azure ML Studio) que permiten construir modelos mediante interfaz. Sin embargo, para trabajo serio la programación es necesaria: hay que procesar datos, ajustar modelos, integrar soluciones. Python con bibliotecas como scikit-learn es el umbral mínimo de entrada, las bases se pueden aprender en pocas semanas.

Los hiperparámetros son configuraciones del algoritmo que se establecen antes del entrenamiento (profundidad del árbol, learning rate, número de vecinos en k-NN). Se ajustan mediante Grid Search (búsqueda en cuadrícula de valores) o Random Search (búsqueda aleatoria). Es importante usar validación cruzada durante el ajuste para evitar sobreajuste en el conjunto de validación.

Sí, los algoritmos clásicos (regresión logística, SVM, árboles) son eficaces con datasets de 100-1000 ejemplos. La clave es elegir bien el modelo y aplicar regularización para prevenir el sobreajuste. Para datos muy pequeños (decenas de ejemplos) es mejor usar modelos simples interpretables o métodos basados en reglas expertas.

SVM busca el hiperplano de separación óptimo con máximo margen entre clases, la regresión logística maximiza la probabilidad de clasificación correcta. SVM funciona mejor en espacios de alta dimensión y con kernel trick resuelve problemas no lineales. La regresión logística es más fácil de interpretar y proporciona probabilidades calibradas de pertenencia a clase.