Qué es realmente una red neuronal — y por qué el término "aprendizaje profundo" se usa casi siempre de forma imprecisa

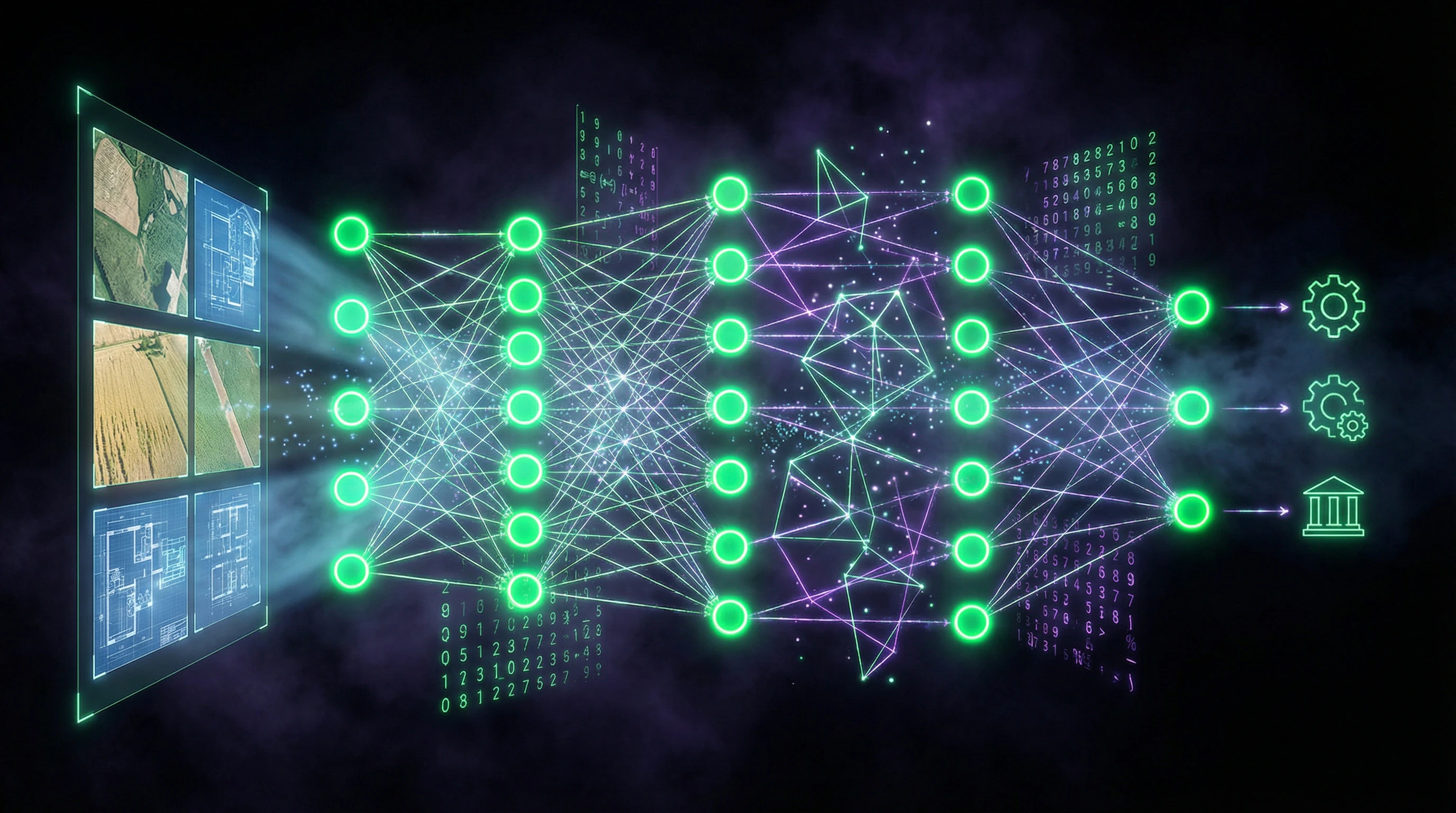

Una red neuronal no piensa ni comprende. Es un modelo matemático: capas de funciones ponderadas que transforman datos de entrada en datos de salida mediante operaciones matriciales y activaciones no lineales. Más información en la sección Ética de la inteligencia artificial.

El término "neuronal" es una metáfora histórica que remite al modelo simplificado de la neurona biológica de los años 40. Las arquitecturas modernas tienen tanto en común con el cerebro como un avión con un pájaro: existe el principio de inspiración, pero el mecanismo de funcionamiento es completamente distinto (S012).

🔎 Anatomía arquitectónica: del perceptrón a los transformers

La unidad básica es la neurona artificial: recibe entradas, multiplica cada una por un peso, suma, añade un sesgo y pasa el resultado por una función de activación (sigmoid, ReLU, tanh).

- Perceptrón (una capa)

- Resuelve solo problemas linealmente separables. Históricamente la primera arquitectura, pero prácticamente inaplicable a datos reales.

- Perceptrón multicapa (MLP)

- La adición de capas ocultas permite aproximar cualquier función continua — teorema de aproximación universal. Pero no dice nada sobre cuántas neuronas se necesitarán ni cómo entrenarlas.

El "aprendizaje profundo" (deep learning) es una subclase del aprendizaje automático que utiliza redes neuronales con múltiples capas ocultas (normalmente más de tres). La diferencia clave: las redes profundas extraen características automáticamente de datos en bruto, mientras que los algoritmos tradicionales requieren ingeniería manual de características (S012).

En materiales de marketing, el término "aprendizaje profundo" se aplica a menudo a cualquier red neuronal, incluso a un perceptrón de dos capas. Esto crea la ilusión de complejidad tecnológica donde no la hay.

🧱 Límites de aplicabilidad: cuándo una red neuronal es excesiva

Error crítico: asumir que las redes neuronales superan universalmente a otros métodos. En la práctica no es así.

| Condición | Red neuronal | Métodos clásicos |

|---|---|---|

| Volumen pequeño de datos (<1000 ejemplos) | Sobreajuste, inestabilidad | Regresión logística, bosque aleatorio — mejores |

| Dependencias lineales claras | Excesiva | Modelos lineales — más eficientes |

| Se requiere interpretabilidad | "Caja negra" | Gradient boosting, árboles — más transparentes |

| Grandes datos + patrones complejos | Óptima | Requieren ingeniería manual de características |

Un estudio sobre la aplicación de redes neuronales en agricultura (2021) analizó 147 trabajos: solo el 23% utilizaba arquitecturas de más de cinco capas, y el 41% aplicaba redes neuronales a tareas donde los métodos tradicionales de visión por computador (segmentación por umbral, operaciones morfológicas) daban resultados comparables con una complejidad computacional significativamente menor (S012).

La elección de la herramienta a menudo está determinada no por requisitos técnicos, sino por la moda tecnológica. Este es un problema sistémico en la industria.

Los cinco argumentos más sólidos a favor de las redes neuronales — y por qué funcionan solo bajo condiciones específicas

Para evitar el hombre de paja, es necesario examinar los argumentos más convincentes de quienes defienden la aplicación generalizada de redes neuronales. Estos argumentos tienen una base real, pero su validez está estrictamente limitada al contexto de aplicación. Más detalles en la sección Medios sintéticos.

🔬 Primer argumento: extracción automática de características de datos en bruto

Los algoritmos tradicionales de aprendizaje automático requieren que un experto defina manualmente qué características de los datos son importantes para la tarea. Para imágenes pueden ser bordes, texturas, histogramas de color; para texto — frecuencias de palabras, n-gramas, estructuras sintácticas.

Las redes neuronales profundas, especialmente las convolucionales (CNN) para imágenes y las recurrentes (RNN) o transformers para secuencias, aprenden automáticamente a extraer características jerárquicas: las primeras capas detectan patrones simples (bordes, esquinas), las intermedias — combinaciones de patrones (texturas, partes de objetos), las últimas — conceptos complejos (objetos completos, relaciones semánticas) (S008).

Esta ventaja es críticamente importante en áreas donde el espacio de características es enorme y no evidente. En lugar de programar reglas manualmente, la red aprende de ejemplos etiquetados e identifica patrones que un experto humano podría pasar por alto.

En agricultura, las redes neuronales se aplican exitosamente para detectar enfermedades de plantas mediante fotografías de hojas. La investigación muestra una precisión del 94–98% para clasificar 12 tipos de enfermedades del tomate usando ResNet-50, mientras que los métodos tradicionales con características manuales alcanzaban solo el 78–85%.

📊 Segundo argumento: escalabilidad con el crecimiento de datos

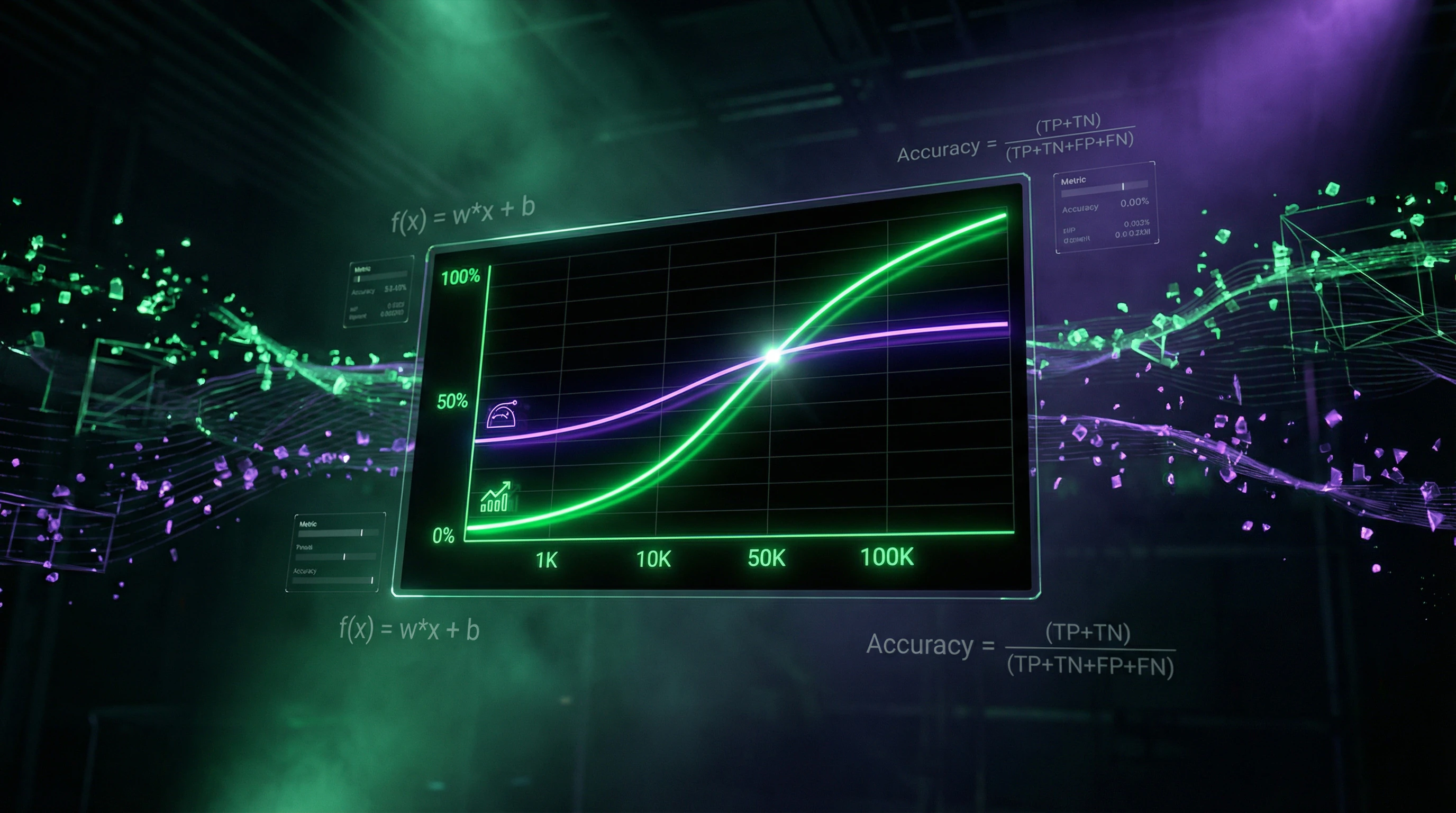

Los algoritmos clásicos a menudo alcanzan una meseta de rendimiento: después de cierto volumen de datos de entrenamiento, ejemplos adicionales no mejoran la calidad del modelo. Las redes neuronales profundas demuestran una dependencia exponencial: la calidad continúa aumentando con más datos, aunque a una tasa decreciente (S008).

Esto las convierte en la opción preferida para tareas donde hay millones de ejemplos disponibles — reconocimiento de voz (S001), traducción automática, generación de imágenes.

- Sin embargo, este argumento tiene una limitación crítica: para la mayoría de tareas aplicadas en negocios y ciencia hay disponibles cientos o miles de ejemplos, no millones.

- En tales condiciones, las redes neuronales son propensas al sobreajuste (overfitting) — memorizar ejemplos de entrenamiento en lugar de identificar patrones generales.

- Los métodos de regularización (dropout, L2-penalty, data augmentation) resuelven parcialmente el problema, pero no eliminan el hecho fundamental: las redes profundas requieren grandes volúmenes de datos para realizar su potencial.

🧬 Tercer argumento: aprendizaje por transferencia y modelos preentrenados

Un desarrollo revolucionario de los últimos años — la posibilidad de usar redes neuronales preentrenadas en enormes conjuntos de datos (ImageNet con 14 millones de imágenes, Common Crawl con terabytes de texto), y reentrenarlas en tareas específicas con pocos datos.

El transfer learning funciona así: las capas inferiores de la red, que aprendieron a reconocer características universales (bordes, texturas, patrones lingüísticos básicos), se congelan, mientras las capas superiores se reentrenan en la tarea objetivo (S008).

En bienes raíces, este enfoque se aplica para la valoración automática de propiedades mediante fotografías: un modelo preentrenado en ImageNet se reentrena con varios miles de fotografías de apartamentos con precios conocidos y alcanza un error absoluto medio del 8–12%, comparable a las valoraciones de tasadores profesionales, pero requiere segundos en lugar de horas.

🔁 Cuarto argumento: capacidad para modelar dependencias no lineales complejas

Muchos procesos reales se caracterizan por dependencias no lineales, multifactoriales con interacciones de alto orden. Por ejemplo, el rendimiento de un cultivo no depende simplemente de temperatura, humedad e iluminación por separado, sino de sus combinaciones complejas: alta temperatura puede ser favorable con suficiente humedad, pero letal durante sequía.

Las redes neuronales modelan naturalmente tales interacciones mediante activaciones no lineales y múltiples capas.

- Sobrevaloración del argumento

- El gradient boosting (XGBoost, LightGBM) también modela eficazmente interacciones no lineales y a menudo supera a las redes neuronales en datos tabulares con menores costes computacionales y mejor interpretabilidad.

- Donde las redes neuronales realmente ganan

- En datos con estructura espacial (imágenes) o temporal (secuencias), donde sus características arquitectónicas (convoluciones, conexiones recurrentes, mecanismos de atención) corresponden naturalmente a la estructura de los datos.

✅ Quinto argumento: aprendizaje end-to-end y optimización de la métrica objetivo

Los sistemas tradicionales a menudo consisten en una secuencia de módulos, cada uno optimizado independientemente: preprocesamiento de datos → extracción de características → clasificación → postprocesamiento. Los errores se acumulan en cada etapa, y la optimización de un módulo no garantiza mejora del resultado final.

Las redes neuronales permiten entrenar todo el sistema completo (end-to-end), optimizando directamente la métrica objetivo (precisión de clasificación, calidad de traducción, beneficio de recomendaciones).

| Condición | Ventaja end-to-end | Riesgo |

|---|---|---|

| Métrica de calidad claramente definida | Optimización directa del resultado objetivo | El sistema puede explotar artefactos de datos |

| Diferenciabilidad de todas las operaciones | El gradiente de error se propaga a todas las etapas | Soluciones inesperadas en lugar de resolver la tarea real |

| Ejemplo: clasificación de neumonía | La red neuronal aprendió a reconocer no la patología, sino el tipo de aparato de rayos X, porque las imágenes de diferentes hospitales correlacionaban con los diagnósticos | |

Este enfoque requiere verificación adicional: validación en datos independientes, análisis de qué características usa la red para resolver, y prueba convincente de que el sistema resuelve precisamente la tarea objetivo, no un artefacto secundario.

Base empírica: qué funciona en aplicaciones reales y qué permanece en las presentaciones

La transición de argumentos teóricos a datos empíricos revela una brecha significativa entre promesas y resultados. El análisis sistemático de la aplicación de redes neuronales en dos áreas específicas —agricultura e inmobiliaria— permite identificar patrones de éxito y fracaso. Más información en la sección Ética y seguridad de la IA.

🧪 Agricultura: de la detección de enfermedades a la predicción de rendimiento

Una revisión de 147 estudios sobre aplicación de redes neuronales, aprendizaje profundo y visión artificial en agricultura durante 2021 revela el siguiente panorama: 68% de los trabajos se dedican a tareas de clasificación (enfermedades de plantas, tipos de cultivos, madurez de frutos), 22% a detección de objetos (malas hierbas, plagas, plantas individuales), 10% a segmentación y predicción.

| Tarea | Proporción de estudios | Precisión media |

|---|---|---|

| Clasificación | 68% | 91–96% |

| Detección de objetos | 22% | 82–89% |

| Predicción de rendimiento | 10% | 76–84% |

El análisis crítico de la metodología descubre problemas sistémicos. El 73% de los trabajos utilizan datasets públicos (PlantVillage, ImageNet subset), recopilados en condiciones controladas: fotografías de hojas sobre fondo uniforme, iluminación ideal, ausencia de oclusiones (S012).

El rendimiento en datos controlados no se transfiere a condiciones reales de campo. Los estudios que probaron modelos en la realidad muestran caídas de precisión de 15–30 puntos porcentuales.

Solo el 12% de los trabajos comparan redes neuronales con métodos tradicionales de visión artificial sobre los mismos datos. De estos trabajos, el 45% muestra que las redes neuronales superan a los métodos tradicionales en menos de 5 puntos porcentuales —una diferencia que puede no justificar costes computacionales varias veces mayores (S012).

La detección de madurez de tomates por color se resuelve eficazmente con simple segmentación por umbral en el espacio de color HSV sin necesidad de entrenar una red profunda. Este es un patrón típico: donde las características visuales son claras, las redes neuronales añaden complejidad sin beneficio.

🏢 Inmobiliaria: valoración de propiedades y predicción de demanda

Una revisión sistemática de la transformación digital en la industria inmobiliaria identifica tres direcciones principales de aplicación de redes neuronales: valoración automática de propiedades (Automated Valuation Models, AVM), predicción de demanda y precios, análisis de imágenes para clasificación y descripción de propiedades (S009).

De 89 trabajos analizados, el 52% utilizan redes neuronales para AVM, el 31% para predicción de series temporales de precios, el 17% para análisis de imágenes.

- Resultados para AVM (redes neuronales vs modelos tradicionales)

- Error porcentual absoluto medio (MAPE): 8–15% frente a 10–18%. La ventaja se manifiesta solo en muestras grandes (más de 50.000 propiedades) y al incluir datos no estructurados (descripciones textuales, imágenes) (S009).

- En muestras pequeñas (menos de 5.000 propiedades)

- El gradient boosting muestra resultados comparables o mejores con tiempo de entrenamiento significativamente menor.

- Problema crítico: opacidad de la valoración

- Los reguladores y tribunales exigen explicaciones de por qué el modelo valoró una propiedad en determinada cantidad. Las redes neuronales como "cajas negras" no pueden proporcionar tales explicaciones, lo que limita su aplicación en contextos legalmente relevantes (S009).

Los métodos de interpretabilidad (SHAP, LIME) ofrecen solo explicaciones aproximadas y no resuelven el problema completamente. Esta es una limitación fundamental, no un detalle técnico.

🧾 Metaanálisis: patrones de éxito y fracaso

La síntesis de datos de ambas revisiones permite identificar condiciones bajo las cuales las redes neuronales demuestran ventaja real sobre las alternativas (S009, S012).

- Grandes volúmenes de datos: más de 10.000 ejemplos etiquetados para tareas de clasificación, más de 50.000 para regresión. Con volúmenes menores, los métodos tradicionales con ingeniería manual de características suelen ser más eficaces.

- Estructura compleja de datos: imágenes, vídeo, audio, textos —datos donde la estructura espacial o temporal contiene información crítica. En datos tabulares la ventaja de las redes neuronales es mínima.

- Disponibilidad de recursos computacionales: el entrenamiento de redes profundas requiere GPU o TPU. Para tareas en tiempo real en dispositivos edge (drones, aplicaciones móviles) se requiere optimización de modelos (cuantización, pruning, distillation), lo que añade complejidad.

- Tolerancia a errores: en tareas donde el error no es crítico (sistemas de recomendación, ranking de resultados de búsqueda), las redes neuronales son eficaces. En tareas con alto coste de error (diagnóstico médico, conducción autónoma) se requiere validación adicional y mecanismos de seguridad.

Condiciones de fracaso: datos escasos, requisitos de interpretabilidad, recursos computacionales limitados, necesidad de adaptación rápida a cambios (concept drift), tareas con reglas y lógica claras.

La elección real entre redes neuronales y alternativas no es una elección entre "magia" y "ordinariez". Es una decisión de ingeniería que depende de las restricciones concretas de la tarea. El ruido de marketing surge cuando estas restricciones se ignoran.

Mecanismos y causalidad: por qué funcionan las redes neuronales — y por qué no es magia

Comprender los mecanismos que subyacen al éxito de las redes neuronales es fundamental para separar las capacidades reales de las representaciones mitificadas. Más información en la sección Verificación de la Realidad.

🧬 Representación jerárquica de características: de píxeles a conceptos

La propiedad fundamental de las redes profundas es su capacidad para construir representaciones jerárquicas de datos. En las redes convolucionales para imágenes, la primera capa aprende a detectar patrones simples (bordes en diferentes ángulos, gradientes de color), la segunda capa combina estos patrones en otros más complejos (esquinas, arcos, texturas simples), la tercera en patrones aún más complejos (partes de objetos: ruedas, ventanas, hojas), y así sucesivamente hasta las capas finales, que representan objetos y escenas completas (S008).

Esto no es magia, sino consecuencia de la optimización: cada capa aprende a transformar los datos de entrada para que la siguiente capa pueda resolver más fácilmente su subtarea. El descenso de gradiente con retropropagación del error encuentra automáticamente estas transformaciones, minimizando la función de pérdida en los datos de entrenamiento. Fundamental: la red no "comprende" conceptos, encuentra regularidades estadísticas en los datos que se correlacionan con las etiquetas de clase.

La red no aprende características universales, sino patrones específicos del conjunto de datos de entrenamiento. Esta distinción entre correlación y causalidad es la principal trampa que convierte la alta precisión en una ilusión.

🔁 Correlación versus causalidad: limitación fundamental

Las redes neuronales aprenden a encontrar correlaciones, no relaciones causales. Si en los datos de entrenamiento todas las fotografías de vacas están tomadas con hierba de fondo, la red puede aprender a reconocer la hierba en lugar de la vaca — y clasificará cualquier imagen con hierba como "vaca", incluso si no hay ninguna vaca. Esto se llama spurious correlation (correlación espuria), y es un problema sistémico de todos los métodos de aprendizaje automático, no solo de las redes neuronales (S004).

En agricultura esto se manifiesta en la incapacidad de los modelos para generalizar a nuevas condiciones: una red entrenada para reconocer enfermedades del tomate en una región puede mostrar baja precisión en otra región con diferente clima, variedades de plantas y métodos de cultivo. La solución requiere recopilar datos de todas las condiciones objetivo, o métodos de domain adaptation, que son en sí mismos un área activa de investigación sin soluciones garantizadas.

- Verificar: ¿los datos de entrenamiento cubren todas las condiciones objetivo de aplicación?

- Identificar: ¿qué variables en los datos se correlacionan con la variable objetivo, pero no están causalmente relacionadas?

- Probar: el modelo con datos de nuevas condiciones que no estaban en el entrenamiento.

- Documentar: los límites de aplicabilidad del modelo y las condiciones bajo las cuales puede fallar.

🧷 Confusores y variables ocultas: por qué la alta precisión puede ser una ilusión

Un confusor es una variable que afecta tanto a los datos de entrada como a la variable objetivo, creando una correlación falsa entre ellos. Ejemplo clásico de medicina: una red neuronal para diagnosticar neumonía por radiografías mostraba 95% de precisión en datos de prueba, pero al implementarse en la práctica clínica la precisión cayó al 70%. Razón: en los datos de entrenamiento, las radiografías de pacientes con neumonía se hacían más frecuentemente con aparatos portátiles (porque los pacientes graves no podían ir a la sala de rayos X), y la red aprendió a reconocer el tipo de aparato, no la patología (S003).

En inmobiliaria existe un problema análogo: un modelo de valoración puede aprender la correlación entre calidad de fotografías y precio (los inmuebles caros los fotografían profesionales) y sobrevalorar cualquier inmueble con fotografías profesionales, independientemente de las características reales. La identificación y control de confusores requiere experiencia en el dominio y no puede automatizarse completamente.

- Confusor oculto

- Variable que no se mide en el conjunto de datos, pero afecta la relación entre entrada y salida. Ejemplo: el estatus socioeconómico del paciente influye tanto en el acceso a diagnóstico de calidad como en el resultado del tratamiento, pero puede no estar registrado en los datos médicos.

- Método de detección

- Comparar el rendimiento del modelo en subgrupos de datos (por sexo, edad, geografía, momento de recopilación). Si la precisión difiere significativamente, es probable que haya un confusor.

- Por qué es crítico

- El modelo puede funcionar perfectamente en datos de prueba, pero fallar en aplicación real, si la distribución de confusores ha cambiado.

La alta precisión en el conjunto de prueba no es garantía de funcionamiento en el mundo real. Es garantía solo de que el modelo ha aprendido bien los patrones en un conjunto de datos específico, incluyendo sus artefactos y sesgos.

Anatomía cognitiva del mito: qué trampas mentales nos hacen creer en la «magia de la IA»

La mitologización de las redes neuronales no es casualidad. Es el resultado del choque de tres trampas cognitivas: antropomorfismo, atención selectiva y prueba social. Más detalles en la sección Fundamentos de epistemología.

Cuando un sistema genera texto similar al humano, el cerebro automáticamente le atribuye comprensión. No es un error de percepción, es economía evolutiva: si algo habla como un humano, probablemente piensa como un humano.

- Antropomorfismo: atribuimos consciencia e intención a cualquier comportamiento complejo

- Atención selectiva: notamos los éxitos, ignoramos los fallos y casos límite

- Prueba social: si todos hablan de la «magia de la IA», entonces debe ser real

- Ilusión de comprensión: la complejidad del algoritmo nos parece sinónimo de consciencia

La atención selectiva amplifica el efecto. Cuando ChatGPT escribe un poema, se convierte en noticia. Cuando alucina hechos o confunde la lógica, queda en la sombra.

El mito de la magia de la IA no se sostiene en hechos, sino en asimetría de información: vemos el resultado, pero no vemos el mecanismo. La incertidumbre se llena de misticismo.

La prueba social cierra el ciclo. Medios, inversores, incluso científicos usan el lenguaje de la magia, no porque crean en ella, sino porque funciona. El lenguaje crea la realidad de la percepción.

La defensa contra estas trampas es simple: verifica tus suposiciones, exige el mecanismo, no solo el resultado, y recuerda: complejidad ≠ consciencia.