📊 Fundamentos del aprendizaje automático

📊 Fundamentos del aprendizaje automáticoCómo funciona la inteligencia artificial: de los datos a las decisionesλ

Comprender los principios de funcionamiento de la IA — desde el entrenamiento con datos hasta la aplicación práctica en medicina, negocios y vida cotidiana

Overview

La inteligencia artificial aprende de los datos 🧠 — identifica patrones, construye predicciones, toma decisiones. Las redes neuronales, algoritmos de aprendizaje automático y procesamiento del lenguaje permiten a las máquinas resolver tareas que antes requerían pensamiento humano. Sin magia: solo matemáticas, estadística y potencia computacional.

🛡️

Protocolo Laplace: La IA no es un reemplazo de la mente humana, sino una herramienta para amplificarla. Comprender los principios básicos del funcionamiento de la IA está al alcance de todos y no requiere formación técnica para su aplicación práctica.

Reference Protocol

Base Científica

Marco basado en evidencia para análisis crítico

Navigation Matrix

Subsecciones

[ai-errors-biases]

Errores y sesgos de la IA

Cómo reconocer y minimizar los riesgos de errores algorítmicos en diagnóstico, cirugía e investigación clínica

Explorar

[ml-basics]

Fundamentos del aprendizaje automático

Estudie los algoritmos fundamentales, las bases matemáticas y los métodos prácticos del aprendizaje automático que forman la base de la inteligencia artificial moderna y el análisis de datos

Explorar

Protocol: Evaluation

Ponte a Prueba

Cuestionarios sobre este tema próximamente

Sector L1

Artículos

Materiales de investigación, ensayos y profundizaciones en los mecanismos del pensamiento crítico.

📊 Fundamentos del aprendizaje automático

📊 Fundamentos del aprendizaje automático⚡

Más Información

Fundamentos del funcionamiento de la IA: de los datos a las decisiones

La inteligencia artificial funciona como un sistema matemático de reconocimiento de patrones en grandes volúmenes de datos. El algoritmo recibe ejemplos, identifica conexiones estadísticas entre la entrada y el resultado, y luego aplica los patrones encontrados a nueva información.

Esto difiere fundamentalmente de la programación tradicional: allí el desarrollador escribe cada regla manualmente, aquí la IA forma las reglas de manera autónoma basándose en la experiencia.

Qué es el aprendizaje automático

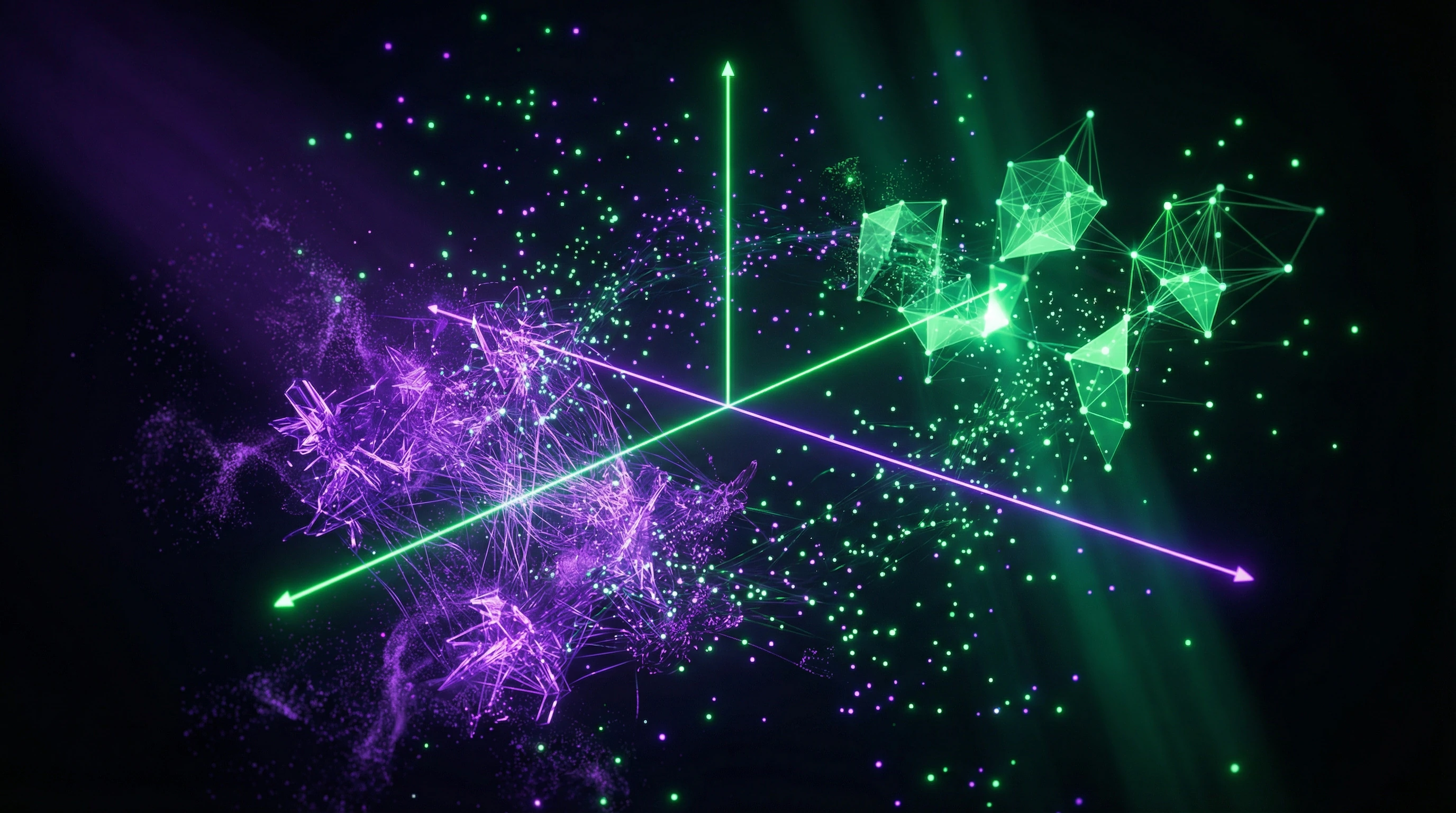

El aprendizaje automático es un subconjunto de la IA donde los sistemas aprenden de los datos sin programación explícita de cada paso.

| Tipo de aprendizaje | Principio | Tareas |

|---|---|---|

| Supervisado (supervised) | El algoritmo recibe ejemplos etiquetados con respuestas correctas | Clasificación, predicción |

| No supervisado (unsupervised) | El sistema encuentra estructura en datos no etiquetados de forma autónoma | Clustering, detección de patrones |

| Por refuerzo (reinforcement) | El modelo aprende mediante un sistema de recompensas y penalizaciones | Optimización de secuencias de acciones |

El papel de los datos en el entrenamiento de la IA

Los datos son el combustible de la IA: la calidad y el volumen del conjunto de entrenamiento determinan directamente la precisión del modelo.

- Recopilación de información relevante

- Primera etapa: selección de fuentes que realmente reflejen la tarea.

- Limpieza y normalización

- Eliminación de errores, valores atípicos, unificación de formatos a un estándar común.

- Etiquetado (para aprendizaje supervisado)

- Adición de respuestas correctas, si es necesario.

- Representatividad

- Requisito crítico: los datos de entrenamiento deben reflejar la diversidad real de situaciones. Si esto falta, el modelo producirá resultados sesgados. Por ejemplo, un sistema de reconocimiento facial entrenado predominantemente con fotografías de personas de apariencia europea funciona peor con otros grupos étnicos: esto es consecuencia directa de errores y sesgos de la IA.

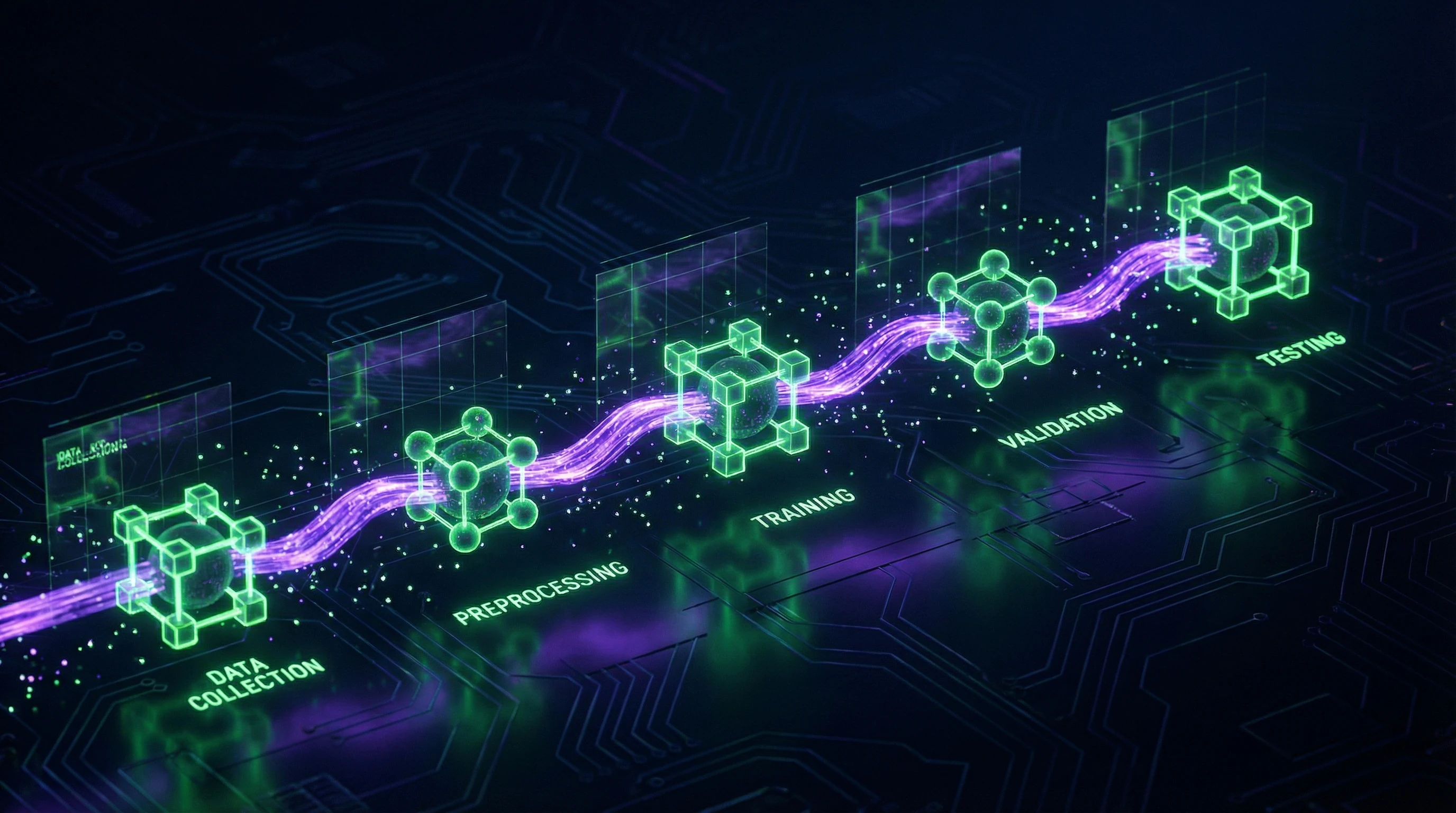

Proceso de entrenamiento y prueba de modelos

El entrenamiento de la IA se realiza en varias etapas con división de datos en tres conjuntos.

- Conjunto de entrenamiento (70–80%) — el modelo ajusta parámetros internos, minimizando el error entre predicciones y valores reales mediante optimización.

- Conjunto de validación (10–15%) — se utiliza para ajustar hiperparámetros y prevenir el sobreajuste (cuando el modelo funciona excelentemente con datos conocidos, pero generaliza mal con nuevos).

- Conjunto de prueba (10–15%) — la verificación final muestra el rendimiento real del sistema en condiciones lo más cercanas posible a la producción.

La calidad de los datos es más importante que su cantidad: un conjunto bien preparado dará mejores resultados que gigabytes de datos sucios y desequilibrados.

Redes neuronales: arquitectura y principios

Las redes neuronales son modelos computacionales inspirados en la estructura de las neuronas biológicas, pero que funcionan bajo principios completamente diferentes. Una red neuronal artificial consta de nodos (neuronas) organizados en capas y conectados mediante enlaces ponderados que transmiten y transforman información.

Cada neurona recibe señales de entrada, les aplica una función matemática (generalmente una suma ponderada con transformación no lineal) y transmite el resultado a la siguiente capa. Es precisamente esta arquitectura multicapa la que permite a la red identificar patrones complejos y jerárquicos en los datos, desde características simples en las primeras capas hasta conceptos abstractos en los niveles profundos.

Estructura de la neurona artificial

Una neurona artificial es una función matemática que recibe varias entradas, multiplica cada una por su peso correspondiente, suma los resultados, añade un sesgo (bias) y lo procesa mediante una función de activación.

- Pesos

- Determinan la importancia de cada señal de entrada y se ajustan durante el entrenamiento mediante el algoritmo de retropropagación del error (backpropagation).

- Función de activación

- Introduce no linealidad, sin la cual incluso una red multicapa se comportaría como un simple modelo lineal. Variantes populares: ReLU, sigmoid, tanh.

- Sesgo (bias)

- Permite que la neurona se active incluso con entradas nulas, aumentando la flexibilidad del modelo.

Capas y arquitecturas especializadas

Una red neuronal típica contiene una capa de entrada (recibe los datos originales), una o varias capas ocultas (realizan transformaciones) y una capa de salida (genera el resultado final).

| Tipo de arquitectura | Estructura de conexiones | Aplicación |

|---|---|---|

| Totalmente conectadas (Dense) | Cada neurona está conectada con todas las neuronas de la siguiente capa | Clasificación, regresión |

| Convolucionales (CNN) | Conexiones locales y pesos compartidos | Procesamiento de imágenes |

| Recurrentes (RNN) | Conexiones retroalimentadas para procesar secuencias | Análisis de texto, series temporales |

La profundidad de la red (número de capas) y la anchura (número de neuronas por capa) determinan su capacidad expresiva, pero una complejidad excesiva conduce al sobreajuste y requiere más datos.

Diferencias con el cerebro biológico

A pesar del nombre, las redes neuronales artificiales difieren radicalmente de las biológicas: utilizan modelos matemáticos simplificados en lugar de complejos procesos electroquímicos, aprenden mediante descenso de gradiente en lugar de plasticidad sináptica, y funcionan de forma síncrona capa por capa, no de manera asíncrona como las neuronas reales.

El cerebro biológico contiene aproximadamente 86.000 millones de neuronas con billones de conexiones, cada una de las cuales puede tener decenas de tipos de neurotransmisores y una dinámica temporal compleja; las IA actuales ni siquiera se acercan a esta complejidad.

El cerebro es energéticamente eficiente (consume alrededor de 20 W), mientras que el entrenamiento de grandes redes neuronales requiere megavatios de electricidad. Esta diferencia fundamental a menudo se pasa por alto en las descripciones populares de la IA, creando una falsa impresión de proximidad entre los sistemas artificiales y biológicos.

Tecnologías clave de la IA moderna

La inteligencia artificial moderna se apoya en tres tecnologías complementarias. El aprendizaje profundo utiliza redes neuronales multicapa para la extracción automática de características, el procesamiento del lenguaje natural permite a las máquinas comprender y generar habla, y la visión por computador interpreta información visual.

Estas áreas a menudo se combinan: los sistemas de descripción de imágenes integran visión por computador y NLP, mientras que modelos multimodales como GPT-4 trabajan simultáneamente con texto e imágenes.

Aprendizaje profundo (Deep Learning)

El aprendizaje profundo es una rama del aprendizaje automático que utiliza redes neuronales con múltiples capas ocultas (generalmente de 10 a cientos) para identificar representaciones jerárquicas de datos.

El avance decisivo ocurrió en 2012: la red convolucional AlexNet ganó el concurso ImageNet de reconocimiento de imágenes con una ventaja abrumadora, demostrando la superioridad de las arquitecturas profundas.

Factores clave del éxito: disponibilidad de grandes conjuntos de datos, aumento de la potencia computacional de las GPU y métodos de entrenamiento mejorados (dropout, batch normalization, residual connections).

Hoy el aprendizaje profundo domina en visión por computador, reconocimiento de voz, traducción automática y modelos generativos.

Procesamiento del lenguaje natural (NLP)

El NLP permite a los ordenadores analizar, comprender y generar lenguaje humano mediante la combinación de reglas lingüísticas y modelos estadísticos.

Los sistemas modernos utilizan transformers, una arquitectura basada en el mecanismo de atención (attention) que procesa eficientemente secuencias largas de texto y captura dependencias contextuales.

| Componente | Función | Resultado |

|---|---|---|

| Modelos de lenguaje grandes (LLM) | Se entrenan con miles de millones de palabras, predicen la siguiente palabra o reconstruyen fragmentos faltantes | Asimilan gramática, hechos y elementos de razonamiento |

| Aplicaciones | Traducción automática, chatbots, resumen, análisis de sentimiento, generación de contenido | Uso práctico en productos y servicios |

Visión por computador

La visión por computador otorga a las máquinas la capacidad de extraer información de imágenes y vídeos: clasificar (qué se representa), detectar (dónde están los objetos), segmentar (delimitar contornos) y generar imágenes.

Las redes neuronales convolucionales (CNN) se han convertido en el estándar gracias a su capacidad de aprender automáticamente jerarquías de características visuales: las primeras capas detectan bordes y texturas, las intermedias identifican partes de objetos, y las profundas reconocen objetos completos y escenas.

Arquitecturas modernas como ResNet, EfficientNet y Vision Transformers alcanzan precisión sobrehumana en tareas específicas: reconocimiento de señales de tráfico, diagnóstico de radiografías.

Las aplicaciones abarcan vehículos autónomos, diagnóstico médico, sistemas de seguridad, realidad aumentada y control de calidad en producción.

Etapas de creación de un sistema de IA: de la idea a producción

Definición de objetivos y elección de arquitectura

El desarrollo de un sistema de IA comienza con la formulación clara del problema de negocio y su traducción a una especificación técnica: clasificación, regresión, clustering o generación.

En esta etapa se definen las métricas de éxito (accuracy, F1-score, BLEU para NLP), los recursos computacionales disponibles y los requisitos de latencia. La elección de arquitectura depende del tipo de datos: para imágenes se utilizan CNN, para secuencias — RNN/LSTM o transformers, para datos tabulares — gradient boosting o algoritmos ML clásicos.

Es fundamental evaluar si hay suficientes datos para entrenar un modelo profundo o si conviene comenzar con transfer learning sobre pesos preentrenados.

Recopilación, limpieza y preparación de datos

La calidad de los datos determina el 80% del éxito del proyecto: el modelo no puede aprender lo que no está en el conjunto de entrenamiento.

- Recopilación de ejemplos representativos y etiquetado (para supervised learning)

- Eliminación de duplicados, tratamiento de valores faltantes y outliers

- Normalización de características; para imágenes — augmentation (rotaciones, recortes, cambios de brillo)

- Para texto — tokenización y vectorización mediante embeddings

- División en conjuntos de entrenamiento (70–80%), validación (10–15%) y test (10–15%)

- Corrección del desbalance de clases mediante oversampling, undersampling o ponderación de la función de pérdida

Es crítica la verificación de ausencia de fuga de información entre conjuntos.

Entrenamiento, validación y despliegue

El entrenamiento consiste en la optimización iterativa de los pesos del modelo mediante minimización de la función de pérdida sobre el conjunto de entrenamiento con algoritmos como SGD, Adam o AdamW.

El conjunto de validación se utiliza para ajustar hiperparámetros (learning rate, batch size, arquitectura) y early stopping ante overfitting. Tras alcanzar las métricas objetivo, el modelo se prueba en datos reservados, se verifica con edge cases y adversarial examples, y luego se empaqueta en una API o se integra en la aplicación.

En producción es crítica la monitorización: seguimiento del drift en la distribución de datos de entrada, degradación de métricas, latencia y consumo de recursos.

Las prácticas MLOps modernas incluyen versionado de modelos, A/B testing, reentrenamiento automático ante caída de calidad y herramientas de explainability para auditoría de decisiones.

Aplicaciones prácticas de la IA: de la medicina a la vida cotidiana

IA en medicina y diagnóstico

La IA médica analiza radiografías, resonancias magnéticas y tomografías computarizadas con una precisión comparable o superior a la de los radiólogos en tareas específicas como la detección de neumonía, tumores o fracturas. Los algoritmos procesan preparaciones histológicas para identificar células cancerosas y predicen el riesgo de enfermedades cardiovasculares mediante ECG.

En el descubrimiento de fármacos, la IA acelera la búsqueda de moléculas candidatas, prediciendo sus propiedades e interacción con proteínas diana. Esto reduce el tiempo de desarrollo de medicamentos de 10–15 años a 3–5.

Los asistentes virtuales ayudan a los pacientes con el seguimiento de síntomas, recordatorios de medicación y consultas iniciales a través de chatbots, trasladando parte de la carga del médico al algoritmo.

Automatización de procesos empresariales

En el sector corporativo, la IA automatiza tareas rutinarias: procesamiento de documentos mediante OCR y NLP, enrutamiento de consultas de clientes, previsión de demanda y optimización logística. Los sistemas de recomendación aumentan la conversión del e-commerce en un 20–30%, analizando el historial de compras y el comportamiento en el sitio web.

| Aplicación | Efecto |

|---|---|

| Chatbots en atención al cliente | Procesan hasta el 80% de consultas estándar |

| Detección de fraude en bancos | Reducen pérdidas por fraude en un 40–60% |

| Mantenimiento predictivo | Reducen tiempos de inactividad de equipos y costes de reparación |

IA en educación y vida cotidiana

Las plataformas educativas adaptativas ajustan el ritmo y la complejidad del material al nivel del estudiante, analizando patrones de errores. Los sistemas de corrección automática de ensayos y código proporcionan retroalimentación instantánea, ahorrando tiempo a los docentes.

En el hogar, los asistentes de voz gestionan el hogar inteligente, responden preguntas y ejecutan tareas mediante NLP. Las recomendaciones de música, películas y contenido se personalizan mediante filtrado colaborativo y deep learning.

Las cámaras de smartphones utilizan IA para reconocimiento de escenas, modo retrato con desenfoque de fondo y fotografía nocturna mediante procesamiento multifotograma. Las aplicaciones de navegación predicen atascos y optimizan rutas, procesando datos de millones de usuarios en tiempo real.

Mitos y realidad sobre la inteligencia artificial

IA no es igual a redes neuronales

Un error común identifica toda la IA con las redes neuronales, aunque estas son solo una de las herramientas del arsenal disponible.

| Método | Fortalezas | Cuándo aplicar |

|---|---|---|

| ML clásico (árboles, SVM, regresión logística) | Alta interpretabilidad, bajo costo computacional | Datos tabulares de pequeño volumen |

| Sistemas expertos basados en reglas | Transparencia total de la lógica | Diagnóstico médico, análisis financiero |

| Algoritmos evolutivos, reinforcement learning | Resuelven problemas sin datos etiquetados | Optimización, control, juegos |

| Aprendizaje profundo | Escalabilidad, trabajo con datos no estructurados | Imágenes, texto, audio con grandes volúmenes |

La elección del método depende del volumen de datos, requisitos de precisión, interpretabilidad y recursos computacionales: no existe una solución universal.

Limitaciones de la IA actual

Los sistemas de IA actuales no poseen comprensión en el sentido humano: encuentran correlaciones estadísticas en los datos sin captar relaciones causales.

Los modelos son frágiles ante adversarial attacks: cambios mínimos e imperceptibles en la entrada pueden causar errores catastróficos. La generalización más allá de la distribución de entrenamiento sigue siendo un problema sin resolver: un modelo entrenado con fotos de verano puede fallar con imágenes invernales.

Los requisitos de datos son enormes: para entrenar GPT-3 se utilizaron cientos de miles de millones de tokens, e ImageNet contiene 14 millones de imágenes etiquetadas. El consumo energético del entrenamiento de modelos grandes es comparable a la emisión anual de carbono de varios automóviles, lo que plantea cuestiones de sostenibilidad ecológica.

Aspectos éticos y uso responsable

Los sistemas de IA heredan y amplifican los sesgos presentes en los datos de entrenamiento: algoritmos de contratación discriminan por género, sistemas de reconocimiento facial funcionan peor con piel oscura, el scoring crediticio puede ser injusto con las minorías.

La opacidad de los modelos de deep learning dificulta la auditoría y explicación de decisiones, lo cual es crítico en medicina, derecho y finanzas. La adopción masiva de IA amenaza empleos en transporte, manufactura y servicio al cliente, requiriendo programas de recualificación.

Los deepfakes y modelos generativos crean riesgos de desinformación y manipulación de la opinión pública.

- Auditoría de datos sobre sesgos y representatividad

- Aplicación de métodos de explainable AI para transparencia de decisiones

- Control humano en decisiones críticas (medicina, derecho, finanzas)

- Documentación de limitaciones del sistema y escenarios de fallo

- Monitoreo regular del impacto social y efectos secundarios

Knowledge Access Protocol

FAQ

Preguntas Frecuentes

La inteligencia artificial es una tecnología que permite a las computadoras realizar tareas que requieren pensamiento humano: reconocimiento de patrones, toma de decisiones, comprensión del lenguaje. La IA aprende de los datos mediante algoritmos, encuentra patrones y los aplica para resolver nuevas tareas. Ejemplos: asistentes de voz, recomendaciones en redes sociales, diagnóstico médico.

Una red neuronal recibe un gran conjunto de ejemplos con respuestas correctas y ajusta gradualmente las conexiones entre neuronas, minimizando errores. El proceso es similar a enseñar a un niño: mostramos miles de fotos de gatos hasta que el sistema aprende a reconocerlos. Después del entrenamiento, el modelo se prueba con datos nuevos para verificar su precisión.

En la programación tradicional, el humano escribe todas las reglas manualmente, mientras que en el aprendizaje automático el sistema encuentra patrones en los datos por sí mismo. El programador solo define el objetivo y proporciona ejemplos, el algoritmo construye el modelo de solución de forma autónoma. Esto permite resolver tareas donde las reglas son demasiado complejas para describirse explícitamente.

No, es un mito común. Las redes neuronales artificiales solo están inspiradas en la biología, pero funcionan mediante operaciones matemáticas y métodos estadísticos, no procesos biológicos. El cerebro humano utiliza señales químicas, emociones y consciencia, que la IA no posee.

No, los datos son la base del funcionamiento de la IA moderna. Sin datos de calidad para el entrenamiento, el sistema no puede identificar patrones ni hacer predicciones precisas. Cuanto más grandes y diversos sean los datos, mejor funciona el modelo.

El proceso incluye seis etapas clave: definición de objetivos, recopilación de datos, preparación y limpieza de los mismos, entrenamiento del modelo, pruebas con datos nuevos y despliegue en producción. Después del lanzamiento se requiere monitoreo constante y mejora del sistema basándose en su funcionamiento real.

El aprendizaje profundo es una rama del aprendizaje automático que utiliza redes neuronales multicapa para analizar datos complejos. La tecnología permite extraer características automáticamente de imágenes, texto y audio sin configuración manual. Se aplica en reconocimiento facial, asistentes de voz y vehículos autónomos.

Comienza con herramientas listas para usar: ChatGPT para textos, Midjourney para imágenes, asistentes de voz para automatizar tareas. Muchos servicios tienen una interfaz simple y no requieren programación. Aprende conceptos básicos a través de cursos gratuitos en español.

La IA ayuda en el diagnóstico de enfermedades mediante imágenes, predice riesgos de complicaciones, acelera el desarrollo de medicamentos y personaliza planes de tratamiento. Los sistemas analizan datos médicos más rápido que los médicos e identifican patrones imperceptibles para el humano. La tecnología ya se utiliza en oncología, radiología y cardiología.

El modelo se prueba con un conjunto de datos separado que no se usó durante el entrenamiento, midiendo precisión, exhaustividad y puntuación F1. Es importante verificar el funcionamiento en casos límite y escenarios de uso reales. Los profesionales también analizan la matriz de confusión y realizan pruebas A/B.

No, es un error común. La IA incluye múltiples tecnologías: sistemas expertos, algoritmos genéticos, inferencia lógica, árboles de decisión. Las redes neuronales son solo una herramienta, aunque muy popular en los últimos años.

La IA actual no es completamente autónoma y requiere supervisión humana, definición de objetivos e interpretación de resultados. La tecnología funciona mejor como herramienta que potencia las capacidades humanas, no como sustituto. La creatividad, la empatía y el pensamiento estratégico siguen siendo exclusivos de las personas.

El NLP es un campo de la IA que permite a las computadoras comprender, interpretar y generar lenguaje humano. La tecnología se utiliza en chatbots, traductores, análisis de sentimientos, asistentes de voz. Los modelos modernos como GPT comprenden el contexto y crean textos coherentes.

Se requieren grandes volúmenes de datos de calidad, etiquetados y relevantes para la tarea a resolver. Para clasificación de imágenes se necesitan miles de fotos con etiquetas, para NLP corpus textuales. Los datos deben ser diversos, equilibrados y libres de errores.

Los principales problemas: sesgos algorítmicos debido a datos no objetivos, privacidad de información personal, transparencia en la toma de decisiones y responsabilidad por errores. Es importante desarrollar IA considerando principios éticos, garantizar control y explicabilidad de los sistemas. Los reguladores de distintos países están creando marcos legales para un uso responsable.

La IA actual combina y transforma patrones de los datos de entrenamiento, pero no posee verdadera creatividad o comprensión. Los sistemas generan nuevas imágenes, textos, música basándose en ejemplos aprendidos, pero no crean ideas conceptualmente nuevas. Las innovaciones disruptivas siguen siendo prerrogativa de la inteligencia humana.