Анатомия информационного поля вакцинации: почему нейтральных источников не существует, и как это использовать

Когда речь заходит о вакцинации, первое, что необходимо понять: абсолютно нейтральных источников информации не существует. Каждый источник имеет свою эпистемологическую позицию, методологические ограничения и институциональный контекст (S005).

Это не недостаток системы — это её фундаментальное свойство. Вопрос не в том, есть ли bias, а в том, как его идентифицировать и взвешивать. Подробнее — в разделе Кишечные паразиты и микробиом.

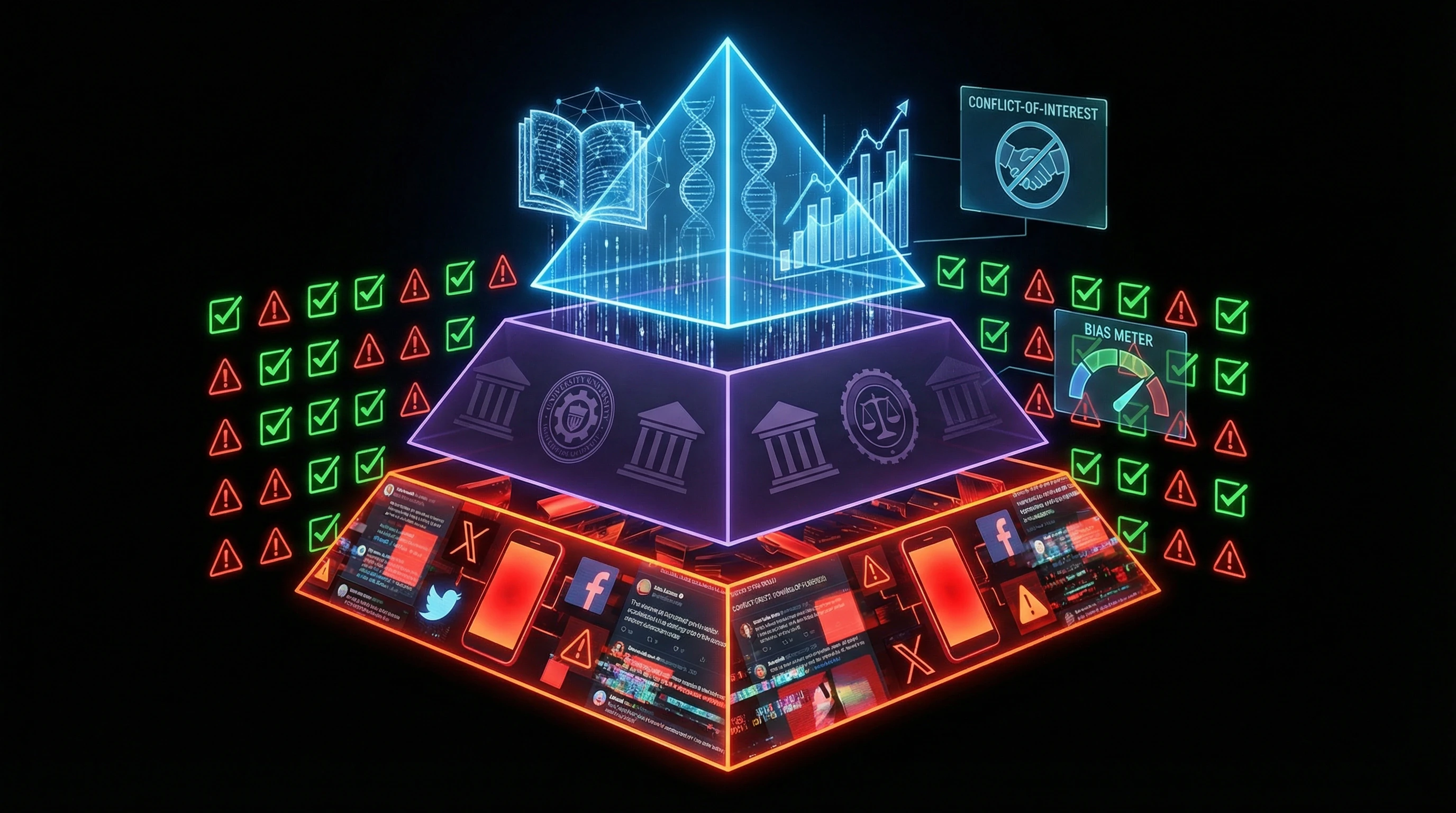

🔎 Три уровня источников: от первичных данных до медийного шума

Информационная экосистема вакцинации структурирована иерархически. Первый уровень — первичные исследования: рандомизированные контролируемые испытания, когортные исследования, систематические обзоры в рецензируемых журналах (S010).

Второй уровень — институциональные рекомендации: протоколы ВОЗ, CDC, национальных министерств здравоохранения, синтезирующие первичные данные. Третий уровень — медийные интерпретации: новостные статьи, блоги, социальные сети, где данные проходят через фильтры редакционной политики, алгоритмической оптимизации и когнитивных искажений авторов.

| Уровень | Источник | Контроль качества | Основной риск |

|---|---|---|---|

| 1 (первичный) | РКИ, когортные исследования, мета-анализы | Рецензирование, регистрация протокола | Bias публикации, конфликт интересов авторов |

| 2 (синтез) | Рекомендации ВОЗ, CDC, министерств | Систематический обзор, экспертная оценка | Политическое давление, лаг между данными и рекомендацией |

| 3 (интерпретация) | Новости, блоги, соцсети | Редакционная политика (часто отсутствует) | Сенсационализм, упрощение, манипуляция |

⚙️ Методологическая иерархия доказательств: почему не все исследования равны

Систематический подход к оценке источников требует понимания иерархии доказательств (S009). На вершине пирамиды находятся мета-анализы рандомизированных контролируемых испытаний — исследования, объединяющие данные множества РКИ для увеличения статистической мощности.

Ниже располагаются отдельные РКИ, затем когортные исследования, исследования случай-контроль, серии случаев и, наконец, экспертные мнения. Критическая ошибка большинства людей — придавать равный вес анекдотическому свидетельству и систематическому обзору тысяч пациентов.

Иерархия доказательств существует не потому, что учёные любят сложность. Она отражает реальные различия в способности метода контролировать систематические ошибки и случайные колебания.

🧱 Институциональные конфликты интересов: как их идентифицировать и взвешивать

Конфликт интересов не означает автоматическую недостоверность источника, но требует дополнительной проверки. Фармацевтические компании финансируют исследования своих продуктов — это создаёт потенциальный bias публикации (положительные результаты публикуются чаще отрицательных).

- Bias публикации

- Систематическое исключение из научного дискурса исследований с отрицательными результатами. Независимые систематические обзоры, анализирующие все зарегистрированные испытания (включая неопубликованные), позволяют корректировать этот эффект (S010).

- Финансовые интересы антивакцинальных организаций

- Продажа альтернативных методов лечения, юридические услуги, монетизация контента через рекламу и донаты. Механизм стимулов идентичен: чем более экстремальна позиция, тем выше engagement и доход.

Стальной человек: семь сильнейших аргументов критиков вакцинации, которые заслуживают серьёзного разбора

Интеллектуальная честность требует рассмотрения наиболее сильных версий оппонирующих аргументов, а не их карикатурных упрощений. Это называется принципом "стального человека" — противоположность логической ошибке "соломенного чучела". Подробнее — в разделе Чудо-БАДы и пищевые добавки.

Ниже представлены семь наиболее обоснованных критических позиций, которые нельзя отмахнуться простым "наука доказала".

- Временные рамки испытаний недостаточны для выявления долгосрочных эффектов

- Индивидуальная генетическая вариабельность делает популяционные исследования нерелевантными

- Конфликт интересов в системе регуляции и исследований

- Статистические манипуляции в представлении рисков и пользы

- Феномен антигенной перегрузки и иммунологическая незрелость

- Проблема замещения штаммов и эволюционное давление

- Эпистемологическая проблема доказательства безопасности

⚠️ Аргумент первый: временные рамки испытаний

Большинство вакцин проходят клинические испытания длительностью 2–5 лет, тогда как некоторые побочные эффекты могут проявляться через десятилетия. Связь между асбестом и мезотелиомой была установлена через 30–40 лет после экспозиции.

Невозможно доказать отсутствие эффекта, который ещё не наступил. Это методологически корректный аргумент.

Однако он игнорирует системы постмаркетингового надзора, которые отслеживают миллионы вакцинированных на протяжении десятилетий и не выявили паттернов отсроченных системных повреждений (S010).

🧩 Аргумент второй: генетическая вариабельность

Каждый человек имеет уникальный генетический профиль, влияющий на метаболизм, иммунный ответ и чувствительность к ксенобиотикам. Популяционные исследования показывают средние эффекты, но не предсказывают индивидуальную реакцию.

Существуют задокументированные случаи тяжёлых реакций на вакцины у людей с определёнными генетическими полиморфизмами (S010). Этот аргумент корректен в своей основе, но его экстраполяция на отказ от вакцинации логически некорректна: та же генетическая вариабельность делает инфекционные заболевания непредсказуемо опасными для конкретного индивида.

🔬 Аргумент третий: конфликт интересов

Регуляторные агентства частично финансируются фармацевтической индустрией через сборы за рассмотрение заявок. Исследователи получают гранты от производителей вакцин. Члены экспертных комитетов имеют консультационные контракты с компаниями.

- Regulatory capture

- Ситуация, когда регулятор действует в интересах регулируемой индустрии, а не общественного блага. Исторические примеры: опиоидный кризис, скандал с Vioxx.

- Сдержки и противовесы

- Множественность независимых регуляторов в разных юрисдикциях, академические исследования без индустриального финансирования и системы whistleblower protection снижают риск систематического искажения.

📊 Аргумент четвёртый: статистические манипуляции

Абсолютное снижение риска часто подменяется относительным снижением в коммуникации результатов. "Вакцина снижает риск на 95%" звучит впечатляюще, но если базовый риск составляет 1%, абсолютное снижение — всего 0,95%.

Framing effect — техника систематически используется в медицинской коммуникации для преувеличения эффектов вмешательств. Публика не получает инструментов для понимания абсолютных рисков.

Однако это проблема научной коммуникации, а не доказательной базы самих вакцин.

🧬 Аргумент пятый: антигенная перегрузка

Современный календарь вакцинации предполагает введение множественных антигенов в первые годы жизни, когда иммунная система находится в стадии развития. Критики утверждают, что это может приводить к иммунологическому дисбалансу, аутоиммунным реакциям или хроническому воспалению.

Теоретическая основа этого аргумента существует, но эмпирические данные не подтверждают гипотезу: дети ежедневно сталкиваются с тысячами антигенов из окружающей среды, и количество антигенов в вакцинах на порядки меньше естественной антигенной нагрузки (S010).

⚙️ Аргумент шестой: замещение штаммов

Массовая вакцинация создаёт селективное давление на патогены, потенциально приводя к эволюции более вирулентных или вакцино-резистентных штаммов. Это наблюдалось с пневмококковыми вакцинами, где элиминация вакцинных серотипов привела к росту невакцинных серотипов.

Аргумент методологически корректен и признаётся в научной литературе как реальный риск, требующий постоянного эпидемиологического надзора и обновления вакцинных составов.

🧠 Аргумент седьмой: эпистемология безопасности

Логически невозможно доказать абсолютную безопасность любого вмешательства — можно только не обнаружить вред в пределах чувствительности используемых методов. Отсутствие доказательств вреда не является доказательством отсутствия вреда.

Этот философский аргумент корректен, но применим ко всем медицинским вмешательствам, включая отказ от вмешательства. Решение принимается на основе сравнительной оценки рисков, а не абсолютных гарантий.

Доказательная база безопасности вакцин: что показывают данные за пределами маркетинговых заявлений

Переход от теоретических аргументов к эмпирическим данным требует систематического анализа исследований с учётом их методологического качества, размера выборки, длительности наблюдения и потенциальных источников систематических ошибок. Подробнее — в разделе Альтернативная онкология.

📊 Мета-анализы безопасности: что показывают объединённые данные миллионов пациентов

Систематические обзоры, объединяющие данные множественных исследований, предоставляют наиболее надёжные оценки эффектов вакцинации (S010). Кокрейновские обзоры — золотой стандарт доказательной медицины — анализируют все доступные РКИ по строгим методологическим критериям.

Для основных вакцин детского календаря (АКДС, MMR, полиомиелит) существуют мета-анализы, включающие данные сотен тысяч участников с периодом наблюдения до 10 лет. Эти обзоры последовательно показывают, что серьёзные побочные эффекты встречаются с частотой 1–10 на миллион доз, тогда как осложнения предотвращаемых заболеваний — на три–четыре порядка чаще.

| Показатель | Серьёзные побочные эффекты вакцин | Осложнения болезней без вакцинации |

|---|---|---|

| Частота на миллион доз/случаев | 1–10 | 1000–10000 |

| Период наблюдения в мета-анализах | До 10 лет | Историческая база |

| Источник данных | РКИ + постмаркетинговый надзор | Эпидемиологические данные |

🧪 Постмаркетинговый надзор: системы раннего обнаружения сигналов безопасности

После регистрации вакцины продолжается мониторинг через системы пассивного (VAERS в США, Yellow Card в Великобритании) и активного надзора (Vaccine Safety Datalink). Эти системы анализируют миллионы медицинских записей в реальном времени, используя статистические методы для выявления необычных паттернов побочных эффектов (S004).

Системы пассивного надзора фиксируют все сообщения без верификации причинно-следственной связи, что приводит к переоценке рисков при некритическом анализе. Активный надзор через связанные медицинские базы данных позволяет контролировать конфаундеры и устанавливать причинность.

🔎 Проблема publication bias и методы её коррекции

Систематическая ошибка публикации — тенденция публиковать положительные результаты чаще отрицательных — является реальной проблемой медицинской литературы (S009). Для вакцин это означает потенциальную недооценку побочных эффектов или переоценку эффективности.

- Обязательная регистрация всех клинических испытаний до начала (ClinicalTrials.gov)

- Анализ воронкообразных графиков для выявления асимметрии публикаций

- Запросы данных неопубликованных исследований у регуляторов через Freedom of Information Act

- Применение методов коррекции в систематических обзорах высокого качества

📈 Эпидемиологические естественные эксперименты: что происходит при снижении охвата вакцинацией

Наиболее убедительные данные о пользе вакцинации получены из наблюдений за популяциями, где охват вакцинацией снизился. Япония, 1975: после приостановки коклюшной вакцинации из-за опасений безопасности заболеваемость выросла с 393 случаев до 13 000 за три года, с 41 смертью.

Великобритания, 1998–2003: после публикации дискредитированной статьи Wakefield охват MMR упал с 92% до 80%, что привело к вспышкам кори с тысячами случаев и несколькими смертями. Эти естественные эксперименты демонстрируют причинно-следственную связь между вакцинацией и контролем заболеваний на популяционном уровне.

Механизм ясен: снижение коллективного иммунитета ниже критического порога позволяет возбудителю распространяться экспоненциально. Это не корреляция, а прямая причинность, воспроизводимая в разных странах и временных периодах.

Механизмы причинности: как отличить корреляцию от каузации в контексте побочных эффектов

Центральная проблема оценки безопасности вакцин — установление причинно-следственной связи между вакцинацией и наблюдаемыми событиями. Временная последовательность (событие произошло после вакцинации) необходима, но недостаточна для доказательства причинности. Подробнее — в разделе Научный метод.

🧬 Критерии Хилла: девять условий для установления причинности

Эпидемиолог Остин Брэдфорд Хилл сформулировал девять критериев для оценки причинно-следственных связей: сила ассоциации, консистентность (воспроизводимость в разных популяциях), специфичность, временная последовательность, биологический градиент (доза-ответ), биологическая правдоподобность, когерентность с существующими знаниями, экспериментальное подтверждение, аналогия с известными механизмами.

Для установления причинной связи между вакциной и побочным эффектом необходимо выполнение большинства этих критериев, а не только временной последовательности (S010). Когда критерии не соблюдены — например, нет биологического механизма или эффект не воспроизводится в других популяциях — ассоциация остаётся статистической артефактом.

- Сила ассоциации: насколько часто побочный эффект встречается у вакцинированных vs невакцинированных

- Консистентность: воспроизводится ли связь в разных странах, возрастных группах, типах вакцин

- Специфичность: вызывает ли вакцина именно этот эффект, а не множество случайных исходов

- Биологический градиент: усиливается ли эффект с увеличением дозы или числа доз

- Биологическая правдоподобность: существует ли известный механизм, объясняющий связь

🔁 Проблема конфаундеров: скрытые переменные, искажающие причинность

Конфаундер — переменная, связанная одновременно с экспозицией (вакцинацией) и исходом (побочным эффектом), создающая ложную ассоциацию. Дети, получающие вакцины, чаще посещают врачей, что увеличивает вероятность диагностики любых состояний (surveillance bias).

| Конфаундер | Связь с вакцинацией | Связь с исходом | Результат |

|---|---|---|---|

| Социально-экономический статус | Влияет на доступ к вакцинации | Влияет на множество исходов здоровья | Ложная ассоциация вакцины с болезнью |

| Генетические факторы | Определяют иммунный ответ | Определяют предрасположенность к заболеванию | Вакцина кажется причиной врождённого состояния |

| Возраст вакцинации | Фиксирован по графику | Совпадает с периодом диагностики других болезней | Временная корреляция без причинности |

Контроль конфаундеров требует многомерного статистического анализа или рандомизации в экспериментальных исследованиях. Без этого любая ассоциация остаётся подозрительной.

⚙️ Обратная причинность и протопатический bias

Иногда наблюдаемая ассоциация отражает обратную причинность: не вакцина вызвала событие, а ранние симптомы события повлияли на решение о вакцинации. Протопатический bias возникает, когда ранние, недиагностированные стадии заболевания влияют на экспозицию.

Если родители детей с ранними признаками неврологических нарушений чаще откладывают вакцинацию, последующая диагностика аутизма будет ассоциирована с невакцинированным статусом, создавая ложное впечатление защитного эффекта отказа от вакцин. Это не доказывает, что вакцины безопасны — это доказывает, что временная последовательность может лгать.

Различие между корреляцией и причинностью — не философский вопрос, а практический инструмент для чтения данных. Без понимания этих механизмов любой факт можно интерпретировать в нужную сторону.

Когнитивная анатомия антивакцинальных нарративов: какие психологические механизмы эксплуатируются

Эффективность антивакцинальной пропаганды объясняется не логической силой аргументов, а эксплуатацией эволюционно древних когнитивных механизмов, которые работают быстрее рационального анализа. Подробнее — в разделе Статистика и теория вероятностей.

🧩 Эвристика доступности: почему яркие истории побеждают статистику

Человеческий мозг оценивает вероятность событий на основе лёгкости, с которой примеры приходят на ум. Эмоционально заряженная история ребёнка с побочным эффектом после вакцинации создаёт более сильный когнитивный след, чем абстрактная статистика миллионов благополучно вакцинированных детей.

Видео плачущей матери активирует эмпатические нейронные сети и систему зеркальных нейронов, обходя аналитическое мышление. Антивакцинальный контент систематически использует персональные нарративы, тогда как провакцинальная коммуникация опирается на обезличенные данные — это структурная асимметрия убедительности (S002).

Яркая история побеждает не потому, что она истинна, а потому, что она доступна памяти быстрее, чем таблица с миллионом точек данных.

🕳️ Иллюзия контроля и omission bias

Люди переоценивают риски активных действий по сравнению с рисками бездействия. Решение вакцинировать воспринимается как активное вмешательство, за которое родитель несёт ответственность, тогда как заболевание при отказе от вакцинации воспринимается как естественное событие, за которое ответственность размыта.

- Асимметрия сожаления

- Родители больше боятся, что их действие (вакцинация) причинит вред, чем того, что их бездействие приведёт к заболеванию. Иллюзия контроля усиливает этот эффект: отказ от вакцинации создаёт ощущение, что родитель контролирует ситуацию, хотя объективно контроль над инфекционными заболеваниями при этом снижается.

🧠 Motivated reasoning и identity-protective cognition

Когда информация угрожает групповой идентичности или мировоззрению, люди обрабатывают её предвзято, чтобы защитить существующие убеждения. Для родителей, интегрированных в антивакцинальные сообщества, принятие доказательств безопасности вакцин означает не просто изменение мнения, но потенциальную потерю социальной поддержки, статуса в группе и согласованности идентичности (S002).

Более образованные и аналитически способные люди лучше находят аргументы в поддержку групповой позиции, а не объективной истины.

🔁 Эффект Даннинга-Крюгера в медицинской грамотности

Люди с низкой компетентностью в области систематически переоценивают свои знания и способность оценивать доказательства. Доступность медицинской информации в интернете создаёт иллюзию компетентности: прочитав несколько статей, человек чувствует себя способным оценивать методологию исследований, хотя для этого требуются годы специализированного обучения.

Антивакцинальные источники эксплуатируют это, предоставляя упрощённые интерпретации сложных данных, создающие ощущение понимания без реального понимания (S005).

- Прочитал статью → почувствовал себя экспертом

- Нашёл аргумент, подтверждающий предубеждение → уверенность выросла

- Критика методологии воспринимается как атака на компетентность → защитная реакция

- Цикл замыкается: чем больше информации, тем выше уверенность в неправильности

Протокол верификации источников: пошаговая система проверки информации о вакцинах

Критическая оценка источников требует систематического подхода, а не интуитивных суждений о правдоподобности. Ниже — протокол из семи уровней проверки, каждый отсекает определённый тип недостоверной информации. Подробнее — в разделе Память воды.

✅ Уровень первый: идентификация типа источника и его эпистемологического статуса

Первый вопрос: это первичное исследование, систематический обзор, институциональная рекомендация, новостная статья, блог или пост в соцсети? Каждый тип имеет разную доказательную силу (S001).

| Тип источника | Сила доказательства | Основной риск |

|---|---|---|

| Первичное исследование | Средняя | Методологическая слабость, нерепрезентативность |

| Систематический обзор | Высокая | Зависит от качества включённых работ |

| Институциональная рекомендация | Высокая | Может отставать от новых данных |

| Медийная интерпретация | Низкая | Сенсационализм, упрощение, искажение |

| Блог, соцсеть | Не определена | Отсутствие контроля качества |

🔎 Уровень второй: проверка рецензирования и индексации

Опубликовано ли исследование в рецензируемом журнале? Индексируется ли журнал в PubMed, Scopus или Web of Science? Какой импакт-фактор? Эти метрики не гарантируют качество конкретной статьи, но указывают на минимальный уровень методологического контроля (S009).

Красные флаги: публикация в «хищнических» журналах (predatory journals), которые публикуют всё за плату без реального рецензирования; препринты без рецензирования; статьи, отозванные после публикации (retracted). Проверка: поиск названия журнала в Directory of Open Access Journals или Beall's List хищнических издателей.

📊 Уровень третий: анализ методологии и размера выборки

Какой дизайн исследования? Рандомизированное контролируемое испытание (РКИ) сильнее наблюдательного исследования. Какой размер выборки и как она отобрана? Маленькие выборки или смещённая выборка (например, только люди, уже убеждённые в опасности вакцин) дают ненадёжные результаты.

Есть ли контрольная группа? Как долго длилось наблюдение? Долгосрочные эффекты требуют долгосрочных исследований, а не экстраполяции краткосрочных данных.

🔗 Уровень четвёртый: проверка конфликта интересов и финансирования

Кто финансировал исследование? Фармацевтическая компания, государственное агентство, независимый фонд? Конфликт интересов не означает автоматическую ложь, но требует повышенного скептицизма.

- Финансирование от производителя вакцины

- Повышенный риск смещения в пользу безопасности; требует независимой репликации

- Финансирование от антивакцинальной организации

- Повышенный риск смещения против вакцин; требует проверки методологии

- Государственное или независимое финансирование

- Более нейтральный статус, но не гарантирует качество

🎯 Уровень пятый: проверка цитирования и воспроизводимости

Цитируется ли исследование другими учёными? Высокое цитирование указывает на влияние, но не на истину (ошибочные работы тоже цитируются). Попытались ли другие исследователи воспроизвести результаты? Если нет — это красный флаг.

Доступны ли исходные данные и код анализа? Современный стандарт — открытые данные. Если автор отказывается их предоставить, это повод для подозрения.

⚠️ Уровень шестой: анализ логики и причинности

Даже если методология безупречна, логика может быть ошибочной. Путает ли автор корреляцию с каузацией? Игнорирует ли альтернативные объяснения? Использует ли логические ошибки (ad hominem, appeal to authority, false dilemma)?

Пример: «После вакцинации у ребёнка развился аутизм, значит вакцина вызвала аутизм». Это игнорирует, что аутизм диагностируется в возрасте 12–36 месяцев, когда проводятся многие прививки. Временная близость ≠ причинность. Проверка: есть ли биологический механизм? Есть ли контрольная группа невакцинированных детей с аутизмом?

🔐 Уровень седьмой: контекст и консенсус

Что говорят другие авторитетные источники? Если одно исследование противоречит консенсусу десятков других, требуется объяснение. Консенсус может быть ошибочным, но он снижает вероятность того, что вы наткнулись на истину, которую все остальные пропустили.

Проверьте позицию крупных медицинских организаций: ВОЗ, CDC, EMA, национальные органы здравоохранения. Они ошибаются, но их ошибки обычно более консервативны, чем ошибки маргинальных источников.

📋 Чек-лист быстрой верификации

- Определить тип источника (первичное исследование, обзор, медиа, блог)

- Проверить рецензирование и индексацию в авторитетных базах

- Оценить методологию: размер выборки, дизайн, контрольная группа

- Выявить конфликт интересов и источник финансирования

- Проверить цитирование и попытки воспроизведения результатов

- Анализировать логику: не путает ли корреляцию с каузацией

- Сравнить с консенсусом авторитетных организаций

Этот протокол не гарантирует истину, но значительно снижает вероятность попадания на манипуляцию. Главное: применять его систематически, а не выборочно в зависимости от желаемого результата.