Что такое «алгоритмическая радикализация» и почему этот термин стал оружием в информационных войнах

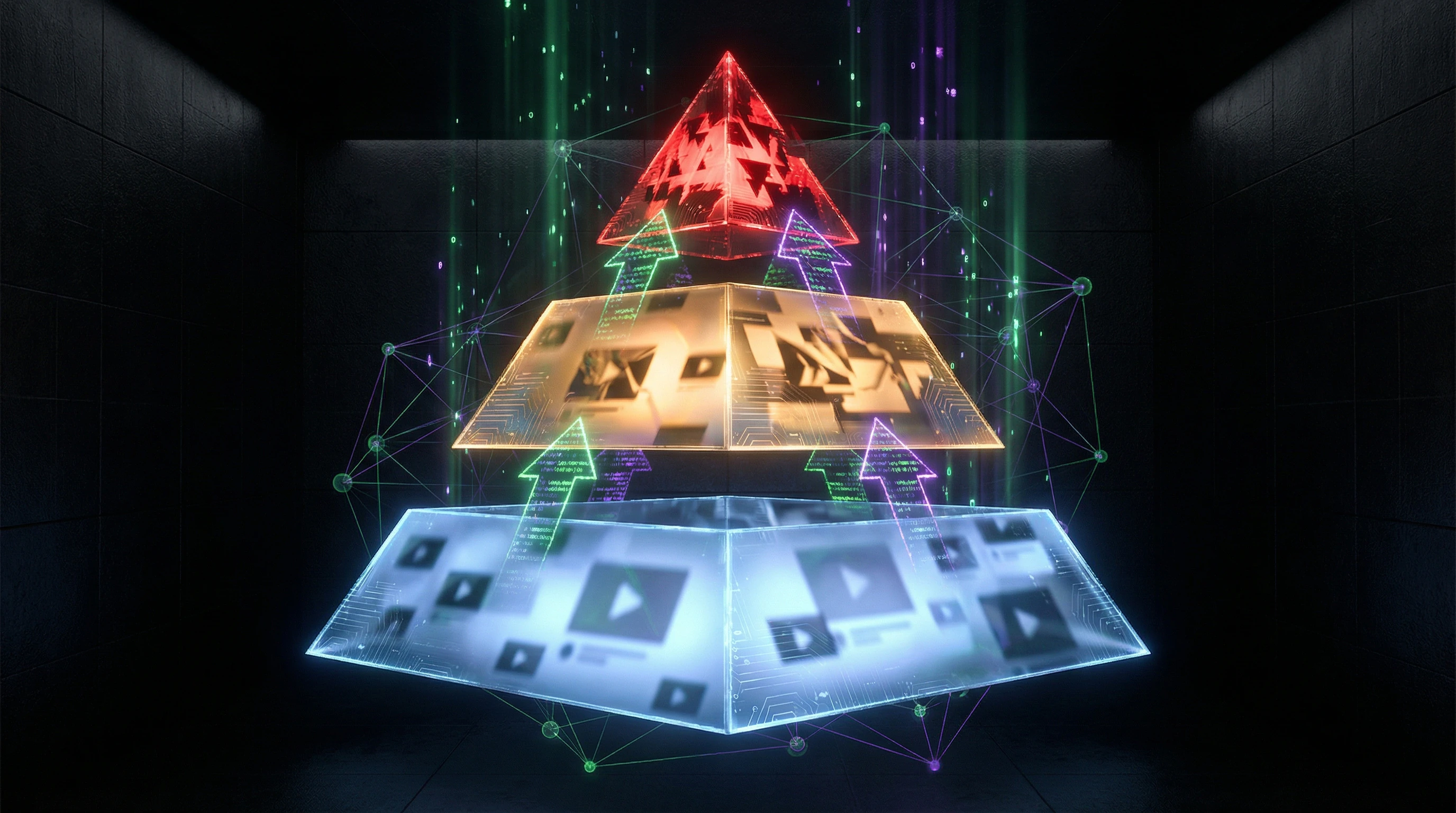

Термин «алгоритмическая радикализация» описывает гипотетический процесс, при котором рекомендательные системы видеоплатформ систематически направляют пользователей от умеренного контента к экстремистскому через цепочку постепенно радикализирующихся рекомендаций. Концепция «конвейера радикализации» (radicalization pipeline) предполагает существование предсказуемого пути: пользователь начинает с просмотра мейнстримного политического контента, алгоритм рекомендует ему более провокационный материал, затем — откровенно экстремистский, и в итоге человек оказывается в информационном пузыре радикальных идей (S010).

Этот нарратив стал центральным в дебатах о экономике внимания и ответственности платформ. Но за популярностью концепции скрывается методологический кризис: большинство исследований не различают корреляцию и причинность, опираются на анекдотические свидетельства вместо количественных данных и игнорируют альтернативные объяснения.

Три компонента нарратива о «пайплайне»

- Иерархия контента

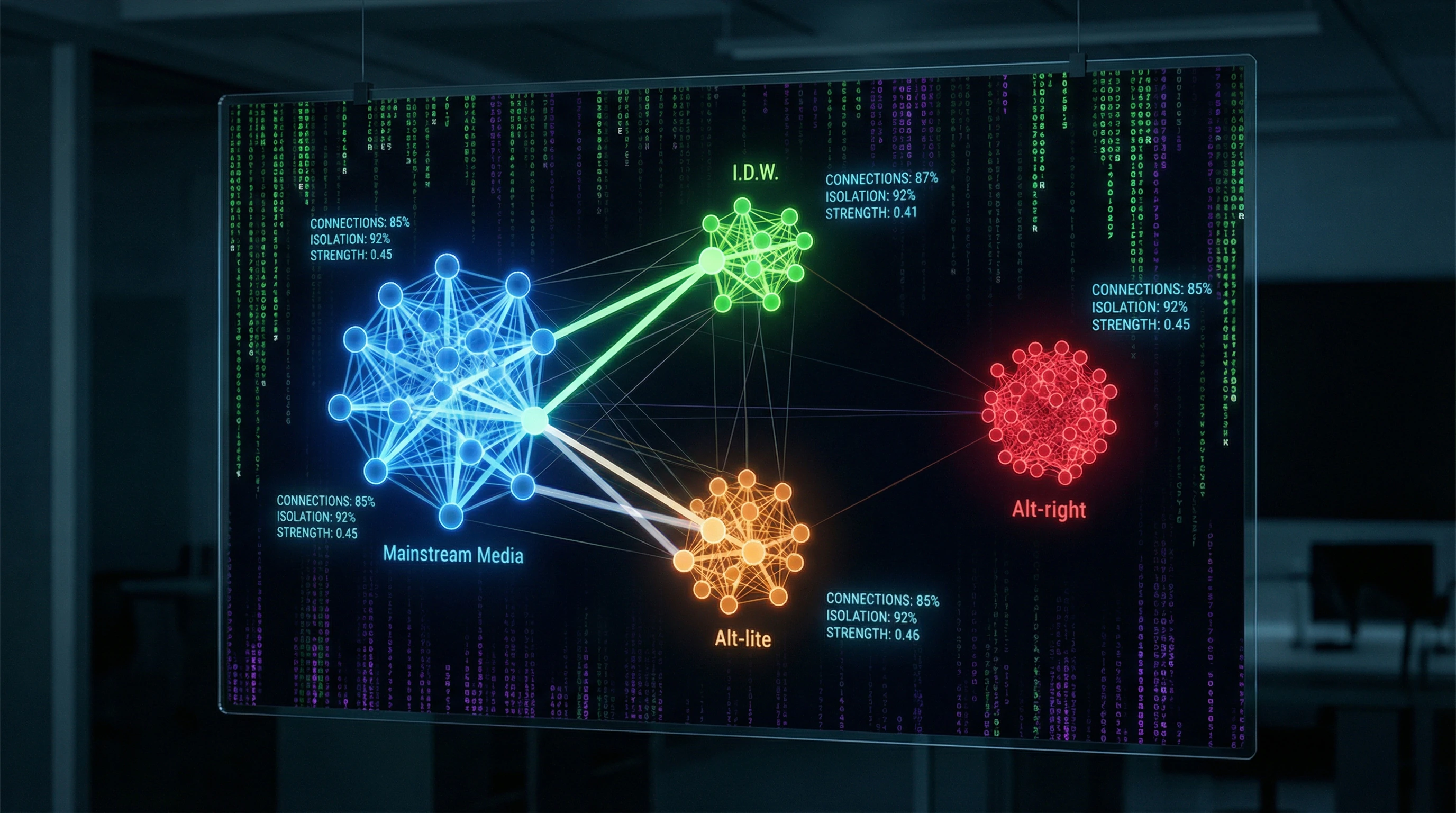

- Существует чёткая лестница от умеренного к экстремистскому: Intellectual Dark Web (I.D.W.) — интеллектуалы, критикующие прогрессивную повестку; Alt-lite — правые популисты с провокационной риторикой; Alt-right — откровенные сторонники превосходства белой расы и антисемитизма (S010).

- Активное продвижение переходов

- Алгоритм YouTube рекомендует более радикальный контент пользователям, смотрящим умеренный, создавая направленный поток от одной категории к другой.

- Систематичность процесса

- Этот механизм работает не случайно, а является основным драйвером онлайн-радикализации на платформе.

Радикализация как научный концепт: за пределами технологического детерминизма

Радикализация определяется как «процесс, в ходе которого индивид или группа принимает экстремистские идеологические убеждения и/или готовность использовать насилие для достижения политических целей» (S002). Ключевое различие: радикализация взглядов не равна радикализации действий.

Исследования показывают, что радикализация — это многофакторный процесс, включающий личностные предрасположенности, социальное окружение, политический контекст и триггерные события (S005). Попытка свести этот сложный феномен к механическому действию алгоритма рекомендаций упрощает проблему до уровня технологического детерминизма.

Радикализация взглядов не равна радикализации действий. Просмотр провокационного контента — это не то же самое, что принятие экстремистской идеологии или готовность к насилию.

Методологическая ловушка: анекдоты вместо данных

Большинство публикаций о «конвейере радикализации» на YouTube опирается на качественные методы: анализ отдельных случаев, интервью с бывшими экстремистами, журналистские расследования. Типичный пример — история человека, который утверждает, что «YouTube затянул его в Alt-right через рекомендации». Подробнее — в разделе Основы эпистемологии.

Эти нарративы обладают мощным эмоциональным воздействием, но не могут служить доказательством систематического эффекта. Проблема репрезентативности остаётся нерешённой: сколько пользователей получили те же рекомендации, но не радикализировались? Какова базовая частота радикализации среди пользователей, не получавших таких рекомендаций?

| Вопрос | Требуемый ответ | Статус в литературе |

|---|---|---|

| Какова доля пользователей, получивших рекомендации, но не радикализировавшихся? | Количественные данные с контрольной группой | Отсутствует |

| Отличается ли траектория радикализации у пользователей с рекомендациями от тех, кто их не получал? | Сравнительный анализ с контролем переменных | Редко |

| Какова роль предшествующих убеждений пользователя в выборе контента? | Анализ селекционного смещения | Игнорируется |

Без контрольной группы и количественных данных невозможно отделить корреляцию от причинности. Это не методологический педантизм — это основание, на котором строится вся логика доказательства (S010).

Стальная версия аргумента: семь самых убедительных доводов в пользу существования алгоритмического пайплайна

Прежде чем разбирать доказательства против гипотезы «конвейера радикализации», необходимо честно представить сильнейшие аргументы в её пользу. Интеллектуальная честность требует конструирования «стальной версии» (steelman) оппонентской позиции — не карикатуры, а максимально убедительной формулировки. Подробнее — в разделе Эпистемология.

🔥 Аргумент первый: экономическая логика максимизации вовлечённости неизбежно ведёт к радикализации

Бизнес-модель YouTube построена на максимизации времени просмотра, что напрямую влияет на рекламные доходы. Алгоритм оптимизирован на предсказание того, какое видео удержит пользователя на платформе дольше всего.

Эмоционально заряженный, провокационный контент генерирует более высокую вовлечённость, чем нюансированный и взвешенный. Радикальный контент — это «суперстимул» для системы, настроенной на вовлечённость. Это не злой умысел разработчиков, а неизбежное следствие функции оптимизации.

Структурный стимул алгоритма рекомендовать всё более провокационный материал встроен в саму архитектуру платформы, ориентированной на экономику внимания.

📈 Аргумент второй: документированный рост экстремистских каналов коррелирует с изменениями алгоритма рекомендаций

Исследователи фиксируют взрывной рост аудитории правых популистских и экстремистских каналов на YouTube в период 2015–2018 годов (S002, S003). Этот рост совпадает с изменениями в алгоритме рекомендаций, которые YouTube внедрил для увеличения времени просмотра.

Каналы Alt-lite и Alt-right сообщали о резком увеличении подписчиков и просмотров именно через рекомендации, а не через поиск или внешние ссылки. Временная корреляция между изменениями алгоритма и ростом экстремистского контента предполагает причинно-следственную связь.

🎯 Аргумент третий: свидетельства бывших экстремистов о роли YouTube в их радикализации

Множество людей, прошедших через дерадикализацию, описывают YouTube как ключевой фактор в их идеологическом сдвиге (S004). Они детально рассказывают, как начинали с просмотра видео о феминизме или иммиграции, получали рекомендации более радикальных критиков этих явлений, затем — откровенно расистского контента.

Эти свидетельства согласуются между собой и описывают повторяющийся паттерн. Отвергать их как «анекдотические» значит игнорировать живой опыт людей, непосредственно столкнувшихся с феноменом.

- Начало: видео о социальных явлениях (нейтральный контент)

- Рекомендации: критика с более острым углом зрения

- Углубление: откровенно идеологизированный контент

- Результат: переход в экстремистские сообщества

🧬 Аргумент четвёртый: психологические механизмы персонализации усиливают эффект эхо-камеры

Алгоритм персонализации создаёт уникальную ленту рекомендаций для каждого пользователя на основе истории просмотров. Если пользователь начинает смотреть контент определённой идеологической направленности, алгоритм интерпретирует это как предпочтение и рекомендует больше похожего контента.

Это создаёт эффект эхо-камеры: пользователь всё реже сталкивается с альтернативными точками зрения и всё глубже погружается в идеологический пузырь. Персонализация превращает случайный интерес в самоусиливающуюся петлю обратной связи.

🌐 Аргумент пятый: кросс-платформенные данные показывают, что YouTube — главный источник трафика для экстремистских сайтов

Анализ реферального трафика на экстремистские веб-сайты и форумы показывает, что YouTube является одним из крупнейших источников новых посетителей (S005). Пользователи переходят с YouTube на платформы вроде 4chan, 8chan, Gab, где радикализация продолжается в более интенсивной форме.

YouTube функционирует как «воронка» — привлекает широкую аудиторию умеренным контентом, затем направляет наиболее восприимчивых пользователей в экосистему экстремистских платформ. Без YouTube многие из этих пользователей никогда не обнаружили бы существование радикальных сообществ.

🛠️ Аргумент шестой: внутренние документы YouTube подтверждают, что компания знала о проблеме

Журналистские расследования и утечки внутренних документов показывают, что сотрудники YouTube неоднократно предупреждали руководство о том, что алгоритм рекомендаций продвигает экстремистский контент (S008). Инженеры предлагали изменения, которые снизили бы этот эффект, но руководство отклоняло их из-за опасений, что это уменьшит вовлечённость и доходы.

Это свидетельствует о том, что проблема реальна и признавалась внутри компании, но экономические интересы перевешивали этические соображения.

⚖️ Аргумент седьмой: массовые стрелки и террористы цитировали YouTube как источник радикализации

В манифестах и заявлениях нескольких массовых убийц последних лет упоминается YouTube как платформа, где они познакомились с идеологией превосходства белой расы или антисемитизмом (S006). Стрелок из Крайстчерча, террорист из Питтсбурга и другие преступники описывали свой путь радикализации, начинавшийся с просмотра видео на YouTube.

Когда экстремистское насилие напрямую связывается с платформой, это требует серьёзного отношения к гипотезе алгоритмической радикализации, независимо от статистических данных. Связь между технологией и реальным вредом становится неоспоримой.

Количественный аудит: что показало крупнейшее исследование 2 миллионов рекомендаций YouTube

В 2019 году исследователи из Федеральной политехнической школы Лозанны провели первое масштабное количественное исследование гипотезы «конвейера радикализации» на YouTube. Работа, опубликованная на конференции ACM FAT* (Fairness, Accountability, and Transparency), проанализировала более 2 миллионов видео- и канальных рекомендаций, собранных в период с мая по июль 2019 года (S003).

Это исследование стало поворотным моментом в дебатах, поскольку впервые предоставило крупномасштабные эмпирические данные вместо анекдотических свидетельств. Подробнее — в разделе Логические ошибки.

Методология: как исследователи картировали экосистему политического контента

Исследователи создали датасет из 792 каналов, разделённых на четыре категории: Media (мейнстримные новостные каналы); Intellectual Dark Web — интеллектуалы, критикующие прогрессивную идеологию; Alt-lite (правые популисты с провокационной риторикой); Alt-right (откровенные сторонники превосходства белой расы) (S003).

Для каждого канала собирались рекомендации двух типов: видео-рекомендации (какие видео YouTube предлагает после просмотра) и канальные рекомендации (какие каналы YouTube предлагает на странице канала). Анализировалась вероятность перехода между категориями через рекомендации.

Ключевой результат: отсутствие существенных доказательств систематического пайплайна

Главный вывод исследования: на момент 2019 года не существовало существенных количественных доказательств предполагаемого пайплайна (S003). Анализ показал, что видео-рекомендации YouTube крайне редко направляют пользователей от умеренного контента к экстремистскому.

Контент Alt-right практически не появляется в видео-рекомендациях даже для пользователей, смотрящих Alt-lite или Intellectual Dark Web. Это означает, что алгоритм не создаёт автоматический путь от умеренного контента к экстремистскому.

Исследователи обнаружили, что контент Alt-lite достижим из каналов Intellectual Dark Web через рекомендации, но видео Alt-right достижимы только через канальные рекомендации, а не через рекомендации конкретных видео (S003).

Нюанс: различие между видео-рекомендациями и канальными рекомендациями

Исследование выявило критическое различие между двумя типами рекомендаций:

| Тип рекомендации | Видимость для пользователя | Связь между категориями | Требуемое действие |

|---|---|---|---|

| Видео-рекомендации | Боковая панель, конец видео (высокая) | Слабая | Пассивный просмотр |

| Канальные рекомендации | Страница канала (низкая) | Сильная между I.D.W., Alt-lite, Alt-right | Активный переход на страницу канала |

Канальные рекомендации требуют целенаправленного действия пользователя — перехода на страницу канала и просмотра раздела рекомендаций. Это не пассивный «конвейер», а результат активного поиска похожего контента.

Временная динамика: изменения алгоритма после общественного давления

Исследование проводилось в 2019 году, после того как YouTube внёс изменения в алгоритм рекомендаций в ответ на критику. В январе 2019 года YouTube объявил о мерах по снижению рекомендаций «пограничного контента» — материала, который не нарушает правила платформы, но находится на грани.

Это означает, что исследование фиксирует состояние алгоритма после корректировок, а не в период 2015–2018 годов, когда предположительно «конвейер» работал наиболее активно. Критики исследования указывают на это как на ограничение: возможно, пайплайн существовал ранее, но был устранён к моменту исследования.

Связь между экономикой внимания и дизайном платформ показывает, что изменения алгоритма часто следуют за общественным давлением, а не предшествуют ему. Это создаёт методологическую проблему: исследования, проведённые после корректировок, не могут полностью подтвердить или опровергнуть гипотезы о поведении алгоритма в прошлом.

Механизм или миф: почему корреляция между просмотром и радикализацией не доказывает причинность

Даже если бы исследования показали, что пользователи, смотрящие экстремистский контент на YouTube, действительно радикализируются, это не доказывало бы, что алгоритм рекомендаций является причиной радикализации. Подробнее — в разделе Когнитивные искажения.

Фундаментальная проблема: корреляция не равна каузации. Наблюдение связи между двумя явлениями ничего не говорит о направлении влияния или о наличии третьих факторов.

🔁 Проблема обратной причинности: радикализация предшествует просмотру, а не следует за ним

Люди, уже имеющие радикальные взгляды или предрасположенность к ним, активно ищут соответствующий контент на YouTube. Алгоритм не толкает их к экстремизму — он лишь эффективно удовлетворяет существующий спрос.

Исследования радикализации показывают, что процесс обычно начинается с личного опыта, социального окружения или политических событий, а не с потребления медиа (S002, S005). Онлайн-контент может усиливать и легитимизировать уже существующие взгляды, но редко создаёт их с нуля.

- Пользователь переживает личный кризис (экономический, социальный, идентификационный)

- Формируется предрасположенность к определённым объяснениям и сообществам

- Активный поиск контента, соответствующего этой предрасположенности

- Алгоритм рекомендует релевантный материал (потому что пользователь его ищет)

- Наблюдатель видит корреляцию и ошибочно приписывает её алгоритму

🧬 Конфаундеры: третьи переменные, объясняющие и просмотр, и радикализацию

Множество факторов одновременно влияют на выбор контента и на радикализацию: авторитаризм, потребность в когнитивном закрытии, социальная изоляция, экономическая нестабильность, политическая поляризация в обществе.

| Конфаундер | Влияние на просмотр контента | Влияние на радикализацию |

|---|---|---|

| Экономический кризис | Поиск объяснений в конспирологии | Угроза статусу, поиск врага |

| Социальная изоляция | Онлайн-сообщества как замена | Уязвимость к групповому влиянию |

| Авторитарные черты личности | Предпочтение чёткой иерархии и врагов | Восприимчивость к авторитарным нарративам |

Без контроля этих конфаундеров невозможно изолировать эффект алгоритма. Человек, переживающий экономический кризис, может одновременно искать объяснения в конспирологических теориях и смотреть соответствующий контент. Алгоритм не создал его уязвимость — он лишь предоставил контент, резонирующий с уже существующими тревогами.

🎲 Проблема селекции: кто становится объектом исследований о радикализации

Большинство качественных исследований о роли YouTube в радикализации основаны на интервью с людьми, которые уже прошли через радикализацию и дерадикализацию. Это создаёт систематическую ошибку выжившего.

- Ошибка выжившего в контексте радикализации

- Мы слышим истории тех, кто радикализировался, но не слышим историй миллионов пользователей, которые смотрели похожий контент и не радикализировались. Возможно, YouTube рекомендовал экстремистский контент миллионам людей, но радикализировались только те, кто уже имел предрасположенность.

- Базовая частота

- Без знания, сколько людей получили рекомендации, но не радикализировались, невозможно оценить реальный эффект алгоритма. Если 0,01% получивших рекомендацию радикализировались, это совсем не то же самое, что если бы радикализировались 50%.

⚙️ Алгоритмическая власть и моральная ответственность: философский аспект каузации

Философские исследования алгоритмической власти поднимают вопрос о том, можно ли вообще приписывать алгоритмам причинную роль в социальных процессах (S007). Алгоритм — это инструмент, реализующий цели своих создателей и отражающий предпочтения пользователей.

Приписывание алгоритму автономной способности «радикализировать» людей антропоморфизирует технологию и перераспределяет ответственность. Реальные акторы: разработчики, выбравшие функцию оптимизации; руководители, приоритизировавшие прибыль над безопасностью; пользователи, делающие выбор смотреть определённый контент. Дискурс об «алгоритмической радикализации» может служить удобным способом избежать более сложных вопросов о социальных причинах экстремизма и о экономике внимания, которая стимулирует поляризацию независимо от алгоритма.

Конфликты в доказательной базе: где исследования расходятся и что это означает

Научная литература о роли YouTube в радикализации демонстрирует значительные расхождения в выводах. Эти расхождения не случайны — они отражают фундаментальные различия в методологии, временных рамках и географическом охвате. Подробнее — в разделе Источники и доказательства.

🧪 Качественные против количественных: почему методология определяет выводы

Качественные исследования, основанные на интервью и анализе отдельных случаев, поддерживают гипотезу «конвейера радикализации» (S002). Количественные исследования, анализирующие большие массивы данных о рекомендациях, не находят существенных доказательств систематического эффекта (S001, S003).

Это расхождение раскрывает ловушку в интерпретации данных: качественные методы выявляют существование феномена (да, некоторые люди радикализируются через YouTube), но не оценивают его распространённость. Количественные методы оценивают частоту, но могут упускать нюансы индивидуальных траекторий.

Ключевой вопрос: является ли алгоритмическая радикализация систематическим эффектом, затрагивающим значительную долю пользователей, или редким исключением, которое получает непропорциональное внимание из-за драматичности отдельных случаев?

Связь с экономикой внимания здесь прямая: редкие, но экстремальные события получают больше медиа-покрытия, что создаёт иллюзию их частотности.

📅 Временной фактор: изменения алгоритма и эволюция проблемы

Исследования разных периодов приходят к разным выводам, потому что сам объект исследования менялся. Работы 2015–2018 годов фиксируют более сильный эффект «конвейера», чем исследования 2019–2020 годов, после внедрения YouTube мер по снижению рекомендаций пограничного контента (S007).

Это создаёт методологическую проблему: мы не можем просто усреднить результаты исследований разных периодов, поскольку они описывают разные версии алгоритма. Критически важно различать утверждения о том, как алгоритм работал в прошлом, и утверждения о том, как он работает сейчас.

| Период | Характер выводов | Причина различий |

|---|---|---|

| 2015–2018 | Сильный эффект «конвейера» | Алгоритм оптимизирован на engagement, без фильтров экстремизма |

| 2019–2020 | Слабый или отсутствующий эффект | Внедрены меры по снижению рекомендаций пограничного контента |

| 2021–2024 | Требует новых исследований | Дальнейшие изменения в рекомендательной системе |

🌍 Географические и языковые ограничения: проблема генерализации

Подавляющее большинство исследований фокусируется на англоязычном контенте и пользователях из США и Западной Европы. Паттерны рекомендаций могут существенно различаться в других языковых и культурных контекстах.

Исследования радикализации в Центральной Азии показывают, что онлайн-пропаганда играет роль, но её эффективность сильно зависит от локального политического и социального контекста (S005). Обобщение выводов, полученных на англоязычном материале, на глобальную аудиторию YouTube методологически некорректно.

- Англоязычный контекст

- Высокая конкуренция контента, развитая система модерации, разнообразие альтернативных платформ. Алгоритм может быть менее радикализирующим просто потому, что конкуренция за внимание выше.

- Неанглоязычные контексты

- Меньше модерации, меньше альтернативных платформ, более гомогенные аудитории. Возможно, «конвейер радикализации» работает по-другому или эффективнее.

- Вывод

- Глобальные утверждения о YouTube требуют исследований, охватывающих минимум 5–10 языков и культурных контекстов. Текущая доказательная база этого не обеспечивает.

Связь с эпистемологией очевидна: мы не можем делать универсальные выводы из локальных данных без явного указания границ применимости.

Когнитивная анатомия мифа: какие ментальные ловушки делают нарратив о «пайплайне» таким убедительным

Почему гипотеза «конвейера радикализации» получила такое широкое распространение, несмотря на отсутствие убедительных количественных доказательств? Ответ лежит в когнитивных искажениях, которые делают этот нарратив психологически неотразимым. Подробнее — в разделе Астрология.

Первое искажение — иллюзия причинности. Когда человек видит, что кто-то смотрел видео о политике, а потом высказал радикальные взгляды, мозг автоматически связывает события причинно-следственной связью. Но это игнорирует третьи переменные: предыдущие убеждения, социальное окружение, жизненные обстоятельства.

Алгоритм YouTube становится козлом отпущения за явления, которые существовали задолго до его появления. Это когнитивно экономно: вместо анализа сложной социальной реальности мы указываем на одну кнопку.

Второе — подтверждающее смещение. Исследователи и журналисты ищут примеры радикализации через YouTube и находят их. Но они не считают миллионы людей, которые смотрят те же видео и остаются умеренными. (S003) показал именно это: рекомендации не создают радикальный путь, они его усиливают для уже предрасположенных.

- Человек с радикальными взглядами ищет контент, соответствующий его убеждениям

- Алгоритм рекомендует похожий контент (это его работа)

- Наблюдатель видит цепь видео и заключает: алгоритм радикализировал человека

- На самом деле: алгоритм отразил уже существующую траекторию

Третье — нарративная привлекательность. История о «конвейере» имеет четкую структуру: злодей (алгоритм), жертва (пользователь), спасение (регулирование). Это архетип, который работает в медиа, политике и науке. Теории заговора часто побеждают скучные статистические выводы именно потому, что они рассказывают лучшую историю.

Четвертое — моральная паника. Каждое новое средство коммуникации вызывает страх: печать якобы развращала молодежь, телевидение якобы делало людей пассивными, интернет якобы разрушал общество. YouTube попал в этот цикл. (S002) документирует, как медиа-нарратив о «rabbit hole» сформировался раньше, чем появились данные.

- Эффект ореола

- Если источник (исследователь, журналист, организация) авторитетен в одной области, его утверждения в другой кажутся более убедительными. Компьютерные ученые говорят об алгоритмах — звучит как факт, хотя это может быть спекуляция.

- Доступность информации

- Драматичные истории о радикализации легче вспомнить, чем статистику о 99% пользователей, которые не радикализировались. Мозг использует доступность как прокси для частоты.

Пятое — институциональный интерес. Исследователям проще получить финансирование на проект о «опасности алгоритмов», чем на проект о «алгоритмы работают как ожидается». Журналистам проще написать статью о угрозе, чем о отсутствии угрозы. Политикам проще регулировать видимого врага, чем решать социальные проблемы.

Это не заговор — это структурные стимулы. Экономика внимания награждает сенсационность. Система науки награждает новизну. Политика награждает простые решения.

Результат: нарратив о «конвейере» становится самоподдерживающимся. Каждое новое исследование, даже если оно опровергает гипотезу, интерпретируется как подтверждение. (S007) использовал контрфактические боты и показал, что рекомендации YouTube не вызывают радикализацию. Но вывод часто переформулируют как «YouTube может радикализировать, если условия благоприятны» — что уже не фальсифицируемо.

Когнитивная иммунология здесь требует одного: различать между «алгоритм может усилить существующие тренды» и «алгоритм создает радикализацию». Первое вероятно. Второе — не доказано. И это различие имеет значение для политики, исследований и вашего собственного мышления.