Что такое ошибка чёрного ящика и почему она не сводится к простому незнанию механизма работы

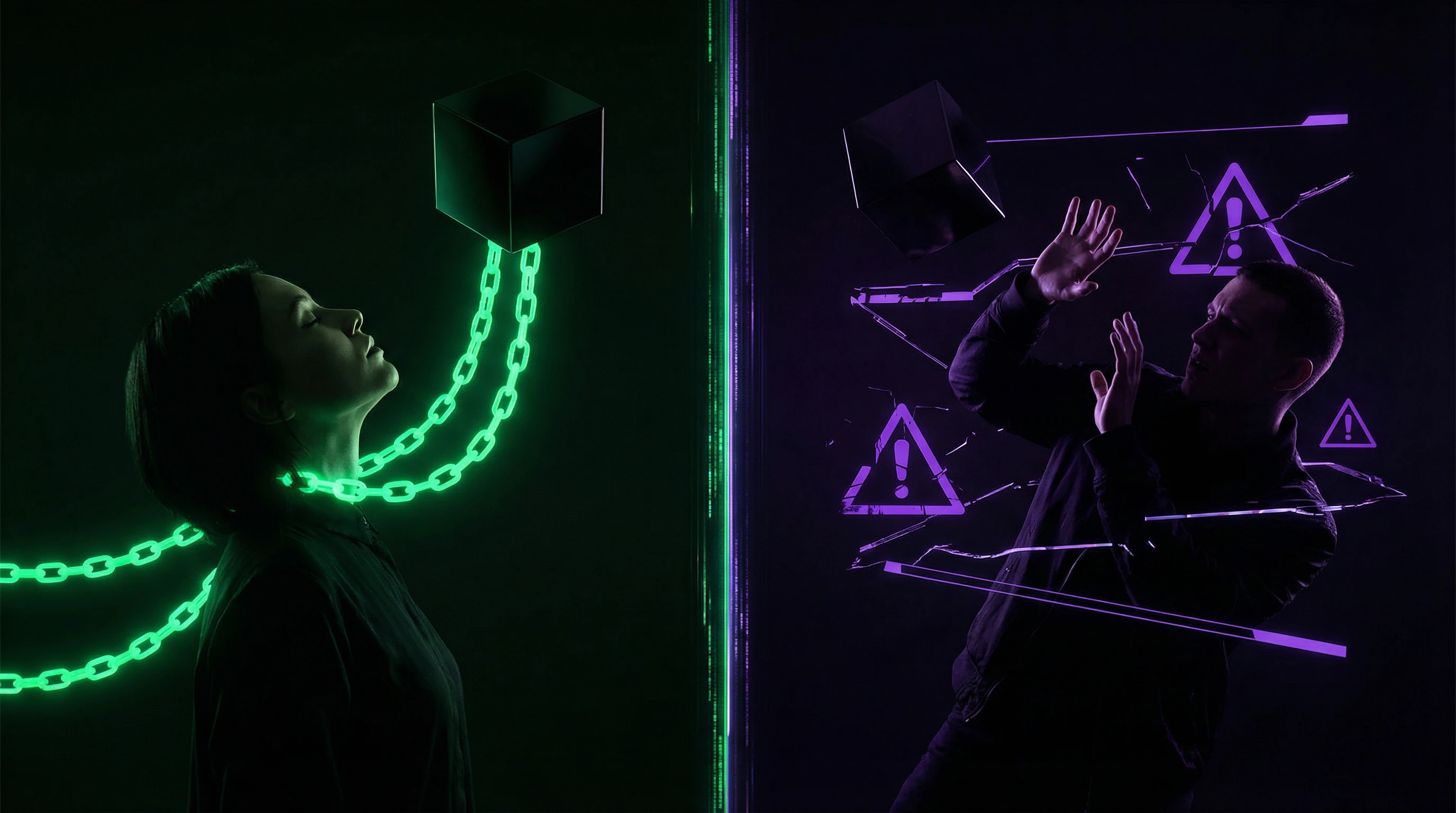

Ошибка чёрного ящика (black box fallacy) — это когнитивное искажение, при котором человек формирует крайнюю оценку системы (полное доверие или полное отвержение) исключительно на основании непрозрачности её внутреннего устройства, игнорируя эмпирические данные о её эффективности, надёжности и контексте применения. Подробнее — в разделе Критическое мышление.

Это не просто незнание — это замена анализа результатов анализом доступности информации о процессе.

🧩 Два полюса одной ошибки: слепое доверие и параноидальное отвержение

Ошибка проявляется в двух противоположных формах. Первая — слепое доверие авторитету непрозрачности: «Это сложная система, я не понимаю, как она работает, значит, она точно правильная». Вторая — параноидальное отвержение: «Я не вижу, что внутри, значит, это обман/опасность/манипуляция».

Обе формы объединяет подмена: вместо оценки валидности выходных данных, воспроизводимости результатов и соответствия системы задаче человек оценивает только степень своего понимания механизма.

⚠️ Почему это не то же самое, что эвристика доступности или эффект ореола

Ошибка чёрного ящика отличается от смежных когнитивных искажений. Эвристика доступности работает с лёгкостью извлечения примеров из памяти. Эффект ореола переносит оценку одного качества на другие.

- Ошибка чёрного ящика

- активируется именно непрозрачностью процесса и приводит к игнорированию эмпирических данных о результатах. Человек может знать, что система ошибается в 30% случаев, но продолжать ей доверять, потому что «алгоритм сложный». Или наоборот: система демонстрирует 95% точности, но отвергается, потому что «непонятно, как она это делает».

🔎 Границы применимости термина: где ошибка есть, а где её нет

Не любое использование непрозрачной системы — ошибка. Если вы принимаете аспирин, не зная механизма ингибирования циклооксигеназы, но опираетесь на мета-анализы эффективности и профиль безопасности — это рациональное делегирование экспертизе.

| Сценарий | Основание решения | Это ошибка? |

|---|---|---|

| Врач назначает препарат только потому, что «это новая разработка, механизм сложный» | Непрозрачность процесса | Да — игнорирует отсутствие РКИ |

| Пациент отказывается от вакцины с доказанной эффективностью | «Не понимаю, что там внутри» | Да — вытесняет анализ доказательств |

| Пациент принимает препарат на основе мета-анализов, не зная механизма | Эмпирические данные о результатах | Нет — рациональное делегирование |

Ошибка возникает, когда непрозрачность становится единственным или главным критерием оценки, вытесняя анализ доказательств.

Пять самых сильных аргументов в пользу того, что непрозрачность систем действительно создаёт проблему доверия

Опасения по поводу непрозрачных систем не беспочвенны. Существуют реальные риски, связанные с делегированием решений системам, внутреннее устройство которых недоступно для проверки. Подробнее — в разделе Статистика и теория вероятностей.

🧪 Аргумент 1: Невозможность аудита и воспроизводимости результатов в критических областях

Когда система принимает решения, влияющие на жизнь и здоровье (медицинская диагностика, судебные алгоритмы оценки рисков, системы управления критической инфраструктурой), невозможность аудита её логики создаёт реальную проблему ответственности.

Если алгоритм рекомендует отказать в условно-досрочном освобождении или назначает химиотерапию, но никто не может объяснить, на основании каких признаков принято решение, это невозможность выявить систематическую ошибку или предвзятость до того, как она причинит вред.

🔬 Аргумент 2: История медицины полна примеров «работающих» методов, оказавшихся вредными

Кровопускание «работало» веками — пациенты иногда выздоравливали, врачи наблюдали корреляцию. Лоботомия получила Нобелевскую премию. Талидомид прошёл клинические испытания.

Непрозрачность механизма в сочетании с наблюдаемым эффектом не гарантирует безопасности. Требование понимания механизма — это урок истории: корреляция без понимания причинности может маскировать вред, который проявится позже или в других условиях.

📊 Аргумент 3: Алгоритмические системы могут воспроизводить и усиливать скрытые предвзятости

Непрозрачные модели машинного обучения, обученные на исторических данных, кодируют расовые, гендерные, социально-экономические предвзятости, не делая их явными.

- Система оценки кредитных рисков может дискриминировать по почтовому индексу

- Система рекрутинга — по имени

- Система медицинской диагностики — по доступу к предыдущим обследованиям

Без прозрачности эти предвзятости невозможно обнаружить и скорректировать до масштабирования системы.

⚠️ Аргумент 4: Асимметрия информации создаёт пространство для манипуляции

Когда разработчик системы знает её ограничения, а пользователь — нет, возникает классическая проблема асимметричной информации. Производитель диагностического ИИ может знать, что система работает только на определённых демографических группах или типах изображений, но продавать её как универсальное решение.

Без прозрачности методологии, обучающих данных и валидации пользователь не может оценить реальную применимость системы к своему контексту. Это особенно опасно в техно-эзотерике, где непрозрачность часто служит маркером якобы «продвинутости».

🧠 Аргумент 5: Делегирование решений непрозрачным системам атрофирует экспертизу

Если врачи начинают полагаться на рекомендации системы поддержки принятия решений, не понимая её логики, они постепенно теряют способность принимать решения самостоятельно. Это создаёт хрупкость: при сбое системы, её недоступности или применении в нестандартной ситуации эксперт оказывается беспомощным.

- Непрозрачность ускоряет атрофию, потому что не оставляет возможности для обучения через понимание логики системы

- Эксперт теряет способность критически оценивать рекомендации

- Организация становится зависима от чёрного ящика вместо развития компетентности

Что говорят систематические обзоры и мета-анализы о реальной эффективности непрозрачных систем в медицине и обучении

Переходя от аргументов к доказательствам, нужно разделить два вопроса: работают ли непрозрачные системы (эмпирическая эффективность) и можно ли сделать их прозрачными без потери эффективности (техническая возможность). Мета-анализы последних лет дают неожиданные ответы на оба.

📊 ИИ-чатботы демонстрируют более высокую эмпатию, чем врачи, в контролируемых исследованиях

Систематический обзор, сравнивающий ИИ-чатботы и медицинских специалистов в контексте эмпатии при уходе за пациентами, выявил парадокс: в контролируемых условиях ИИ-системы демонстрировали более высокие показатели воспринимаемой эмпатии, чем живые врачи (S004). Это не означает, что ИИ «чувствует» — структурированные, последовательные, неспешные ответы алгоритма воспринимались пациентами как более внимательные, чем торопливые консультации перегруженных специалистов.

Непрозрачность механизма не помешала системе превзойти человека по измеряемому критерию качества взаимодействия.

🧪 Системы поддержки принятия врачебных решений (CDSS) улучшают диагностическую точность при правильной интеграции

Анализ эффективности CDSS показывает значительное улучшение диагностической точности и снижение врачебных ошибок, но только при условии правильной интеграции в клинический процесс и обучения персонала (S010). Ключевой фактор — не прозрачность алгоритма, а прозрачность процесса использования: врач должен понимать, какие данные система учитывает, какие ограничения имеет, как интегрировать рекомендации в клиническое мышление.

Непрозрачность внутреннего алгоритма не была критическим фактором эффективности.

🔎 Диагностическая точность ИИ в скрининге превосходит человека в узкоспециализированных задачах

Мета-анализ диагностической точности ИИ для скрининга специфических состояний демонстрирует, что в узкоспециализированных задачах (выявление диабетической ретинопатии, обнаружение ранних признаков рака лёгких на КТ) ИИ-системы достигают чувствительности и специфичности, сопоставимых или превосходящих показатели опытных специалистов (S011). Критически важно: эти результаты получены в условиях, когда врачи не понимали внутреннюю логику алгоритма, но могли оценить его выходные данные и интегрировать их в диагностический процесс.

- Система работает на узкой, хорошо определённой задаче

- Выходные данные валидированы на независимых когортах

- Врач может оценить результат в контексте клинической картины

- Механизм остаётся непрозрачным, но это не снижает полезность

🧬 Когнитивный анализ задач (CTA) в хирургии: раскрытие чёрного ящика экспертного мышления улучшает обучение

Систематический обзор влияния когнитивного анализа задач на хирургическое образование показывает противоположную сторону проблемы: когда «чёрный ящик» экспертного мышления хирурга раскрывается через структурированный анализ когнитивных процессов принятия решений, эффективность обучения значительно возрастает (S005). Мета-анализ 12 исследований выявил большой размер эффекта в пользу CTA-обучения по сравнению с традиционными методами.

Это демонстрирует, что прозрачность процесса мышления эксперта критически важна для передачи экспертизы, даже если сам эксперт не может вербализовать все свои решения без структурированного анализа. Подробнее — в разделе Дебанкинг и пребанкинг.

⚙️ Прогностическая роль МРТ: когда непрозрачность биологического процесса не мешает клинической пользе

Исследования прогностической роли магнитно-резонансной томографии показывают, что МРТ-биомаркеры могут предсказывать исходы заболеваний с высокой точностью, даже когда точный биологический механизм связи между визуализируемым признаком и исходом остаётся неясным (S012). Врачи используют эти прогностические модели, не понимая полностью патофизиологию, но опираясь на валидированные корреляции.

Это рациональное использование непрозрачности: механизм неясен, но воспроизводимость, валидация на независимых когортах и клиническая полезность доказаны.

Механизм ошибки: как непрозрачность эксплуатирует эволюционные эвристики и создаёт иллюзию понимания

Ошибка чёрного ящика не возникает в вакууме — она эксплуатирует несколько фундаментальных особенностей человеческого познания, сформированных эволюцией для решения задач в условиях ограниченной информации и времени. Подробнее — в разделе Проверка Реальности.

🧩 Эвристика «сложность = компетентность» и её эволюционные корни

В социальной среде наших предков сложность объяснения часто коррелировала с экспертизой: шаман, способный дать сложное объяснение болезни, вероятно, обладал большим опытом, чем тот, кто давал простое. Эта эвристика работала, потому что сложность была дорогостоящим сигналом — её трудно подделать без реального знания.

Но в современном мире сложность легко имитировать: псевдонаучный жаргон, сложные диаграммы, многоступенчатые алгоритмы могут создавать видимость экспертизы без её содержания. Непрозрачность системы активирует эту эвристику: «Я не понимаю, значит, это сложно, значит, создатели компетентны».

Сложность перестала быть сигналом компетентности — она стала инструментом манипуляции. Непрозрачность позволяет выдавать имитацию за реальность.

🔁 Иллюзия объяснительной глубины и переоценка собственного понимания

Люди систематически переоценивают глубину своего понимания причинно-следственных механизмов. Когда человек может назвать систему («это нейросеть», «это квантовый компьютер», «это блокчейн»), он часто ошибочно полагает, что понимает, как она работает.

Непрозрачность системы парадоксально усиливает эту иллюзию: отсутствие деталей позволяет заполнить пробелы упрощёнными ментальными моделями, которые кажутся достаточными. Человек не осознаёт границ своего незнания, потому что система не предоставляет информации, которая могла бы эти границы обнажить.

- Назвал систему — почувствовал понимание

- Непрозрачность скрывает пробелы в этом понимании

- Отсутствие противоречивых данных укрепляет иллюзию

- Критическое мышление отключается

⚠️ Асимметрия доверия: почему легче поверить в магию, чем проверить статистику

Проверка эмпирических данных об эффективности системы требует когнитивных усилий: нужно найти исследования, оценить их методологию, понять статистику, учесть контекст. Принятие на веру или отвержение на основании непрозрачности требует нулевых усилий.

Эволюционно мы настроены минимизировать когнитивные затраты. Непрозрачность создаёт асимметрию: путь наименьшего сопротивления — это крайняя оценка (полное доверие или полное отвержение), а не трудоёмкий анализ доказательств.

| Сценарий | Когнитивные затраты | Результат |

|---|---|---|

| Проверить исследования об эффективности | Высокие | Обоснованное суждение |

| Поверить в непрозрачность как в сигнал качества | Нулевые | Иллюзия понимания |

| Отвергнуть систему как «чёрный ящик» | Нулевые | Необоснованный скептицизм |

🧬 Конфаундер контекста: когда непрозрачность коррелирует с новизной и сложностью задачи

Непрозрачные системы часто применяются в новых, сложных областях, где ещё нет устоявшихся стандартов оценки. Это создаёт конфаундер: плохие результаты могут быть следствием не непрозрачности, а незрелости технологии или неправильного применения.

Хорошие результаты могут быть следствием не качества системы, а тщательного отбора задач, где она работает. Без контроля этого конфаундера невозможно отделить эффект непрозрачности от эффекта новизны. Это особенно критично в областях, где технологический мистицизм уже создал благодатную почву для переоценки возможностей.

Где доказательства сильны, а где остаются пробелы: честный анализ ограничений текущих данных

Критический анализ требует признания не только того, что мы знаем, но и того, чего мы не знаем. Систематические обзоры и мета-анализы имеют собственные ограничения, которые необходимо учитывать при интерпретации результатов. Подробнее — в разделе Логика и вероятность.

📊 Публикационное смещение: видимы только успехи

Исследования, демонстрирующие высокую эффективность ИИ-систем, публикуются чаще, чем исследования с нулевыми или отрицательными результатами. Это создаёт систематическое смещение в мета-анализах: оценки эффективности могут быть завышены на 20–40% в зависимости от области.

Проблема усугубляется тем, что многие ИИ-системы разрабатываются коммерческими компаниями, которые контролируют доступ к данным и могут выборочно публиковать результаты. Без доступа к протоколам неопубликованных исследований невозможно оценить истинный масштаб этого смещения.

Если видны только успехи, карта эффективности становится картой маркетинга, а не реальности.

🔬 Гетерогенность: разные исследования говорят на разных языках

Разные исследования используют разные метрики эффективности, разные популяции, разные условия применения (S001, S003, S007). Это затрудняет прямое сравнение и обобщение результатов.

Для ИИ-систем проблема особенно остра: нет консенсуса о том, как оценивать «объяснимость» или «прозрачность», нет стандартных бенчмарков для сравнения систем в реальных клинических условиях. Один исследователь может считать систему «объяснимой», если она выдаёт коэффициенты; другой потребует полной трассировки логики решения.

- Метрика A: точность на тестовом наборе

- Метрика B: чувствительность и специфичность

- Метрика C: время принятия решения

- Метрика D: согласованность с экспертным мнением

- Метрика E: удовлетворённость пользователя

Каждая метрика отвечает на разный вопрос. Без стандартизации невозможно сказать, какая система лучше.

⚠️ Разрыв между лабораторией и клиникой

Большинство исследований проводятся в контролируемых условиях: тщательно отобранные датасеты, стандартизированные протоколы, отсутствие временного давления. Реальная клиническая практика радикально отличается: неполные данные, нестандартные случаи, необходимость быстрых решений, интеграция с существующими рабочими процессами.

Эффективность, продемонстрированная в исследовании, может не воспроизводиться в реальных условиях. Систематических данных о долгосрочных результатах внедрения ИИ-систем в рутинную практику пока недостаточно. Это не означает, что системы неэффективны — это означает, что мы не знаем, насколько хорошо они работают там, где они действительно используются.

| Параметр | Контролируемое исследование | Реальная практика |

|---|---|---|

| Качество данных | Высокое, стандартизированное | Неполное, вариативное |

| Временное давление | Отсутствует | Высокое |

| Интеграция с рабочим процессом | Идеальная | Часто конфликтная |

| Отбор случаев | Репрезентативный | Смещённый (тяжёлые случаи) |

🧪 Атрофия экспертизы: теория без данных

Аргумент об атрофии экспертизы при делегировании решений непрозрачным системам теоретически обоснован, но эмпирически слабо подтверждён. Нет долгосрочных исследований, отслеживающих изменение когнитивных навыков врачей, использующих системы поддержки решений, по сравнению с контрольной группой.

Нет данных о том, как меняется способность принимать решения в нестандартных ситуациях после многолетнего использования ИИ-ассистентов. Это критический пробел: если атрофия реальна, её эффекты могут проявиться через годы, когда откат назад будет невозможен. Мы можем только гадать, опираясь на когнитивные искажения и эволюционную психологию.

Мы знаем механизм, но не знаем масштаба. Это опаснее, чем не знать ничего.

Сильные стороны доказательной базы: эффективность ИИ-систем в узких, хорошо определённых задачах (диагностика по изображениям, скрининг) подтверждена множеством исследований. Слабые стороны: долгосрочные эффекты, влияние на когнитивные навыки, реальная клиническая эффективность, механизмы ошибок при делегировании решений — всё это остаётся в тени.

Когнитивная анатомия ошибки: какие именно искажения эксплуатируются и как они взаимодействуют

Ошибка чёрного ящика — не изолированное искажение, а узел в сети взаимосвязанных когнитивных уязвимостей. Понимание этой сети необходимо для разработки эффективных контрмер. Подробнее — в разделе Ошибки и предвзятость ИИ.

🧩 Эффект ореола технологии: перенос престижа на конкретную систему

Если ИИ-системы в целом ассоциируются с прогрессом и инновациями, эта позитивная оценка переносится на конкретную систему без анализа её индивидуальных характеристик. «Это ИИ» становится достаточным основанием для доверия.

Непрозрачность усиливает эффект: отсутствие деталей не позволяет обнаружить, что конкретная система может быть плохо спроектирована, недостаточно валидирована или применена не по назначению. Это особенно опасно в контексте техно-эзотерики, где технологический язык сам становится источником авторитета.

⚠️ Ошибка атрибуции агентности: приписывание системе намерений и понимания

Люди склонны приписывать агентность (намерения, цели, понимание) системам, демонстрирующим сложное поведение. Когда ИИ-чатбот даёт эмпатичный ответ, легко забыть, что это результат статистической оптимизации, а не понимания эмоций.

Непрозрачность усиливает эту иллюзию: если мы не видим механизм, легче представить, что внутри есть «понимание». Это приводит к переоценке надёжности системы — мы доверяем ей так, как доверяли бы понимающему эксперту, хотя система не обладает гибкостью и контекстуальным пониманием человека.

🔁 Петля подтверждения: как использование системы усиливает доверие к ней

Каждое успешное применение системы (даже случайное совпадение) интерпретируется как подтверждение её компетентности. Неудачи переатрибутируются: ошибка пользователя, неправильный контекст, недостаточно точный запрос — всё, кроме самой системы.

- Пользователь применяет систему и получает результат

- Результат интерпретируется как успех (даже если это совпадение)

- Доверие к системе растёт

- Пользователь применяет систему в более сложных ситуациях

- Неудачи объясняются внешними факторами, а не ограничениями системы

- Цикл повторяется, доверие укрепляется

Непрозрачность блокирует выход из этого цикла: нет способа проверить, действительно ли система работает лучше, чем случайность, или это эвристика доступности — мы помним успехи и забываем неудачи.

🎯 Взаимодействие искажений: синергия уязвимостей

Эти три механизма не действуют независимо. Эффект ореола создаёт начальное доверие, ошибка атрибуции агентности делает систему психологически «живой» и ответственной, а петля подтверждения закрепляет оба эффекта.

Добавьте игнорирование базовой частоты — пользователь не знает, насколько часто система ошибается в целом — и получите идеальный шторм: система воспринимается как компетентная, понимающая и надёжная, хотя на самом деле это просто чёрный ящик, который иногда выдаёт полезные результаты.

Непрозрачность — это не просто отсутствие информации. Это активный катализатор, который превращает нормальные когнитивные процессы в систематические ошибки суждения.