Теория мёртвого интернета: от анонимного поста до массовой паники — что именно утверждается и почему это важно

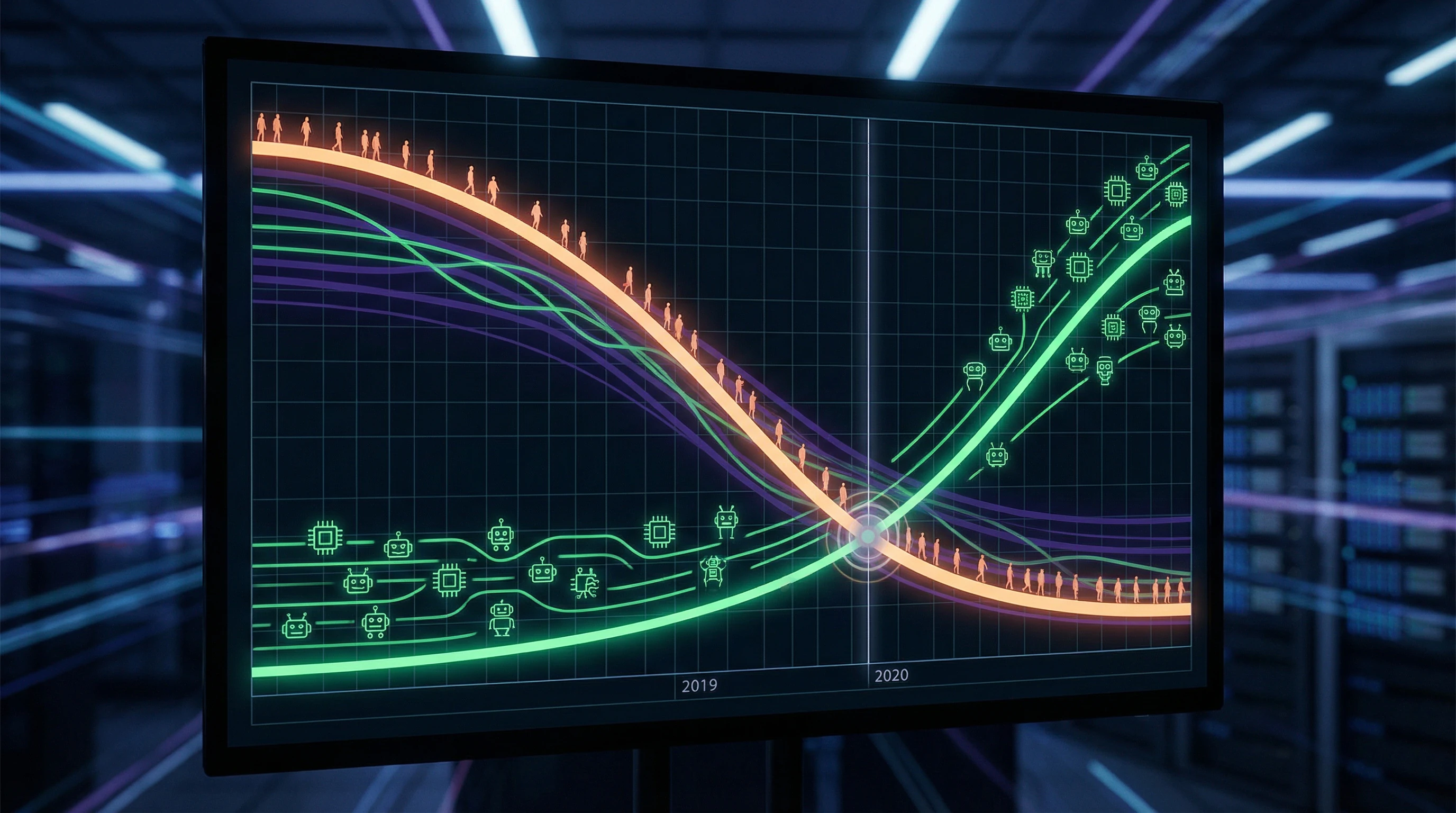

Теория мёртвого интернета (Dead Internet Theory) — это конспирологическая гипотеза, утверждающая, что значительная часть онлайн-активности, контента и взаимодействий генерируется не живыми людьми, а ботами, алгоритмами и искусственным интеллектом. Согласно этой теории, интернет «умер» примерно в 2016–2017 годах, когда автоматизированные системы достигли критической массы и начали доминировать над человеческим присутствием. Подробнее — в разделе Ментальные ошибки.

Сторонники теории утверждают, что корпорации и правительства намеренно поддерживают иллюзию живого интернета, чтобы манипулировать общественным мнением, продавать рекламу и контролировать информационное пространство.

Интернет не просто изменился — он якобы перестал быть пространством человеческого общения и превратился в театр теней, где люди взаимодействуют с симуляциями.

⚠️ Ключевые утверждения теории: что именно считается «мёртвым»

Теория опирается на четыре взаимосвязанных утверждения. Большинство комментариев в социальных сетях якобы пишутся ботами, а не реальными пользователями. Значительная доля контента — статей, видео, постов — генерируется алгоритмами для создания видимости активности.

- Тренды и вирусные явления

- Якобы искусственно создаются и поддерживаются автоматизированными системами, а не возникают органично из человеческих интересов.

- Соотношение активности

- Реальные люди составляют меньшинство онлайн-активности, их взаимодействия тонут в море синтетического шума.

🧩 Исторический контекст: как анонимный пост стал культурным феноменом

Первое систематическое изложение теории появилось на форуме Agora Road's Macintosh Cafe в 2021 году, хотя отдельные элементы циркулировали на имиджбордах с 2016 года. Пост описывал интернет как «мёртвое пространство», где алгоритмы имитируют человеческую активность настолько убедительно, что большинство пользователей не замечают подмены.

Теория быстро распространилась на Reddit, Twitter и YouTube, где нашла отклик у людей, испытывающих «цифровую усталость» и ощущение нереальности онлайн-взаимодействий. К 2023 году, после запуска ChatGPT и взрывного роста генеративного ИИ, теория получила второе дыхание — теперь уже не как конспирология, а как описание наблюдаемой реальности.

| Период | Статус теории | Триггер распространения |

|---|---|---|

| 2016–2020 | Маргинальная гипотеза на имиджбордах | Рост ботов в соцсетях |

| 2021 | Систематизированная конспирология | Пост на Macintosh Cafe |

| 2023–2024 | Квазинаучное наблюдение | Взрывной рост генеративного ИИ |

🔎 Границы анализа: что мы проверяем и чего не проверяем

В этой статье мы фокусируемся на проверяемых утверждениях теории: долю автоматизированного контента, статистику ботов, данные о синтетических медиа. Мы не рассматриваем конспирологические элементы о «глобальном заговоре» или «намеренном убийстве интернета» — эти утверждения не поддаются эмпирической проверке.

Наша задача — отделить наблюдаемые тренды от когнитивных искажений и показать, где заканчивается статистика и начинается параноидальная интерпретация. Это не означает, что теория полностью ложна — скорее, она смешивает реальные явления с неверными выводами о их причинах и масштабах.

Стальная версия теории: семь самых убедительных аргументов в пользу «мёртвого интернета» — и почему их нельзя игнорировать

Прежде чем разбирать теорию, необходимо представить её в максимально сильной форме — так называемый «steelman argument». Это интеллектуально честный подход: мы берём лучшие аргументы сторонников теории, очищаем их от эмоций и конспирологии, и проверяем, насколько они соответствуют данным. Подробнее — в разделе Критическое мышление.

Ниже — семь наиболее убедительных наблюдений, которые питают теорию мёртвого интернета.

⚠️ Аргумент первый: экспоненциальный рост ботов в социальных сетях

Статистика ботов в социальных сетях действительно тревожная. По различным оценкам, от 15% до 60% аккаунтов в Twitter (до ребрендинга в X) были автоматизированными или полуавтоматизированными.

Facebook регулярно удаляет миллиарды фейковых аккаунтов ежеквартально — в 2022 году компания заблокировала более 1.6 миллиарда аккаунтов за три месяца. Instagram борется с ботами, которые генерируют комментарии, лайки и подписки.

Если платформы удаляют миллиарды ботов, сколько ещё остаётся необнаруженными? Эти цифры не являются секретом — они публикуются в отчётах самих платформ.

🧩 Аргумент второй: синтетический контент стал неотличим от человеческого

С появлением GPT-3, GPT-4 и других больших языковых моделей граница между человеческим и машинным текстом размылась. Исследования показывают, что люди не могут надёжно отличить текст, написанный ИИ, от человеческого — точность определения колеблется около 50%, что эквивалентно случайному угадыванию.

Генеративные модели создают статьи, посты в соцсетях, комментарии, которые проходят модерацию и воспринимаются как подлинные. Если мы не можем отличить синтетический контент, как мы можем быть уверены, что общаемся с людьми?

🔁 Аргумент третий: рост «пустого» контента и контентных ферм

Интернет переполнен низкокачественным контентом, созданным для SEO и монетизации рекламы. Контентные фермы генерируют тысячи статей в день, используя шаблоны и автоматизацию.

YouTube заполнен автоматически сгенерированными видео — компиляциями, перезаливками, роботизированными озвучками. TikTok и Instagram Reels показывают бесконечные вариации одного и того же контента, созданного по алгоритмическим шаблонам.

- Контент создаётся ради контента, а не ради смысла

- Человеческое творчество становится редким исключением

- Алгоритмы оптимизируют под вирусность, не под качество

📊 Аргумент четвёртый: манипуляция трендами и искусственная вирусность

Документированы случаи, когда тренды в социальных сетях создавались искусственно через ботнеты и координированные кампании. Политические акторы используют автоматизированные системы для продвижения хештегов, дискредитации оппонентов, создания иллюзии массовой поддержки.

Маркетинговые агентства продают «вирусность» как услугу, используя сети ботов для накрутки просмотров, лайков и репостов. Если тренды можно купить, как мы можем доверять тому, что видим в ленте?

🧠 Аргумент пятый: феномен «цифровой дереализации» у пользователей

Многие пользователи сообщают о субъективном ощущении «нереальности» онлайн-взаимодействий. Комментарии кажутся шаблонными, диалоги — повторяющимися, реакции — предсказуемыми.

Психологи фиксируют рост «цифровой усталости» и ощущения, что «все вокруг боты». Это субъективное переживание не является доказательством, но оно массово и устойчиво.

Коллективное бессознательное может распознавать изменившуюся природу интернета раньше, чем это фиксируют данные. Но субъективное ощущение и объективная реальность — разные вещи.

🕳️ Аргумент шестой: снижение качества поиска и рост SEO-спама

Google и другие поисковики всё чаще выдают низкокачественные, автоматически сгенерированные результаты. SEO-оптимизированные статьи, созданные ИИ, вытесняют оригинальный контент.

Пользователи жалуются, что поиск стал «бесполезным» — первые страницы заполнены рекламой, спамом и контентными фермами. Интернет оптимизируется под алгоритмы, а не под людей, что делает его менее пригодным для человеческих потребностей.

⚙️ Аргумент седьмой: экономические стимулы для автоматизации контента

Создание контента людьми дорого и медленно. Автоматизация дешева и масштабируема. Рекламные платформы платят за просмотры и клики, независимо от того, кто их генерирует.

- Экономическая логика

- Подталкивает к замене людей алгоритмами. В капиталистической системе, где контент — товар, неизбежна его индустриализация.

- «Мёртвый интернет»

- Не заговор, а естественный результат рыночных сил, когда масштабируемость побеждает качество.

Доказательная база: что говорят данные о реальной доле синтетического контента — цифры, исследования, факты без эмоций

От аргументов переходим к проверяемым данным. Подробнее — в разделе Источники и доказательства.

🧪 Статистика ботов: что показывают исследования трафика

Imperva, компания по кибербезопасности, ежегодно публикует отчёты о составе интернет-трафика. В 2022 году около 47.4% всего веб-трафика генерировалось ботами — как «хорошими» (поисковые краулеры, мониторинговые системы), так и «плохими» (скрейперы, спам-боты, DDoS-атаки). Доля «плохих» ботов составила 30.2% от общего трафика.

Трафик не равен контенту. Боты генерируют множество запросов, но это не означает, что они создают контент, видимый людям.

📊 Синтетический контент в социальных сетях: данные платформ

Twitter оценивал долю ботов в 5% от активных аккаунтов, но независимые исследователи называли 9–15%. Илон Маск, оспаривая покупку платформы, утверждал, что реальная доля может достигать 20% и выше. Facebook удалил 1.9 миллиарда фейковых аккаунтов за Q2 2022 — около 5% от общей базы пользователей.

Instagram борется с автоматизированными системами, генерирующими комментарии и лайки, но точных цифр не публикует. Проблема ботов реальна, но масштаб зависит от методологии подсчёта.

🧾 Генеративный ИИ и текстовый контент: исследования распространённости

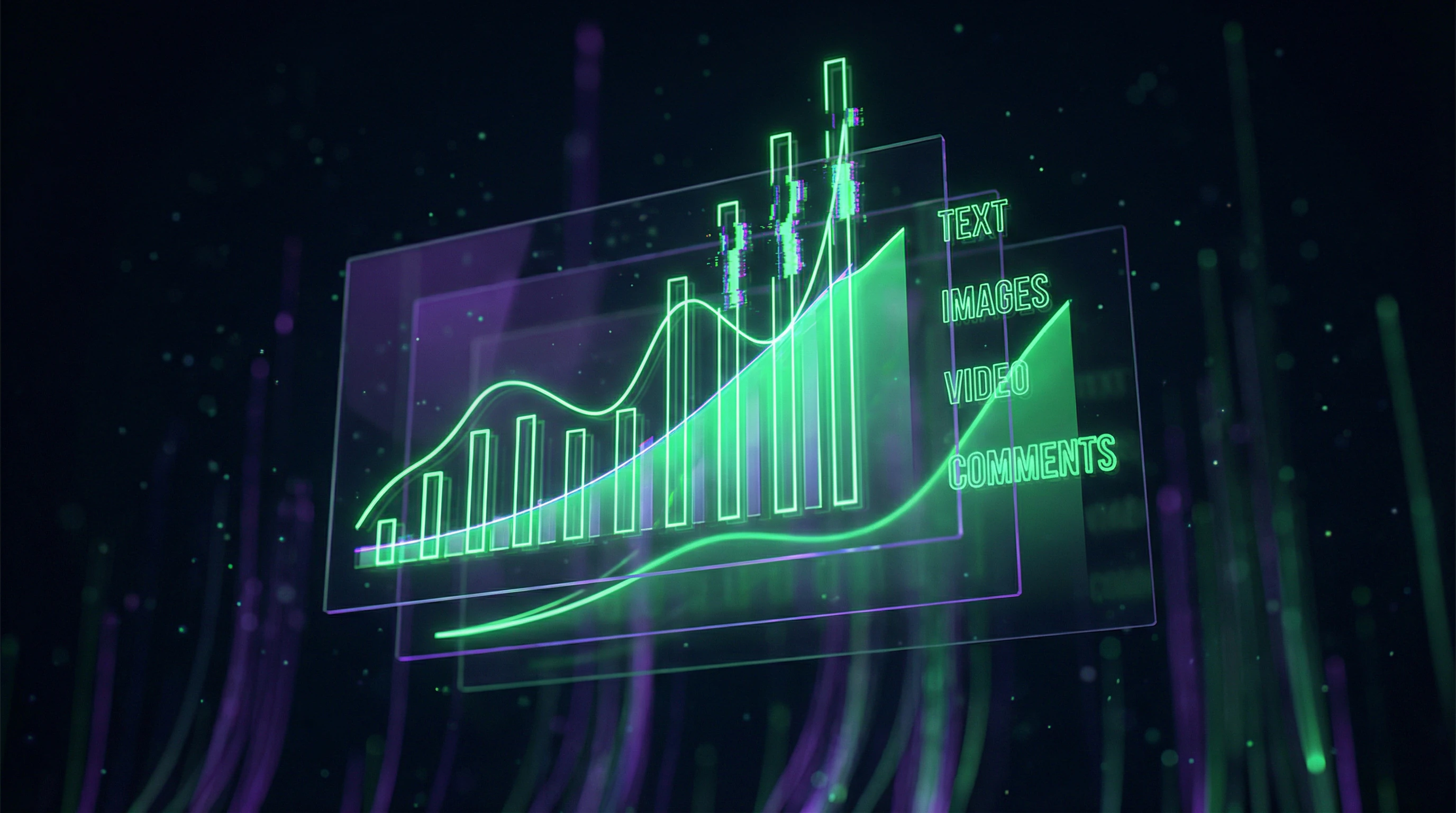

После запуска ChatGPT в ноябре 2022 года доля ИИ-генерированного текста начала расти экспоненциально. Исследование Originality.AI (2023) показало: около 10–15% новых статей в англоязычном сегменте содержат признаки генерации ИИ.

| Ниша контента | Доля ИИ-контента | Надёжность детекции |

|---|---|---|

| Общий интернет | 10–15% | 70–80% |

| SEO-контент, обзоры, новостные агрегаторы | 40–60% | 60–70% |

Методология детекции ИИ-текста несовершенна — ложноположительные и ложноотрицательные результаты составляют 20–30%. Точные цифры неизвестны, но тренд очевиден: синтетический текст становится нормой.

🔬 Синтетические изображения и видео: данные о deepfakes и генеративных моделях

Генеративные модели (Midjourney, DALL-E, Stable Diffusion для изображений; Runway, Synthesia для видео) сделали создание синтетических медиа доступным массово. Исследование Sensity AI показало: количество deepfake-видео удваивается каждые шесть месяцев.

- В 2023 году зафиксировано более 95,000 deepfake-видео (большинство — порнографического содержания).

- Это только обнаруженные случаи.

- Синтетические изображения для иллюстраций, рекламы, соцсетей не поддаются точному подсчёту — неотличимы от фотографий и не маркируются.

🧬 Методологические ограничения: почему точные цифры невозможны

Все приведённые данные имеют серьёзные ограничения. Детекция ботов и ИИ-контента несовершенна — алгоритмы постоянно улучшаются, обходя системы обнаружения.

- Проблема 1: Стимулы платформ

- Платформы не заинтересованы публиковать точные цифры — высокая доля ботов снижает доверие рекламодателей и инвесторов.

- Проблема 2: Размытое определение

- Что считать синтетическим контентом? Текст, отредактированный ИИ? Изображение с фильтрами? Видео с автоматическими субтитрами? Эти вопросы не имеют однозначных ответов, делая любые оценки приблизительными.

- Проблема 3: Скрытые объёмы

- Большая часть синтетического контента остаётся необнаруженной — особенно в закрытых системах, корпоративных сетях и приватных каналах.

Вывод: данные подтверждают рост синтетического контента, но точные масштабы остаются неизвестны. Это не означает, что теория мёртвого интернета верна — это означает, что интернет действительно меняется, и игнорирование базовых частот в интерпретации этих данных приводит к ошибочным выводам.

Механизм явления: причинно-следственные связи против корреляций — почему интернет меняется и кто за это отвечает

Рост автоматизированного контента — факт. Но является ли он результатом заговора или естественным следствием технологии и экономики? Разбираем причинно-следственные связи. Подробнее — в разделе Психология веры.

⚙️ Экономика внимания: почему автоматизация неизбежна

Интернет монетизирует внимание. Рекламные платформы платят за просмотры, клики, время на странице — чем больше контента, тем больше возможностей для показа рекламы.

Человек создаёт одну статью в день. ИИ создаёт тысячу за час. Выбор платформы очевиден не потому, что она злонамеренна, а потому что это рыночная эффективность. Платформы оптимизируют под свои бизнес-модели, не «убивая» интернет намеренно.

🔁 Технологический детерминизм: развитие ИИ как неизбежный процесс

Генеративный ИИ — результат десятилетий исследований, а не внезапный заговор. GPT-3 (2020), GPT-4 (2023), Stable Diffusion и Midjourney (2022) развивались открыто: научные статьи, открытый код, предсказуемое улучшение качества и снижение стоимости.

Теория мёртвого интернета интерпретирует технологический прогресс как злонамеренный план, игнорируя, что это естественная траектория развития ИИ.

🧩 Конфаундеры: другие факторы, объясняющие наблюдаемые изменения

Ощущение «мёртвости» может объясняться не ростом ботов, а совсем другим. Алгоритмическая курация создаёт пузыри фильтров — пользователи видят повторяющиеся паттерны. Коммерциализация привела к стандартизации: все следуют одним SEO-правилам, создавая иллюзию однообразия.

Рост числа пользователей разбавил качество — больше людей создают контент, но средний уровень снижается. Эти факторы не связаны с ботами, но создают похожие субъективные ощущения.

| Наблюдение | Объяснение через ботов | Альтернативные причины |

|---|---|---|

| Контент кажется повторяющимся | Боты генерируют однообразный текст | Алгоритмы показывают похожее; SEO-стандартизация |

| Меньше оригинальных голосов | Боты заглушают людей | Коммерциализация вытеснила любителей; концентрация платформ |

| Качество среднего контента упало | Боты заполняют интернет мусором | Больше пользователей = больше среднего контента; демократизация создания |

| Сложнее найти нишевый контент | Боты вытеснили нишевых авторов | Алгоритмы приоритизируют популярное; экономика масштаба |

🎯 Где заканчивается корреляция и начинается причина

Корреляция: интернет меняется, ИИ развивается — оба процесса идут параллельно. Причина: ИИ вызывает изменения интернета? Или интернет вызывает спрос на ИИ? Или оба явления — следствие третьего фактора (капитализм, масштабирование платформ)?

Теория мёртвого интернета берёт корреляцию и объявляет её причиной, добавляя намерение (заговор). Это классическая ошибка когнитивного искажения: видим паттерн → предполагаем агента → приписываем ему цель.

- Причинно-следственная цепь (реальная)

- Экономические стимулы → инвестиции в ИИ → технологический прогресс → внедрение в платформы → изменение контента

- Причинно-следственная цепь (теория мёртвого интернета)

- Заговор → намеренное внедрение ботов → убийство интернета → контроль информации

- Почему вторая версия привлекательнее

- Она проще (один агент вместо системы факторов), объясняет ощущение потери контроля, предлагает врага вместо неопределённости

Реальность сложнее: интернет меняется потому, что его экономика требует масштабирования, а ИИ — инструмент масштабирования. Это не заговор, это логика рынка. Но это не означает, что изменения безвредны или что их нельзя критиковать — просто критика должна быть направлена на экономические стимулы, а не на вымышленных врагов.

Конфликты и неопределённости: где источники расходятся и почему единого ответа не существует

Исследования доли ботов и синтетического контента дают противоречивые результаты. Разные методологии, разные определения, разные временные рамки — всё это приводит к разбросу оценок от 5% до 60%. Подробнее — в разделе Логические ошибки.

🔎 Определение «бота»: технический агент или социальный актор?

Главная проблема — отсутствие единого определения «бота». Технически это любая автоматизированная программа, взаимодействующая с веб-сервисами: поисковые краулеры Google, мониторинговые системы, автоматические уведомления.

В контексте теории мёртвого интернета «бот» означает систему, имитирующую человеческое поведение для манипуляции или обмана. Эти определения не пересекаются.

Исследования, использующие широкое определение, дают высокие цифры; узкое определение — низкие. Это методологическая неопределённость, которую невозможно устранить без консенсуса.

📊 Проблема измерения: как считать то, что скрывается?

Боты и ИИ-системы постоянно совершенствуются, чтобы избегать обнаружения. Это создаёт фундаментальную проблему: мы можем подсчитать только обнаруженные случаи, но не знаем, сколько осталось необнаруженными.

Разные исследования используют разные методы детекции: поведенческий анализ, лингвистические паттерны, технические сигнатуры. Ни один метод не является надёжным на 100%.

- Поведенческий анализ — отслеживание паттернов активности, но боты учатся имитировать человеческие ритмы

- Лингвистические паттерны — анализ текста, но генеративный ИИ становится неотличим от человеческой речи

- Технические сигнатуры — проверка метаданных и IP, но легко маскируются через прокси и VPN

🧾 Временная динамика: проблема быстро меняющейся реальности

Ситуация меняется так быстро, что исследования устаревают к моменту публикации. Данные за 2022 год не отражают реальность 2024 года, когда генеративный ИИ стал массовым инструментом.

Любые оценки доли синтетического контента — это моментальный снимок, который теряет актуальность через несколько месяцев. Мы всегда анализируем прошлое, а не настоящее.

- Лаг исследования

- От сбора данных до публикации проходит 6–18 месяцев. За это время технология ИИ делает несколько поколений вперёд.

- Лаг адаптации

- Как только выходит исследование о методе детекции, создатели ботов уже работают над обходом этого метода.

- Лаг осознания

- Общественность узнаёт о проблеме, когда она уже перешла в новую фазу развития.

Эти три лага создают эффект «преследования хвоста»: мы описываем вчерашнюю реальность, пока сегодняшняя уже другая. Единого ответа на вопрос «какова доля синтетического контента?» не существует не потому, что исследователи некомпетентны, а потому, что сам вопрос предполагает статичную реальность, которой нет.

Когнитивная анатомия мифа: какие психологические механизмы превращают наблюдение в конспирологию

Теория мёртвого интернета — это классический пример того, как реальные наблюдения трансформируются в конспирологическое мышление. Разбираем когнитивные искажения, которые питают эту теорию. Подробнее — в разделе Карма и реинкарнация.

⚠️ Паттерн-матчинг и апофения: видеть связи там, где их нет

Человеческий мозг эволюционно настроен на поиск паттернов — это помогало выживать, распознавая угрозы. Но эта способность даёт сбои, создавая иллюзию паттернов в случайных данных.

Апофения — восприятие значимых связей между несвязанными явлениями. Сторонники теории мёртвого интернета видят «доказательства» везде: повторяющиеся комментарии, похожие посты, шаблонные ответы. Но эти явления объясняются просто: люди копируют друг друга, используют одни и те же мемы, следуют трендам.

Апофения превращает банальность в «улику заговора» — и чем больше данных, тем больше «совпадений» находит мозг.

🕳️ Эффект подтверждения: искать только то, что подтверждает гипотезу

Когда человек принимает теорию мёртвого интернета, он начинает искать подтверждения и игнорировать опровержения. Встретил шаблонный комментарий? «Это бот!» Увидел оригинальный пост? «Редкое исключение».

Этот когнитивный фильтр делает теорию неопровержимой — любые данные интерпретируются в её пользу. Confirmation bias — систематическая ошибка, которая укрепляет убеждения независимо от фактов.

🧠 Агентность и интенциональность: приписывать намерения безличным процессам

Люди склонны видеть намерения и агентов там, где действуют безличные процессы. Рост автоматизации интернета — результат экономических стимулов и технологического развития, а не чей-то злонамеренный план.

Но мозг требует врага, координатора, заговорщика. Безличные силы рынка и алгоритмов переживаются как сговор. Это не паранойя — это нормальная работа системы распознавания агентов, которая срабатывает слишком часто.

- Наблюдение: контент стал более однородным и автоматизированным

- Интерпретация: это не рыночная логика, а чей-то план

- Поиск агента: кто это может быть? ИИ-компании? Государство? Корпорации?

- Укрепление: любой новый факт становится «доказательством» плана

📊 Эвристика доступности: запоминаем яркое, забываем типичное

Яркие примеры ботов, скопированных постов и странных комментариев легко вспомнить и они кажутся частыми. Миллионы обычных постов остаются незамеченными — они не вызывают эмоций.

Эвристика доступности заставляет нас переоценивать частоту того, что легко вспомнить. Несколько ярких примеров ботов создают впечатление, что боты везде.

🎯 Игнорирование базовой частоты: забывать о контексте

Даже если 5% интернета — это синтетический контент, это не означает, что интернет «мёртв». Но когда человек сосредоточен на этих 5%, он забывает о 95% живого контента.

Игнорирование базовой частоты — это систематическое пренебрежение контекстом и масштабом. Теория мёртвого интернета работает именно так: берёт реальное явление (рост ИИ-контента) и игнорирует его истинный масштаб.

⚫⚪ Чёрно-белое мышление: нет полутонов

Теория мёртвого интернета предполагает дихотомию: либо интернет живой, либо мёртв. Либо контент человеческий, либо ботский. Но реальность сложнее: контент может быть частично автоматизирован, частично человеческим, гибридным.

Ложная дихотомия упрощает мир, делая его понятнее, но менее точнее. Сложные явления требуют сложных моделей — а не выбора между двумя крайностями.

Миф о мёртвом интернете — это не ложь. Это реальное наблюдение, пропущенное через фильтры когнитивных искажений, которые превращают частичную правду в абсолютный заговор.