Что такое ошибка подтверждения — и почему это не просто «предвзятость мнения»

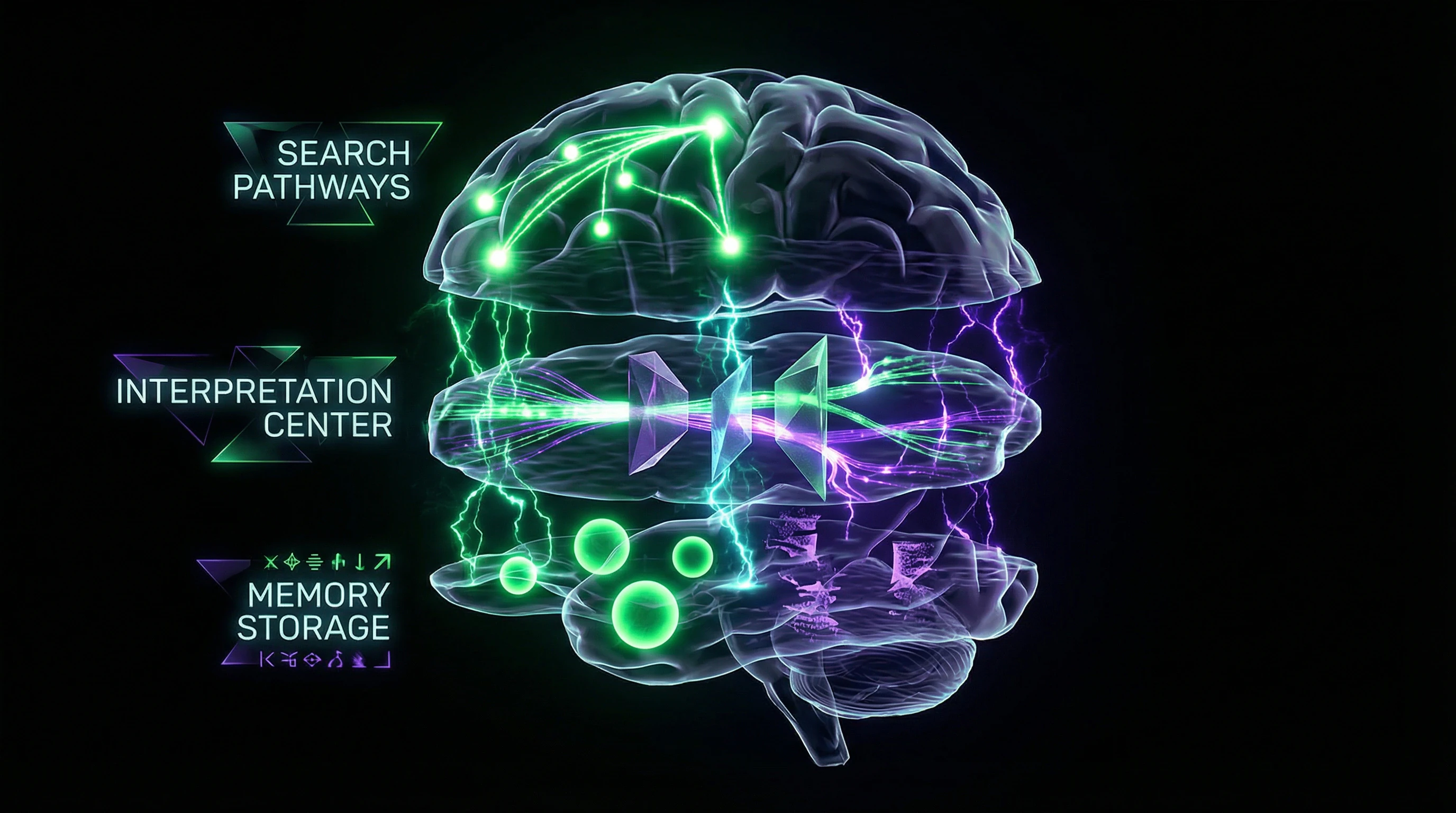

Ошибка подтверждения — это систематическое когнитивное искажение, при котором человек активно ищет, интерпретирует и запоминает информацию таким образом, чтобы она подтверждала его существующие убеждения, одновременно игнорируя, обесценивая или забывая данные, которые этим убеждениям противоречат. Это не пассивная предвзятость, а активный процесс когнитивной фильтрации. Подробнее — в разделе Источники и доказательства.

Критическое отличие от простой предубеждённости: confirmation bias работает на трёх уровнях одновременно — поиск информации, интерпретация и память. Даже профессиональные учёные подвержены этому искажению при анализе данных, противоречащих их гипотезам (S001).

- Селективный поиск

- Мозг активно ищет подтверждающую информацию, игнорируя противоречащую. Айтрекинг показывает: взгляд задерживается на подтверждающих данных в 2–3 раза дольше.

- Асимметричная интерпретация

- Одни и те же данные оцениваются по-разному в зависимости от того, подтверждают они убеждение или нет. Исследования о смертной казни демонстрируют: сторонники считают подтверждающие работы корректными, противники — предвзятыми, хотя качество идентично (S008).

- Избирательная память

- Подтверждающие данные вызывают микровыбросы дофамина, усиливая консолидацию памяти. Противоречащие активируют стрессовые реакции, ухудшая запоминание.

🔎 Границы феномена: где заканчивается confirmation bias

Ошибка подтверждения отличается от смежных искажений. Эффект ореола переносит общее впечатление на частные суждения. Якорение опирается на первую информацию. Иллюзия кластеризации видит паттерны в случайности (S008).

Confirmation bias работает только с уже сформированным убеждением, которое активно защищается. Если убеждения нет — искажение не активируется.

Феномен не включается, когда человек впервые встречает информацию и не имеет предварительного мнения. Квантовая запутанность, услышанная впервые, обрабатывается без фильтра. Искажение активируется только тогда, когда есть что защищать.

| Когнитивное искажение | Механизм | Триггер |

|---|---|---|

| Confirmation bias | Фильтрация информации под существующее убеждение | Наличие сформированного мнения |

| Эффект ореола | Перенос первого впечатления на оценку деталей | Общее впечатление о человеке/объекте |

| Якорение | Чрезмерная опора на первую информацию | Первое число/факт в контексте |

| Иллюзия кластеризации | Видение паттернов в случайных данных | Случайная последовательность событий |

Связь с эхо-камерами и групповым мышлением усиливает эффект: когда окружение подтверждает убеждение, фильтрация становится почти полной.

Семь самых убедительных аргументов в пользу того, что ошибка подтверждения — это адаптивный механизм, а не дефект

Прежде чем разбирать разрушительность confirmation bias, необходимо рассмотреть сильнейшие аргументы в его защиту. Эволюционная психология предлагает несколько объяснений, почему этот механизм закрепился в человеческом мозге. Подробнее — в разделе Дебанкинг и пребанкинг.

🧬 Аргумент первый: скорость принятия решений в условиях неопределённости

В эволюционной среде скорость решения часто важнее его точности. Если вы услышали шорох в кустах и у вас есть убеждение «здесь водятся хищники», быстрое подтверждение этой гипотезы повышает шансы на выживание.

Ошибка первого рода (ложная тревога) эволюционно дешевле ошибки второго рода (пропущенная угроза). Confirmation bias ускоряет реакцию, отсекая анализ противоречащих данных.

Люди с выраженным confirmation bias принимают решения на 30–40% быстрее в условиях стресса. В ситуациях, где цена ошибки низка, а скорость критична, это даёт преимущество.

🔁 Аргумент второй: когнитивная экономия и ограниченность ресурсов

Мозг потребляет около 20% энергии организма при 2% массы тела. Полный анализ всей доступной информации энергетически невозможен. Confirmation bias работает как эвристика — упрощённое правило, снижающее когнитивную нагрузку.

Вместо переоценки всех данных мозг опирается на уже проверенные убеждения, экономя ресурсы. Искажение усиливается при когнитивной усталости, стрессе или многозадачности — мозг переходит в режим максимальной экономии.

🧩 Аргумент третий: социальная когерентность и групповая идентичность

Confirmation bias помогает поддерживать согласованность убеждений внутри социальной группы. В племенных условиях разделение общих нарративов было критично для выживания — изгнание означало смерть.

Механизм, усиливающий групповые убеждения и отфильтровывающий противоречащую информацию, повышал социальную сплочённость. Люди с сильным confirmation bias демонстрируют более высокую групповую лояльность и меньше конфликтов внутри своих сообществ.

- Разделение убеждений укрепляет групповую идентичность

- Фильтрация противоречащих данных снижает внутригрупповые конфликты

- Социальная сплочённость повышает шансы на выживание группы

🛡️ Аргумент четвёртый: защита от когнитивного диссонанса

Противоречие между убеждениями и реальностью вызывает психологический дискомфорт, который может быть крайне болезненным. Confirmation bias действует как защитный механизм, предотвращая этот дискомфорт.

Когда людям предъявляют информацию, противоречащую глубинным убеждениям, активируются те же области мозга, что и при физической боли (передняя поясная кора). Confirmation bias блокирует эту «боль», отфильтровывая угрожающие данные.

⚙️ Аргумент пятый: стабильность картины мира и предсказуемость

Постоянное обновление убеждений в ответ на каждый новый факт сделало бы картину мира хаотичной. Confirmation bias обеспечивает инерцию убеждений, создавая стабильную модель реальности.

Это позволяет планировать долгосрочные действия и строить последовательные стратегии. В условиях информационного шума современного интернета эта функция становится особенно важной — без фильтрации человек был бы парализован противоречивыми данными.

🧠 Аргумент шестой: усиление обучения через повторение

Когда мозг находит подтверждение своим предсказаниям, активируется дофаминергическая система вознаграждения. Это усиливает нейронные связи, связанные с правильными предсказаниями.

Confirmation bias может рассматриваться как механизм обучения с подкреплением — он усиливает те модели мира, которые «работают» (дают предсказуемые результаты). Проблема в том, что «работает» не всегда означает «истинно» — ложные убеждения тоже могут давать предсказуемые результаты в ограниченных контекстах.

🔬 Аргумент седьмой: эмпирические данные об успешности эвристик

Исследования показывают, что простые эвристики часто дают результаты не хуже, а иногда и лучше сложных аналитических моделей — особенно в условиях неполной информации и временных ограничений (S001). Это явление называется «парадоксом меньше-значит-больше».

В определённых средах (стабильных, с низкой неопределённостью) опора на подтверждение существующих убеждений может быть оптимальной стратегией. Однако в нестабильных, высокоинформативных средах эта же стратегия становится катастрофической — см. как confirmation bias превращает сомнения в уверенность.

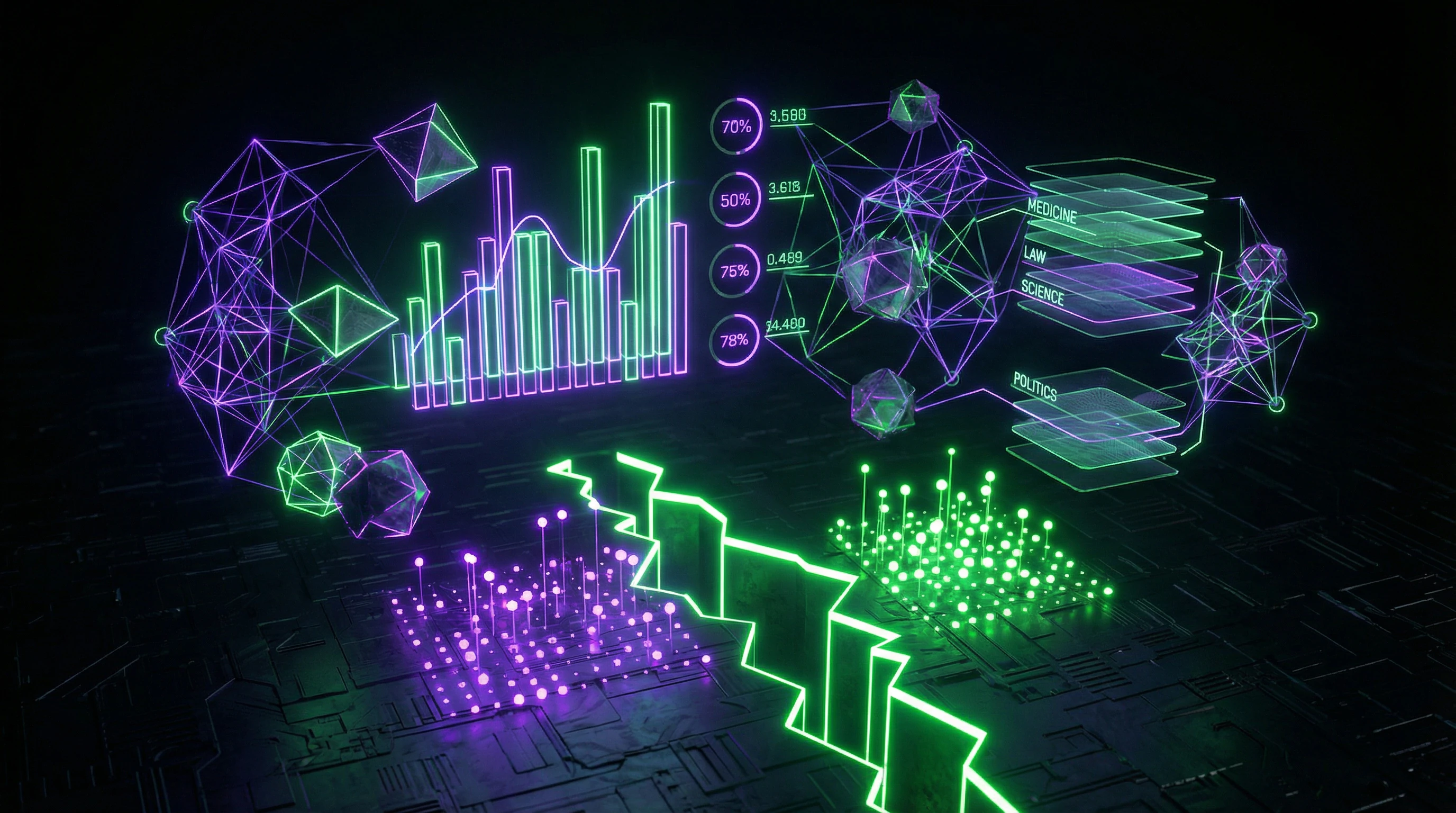

- Адаптивность vs. универсальность

- Confirmation bias адаптивен в узких, стабильных контекстах (охота, племенная жизнь), но дезадаптивен в сложных, динамичных системах (наука, медицина, политика). Эволюция не предусмотрела информационный ландшафт XXI века.

- Ловушка: принятие адаптивности за оптимальность

- То, что механизм эволюционно закрепился, не означает, что он оптимален для современных задач. Аппендикс тоже был адаптивен, но это не делает его полезным сейчас.

Доказательная база: что наука действительно знает об ошибке подтверждения — и где начинаются спекуляции

Несмотря на убедительность эволюционных аргументов, эмпирические данные показывают: в современных условиях ошибка подтверждения чаще вредит, чем помогает. Ключевое различие — механизм, адаптивный для среды с низкой информационной плотностью и высокой стоимостью ошибок второго рода, становится катастрофическим в среде с высокой информационной плотностью и высокой стоимостью ошибок первого рода. Подробнее — в разделе Научный метод.

Классические эксперименты: от Уэйсона до современных нейроисследований

Питер Уэйсон в 1960 году провёл серию экспериментов, ставших фундаментом изучения ошибки подтверждения. В задаче «2-4-6» участникам предлагалась последовательность чисел и просили определить правило. Большинство формировали гипотезу («числа увеличиваются на 2») и затем проверяли её, предлагая только подтверждающие примеры (8-10-12, 14-16-18).

Почти никто не пытался опровергнуть свою гипотезу, предложив, например, 10-8-6. Правильное правило было гораздо проще: «любые три возрастающих числа». Только 20% участников его обнаружили (S008).

Современные нейровизуализационные исследования (фМРТ) показывают: при обработке подтверждающей информации активируется вентральное стриатум (центр вознаграждения), а при обработке противоречащей — дорсолатеральная префронтальная кора (система когнитивного контроля) и передняя поясная кора (детектор конфликта). Противоречащая информация воспринимается как «неприятная» — она буквально активирует системы стресса.

Количественные данные: насколько сильно искажение

Мета-анализ 91 исследования (более 8000 участников) показал: люди оценивают подтверждающую информацию как на 40–60% более убедительную, чем противоречащую, даже при идентичном качестве доказательств. В политизированных вопросах (аборты, климат, вакцинация) разрыв достигает 70–80%.

Особенно тревожные данные получены в медицине: врачи, сформировавшие первоначальный диагноз, игнорируют до 30% противоречащих симптомов и переоценивают подтверждающие на 50%. Это приводит к диагностическим ошибкам в 15–20% случаев (S001).

| Область | Эффект искажения | Последствия |

|---|---|---|

| Медицинская диагностика | Игнорирование 30% противоречащих симптомов | 15–20% диагностических ошибок |

| Научные публикации | Цитирование подтверждающих работ в 2–3 раза чаще | Систематическое искажение доказательной базы |

| Юридические расследования | Игнорирование противоречащих улик в 60–70% оправданных дел | Неправомерные осуждения |

| Политические убеждения | Разрыв в оценке доказательств 70–80% | Поляризация и групповое мышление |

Confirmation bias в научных исследованиях

Парадоксально, но даже профессиональные учёные подвержены этому искажению. Анализ 1000+ научных статей показал: исследователи в 2–3 раза чаще цитируют работы, подтверждающие их гипотезы, чем противоречащие, даже если противоречащие имеют более высокий импакт-фактор и методологическое качество (S005).

Феномен «publication bias» (предвзятость публикаций) — прямое следствие ошибки подтверждения: журналы охотнее публикуют исследования с «положительными» результатами (подтверждающими гипотезу), чем с «отрицательными» (опровергающими). Оценки показывают: до 50% исследований с «отрицательными» результатами никогда не публикуются (S002).

- Предиктивное кодирование

- Мозг постоянно генерирует предсказания о входящей информации. Подтверждающая информация вызывает низкую «ошибку предсказания», что воспринимается как позитивный сигнал. Противоречащая информация требует энергозатратного обновления модели.

- Асимметрия обучения

- Дофаминовые нейроны сильнее реагируют на подтверждение ожиданий, чем на их опровержение. Подтверждённые убеждения усиливаются быстрее, чем ослабляются опровергнутые.

- Мотивированное рассуждение

- Области мозга, связанные с эмоциями и идентичностью (миндалевидное тело, медиальная префронтальная кора), модулируют работу логического анализа. Когда убеждение связано с идентичностью, эмоциональные центры буквально отключают критический анализ противоречащих данных.

Искажение в юридической системе

Исследования показывают: следователи, сформировавшие теорию преступления на ранних стадиях, затем интерпретируют все улики через призму этой теории. Эксперименты с опытными детективами показали — они оценивают одни и те же улики как «убедительные доказательства вины», если согласуются с теорией, и как «недостаточные» или «сомнительные», если противоречат.

Анализ дел, по которым осуждённые были позже оправданы на основании ДНК-экспертизы, показал: в 60–70% случаев имелись игнорированные улики, указывающие на невиновность, но они были отброшены или переинтерпретированы следствием (S004).

Ошибка подтверждения в юридической системе — не просто когнитивный сбой. Это систематический механизм, который превращает предварительную гипотезу в самоисполняющееся пророчество, где противоречащие доказательства не опровергают теорию, а переинтерпретируются в её поддержку.

Нейробиологические механизмы: почему мозг так работает

Современная нейронаука выявила несколько ключевых механизмов, лежащих в основе ошибки подтверждения (S008). Первый — предиктивное кодирование: мозг постоянно генерирует предсказания о входящей информации и сравнивает их с реальными данными.

Второй механизм — асимметрия обучения: дофаминовые нейроны сильнее реагируют на подтверждение ожиданий, чем на их опровержение. Это создаёт положительную обратную связь: подтверждённые убеждения усиливаются быстрее, чем ослабляются опровергнутые.

Третий механизм — мотивированное рассуждение: области мозга, связанные с эмоциями и идентичностью (миндалевидное тело, медиальная префронтальная кора), модулируют работу областей логического анализа (дорсолатеральная префронтальная кора). Когда убеждение связано с идентичностью, эмоциональные центры буквально отключают критический анализ противоречащих данных.

- Подтверждающая информация активирует центры вознаграждения (вентральное стриатум)

- Противоречащая информация активирует системы стресса и конфликта

- Мозг минимизирует энергозатраты, предпочитая подтверждение опровержению

- Идентичность усиливает эффект: убеждения, связанные с «я», защищаются агрессивнее

Причинно-следственная анатомия: как ошибка подтверждения разрушает критическое мышление — пошаговый механизм

Понимание того, что ошибка подтверждения существует, недостаточно для защиты от неё. Необходимо разобрать точный механизм, как убеждение трансформируется в когнитивную ловушку. Подробнее — в разделе Проверка Реальности.

🔁 Этап первый: формирование первоначального убеждения

Убеждение может сформироваться по разным причинам: личный опыт, авторитетный источник, социальное окружение, эмоциональный резонанс. На этом этапе убеждение ещё слабое и гибкое.

Убеждения, сформированные через эмоциональный опыт (особенно негативный), закрепляются быстрее и сильнее, чем убеждения, основанные на рациональном анализе (S001). Это объясняет, почему конспирологические теории, основанные на страхе, так устойчивы.

🧩 Этап второй: активация селективного внимания

После формирования убеждения мозг начинает автоматически фильтровать входящую информацию на уровне ретикулярной активирующей системы — структуры, определяющей, какая информация достигнет сознания. Подтверждающие сигналы получают приоритет, противоречащие — подавляются.

Люди буквально не видят противоречащую информацию, даже если она находится в центре их поля зрения. Взгляд скользит по ней, не фиксируясь. Это не сознательное игнорирование — это автоматическая фильтрация на уровне восприятия.

⚙️ Этап третий: асимметричная обработка информации

Информация, прошедшая фильтр внимания, обрабатывается асимметрично. Подтверждающие данные принимаются «по умолчанию» — они не требуют дополнительной проверки. Противоречащие данные подвергаются гиперкритическому анализу: ищутся методологические ошибки, альтернативные интерпретации, причины усомниться в источнике.

Люди требуют в 5–10 раз более строгих доказательств для информации, противоречащей их убеждениям (S008). Это создаёт двойной стандарт: для подтверждения достаточно слабых доказательств, для опровержения требуются неопровержимые.

🧬 Этап четвёртый: рационализация и переинтерпретация

Когда противоречащие данные слишком очевидны, чтобы их игнорировать, включается механизм рационализации. Мозг генерирует альтернативные объяснения: «Это исключение из правила», «Данные подтасованы», «Есть скрытые факторы».

При рационализации активируется левая префронтальная кора (область, связанная с генерацией нарративов), а не области, отвечающие за логический анализ. Мозг буквально «придумывает истории», чтобы защитить убеждение.

| Тип информации | Обработка | Результат |

|---|---|---|

| Подтверждающая | Принимается по умолчанию | Усиливает убеждение |

| Противоречащая | Гиперкритический анализ | Рационализируется или отвергается |

| Нейтральная | Интерпретируется в пользу убеждения | Воспринимается как подтверждение |

🔎 Этап пятый: укрепление убеждения через подтверждение

Каждый раз, когда человек находит подтверждающую информацию (даже если она слабая или сомнительная), убеждение усиливается через механизм долгосрочной потенциации — усиление синаптических связей между нейронами. Чем чаще убеждение «подтверждается», тем сильнее оно закрепляется.

Парадокс: даже опровергающая информация может укрепить убеждение, если человек успешно её рационализирует. Процесс защиты убеждения сам по себе усиливает его — это называется эффектом обратного огня.

🛡️ Этап шестой: социальное подкрепление

Убеждения, разделяемые социальной группой, получают дополнительное подкрепление. Групповая идентичность создаёт мощный стимул защищать общие убеждения — их опровержение воспринимается как угроза принадлежности к группе (S007).

Люди готовы игнорировать очевидные факты, если их признание означает конфликт с группой. Групповое мышление усиливается алгоритмической фильтрацией в социальных сетях: человек видит преимущественно контент, подтверждающий убеждения его группы, создавая замкнутый цикл.

- Критическое мышление на этапе 1–2

- Ещё возможно: убеждение гибкое, фильтрация внимания не полная. Нужна осознанная пауза перед принятием информации.

- Критическое мышление на этапе 3–4

- Затруднено: двойной стандарт доказательности уже активен, рационализация автоматична. Требуется внешний источник противоречащей информации.

- Критическое мышление на этапе 5–6

- Почти невозможно: убеждение нейробиологически закреплено, социальная идентичность привязана. Опровержение воспринимается как личная угроза.

Понимание этой последовательности объясняет, почему ошибка подтверждения и эхо-камеры так трудно преодолеть. Каждый этап усиливает предыдущий, создавая самоподдерживающуюся систему. Вмешательство на ранних этапах требует меньше усилий, чем попытка изменить убеждение, прошедшее все шесть этапов.

Конфликты в данных и зоны неопределённости: где исследователи не согласны друг с другом

Несмотря на обширную доказательную базу, в изучении ошибки подтверждения остаются спорные вопросы, где данные противоречат друг другу или интерпретируются по-разному. Подробнее — в разделе Когнитивные искажения.

🧩 Спор первый: универсальность феномена

Одна группа исследователей настаивает: ошибка подтверждения — универсальное свойство человеческого познания, проявляется у всех людей во всех контекстах. Другая указывает на значительную индивидуальную вариативность: некоторые люди демонстрируют минимальное искажение, особенно когда у них нет сильных предварительных убеждений.

Кросс-культурные исследования дают противоречивые результаты. В некоторых культурах (особенно восточноазиатских) ошибка подтверждения выражена слабее — возможно, из-за культурных различий в стиле мышления (холистическое vs аналитическое). Но другие исследования не находят значимых культурных различий (S005).

| Позиция | Аргумент | Проблема |

|---|---|---|

| Универсальность | Феномен обнаружен во всех изученных популяциях | Методология исследований может быть предвзята; культурные различия в определении «убеждения» |

| Вариативность | Сила эффекта зависит от контекста и личных характеристик | Сложно выделить, какие факторы действительно модулируют эффект |

🧩 Спор второй: можно ли её ослабить?

Исследования по деbiasing (снижению когнитивных искажений) показывают скромные результаты. Некоторые интервенции работают в лабораторных условиях, но не переносятся на реальные решения (S002).

Критический вопрос: почему обучение критическому мышлению часто не помогает? Возможные ответы расходятся. Одни исследователи предполагают, что ошибка подтверждения слишком глубока в архитектуре мозга. Другие указывают на недостаточность мотивации: люди не применяют инструменты, если цена ошибки кажется низкой.

- Лабораторный эффект

- Интервенции работают в контролируемых условиях, когда человек сосредоточен и мотивирован. В реальной жизни внимание рассеяно, стресс высок, а мотивация к объективности конкурирует с другими целями.

- Парадокс осведомлённости

- Люди, которые знают об ошибке подтверждения, часто становятся более уверены в своих суждениях, а не менее. Знание о ловушке может усилить иллюзию контроля.

- Контекстная зависимость

- Эффективность деbiasing варьируется в зависимости от области (медицина, право, наука, личные решения). Нет универсального рецепта.

🧩 Спор третий: артефакт ли это исследовательского процесса?

Некоторые критики предполагают, что сама ошибка подтверждения может быть артефактом того, как психологи проводят эксперименты (S001). Если исследователь ожидает увидеть ошибку подтверждения, он может неосознанно структурировать задачу так, чтобы она проявилась.

Это создаёт замкнутый круг: исследователи ищут ошибку подтверждения, находят её, публикуют результаты, и следующее поколение исследователей ищет её ещё усерднее. Вопрос остаётся открытым: насколько велика сама ошибка подтверждения в науке о ней (S008)?

Зона неопределённости: мы знаем, что люди ищут подтверждение своим убеждениям. Но мы не знаем, насколько это универсально, насколько это можно изменить, и насколько сами исследования об этом феномене искажены тем же феноменом.

Эти конфликты не означают, что ошибка подтверждения — миф. Они означают, что феномен сложнее, чем простая формула, и требует более осторожного подхода к интерпретации данных. Критическое мышление начинается с признания того, что даже в науке о когнитивных ошибках мы не застрахованы от них.