Когнитивные ловушки и логические ошибки: где заканчивается эвристика и начинается катастрофа

Термин «когнитивное искажение» (cognitive bias) описывает систематические отклонения в обработке информации, возникающие из-за ограничений архитектуры мозга. Логические ошибки (logical fallacies) — это нарушения формальных правил вывода, которые делают аргумент недействительным независимо от истинности посылок. Подробнее — в разделе Ментальные ошибки.

Граница между ними размыта: искажение подтверждения (confirmation bias) заставляет искать только поддерживающие данные, а затем логическая ошибка «после — значит вследствие» (post hoc ergo propter hoc) превращает корреляцию в причинность.

🧩 Три уровня сбоя: восприятие, вывод, действие

Когнитивные ловушки работают на трёх этажах принятия решений.

- Уровень восприятия

- Эффект доступности (availability heuristic) заставляет переоценивать вероятность событий, которые легко вспомнить — авиакатастрофы кажутся частыми, потому что медийно заметны, хотя статистически редки.

- Уровень вывода

- Ошибка базовой ставки (base rate fallacy) игнорирует априорные вероятности — врач видит положительный тест на редкую болезнь и ставит диагноз, забывая, что при низкой распространённости большинство позитивов ложные (S005).

- Уровень действия

- Эскалация обязательств (sunk cost fallacy) заставляет продолжать провальный проект, потому что «уже столько вложено».

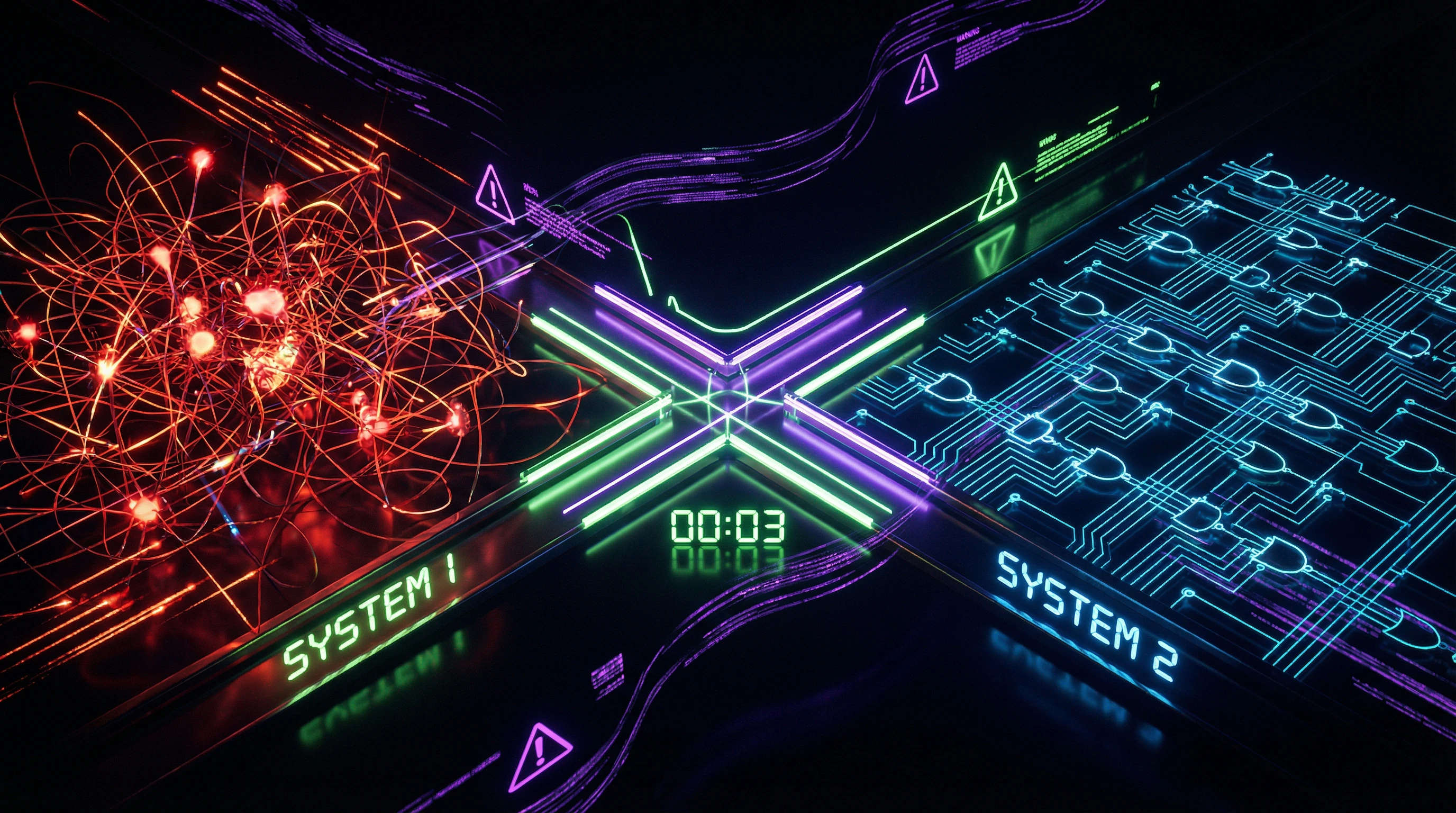

🔎 Почему быстрые решения — это поле боя между системой 1 и системой 2

Дэниел Канеман разделил мышление на две системы: Система 1 (быстрая, автоматическая, эмоциональная) и Система 2 (медленная, аналитическая, энергозатратная). Под давлением времени Система 2 отключается — мозг экономит глюкозу.

Дипломатические переговоры, где каждая секунда молчания интерпретируется как сигнал, становятся полигоном для ловушек: эффект якоря (anchoring) определяет весь диапазон торга, а ошибка атрибуции (fundamental attribution error) приписывает жёсткость оппонента его характеру, а не ситуационному давлению (S001).

⚙️ Эвристики как оружие: когда упрощение становится манипуляцией

Эвристика репрезентативности (representativeness heuristic) заставляет судить о вероятности по сходству с прототипом: «Он выглядит как программист, значит, скорее всего, программист» — игнорируя, что библиотекарей в популяции больше.

| Эвристика | Механизм | Поле манипуляции |

|---|---|---|

| Репрезентативности | Судить по сходству с прототипом | Стереотипизация в рекламе и найме |

| Аффекта | Связывать оценку риска с эмоциональной окраской | Позитивный имидж обходит аналитику (зелёная энергия, новые технологии) |

В маркетинге эвристика репрезентативности превращается в стереотипизацию: рекламные образы эксплуатируют прототипы, чтобы обойти аналитическое мышление. Эвристика аффекта связывает оценку риска с эмоциональной окраской: технологии с позитивным имиджем воспринимаются как безопасные, даже если данные неоднозначны.

Подробнее о том, как выявлять такие ошибки, см. в справочнике логических ошибок.

Стальная версия аргумента: почему когнитивные ловушки — это не баг, а адаптация

Прежде чем разбирать ошибки, необходимо признать: эвристики существуют, потому что работают. В условиях неопределённости и ограниченных ресурсов (времени, информации, вычислительной мощности мозга) они дают «достаточно хорошие» решения с минимальными затратами. Подробнее — в разделе Дебанкинг и пребанкинг.

Критика должна учитывать экологическую рациональность — соответствие стратегии среде. Это не оправдание, а контекст.

- Эвристики побеждают в условиях высокой неопределённости и шума

- Социальные эвристики координируют коллективные действия

- Когнитивная экономия — это эволюционное преимущество

- Логические ошибки могут быть риторически эффективными

- Контекстная специфичность делает универсальную критику бессмысленной

- Квантовая модель решений объясняет «иррациональность» как рациональность другого порядка

- Консультации снижают ошибки через увеличение взаимной информации

Эвристики побеждают в условиях высокой неопределённости и шума

Простые эвристики (например, «выбирай узнаваемое») часто превосходят сложные статистические модели в реальных задачах с зашумлёнными данными. Сложные модели переобучаются на шуме, а эвристики игнорируют его.

В медицине быстрая диагностика по паттернам спасает жизни, когда времени на полный анализ нет — опытный врач «видит» инфаркт по совокупности неявных признаков быстрее, чем алгоритм обработает ЭКГ (S005).

Социальные эвристики координируют коллективные действия

Эвристика «делай как большинство» кажется конформизмом, но она решает проблему координации без централизованного управления. В условиях паники (пожар, теракт) следование за толпой может быть оптимальной стратегией — у вас нет времени анализировать планы эвакуации.

Коллективное поведение агрегирует распределённую информацию. Проблема возникает, когда среда меняется быстрее, чем эвристика адаптируется: толпа бежит к заблокированному выходу, потому что «все туда бегут».

Когнитивная экономия — это эволюционное преимущество

Мозг потребляет 20% энергии тела при 2% массы. Аналитическое мышление энергетически дорого — его нельзя держать включённым постоянно.

Эвристики — это кэш, который позволяет принимать тысячи микрорешений в день (что надеть, какой маршрут выбрать, кому доверять) без сжигания глюкозы. Критика эвристик без учёта этого ограничения — всё равно что критиковать кэш процессора за то, что он не хранит всю базу данных.

Логические ошибки могут быть риторически эффективными

Argumentum ad populum формально ошибочен, но социально убедителен — он апеллирует к потребности в принадлежности. В дипломатии и политике риторическая сила аргумента важнее его логической валидности (S001).

Ошибка «скользкий склон» может быть обоснованной, если существуют механизмы эскалации — например, первый компромисс действительно создаёт прецедент для следующих. Цель риторики — не доказать истину, а склонить аудиторию к действию.

Контекстная специфичность делает универсальную критику бессмысленной

То, что является ошибкой в одной области, может быть нормой в другой. В науке post hoc ergo propter hoc — грубая ошибка, но в медицинской диагностике временная последовательность симптомов — ключевой диагностический признак.

- Эффект Даннинга-Крюгера

- Переоценка компетентности новичками критикуется в науке, но в стартап-культуре «наивная самоуверенность» может быть преимуществом — она позволяет начать проект, который эксперт отверг бы как нереалистичный.

- Логические ошибки в дискурсе

- Умные люди верят в глупости не потому, что глупы, а потому, что контекст и риторика переопределяют логику. Подробнее см. логические ошибки в дискурсе.

Квантовая модель решений объясняет «иррациональность» как рациональность другого порядка

Классическая теория принятия решений предсказывает, что люди максимизируют ожидаемую полезность. Но эксперименты показывают систематические нарушения: эффект порядка, где последовательность вопросов меняет ответы, и эффект дизъюнкции, где знание исхода меняет предпочтения нелогичным образом.

Квантовая модель социальных агентов объясняет это через суперпозицию состояний и интерференцию вероятностей (S003). Решения не детерминированы до момента «измерения» (вопроса), и контекст коллапсирует волновую функцию предпочтений. Это не ошибка, а другая математика.

Консультации снижают ошибки через увеличение взаимной информации

Парадоксы классической теории решений (например, Ellsberg paradox, где люди предпочитают известные вероятности неизвестным) ослабевают, когда агенты консультируются друг с другом. Обмен информацией увеличивает взаимную информацию между агентами, что снижает энтропию решений и уменьшает влияние когнитивных искажений (S003).

Коллективные решения часто точнее индивидуальных — не потому что «мудрость толпы», а потому что информационная интерференция гасит случайные флуктуации.

Это объясняет, почему логические ошибки менее опасны в открытых системах, где возможен диалог и перепроверка. Изоляция усиливает искажения; связность их нейтрализует.

Доказательная база: что говорят исследования 2025 года о механизмах когнитивных ловушек

Эмпирические данные о когнитивных искажениях накапливаются с 1970-х годов, но только в последние годы появились модели, объясняющие, почему классическая теория рациональности систематически проваливается. Ключевой сдвиг — переход от описания ошибок к пониманию их механизмов. Подробнее — в разделе Критическое мышление.

Квантовая теория решений: почему классическая модель парадоксальна

Классическая теория ожидаемой полезности предполагает, что предпочтения стабильны и не зависят от порядка вопросов. Эксперименты показывают обратное: если сначала спросить «Вы счастливы в браке?», а потом «Насколько вы счастливы в целом?», корреляция между ответами высокая. Если поменять порядок — корреляция падает.

Это эффект порядка (order effect), необъяснимый в классической модели (S003). Квантовая модель решений вводит некоммутативность: измерение одного параметра меняет состояние системы, влияя на измерение другого. Математически это описывается через операторы проекции в гильбертовом пространстве — те же уравнения, что в квантовой механике (S003).

Порядок вопросов — не просто артефакт анкеты. Это фундаментальное свойство: измерение одного аспекта переконфигурирует психическое состояние для следующего.

Парадокс Ellsberg и неопределённость: почему люди избегают неизвестных вероятностей

В парадоксе Ellsberg участникам предлагают две урны: в первой 50 красных и 50 чёрных шаров (известное распределение), во второй — 100 шаров неизвестного соотношения. Большинство предпочитает ставить на первую урну, даже если выигрыш одинаков — это нарушает аксиому независимости классической теории.

Квантовая модель объясняет это через энтропию: неопределённость второй урны увеличивает энтропию решения, что воспринимается как риск. Когда агенты консультируются, обмен информацией снижает энтропию — и предпочтение первой урны ослабевает (S003). Групповые решения показывают меньшую чувствительность к парадоксу Ellsberg.

Контекстная специфичность в медицинской диагностике: когда эвристики убивают

Исследование клинического мышления показало, что контекстные факторы — время суток, усталость врача, порядок поступления пациентов — систематически влияют на точность диагностики (S005). Эффект доступности заставляет врача ставить диагноз, который он недавно видел.

Если утром было три случая пневмонии, четвёртый пациент с кашлем получит тот же диагноз, даже если симптомы отличаются. Ошибка базовой ставки особенно опасна при редких болезнях: тест с чувствительностью 99% и специфичностью 99% для болезни с распространённостью 0.1% даёт 90% ложноположительных результатов — но врачи игнорируют это, фокусируясь на «99% точности» (S005).

- Эффект доступности

- Недавно увиденный случай становится якорем для интерпретации новых данных. Механизм: активированные нейронные сети остаются возбуждены, снижая порог срабатывания для похожих паттернов.

- Ошибка базовой ставки

- Игнорирование исходной вероятности события в пользу специфичности теста. Опасна в медицине: редкая болезнь + высокоточный тест = большинство положительных результатов ложные.

Дипломатические провалы: как когнитивные ловушки разрушают переговоры

Анализ дипломатических кейсов выявил типичные ловушки: эффект якоря (первое предложение определяет диапазон торга), ошибка атрибуции (жёсткость оппонента приписывается характеру, а не ситуации), эскалация обязательств (S001). Карибский кризис 1962 года — обе стороны интерпретировали действия друг друга через призму враждебных намерений, игнорируя ситуационное давление.

Только прямая коммуникация (горячая линия Кеннеди-Хрущёв) снизила информационную энтропию и позволила избежать эскалации.

Evidence-based management: почему гиперрациональность — это тоже ловушка

Критика evidence-based management показывает парадокс: требование строгих доказательств для каждого решения может парализовать действие (S002). В условиях неопределённости (стартап в новой нише) данных просто нет — ждать их появления означает упустить окно возможностей.

EBM работает в стабильных средах (медицина, инженерия), но в быстро меняющихся контекстах (технологический бизнес, геополитика) эвристики и интуиция экспертов могут быть эффективнее. Ошибка — не в использовании эвристик, а в неспособности переключаться между режимами мышления в зависимости от контекста (S002).

Гиперрациональность в условиях неопределённости — это не добродетель, а паралич. Эвристики существуют потому, что они работают в реальном времени.

Автоматизированные системы принятия решений: новые ловушки старых ошибок

Автоматизированные системы принятия решений наследуют когнитивные искажения своих создателей через данные и алгоритмы. Если обучающая выборка содержит исторические предубеждения (например, алгоритм найма обучен на данных, где 90% успешных кандидатов — мужчины), система воспроизведёт дискриминацию.

Ошибка подтверждения кодируется в выборе метрик: если оптимизировать точность, игнорируя ложноотрицательные результаты, система будет пропускать редкие, но критичные случаи. Ethics-based auditing предлагает структурированную проверку на соответствие этическим нормам, но это «мягкий» механизм — основная задача аудиторов не наказывать, а стимулировать этическую рефлексию на ключевых этапах разработки.

Подробнее о логических ошибках, которые кодируются в алгоритмы, см. логические ошибки: учимся выявлять софизмы и корреляция не равна причинности.

Механизмы саботажа: как эвристики превращают скорость в уязвимость

Понимание механизма — это ключ к защите. Когнитивные ловушки работают не случайно: они эксплуатируют архитектурные особенности мозга, эволюционные приоритеты и социальные инстинкты. Подробнее — в разделе Статистика и теория вероятностей.

Разбор причинно-следственных цепочек показывает, где именно ломается рациональность.

🔁 Эффект доступности: почему медийные события искажают оценку рисков

Эвристика доступности оценивает вероятность события по лёгкости, с которой примеры приходят в голову. Яркие, эмоционально заряженные события (теракты, авиакатастрофы, нападения акул) запоминаются лучше и активируются быстрее, чем статистически частые, но скучные (сердечно-сосудистые заболевания, автомобильные аварии).

Медиа усиливают эффект: освещение редких, но драматичных событий создаёт иллюзию частоты. Люди боятся летать, но не боятся ездить на машине, хотя риск погибнуть в ДТП на порядки выше.

В бизнесе это приводит к переоценке «чёрных лебедей» и недооценке рутинных рисков — стратегия фокусируется на видимых угрозах, игнорируя системные.

🧷 Эффект якоря: как первое число захватывает весь диапазон переговоров

Anchoring effect работает через прайминг: первое число, которое вы слышите (даже если оно случайно), становится точкой отсчёта для всех последующих оценок.

Классический эксперимент: участникам крутили рулетку (случайное число от 0 до 100), а затем просили оценить долю африканских стран в ООН. Те, кому выпало 10, давали оценку ~25%, те, кому 65 — ~45%. Рулетка не имела отношения к вопросу, но якорь сработал.

- В переговорах

- Первое предложение определяет диапазон торга. Если продавец называет цену $100k, финальная сделка будет ближе к этой цифре, чем если бы он начал с $50k.

- Защита

- Делать первое предложение самому или явно отвергать якорь: «Эта цифра не релевантна, давайте начнём с анализа рынка».

🧩 Ошибка базовой ставки: почему врачи ставят неверные диагнозы при точных тестах

Base rate fallacy игнорирует априорную вероятность (базовую ставку) и фокусируется на специфичной информации. Тест на редкую болезнь (распространённость 0.1%) с чувствительностью 99% и специфичностью 99% даёт положительный результат.

Интуитивный ответ: вероятность болезни ~99%. Правильный ответ (теорема Байеса): ~9% (S005).

| Группа | Размер | Результат теста | Количество |

|---|---|---|---|

| Больные (0.1%) | 10 из 10,000 | Положительный (99%) | ~10 |

| Здоровые (99.9%) | 9,990 из 10,000 | Ложноположительный (1%) | ~100 |

| Вероятность болезни при положительном тесте | 10 / (10+100) ≈ 9% | ||

Врачи систематически игнорируют базовую ставку, фокусируясь на «99% точности теста». Это приводит к гипердиагностике и ненужному лечению.

🔁 Эскалация обязательств: почему невозвратные затраты убивают проекты

Sunk cost fallacy заставляет продолжать провальный проект, потому что «уже столько вложено». Мозг воспринимает отказ как признание ошибки, что активирует болевые центры (anterior cingulate cortex).

Рационально: невозвратные затраты не должны влиять на решение — важны только будущие выгоды и издержки. Но эмоционально: отказ = потеря лица, признание некомпетентности.

В корпорациях это усиливается групповым мышлением: команда, вложившая годы в проект, не может признать провал без разрушения идентичности.

Пример: Concorde — британское и французское правительства продолжали финансировать убыточный проект, потому что остановка означала признание ошибки на национальном уровне.

🧬 Фундаментальная ошибка атрибуции: почему мы видим характер, а не ситуацию

Fundamental attribution error переоценивает роль личностных факторов и недооценивает ситуационные. Если кто-то грубит, мы думаем «он грубиян», а не «возможно, у него тяжёлый день».

Механизм: оценка ситуационных факторов требует дополнительной информации и когнитивных усилий, а атрибуция характеру — быстрая и автоматическая.

- Наблюдаем поведение (жёсткая позиция оппонента)

- Быстро атрибутируем характеру (враждебность, агрессия)

- Игнорируем ситуационные факторы (внутриполитическое давление, ограничения)

- Принимаем решение на основе неполной модели (переговоры срываются) (S001)

Защита: явно моделировать ситуационные ограничения. Спросить себя: «Какие факторы могут заставить его действовать так?» — это переключает внимание с Системы 1 на Системы 2.

Подробнее о логических ошибках и их механизмах — и как они встраиваются в дискурс.

Конфликты и неопределённости: где источники расходятся и почему это важно

Научная честность требует признать: не все вопросы решены. Источники расходятся в оценке того, насколько когнитивные искажения универсальны, насколько они поддаются коррекции и в каких контекстах эвристики оправданы. Подробнее — в разделе Эпистемология.

Три узла разногласий, которые определяют, как вы будете действовать дальше.

- Универсальность vs. контекстуальность. (S003) утверждает, что эвристики — адаптивный инструмент, работающий в большинстве сценариев. Но (S001) показывает: мотивированное рассуждение и идеологические фильтры настолько мощны, что «универсальные» правила ломаются под давлением убеждений. Вывод: эвристика работает, пока не включается защита идентичности.

- Коррекция через обучение vs. структурная неизбежность. (S002) предлагает альтернативные формы тестирования, намекая на пластичность когнитивных процессов. Однако (S004) указывает на жёсткие ограничения рабочей памяти — ресурс конечен, и никакое обучение не расширит его физически.

- Ассоциативное vs. пропозициональное обучение. (S005) переопределяет механизм: человеческое обучение не просто ассоциативно, оно пропозиционально (логико-структурировано). Это означает, что ловушки — не просто автоматические срабатывания, а результат неправильно построенных суждений.

Разногласия между источниками — не слабость науки, а карта реальности. Каждый конфликт указывает на граничный случай, где ваша модель мира может дать сбой.

Практический смысл: не ищите универсальный лайфхак. Вместо этого выявляйте логические ошибки в собственных суждениях и различайте корреляцию и причинность в каждом конкретном решении.