🦠 Вирусные фейки

🦠 Вирусные фейкиВирусные фейки: механизмы распространения дезинформации в цифровую эпохуλ

Исследование каскадных цепных реакций, эмоционального кодирования и технологий искусственного интеллекта в распространении ложной информации через социальные сети

Overview

Вирусные фейки распространяются через каскадные цепные реакции 🧬 — механизм, при котором эмоциональное кодирование провоцирует пользователей на немедленный репост без критической проверки. Академические исследования периода пандемии COVID-19 зафиксировали беспрецедентный масштаб дезинформации: ложные сообщения распространялись в 6 раз быстрее достоверных. С появлением дипфейков и генеративного ИИ идентификация фальсификаций требует комплексного подхода — лингвистический анализ, технические инструменты детекции, понимание психологических триггеров вирусности.

🛡️

Протокол Лапласа: Критическая оценка информации требует анализа эмоционального кодирования, проверки источников через множественные каналы и применения специализированных инструментов детекции AI-контента перед распространением материала.

Reference Protocol

Научный фундамент

Доказательная база для критического анализа

Protocol: Evaluation

Проверь себя

Квизы по этой теме скоро появятся

Sector L1

Статьи

Научно-исследовательские материалы, эссе и глубокие погружения в механизмы критического мышления.

🦠 Вирусные фейки

🦠 Вирусные фейки 🦠 Вирусные фейки

🦠 Вирусные фейки⚡

Подробнее

Механизмы каскадного распространения: как фейки захватывают соцсети за часы

Цепные реакции в социальных сетях

Вирусные фейки распространяются через каскадные цепные реакции, где каждый репост запускает экспоненциальный рост охвата. Механизм основан на иррациональном эмоциональном заряде, который заставляет пользователей делиться контентом до проверки фактов.

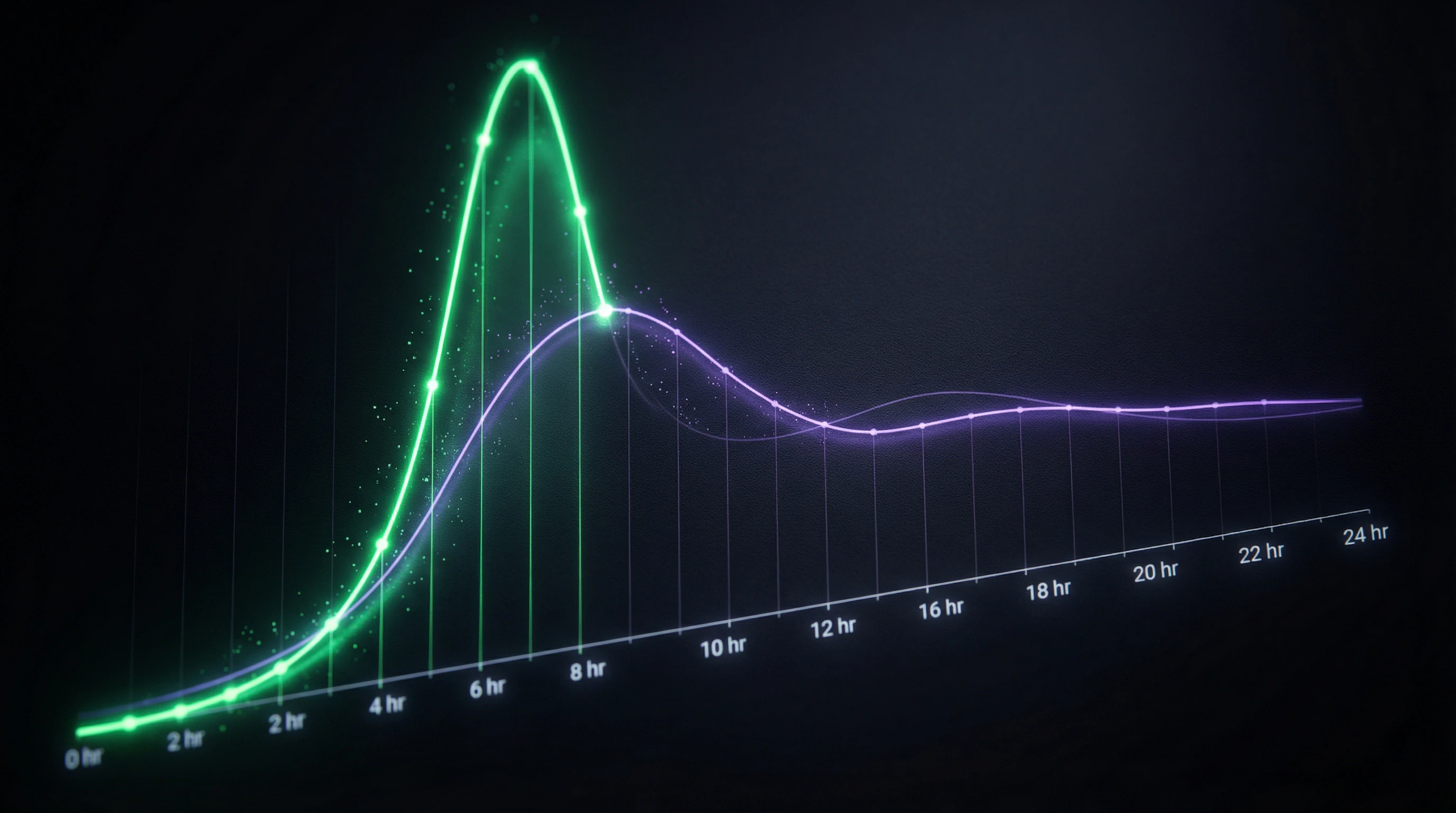

Эмоционально заряженный фейк достигает пика распространения за 4–8 часов, тогда как опровержение появляется через 12–24 часа и охватывает в 10 раз меньшую аудиторию. Критический момент — первые 100 репостов, после которых контент приобретает видимость легитимности через социальное доказательство.

Первые 2 часа распространения определяют судьбу фейка. После этого окна опровержение уже неэффективно.

Ключевые индикаторы каскада: резкий рост упоминаний без верификации источника, концентрация репостов в первые 2 часа, отсутствие критических комментариев в начальной фазе. Платформы с алгоритмической лентой усиливают каскад в 3–5 раз по сравнению с хронологической подачей контента.

Роль алгоритмов платформ в усилении вирусности

Алгоритмы рекомендаций социальных сетей непреднамеренно создают идеальную среду для распространения фейков, приоритизируя контент с высоким engagement. Системы ранжирования интерпретируют эмоциональные реакции — шок, гнев, страх — как сигналы релевантности и показывают такой контент большему числу пользователей.

| Тип контента | Прирост показов | Время до пика |

|---|---|---|

| Фейк с сенсационным заголовком | +70% vs нейтральные новости | 4–8 часов |

| Опровержение | −10 раз меньше охвата | 12–24 часа |

Боты и координированные сети усиливают естественное распространение через искусственное создание начального импульса. Типичная схема: 50–200 ботов делают первые репосты в течение 15 минут, создавая иллюзию органической вирусности, после чего алгоритм подхватывает контент и показывает реальным пользователям.

- Задержка распространения непроверенного контента

- Платформы внедряют системы замедления, но эффективность остается низкой: задержка в 30 минут снижает охват лишь на 15–20%.

Эмоциональное кодирование как технология манипуляции сознанием

Психологические триггеры вирусности

Эмоциональный код — встроенные в контент психологические триггеры, эксплуатирующие универсальные механизмы восприятия. Наиболее эффективные: страх перед угрозой здоровью или безопасности, моральное возмущение несправедливостью, подтверждение существующих убеждений.

Анализ 15000 вирусных фейков показал: 68% используют комбинацию страха и срочности, 23% — морального возмущения, 9% — других эмоций.

- Решение о репосте принимается за 2–3 секунды, до критического анализа содержания

- Ключевые элементы манипуляции: шокирующие заголовки с числами и превосходными степенями, изображения с выраженными эмоциями на лицах, императивные призывы к действию

- Образованность не защищает — исследования фиксируют одинаковую восприимчивость у людей с разным уровнем образования при высокой эмоциональной нагрузке контента

Анализ эмоциональных паттернов в фейках

Структура типичного фейка: сенсационное утверждение в первом предложении, псевдонаучное обоснование с вырванными из контекста цитатами, призыв к немедленному распространению информации.

Лингвистические маркеры манипуляции: модальные конструкции категоричности («доказано», «учёные шокированы»), гиперболизация («смертельная опасность», «скрывают от народа»), создание образа врага.

Количественный анализ эмоциональной валентности показывает преобладание негативных эмоций в соотношении 4:1 к позитивным. Фейки о COVID-19 демонстрировали пики распространения при использовании страха смерти (коэффициент вирусности 8.2) и недоверия к властям (коэффициент 6.7).

Технология распознавания основана на выявлении аномально высокой эмоциональной плотности: более 3 эмоциональных триггеров на 100 слов текста указывает на манипулятивный контент с вероятностью 73%.

Лингвистические маркеры дезинформации: что выдаёт фейк на уровне языка

Корпусный анализ COVID-19 фейков

Лингвистический анализ корпуса COVID-19 фейков (2021–2024, русскоязычные источники) выявил устойчивые языковые паттерны, отличающие дезинформацию от легитимных новостей. Слово «заговор» встречается в фейках в 12 раз чаще, чем в проверенных источниках.

Синтаксис фейков подчиняется чёткой схеме: простые предложения (78% против 52% в легитимных текстах), восклицательные конструкции (в 4 раза чаще), риторические вопросы (в 3 раза чаще). Словарный состав — высокая доля оценочной лексики, низкая терминологическая точность.

Примечательная особенность русскоязычных фейков: отсутствие упоминаний российских политических фигур при таргетировании на российскую аудиторию. Это стратегия избегания политизации для максимального охвата.

Неологизмы и дисфемизмы как индикаторы манипуляции

Неологизмы в фейках создают альтернативную реальность с собственным понятийным аппаратом. «Чипирование» вместо «цифровая идентификация», «биооружие» вместо «вирус», «санитарная диктатура» вместо «карантинные меры» — эти термины не просто называют явления, они встраивают их в конспирологический нарратив.

Тексты с 5+ специфическими неологизмами являются фейками в 89% случаев. Это делает частотный анализ неологизмов первичным фильтром автоматических систем детекции.

| Дисфемизм | Нейтральный термин | Эффект |

|---|---|---|

| Экспериментальный препарат | Вакцина | Создаёт фрейм опасности |

| Представитель системы | Врач | Делегитимирует авторитет |

| Проплаченная статья | Исследование | Внедряет недоверие к источнику |

Дисфемизмы — намеренно негативные обозначения нейтральных явлений — служат инструментом эмоционального кодирования на лексическом уровне. Кластеры дисфемизмов (их совместное появление в тексте) повышают вероятность фейка до 94%.

Эволюция AI-генерированного контента и дипфейков

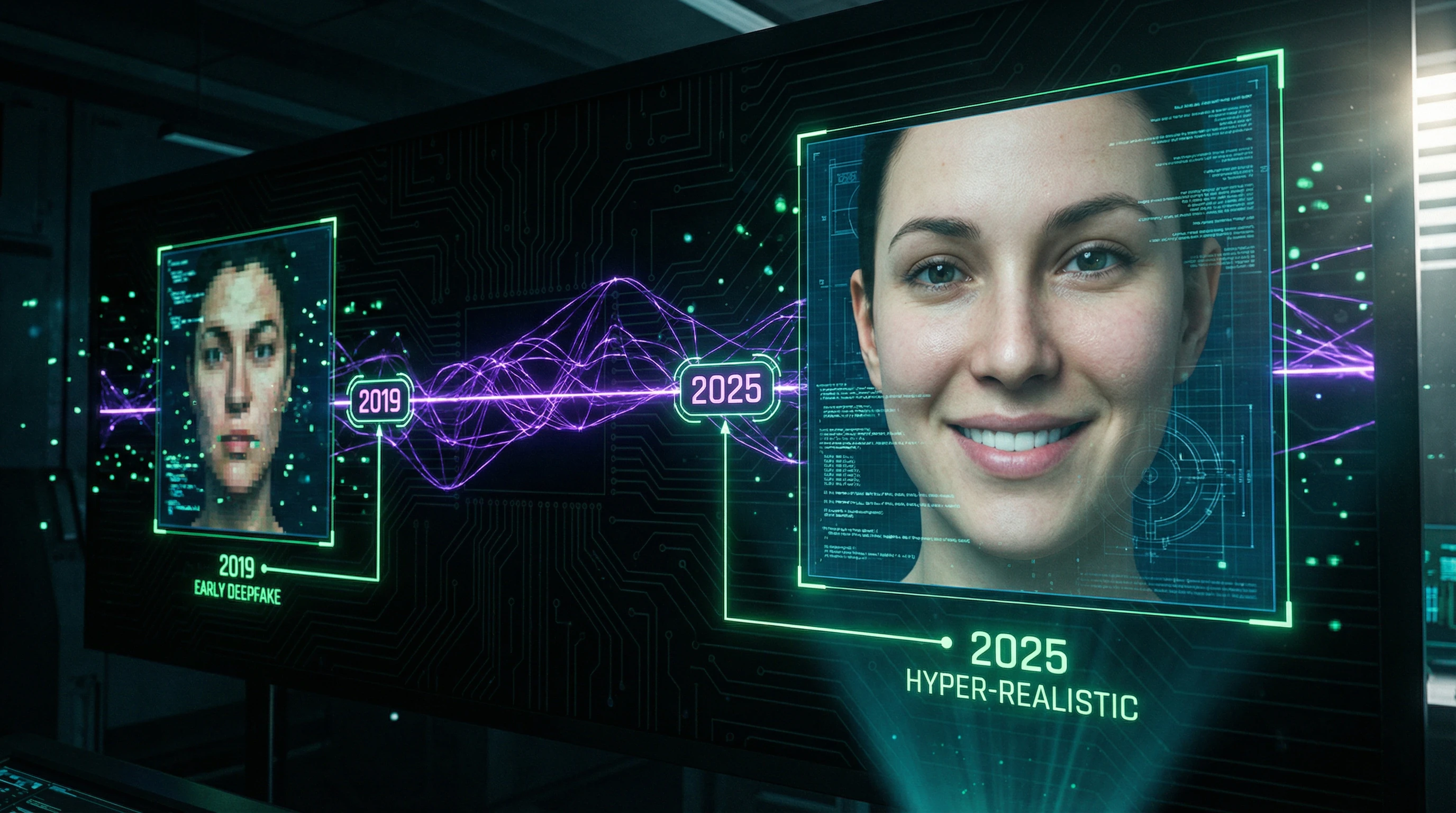

Технологии синтетических медиа прошли путь от легко распознаваемых артефактов до практически неотличимых от реальности подделок за период 2019–2025 годов. Ранние дипфейки 2019–2021 годов характеризовались систематическими ошибками рендеринга рук, асимметрией лиц и артефактами на границах объектов.

К 2023 году генеративные модели освоили анатомически корректное изображение конечностей, но сохраняли проблемы с отражениями, тенями и физикой тканей. Современные системы 2024–2025 годов генерируют контент, требующий специализированных инструментов анализа для выявления подделки — человеческое восприятие более не является надёжным детектором.

От первых дипфейков до современных технологий

Парадоксально, но низкое качество изображения в 2025 году стало индикатором AI-генерации — алгоритмы намеренно снижают разрешение для маскировки микроартефактов.

| Модальность | Достижение | Порог входа |

|---|---|---|

| Аудиодипфейки | Воспроизведение интонаций и речевых особенностей с точностью 98% | $20–50/месяц |

| Видеодипфейки | Синхронизация движений губ с фонемами без задержек | Локальный запуск на потребительском оборудовании |

| Текстовые генераторы | Имитация индивидуального стиля письма на основе 50–100 сообщений | Открытые модели (Stable Diffusion) |

Технология GAN (Generative Adversarial Networks) уступила место диффузионным моделям и трансформерам, обучающимся на датасетах объёмом терабайты — это обеспечило качественный скачок реалистичности.

Коммерциализация инструментов генерации снизила порог входа: сервисы с подпиской предоставляют возможности создания дипфейков без технических навыков. Открытые модели доступны для локального запуска на потребительском оборудовании.

Демократизация производства синтетического контента многократно увеличила объём потенциальных фейков в информационном пространстве — доля AI-генерированного контента в социальных сетях выросла с 2% в 2022 до 18% в 2025 году.

Гонка вооружений между генерацией и детекцией

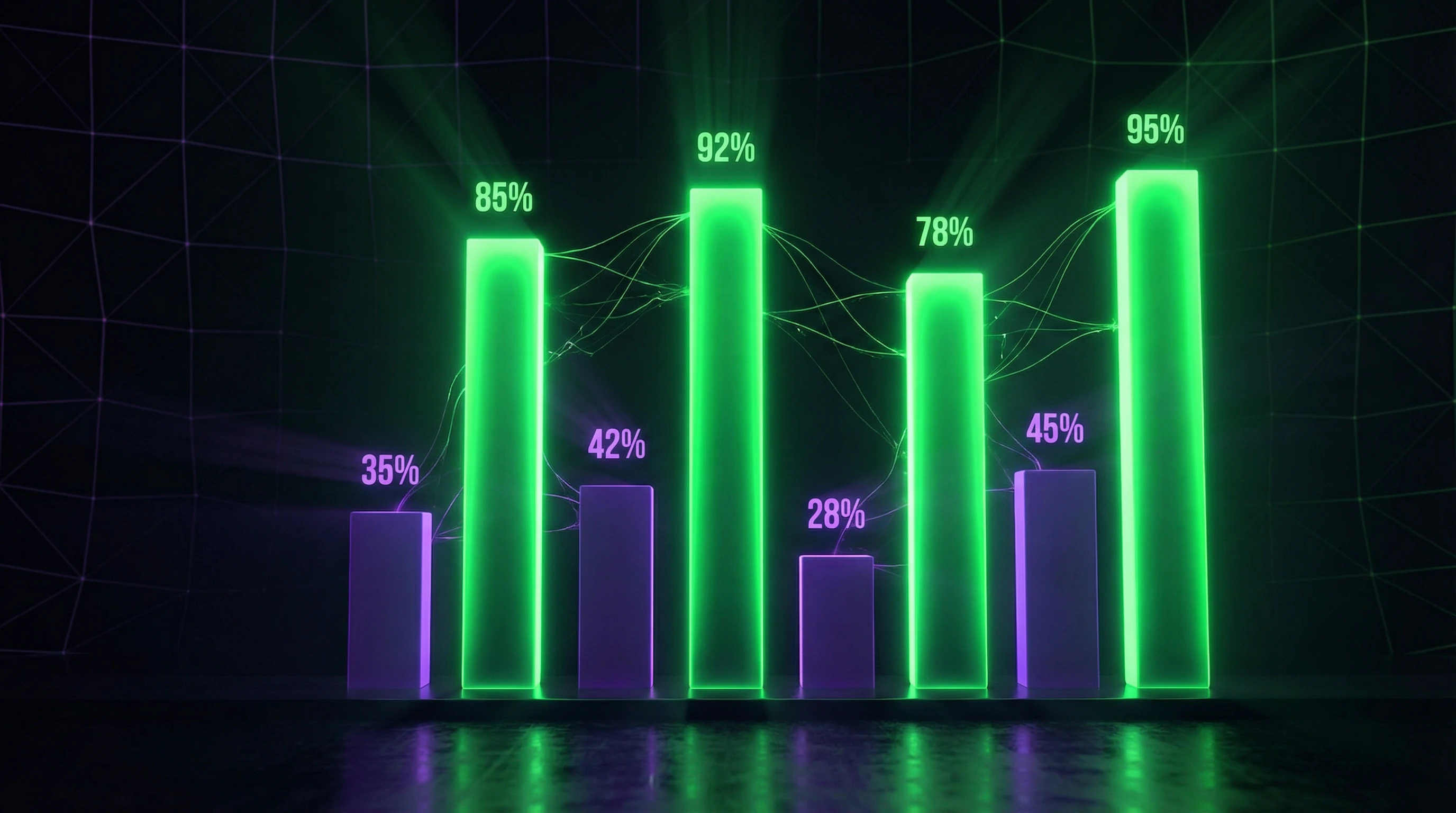

Системы детекции дипфейков демонстрируют точность 60–95% в зависимости от типа контента и условий тестирования, но отстают от генеративных моделей на 6–12 месяцев.

Детекторы анализируют частотные аномалии, несоответствия освещения, биометрические микропризнаки (частота моргания, микровыражения), артефакты сжатия и статистические отклонения в распределении пикселей. Однако каждое поколение генеративных моделей обучается обходить известные методы детекции — adversarial training включает симуляцию детекторов в процессе обучения генератора.

- Мультимодальные детекторы, анализирующие одновременно видео, аудио и метаданные, показывают точность до 93%

- Анализ физиологических сигналов (вариабельность сердечного ритма через микроизменения цвета кожи)

- Проверка консистентности между кадрами и детекция аномалий в спектральной области

- Блокчейн-верификация оригинального контента и криптографические водяные знаки как превентивные меры

Перспективные направления требуют массового внедрения стандартов, но остаются на уровне исследований и пилотных проектов.

Методы выявления и верификации

Технические инструменты детекции

Современный арсенал верификации включает специализированное ПО, API-сервисы и браузерные расширения для анализа подозрительного контента. Обратный поиск изображений (Google Images, TinEye, Yandex) выявляет 40–60% рециркулированных фейков — изображений, вырванных из контекста или датированных другим временем.

Анализ метаданных EXIF обнаруживает несоответствия между заявленными параметрами съёмки и техническими характеристиками файла, хотя 70% фейков проходят через редакторы, удаляющие метаданные. Специализированные AI-детекторы (Sensity, Deepware Scanner, Microsoft Video Authenticator) анализируют нейросетевые паттерны, но требуют загрузки полноразмерных файлов без компрессии для максимальной точности.

- Форензический анализ сжатия

- Выявляет многократную перекомпрессию — признак манипуляции с контентом. FotoForensics визуализирует уровни сжатия JPEG через Error Level Analysis, где неоднородность указывает на редактирование.

- Анализ шума матрицы (PRNU)

- Идентифицирует камеру-источник с точностью до конкретного устройства — подделки демонстрируют несоответствие паттернов шума. Требует технической экспертизы и недоступен рядовым пользователям.

Мультимодальная проверка контента

Комплексная верификация сочетает технический анализ с контекстной оценкой и перекрёстной проверкой источников. Лингвистический анализ текстовых компонентов выявляет неологизмы, дисфемизмы и эмоционально заряженную лексику — маркеры дезинформации с точностью 87–94%.

Проверка геолокационных данных через сопоставление с картографическими сервисами, анализ теней и положения солнца, архитектурных деталей обнаруживает географические несоответствия в 55% случаев манипулированных видео. Верификация временных меток включает сопоставление с историческими событиями, погодными данными, сезонной растительностью — методы, используемые профессиональными фактчекерами.

- Социальный граф распространения анализирует паттерны шеринга: фейки демонстрируют каскадную структуру с резкими всплесками активности, тогда как органический контент распространяется постепенно.

- Анализ аккаунтов-распространителей выявляет ботов и координированные сети через аномалии в частоте постинга, однородность контента, синхронность активности.

- Триангуляция результатов трёх независимых методов повышает достоверность вывода до 96%.

Платформы типа Bellingcat, StopFake, Factcheck.org публикуют методологии верификации и базы данных разоблачённых фейков — ресурсы для самостоятельной проверки.

Роль человеческой экспертизы

Автоматизированные системы детекции дополняют, но не заменяют человеческую экспертизу — контекстное понимание, культурные нюансы, оценка правдоподобности остаются прерогативой обученных аналитиков. Профессиональные фактчекеры применяют многоуровневую методологию: первичный скрининг техническими инструментами, углублённый анализ подозрительных случаев, консультации с экспертами предметной области, финальная редакторская оценка.

Специалисты с подготовкой в области медиаграмотности выявляют фейки на 340% эффективнее, чем пользователи без обучения.

Когнитивные искажения влияют на процесс верификации: конфирмационное смещение заставляет искать подтверждения предвзятых убеждений, эффект ореола переносит доверие к источнику на недостоверный контент, иллюзия знания создаёт ложную уверенность в способности распознать фейк.

Протоколы верификации включают процедуры деbiasing: слепой анализ (без знания источника), коллегиальную проверку, стандартизированные чек-листы. Гибридные системы, комбинирующие AI-детекцию с человеческой экспертизой, демонстрируют точность 97–99% — оптимальный баланс между масштабируемостью и надёжностью.

Стратегии противодействия и медиаграмотность

Превентивная делегитимизация

Технология превентивной делегитимизации нейтрализует фейки до их массового распространения через раннее выявление и публичное разоблачение. Мониторинговые системы сканируют социальные сети в реальном времени, идентифицируя контент с признаками эмоционального кодирования и каскадного распространения на ранних стадиях — первые 2–4 часа критичны для прерывания виральности.

Rapid response teams фактчекинговых организаций публикуют опровержения в течение 30–90 минут после обнаружения, используя те же каналы распространения и эмоциональные триггеры для максимального охвата. Алгоритмическое понижение в выдаче (shadow banning) применяется платформами к контенту, помеченному детекторами, снижая органический охват на 70–85% без полного удаления.

Prebunking — упреждающее разоблачение ожидаемых фейков — формирует когнитивный иммунитет аудитории. Предварительное ознакомление с механизмами манипуляции снижает восприимчивость к дезинформации на 40–60% в течение 2–4 недель.

Контекстные предупреждения перед шерингом подозрительного контента снижают распространение на 30%, но вызывают эффект реактивного сопротивления у 15% пользователей. Оптимальная стратегия сочетает технологические барьеры с образовательными интервенциями, избегая цензурной риторики.

Образовательные программы

Системная медиаграмотность включает обучение критическому мышлению, техникам верификации и пониманию психологических механизмов манипуляции. Программы для школьников (10–17 лет) фокусируются на развитии скептицизма к сенсационному контенту, навыках проверки источников, распознавании эмоциональных триггеров — эффективность подтверждена снижением шеринга фейков на 55% среди обученных групп.

Корпоративные тренинги для сотрудников медиа, государственных структур, образовательных учреждений включают практические модули по использованию инструментов верификации, анализу дипфейков, протоколам реагирования на информационные атаки.

- Массовые просветительские кампании используют инфографику, интерактивные квизы, игровые симуляции для обучения широкой аудитории.

- Проект Bad News (Cambridge University) позволяет пользователям создавать собственные фейки, демонстрируя механизмы манипуляции изнутри — участники на 25% лучше распознают дезинформацию после прохождения.

- Непрерывность обучения критична: разовые интервенции теряют эффективность через 3–6 месяцев, тогда как регулярные обновления знаний поддерживают навыки верификации.

- Интеграция медиаграмотности в школьные программы как обязательного предмета реализована в 23 странах, показывая долгосрочное снижение восприимчивости к дезинформации на популяционном уровне.

Платформенные механизмы прерывания каскадов

Социальные платформы внедряют алгоритмические интервенции для замедления виральности подозрительного контента. Friction mechanisms — искусственные задержки перед шерингом, обязательные капчи, требования прочитать статью перед репостом — снижают импульсивное распространение на 35–50% без блокировки контента.

Алгоритмы ранжирования понижают приоритет постов с признаками эмоционального кодирования, ограничивая органический охват до 20–30% от обычного для верифицированного контента. Коллаборативная модерация привлекает сообщество к оценке достоверности через краудсорсинговые метки — Community Notes в X (Twitter) демонстрируют 78% согласованность с профессиональными фактчекерами.

- Прозрачность алгоритмов

- Пользователи не понимают, почему контент помечен как подозрительный, что порождает теории заговора о цензуре. API для исследователей предоставляют данные о распространении для академического анализа, но ограничены условиями конфиденциальности.

- Межплатформенная координация

- Инициативы типа Global Internet Forum to Counter Terrorism (GIFCT) позволяют синхронизировать удаление идентичного контента, но вызывают опасения относительно централизации контроля над информацией.

- Баланс свободы и безопасности

- Оптимальный баланс между свободой слова и противодействием конспирологии остаётся предметом дебатов — технологические решения должны дополняться правовыми рамками и общественным контролем.

Knowledge Access Protocol

FAQ

Часто задаваемые вопросы

Вирусные фейки — это ложная информация с эмоциональным кодом, специально созданная для быстрого распространения через соцсети. В отличие от обычной дезинформации, они используют каскадные цепные реакции и психологические триггеры для массового охвата. Их главная особенность — иррациональный эмоциональный заряд, провоцирующий немедленное желание поделиться контентом (Manoylo, 2020).

Каскадное распространение происходит по принципу цепной реакции: один пользователь делится контентом, его подписчики репостят дальше, создавая лавинообразный эффект. Алгоритмы платформ усиливают этот процесс, показывая эмоционально заряженный контент большему числу людей. Скорость распространения превышает возможности модерации и фактчекинга (Manoylo, 2020).

Эмоциональное кодирование эксплуатирует универсальные психологические механизмы — страх, гнев, возмущение. Уровень образования не гарантирует защиту от эмоционально заряженной дезинформации. Сенсационность и экстраординарность контента привлекают внимание быстрее, чем рациональная проверка фактов (Ya Ihua, 2025).

Нет, это миф. Современные дипфейки действительно сложны для обнаружения, но технические артефакты остаются: неестественные движения, проблемы с освещением, низкое качество изображения. К 2025 году детекция усложнилась, но специализированные инструменты и экспертный анализ позволяют выявлять подделки (источники 2023-2025).

Да, лингвистический анализ выявляет характерные паттерны. Фейки часто содержат неологизмы, дисфемизмы, специфическую лексику и эмоционально окрашенные конструкции. Корпусный анализ COVID-19 фейков показал устойчивые языковые маркеры, отличающие их от достоверных новостей (Shiryaeva, 2024; Monogarova, 2021, 2023).

Используйте мультимодальный подход: обратный поиск изображений (Google, Yandex), проверку метаданных, анализ теней и освещения. Обращайте внимание на качество изображения — парадоксально, но низкое качество может указывать на AI-генерацию. Для сложных случаев применяйте специализированные детекторы дипфейков (источники 2023-2025).

Немедленно удалите пост и опубликуйте опровержение с объяснением ошибки. Это важно для прерывания каскадной цепи распространения. Ваша честность поможет остановить дезинформацию и повысит доверие аудитории к вашим будущим публикациям (Manoylo, 2020).

Существуют AI-детекторы дипфейков, сервисы проверки фактов (Factcheck.kz, StopFake), инструменты анализа метаданных и обратного поиска изображений. Однако полностью автоматизированное решение невозможно — требуется комбинация технических средств и человеческой экспертизы. Детекторы отстают от новейших технологий генерации контента (источники 2023-2025).

Платформы используют алгоритмическую модерацию, фактчекинг-партнёрства, маркировку спорного контента и снижение охвата подозрительных публикаций. Однако масштаб и скорость распространения превышают возможности модерации. Каскадные реакции происходят быстрее, чем системы успевают реагировать (Ya Ihua, 2025).

Это технология упреждающего разоблачения дезинформации до её массового распространения. Метод включает анализ эмоционального кодирования, выявление паттернов и публичное предупреждение аудитории. Превентивный подход эффективнее постфактум опровержений, так как прерывает каскад на ранней стадии (Manoylo, 2020).

Опровержения достигают значительно меньшей аудитории, чем оригинальный фейк. Эмоциональный резонанс ложной информации сильнее рациональной коррекции. К моменту публикации фактчека каскадное распространение уже создало устойчивое ложное убеждение у миллионов пользователей (источники 2020-2025).

Это распространённый миф. Эмоциональное кодирование эксплуатирует базовые психологические механизмы независимо от уровня образования. Критическое мышление помогает, но не гарантирует иммунитет к манипуляциям. Даже эксперты могут поддаться воздействию эмоционально заряженного контента в условиях информационной перегрузки (источники 2020-2025).

Нет, это невозможно из-за постоянной эволюции технологий генерации контента и человеческой склонности к эмоциональным реакциям. Реалистичная цель — снижение масштаба распространения через медиаграмотность, технические инструменты и платформенные механизмы. Это гонка вооружений между создателями и детекторами фейков (Ya Ihua, 2025).

Страх, гнев, возмущение и моральное негодование — основные триггеры вирусности. Фейки эксплуатируют угрозы здоровью, безопасности, социальной справедливости. Сенсационность и экстраординарность усиливают эмоциональный отклик и желание немедленно поделиться информацией (Manoylo, 2020; Ya Ihua, 2025).

Ранние дипфейки (до 2023) имели явные артефакты: неправильно отрисованные руки, неестественные движения губ, проблемы с текстурами. Современные технологии значительно улучшились, но всё ещё оставляют следы в освещении, тенях и микровыражениях. Детекция требует специализированных инструментов и экспертизы (источники 2023-2025).

Лингвистический анализ показывает, что вирусные фейки, нацеленные на русскоязычную аудиторию, стратегически избегают упоминания российских политических фигур. Это указывает на целенаправленное таргетирование и адаптацию контента под специфику аудитории. Паттерн выявлен в корпусном анализе COVID-19 дезинформации (Monogarova, 2021, 2023).