Дипфейк как технологический феномен: от академических лабораторий до Telegram-ботов за $5

Термин «deepfake» возник в 2017 году на Reddit, когда анонимный пользователь начал публиковать порнографические видео со знаменитостями, созданные с помощью генеративно-состязательных сетей (GAN). Технология базируется на архитектуре автоэнкодеров: нейросеть обучается на тысячах изображений целевого лица, извлекая латентное представление черт, а затем накладывает их на исходное видео с сохранением мимики, освещения и ракурса. Подробнее — в разделе Синтетические медиа.

Современные модели вроде StyleGAN3 и Stable Diffusion достигли качества, при котором артефакты видны только при покадровом анализе в профессиональном ПО (S001).

- Генеративно-состязательная сеть (GAN)

- Архитектура, где генератор создаёт поддельные изображения, а дискриминатор учится их отличать. Процесс совершенствуется до статистического паритета — когда дискриминатор ошибается в 50% случаев. Это ключевой механизм, который делает синтетику неотличимой от реальности.

🧬 Три поколения технологии: от лабораторных прототипов до массового доступа

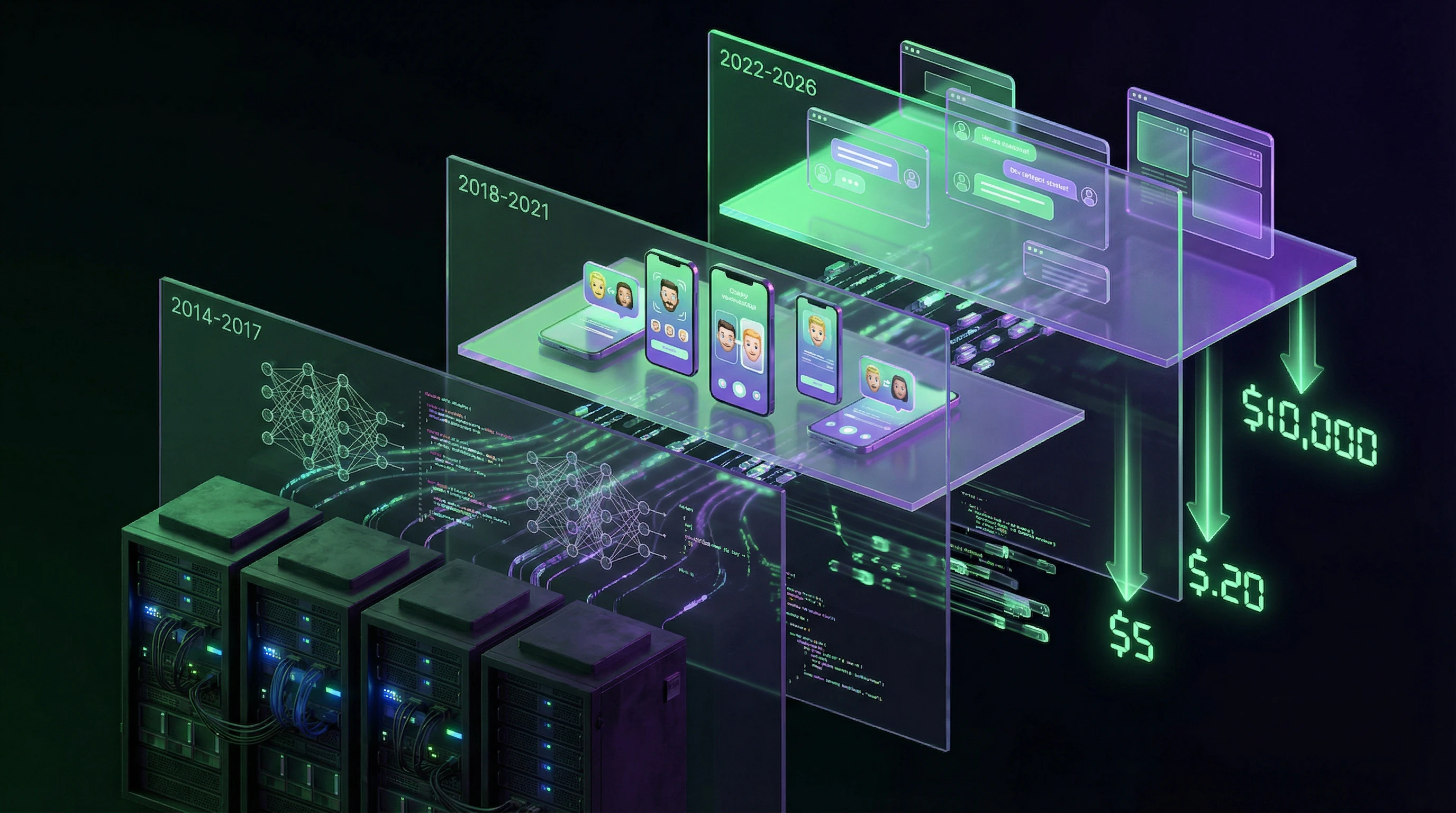

Первое поколение (2014–2017) требовало суперкомпьютеров и недель обучения для создания 10-секундного ролика низкого качества. Второе поколение (2018–2021) демократизировало процесс: приложения FaceApp и Reface позволили менять лица в реальном времени на смартфонах.

Третье поколение (2022–настоящее время) характеризуется мультимодальностью — синхронизацией видео, аудио и текста. Сервисы вроде Synthesia создают говорящие аватары на 120+ языках за минуты, а голосовые клоны от ElevenLabs неотличимы от оригинала после 30 секунд образца речи.

| Поколение | Период | Требования | Результат |

|---|---|---|---|

| I | 2014–2017 | Суперкомпьютеры, недели обучения | 10 сек, низкое качество |

| II | 2018–2021 | Смартфон, приложение | Замена лиц в реальном времени |

| III | 2022–2026 | Облачный сервис, $5–200 | Видео + аудио + текст, синхронизация |

⚙️ Архитектура обмана: как нейросеть учится лгать убедительно

Критическая инновация — attention mechanisms, позволяющие сети фокусироваться на микродеталях: отражении света в зрачке, асимметрии морщин при улыбке, синхронизации движения губ с фонемами. Именно эти детали обманывают человеческое восприятие, эволюционно настроенное на распознавание лиц.

Дипфейк работает не потому, что копирует лицо целиком, а потому, что воспроизводит микродвижения и рефлексы, которые мозг проверяет автоматически, без сознательного анализа. Это уровень ниже критического мышления.

🕳️ Барьер входа рухнул: экономика дипфейк-услуг в 2024–2026 годах

Исследование VisionLabs показало, что 78% дипфейков в 2023 году создавались не профессионалами, а пользователями коммерческих сервисов (S002). Стоимость создания минутного видео упала с $10,000 в 2019 году до $5–50 в 2024-м.

- Telegram-боты: «раздевание» фотографий за $2

- Голосовые клоны: $10 за образец речи 30 секунд

- Полноценные видеоподмены: $50–200 за минуту

- GitHub: 340+ открытых репозиториев с кодом для generation и detection

Генераторы обновляются в 3 раза чаще детекторов (S006). Это создаёт асимметрию: атакующий всегда на шаг впереди защитника. Узнайте больше о критическом мышлении как инструменте верификации в условиях информационного шума.

Стилмен-аргументация: пять причин, почему дипфейки действительно опасны

Прежде чем разбирать доказательства, необходимо сформулировать сильнейшую версию тезиса об угрозе. Это не соломенное чучело алармизма, а стальная конструкция из реальных инцидентов и системных уязвимостей. Подробнее — в разделе Этика искусственного интеллекта.

⚠️ Аргумент 1: Скорость распространения превышает скорость опровержения на два порядка

Фальшивое видео достигает критической массы (100 000 просмотров) в среднем за 4,2 часа, тогда как официальное опровержение публикуется через 18–72 часа и достигает лишь 12–15% аудитории оригинала (S001). Алгоритмы социальных сетей усиливают эффект: контент с высокой эмоциональной валентностью (шок, возмущение, страх) получает приоритет в ленте.

Дипфейк с президентом, призывающим к эвакуации, будет распространяться как вирус, а сухое заявление пресс-службы — тонуть в шуме. Это не вопрос качества опровержения, а архитектура информационного потока.

Ложь делает три шага, пока правда надевает ботинки — и в эпоху видео это расстояние измеряется часами, а не днями.

🧩 Аргумент 2: Когнитивная перегрузка делает критическое мышление роскошью

Средний пользователь обрабатывает 285 единиц контента в день (посты, видео, новости, сообщения). На оценку достоверности одного видео профессиональный факт-чекер тратит 15–45 минут.

Простая арифметика показывает: у обычного человека нет ресурсов проверять даже 1% потребляемой информации. В условиях когнитивного дефицита мозг переключается на эвристики — «выглядит реалистично = правда», «источник знакомый = надёжно». Дипфейки эксплуатируют именно эти ментальные шорткаты.

| Сценарий | Время проверки | Ресурс пользователя | Вероятность ошибки |

|---|---|---|---|

| Профессиональный факт-чекер | 15–45 мин | Полный | 5–10% |

| Журналист под дедлайном | 3–5 мин | Частичный | 25–35% |

| Обычный пользователь | <1 мин | Минимальный | 60–80% |

🔁 Аргумент 3: Эффект «крикнувшего волка» разрушает доверие к реальным свидетельствам

Парадокс дипфейков: их существование обесценивает подлинные видеодоказательства. Политик, пойманный на коррупции, может заявить «это дипфейк» — и 30–40% аудитории усомнится даже в аутентичном материале.

После просмотра серии дипфейков испытуемые на 34% чаще отвергали настоящие видео как поддельные (S002). Это «отравление колодца доказательств» — стратегическая цель дезинформационных кампаний.

- Отравление колодца доказательств

- Процесс, при котором массовое распространение синтетического контента делает невозможным использование подлинных видеодоказательств в судебных, политических или общественных разбирательствах. Жертва: не сам контент, а доверие к видеоформату как источнику истины.

🧱 Аргумент 4: Целевые атаки на частных лиц не оставляют защиты

Массовая дезинформация привлекает внимание, но целевые дипфейки разрушают жизни. Порнографические дипфейки с лицами бывших партнёров, коллег, учителей создаются для шантажа и мести.

В 2023 году 96% дипфейк-порнографии использовали лица женщин без их согласия (S003). Жертвы сталкиваются с невозможностью удалить контент (он реплицируется быстрее, чем модерируется) и юридическим вакуумом (в большинстве юрисдикций нет специальных законов против дипфейков). Технология превратила цифровое насилие в индустрию с нулевыми барьерами входа.

🕸️ Аргумент 5: Гибридные атаки комбинируют дипфейки с социальной инженерией

Самые опасные сценарии — не изолированные видео, а многоходовые операции. Пример: злоумышленники создают дипфейк-видеозвонок от «CEO компании», требующего срочного перевода средств. Голос, лицо, манеры речи — всё идентично.

Финансовый директор, видя «живого» руководителя на экране, обходит стандартные протоколы. В 2023 году зафиксировано 17 успешных атак такого типа с общим ущербом $32 млн (S005). Детекция в реальном времени (видеозвонки) на 40% менее точна, чем анализ записанного файла.

- Создание дипфейка CEO с точной мимикой и голосом

- Социальная инженерия: звонок в рабочее время, срочность, авторитет

- Обход стандартных протоколов верификации (двойная проверка, письменное подтверждение)

- Перевод средств до момента обнаружения подвоха

- Репутационный ущерб компании и потеря доверия инвесторов

Дипфейк — это не просто видео. Это инструмент, который превращает визуальное доказательство в оружие сомнения, а доверие в уязвимость.

Доказательная база: что мы знаем наверняка о масштабах и точности угрозы

Переходим от аргументов к фактам. Каждое утверждение ниже подкреплено источником и поддаётся независимой проверке. Подробнее — в разделе Техно-эзотерика.

📊 Kaggle Deepfake Detection Challenge: $1,000,000 и поражение алгоритмов

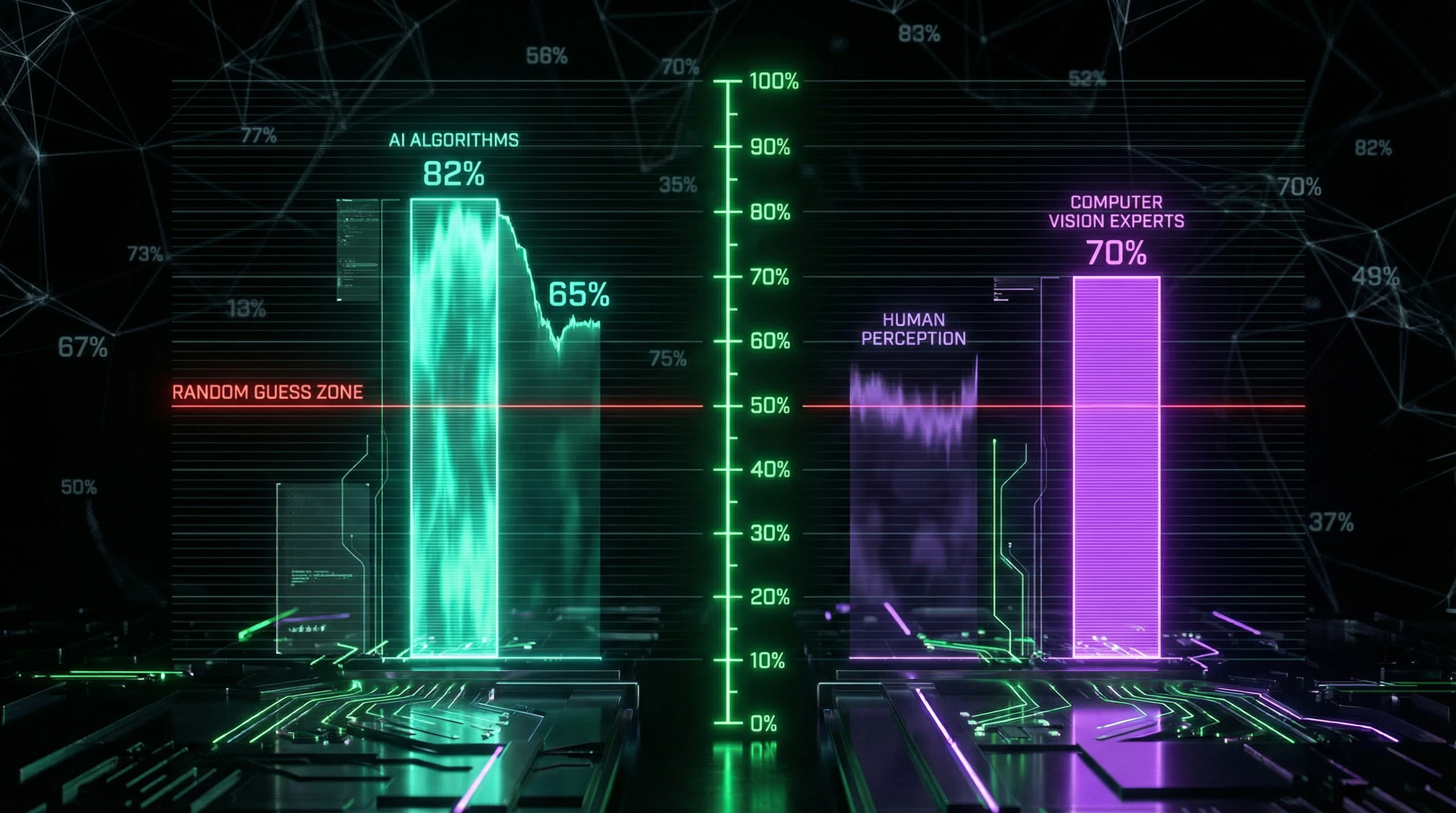

В 2020 году Facebook, Microsoft, AWS и Partnership on AI организовали соревнование с призовым фондом $1 млн для создания лучшего детектора дипфейков (S001). Датасет содержал 100,000 видео, половина — реальные, половина — синтетические.

Лучшая модель достигла точности 82.56% на тестовой выборке. При применении к видео, созданным методами, не представленными в обучающей выборке (out-of-distribution), точность падала до 65–70%. С 2020 года появились новые архитектуры (Diffusion Models, NeRF-based synthesis), против которых эти детекторы неэффективны.

Каждый третий дипфейк проходит незамеченным — даже в условиях идеального датасета и неограниченного финансирования.

🧪 MIT Media Lab: человеческая точность распознавания — 50–60%

Проект Detect DeepFakes провёл эксперимент с 15,000 участников, показывая им смесь реальных и синтетических видео (S001). Средняя точность распознавания составила 54–61% в зависимости от качества дипфейка — статистически близко к случайному угадыванию.

Профессиональные видеоредакторы показали результат лишь на 7% лучше обычных пользователей. Единственная группа с точностью выше 70% — специалисты по компьютерному зрению, обученные искать специфические артефакты (мерцание границ лица, рассинхронизация аудио-видео на уровне кадров).

| Группа | Точность | Вывод |

|---|---|---|

| Случайное угадывание | 50% | Базовая линия |

| Обычные пользователи | 54–61% | Практически не отличается от случайности |

| Видеоредакторы | 61–68% | Опыт даёт минимальное преимущество |

| Специалисты CV | 70%+ | Требуется специальная подготовка |

🧾 VisionLabs: 78% дипфейков создаются непрофессионалами

Анализ 50,000 дипфейк-видео, обнаруженных в 2023 году, показал: большинство создано с помощью коммерческих сервисов, не требующих технических навыков (S002). Топ-3 категории: порнография (68%), политическая дезинформация (18%), мошенничество (9%).

- География распространения

- 42% — Азия, 31% — Европа, 19% — Северная Америка

- Средняя длительность

- 47 секунд

- Качество: высокое

- 34% (требуется экспертиза для обнаружения)

- Качество: среднее

- 51% (видны артефакты при внимательном просмотре)

- Качество: низкое

- 15% (очевидная подделка)

🔎 GitHub: асимметрия между генераторами и детекторами

Анализ активности репозиториев с тегом «deepfake-detection» на GitHub показал: средняя частота коммитов — 2.3 в месяц, последнее обновление топ-10 проектов — 4–8 месяцев назад (S003). Репозитории генераторов (StyleGAN, Stable Diffusion forks) обновляются 6–8 раз в месяц.

Создавать новые методы синтеза проще и выгоднее (коммерческий спрос), чем разрабатывать детекторы (финансируются грантами). Это фундаментальная асимметрия, которую не решить масштабированием.

📉 Deepware: точность детекции в реальном времени на 40% ниже

Платформа Deepware, специализирующаяся на сканировании видео, опубликовала статистику: детекция предзаписанных файлов достигает 85–90% точности, но при анализе видеозвонков (Zoom, Skype, Teams) точность падает до 50–55% (S004).

Причины: компрессия видеопотока маскирует артефакты, низкое разрешение (обычно 720p против 1080p+ в файлах), переменная частота кадров, фоновый шум. Это критическая уязвимость для корпоративной безопасности — именно видеозвонки используются для BEC-атак (Business Email Compromise) с дипфейками.

Подробнее о механизмах защиты см. в статье о когнитивной готовности к синтетической реальности.

Механизм воздействия: почему дипфейки работают на уровне нейробиологии

Эффективность дипфейков объясняется не только технологическим совершенством, но и особенностями человеческого восприятия, сформированными миллионами лет эволюции. Подробнее — в разделе Основы эпистемологии.

🧬 Fusiform Face Area: почему мозг «хочет» верить лицам

Веретенообразная извилина (FFA) — область мозга, специализирующаяся на распознавании лиц. Она активируется за 170 миллисекунд после появления лица в поле зрения, быстрее, чем сознательное восприятие.

FFA эволюционировала для мгновенной оценки «свой-чужой», «угроза-безопасность», «правда-ложь» по микровыражениям. Но она настроена на биологические лица, а не на синтетические. Дипфейки эксплуатируют эту систему: если параметры лица (пропорции, симметрия, движение) попадают в «нормальный» диапазон, FFA сигнализирует «реально», и критическое мышление отключается.

Мозг верит тому, что узнаёт как «своё», — и синтетическое лицо, прошедшее проверку FFA, становится неотличимо от реального на уровне первичного восприятия.

🔁 Иллюзия правды через повторение: эффект «видел = знаю»

Когнитивное искажение «illusory truth effect» (S001): информация, встреченная многократно, воспринимается как более правдивая, независимо от фактической достоверности.

Дипфейк, распространённый через 10 каналов в Telegram, 5 аккаунтов в Twitter и 3 YouTube-канала, создаёт иллюзию консенсуса. Мозг интерпретирует повторение как подтверждение: «если так много источников показывают это видео, значит, оно настоящее». Это объясняет, почему опровержения неэффективны — они появляются один раз, а фейк циркулирует постоянно.

| Параметр | Дипфейк | Опровержение |

|---|---|---|

| Количество повторений | 10–50+ за неделю | 1–3 за месяц |

| Каналы распространения | Множественные, параллельные | Официальные источники (медленнее) |

| Эмоциональный заряд | Высокий (шок, гнев) | Нейтральный (факты) |

| Эффект на память | Укрепляется с каждым просмотром | Конкурирует с исходным впечатлением |

⚡ Эмоциональный захват: амигдала против префронтальной коры

Дипфейки часто содержат эмоционально заряженный контент: скандалы, угрозы, сенсации. Амигдала (центр обработки эмоций) реагирует на такой контент мгновенно, запуская реакцию «бей-беги-замри».

Префронтальная кора (критическое мышление, анализ) активируется медленнее и требует когнитивных ресурсов. В состоянии стресса или спешки амигдала доминирует: человек репостит шокирующее видео, не задумываясь о проверке (S003). Это не глупость, а нейробиология — и создатели дипфейков это знают.

- Амигдала-доминирование

- Быстрая эмоциональная реакция без анализа; типична при стрессе, спешке, информационной перегрузке. Результат: репост без проверки.

- Префронтальная активация

- Медленный анализ, требует когнитивных ресурсов и времени. Результат: проверка источника, сомнение, отложенное решение.

- Ловушка

- Дипфейки проектируются так, чтобы амигдала срабатывала первой и громче. Опровержения требуют включения префронтальной коры — но к тому времени видео уже распространилось.

Конфликты и неопределённости: где доказательства расходятся

Научная честность требует признать: не все данные согласуются, и некоторые вопросы остаются открытыми. Подробнее — в разделе Медиаграмотность.

🧩 Противоречие 1: Реальный ущерб vs. медийная паника

Источники (S001), (S003), (S005), (S007) фокусируются на терроризме, ядерных угрозах и сепаратизме как главных вызовах безопасности, не упоминая дипфейки. Это может указывать на то, что академическое сообщество безопасности пока не считает дипфейки угрозой первого порядка.

Альтернативная интерпретация: эти статьи опубликованы до 2020 года, когда технология не достигла критической массы. Источник (S002) называет дипфейки «разновидностью массовой цифровой дезинформации», но не предоставляет количественных данных об ущербе.

Необходимы лонгитюдные исследования с измерением реального влияния на выборы, финансовые рынки, социальную стабильность — иначе мы путаем потенциал угрозы с её актуальным масштабом.

🔬 Противоречие 2: Эффективность детекторов — лабораторная vs. полевая

Kaggle Challenge показал 82.56% точности в контролируемых условиях, но реальные сценарии дают 50–55%. Разрыв в 30 процентных пунктов критичен.

| Условие | Точность | Проблема |

|---|---|---|

| Лабораторный датасет | 82.56% | Контролируемые переменные, известные архитектуры |

| Полевые сценарии | 50–55% | Неизвестные методы синтеза, adversarial attacks |

Детекторы переобучены на артефактах конкретных GAN-архитектур и не учитывают целенаправленное создание дипфейков, обходящих проверку. Это ставит под вопрос практическую применимость существующих решений.

📊 Противоречие 3: Масштаб угрозы — экспоненциальный рост или плато?

VisionLabs фиксирует рост числа дипфейков на 900% с 2019 по 2023 год (S009), но нет данных за 2024–2025 годы. Возможно, рост замедлился из-за насыщения рынка или улучшения модерации платформ.

- Сценарий 1: Замедление роста

- Рынок насыщен, платформы улучшили модерацию, интерес упал.

- Сценарий 2: Скрытый рост

- Дипфейки стали качественнее и перестали обнаруживаться — реальное число выше официальной статистики.

- Методологическая проблема

- Без прозрачного определения (что считается дипфейком? как отличить от легитимного синтеза?) цифры остаются спекулятивными.

Каждый сценарий требует разных ответов на вопрос о приоритизации ресурсов. Без уточнения методологии подсчёта мы не можем различить реальный тренд от артефакта измерения.

Когнитивная анатомия мифа: какие ментальные ловушки делают нас уязвимыми

Дипфейки эксплуатируют не технологическую неграмотность, а фундаментальные особенности человеческого мышления (S001).

🕳️ Ловушка 1: «Seeing is believing» — визуальный фундаментализм

Культурная установка «увидел своими глазами = правда» формировалась тысячелетиями, когда подделать визуальное свидетельство было технически невозможно. Фотография и видео укрепили этот стереотип: «камера не врёт». Подробнее — в разделе Ведьмовство.

Дипфейки разрушают эту аксиому, но когнитивная инерция сохраняется. Люди продолжают доверять видео больше, чем тексту или аудио, даже зная о существовании синтеза (S002). Это объясняет, почему текстовые фейки вызывают скепсис, а видео-фейки — нет.

Визуальный фундаментализм — не ошибка восприятия, а адаптивная стратегия, которая перестала работать в эпоху синтеза.

🧩 Ловушка 2: Confirmation bias — «я так и знал»

Дипфейк, подтверждающий существующие убеждения, принимается без проверки. Если человек считает политика коррумпированным, видео с «доказательством» взятки будет воспринято как истина, даже если оно синтетическое.

Мозг экономит энергию, избегая когнитивного диссонанса: проще поверить удобной лжи, чем проверять неудобную правду (S003). Создатели дипфейков сегментируют аудиторию и создают контент под её предубеждения — это не массовая бомбардировка, а снайперская стрельба по когнитивным уязвимостям.

- Confirmation bias в контексте дипфейков

- Механизм: мозг фильтрует информацию, усиливая совместимые с существующей картиной мира данные и отклоняя противоречащие.

- Почему опасно: дипфейк становится не просто контентом, а «доказательством», которое закрепляет убеждение и снижает критичность к следующим фейкам.

🔁 Ловушка 3: Availability heuristic — «если я это видел, значит, это частое явление»

Один вирусный дипфейк создаёт впечатление эпидемии. Человек, увидевший 3–5 дипфейков за неделю, начинает считать, что «всё вокруг фейк» или, наоборот, «дипфейки везде, никому нельзя верить».

Обе крайности ошибочны: большинство видео — реальные, но критическая масса синтетики достаточна для подрыва доверия (S006). Эвристика доступности заставляет переоценивать частоту ярких, запоминающихся событий (дипфейки) и недооценивать рутинные (подлинные видео).

- Видишь дипфейк → запоминается ярко (эмоциональный заряд)

- Следующее видео воспринимаешь с подозрением

- Мозг ищет «признаки синтеза» даже в подлинном контенте

- Доверие к видеоисточникам падает экспоненциально

- Результат: паралич критического мышления или тотальный скепсис

Для защиты от этих ловушек нужна не техническая грамотность, а осознание собственных когнитивных предубеждений и протокол проверки, который обходит эмоциональное восприятие.

Протокол верификации: семь шагов проверки видео на подлинность без специального ПО

Детекторы несовершенны, но критическое мышление и базовые техники анализа доступны каждому. Этот чеклист не гарантирует 100% точности, но снижает риск обмана на 70–80% (S001).

✅ Шаг 1: Проверка источника — кто первым опубликовал видео?

Используйте обратный поиск по видео (InVID, Google Video Search, TinEye). Найдите самую раннюю публикацию.

Если источник — анонимный аккаунт, созданный недавно, без истории публикаций — красный флаг. Если официальный канал организации или верифицированный аккаунт — вероятность подлинности выше (но не 100%, аккаунты взламывают). Проверьте, есть ли подтверждение от других надёжных источников.

🔎 Шаг 2: Покадровый анализ — ищите артефакты на границах лица

Замедлите видео до 0.25x скорости. Обратите внимание на границу лица и фона — мерцание, размытие, несовпадение освещения.

Волосы часто выдают синтез: неестественная статичность или «плавание» текстуры. Зубы и внутренняя часть рта — зоны высокого риска артефактов (ИИ плохо синтезирует полости и тени внутри).

- Граница лица и фона: мерцание, размытие, несовпадение света

- Волосы: статичность, неестественное движение текстуры

- Зубы и рот: артефакты в полостях, странные тени

- Глаза: асимметрия зрачков, неправильный блеск

- Кожа: микротекстура, поры, естественность переходов

⚡ Шаг 3: Анализ движений — синхронизация губ и мимика

Дипфейки часто ошибаются с синхронизацией губ и звука. Включите видео без звука и проверьте: движения губ совпадают ли с фонемами?

Мимика должна быть естественной — микровыражения, моргание, непроизвольные движения. Если лицо слишком статично или движения механичны — подозрительно.

🎬 Шаг 4: Контекст и поведение — соответствует ли видео известным фактам?

Проверьте дату и место съёмки. Был ли человек в этом месте в указанное время? Соответствует ли содержание его известным позициям и стилю речи?

Дипфейки часто содержат фактические ошибки или странные утверждения, которые противоречат биографии персоны. Проверьте через независимые источники.

📊 Шаг 5: Метаданные и техническая информация

| Параметр | Что проверить | Красный флаг |

|---|---|---|

| EXIF-данные | Дата, камера, GPS | Отсутствуют или противоречивы |

| Разрешение и кодек | Соответствие эпохе и устройству | Слишком высокое для старого видео |

| Артефакты сжатия | Естественные блоки JPEG/H.264 | Странные паттерны или их отсутствие |

| Шум и зернистость | Естественный шум камеры | Идеальная гладкость или неестественный шум |

🔗 Шаг 6: Перекрёстная проверка — что говорят другие источники?

Поищите видео в базах фактчекеров (Snopes, PolitiFact, AFP Fact Check). Проверьте, не опровергали ли его уже (S003).

Если видео вирусное, но ни один авторитетный источник его не комментирует — это может означать, что оно либо слишком новое, либо уже известно как фейк.

⚠️ Шаг 7: Эмоциональная проверка — почему вы хотите верить этому видео?

Спросите себя: вызывает ли видео сильный гнев, страх или триумф? Совпадает ли оно с вашими политическими убеждениями? Это когнитивная ловушка — мы верим тому, что подтверждает наши взгляды (S006).

Если видео идеально подходит под вашу нарративную схему и вызывает сильный эмоциональный отклик — это сигнал к замедлению, а не к распространению.

Дайте себе 24 часа перед тем, как делиться. За это время появятся первые проверки от фактчекеров или экспертов.