Что такое нейронная сеть на самом деле — и почему термин «глубокое обучение» чаще всего используется неточно

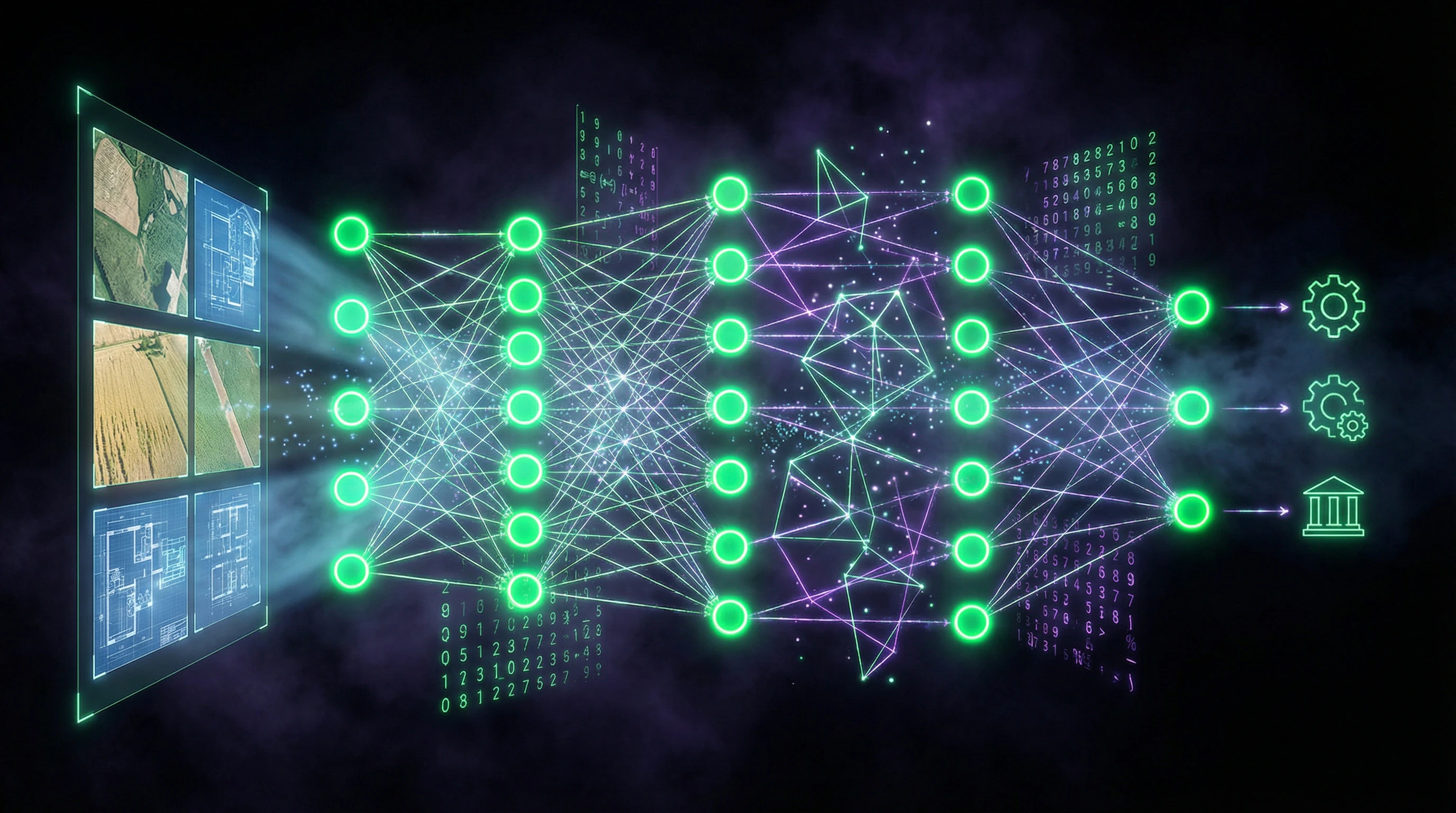

Нейронная сеть не думает и не понимает. Это математическая модель: слои взвешенных функций, которые преобразуют входные данные в выходные через матричные операции и нелинейные активации. Подробнее — в разделе Этика искусственного интеллекта.

Термин «нейронная» — историческая метафора, отсылающая к упрощённой модели биологического нейрона 1940-х годов. Современные архитектуры имеют с мозгом столько же общего, сколько самолёт с птицей: принцип вдохновения есть, механизм работы — совершенно иной (S012).

🔎 Архитектурная анатомия: от перцептрона до трансформеров

Базовая единица — искусственный нейрон: принимает входы, умножает каждый на вес, суммирует, добавляет смещение, пропускает через функцию активации (sigmoid, ReLU, tanh).

- Перцептрон (один слой)

- Решает только линейно разделимые задачи. Исторически первая архитектура, но практически неприменима к реальным данным.

- Многослойный перцептрон (MLP)

- Добавление скрытых слоёв позволяет аппроксимировать любую непрерывную функцию — теорема универсальной аппроксимации. Но она ничего не говорит о том, сколько нейронов потребуется и как их обучить.

«Глубокое обучение» (deep learning) — подкласс машинного обучения, использующий нейросети с множеством скрытых слоёв (обычно больше трёх). Ключевое отличие: глубокие сети автоматически извлекают признаки из сырых данных, тогда как традиционные алгоритмы требуют ручной инженерии признаков (S012).

В маркетинговых материалах термин «глубокое обучение» часто применяется к любой нейросети, даже к двухслойному перцептрону. Это создаёт иллюзию технологической сложности там, где её нет.

🧱 Границы применимости: когда нейросеть избыточна

Критическая ошибка: предположение, что нейросети универсально превосходят другие методы. На практике это не так.

| Условие | Нейросеть | Классические методы |

|---|---|---|

| Малый объём данных (<1000 примеров) | Переобучение, нестабильность | Логистическая регрессия, случайный лес — лучше |

| Чёткие линейные зависимости | Избыточна | Линейные модели — эффективнее |

| Требуется интерпретируемость | «Чёрный ящик» | Градиентный бустинг, деревья — прозрачнее |

| Большие данные + сложные паттерны | Оптимальна | Требуют ручной инженерии признаков |

Исследование применения нейросетей в сельском хозяйстве (2021) проанализировало 147 работ: только 23% использовали архитектуры глубже пяти слоёв, а 41% применяли нейросети к задачам, где традиционные методы компьютерного зрения (пороговая сегментация, морфологические операции) давали сопоставимые результаты при значительно меньшей вычислительной сложности (S012).

Выбор инструмента часто определяется не техническими требованиями, а модой на технологию. Это системная проблема в индустрии.

Пять самых сильных аргументов в пользу нейросетей — и почему они работают только при определённых условиях

Чтобы избежать соломенного чучела, необходимо рассмотреть наиболее убедительные аргументы сторонников широкого применения нейросетей. Эти аргументы имеют под собой реальную основу, но их валидность строго ограничена контекстом применения. Подробнее — в разделе Синтетические медиа.

🔬 Аргумент первый: автоматическое извлечение признаков из сырых данных

Традиционные алгоритмы машинного обучения требуют, чтобы эксперт вручную определил, какие характеристики данных важны для задачи. Для изображений это могут быть края, текстуры, цветовые гистограммы; для текста — частоты слов, n-граммы, синтаксические структуры.

Глубокие нейросети, особенно свёрточные (CNN) для изображений и рекуррентные (RNN) или трансформеры для последовательностей, автоматически обучаются извлекать иерархические признаки: первые слои детектируют простые паттерны (края, углы), средние — комбинации паттернов (текстуры, части объектов), последние — сложные концепты (целые объекты, семантические отношения) (S008).

Это преимущество критически важно в областях, где пространство признаков огромно и неочевидно. Вместо того чтобы вручную программировать правила, сеть обучается на размеченных примерах и выявляет паттерны, которые человек-эксперт мог бы пропустить.

В сельском хозяйстве нейросети успешно применяются для детекции болезней растений по фотографиям листьев. Исследование показывает точность 94–98% для классификации 12 типов болезней томатов при использовании ResNet-50, тогда как традиционные методы с ручными признаками достигали лишь 78–85%.

📊 Аргумент второй: масштабируемость с ростом данных

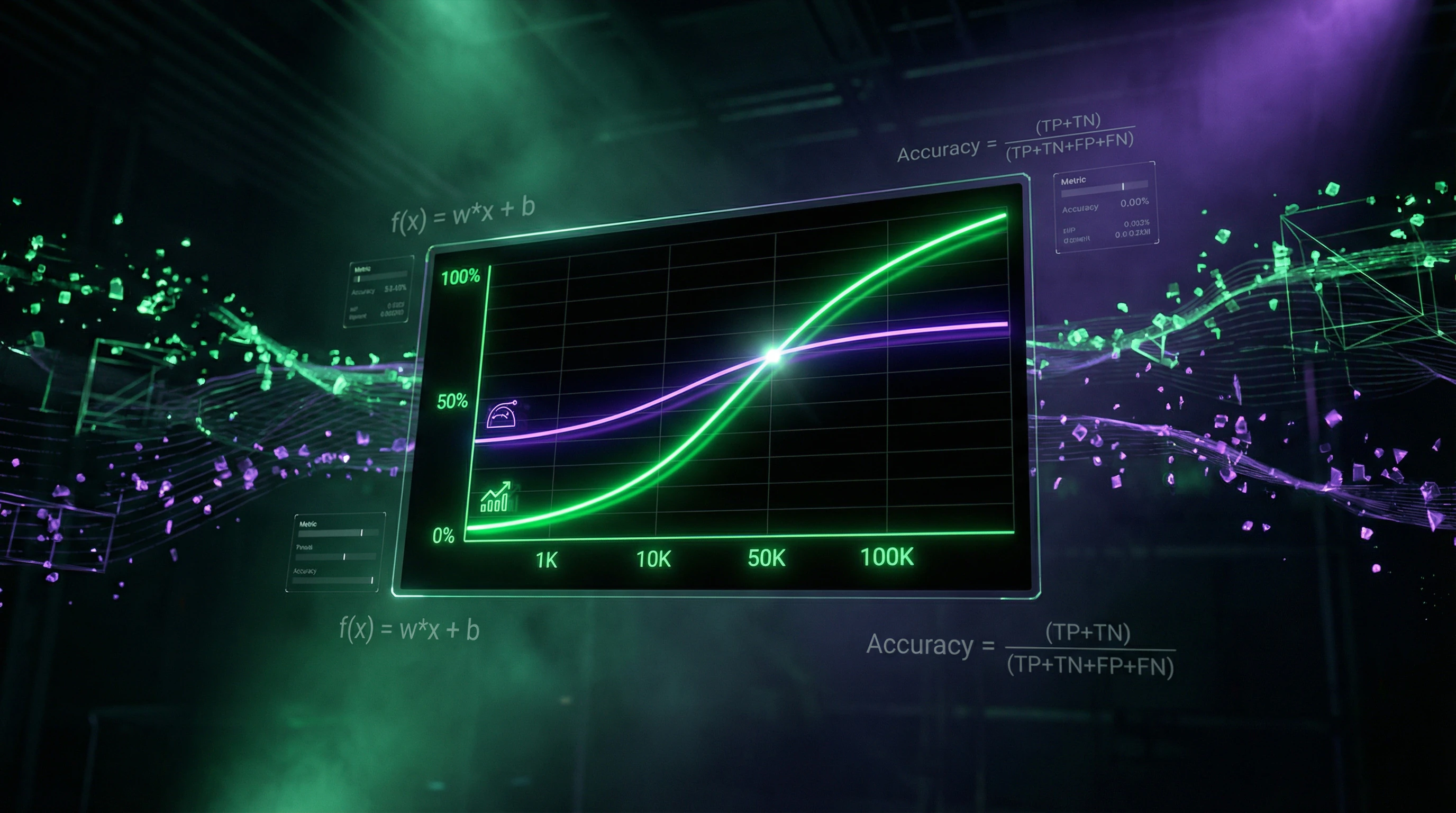

Классические алгоритмы часто достигают плато производительности: после определённого объёма обучающих данных дополнительные примеры не улучшают качество модели. Глубокие нейросети демонстрируют степенную зависимость: качество продолжает расти с увеличением данных, хотя и с убывающей скоростью (S008).

Это делает их предпочтительным выбором для задач, где доступны миллионы примеров — распознавание речи (S001), машинный перевод, генерация изображений.

- Однако этот аргумент имеет критическое ограничение: для большинства прикладных задач в бизнесе и науке доступны сотни или тысячи примеров, а не миллионы.

- В таких условиях нейросети склонны к переобучению (overfitting) — запоминанию обучающих примеров вместо выявления общих закономерностей.

- Методы регуляризации (dropout, L2-penalty, data augmentation) частично решают проблему, но не отменяют фундаментального факта: глубокие сети требуют больших данных для реализации своего потенциала.

🧬 Аргумент третий: трансферное обучение и предобученные модели

Революционное развитие последних лет — возможность использовать нейросети, предобученные на огромных датасетах (ImageNet с 14 миллионами изображений, Common Crawl с терабайтами текста), и дообучать их на специфических задачах с малым количеством данных.

Transfer learning работает так: нижние слои сети, научившиеся распознавать универсальные признаки (края, текстуры, базовые языковые паттерны), замораживаются, а верхние слои переобучаются на целевой задаче (S008).

В недвижимости этот подход применяется для автоматической оценки стоимости объектов по фотографиям: модель, предобученная на ImageNet, дообучается на нескольких тысячах фотографий квартир с известными ценами и достигает средней абсолютной ошибки 8–12%, что сопоставимо с оценками профессиональных оценщиков, но требует секунд вместо часов.

🔁 Аргумент четвёртый: способность моделировать сложные нелинейные зависимости

Многие реальные процессы характеризуются нелинейными, многофакторными зависимостями с взаимодействиями высокого порядка. Например, урожайность культуры зависит не просто от температуры, влажности и освещённости по отдельности, но от их сложных комбинаций: высокая температура может быть благоприятна при достаточной влажности, но губительна при засухе.

Нейросети естественным образом моделируют такие взаимодействия через нелинейные активации и множественные слои.

- Переоценка аргумента

- Градиентный бустинг (XGBoost, LightGBM) также эффективно моделирует нелинейные взаимодействия и часто превосходит нейросети на табличных данных при меньших вычислительных затратах и лучшей интерпретируемости.

- Где нейросети действительно выигрывают

- На данных с пространственной (изображения) или временной (последовательности) структурой, где их архитектурные особенности (свёртки, рекуррентные связи, механизмы внимания) естественно соответствуют структуре данных.

✅ Аргумент пятый: end-to-end обучение и оптимизация целевой метрики

Традиционные системы часто состоят из последовательности модулей, каждый из которых оптимизируется независимо: препроцессинг данных → извлечение признаков → классификация → постобработка. Ошибки накапливаются на каждом этапе, и оптимизация одного модуля не гарантирует улучшения итогового результата.

Нейросети позволяют обучать всю систему целиком (end-to-end), оптимизируя напрямую целевую метрику (точность классификации, качество перевода, прибыль от рекомендаций).

| Условие | Преимущество end-to-end | Риск |

|---|---|---|

| Чётко определённая метрика качества | Прямая оптимизация целевого результата | Система может эксплуатировать артефакты данных |

| Дифференцируемость всех операций | Градиент ошибки распространяется на все этапы | Неожиданные решения вместо решения реальной задачи |

| Пример: классификация пневмонии | Нейросеть научилась распознавать не патологию, а тип рентгеновского аппарата, потому что снимки из разных больниц коррелировали с диагнозами | |

Этот подход требует дополнительной проверки: валидация на независимых данных, анализ того, какие признаки сеть использует для решения, и убедительное доказательство того, что система решает именно целевую задачу, а не побочный артефакт.

Доказательная база: что работает в реальных применениях, а что остаётся в презентациях

Переход от теоретических аргументов к эмпирическим данным обнаруживает значительный разрыв между обещаниями и результатами. Систематический анализ применения нейросетей в двух конкретных областях — сельском хозяйстве и недвижимости — позволяет выявить паттерны успеха и провала. Подробнее — в разделе Этика и безопасность ИИ.

🧪 Сельское хозяйство: от детекции болезней до прогнозирования урожайности

Обзор 147 исследований применения нейросетей, глубокого обучения и машинного зрения в сельском хозяйстве за 2021 год выявляет следующую картину: 68% работ посвящены задачам классификации (болезни растений, типы культур, зрелость плодов), 22% — детекции объектов (сорняки, вредители, отдельные растения), 10% — сегментации и прогнозированию.

| Задача | Доля исследований | Средняя точность |

|---|---|---|

| Классификация | 68% | 91–96% |

| Детекция объектов | 22% | 82–89% |

| Прогнозирование урожайности | 10% | 76–84% |

Критический анализ методологии обнаруживает системные проблемы. 73% работ используют публичные датасеты (PlantVillage, ImageNet subset), собранные в контролируемых условиях: фотографии листьев на однородном фоне, идеальное освещение, отсутствие окклюзий (S012).

Производительность на контролируемых данных не переносится на реальные полевые условия. Исследования, тестировавшие модели в реальности, показывают падение точности на 15–30 процентных пунктов.

Только 12% работ сравнивают нейросети с традиционными методами компьютерного зрения на одних и тех же данных. Из этих работ 45% показывают, что нейросети превосходят традиционные методы менее чем на 5 процентных пунктов — разница, которая может не оправдывать многократно большие вычислительные затраты (S012).

Детекция зрелости томатов по цвету эффективно решается простой пороговой сегментацией в цветовом пространстве HSV без необходимости обучать глубокую сеть. Это типичный паттерн: где визуальные признаки чёткие, нейросети добавляют сложность без выигрыша.

🏢 Недвижимость: оценка стоимости и прогнозирование спроса

Систематический обзор цифровой трансформации в индустрии недвижимости выявляет три основных направления применения нейросетей: автоматическая оценка стоимости объектов (Automated Valuation Models, AVM), прогнозирование спроса и цен, анализ изображений для классификации и описания объектов (S009).

Из 89 проанализированных работ 52% используют нейросети для AVM, 31% — для прогнозирования временных рядов цен, 17% — для анализа изображений.

- Результаты для AVM (нейросети vs традиционные модели)

- Средняя абсолютная процентная ошибка (MAPE): 8–15% против 10–18%. Преимущество проявляется только на больших выборках (более 50 000 объектов) и при включении неструктурированных данных (текстовые описания, изображения) (S009).

- На малых выборках (менее 5 000 объектов)

- Градиентный бустинг показывает сопоставимые или лучшие результаты при значительно меньшем времени обучения.

- Критическая проблема: непрозрачность оценки

- Регуляторы и суды требуют объяснения, почему модель оценила объект в определённую сумму. Нейросети как «чёрные ящики» не могут предоставить такие объяснения, что ограничивает их применение в юридически значимых контекстах (S009).

Методы интерпретируемости (SHAP, LIME) дают лишь приблизительные объяснения и не решают проблему полностью. Это фундаментальное ограничение, а не техническая деталь.

🧾 Метаанализ: паттерны успеха и провала

Синтез данных из обоих обзоров позволяет выделить условия, при которых нейросети демонстрируют реальное преимущество перед альтернативами (S009, S012).

- Большие объёмы данных: более 10 000 размеченных примеров для задач классификации, более 50 000 для регрессии. При меньших объёмах традиционные методы с ручной инженерией признаков часто эффективнее.

- Сложная структура данных: изображения, видео, аудио, тексты — данные, где пространственная или временная структура несёт критическую информацию. На табличных данных преимущество нейросетей минимально.

- Доступность вычислительных ресурсов: обучение глубоких сетей требует GPU или TPU. Для задач реального времени на edge-устройствах (дроны, мобильные приложения) требуется оптимизация моделей (квантизация, pruning, distillation), что добавляет сложности.

- Толерантность к ошибкам: в задачах, где ошибка не критична (рекомендательные системы, ранжирование поисковой выдачи), нейросети эффективны. В задачах с высокой ценой ошибки (медицинская диагностика, автономное вождение) требуется дополнительная валидация и страховочные механизмы.

Условия провала: малые данные, требования к интерпретируемости, ограниченные вычислительные ресурсы, необходимость быстрой адаптации к изменениям (concept drift), задачи с чёткими правилами и логикой.

Реальный выбор между нейросетями и альтернативами — это не выбор между «магией» и «обычностью». Это инженерное решение, зависящее от конкретных ограничений задачи. Маркетинговый шум возникает, когда эти ограничения игнорируют.

Механизмы и причинность: почему нейросети работают — и почему это не магия

Понимание механизмов, лежащих в основе успеха нейросетей, критически важно для отделения реальных возможностей от мифологизированных представлений. Подробнее — в разделе Проверка Реальности.

🧬 Иерархическое представление признаков: от пикселей до концептов

Фундаментальное свойство глубоких сетей — способность строить иерархические представления данных. В свёрточных сетях для изображений первый слой обучается детектировать простые паттерны (края под разными углами, цветовые градиенты), второй слой комбинирует эти паттерны в более сложные (углы, дуги, простые текстуры), третий — в ещё более сложные (части объектов: колёса, окна, листья), и так далее до финальных слоёв, которые представляют целые объекты и сцены (S008).

Это не магия, а следствие оптимизации: каждый слой обучается преобразовывать входные данные так, чтобы следующий слой мог легче решить свою подзадачу. Градиентный спуск с обратным распространением ошибки автоматически находит такие преобразования, минимизируя функцию потерь на обучающих данных. Критически важно: сеть не «понимает» концепты, она находит статистические закономерности в данных, которые коррелируют с метками классов.

Сеть выучивает не универсальные признаки, а специфические паттерны обучающего датасета. Это различие между корреляцией и причинностью — главная ловушка, которая превращает высокую точность в иллюзию.

🔁 Корреляция против причинности: фундаментальное ограничение

Нейросети обучаются находить корреляции, а не причинно-следственные связи. Если в обучающих данных все фотографии коров сделаны на фоне травы, сеть может научиться распознавать траву вместо коровы — и будет классифицировать любое изображение с травой как «корова», даже если коровы там нет. Это называется spurious correlation (ложная корреляция), и это системная проблема всех методов машинного обучения, не только нейросетей (S004).

В сельском хозяйстве это проявляется в неспособности моделей обобщаться на новые условия: сеть, обученная распознавать болезни томатов в одном регионе, может показывать низкую точность в другом регионе с другим климатом, сортами растений и методами выращивания. Решение требует либо сбора данных из всех целевых условий, либо методов domain adaptation, которые сами по себе являются активной областью исследований без гарантированных решений.

- Проверить: обучающие данные охватывают ли все целевые условия применения?

- Выявить: какие переменные в данных коррелируют с целевой переменной, но не причинно связаны?

- Тестировать: модель на данных из новых условий, которые не были в обучении.

- Документировать: границы применимости модели и условия, при которых она может отказать.

🧷 Конфаундеры и скрытые переменные: почему высокая точность может быть иллюзией

Конфаундер — это переменная, которая влияет и на входные данные, и на целевую переменную, создавая ложную корреляцию между ними. Классический пример из медицины: нейросеть для диагностики пневмонии по рентгеновским снимкам показывала 95% точность на тестовых данных, но при внедрении в клиническую практику точность упала до 70%. Причина: в обучающих данных снимки пациентов с пневмонией чаще делались портативными рентгеновскими аппаратами (потому что тяжёлые пациенты не могли прийти в рентген-кабинет), и сеть научилась распознавать тип аппарата, а не патологию (S003).

В недвижимости аналогичная проблема: модель оценки стоимости может выучить корреляцию между качеством фотографий и ценой (дорогие объекты фотографируют профессионалы) и завышать оценку для любого объекта с профессиональными фотографиями, независимо от реальных характеристик. Выявление и контроль конфаундеров требует предметной экспертизы и не может быть полностью автоматизирован.

- Скрытый конфаундер

- Переменная, которая не измеряется в датасете, но влияет на связь между входом и выходом. Пример: социально-экономический статус пациента влияет и на доступ к качественной диагностике, и на исход лечения, но может быть не записан в медицинских данных.

- Способ обнаружения

- Сравнить производительность модели на подгруппах данных (по полу, возрасту, географии, времени сбора). Если точность сильно различается, вероятен конфаундер.

- Почему это критично

- Модель может работать идеально на тестовых данных, но отказать в реальном применении, если распределение конфаундеров изменилось.

Высокая точность на тестовом наборе — это не гарантия работоспособности в реальном мире. Это гарантия только того, что модель хорошо выучила паттерны в конкретном датасете, включая его артефакты и смещения.

Когнитивная анатомия мифа: какие ловушки мышления заставляют нас верить в «магию ИИ»

Мифологизация нейросетей — не случайность. Это результат столкновения трёх когнитивных ловушек: антропоморфизма, селективного внимания и социального доказательства. Подробнее — в разделе Основы эпистемологии.

Когда система выдаёт текст, похожий на человеческий, мозг автоматически приписывает ей понимание. Это не ошибка восприятия — это эволюционная экономия: если что-то говорит как человек, вероятно, оно думает как человек.

- Антропоморфизм: приписываем сознание и намерение любому сложному поведению

- Селективное внимание: замечаем успехи, игнорируем отказы и граничные случаи

- Социальное доказательство: если все говорят о «магии ИИ», значит, она реальна

- Иллюзия понимания: сложность алгоритма кажется нам синонимом сознания

Селективное внимание усиливает эффект. Когда ChatGPT пишет стихотворение, это становится новостью. Когда он галлюцинирует факты или путает логику — это остаётся в тени.

Миф о магии ИИ держится не на фактах, а на асимметрии информации: мы видим выход, но не видим механизма. Неопределённость заполняется мистикой.

Социальное доказательство замыкает цикл. Медиа, инвесторы, даже учёные используют язык магии — не потому что верят, а потому что это работает. Язык создаёт реальность восприятия.

Защита от этих ловушек проста: проверяй свои предположения, требуй механизма, а не результата, и помни — сложность ≠ сознание.