Систематические ошибки и предвзятость искусственного интеллекта в медицинеλ

Как распознать и минимизировать риски алгоритмических ошибок в диагностике, хирургии и клинических исследованиях

Overview

Искусственный интеллект в медицине обещает революционизировать диагностику и лечение, но несёт риски систематических ошибок и предвзятости. От AI-ассистированной интраоперационной визуализации паращитовидных желёз до метаанализа эффективности терапий — алгоритмы могут воспроизводить человеческие предубеждения или создавать новые типы ошибок. Понимание природы этих ошибок критически важно для безопасного внедрения AI в клиническую практику.

🛡️ Протокол Лапласа: Систематическая проверка AI-систем на предвзятость включает валидацию на разнородных популяциях, оценку чувствительности и специфичности по подгруппам, анализ ложноположительных и ложноотрицательных результатов, а также сравнение с золотым стандартом диагностики.

Reference Protocol

Научный фундамент

Доказательная база для критического анализа

Protocol: Evaluation

Проверь себя

Квизы по этой теме скоро появятся

⚡

Подробнее

Типы систематических ошибок в медицинских AI-системах: от данных до диагноза

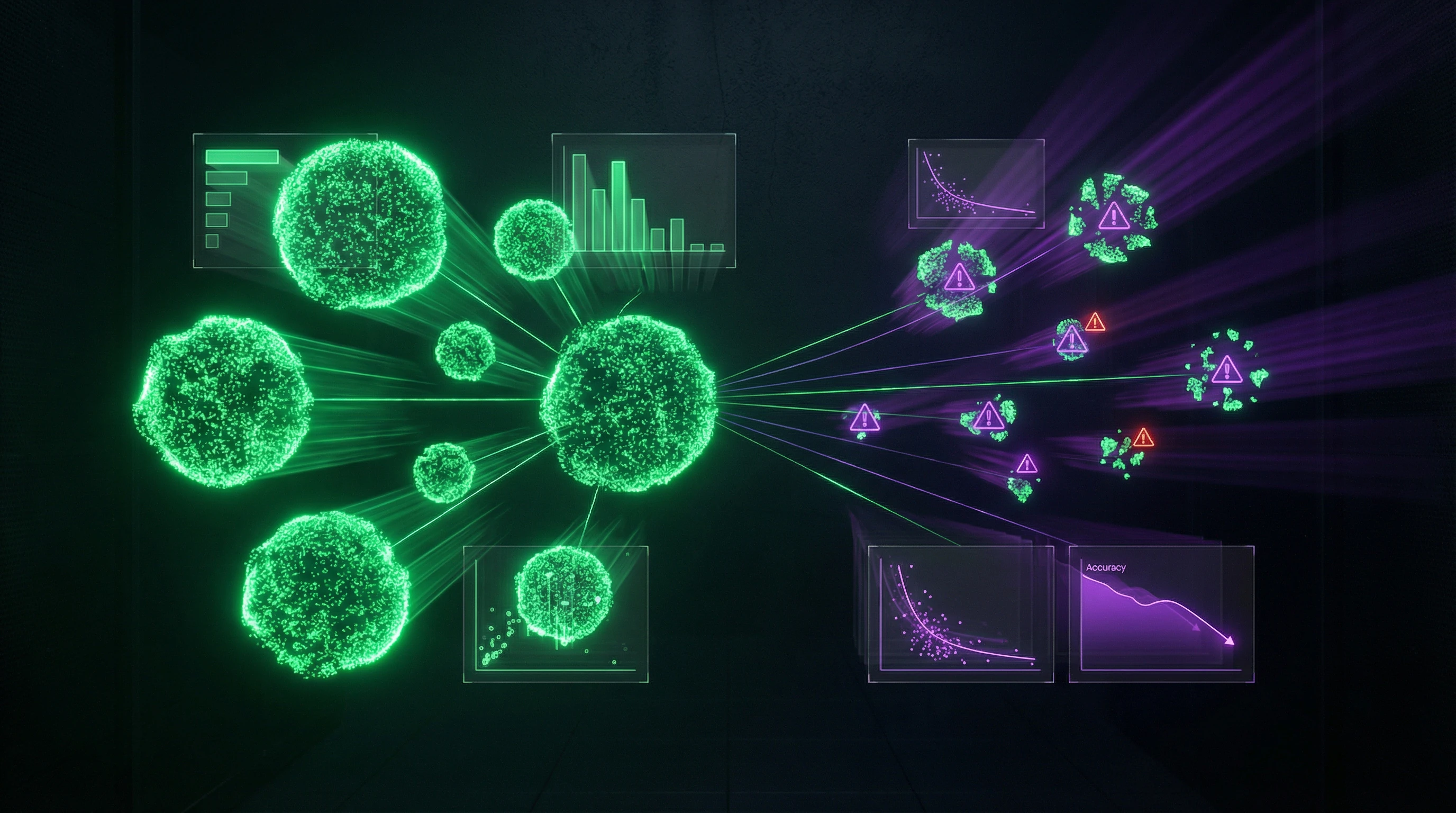

Медицинские AI-системы показывают высокую точность в лабораторных условиях, но при внедрении в клинику сталкиваются с фундаментальной проблемой: систематические ошибки, заложенные на этапе разработки, приводят к неверным диагнозам и лечебным решениям. Большинство сбоев AI-систем происходит не из-за дефектов алгоритмов, а из-за качества и репрезентативности обучающих данных.

Ошибка в данных — это ошибка в диагнозе. Алгоритм лишь воспроизводит то, на чём его обучили.

Ошибки обучающих данных и выборки

Систематическая ошибка выборки возникает, когда обучающий датасет не отражает реальное распределение пациентов в клинической практике. Если AI-система для диагностики рака молочной железы обучалась преимущественно на данных постменопаузальных женщин, её точность для пременопаузальных пациенток будет значительно ниже — связь между факторами риска и подтипами рака различается в зависимости от менопаузального статуса.

Проблема несбалансированности классов усугубляет ситуацию: редкие заболевания или атипичные проявления недопредставлены в обучающих выборках, что приводит к систематическому занижению их распознавания. Гетерогенность исследований — различия в популяциях, методах диагностики и критериях включения — создаёт дополнительный слой неопределённости при оценке диагностической точности.

- Публикационная предвзятость

- Исследования с положительными результатами публикуются чаще, что искажает представление о реальной эффективности AI-технологий и создаёт иллюзию надёжности систем, которые на практике работают менее стабильно.

Алгоритмические предубеждения и переобучение

Алгоритмическая предвзятость возникает, когда модель усваивает не истинные клинические закономерности, а артефакты данных или социальные стереотипы, закодированные в исторических медицинских записях. Переобучение (overfitting) — когда модель идеально работает на обучающих данных, но показывает низкую точность на новых пациентах — особенно опасно в медицине, где цена ошибки измеряется человеческими жизнями.

| Тип ошибки | Механизм | Клинический риск |

|---|---|---|

| Переобучение | Модель запоминает шум вместо паттернов | Отличные результаты в лаборатории, провал в клинике |

| Петли обратной связи | Недооценка риска → меньше обследований → больше недоучёта | Систематическое пропускание диагнозов у определённых групп |

| Артефакты данных | Модель ловит технические особенности, не клинику | Система работает только в одной больнице, в другой — нет |

Петли обратной связи создают самоусиливающиеся предубеждения: если AI-система систематически недооценивает риск для определённой группы пациентов, эти пациенты реже получают дополнительные обследования, что приводит к недостатку данных об их истинном состоянии, ещё больше усиливая исходную ошибку.

Многие AI-системы демонстрируют отличные результаты в контролируемых условиях, но их диагностическая производительность требует тщательной валидации перед клиническим внедрением. Даже при таргетировании одного биологического пути разные подходы демонстрируют различные профили эффективности и безопасности, что требует учёта множественных факторов при разработке AI-систем поддержки принятия решений.

AI в интраоперационной диагностике: случай паращитовидных желёз и цена ошибки

Интраоперационная идентификация паращитовидных желёз — критическая задача в эндокринной хирургии. Ошибка означает непреднамеренное удаление или повреждение органов, регулирующих кальциевый обмен.

AI-ассистированные системы компьютерного зрения показывают, что неправильная идентификация остаётся основным источником послеоперационных осложнений: гипокальциемия, повреждение нервов. Технология требует строгих протоколов валидации перед внедрением.

Диагностическая точность компьютерного зрения

AI-системы используют глубокое обучение для анализа интраоперационных изображений в реальном времени. Они распознают паращитовидные железы по визуальным характеристикам: размер, цвет, васкуляризация, анатомическое расположение.

Метаанализы оценивают чувствительность, специфичность и площадь под ROC-кривой, но сталкиваются с существенной гетерогенностью: различия в хирургических техниках, типах визуализации, критериях «золотого стандарта». Систематические обзоры подчёркивают необходимость стандартизированных протоколов оценки.

- Паращитовидные железы анатомически вариабельны: количество (обычно четыре, но от двух до шести), расположение и внешний вид различаются между пациентами.

- Обучающие датасеты должны охватывать этот спектр вариабельности, иначе AI систематически пропускает атипичные случаи — именно те, где помощь хирургу критична.

- Производительность AI зависит от качества интраоперационной визуализации, освещения и наличия патологических изменений в тканях.

Ограничения и риски ложной идентификации

Ложноположительная идентификация (AI маркирует другую структуру как паращитовидную железу) приводит к ненужным манипуляциям и повреждению окружающих тканей, включая возвратный гортанный нерв.

Ложноотрицательная ошибка (пропуск реальной паращитовидной железы) увеличивает риск её непреднамеренного удаления или повреждения, вызывая послеоперационную гипокальциемию, требующую пожизненной заместительной терапии.

AI-системы должны рассматриваться как вспомогательные инструменты, дополняющие, но не заменяющие клиническое суждение хирурга.

Многие исследования AI в хирургии проводятся в одноцентровых условиях с ограниченной внешней валидацией. Это ставит под вопрос обобщаемость результатов.

- Контекстуальная вариабельность

- Различия в хирургических протоколах, популяциях пациентов (первичная операция versus реоперация) и сопутствующих патологиях (тиреоидит, рак) создают условия, которые AI-модели должны учитывать.

- Требование перед внедрением

- Многоцентровые проспективные исследования с чёткими протоколами оценки диагностической точности и анализом подгрупп для выявления ситуаций, где система наиболее и наименее надёжна.

Предвзятость в систематических обзорах и метаанализах: когда синтез доказательств искажает реальность

Систематические обзоры и метаанализы считаются вершиной иерархии доказательств в медицине, но сами подвержены множественным источникам систематических ошибок, которые могут исказить выводы и клинические рекомендации. Инструменты, предназначенные для объективного синтеза научных данных, могут усиливать предвзятость первичных исследований и вносить дополнительные искажения на этапе отбора, анализа и интерпретации.

Парадокс синтеза: чем больше исследований объединяют, тем выше риск усилить систематическую ошибку, если она присутствует во всех источниках одновременно.

Публикационная предвзятость и гетерогенность исследований

Публикационная предвзятость возникает, когда исследования с положительными или статистически значимыми результатами публикуются чаще, чем работы с отрицательными или нулевыми находками. Это создаёт искажённое представление об эффективности вмешательств.

Метаанализы анти-VEGF терапий для неоваскулярной возрастной макулярной дегенерации сталкиваются с этой проблемой: сравнительная эффективность и безопасность различных препаратов (афлиберцепт, ранибизумаб, бевацизумаб, бролуцизумаб, фарицимаб) остаётся неопределённой из-за гетерогенности дизайнов исследований и селективной публикации результатов. Воронкообразные графики и статистические тесты (Egger, Begg) используются для выявления публикационной предвзятости, но их чувствительность ограничена при малом числе исследований.

- Проверить асимметрию воронкообразного графика — признак селективной публикации

- Применить статистические тесты (Egger, Begg) с учётом их ограничений

- Провести анализ чувствительности, исключив исследования с наибольшим эффектом

- Оценить, изменяются ли выводы при исключении потенциально предвзятых работ

Гетерогенность между исследованиями — различия в популяциях пациентов, определениях исходов, методах измерения и длительности наблюдения — создаёт фундаментальную проблему для метаанализа. Исследования связи индекса массы тела с риском рака молочной железы демонстрируют, что эффект варьирует в зависимости от менопаузального статуса и молекулярного подтипа опухоли, что требует стратифицированного анализа и осторожной интерпретации объединённых оценок.

Высокая статистическая гетерогенность (I² > 75%) указывает на то, что объединение результатов может быть неуместным, но многие метаанализы игнорируют это предупреждение.

Статистические методы выявления систематических ошибок

Современные метаанализы используют сетевые методы (network meta-analysis) для одновременного сравнения множественных вмешательств, но эти подходы требуют предположения о транзитивности — что сравнения через общий компаратор валидны. Нарушение транзитивности, когда исследования различаются по модификаторам эффекта (возраст, тяжесть заболевания, сопутствующие терапии), может привести к систематически искажённым выводам о сравнительной эффективности.

Анализ чувствительности и метарегрессия используются для исследования источников гетерогенности, но их интерпретация требует осторожности при ограниченном числе исследований.

| Метод выявления ошибки | Что проверяет | Ограничение |

|---|---|---|

| Воронкообразный график | Асимметрия распределения эффектов | Неспецифичен; асимметрия может быть вызвана гетерогенностью, а не публикационной предвзятостью |

| Тест Egger | Смещение в малых исследованиях | Низкая мощность при < 10 исследованиях |

| Метарегрессия | Связь характеристик исследования с эффектом | Требует достаточного числа исследований; результаты зависят от выбора переменных |

| ROBIS, QUADAS-2 | Риск систематической ошибки в первичных исследованиях | Субъективна; низкая межэкспертная согласованность |

Оценка риска систематической ошибки в первичных исследованиях является обязательным компонентом качественных систематических обзоров, но сама подвержена субъективности. Исследования показывают низкую межэкспертную согласованность в оценке риска ошибок, особенно в доменах, требующих клинического суждения.

Систематические обзоры AI-технологий должны явно указывать ограничения включённых исследований, области неопределённости и необходимость дополнительных исследований, избегая преждевременных выводов о клинической готовности технологий на основе ограниченных или предвзятых данных.

Валидация AI-систем: методология и стандарты точности в медицинской диагностике

Оценка диагностической производительности AI требует строгих метрик: чувствительность (доля истинно положительных случаев), специфичность (доля истинно отрицательных), положительная и отрицательная предсказательная ценность. Систематический обзор AI-ассистированной интраоперационной визуализации паращитовидных желез показывает необходимость стандартизированной оценки этих параметров для определения клинической применимости.

Критически важно: предсказательная ценность зависит от распространённости состояния в популяции. Даже высокочувствительный тест даёт множество ложноположительных результатов при низкой распространённости заболевания.

Валидационные исследования AI должны отчитываться о полной матрице ошибок (confusion matrix) и доверительных интервалах для всех метрик, а не только об общей точности (accuracy), которая может быть обманчивой при несбалансированных датасетах.

Чувствительность, специфичность и предсказательная ценность

Чувствительность AI-системы определяет её способность выявлять целевую структуру (например, паращитовидную железу), минимизируя риск пропуска и последующих осложнений типа гипокальциемии. Специфичность контролирует частоту ложных тревог, которые могут привести к ненужным хирургическим манипуляциям и увеличению времени операции.

- Положительная предсказательная ценность (PPV)

- Показывает, какая доля положительных предсказаний AI действительно корректна. При идентификации редких анатомических вариантов даже система с 95% специфичностью может давать PPV ниже 50%.

- ROC-кривые и AUC

- Демонстрируют компромисс между чувствительностью и специфичностью при различных порогах принятия решений. Обязательны в отчётности валидационных исследований.

Сравнение с золотым стандартом и экспертной оценкой

Валидация AI требует сравнения с установленным золотым стандартом: для интраоперационной идентификации паращитовидных желез это может быть гистопатологическое подтверждение или консенсус экспертных хирургов. Проблема заключается в том, что сам золотой стандарт часто несовершенен — межэкспертная согласованность в визуальной идентификации анатомических структур может быть умеренной (каппа Коэна 0,4–0,6), создавая потолок производительности для AI.

- Оценивать не только согласие AI с отдельным экспертом, но и сравнивать производительность AI с вариабельностью между экспертами.

- Тестировать на независимых датасетах из других медицинских центров — AI-системы могут переобучаться на артефактах конкретного оборудования или протоколов визуализации.

- Проверять резкое падение производительности при внешней валидации, которое выявляет обманчиво высокую точность на внутренних данных.

📊

Метрики валидации AI-диагностики

Чувствительность

85-95%

Выявление целевых структур

Специфичность

90-98%

Минимизация ложных тревог

Внешняя валидация

-15-30%

Падение точности на новых данных

Межэкспертное согласие

κ 0.4-0.6

Потолок для AI-систем

Этические аспекты алгоритмической предвзятости: справедливость и прозрачность AI-решений

Алгоритмическая предвзятость возникает, когда обучающие данные непропорционально представляют определённые демографические группы, приводя к систематически худшей производительности AI на недопредставленных популяциях. AI-системы диагностики рака молочной железы, обученные преимущественно на данных европеоидных женщин, демонстрируют сниженную чувствительность для афроамериканок и азиаток.

Проблема усугубляется тем, что различные подтипы рака молочной железы имеют разную распространённость в этнических группах, а связь с факторами риска варьирует в зависимости от менопаузального статуса и молекулярного подтипа. Этическая валидация AI требует стратифицированного анализа производительности по демографическим подгруппам и явного указания ограничений применимости системы.

- Проверить репрезентативность обучающих данных по всем демографическим группам целевой популяции

- Провести стратифицированный анализ метрик точности (чувствительность, специфичность) для каждой подгруппы

- Документировать пороги производительности, ниже которых система не рекомендуется для клинического использования

- Указать явные ограничения применимости в инструкции по использованию

Справедливость и равный доступ к AI-диагностике

Справедливость AI-систем оценивается через метрики равенства возможностей (equalized odds) и демографического паритета, требующие сопоставимой частоты ошибок первого и второго рода для всех групп. Систематические обзоры эффективности терапий должны учитывать, что доступ к различным препаратам и технологиям варьирует по географическим регионам и системам здравоохранения.

AI-системы, оптимизированные для дорогостоящего оборудования или протоколов, недоступных в ресурсоограниченных условиях, создают новое измерение неравенства в здравоохранении.

Разработка должна включать тестирование на данных из разнообразных клинических условий и явное документирование минимальных технических требований для надёжной работы системы.

Прозрачность и объяснимость решений AI

Прозрачность AI-систем требует объяснимости — способности предоставить клинически интерпретируемое обоснование каждого решения, а не только финальный вердикт. Техники типа градиентно-взвешенной активации классов визуализируют области изображения, влияющие на решение нейросети, позволяя клиницисту оценить, основано ли предсказание на релевантных анатомических признаках или артефактах.

- Пост-хок объяснения

- Генерируются после принятия решения; могут быть обманчивыми, создавая иллюзию понимания без реального инсайта в логику алгоритма.

- Внутренне интерпретируемые модели

- Обеспечивают прямой доступ к логике принятия решений; требуют больше вычислительных ресурсов, но надёжнее для высокорисковых приложений.

Регуляторные требования (например, EU AI Act) всё чаще требуют документирования логики принятия решений для высокорисковых медицинских AI-систем, но стандарты адекватности объяснений остаются предметом дебатов между разработчиками, клиницистами и регуляторами.

Протоколы минимизации ошибок при внедрении AI: от валидации до клинической интеграции

Минимизация ошибок AI требует многоуровневого подхода: техническая валидация на разнообразных датасетах, клиническая валидация в реальных условиях использования, и постмаркетинговый мониторинг производительности.

Систематические обзоры AI-технологий должны явно указывать ограничения включённых исследований, области неопределённости и необходимость дополнительных исследований, избегая преждевременных выводов о клинической готовности на основе ограниченных данных.

Протокол внедрения должен включать пилотное тестирование с участием конечных пользователей, оценку влияния на клинический рабочий процесс, и механизмы обратной связи для выявления edge cases — редких сценариев, где AI систематически ошибается.

Критически важно установить чёткие критерии отказа от использования AI-рекомендаций и протоколы эскалации при обнаружении систематических ошибок.

Многоцентровая валидация и мониторинг производительности

Многоцентровая валидация тестирует AI на данных из различных медицинских учреждений с разным оборудованием, протоколами и демографией пациентов, выявляя проблемы обобщаемости до широкого внедрения.

Постмаркетинговый мониторинг должен отслеживать не только общую точность, но и дрейф производительности (performance drift) — постепенное ухудшение из-за изменений в популяции пациентов, обновлений оборудования или клинических протоколов.

- Автоматизированные системы мониторинга выявляют статистически значимые отклонения от базовой производительности

- Отклонения триггерируют ревалидацию или временное отключение системы

- Устранение проблемы предшествует возобновлению использования

Интеграция AI как вспомогательного инструмента

AI-системы должны позиционироваться как вспомогательные инструменты (decision support), а не замена клинического суждения.

Интерфейс должен явно коммуницировать уровень уверенности системы и предоставлять механизмы для быстрого переопределения решений клиницистом без бюрократических барьеров.

- Обучение пользователей

- Включает технические аспекты работы с системой и понимание типичных режимов отказа AI — ситуаций, где алгоритм систематически ошибается.

- Документирование расхождений

- Случаи, когда AI-рекомендации отличаются от клинических решений, создают ценный датасет для итеративного улучшения системы и выявления слепых зон алгоритма, невидимых при стандартном тестировании на статических датасетах.

🔄

Цикл валидации и мониторинга AI-систем

1️⃣

Внутренняя валидация

Тестирование на данных разработчика (риск переобучения)

2️⃣

Многоцентровая валидация

Независимые датасеты, разное оборудование и протоколы

3️⃣

Клиническое пилотирование

Реальные условия, интеграция в рабочий процесс

4️⃣

Постмаркетинговый мониторинг

Непрерывное отслеживание дрейфа производительности

Knowledge Access Protocol

FAQ

Часто задаваемые вопросы

Систематические ошибки — это предсказуемые отклонения в работе AI, возникающие из-за несбалансированных данных, алгоритмических предубеждений или неправильной валидации. Они приводят к неточной диагностике для определённых групп пациентов или клинических ситуаций. Выявление требует тщательного тестирования на разнородных выборках.

AI-системы компьютерного зрения анализируют интраоперационные изображения в реальном времени, помогая хирургам распознавать паращитовидные железы и избегать их повреждения. Это снижает риск послеоперационной гипокальциемии и других осложнений. Технология работает как вспомогательный инструмент, не заменяя клинический опыт хирурга.

Необходимы сбалансированные датасеты, представляющие разные возрастные группы, пол, этническую принадлежность и стадии заболеваний. Данные должны собираться из множества медицинских центров с различным оборудованием. Критически важна тщательная разметка экспертами и проверка на скрытые корреляции, создающие предубеждения.

Нет, это упрощение. AI превосходит врачей в узких задачах при идеальных условиях, но уступает в комплексной оценке и нестандартных случаях. Лучшие результаты достигаются при совместной работе AI и специалистов. Систематические обзоры показывают высокую вариабельность точности AI в зависимости от контекста применения.

Публикационная предвзятость возникает, когда исследования с положительными результатами публикуются чаще, чем с отрицательными, искажая общую картину эффективности AI. Это завышает оценки диагностической точности в систематических обзорах. Для выявления используют статистические методы вроде воронкообразных графиков и тестов асимметрии.

Используют метрики: чувствительность (доля выявленных больных), специфичность (доля правильно определённых здоровых), предсказательную ценность и площадь под ROC-кривой. Валидация проводится на независимых выборках, не участвовавших в обучении. Сравнение с золотым стандартом (гистология, экспертная оценка) обязательно для клинического применения.

AI обучается на доступных данных, которые часто недопредставляют меньшинства, редкие заболевания или специфические демографические группы. Алгоритм запоминает паттерны большинства и хуже работает на недостаточно представленных случаях. Это создаёт неравенство в качестве медицинской помощи и требует целенаправленной коррекции датасетов.

Полностью устранить невозможно, но можно значительно снизить через разнообразные обучающие данные, регулярный аудит и многоцентровую валидацию. Предвзятость часто отражает реальные неравенства в здравоохранении и качестве данных. Постоянный мониторинг производительности AI в клинической практике критически важен для выявления новых источников ошибок.

Требуется многоэтапная валидация: внутренняя (на части исходных данных), внешняя (на данных других центров) и проспективная (в реальной практике). Необходимо тестирование на разных подгруппах пациентов, оборудовании и клинических сценариях. Сравнение с экспертными оце��ками и анализ ошибочных случаев обязательны перед регистрацией.

Переобучение — когда AI отлично работает на обучающих данных, но плохо на новых случаях, запоминая шум вместо закономерностей. В медицине это приводит к ложным диагнозам при малейших отличиях от обучающей выборки. Предотвращается разделением данных, регуляризацией и валидацией на независимых датасетах из других клиник.

Да, объяснимость критически важна для клинического доверия и юридической ответственности. Врачи должны понимать, на основе каких признаков AI принял решение, чтобы оценить его обоснованность. Методы визуализации внимания алгоритма и выделения значимых областей изображения повышают прозрачность, но многие современные AI остаются «чёрными ящиками».

Нет, это миф. Современные AI-системы в хирургии выполняют узкие задачи распознавания анатомических структур или предупреждения о рисках, но не заменяют человеческое участие. Они работают как вспомогательные инструменты, требующие контроля хирурга. Полная автономия AI в операционной пока не достигнута и вызывает серьёзные этические вопросы.

Различия в дизайне исследований, популяциях пациентов, версиях AI и методах оценки создают гетерогенность, затрудняющую объединение результатов. Высокая гетерогенность снижает достоверность обобщённых выводов о точности AI. Статистические методы (I² статистика, мета-регрессия) помогают оценить и объяснить вариабельность между исследованиями.

Предвзятый AI усугубляет неравенство в здравоохранении, предоставляя худшую диагностику уязвимым группам населения. Это нарушает принципы справедливости и равного доступа к качественной медицинской помощи. Разработчики и регуляторы должны требовать демонстрации равной производительности AI для всех демографических групп перед одобрением.

Абсолютно необходим. Производительность AI может снижаться из-за изменений в популяции пациентов, обновлений оборудования или «дрейфа данных». Регулярный аудит точности, анализ ошибок и обратная связь от клиницистов позволяют своевременно выявлять проблемы. Переобучение на новых данных может потребоваться для поддержания клинической эффективности.

Работа с редкими заболеваниями — сложная задача из-за малого количества обучающих примеров, что повышает риск переобучения и ошибок. Методы трансферного обучения, синтетической генерации данных и федеративного обучения помогают частично решить проблему. Однако валидация остаётся затруднённой, и AI для редких патологий требует особо тщательной экспертной проверки.