📊 Основы машинного обучения

📊 Основы машинного обученияКак работает искусственный интеллект: от данных до решенийλ

Понимание принципов работы ИИ — от обучения на данных до практического применения в медицине, бизнесе и повседневной жизни

Overview

Искусственный интеллект учится на данных 🧠 — находит паттерны, строит прогнозы, принимает решения. Нейронные сети, алгоритмы машинного обучения и обработка языка позволяют машинам решать задачи, которые раньше требовали человеческого мышления. Никакой магии: только математика, статистика и вычислительная мощность.

🛡️

Протокол Лапласа: ИИ — это не замена человеческого разума, а инструмент его усиления. Понимание базовых принципов работы ИИ доступно каждому и не требует технического образования для практического применения.

Reference Protocol

Научный фундамент

Доказательная база для критического анализа

Navigation Matrix

Подразделы

[ai-errors-biases]

Ошибки и предвзятость ИИ

Как распознать и минимизировать риски алгоритмических ошибок в диагностике, хирургии и клинических исследованиях

Изучить

[ml-basics]

Основы машинного обучения

Изучите базовые алгоритмы, математические основы и практические методы машинного обучения, которые формируют фундамент современной искусственной интеллектуальности и анализа данных

Изучить

Protocol: Evaluation

Проверь себя

Квизы по этой теме скоро появятся

Sector L1

Статьи

Научно-исследовательские материалы, эссе и глубокие погружения в механизмы критического мышления.

📊 Основы машинного обучения

📊 Основы машинного обучения⚡

Подробнее

Основы работы ИИ: от данных до решений

Искусственный интеллект работает как математическая система распознавания закономерностей в больших объёмах данных. Алгоритм получает примеры, выявляет статистические связи между входом и результатом, затем применяет найденные паттерны к новой информации.

Это принципиально отличается от традиционного программирования: там разработчик прописывает каждое правило вручную, здесь ИИ формирует правила самостоятельно на основе опыта.

Что такое машинное обучение

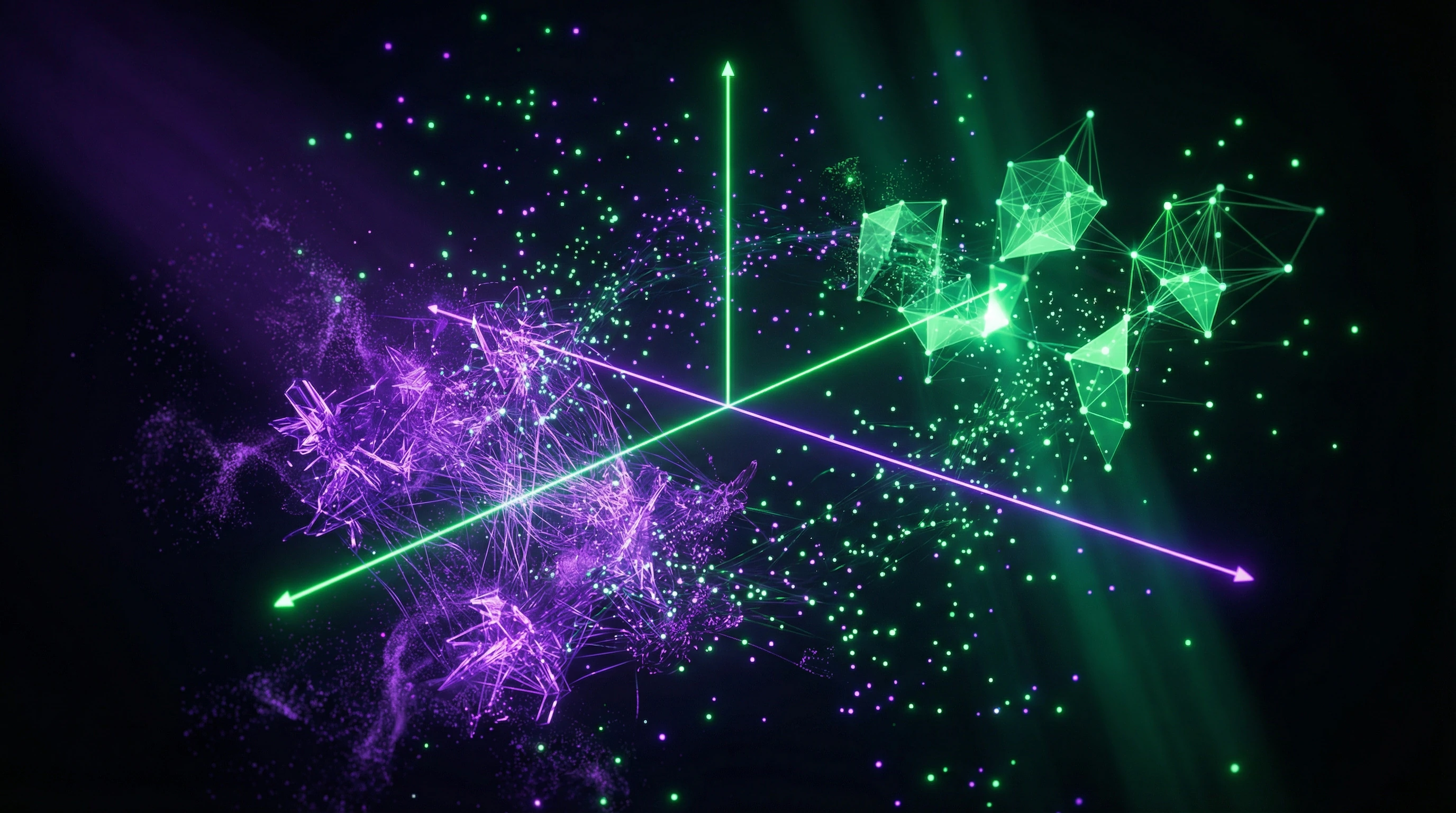

Машинное обучение — подмножество ИИ, где системы обучаются на данных без явного программирования каждого шага.

| Тип обучения | Принцип | Задачи |

|---|---|---|

| С учителем (supervised) | Алгоритм получает размеченные примеры с правильными ответами | Классификация, прогнозирование |

| Без учителя (unsupervised) | Система самостоятельно находит структуру в неразмеченных данных | Кластеризация, выявление паттернов |

| С подкреплением (reinforcement) | Модель учится через систему вознаграждений и штрафов | Оптимизация последовательности действий |

Роль данных в обучении ИИ

Данные — топливо для ИИ: качество и объём обучающей выборки напрямую определяют точность работы модели.

- Сбор релевантной информации

- Первый этап: выбор источников, которые действительно отражают задачу.

- Очистка и нормализация

- Удаление ошибок, выбросов, приведение форматов к единому стандарту.

- Разметка (для обучения с учителем)

- Добавление правильных ответов, если требуется.

- Репрезентативность

- Критическое требование: обучающие данные должны отражать реальное разнообразие ситуаций. Если этого нет, модель даст смещённые результаты. Например, система распознавания лиц, обученная преимущественно на фотографиях людей европейской внешности, хуже работает с другими этническими группами — это прямое следствие ошибок и предвзятости ИИ.

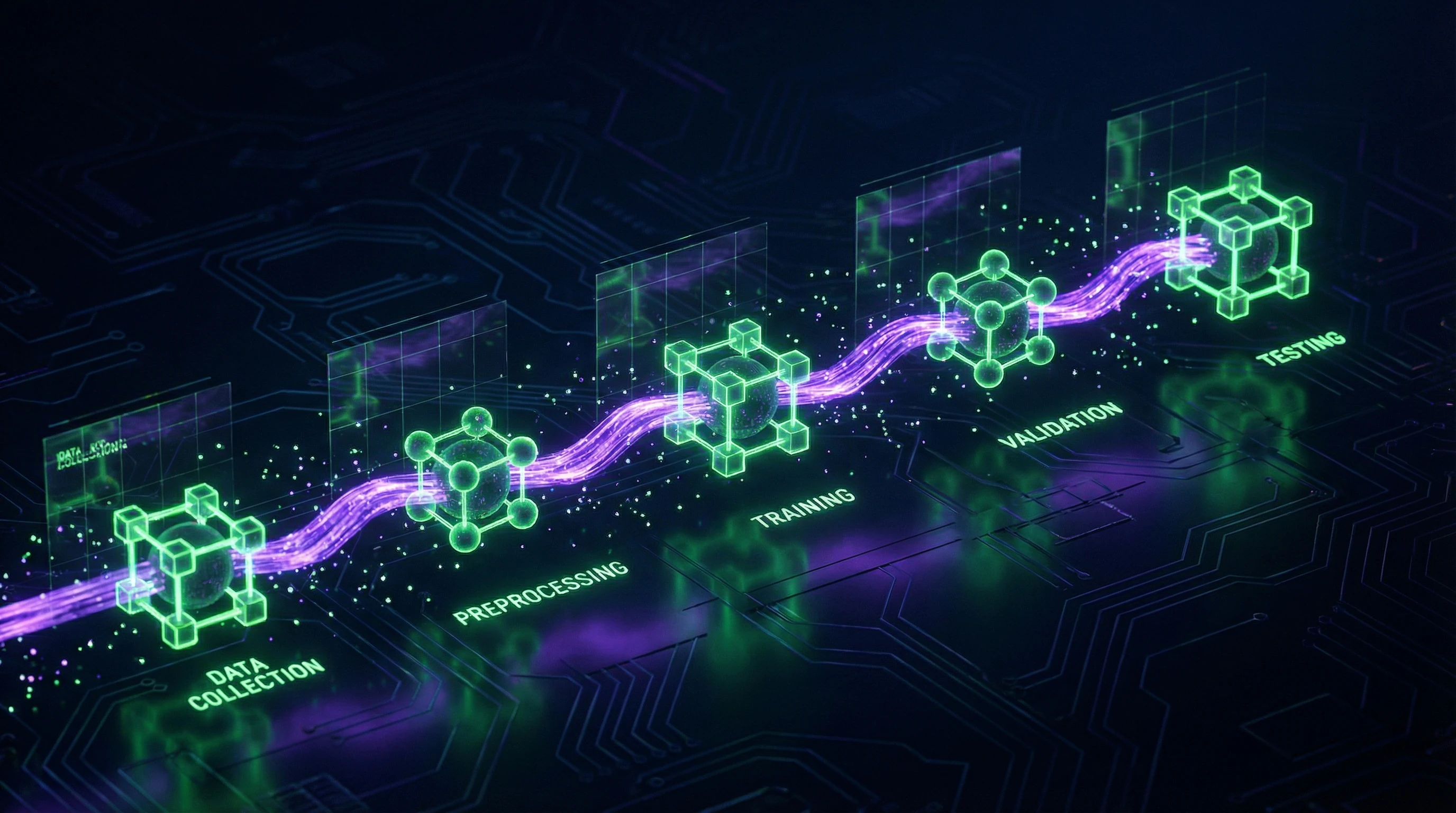

Процесс обучения и тестирования моделей

Обучение ИИ проходит в несколько этапов с разделением данных на три выборки.

- Обучающая выборка (70–80%) — модель настраивает внутренние параметры, минимизируя ошибку между предсказаниями и реальными значениями через оптимизацию.

- Валидационная выборка (10–15%) — используется для подбора гиперпараметров и предотвращения переобучения (когда модель отлично работает на знакомых данных, но плохо обобщает на новые).

- Тестовая выборка (10–15%) — финальная проверка показывает реальную производительность системы в условиях, максимально приближенных к боевым.

Качество данных важнее их количества: одна хорошо подготовленная выборка даст лучший результат, чем гигабайты грязных, несбалансированных данных.

Нейронные сети: архитектура и принципы

Нейронные сети — это вычислительные модели, вдохновлённые структурой биологических нейронов, но работающие на совершенно иных принципах. Искусственная нейросеть состоит из узлов (нейронов), организованных в слои и соединённых взвешенными связями, которые передают и трансформируют информацию.

Каждый нейрон получает входные сигналы, применяет к ним математическую функцию (обычно взвешенную сумму с нелинейным преобразованием) и передаёт результат следующему слою. Именно эта многослойная архитектура позволяет сети выявлять сложные, иерархические закономерности в данных — от простых признаков на первых слоях до абстрактных концепций на глубоких уровнях.

Структура искусственного нейрона

Искусственный нейрон — это математическая функция, которая принимает несколько входов, умножает каждый на соответствующий вес, суммирует результаты, добавляет смещение (bias) и пропускает через функцию активации.

- Веса

- Определяют важность каждого входного сигнала и настраиваются в процессе обучения через алгоритм обратного распространения ошибки (backpropagation).

- Функция активации

- Вносит нелинейность, без которой даже многослойная сеть вела бы себя как простая линейная модель. Популярные варианты: ReLU, sigmoid, tanh.

- Смещение (bias)

- Позволяет нейрону активироваться даже при нулевых входах, увеличивая гибкость модели.

Слои и специализированные архитектуры

Типичная нейросеть содержит входной слой (получает исходные данные), один или несколько скрытых слоёв (выполняют преобразования) и выходной слой (генерирует финальный результат).

| Тип архитектуры | Структура связей | Применение |

|---|---|---|

| Полносвязные (Dense) | Каждый нейрон соединён со всеми нейронами следующего слоя | Классификация, регрессия |

| Свёрточные (CNN) | Локальные связи и разделяемые веса | Обработка изображений |

| Рекуррентные (RNN) | Обратные связи для обработки последовательностей | Анализ текста, временных рядов |

Глубина сети (количество слоёв) и ширина (количество нейронов в слое) определяют её выразительную способность, но избыточная сложность ведёт к переобучению и требует больше данных.

Отличия от биологического мозга

Несмотря на название, искусственные нейросети радикально отличаются от биологических: они используют упрощённые математические модели вместо сложных электрохимических процессов, обучаются через градиентный спуск вместо синаптической пластичности, и работают синхронно слой за слоем, а не асинхронно как настоящие нейроны.

Биологический мозг содержит около 86 миллиардов нейронов с триллионами связей, каждая из которых может иметь десятки типов нейромедиаторов и сложную временную динамику — современные ИИ даже близко не приближаются к этой сложности.

Мозг эффективен энергетически (потребляет около 20 Вт), тогда как обучение крупных нейросетей требует мегаватты электроэнергии. Это фундаментальное различие часто упускается в популярных описаниях ИИ, создавая ложное впечатление о близости искусственных и биологических систем.

Ключевые технологии современного ИИ

Современный искусственный интеллект опирается на три взаимодополняющие технологии. Глубокое обучение использует многослойные нейросети для автоматического извлечения признаков, обработка естественного языка позволяет машинам понимать и генерировать речь, компьютерное зрение интерпретирует визуальную информацию.

Эти направления часто комбинируются: системы описания изображений объединяют компьютерное зрение и NLP, мультимодальные модели типа GPT-4 работают одновременно с текстом и картинками.

Глубокое обучение (Deep Learning)

Глубокое обучение — подраздел машинного обучения, использующий нейросети с множеством скрытых слоёв (обычно от 10 до сотен) для выявления иерархических представлений данных.

Прорыв произошёл в 2012 году: свёрточная сеть AlexNet выиграла конкурс ImageNet по распознаванию изображений с огромным отрывом, продемонстрировав преимущество глубоких архитектур.

Ключевые факторы успеха: доступность больших датасетов, рост вычислительной мощности GPU и улучшенные методы обучения (dropout, batch normalization, residual connections).

Сегодня глубокое обучение доминирует в компьютерном зрении, распознавании речи, машинном переводе и генеративных моделях.

Обработка естественного языка (NLP)

NLP позволяет компьютерам анализировать, понимать и генерировать человеческий язык через комбинацию лингвистических правил и статистических моделей.

Современные системы используют трансформеры — архитектуру, основанную на механизме внимания (attention), которая эффективно обрабатывает длинные последовательности текста и улавливает контекстные зависимости.

| Компонент | Функция | Результат |

|---|---|---|

| Большие языковые модели (LLM) | Обучаются на миллиардах слов, предсказывают следующее слово или восстанавливают пропущенные фрагменты | Усваивают грамматику, факты и элементы рассуждений |

| Применения | Машинный перевод, чат-боты, суммаризация, анализ тональности, генерация контента | Практическое использование в продуктах и сервисах |

Компьютерное зрение

Компьютерное зрение даёт машинам способность извлекать информацию из изображений и видео: классифицировать (что изображено), детектировать (где находятся объекты), сегментировать (выделять границы) и генерировать изображения.

Свёрточные нейросети (CNN) стали стандартом благодаря способности автоматически обучаться иерархии визуальных признаков: первые слои выявляют края и текстуры, средние — части объектов, глубокие — целые объекты и сцены.

Современные архитектуры типа ResNet, EfficientNet и Vision Transformers достигают сверхчеловеческой точности в узких задачах: распознавание дорожных знаков, диагностика рентгеновских снимков.

Применения охватывают автономные автомобили, медицинскую диагностику, системы безопасности, дополненную реальность и контроль качества на производстве.

Этапы создания ИИ-системы: от идеи до продакшена

Определение целей и выбор архитектуры

Разработка ИИ-системы начинается с чёткой формулировки бизнес-задачи и перевода её в техническую постановку: классификация, регрессия, кластеризация или генерация.

На этом этапе определяют метрики успеха (accuracy, F1-score, BLEU для NLP), доступные вычислительные ресурсы и требования к латентности. Выбор архитектуры зависит от типа данных: для изображений используют CNN, для последовательностей — RNN/LSTM или трансформеры, для табличных данных — градиентный бустинг или классические ML-алгоритмы.

Критически важно оценить, достаточно ли данных для обучения глубокой модели или стоит начать с transfer learning на предобученных весах.

Сбор, очистка и подготовка данных

Качество данных определяет 80% успеха проекта: модель не может научиться тому, чего нет в обучающей выборке.

- Сбор репрезентативных примеров и разметка (для supervised learning)

- Удаление дубликатов, обработка пропусков и выбросов

- Нормализация признаков; для изображений — аугментация (повороты, обрезки, изменение яркости)

- Для текста — токенизация и векторизация через embeddings

- Разделение на обучающую (70–80%), валидационную (10–15%) и тестовую (10–15%) выборки

- Коррекция дисбаланса классов через oversampling, undersampling или взвешивание функции потерь

Критична проверка отсутствия утечки информации между выборками.

Обучение, валидация и развертывание

Обучение заключается в итеративной оптимизации весов модели через минимизацию функции потерь на обучающей выборке с помощью алгоритмов типа SGD, Adam или AdamW.

Валидационная выборка используется для подбора гиперпараметров (learning rate, batch size, архитектура) и раннего останова при переобучении. После достижения целевых метрик модель тестируют на отложенных данных, проверяют на edge cases и adversarial examples, затем упаковывают в API или встраивают в приложение.

В продакшене критичен мониторинг: отслеживание drift'а распределения входных данных, деградации метрик, латентности и ресурсопотребления.

Современные MLOps-практики включают версионирование моделей, A/B-тестирование, автоматический ретрейнинг при падении качества и explainability-инструменты для аудита решений.

Практические применения ИИ: от медицины до повседневности

ИИ в медицине и диагностике

Медицинский ИИ анализирует рентгеновские снимки, МРТ и КТ с точностью, сопоставимой или превосходящей врачей-радиологов в узких задачах вроде обнаружения пневмонии, опухолей или переломов. Алгоритмы обрабатывают гистологические препараты для выявления раковых клеток и предсказывают риск сердечно-сосудистых заболеваний по ЭКГ.

В drug discovery ИИ ускоряет поиск молекул-кандидатов, предсказывая их свойства и взаимодействие с белками-мишенями. Это сокращает время разработки препаратов с 10–15 лет до 3–5.

Виртуальные ассистенты помогают пациентам с трекингом симптомов, напоминаниями о приёме лекарств и первичной консультацией через чат-боты — перемещая часть нагрузки с врача на алгоритм.

Автоматизация бизнес-процессов

В корпоративном секторе ИИ автоматизирует рутину: обработку документов через OCR и NLP, маршрутизацию обращений клиентов, прогнозирование спроса и оптимизацию логистики. Рекомендательные системы увеличивают конверсию e-commerce на 20–30%, анализируя историю покупок и поведение на сайте.

| Применение | Эффект |

|---|---|

| Чат-боты в поддержке | Обрабатывают до 80% типовых запросов |

| Fraud detection в банках | Снижают потери от мошенничества на 40–60% |

| Predictive maintenance | Сокращают простои оборудования и затраты на ремонт |

ИИ в образовании и повседневной жизни

Адаптивные образовательные платформы подстраивают темп и сложность материала под уровень студента, анализируя паттерны ошибок. Системы автоматической проверки эссе и кода предоставляют мгновенную обратную связь, экономя время преподавателей.

В быту голосовые ассистенты управляют умным домом, отвечают на вопросы и выполняют задачи через NLP. Рекомендации музыки, фильмов и контента персонализируются через collaborative filtering и deep learning.

Камеры смартфонов используют ИИ для распознавания сцен, портретного режима с размытием фона и ночной съёмки через multi-frame processing. Навигационные приложения предсказывают пробки и оптимизируют маршруты, обрабатывая данные миллионов пользователей в реальном времени.

Мифы и реальность об искусственном интеллекте

ИИ не равно нейросети

Распространённое заблуждение отождествляет весь ИИ с нейронными сетями, хотя последние — лишь один из инструментов в арсенале.

| Метод | Сильные стороны | Когда применять |

|---|---|---|

| Классические ML (деревья, SVM, логрегрессия) | Высокая интерпретируемость, низкие вычисления | Табличные данные малого объёма |

| Экспертные системы на правилах | Полная прозрачность логики | Медицинская диагностика, финансовый анализ |

| Эволюционные алгоритмы, reinforcement learning | Решают задачи без размеченных данных | Оптимизация, управление, игры |

| Глубокое обучение | Масштабируемость, работа с неструктурированными данными | Изображения, текст, звук при больших объёмах |

Выбор метода зависит от объёма данных, требований к точности, интерпретируемости и вычислительным ресурсам — универсального решения не существует.

Ограничения современного ИИ

Современные ИИ-системы не обладают пониманием в человеческом смысле: они находят статистические корреляции в данных, не постигая причинно-следственные связи.

Модели хрупки к adversarial attacks — минимальные, незаметные глазу изменения входа могут вызвать катастрофические ошибки. Обобщение за пределы обучающего распределения остаётся нерешённой проблемой: модель, обученная на летних фото, может провалиться на зимних.

Требования к данным огромны: для обучения GPT-3 использовались сотни миллиардов токенов, а ImageNet содержит 14 миллионов размеченных изображений. Энергопотребление обучения крупных моделей сопоставимо с годовым выбросом углерода нескольких автомобилей, что поднимает вопросы экологической устойчивости.

Этические аспекты и ответственное использование

ИИ-системы наследуют и усиливают предвзятости, присутствующие в обучающих данных: алгоритмы найма дискриминируют по полу, системы распознавания лиц хуже работают на тёмной коже, кредитный скоринг может быть несправедлив к меньшинствам.

Непрозрачность deep learning моделей затрудняет аудит и объяснение решений, что критично в медицине, юриспруденции и финансах. Массовое внедрение ИИ угрожает рабочим местам в транспорте, производстве, клиентском сервисе, требуя программ переквалификации.

Deepfakes и генеративные модели создают риски дезинформации и манипуляции общественным мнением.

- Аудит данных на предвзятость и репрезентативность

- Применение методов explainable AI для прозрачности решений

- Человеческий контроль в критических решениях (медицина, юриспруденция, финансы)

- Документирование ограничений системы и сценариев отказа

- Регулярный мониторинг социального воздействия и побочных эффектов

Knowledge Access Protocol

FAQ

Часто задаваемые вопросы

Искусственный интеллект — это технология, позволяющая компьютерам выполнять задачи, требующие человеческого мышления: распознавание образов, принятие решений, понимание языка. ИИ учится на данных через алгоритмы, находит закономерности и применяет их для решения новых задач. Примеры: голосовые помощники, рекомендации в соцсетях, медицинская диагностика.

Нейросеть получает большой набор примеров с правильными ответами и постепенно настраивает связи между нейронами, минимизируя ошибки. Процесс похож на обучение ребёнка: показываем тысячи фотографий кошек, пока система не научится их распознавать. После обучения модель тестируется на новых данных для проверки точности.

В обычном программировании человек прописывает все правила вручную, а в машинном обучении система сама находит закономерности в данных. Программист задаёт только цель и предоставляет примеры, алгоритм самостоятельно строит модель решения. Это позволяет решать задачи, где правила слишком сложны для явного описания.

Нет, это распространённый миф. Искусственные нейросети лишь вдохновлены биологией, но работают через математические операции и статистические методы, а не биологические процессы. Человеческий мозг использует химические сигналы, эмоции и сознание, которых у ИИ нет.

Нет, данные — это основа работы современного ИИ. Без качественных данных для обучения система не сможет выявить закономерности и делать точные предсказания. Чем больше и разнообразнее данные, тем лучше работает модель.

Процесс включает шесть ключевых этапов: определение целей, сбор данных, их подготовку и очистку, обучение модели, тестирование на новых данных и развёртывание в продакшн. После запуска требуется постоянный мониторинг и улучшение системы на основе реальной работы.

Глубокое обучение — это подраздел машинного обучения, использующий многослойные нейросети для анализа сложных данных. Технология позволяет автоматически выделять признаки из изображений, текста, звука без ручной настройки. Применяется в распознавании лиц, голосовых помощниках, беспилотных автомобилях.

Начните с готовых инструментов: ChatGPT для текстов, Midjourney для изображений, голосовые помощники для автоматизации задач. Многие сервисы имеют простой интерфейс и не требуют программирования. Изучите базовые понятия через бесплатные курсы на русском языке.

ИИ помогает в диагностике заболеваний по снимкам, предсказывает риски осложнений, ускоряет разработку лекарств и персонализирует планы лечения. Системы анализируют медицинские данные быстрее врачей и выявляют закономерности, незаметные человеку. Технология уже используется в онкологии, радиологии, кардиологии.

Модель тестируют на отдельном наборе данных, который не использовался при обучении, измеряя точность, полноту и F1-меру. Важно проверить работу на граничных случаях и реальных сценариях использования. Профессионалы также анализируют матрицу ошибок и проводят A/B-тестирование.

Нет, это заблуждение. ИИ включает множество технологий: экспертные системы, генетические алгоритмы, логический вывод, деревья решений. Нейросети — лишь один из инструментов, хотя и очень популярный в последние годы.

Современный ИИ не является полностью автономным и требует человеческого контроля, постановки целей и интерпретации результатов. Технология лучше всего работает как инструмент, усиливающий человеческие способности, а не заменяющий их. Творчество, эмпатия и стратегическое мышление остаются за людьми.

NLP — это направление ИИ, позволяющее компьютерам понимать, интерпретировать и генерировать человеческий язык. Технология используется в чат-ботах, переводчиках, анализе тональности текстов, голосовых помощниках. Современные модели типа GPT понимают контекст и создают связные тексты.

Требуются большие объёмы качественных, размеченных данных, релевантных решаемой задаче. Для классификации изображений нужны тысячи фото с метками, для NLP — текстовые корпуса. Данные должны быть разнообразными, сбалансированными и очищенными от ошибок.

Основные проблемы: предвзятость алгоритмов из-за необъективных данных, приватность личной информации, прозрачность принятия решений и ответственность за ошибки. Важно разрабатывать ИИ с учётом этических принципов, обеспечивать контроль и объяснимость систем. Регуляторы разных стран создают правовые рамки для ответственного использования.

Современный ИИ комбинирует и трансформирует паттерны из обучающих данных, но не обладает истинным творчеством или пониманием. Системы генерируют новые изображения, тексты, музыку на основе изученных примеров, но не создают концептуально новые идеи. Прорывные инновации пока остаются прерогативой человеческого интеллекта.