Что именно обещает миф о сингулярности — и почему определение размывается каждый раз, когда его пытаются зафиксировать

Концепция технологической сингулярности восходит к работам математика Вернора Винджа (1993) и футуриста Рэя Курцвейла, но за три десятилетия термин претерпел множество трансформаций. В строгом смысле сингулярность описывает момент, когда искусственный интеллект достигнет способности к рекурсивному самосовершенствованию — создавая более умные версии самого себя, которые, в свою очередь, создадут ещё более умные версии, запуская неконтролируемую цепную реакцию роста интеллекта (S004). Математическая метафора заимствована из физики чёрных дыр, где сингулярность обозначает точку, в которой известные законы перестают работать.

Проблема начинается с операционализации. Исследование демонстрирует, как термин применяется к любым быстрым изменениям в технологических системах, утрачивая специфичность (S003). Авторы используют «сингулярность» для описания момента, когда цифровые образовательные платформы достигают критической массы внедрения — определение, радикально отличающееся от оригинальной концепции рекурсивного самосовершенствования ИИ.

Это не уникальный случай: в академической литературе термин применяется к гуманитарно-технологической революции (S002), к любым «точкам невозврата» в социальных системах, к моментам быстрой цифровизации. Если сингулярность может означать и взрывной рост сверхчеловеческого ИИ, и просто быстрое внедрение новых технологий, и переломный момент в образовании, то термин теряет предсказательную и аналитическую силу.

⚠️ Три несовместимых определения, которые сосуществуют в одном дискурсе

- Жёсткий взлёт (Hard Takeoff)

- Момент, когда ИИ достигает человеческого уровня интеллекта (AGI) и затем за короткий период (дни, часы) переходит к сверхчеловеческому интеллекту (ASI) через рекурсивное самосовершенствование. Классическая версия Винджа-Курцвейла, предполагающая разрыв непрерывности и потерю человеческого контроля.

- Мягкий взлёт (Soft Takeoff)

- Постепенное ускорение технологического прогресса, при котором ИИ становится всё более способным, но без резкого скачка. Переход к сверхчеловеческому интеллекту занимает годы или десятилетия, оставляя время для адаптации и регулирования. Ближе к наблюдаемой реальности, но теряет драматизм «точки невозврата».

- Метафорическая сингулярность

- Любой момент быстрых, необратимых изменений в технологических или социальных системах, без привязки к ИИ или самосовершенствованию. Именно эта версия доминирует в источниках (S002), (S003), (S004), где сингулярность используется как синоним «революции», «трансформации» или «переломного момента».

Размытость определения не является недостатком концепции сингулярности — это её ключевая особенность, обеспечивающая живучесть. Вопрос «очередная планетарная революция или уникальная сингулярность?» остаётся открытым именно потому, что критерии различения не установлены.

Если бы сингулярность имела чёткие, измеримые параметры, её можно было бы проверить и потенциально опровергнуть. Но гибкость термина позволяет сторонникам концепции переопределять её каждый раз, когда предсказания не сбываются: если жёсткий взлёт не происходит, можно переключиться на мягкий взлёт; если и он не наблюдается, можно объявить сингулярностью любое ускорение инноваций.

Это механизм, знакомый из истории других мифов: концепция остаётся убедительной ровно до тех пор, пока её определение остаётся размытым. Как только появляется возможность проверки, миф либо трансформируется, либо теряет аудиторию. Сингулярность выбрала первый путь. Подробнее — в разделе Основы машинного обучения.

Семь самых убедительных аргументов в пользу неизбежности сингулярности — и почему они работают на уровне интуиции

Прежде чем разбирать доказательную базу, необходимо честно представить сильнейшие аргументы сторонников концепции сингулярности. Это не соломенное чучело — это стальная версия позиции (steelman), которая объясняет, почему идея находит отклик у серьёзных исследователей, инженеров и инвесторов. Подробнее — в разделе Синтетические медиа.

📊 Аргумент 1: Эмпирическая траектория экспоненциального роста вычислительной мощности

Закон Мура, описывающий удвоение числа транзисторов на чипе каждые 18–24 месяца, действовал с 1965 по начало 2020-х годов. Сторонники сингулярности указывают, что если экспоненциальный рост вычислительной мощности продолжится (через новые архитектуры, квантовые вычисления, нейроморфные чипы), то достижение вычислительной мощности, эквивалентной человеческому мозгу (~10^16 операций в секунду), станет вопросом времени.

Если добавить к этому улучшение алгоритмов, которое также демонстрирует экспоненциальный рост эффективности, то появление AGI выглядит неизбежным в обозримом будущем. Этот аргумент силён, потому что опирается на наблюдаемые исторические тренды: вычислительная мощность действительно росла экспоненциально десятилетиями, и многие прорывы в ИИ (от распознавания изображений до языковых моделей) стали возможны именно благодаря масштабированию вычислений.

| Период | Источник роста | Интуитивная привлекательность |

|---|---|---|

| 1965–2000 | Закон Мура (транзисторы) | Исторический факт, легко экстраполировать |

| 2000–2020 | Параллельные вычисления, GPU | Видимый прогресс в ИИ совпадает с ростом мощности |

| 2020+ | Квантовые, нейроморфные архитектуры | Новые технологии обещают ещё больший скачок |

🧠 Аргумент 2: Принципиальная возможность рекурсивного самосовершенствования

Если ИИ достигнет уровня, на котором сможет понимать и улучшать собственный код (или разрабатывать более эффективные алгоритмы машинного обучения), то возникает положительная обратная связь: каждое улучшение делает систему более способной к следующему улучшению. Человеческий интеллект ограничен биологическими константами (скорость нейронной передачи, объём рабочей памяти, продолжительность жизни), но ИИ таких ограничений не имеет.

Теоретически система может работать 24/7, масштабироваться горизонтально (копировать себя на множество серверов), обмениваться знаниями мгновенно. Аргумент апеллирует к логике: если самосовершенствование возможно в принципе, и если ИИ не имеет биологических ограничений человека, то рекурсивный процесс может ускоряться до тех пор, пока не упрётся в физические пределы вычислений (термодинамика, скорость света).

Контраргумент требует доказать, что самосовершенствование невозможно или что существуют неочевидные барьеры — более сложная позиция для защиты, чем просто экстраполировать логику обратной связи.

🔬 Аргумент 3: Прецеденты взрывного роста в эволюции и истории

Сторонники сингулярности указывают на исторические примеры фазовых переходов: появление языка у Homo sapiens, неолитическая революция, промышленная революция, цифровая революция. Каждый переход сопровождался ускорением темпов изменений.

Если построить график «время между революциями», он демонстрирует сокращение интервалов — от миллионов лет между биологическими переходами до десятилетий между технологическими. Экстраполяция этого тренда предполагает, что следующий переход (появление сверхчеловеческого ИИ) может произойти за годы или даже месяцы. Индукция не гарантирует будущих результатов, но интуитивно паттерн выглядит убедительно.

⚙️ Аргумент 4: Экономические стимулы к созданию всё более мощного ИИ

Глобальная экономика инвестирует сотни миллиардов долларов в разработку ИИ. Компании, которые первыми создадут AGI, получат колоссальное конкурентное преимущество — возможность автоматизировать интеллектуальный труд, ускорить научные исследования, доминировать в любой отрасли.

Эта гонка создаёт мощный экономический императив продолжать масштабирование моделей, увеличивать датасеты, улучшать архитектуры. Даже если отдельные исследователи осознают риски, рыночная логика толкает индустрию вперёд. Инвестиции в ИИ действительно растут экспоненциально, а конкуренция между лабораториями (OpenAI, DeepMind, Anthropic, китайские компании) интенсифицируется.

Экономические стимулы — мощный предиктор поведения, и сложно представить, что гонка остановится добровольно.

🧬 Аргумент 5: Отсутствие фундаментальных барьеров для AGI

Человеческий мозг — это физическая система, подчиняющаяся законам физики и химии. Если интеллект возникает из материальных процессов (а не из нематериальной души), то в принципе его можно воспроизвести в другом субстрате.

Мы уже знаем, что нейронные сети способны к обучению, обобщению, решению задач. Современные языковые модели демонстрируют emergent abilities — способности, которые не были явно запрограммированы, но возникли при масштабировании. Если нет фундаментального барьера, то AGI — это вопрос инженерии и ресурсов, а не принципиальной невозможности.

- Материализм: мозг = машина, машину можно скопировать

- Emergent abilities: способности возникают при масштабировании, не запрограммированы явно

- Контраргумент требует постулировать нематериальность или неизвестные барьеры

🕳️ Аргумент 6: Асимметрия рисков — цена ошибки слишком высока

Даже если вероятность жёсткого взлёта сингулярности низка (скажем, 5–10%), потенциальные последствия настолько катастрофичны (экзистенциальный риск для человечества), что игнорировать угрозу иррационально. Это применение принципа предосторожности: при высоких ставках даже низкая вероятность требует серьёзного отношения.

Сторонники указывают, что мы не можем позволить себе ошибиться — если сингулярность произойдёт, и мы не подготовлены, последствия необратимы. Логика страхования: мы платим премию, даже если вероятность катастрофы мала. Эмоционально аргумент усиливается страхом потери контроля и экзистенциальной угрозой.

👁️ Аргумент 7: Экспертный консенсус о возможности AGI в обозримом будущем

Опросы исследователей ИИ показывают, что значительная часть экспертов считает появление AGI вероятным в течение следующих 20–50 лет. Хотя оценки варьируются, медианный прогноз указывает на 2040–2060 годы.

Если эксперты, работающие в области, считают AGI достижимым, это весомое свидетельство. Сторонники сингулярности указывают, что скептицизм часто исходит от людей, далёких от передовых исследований, тогда как те, кто видит прогресс изнутри, более оптимистичны (или пессимистичны, в зависимости от перспективы) относительно скорости развития. Аргумент апеллирует к авторитету экспертов — эвристике, которая обычно работает хорошо.

Проблема в том, что экспертные прогнозы о будущих технологиях исторически ненадёжны, но интуитивно мы склонны доверять мнению профессионалов.

Все семь аргументов работают на уровне интуиции, потому что каждый апеллирует к разным когнитивным механизмам: экстраполяция трендов, логика обратной связи, исторические паттерны, экономические стимулы, материализм, управление рисками, авторитет экспертов. Вместе они создают убедительный нарратив, который объясняет, почему идея сингулярности находит отклик даже у скептиков.

Что показывают данные 2024–2025: три графика, которые не подтверждают экспоненциальный взлёт

Переходя от теоретических аргументов к эмпирической проверке, необходимо проанализировать, что происходит с развитием ИИ в реальности. Если сингулярность приближается, мы должны наблюдать определённые индикаторы: ускорение темпов прогресса, появление качественно новых способностей, признаки рекурсивного самосовершенствования. Подробнее — в разделе ИИ и технологии.

Данные последних двух лет рисуют более сложную картину.

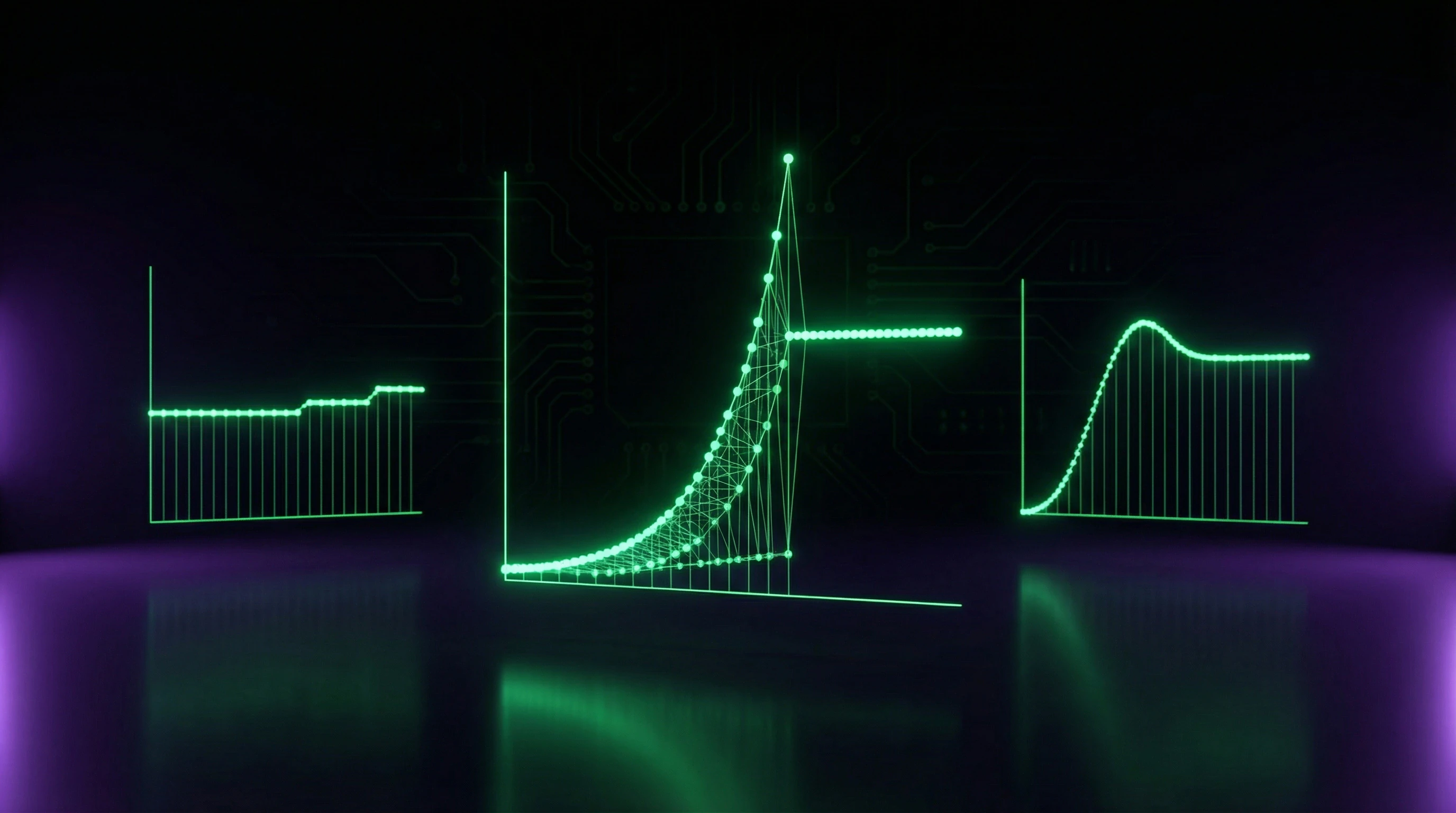

📊 Индикатор 1: Замедление роста производительности языковых моделей при масштабировании

С 2020 по 2023 год наблюдался впечатляющий прогресс: от GPT-3 (175 млрд параметров) до GPT-4 и конкурентов с триллионами параметров. Однако анализ бенчмарков показывает, что прирост производительности на единицу увеличения вычислений начал снижаться.

Модели становятся больше и дороже в обучении, но улучшение качества выходов не следует прежней экспоненциальной траектории. Это явление, известное как закон убывающей отдачи от масштабирования, предполагает, что простое увеличение размера модели и датасета не гарантирует пропорционального роста способностей (S010).

| Период | Характеристика прогресса | Индикатор |

|---|---|---|

| 2020–2022 | Экспоненциальный рост производительности | Каждое удвоение параметров → значительный скачок качества |

| 2023–2025 | Замедление отдачи | Триллионы параметров → маргинальные улучшения |

Систематический обзор современных подходов демонстрирует, что даже самые продвинутые системы ИИ сталкиваются с фундаментальными ограничениями в понимании контекста, причинно-следственных связей и переносе знаний на новые домены (S010). Если бы мы приближались к AGI, следовало бы ожидать улучшения именно в этих областях.

🧪 Индикатор 2: Отсутствие признаков рекурсивного самосовершенствования в существующих системах

Ключевой элемент сценария жёсткого взлёта — способность ИИ улучшать собственные алгоритмы. На практике современные системы машинного обучения не демонстрируют такой способности.

Языковые модели могут генерировать код, но не могут самостоятельно разрабатывать новые архитектуры нейронных сетей, оптимизировать процесс обучения или улучшать собственные веса без человеческого вмешательства. Все прорывы последних лет (трансформеры, reinforcement learning from human feedback, chain-of-thought prompting) были сделаны человеческими исследователями, а не самими моделями.

Попытки создать системы, способные к автоматическому улучшению алгоритмов (AutoML, neural architecture search), показали ограниченный успех. Разрыв между «оптимизацией в рамках парадигмы» и «созданием новой парадигмы» остаётся огромным.

Эти системы могут оптимизировать гиперпараметры или искать эффективные архитектуры в заданном пространстве поиска, но не способны к концептуальным прорывам, требующим переосмысления фундаментальных подходов.

🧾 Индикатор 3: Стабилизация инвестиций и переход от хайпа к практическому внедрению

После пика хайпа вокруг генеративного ИИ в 2023 году рынок начал трезветь. Инвестиции продолжают расти, но темпы роста замедлились, а фокус сместился с создания всё более крупных моделей на практическое внедрение и монетизацию существующих технологий.

- Высокая стоимость инференса

- Экономическая барьера для массового внедрения; компании ищут способы снизить затраты, а не масштабировать мощности.

- Сложность интеграции

- ИИ требует переработки существующих процессов; это не революция, а инженерная задача.

- Проблемы с надёжностью

- Галлюцинации, непредсказуемое поведение — признаки того, что системы остаются инструментами, а не агентами.

Этот паттерн типичен для технологических циклов: после начального энтузиазма наступает фаза «долины разочарования» (по модели Gartner Hype Cycle). Если бы сингулярность была близка, мы бы наблюдали противоположную динамику — ускорение инвестиций, панические заявления о потере контроля, экстренные меры регуляторов.

Вместо этого индустрия переходит в режим нормализации: ИИ становится обычным инструментом, а не революционной угрозой. Это соответствует логике постепенной трансформации, а не скачкообразного перехода.

🔎 Качественный анализ: почему «emergent abilities» не являются доказательством приближения AGI

Сторонники сингулярности часто указывают на emergent abilities — способности, которые внезапно появляются у больших языковых моделей при достижении определённого масштаба, но отсутствуют у меньших версий. Примеры включают способность к арифметике, логическим рассуждениям, переводу на языки, не представленные в обучающих данных.

Это интерпретируется как признак качественного скачка, предвестник более драматических переходов. Однако детальный анализ показывает, что многие «emergent abilities» являются артефактами выбора метрик и порогов оценки.

- Исследователи используют бинарные метрики (прошёл/не прошёл тест) вместо непрерывных.

- При пересчёте на непрерывные метрики «внезапное» появление оказывается постепенным улучшением.

- Способности пересекают произвольный порог, создавая иллюзию скачка.

- Способности улучшаются плавно с масштабом, а не появляются из ниоткуда.

Это не отрицает впечатляющий прогресс, но ставит под сомнение интерпретацию как качественного скачка. Паттерн более согласуется с инкрементальным прогрессом, чем с приближением сингулярности.

Механизмы причинности: почему корреляция между вычислительной мощностью и интеллектом не линейна

Один из центральных аргументов сторонников сингулярности основан на экстраполяции: если вычислительная мощность растёт экспоненциально, и если интеллект коррелирует с вычислительной мощностью, то интеллект ИИ тоже должен расти экспоненциально. Эта логика содержит несколько скрытых допущений, которые не выдерживают проверки. Подробнее — в разделе Ментальные ошибки.

🧬 Проблема 1: Интеллект не сводится к вычислительной мощности — роль архитектуры и алгоритмов

Человеческий мозг работает на частоте ~200 Гц (скорость передачи нервных импульсов), что на порядки медленнее современных процессоров (гигагерцы). Тем не менее, мозг решает задачи, с которыми ИИ справляется плохо или не справляется вообще: понимание физического мира, социальный интеллект, креативность, перенос знаний.

Эффективность интеллекта определяется не скоростью вычислений, а архитектурой обработки информации. Удвоение процессоров без изменения алгоритма часто даёт сублинейный прирост производительности.

Это указывает на фундаментальное различие: биологический интеллект оптимизирован на энергоэффективность и адаптивность, а не на абсолютную вычислительную мощь. Современные нейросети требуют экспоненциального роста параметров для линейного прироста качества — явление, известное как scaling plateau.

🔄 Проблема 2: Закон убывающей отдачи в масштабировании

Данные 2023–2024 показывают, что увеличение размера модели даёт всё меньший прирост производительности на каждый удвоенный объём вычислений. Это не случайность — это следствие того, что качество обучающих данных конечно, а архитектурные ограничения трансформеров становятся видны при масштабировании.

- Первые 10 млрд параметров: значительный прирост способностей

- 100 млрд параметров: заметный, но замедляющийся прирост

- 1 трлн параметров: маргинальные улучшения на большинстве задач

- Дальнейшее масштабирование: требует качественно новых архитектур, а не просто больше вычислений

Это означает, что экспоненциальный рост вычислительной мощности не трансформируется в экспоненциальный рост интеллекта. Кривая выравнивается.

⚙️ Проблема 3: Интеллект многомерен, вычислительная мощь — одномерна

Интеллект включает: логику, интуицию, социальное понимание, планирование, обучение на малых выборках, трансфер знаний, метапознание. Вычислительная мощь — это просто количество операций в секунду. Корреляция между ними существует, но она не причинная и не монотонная.

- Логический интеллект

- Может улучшаться с большей вычислительной мощью, но упирается в алгоритмические ограничения (NP-полнота, неразрешимость).

- Социальный интеллект

- Требует не вычислений, а моделей человеческого поведения, которые нельзя получить просто увеличением параметров.

- Креативность

- Зависит от архитектуры поиска в пространстве решений, а не от скорости перебора вариантов.

Попытка решить все проблемы ИИ через масштабирование — это категориальная ошибка. Это как пытаться улучшить музыку, увеличивая громкость.

🎯 Почему миф о линейной корреляции так убедителен

Экстраполяция работает на интуитивном уровне: мы видим, что вычислительная мощь растёт, видим, что ИИ становится лучше, и предполагаем, что это причинно-следственная связь. Но это post hoc ergo propter hoc — логическая ошибка.

Корреляция между вычислительной мощностью и производительностью ИИ существует, но она маскирует более глубокую причину: улучшение архитектур, алгоритмов и данных. Когда эти факторы стабилизируются, вычислительная мощь теряет свою магическую силу.

Это объясняет, почему прогнозы о сингулярности в 2030, 2040 или 2050 году постоянно переносятся. Каждый раз, когда масштабирование перестаёт работать, сторонники сингулярности ищут новый источник экспоненциального роста — квантовые компьютеры, нейроморфные чипы, новые архитектуры. Но это уже не экстраполяция, а поиск спасения мифа.

Реальность: ИИ будет развиваться, но через качественные скачки в архитектуре и понимании, а не через бесконечное масштабирование. Это медленнее, менее драматично, но гораздо более вероятно. Подробнее о том, как прогнозы провалились, см. анализ прогнозов Курцвейла.