Анатомия мифа: что делает заблуждение об ИИ таким живучим и почему рациональные аргументы против него бессильны

Миф об искусственном интеллекте — это не просто ложное утверждение. Это самоподдерживающаяся когнитивная конструкция, которая эксплуатирует фундаментальные особенности человеческого мышления: страх перед неизвестным, склонность к упрощению сложных систем и потребность в нарративах, объясняющих быстрые технологические изменения (S005).

Мифы об ИИ распространяются быстрее фактической информации именно потому, что они предлагают простые эмоциональные ответы на сложные технические вопросы (S005).

⚠️ Три компонента устойчивого мифа

- Эмоциональный якорь

- Страх потери работы, тревога перед неконтролируемой технологией или эйфория от обещаний мгновенной трансформации бизнеса. Эмоция — первичный фильтр восприятия информации.

- Упрощённая ментальная модель

- Сведение сложной системы к одной характеристике: «ИИ заменяет людей», «ИИ всегда объективен», «ИИ — это магия». Упрощение снижает когнитивную нагрузку, но искажает реальность (S001).

- Социальное подкрепление

- Повторение мифа через медиа, корпоративный маркетинг и экспертные мнения без проверки оснований. Авторитет источника заменяет проверку фактов (S003).

🧩 Почему бизнес-лидеры особенно уязвимы

Руководители компаний находятся в зоне максимального риска: они должны принимать стратегические решения об инвестициях в ИИ без глубокой технической подготовки, под давлением конкурентов и ожиданий акционеров (S003).

Недостаток времени на проверку информации, зависимость от вторичных источников и когнитивная нагрузка заставляют полагаться на эвристики вместо анализа. 67% бизнес-лидеров признают, что принимали решения об ИИ на основе неполной или искажённой информации (S004).

🔁 Петля подтверждения: как миф создаёт реальность

Самый опасный аспект мифов об ИИ — их способность создавать самоисполняющиеся пророчества. Компания, верящая в миф «ИИ слишком дорог для нас», не инвестирует в технологию, отстаёт от конкурентов и получает подтверждение: «Видите, мы не можем себе это позволить» (S004).

| Миф | Действие компании | Результат | «Подтверждение» |

|---|---|---|---|

| «ИИ слишком дорог» | Отказ от инвестиций | Отставание от конкурентов | «Мы не можем себе это позволить» |

| «ИИ заменит всех» | Атмосфера страха, саботаж | Провал проекта | «ИИ опасен для нас» |

Эта петля обратной связи делает миф практически неуязвимым для внешней критики — он подтверждается собственными последствиями. Рациональные аргументы не работают, потому что они не адресуют эмоциональный якорь и не предлагают альтернативный нарратив. Подробнее — в разделе Этика искусственного интеллекта.

Разбор мифов требует не опровержения, а переконструирования: замены упрощённой модели на более точную, эмоционального якоря на конкретные механизмы, социального подкрепления на проверяемые факты. Это работа когнитивной иммунологии, а не риторики.

Миф первый: «ИИ — это волшебная палочка, которая мгновенно решит все бизнес-проблемы без усилий с нашей стороны»

Это заблуждение — самое дорогое для бизнеса. Launch Consulting называет его «мифом о магической трансформации» и отмечает, что именно он приводит к наибольшему числу провалов ИИ-проектов (S003). Компании ожидают, что внедрение ИИ автоматически оптимизирует процессы, увеличит прибыль и решит структурные проблемы, не требуя изменений в организации, данных или стратегии.

🔬 Реальность: ИИ — это усилитель существующих процессов, а не их замена

Blue Prism подчёркивает: эффективность ИИ напрямую зависит от качества интеграции в существующие рабочие процессы и соответствия стратегическим целям организации (S001). ИИ не создаёт стратегию — он исполняет её быстрее и в большем масштабе.

Launch Consulting приводит критический факт: ИИ процветает на данных, и без качественных, структурированных, релевантных данных любая система будет выдавать бесполезные или вредные результаты (S003). Исследование показывает, что 70% неудачных ИИ-проектов провалились не из-за технологии, а из-за плохой подготовки данных и отсутствия чёткой бизнес-цели.

- Качество данных определяет качество результата — мусор на входе = мусор на выходе.

- Стратегическая цель должна быть сформулирована ДО выбора технологии, а не после.

- Интеграция с существующими процессами требует переработки workflow, а не просто добавления нового инструмента.

📊 Цена иллюзии: три категории потерь от веры в магическое решение

Первая категория — прямые финансовые потери от неоправданных инвестиций. Компании тратят средства на внедрение ИИ-решений без предварительного аудита процессов, получают систему, которая автоматизирует неэффективные операции, и удивляются отсутствию ROI (S001).

Вторая — упущенные возможности: пока организация ждёт «магии», конкуренты методично внедряют ИИ в конкретные, хорошо подготовленные процессы и получают реальное преимущество (S003). Третья — репутационный ущерб: провал громкого ИИ-проекта создаёт внутреннее сопротивление технологии на годы вперёд (S004).

Провал ИИ-проекта — это не просто потраченные деньги. Это потеря доверия к технологии внутри организации и замораживание всех последующих инициатив, даже если они обоснованы.

⚙️ Механизм заблуждения: почему маркетинг ИИ-вендоров усиливает миф

Arion Research указывает на роль поставщиков ИИ-решений в поддержании этого мифа (S004). Маркетинговые материалы часто обещают «трансформацию за 90 дней», «автоматизацию без программирования» и «немедленный ROI», умалчивая о необходимости подготовки данных, обучения персонала, итеративной настройки моделей и интеграции с legacy-системами.

Это не обман в юридическом смысле, но создание нереалистичных ожиданий, которые гарантируют разочарование. ProfileTree отмечает: компании, успешно внедрившие ИИ, потратили в среднем 6–18 месяцев на подготовку инфраструктуры до запуска первого продуктивного алгоритма (S008).

Ср. также: ИИ в медицине: как отличить прорыв от маркетинга и ChatGPT и волна ИИ-прорывов: где кончается реальность и начинается маркетинговый шум.

Миф второй: «ИИ полностью заменит человеческие рабочие места и сделает большинство профессий ненужными»

Этот миф — самый эмоционально заряженный и политически используемый. Blue Prism называет его «мифом о тотальной замене» и отмечает, что он блокирует внедрение ИИ сильнее, чем любые технические ограничения (S001). Страх потери работы создаёт сопротивление на всех уровнях организации, от рядовых сотрудников до профсоюзов и регуляторов.

🧪 Данные против страха: что показывают исследования о реальном влиянии ИИ на занятость

Всемирный экономический форум прогнозирует создание 97 миллионов новых рабочих мест к 2025 году (S011). Это не означает отсутствие потерь — некоторые позиции действительно исчезнут, — но общий баланс положительный.

Основное влияние ИИ — трансформация существующих ролей, а не их устранение (S004). Рутинные операции автоматизируются, освобождая время для аналитики, принятия решений и творческой работы.

ИИ не заменяет людей — он усиливает человеческий потенциал. ИИ превосходен в обработке больших массивов данных и выполнении повторяющихся операций, но критически зависит от человеческого контекста, этической оценки и стратегического мышления (S003).

🧬 Новые роли: какие профессии создаёт ИИ и почему их больше, чем кажется

Прямые роли, созданные ИИ-индустрией: специалисты по ИИ, data scientists, инженеры машинного обучения, специалисты по этике ИИ, аудиторы алгоритмов (S011).

Косвенные роли расширяют спектр: менеджеры по трансформации процессов, специалисты по подготовке данных, тренеры ИИ-моделей, интерпретаторы результатов для бизнеса, дизайнеры человеко-машинных интерфейсов (S010).

- Юристы по ИИ-регулированию

- Психологи, изучающие взаимодействие человека и ИИ

- Специалисты по обнаружению и устранению алгоритмических предвзятостей (S008)

⚠️ Реальная угроза: не замена, а неготовность к трансформации

Опасность не в том, что ИИ заберёт работу, а в том, что работники и организации не подготовятся к изменениям (S009). Компании, которые не инвестируют в переквалификацию персонала, столкнутся с кризисом занятости — не потому что ИИ заменил людей, а потому что люди не получили навыков для работы с ИИ.

Успешные организации используют ИИ для upskilling сотрудников и создания новых ролей, фокусирующихся на сотрудничестве с ИИ-технологиями (S004). Это стратегический выбор, а не технологическая неизбежность.

Миф третий: «Все ИИ-технологии одинаковы — это просто разные названия одного и того же»

Это заблуждение особенно опасно для бизнес-лидеров, принимающих решения об инвестициях. Arion Research называет его «мифом о монолитности ИИ» и отмечает, что он приводит к выбору неподходящих технологий для конкретных задач (S004). Руководители думают об ИИ как о единой технологии, но на самом деле это зонтичный термин, охватывающий широкий спектр методов, инструментов и возможностей с различными применениями и ограничениями.

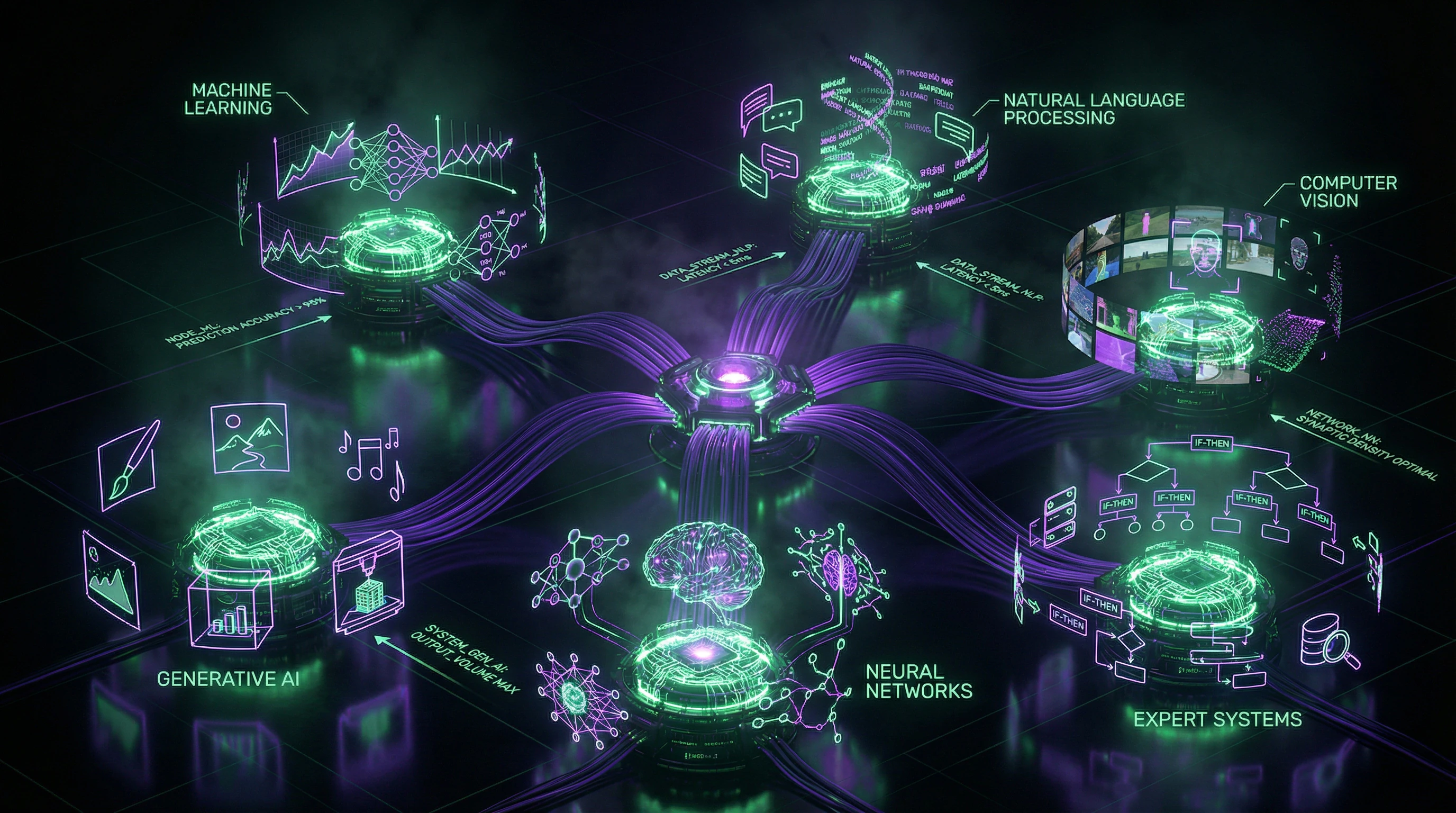

🔎 Таксономия реальности: шесть основных категорий ИИ

Arion Research выделяет ключевые категории: машинное обучение (ML), обработка естественного языка (NLP), компьютерное зрение, генеративный ИИ, нейронные сети и экспертные системы (S004). Каждая категория решает специфические задачи и требует разных данных, инфраструктуры и экспертизы.

| Категория | Основная задача | Входные данные | Выход |

|---|---|---|---|

| Машинное обучение (ML) | Предсказательная аналитика, классификация | Структурированные числовые данные | Вероятность, класс, оценка |

| NLP | Работа с текстом и речью | Текст, аудио | Смысл, классификация, перевод |

| Компьютерное зрение | Анализ изображений и видео | Изображения, видеопоток | Объекты, координаты, аномалии |

| Генеративный ИИ | Создание контента | Текстовые подсказки, примеры | Текст, изображения, код |

| Нейронные сети | Распознавание сложных паттернов | Многомерные данные | Скрытые представления, предсказания |

| Экспертные системы | Формализованное принятие решений | Факты, правила домена | Решение с объяснением |

📊 Практические последствия: как неправильный выбор убивает проект

Типичная ошибка: компания выбирает генеративный ИИ для задачи, требующей точной классификации, и получает креативные, но неточные результаты (S012). Организация внедряет глубокое обучение для простой регрессии, переплачивая за вычислительные ресурсы и получая модель, которую невозможно интерпретировать.

Другой сценарий: бизнес пытается использовать NLP-модель, обученную на английском, для анализа специализированной технической документации на другом языке и удивляется низкому качеству (S012). Blue Prism подчёркивает: генеративный ИИ подходит для решения значительных задач, особенно в автоматизации и повышении эффективности legacy и современных систем, но это не универсальное решение (S001).

Выбор неправильной категории ИИ — это не техническая ошибка, а стратегическая. Она приводит к потере инвестиций, разочарованию команды и дискредитации ИИ в организации.

🧰 Критерии выбора: пять вопросов для определения подходящей категории

- Природа входных данных: структурированные числа, текст, изображения, временные ряды?

- Тип выхода: классификация, предсказание, генерация, оптимизация?

- Требования к интерпретируемости: нужно ли объяснять каждое решение или достаточно общей точности?

- Ограничения по ресурсам: какие вычислительные мощности и время обучения доступны?

- Доступность данных: сколько размеченных примеров есть для обучения?

Launch Consulting отмечает: ответы на эти пять вопросов определяют подходящую категорию ИИ с точностью 80–90% (S003). Пропуск этого анализа — главная причина провалов внедрения.

Миф четвёртый: «Внедрение ИИ слишком дорого и сложно для нашей организации»

Этот миф блокирует внедрение ИИ в малом и среднем бизнесе, создавая конкурентное преимущество для крупных корпораций. Arion Research называет его «мифом о недоступности» и отмечает, что он основан на устаревших представлениях о стоимости и сложности ИИ-технологий (S004).

Реальность изменилась за последние пять лет благодаря облачным вычислениям и предобученным моделям (S004). Достижения в облачных вычислениях и доступность предобученных ИИ-моделей сделали ИИ более доступным, чем когда-либо (S004).

🔬 Революция доступности: как облачные платформы изменили экономику ИИ

Многие облачные ИИ-инструменты предлагают низкий порог входа и масштабируемость, подходящую как для малого, так и для крупного бизнеса (S004). Launch Consulting подчёркивает: благодаря облачным вычислениям и open-source фреймворкам ИИ, организации любого размера могут получить доступ к ИИ-решениям за долю исторической стоимости (S003).

Blue Prism добавляет: теперь большинство организаций могут извлечь выгоду из ИИ без высоких затрат (S001).

📊 Реальная стоимость: три модели ценообразования и их применимость

ProfileTree выделяет три основные модели доступа к ИИ (S008).

- Облачные API с оплатой по использованию: компания платит только за фактические запросы к модели, без инвестиций в инфраструктуру. Стоимость начинается от центов за тысячу запросов для базовых моделей.

- Предобученные модели с fine-tuning: организация берёт готовую модель (часто бесплатную или недорогую) и дообучает её на своих данных. Затраты — в основном на вычислительные ресурсы для обучения, которые можно арендовать временно.

- Полностью кастомные решения: разработка с нуля, требующая команды специалистов и значительных инвестиций. Эта модель нужна только для уникальных задач, где готовые решения не работают.

Большинство бизнес-задач решаются первыми двумя моделями (S008).

⚙️ Скрытая сложность: где действительно возникают проблемы

Bernard Marr (Forbes) указывает на реальные источники сложности: не сама технология ИИ, а интеграция с существующими системами, управление изменениями в организации и обеспечение качества данных (S010). Launch Consulting подтверждает: барьер стоимости не так высок, как раньше, но барьер организационной готовности остаётся значительным (S003).

Компании недооценивают необходимость обучения персонала, реинжиниринга процессов и создания культуры, поддерживающей экспериментирование с ИИ (S003). Это не технический, а организационный вызов — и именно здесь скрыта реальная цена внедрения.

| Барьер | Природа проблемы | Стратегия преодоления |

|---|---|---|

| Стоимость технологии | Переоценена; облачные решения дешевы | Начните с облачных API, платите по использованию |

| Интеграция с системами | Требует переработки процессов | Пилотные проекты на изолированных задачах |

| Компетенции команды | Недостаток знаний, не нехватка людей | Обучение существующих сотрудников, не найм экспертов |

| Культура организации | Страх перед неудачей, консерватизм | Поддержка экспериментирования, прозрачность результатов |

Arion Research рекомендует: начинайте с пилотных проектов малого масштаба, используйте готовые облачные решения и инвестируйте в построение ИИ-компетенций среди существующих сотрудников, а не в найм дорогих внешних экспертов (S004).

Если вас интересует, как отличить реальные прорывы от маркетингового шума в смежных областях, см. ИИ в медицине: как отличить прорыв от маркетинга. Подробнее — в разделе Дипфейки.

Миф пятый: «ИИ полностью объективен и свободен от предвзятости, в отличие от людей»

Это один из самых опасных мифов, потому что он создаёт ложное чувство безопасности. Blue Prism называет его «мифом о машинной объективности» и предупреждает: ни одна система не может быть полностью объективной, так же как ни один человек не может быть не подвержен влиянию окружающего мира (S001). ИИ наследует и часто усиливает предвзятости, присутствующие в обучающих данных (S001).

Алгоритм — это не судья, а зеркало. Если в зеркало смотрит предвзятое общество, отражение будет предвзятым.

🧬 Механизм предвзятости: как человеческие искажения кодируются в алгоритмах

Фундаментальная проблема проста: ИИ-модели обучаются на данных, и человеческие предвзятости могут изначально существовать в этих данных (S004). Если исторические данные о найме показывают предпочтение определённым демографическим группам, ИИ-система, обученная на этих данных, будет воспроизводить и усиливать эту предвзятость (S004).

Blue Prism добавляет: несправедливые ИИ-предвзятости возникают, когда ИИ-приложение разрабатывается с присущими человеческими предубеждениями (S001). Алгоритмы ИИ должны регулярно обновляться и проходить аудит для избежания предвзятостей и обеспечения точности (S011).

🔬 Документированные случаи: три категории алгоритмической дискриминации

ProfileTree классифицирует типы предвзятости ИИ (S008):

- Предвзятость в данных: обучающий набор не репрезентативен для реальной популяции. Система распознавания лиц, обученная преимущественно на изображениях одной расовой группы, показывает низкую точность для других групп (S008).

- Предвзятость в дизайне алгоритма: выбор метрики оптимизации или архитектуры модели неявно фаворизирует определённые результаты. Система кредитного скоринга, оптимизированная только на минимизацию дефолтов, может систематически отказывать группам с меньшей кредитной историей, даже если они платёжеспособны (S008).

- Предвзятость в интерпретации: результаты ИИ используются без учёта контекста. Система предсказания рецидивизма, чьи оценки риска используются механически, без учёта социальных факторов (S008).

Каждая категория требует разных подходов к обнаружению и исправлению. Игнорирование любой из них приводит к систематической дискриминации, замаскированной под «объективность».

🛡️ Протокол защиты: пять обязательных практик для минимизации предвзятости

| Практика | Что делает | Почему критично |

|---|---|---|

| Разнообразие обучающих данных | Активный поиск и включение данных из недопредставленных групп (S004) | Без этого модель слепа к целым сегментам реальности |

| Регулярный мониторинг на предвзятость | Автоматизированные тесты, проверяющие различия в производительности для разных демографических групп (S004) | Предвзятость не видна, пока её не измеришь |

| Адаптивность | Готовность корректировать систему при обнаружении проблем (S004) | Статичный алгоритм деградирует по мере изменения реальности |

| Защитные механизмы (guardrails) | Предотвращение проблем; отмечание несправедливого поведения (S001) | Система должна уметь сказать «нет» себе |

| Прозрачность решений | Аудиторы и пользователи понимают, почему система приняла конкретное решение (S011) | Чёрный ящик — это не объективность, это безответственность |

Эти практики не гарантируют идеальность, но они превращают ИИ из чёрного ящика в систему, которую можно аудировать, критиковать и улучшать. Это единственный путь к ответственному использованию.

Подробнее о том, как маркетинг скрывает реальные ограничения технологий, см. статью об ИИ в медицине и анализ волны ИИ-прорывов. Подробнее — в разделе Обнаружение дипфейков.

Миф шестой: «ИИ не требует ничего, кроме данных — просто загрузите информацию и получите результат»

Это упрощение игнорирует критическую важность качества, релевантности и управления данными (S001). Грязные данные — мусор на входе, мусор на выходе.

ИИ-система работает не с информацией вообще, а с конкретными паттернами в конкретных наборах. Если данные содержат ошибки, пропуски, устаревшие записи или смещение выборки — модель научится воспроизводить эти дефекты с математической точностью. Подробнее — в разделе Статистика и теория вероятностей.

Качество данных определяет потолок качества результата. Никакой алгоритм не может извлечь сигнал из шума, если шум — это всё, что вы ему дали.

Второй слой: данные нужно подготовить. Это означает нормализацию, кодирование категорий, обработку пропусков, удаление выбросов, балансировку классов (если нужно). Каждый шаг — решение, которое влияет на результат.

Третий слой: релевантность. Данные о продажах кофе не помогут предсказать спрос на электроэнергию. Нужно понимать, какие переменные действительно связаны с целевым явлением, а какие — шум или артефакт корреляции.

- Аудит источников данных: откуда они, как собирались, кто их проверял

- Проверка полноты: есть ли пропуски, как они распределены, почему они возникли

- Анализ смещений: репрезентативна ли выборка, или она отражает только часть реальности

- Валидация релевантности: связаны ли признаки с целью или это ложная корреляция

- Мониторинг дрейфа: меняются ли паттерны в данных со временем

Четвёртый слой: управление. Данные нужно версионировать, документировать, контролировать доступ, обновлять. Если вы загрузили датасет год назад и забыли о нём — модель работает на мёртвых данных.

Пятый слой: этика и регуляция. Если данные содержат информацию о защищённых категориях (раса, пол, здоровье), нужно понимать, как это влияет на справедливость результатов (S005). Это не техническая проблема — это проблема ответственности.

«Просто загрузите данные» — это как сказать хирургу: «Просто возьмите скальпель». Инструмент есть, но без диагноза, подготовки и опыта результат будет катастрофой.

Реальная стоимость: подготовка данных часто занимает 60–80% времени проекта. Это не баг, это фича. Организации, которые это понимают, получают работающие системы. Те, что игнорируют, получают дорогие неудачи.