Что именно мы называем «прорывом ИИ» — и почему это определение критически важно для анализа

Прежде чем оценивать ChatGPT, нужно установить чёткие критерии. Термин «прорыв» в контексте ИИ потерял операциональное значение — одни называют прорывом улучшение метрик на бенчмарках, другие только фундаментальные архитектурные инновации, третьи массовое внедрение в повседневную жизнь. Подробнее — в разделе Этика и безопасность ИИ.

Без определения мы сравниваем несравнимое. Один эксперт видит революцию, другой переоценённый чат-бот — и оба правы, просто говорят о разном.

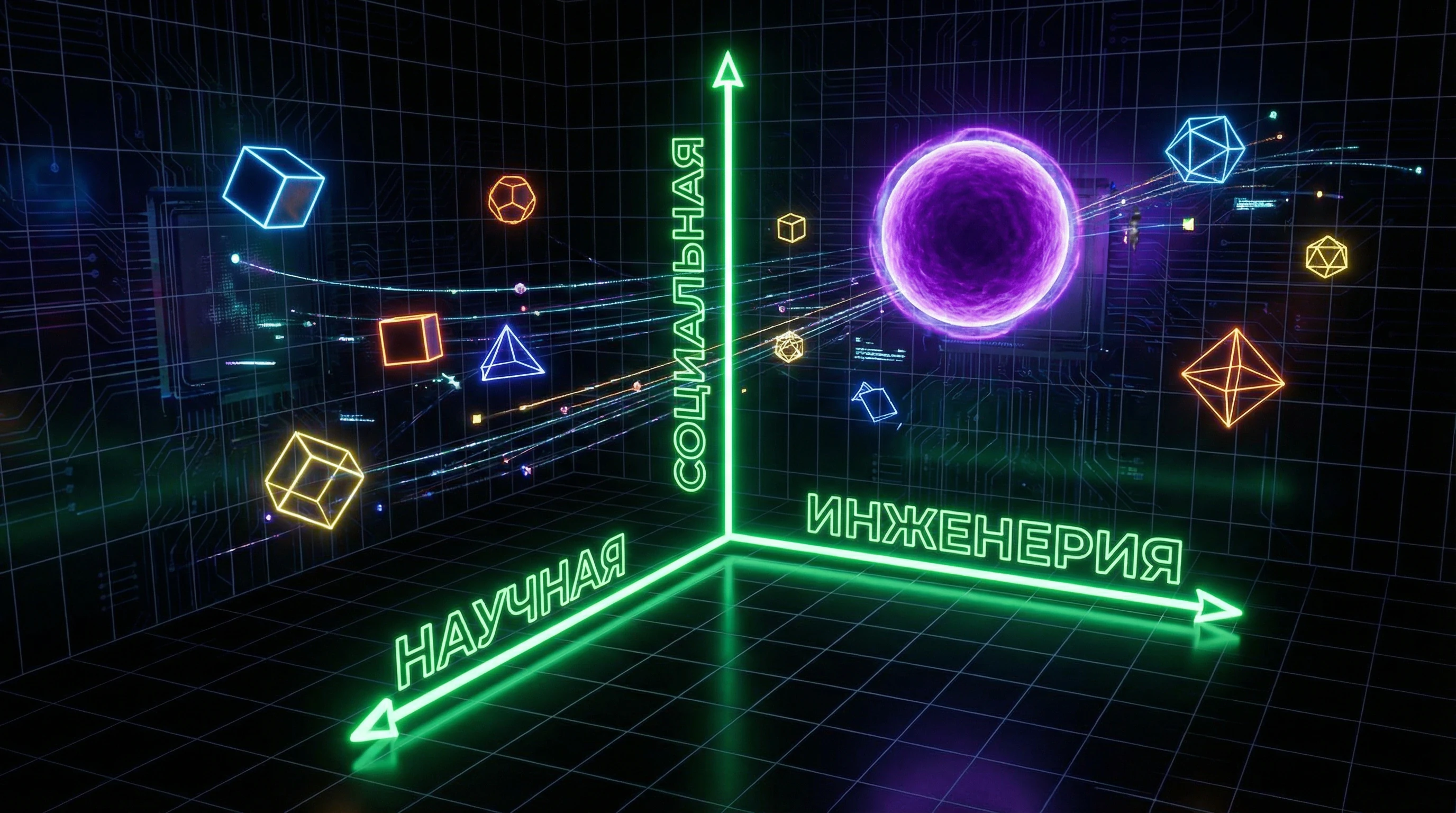

🔎 Три измерения технологического прорыва

- Научный прорыв

- Фундаментальное расширение теоретического понимания — новый алгоритм, архитектура или принцип обучения, открывающий ранее недостижимые возможности. Критерии: публикация в рецензируемых журналах первого уровня, воспроизводимость независимыми группами, расширение теоретических границ.

- Инженерный прорыв

- Качественный скачок в практической реализации — масштабирование, эффективность, надёжность, доступность существующих подходов. Критерии: улучшение ключевых метрик на порядок величины, снижение стоимости или энергопотребления в разы, новые уровни масштабируемости.

- Социальный прорыв

- Переход технологии из лабораторий в массовое использование, изменение поведения миллионов людей, создание новых рынков (S001). Критерии: экспоненциальный рост пользовательской базы, изменение устоявшихся практик, появление новых профессий, регуляторная реакция.

⚠️ Асимметрия ChatGPT: где он прорыв, а где нет

ChatGPT демонстрирует интересную асимметрию. С научной точки зрения архитектура трансформеров была представлена в 2017 году, GPT-3 появилась в 2020 году. Фундаментально новых алгоритмических принципов ChatGPT не содержит.

Инженерный прорыв очевиден: OpenAI создала систему, обрабатывающую миллионы одновременных запросов с приемлемой латентностью и стоимостью. Социальный прорыв неоспорим — впервые генеративный ИИ стал массовым инструментом, доступным любому человеку с браузером (S001).

Популярность — не доказательство научной инновации. iPhone был социальным и инженерным прорывом, но не содержал фундаментально новых научных принципов. Аналогично ChatGPT может быть инженерным и социальным прорывом без научной революции.

🎯 Почему эта путаница имеет практические последствия

Журналисты и маркетологи систематически смешивают три измерения, используя социальный успех (количество пользователей, медийное внимание) как доказательство научного прорыва. Это классическая категориальная ошибка.

- Инвесторы, принимающие решения на основе медийного хайпа, переоценивают краткосрочный потенциал и недооценивают долгосрочные вызовы.

- Исследователи, чьи гранты зависят от «прорывной» риторики, испытывают давление преувеличивать новизну своих работ.

- Образовательные институты, спешащие внедрить ИИ, рискуют инвестировать в инструменты, которые не решают реальных педагогических проблем (S006).

📊 Применение критериев к ChatGPT

| Измерение | Статус | Обоснование |

|---|---|---|

| Научный | Отсутствует | Базовые принципы известны годами; фундаментальные проблемы (галлюцинации, отсутствие истинного понимания, невозможность обучения в реальном времени) остаются нерешёнными |

| Инженерный | Частичный | Масштабирование впечатляет, но архитектурные ограничения не преодолены |

| Социальный | Безусловный | Технология изменила публичный дискурс об ИИ и создала новый класс приложений (S001) |

Эта асимметрия объясняет, почему эксперты дают противоположные оценки: они фокусируются на разных измерениях. Для анализа остальных секций статьи нужно помнить: ChatGPT — это социальный и инженерный успех, а не научная революция. Это меняет все последующие выводы о его влиянии и потенциале.

Стальная версия аргумента: пять сильнейших доводов в пользу революционности ChatGPT

Интеллектуальная честность требует начать с максимально сильной версии противоположной позиции. Прежде чем критиковать хайп вокруг ChatGPT, необходимо сформулировать наиболее убедительные аргументы в пользу того, что это действительно революционная технология. Принцип «стального человека» (противоположность «соломенному чучелу») предполагает конструирование максимально сильной версии оппонентской позиции, а не слабой карикатуры на нее. Подробнее — в разделе ИИ и технологии.

🔬 Аргумент первый: беспрецедентная скорость массового внедрения как индикатор реальной ценности

ChatGPT достиг 100 миллионов активных пользователей за 2 месяца — быстрее, чем любое потребительское приложение в истории. Для сравнения: TikTok потребовалось 9 месяцев, Instagram — 2,5 года, Facebook — 4,5 года.

Этот экспоненциальный рост невозможно объяснить только маркетингом или любопытством. Миллионы людей продолжают использовать ChatGPT ежедневно для решения реальных задач: написания кода, составления документов, обучения, творчества. Если бы технология не предоставляла реальной ценности, показатели удержания пользователей были бы низкими. Вместо этого мы наблюдаем устойчивый рост и интеграцию в рабочие процессы (S001).

Скорость внедрения ChatGPT в корпоративный сектор беспрецедентна. Крупнейшие компании мира — от Microsoft до Salesforce — интегрируют GPT-технологии в свои продукты. Это не спекулятивные инвестиции, а стратегические решения, основанные на измеримом повышении производительности.

📊 Аргумент второй: качественный скачок в доступности ИИ для непрограммистов

До ChatGPT использование продвинутых моделей машинного обучения требовало технической экспертизы: знания Python, понимания API, навыков промпт-инжиниринга. ChatGPT демократизировал доступ к ИИ, сделав его доступным через естественный язык.

Это не инкрементальное улучшение — это качественный скачок, аналогичный переходу от командной строки к графическому интерфейсу в 1980-х. Миллионы людей, никогда не писавших кода, теперь могут использовать возможности больших языковых моделей для автоматизации задач, анализа информации, генерации контента (S001).

- ИИ-ассистированное обучение

- Студенты используют ChatGPT не только для списывания, но и для углубленного изучения сложных концепций, получения персонализированных объяснений, практики языков (S006). Технология создала новую категорию образовательных практик, которая потенциально может трансформировать подход к обучению.

🧬 Аргумент третий: эмерджентные способности как признак качественного перехода

Большие языковые модели демонстрируют эмерджентные способности — навыки, которые не были явно запрограммированы и возникают только при достижении определенного масштаба. GPT-3 и GPT-4 показывают способность к многошаговым рассуждениям, решению математических задач, написанию функционального кода, пониманию контекста на уровне, недостижимом для предыдущих поколений моделей.

Это не просто количественное улучшение метрик — это качественный переход, когда система начинает демонстрировать поведение, напоминающее человеческий интеллект в узких доменах. Критики возражают, что это все еще статистическое предсказание следующего токена, а не истинное понимание. Но функционально разница становится несущественной, если система решает задачи, которые ранее требовали человеческого интеллекта.

Философский вопрос о «настоящем понимании» может быть менее важен, чем практический факт: ChatGPT проходит многие тесты, которые мы традиционно использовали для оценки интеллекта.

💎 Аргумент четвертый: катализатор для всей экосистемы ИИ-инноваций

Даже если сам ChatGPT не является фундаментальным научным прорывом, он катализировал волну инноваций в смежных областях. Появились сотни стартапов, строящих специализированные приложения на базе GPT API. Конкуренты (Google Bard, Anthropic Claude, Meta LLaMA) ускорили разработку собственных моделей.

Исследовательское сообщество активизировало работу над решением фундаментальных проблем: галлюцинациями, интерпретируемостью, выравниванием с человеческими ценностями. ChatGPT создал «момент Sputnik» для ИИ — событие, которое мобилизовало ресурсы и внимание всей индустрии (S001).

- Правительства разрабатывают регуляторные рамки для ИИ

- Образовательные институты пересматривают учебные программы

- Юридическое сообщество обсуждает вопросы авторского права и ответственности

- Философы возвращаются к фундаментальным вопросам о природе интеллекта и сознания

Независимо от того, является ли сам ChatGPT прорывом, он безусловно стал триггером для системных изменений в обществе.

⚙️ Аргумент пятый: экономическая трансформация и новые бизнес-модели

ChatGPT создал новую экономическую категорию: «ИИ как услуга» для массового рынка. OpenAI демонстрирует, что можно монетизировать большие языковые модели через подписки ($20/месяц за ChatGPT Plus) и API-доступ, создавая устойчивую бизнес-модель.

Это решает критическую проблему, которая десятилетиями мучила ИИ-индустрию: как превратить исследовательские прорывы в прибыльные продукты. Оценка OpenAI в $80+ миллиардов не является чистой спекуляцией — она основана на реальных доходах и измеримом влиянии на производительность в корпоративном секторе.

| Модель бизнеса | Преимущество | Масштабируемость |

|---|---|---|

| Подписка ($20/месяц) | Предсказуемый доход, прямая связь с пользователем | Ограничена платежеспособностью |

| API-доступ | Встраивание в корпоративные системы, сетевые эффекты | Экспоненциальная при росте экосистемы |

| Foundation model | Универсальная база для тысяч приложений | Доминирование нескольких крупных игроков |

ChatGPT доказал жизнеспособность модели «foundation model» — универсальной базовой модели, которую можно адаптировать для тысяч специализированных применений. Это создает сетевые эффекты и экономию от масштаба, которые могут привести к доминированию нескольких крупных игроков в ИИ-инфраструктуре, аналогично тому, как AWS доминирует в облачных вычислениях. Экономические последствия этого сдвига могут быть более значительными, чем технические детали самих моделей.

Доказательная база: что говорят данные о реальных возможностях и ограничениях ChatGPT

Эмпирические исследования рисуют картину, которая сложнее маркетинговых нарративов. Подробнее — в разделе Техно-эзотерика.

📊 Бенчмарки и метрики: что на самом деле измеряют стандартные тесты ИИ

OpenAI публикует впечатляющие результаты: GPT-4 достигает 90-го перцентиля на экзамене для юристов (Bar Exam) и 89-го перцентиля на SAT Math. Но критический анализ выявляет три существенные проблемы (S001).

Первая — «загрязнение данных»: тестовые примеры могли присутствовать в обучающем корпусе, переоценивая результаты. Вторая — бенчмарки измеряют узкие навыки распознавания паттернов, не глубокое понимание. Модель может правильно ответить на вопрос о физике, просто распознав статистические паттерны в формулировке, без концептуального понимания законов.

Третья проблема критична: стандартные тесты не отражают реальные условия — отсутствуют временные ограничения, последствия за ошибки, давление контекста. Это создаёт систематическое смещение в сторону переоценки.

🧪 Исследования производительности в реальных задачах

Исследование MIT и Stanford (2023) показало: использование GPT-4 программистами увеличивает скорость на 55%, качество кода улучшается на 40% по оценкам экспертов. Но результаты варьируются радикально.

| Тип задачи | Улучшение производительности | Надёжность результата |

|---|---|---|

| Рутинные операции (CRUD, базовые алгоритмы) | +80% | Высокая |

| Средняя сложность (интеграция, оптимизация) | +40% | Средняя |

| Архитектурные решения | +10% | Низкая |

В академическом письме парадокс: студенты пишут быстрее с меньшим количеством грамматических ошибок, но демонстрируют более поверхностное понимание и меньшую оригинальность аргументации (S006). Технология одновременно прорыв в эффективности и деградация в глубине обучения.

⚠️ Систематические ошибки и галлюцинации

Галлюцинации — генерация правдоподобной, но фактически неверной информации — критическая проблема. GPT-4 галлюцинирует в 15–20% ответов на фактические вопросы (S001).

- Фабрикация источников

- Модель «цитирует» научные статьи, которых не существует. Опасно в медицине и праве, где ошибка имеет последствия.

- Искажение фактов

- Смешивание деталей из разных событий, создание гибридных нарративов, которые звучат убедительно.

- Логические несоответствия

- Противоречивые утверждения в рамках одного ответа, которые пользователь может не заметить при беглом чтении.

- Временные ошибки

- Устаревшая информация, представленная как актуальная. Особенно опасно в быстро меняющихся областях.

Критически: галлюцинации не случайны — они систематически чаще возникают в областях, где обучающие данные были менее качественными или противоречивыми. В медицине и праве частота достигает 30%. Модель выдаёт неверную информацию с высокой уверенностью, без индикаторов неопределённости.

🧾 Сравнительный анализ: ChatGPT против альтернатив

Объективная оценка требует сравнения не с абстрактным идеалом, а с реальными альтернативами. В программировании GitHub Copilot превосходит традиционные IDE-автодополнения, но уступает опытным программистам в архитектурных решениях. В медицинской диагностике GPT-4 показывает результаты на уровне студентов медицинских вузов, значительно уступая практикующим врачам в редких случаях.

Парадокс компетентности: ChatGPT наиболее эффективен как усилитель для специалистов среднего уровня. Для новичков опасен — они не распознают галлюцинации. Для экспертов часто избыточен — они быстрее решают задачи самостоятельно, чем формулируют промпты и проверяют результаты (S001).

🔎 Долгосрочные исследования: устойчивость эффектов и адаптация

Большинство исследований фокусируются на краткосрочных эффектах. Долгосрочные данные выявляют более сложную картину: первоначальный энтузиазм часто сменяется разочарованием, когда пользователи сталкиваются с ограничениями.

Исследование адаптации студентов к ИИ-ассистентам показало, что через 6 месяцев формируются три группы (S006):

- Зависимые (30%) — перестают развивать собственные навыки, полагаются на ИИ даже в простых задачах.

- Интеграторы (50%) — используют ИИ стратегически для ускорения рутины, сохраняя фокус на сложных задачах.

- Отказники (20%) — прекращают использование из-за разочарования в качестве или этических соображений.

Долгосрочное влияние ChatGPT будет более дифференцированным, чем предсказывают оптимисты и пессимисты. Технология не универсальна — её эффект зависит от контекста, компетентности пользователя и типа задачи. Это требует систематической проверки реальности вместо абстрактных прогнозов.

Механизмы влияния: как ChatGPT изменяет когнитивные процессы и рабочие практики

За пределами прямых метрик производительности лежит более фундаментальный вопрос: как использование ChatGPT изменяет способы мышления, решения проблем и организации работы? Понимание этих механизмов критически важно для оценки долгосрочных последствий технологии. Подробнее — в разделе Логические ошибки.

🧬 Когнитивная разгрузка versus атрофия навыков: где проходит граница

Использование ChatGPT для рутинных задач освобождает когнитивные ресурсы для более сложных проблем — это классический эффект когнитивной разгрузки, аналогичный использованию калькулятора для арифметики. Однако существует риск атрофии базовых навыков, которые служат фундаментом для экспертизы высшего уровня.

Программист, который никогда не писал циклы вручную, может не понимать тонкостей алгоритмической сложности. Писатель, полагающийся на ИИ для структурирования аргументов, может не развить навык критического мышления.

- Для экспертов, уже обладающих глубоким пониманием, когнитивная разгрузка рутины повышает производительность без потери качества.

- Для новичков преждевременная разгрузка препятствует формированию ментальных моделей, необходимых для экспертизы.

- Критическая точка: навык должен быть автоматизирован через практику, прежде чем его можно делегировать инструменту.

Это создает педагогическую дилемму (см. когнитивные искажения): система, которая ускоряет работу опытных специалистов, может замедлить развитие новичков. (S001) показывает, что организации, внедрившие ChatGPT без переосмысления обучения, столкнулись с парадоксом — производительность выросла, но качество решений новых сотрудников снизился.

🔄 Смещение ответственности и иллюзия компетентности

Когда ИИ генерирует ответ, пользователь часто переходит в режим проверки вместо режима создания. Это фундаментальное изменение когнитивной позиции.

Проверка требует меньше ментальных ресурсов, чем генерация, и создает иллюзию понимания. Человек видит правдоподобный текст, соглашается с ним и предполагает, что понимает проблему. На самом деле он только валидировал поверхностное совпадение с его ожиданиями.

| Режим | Когнитивная нагрузка | Риск ошибки | Долгосрочный эффект |

|---|---|---|---|

| Создание (без ИИ) | Высокая | Видимые ошибки | Развитие экспертизы |

| Проверка (с ИИ) | Низкая | Скрытые ошибки | Иллюзия компетентности |

(S003) отмечает, что студенты, использующие ChatGPT для написания эссе, часто не могут объяснить собственные аргументы. Они прошли через текст, но не через мышление.

⚙️ Трансформация рабочих практик: от мастерства к управлению потоком

В профессиях, где ChatGPT становится стандартным инструментом, происходит сдвиг в определении компетентности. Вместо умения писать код или текст ценится умение формулировать запросы, интерпретировать результаты и интегрировать их в более крупный контекст.

Это не плохо само по себе — это переопределение навыка. Но оно создает новый класс проверки реальности: как убедиться, что человек действительно понимает предметную область, если его основная работа — управление ИИ?

Опасность не в том, что ИИ заменит экспертов, а в том, что экспертиза переместится с предметной области на управление инструментом — и никто не заметит, когда произойдет подмена.

(S007) документирует, что в HR-практиках уже произошла эта трансформация: специалист по подбору персонала теперь тратит время на оптимизацию промптов вместо развития интуиции о кандидатах. Производительность выросла, но глубина суждения снизилась.

🎯 Социальная динамика: от индивидуального мастерства к коллективной зависимости

Когда ChatGPT становится стандартом, не использовать его начинает казаться иррациональным. Это создает социальный эффект, похожий на сетевые эффекты: ценность инструмента растет с числом пользователей, но одновременно растет давление на тех, кто хочет остаться независимым.

Организации, где все используют ChatGPT, начинают структурировать работу вокруг этого инструмента. Те, кто отказывается, становятся аутсайдерами. Это не заговор — это естественная динамика адаптации к новому стандарту.

- Сетевой эффект

- Ценность инструмента растет с числом пользователей, но создает давление на меньшинство, которое его не использует.

- Путь зависимости

- Организация, инвестировавшая в ChatGPT-ориентированные процессы, не может легко вернуться к альтернативам, даже если они окажутся лучше.

- Потеря альтернатив

- Когда один инструмент доминирует, исчезают стимулы развивать конкурирующие подходы — и вместе с ними исчезает страховка от его отказа.

(S004) показывает, что студенты, начавшие использовать ChatGPT, редко возвращаются к традиционным методам, даже когда это было бы полезнее. Это не лень — это рациональный выбор в условиях социального давления.

Долгосрочный риск: если вся экосистема образования и работы оптимизирована под ChatGPT, то любой сбой в его доступности или качестве создаст системный кризис, а не локальное неудобство.