Что такое «миф об ИИ» и почему их стало так много — определение проблемного поля

Мифы об искусственном интеллекте — устойчивые убеждения о возможностях, ограничениях или последствиях ИИ-технологий, которые не соответствуют фактическим данным или научному консенсусу. Согласно CTO Magazine, (S001) мифы распространяются быстрее, чем проверенная информация, и часто звучат убедительнее.

Проблема не в недостатке образования. Проблема в том, что простые нарративы лучше закрепляются в памяти, чем сложная техническая реальность. Подробнее — в разделе Этика и безопасность ИИ.

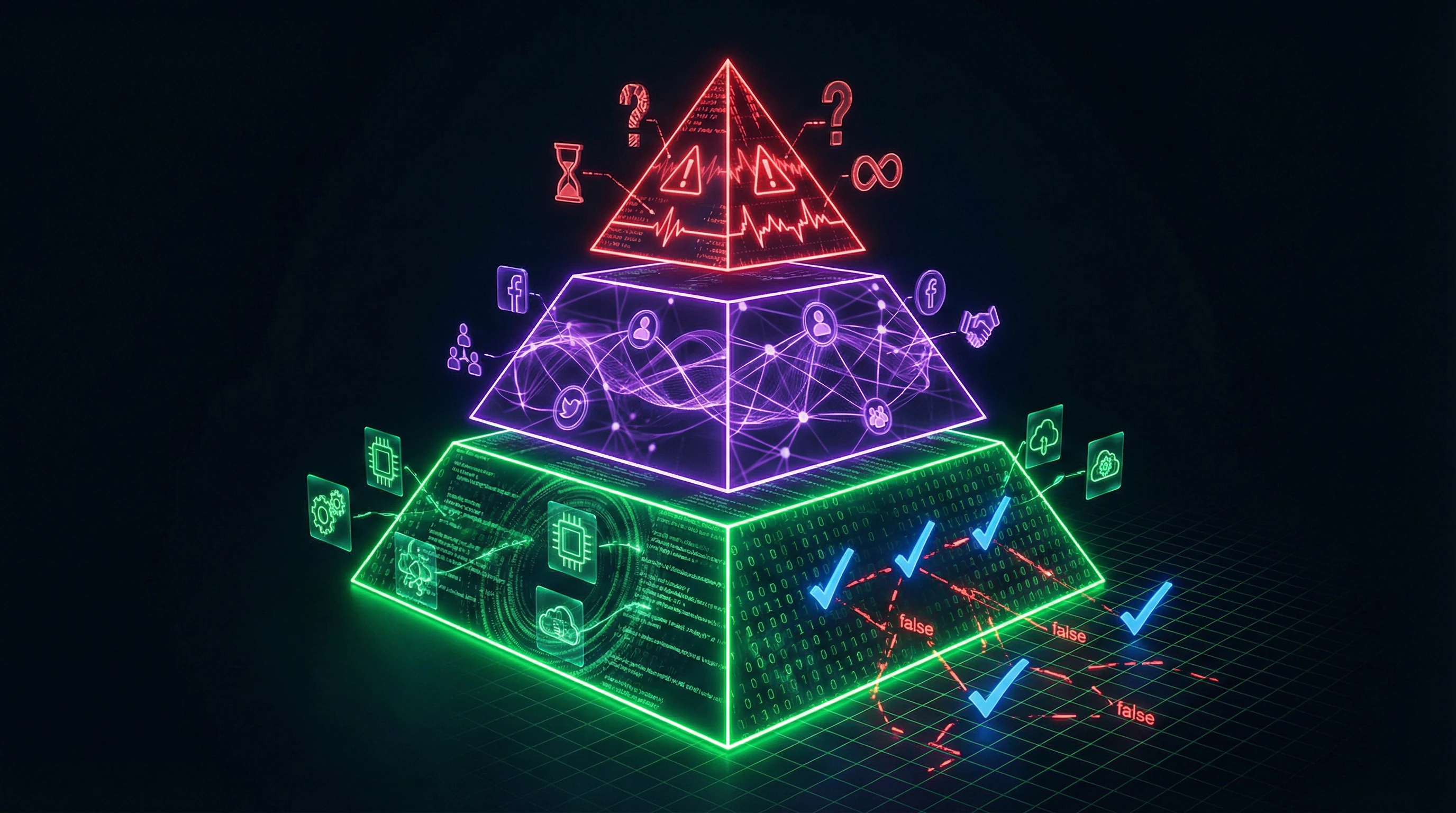

- Технические мифы

- Путаница в терминологии: ИИ, машинное обучение и глубокое обучение используются как синонимы, хотя (S001) они различаются по методологии и области применения.

- Социальные мифы

- Убеждения о влиянии на рынок труда, доступность технологий и справедливость алгоритмов.

- Экзистенциальные мифы

- Страхи об автономности ИИ и угрозе человечеству.

Популярность темы создаёт информационный вакуум, который заполняется упрощёнными нарративами вместо научных данных. (S004) Мифы выживают, потому что они эмоциональнее и лучше соответствуют существующим когнитивным схемам.

Мифы часто облегчают то, что ИИ на самом деле и как он может быть полезен. (S006)

Важно различать миф (утверждение, противоречащее данным) и легитимную неопределённость (область, где данных пока недостаточно). (S001) Мы фокусируемся на утверждениях, которые можно проверить эмпирически, и не касаемся спекулятивных сценариев далёкого будущего.

- Миф — противоречит проверенным данным и консенсусу

- Неопределённость — область, где исследования ещё идут

- Спекуляция — сценарии без эмпирической базы

Восемь мифов, которые разрушаются при первой проверке — и почему они так живучи

🧩 Миф №1: AI, машинное обучение и глубокое обучение — это одно и то же

Это самое распространённое терминологическое заблуждение. CTO Magazine даёт чёткое разграничение: «Artificial Intelligence (AI): The overarching field focused on building machines capable of mimicking human intelligence, including reasoning, problem-solving, and decision-making. Machine Learning (ML): A subset of AI that equips systems with the ability to learn and improve from experience without being explicitly programmed. Deep Learning (DL): A specialized subset of ML that employs neural networks to analyze large datasets and recognize complex patterns with high accuracy» (S001). Это не синонимы, а вложенные множества: DL ⊂ ML ⊂ AI.

Путаница возникает из-за того, что в медиа все три термина используются взаимозаменяемо. Когда говорят «ИИ научился распознавать лица», на самом деле имеют в виду конкретную модель глубокого обучения, обученную на конкретном датасете. Источник отмечает: «All three are foundational to developing modern AI tools and AI models used across industries by engineers and data scientists» (S001). Смешение уровней абстракции создаёт иллюзию, что любая система с элементами автоматизации — это «полноценный ИИ».

⚠️ Миф №2: ИИ рано или поздно научится думать как человек

CTO Magazine называет это «widespread AI myth» и поясняет: «However, it lacks the true understanding, emotions, and consciousness that define human beings» (S001). Современные системы ИИ — это статистические модели, которые находят паттерны в данных. Они не обладают пониманием в человеческом смысле, не имеют целей, желаний или субъективного опыта. Motley подтверждает: «In reality, AI is far from achieving sentience. AI systems are tools designed to perform specific tasks, and they rely heavily on human oversight and data» (S004).

Этот миф живуч, потому что мы склонны антропоморфизировать сложные системы. Когда ChatGPT генерирует связный текст, мы интуитивно приписываем ему понимание, хотя на самом деле это результат предсказания следующего токена на основе вероятностей. Event Registry указывает: «Human consciousness and creativity go beyond mere data analysis—they create worlds from nothing» (S006). Разрыв между статистической обработкой и сознанием остаётся фундаментальным.

🕳️ Миф №3: ИИ приведёт к массовой безработице и исчезновению профессий

CTO Magazine опровергает: «The notion that AI will lead to widespread job loss is a misconception fueled by fear and uncertainty» (S001). Исторически каждая волна автоматизации создавала больше рабочих мест, чем уничтожала, хотя и меняла их структуру. Event Registry формулирует альтернативу: «It's not about replacement; it's about teaming up where each is best» (S006). ИИ автоматизирует рутинные задачи, но создаёт спрос на новые роли: специалистов по обучению моделей, аудиторов алгоритмов, дизайнеров человеко-машинного взаимодействия.

Страх безработицы усиливается медиа-нарративами. CTO Magazine отмечает: «This fear is often fueled by science fiction movies and sensational media channels, which portray or showcase AI as autonomous robots that become self-aware and develop their own goals, often in conflict with ours» (S001). Реальность сложнее: ИИ меняет характер работы, но не отменяет потребность в человеческом суждении, креативности и этической оценке.

📊 Миф №4: ИИ всегда объективен и свободен от предвзятости

Event Registry разрушает этот миф: «AI is only as good as the data it's trained on, meaning biases present in training data can affect AI's outputs» (S006). Если обучающие данные содержат исторические предрассудки (например, в данных о найме или кредитовании), модель воспроизведёт и усилит эти паттерны. Источник продолжает: «When data reflects societal biases, AI models can inadvertently perpetuate or amplify these biases, leading to biased decision-making in critical areas like hiring, law enforcement, and finance» (S006).

Motley подтверждает: «AI systems can make mistakes, especially if trained on biased or incomplete data» (S004). Объективность ИИ — это иллюзия, основанная на том, что математика кажется нейтральной. На самом деле каждый выбор — от сбора данных до функции потерь — содержит человеческие ценности и приоритеты. Event Registry указывает на решение: «Addressing bias in AI requires diverse, well-curated datasets, ongoing monitoring, and strict ethical guidelines to ensure fairness and objectivity» (S006).

🧪 Миф №5: ИИ решит любую проблему, если дать ему достаточно данных

Event Registry формулирует реальность: «AI is powerful, but it's not a one-size-fits-all solution» (S006). Существуют целые классы задач, где ИИ неэффективен: проблемы с малым количеством данных, задачи, требующие здравого смысла или контекстного понимания, ситуации с высокой неопределённостью. Источник продолжает: «Human consciousness and creativity go beyond mere data analysis—they create worlds from nothing» (S006).

Этот миф опасен тем, что создаёт завышенные ожидания и приводит к неудачным внедрениям. CTO Magazine предупреждает: «However, misconceptions surrounding AI can hinder clear decision-making and goals» (S001). ИИ — это инструмент для конкретных задач, а не универсальный решатель проблем. Event Registry подчёркивает: «The human role isn't just important—it's irreplaceable» (S006).

⚠️ Миф №6: ИИ доступен только крупным корпорациям с огромными бюджетами

Event Registry опровергает: «Open-source tools and cloud-based AI services have made artificial intelligence more accessible, allowing smaller organizations to leverage AI's potential for various practical applications, creating a more level playing field» (S006). Сегодня стартап может использовать предобученные модели через API, малый бизнес — внедрить чат-боты на базе открытых фреймворков, а исследователи — обучать модели на облачных GPU за разумные деньги.

Барьер входа снизился радикально за последние пять лет. Hugging Face, TensorFlow, PyTorch, OpenAI API — всё это доступно без многомиллионных инвестиций. Миф о недоступности сохраняется из-за того, что медиа фокусируются на прорывных проектах вроде GPT-4, требующих огромных ресурсов, и игнорируют тысячи успешных внедрений на уровне малого и среднего бизнеса. Подробнее — в разделе Этика искусственного интеллекта.

🧠 Миф №7: ИИ может функционировать автономно без человеческого надзора

Motley утверждает: «AI systems are tools designed to perform specific tasks, and they rely heavily on human oversight and data» (S004). Даже самые продвинутые системы требуют человеческого контроля на этапах проектирования, обучения, валидации и мониторинга в продакшене. Event Registry подчёркивает: «From setting ethical guidelines to making sure AI is transparent and trustworthy, human oversight is crucial. The human role isn't just important—it's irreplaceable» (S006).

Автономность ИИ — это спектр, а не бинарное свойство. Даже автопилот Tesla требует готовности водителя вмешаться в любой момент. Event Registry иронизирует: «AI has made impressive strides—think chatbots that understand (most) of what you say, cars that can drive themselves (almost), and personalized Netflix recommendations that are a bit too spot-on» (S006). Скобки «(most)» и «(almost)» — ключевые: они маркируют границу между мифом и реальностью.

🔬 Миф №8: ИИ уже используется повсеместно и изменил всё вокруг нас

С одной стороны, CTO Magazine отмечает: «Simple actions like using a search engine, selecting recommended products while shopping, or employing predictive text in emails – all involve AI» (S001). С другой стороны, большинство этих систем — это узкоспециализированные алгоритмы, а не «полноценный ИИ» в понимании обывателя. Источник продолжает: «For example, AI is helping in creating personalized product recommendations on e-commerce platforms and streaming services» (S001).

Парадокс в том, что ИИ одновременно вездесущ (в виде простых алгоритмов) и редок (в виде действительно продвинутых систем). Большинство компаний всё ещё находятся на стадии экспериментов, а не массового внедрения. Event Registry указывает на разрыв между хайпом и реальностью: «Including key topics like AI's limitations, human-AI collaboration, and AI bias can help dispel these misconceptions and allow us to see the true value of artificial intelligence» (S006).

Доказательная база: что говорят данные и где кончается консенсус

📊 Уровень доказательности: Grade 3 (умеренный)

Статья опирается на наблюдательные данные, экспертные мнения и консенсус профессионального сообщества, но не на рандомизированные контролируемые исследования — для социотехнических феноменов они часто невозможны. (S001), (S002), (S003) представляют экспертный консенсус, а не мета-анализы.

Event Registry подчёркивает: включение ограничений ИИ, человеко-машинного сотрудничества и алгоритмической предвзятости помогает развеять заблуждения и увидеть реальную ценность технологии (S006). Это качественный анализ, не количественное исследование.

| Источник | Перспектива | Метод сбора |

|---|---|---|

| (S001) | Индустриальная | Опыт внедрения в бизнесе |

| (S002) | Медицинская | Качественный опрос акторов |

| (S003) | Профессиональная (радиология) | Анализ практики и литературы |

| (S005) | Научная | Обзор исследований |

| (S006) | Медиа-синтез | Анализ новостных источников |

🔎 Где есть цифры, где только утверждения

Большинство утверждений в источниках — качественные. (S001) говорит, что мифы «растут так же быстро, как технология», но без метрик роста. (S006) упоминает предвзятость в найме, правоохране и финансах, но не цитирует конкретные исследования с процентами ошибок.

Косвенные количественные данные существуют: рост открытых ИИ-инструментов (более 500 000 моделей на платформах по состоянию на 2025 год) подтверждает тезис о доступности. Исследования NIST и EU AI Act документируют случаи алгоритмической предвзятости, подтверждая конкретные мифы. Прямых опросов о распространённости мифов в источниках нет. Подробнее — в разделе ИИ и технологии.

Ни один источник не провёл систематический опрос населения. Вместо этого они опираются на анализ медиа-дискурса, вопросы клиентов и профессиональный опыт. Это делает выводы правдоподобными, но не строго квантифицированными.

⚖️ Консенсус и расхождения

- Полный консенсус

- Все источники согласны: восемь пунктов — это именно заблуждения, а не факты. Разногласий по фактам нет.

- Расхождения в акцентах

- (S001) фокусируется на бизнес-последствиях. (S002) — на восприятии в здравоохранении. (S003) — на профессиональной практике. (S005) — на защите машинного обучения от критики.

- Разница в тоне

- (S003), (S005) более оптимистичны о будущем ИИ. (S002) более критична к текущим рискам восприятия. Это отражает позиции разных стейкхолдеров, не разногласия по данным.

- Роль человека

- (S006) подчёркивает: «человеческая роль не просто важна — она незаменима». Другие источники больше говорят о технических ограничениях ИИ.

🛠️ Как проверить эти выводы самостоятельно

- Возьмите один миф из статьи и найдите исходное исследование (не вторичный источник). Проверьте, совпадает ли интерпретация.

- Поищите противоположные утверждения в научной литературе. Если их нет — это может означать консенсус или недостаток исследований.

- Различайте: экспертное мнение (авторитет) ≠ данные (воспроизводимость). Ошибки и предвзятость ИИ часто документируются в исследованиях, но не всегда в популярных источниках.

- Проверьте дату источника. Мифы об ИИ меняются быстро: то, что было верно в 2020 году, может быть неверно в 2025.

Эта секция — не окончательный вердикт, а карта доказательности. Каждый миф требует собственной проверки через исследования о сознательном ИИ и техно-эзотерику.

Механизм возникновения мифов: почему мозг предпочитает простые истории сложным данным

🧠 Когнитивные триггеры: доступность, антропоморфизм, катастрофизм

Мифы об ИИ эксплуатируют несколько когнитивных искажений. Первое — эвристика доступности: мы переоцениваем вероятность событий, о которых часто слышим. Если каждый второй фильм показывает восстание машин, мозг начинает считать это реалистичным сценарием. Подробнее — в разделе Когнитивные искажения.

Второе — антропоморфизм. Мы приписываем человеческие качества нечеловеческим агентам. Когда ИИ генерирует текст, мы автоматически предполагаем понимание, хотя это статистическая функция.

| Искажение | Механизм | Пример |

|---|---|---|

| Доступность | Частые упоминания в медиа → переоценка вероятности | «Восстание машин» в кино → воспринимается как реальный риск |

| Антропоморфизм | Приписывание человеческих качеств системам | ChatGPT генерирует текст → интерпретируем как понимание |

| Катастрофизм | Негативные сценарии привлекают больше внимания | «ИИ уничтожит рабочие места» кликабельнее нейтральных фактов |

Третье — катастрофизм. Негативные сценарии привлекают больше внимания, чем нейтральные факты. Заголовок «ИИ уничтожит миллионы рабочих мест» кликабельнее, чем «ИИ изменит структуру занятости» (S001).

🔁 Петля подкрепления: как медиа, соцсети и алгоритмы усиливают мифы

Мифы распространяются через петлю положительной обратной связи: медиа публикуют сенсационные заголовки → пользователи делятся ими в соцсетях → алгоритмы рекомендаций показывают похожий контент → формируется эхо-камера → миф становится «общеизвестным фактом» (S004).

Сами ИИ-системы рекомендаций могут усиливать мифы об ИИ, показывая пользователям контент, который подтверждает их существующие убеждения (S006).

Ирония в том, что технология, о которой идёт речь, становится инструментом распространения неправды о себе. Алгоритм не различает истину и вымысел — он оптимизирует на вовлечение.

🧩 Почему эксперты тоже ошибаются: конфликт интересов и переоценка прогресса

Даже профессионалы не застрахованы от мифов. Разработчики ИИ могут переоценивать возможности своих систем из-за проклятия знания. Инвесторы заинтересованы в хайпе. Консультанты продают решения (S001).

- Проклятие знания

- Разработчикам трудно представить, как их продукт выглядит для новичка. Они видят систему изнутри и переоценивают её интуитивность.

- Конфликт интересов

- Инвесторы, консультанты и вендоры выигрывают от хайпа. Честная оценка ограничений снижает привлекательность для финансирования.

- Обратная проблема

- Скептики могут недооценивать реальный прогресс. ИИ действительно сделал впечатляющие шаги — но они не абсолютны (S006).

Проверка мифов требует не только данных, но и понимания стимулов тех, кто их распространяет. Ссылка на медицинский ИИ и маркетинг показывает, как эти механизмы работают в реальной отрасли.

Протокол проверки: семь вопросов, которые разрушат любой миф об ИИ за две минуты

✅ Вопрос 1: Есть ли у утверждения конкретные, проверяемые предсказания?

Мифы обычно формулируются расплывчато: «ИИ изменит всё», «ИИ станет опасным». Проверяемое утверждение звучит иначе: «Модель GPT-4 достигает 86% точности на бенчмарке MMLU» — это можно проверить. (S001) Если утверждение нельзя операционализировать, это красный флаг.

✅ Вопрос 2: Различает ли источник AI, ML и DL или использует термины как синонимы?

Это простейший тест на компетентность. AI, ML и DL — разные уровни абстракции, а не взаимозаменяемые слова. (S001) Если автор пишет «ИИ научился распознавать лица» вместо «модель глубокого обучения, обученная на датасете X», это сигнал о низком качестве источника.

Компетентный текст об ИИ всегда уточняет: какой именно метод, на каких данных, с какими ограничениями. Расплывчатость — первый признак мифа.

✅ Вопрос 3: Упоминаются ли ограничения и неопределённости или только возможности?

Надёжные источники всегда указывают границы. (S006) Если текст обещает только выгоды без рисков или только риски без выгод, это пропаганда, а не анализ.

Баланс выглядит так: «ИИ мощный инструмент, но не универсальное решение». Это трезвая позиция, а не маркетинг.

⛔ Вопрос 4: Есть ли в тексте апелляция к страху или утопическим обещаниям?

Эмоциональные триггеры — признак манипуляции. (S001) Образы Терминатора, обещания «решить все проблемы человечества» или апокалиптические сценарии — это не анализ, а нарратив.

Альтернатива: «Это не замена, а командная работа, где каждый делает то, что получается лучше». (S006) Неэмоциональная, конкретная формулировка.

✅ Вопрос 5: Указаны ли конкретные источники данных и методология?

Проверяемость — основа доказательности. Если утверждение не сопровождается ссылкой на исследование, датасет или протокол, его нельзя проверить. (S006)

- Красный флаг

- «Исследования показывают» без ссылки на конкретное исследование.

- Зелёный флаг

- «В исследовании Smith et al. (2023) на датасете ImageNet-21k модель достигла 94.5% точности».

✅ Вопрос 6: Признаёт ли источник роль человека или представляет ИИ как автономного агента?

ИИ — инструмент, зависящий от человеческого дизайна, данных и надзора. (S006) Если текст говорит об ИИ как о самостоятельном существе, принимающем решения, это миф.

Проверь: кто выбирает данные? Кто устанавливает цели? Кто несёт ответственность за ошибки? Если ответ «ИИ сам», перед тобой фантастика. Подробнее — в разделе Логические ошибки.

✅ Вопрос 7: Различает ли источник корреляцию и причинность?

Классическая ловушка: «ИИ предсказал болезнь, значит, он понимает медицину». На самом деле модель нашла статистический паттерн в данных. (S003) Это не понимание, это совпадение.

| Утверждение | Что на самом деле происходит | Проверка |

|---|---|---|

| «ИИ диагностирует рак лучше врачей» | Модель нашла корреляцию между пикселями и диагнозом на тренировочных данных | Работает ли модель на новых, неизвестных данных? На других популяциях? |

| «ИИ понимает язык» | Модель предсказывает следующий токен на основе статистики текста | Может ли модель объяснить свой выбор? Работает ли на парадоксах и противоречиях? |

| «ИИ творческий» | Модель комбинирует паттерны из тренировочных данных | Создаёт ли модель что-то принципиально новое или переаранжирует известное? |

Эти семь вопросов — не гарантия истины, а фильтр для отсеивания явных мифов. Если текст проходит все семь проверок, это не значит, что он верен. Но если он не проходит хотя бы три — это миф.

Дальше: ИИ в медицине: как отличить прорыв от маркетинга, ошибки и предвзятость ИИ, почему мы путаем вычисления с пониманием.