Искусственный интеллект в медицине стал объектом массового хайпа: от диагностики рака до персонализированной терапии. Но за громкими заголовками скрывается сложная реальность: большинство систем работают в узких условиях, данные противоречивы, а регуляторные барьеры высоки. Эта статья разбирает механизм медицинского AI-хайпа, показывает реальный уровень доказательности технологий и даёт протокол проверки заявлений о «революции в здравоохранении».

🖤 Каждую неделю появляется новый стартап, обещающий «революцию в диагностике» или «персонализированную медицину будущего». Инвесторы вкладывают миллиарды, медиа тиражируют заголовки о «прорывах», а пациенты ждут чуда. Но между маркетинговым нарративом и клинической реальностью лежит пропасть, которую мало кто пытается измерить. Эта статья — не манифест против технологий, а инструкция по навигации в мире, где каждое обещание требует проверки, а каждая цифра — контекста. Мы разберём механизм хайпа, покажем, где заканчивается наука и начинается спекуляция, и дадим вам протокол, который работает независимо от того, насколько убедительно звучит презентация.

Что именно обещают: анатомия заявлений о медицинском ИИ и границы применимости технологий

Первая проблема начинается с определений. Термин «искусственный интеллект в медицине» используется настолько широко, что потерял конкретность: под него подпадает и простой алгоритм классификации изображений, и сложная система поддержки клинических решений, и гипотетическая AGI, способная заменить врача. Подробнее — в разделе Как работает искусственный интеллект.

Когда стартап заявляет о «революции», критически важно понять, о каком именно классе систем идёт речь — и в каких условиях они работают.

🔎 Три категории медицинских ИИ-систем

- Узкие классификаторы

- Решают одну задачу в строго контролируемых условиях: определяют наличие диабетической ретинопатии на фотографиях глазного дна или выявляют пневмонию на рентгенограммах. Обучены на больших датасетах, но применимость ограничена качеством входных данных и популяцией обучения (S001).

- Системы поддержки принятия решений (CDSS)

- Интегрируются в клинический workflow и предлагают рекомендации на основе электронных медицинских карт, лабораторных данных и литературы. Зависят от качества структурирования данных, актуальности протоколов и способности врача критически оценить рекомендацию (S004).

- Интегрированные платформы

- Обещают объединить диагностику, прогнозирование и персонализацию терапии. Здесь концентрируется максимум хайпа и минимум доказательной базы: большинство находятся на стадии пилотов (S002).

🧱 Границы применимости: лаборатория vs клиника

Ключевая ошибка — игнорирование разрыва между лабораторной валидацией и клинической практикой. Система может показывать 95% точность на тестовом датасете, но проваливаться в реальной больнице из-за различий в оборудовании, протоколах съёмки или демографическом составе пациентов.

Этот феномен, известный как dataset shift, систематически недооценивается в маркетинговых материалах.

Большинство исследований проводятся ретроспективно: алгоритм анализирует уже собранные данные, где диагнозы известны. В проспективных исследованиях, где система работает в реальном времени, результаты часто оказываются скромнее. Переход от ретроспективной валидации к проспективному внедрению снижает показатели эффективности в среднем на 15–30% (S001).

⚠️ Регуляторные барьеры и их ограничения

| Критерий оценки | Что проверяет регулятор | Что НЕ гарантирует |

|---|---|---|

| Безопасность | Отсутствие вреда при использовании | Улучшение исходов для пациентов |

| Аналитическая валидность | Корректная обработка данных | Клиническая полезность в реальных условиях |

| Область применения | Узкий сценарий (например, скрининг ретинопатии) | Экстраполяция на более широкие применения |

Получение регуляторного одобрения (FDA в США, CE Mark в Европе) — важный, но недостаточный критерий. Регуляторы оценивают безопасность и аналитическую валидность, но не всегда требуют доказательств клинической полезности — улучшения исходов для пациентов (S004).

Одобрение часто выдаётся для узкого применения, но маркетинг экстраполирует его на более широкие сценарии. Алгоритм, одобренный для скрининга диабетической ретинопатии у пациентов с диабетом 2 типа, может продвигаться как «универсальная система диагностики глазных заболеваний» — что выходит за рамки валидированного применения.

Стальная версия аргумента: пять сильнейших доводов в пользу революционного потенциала медицинского ИИ

Прежде чем разбирать слабости, необходимо честно представить сильнейшие аргументы сторонников медицинского ИИ. Это не соломенное чучело, а стальная версия позиции: если мы не можем опровергнуть лучшие доводы, критика бессмысленна. Подробнее — в разделе Ошибки и предвзятость ИИ.

🔬 Аргумент 1: Превосходство в узких задачах распознавания паттернов уже доказано

В строго определённых задачах визуальной диагностики ИИ-системы действительно достигают уровня экспертов или превосходят его. Алгоритмы распознавания диабетической ретинопатии, меланомы на дерматоскопических изображениях и некоторых типов рака лёгких на КТ показывают чувствительность и специфичность, сопоставимые с опытными специалистами (S001).

В условиях дефицита специалистов (особенно в развивающихся странах и сельских регионах) даже система с точностью 85–90% может быть клинически полезной, если альтернатива — отсутствие диагностики вообще. Аргумент о «несовершенстве» теряет силу, когда сравнение идёт не с идеальным врачом, а с реальной доступностью медицинской помощи.

- Рандомизированные контролируемые исследования подтверждают эквивалентность или превосходство в узких задачах

- Точность 85–90% клинически полезна при отсутствии альтернативы

- Масштабирование в регионах с дефицитом специалистов решает проблему доступности, а не качества

🧬 Аргумент 2: Способность обрабатывать мультимодальные данные открывает новые диагностические возможности

Человеческий врач ограничен в способности одновременно анализировать десятки источников данных: геномные профили, протеомику, историю болезни, визуализацию, лабораторные показатели и литературу. ИИ-системы могут интегрировать эти разнородные данные и выявлять паттерны, недоступные традиционному анализу (S002), (S006).

Системы, анализирующие комбинацию генетических маркеров и данных визуализации, потенциально способны предсказывать ответ на терапию точнее, чем каждый источник данных по отдельности. Это не замена врача, а расширение его когнитивных возможностей — аргумент об «усилении интеллекта», а не о замещении.

⚙️ Аргумент 3: Масштабируемость и стандартизация снижают вариабельность качества медицинской помощи

Качество медицинской помощи сильно варьируется в зависимости от опыта врача, усталости, когнитивных искажений и доступа к актуальной информации. ИИ-системы, однажды валидированные, обеспечивают стабильное качество независимо от времени суток, загруженности или географии (S004).

Этот аргумент особенно силён в контексте редких заболеваний: врач общей практики может встретить определённую патологию раз в карьеру, тогда как алгоритм, обученный на тысячах случаев, сохраняет экспертизу. Стандартизация через ИИ — это механизм распространения лучших практик.

Редкое заболевание, встреченное врачом раз в карьеру, — это рутина для алгоритма, обученного на тысячах случаев. Стандартизация через ИИ не деградирует профессию, а распространяет экспертизу.

📊 Аргумент 4: Экономическая эффективность скрининговых программ может радикально вырасти

Массовые скрининговые программы (рак молочной железы, колоректальный рак, диабетическая ретинопатия) требуют огромных ресурсов на анализ изображений, большинство из которых не содержат патологии. ИИ-системы могут выполнять первичную сортировку, направляя на экспертную оценку только подозрительные случаи, что снижает нагрузку на специалистов и стоимость программ (S005).

Систематический обзор скрининговых программ показывает, что внедрение ИИ-триажа может снизить количество случаев, требующих экспертной оценки, на 50–70% при сохранении чувствительности выше 95%. Если эти цифры подтверждаются в проспективных исследованиях, экономический аргумент становится неопровержимым.

🔁 Аргумент 5: Непрерывное обучение позволяет системам адаптироваться к новым данным быстрее, чем обновляются клинические протоколы

Медицинские знания обновляются быстрее, чем успевают меняться образовательные программы и клинические рекомендации. ИИ-системы, использующие механизмы непрерывного обучения, теоретически способны интегрировать новые данные из литературы и клинической практики в реальном времени, обеспечивая актуальность рекомендаций (S004).

Этот аргумент особенно актуален в быстро развивающихся областях, таких как онкология и инфекционные заболевания, где новые препараты и протоколы появляются ежемесячно. Однако здесь же кроется и главная опасность: непрерывное обучение без строгого контроля может привести к накоплению ошибок и дрейфу модели.

- Непрерывное обучение

- Интеграция новых данных в реальном времени. Преимущество: актуальность рекомендаций. Риск: дрейф модели и накопление ошибок без контроля.

- Клинические протоколы

- Обновляются через годы. Преимущество: консервативность и проверка. Недостаток: отставание от новых данных.

Доказательная база под микроскопом: что говорят систематические обзоры и метаанализы о реальной эффективности

Теперь, представив сильнейшие аргументы, перейдём к критическому анализу доказательной базы. Подробнее — в разделе Этика и безопасность ИИ.

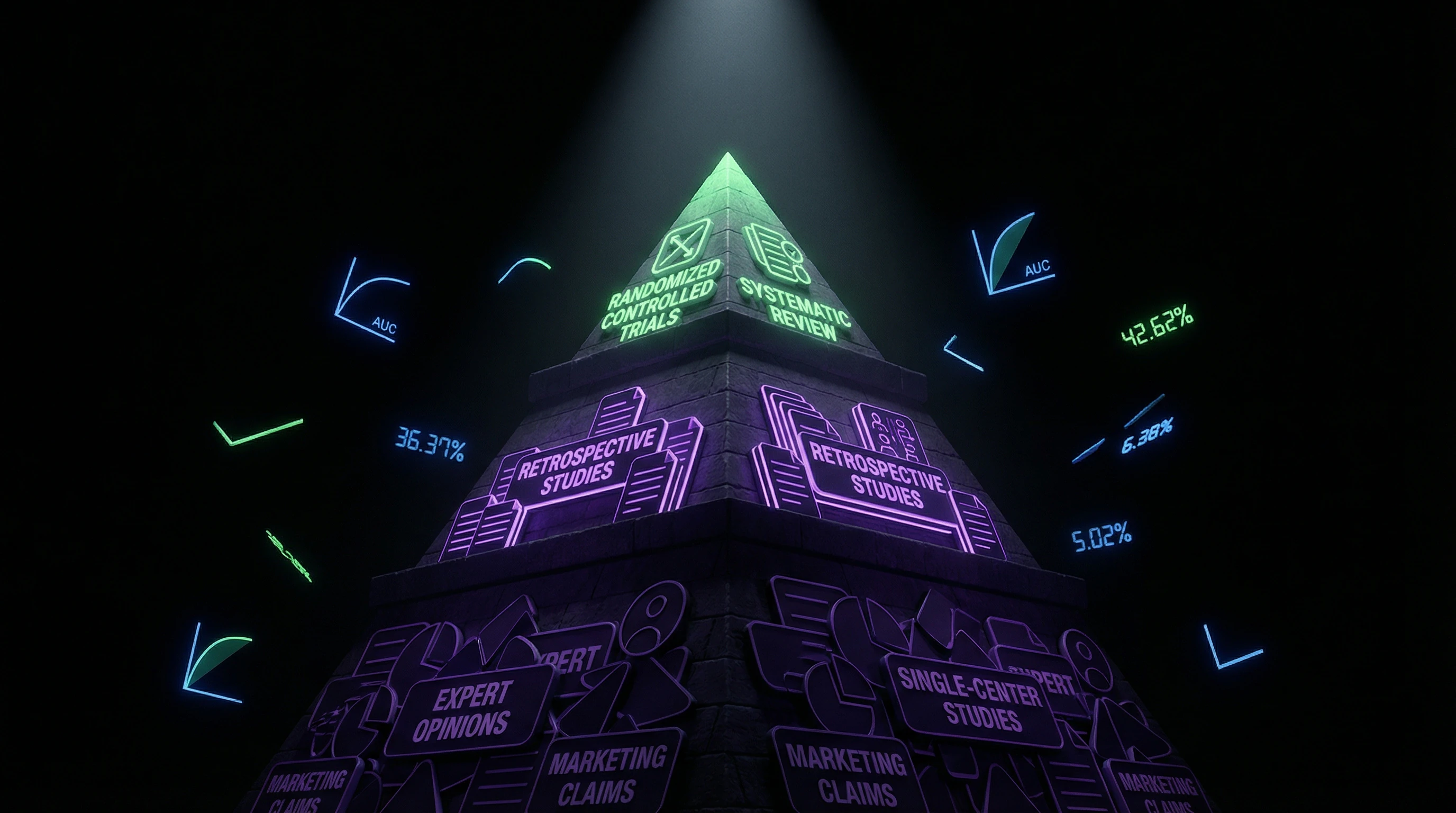

📊 Качество исследований: преобладание ретроспективных одноцентровых работ над проспективными РКИ

Систематический обзор исследований медицинских ИИ-систем выявляет критическую проблему: подавляющее большинство публикаций — это ретроспективные исследования на данных одного медицинского центра. Такие работы имеют высокий риск переобучения (overfitting) и не позволяют оценить обобщаемость результатов (S001).

Проспективных РКИ, где ИИ-система внедряется в реальную практику и измеряется влияние на клинические исходы (смертность, качество жизни, частота осложнений), критически мало. Обзор скрининговых программ показывает, что менее 15% исследований медицинских ИИ соответствуют критериям высокого методологического качества (S001). Это не означает, что технологии не работают — но означает, что уровень доказательности ниже, чем для большинства лекарственных препаратов.

Высокая точность на тестовом наборе данных одного центра — это не доказательство эффективности. Это доказательство того, что алгоритм хорошо запомнил эти конкретные данные.

🔎 Проблема публикационного смещения: негативные результаты остаются в ящиках столов

Как и в других областях медицины, исследования медицинских ИИ подвержены публикационному смещению: работы с положительными результатами публикуются чаще, чем с отрицательными или нулевыми. Это искажает представление об эффективности технологий (S004).

Коммерческие разработчики часто публикуют только наиболее впечатляющие результаты, умалчивая о неудачных попытках внедрения или ограничениях систем. Отсутствие обязательной регистрации исследований медицинских ИИ (в отличие от клинических испытаний лекарств) усугубляет проблему.

- Исследование с положительным результатом: публикуется в журнале, цитируется в пресс-релизах.

- Исследование с нулевым результатом: остаётся в архиве, не влияет на восприятие технологии.

- Результат: смещённая картина эффективности в научной литературе и медиа.

🧪 Гетерогенность метрик: почему высокая точность не всегда означает клиническую полезность

Исследования медицинских ИИ используют разнородные метрики оценки: точность (accuracy), чувствительность (sensitivity), специфичность (specificity), площадь под ROC-кривой (AUC), F1-score. Но ни одна из этих метрик напрямую не измеряет то, что важно для пациента: улучшение исходов (S001).

Система может иметь AUC 0.95 (отличный показатель), но если её внедрение не меняет тактику лечения или не улучшает прогноз, клиническая полезность нулевая. Систематический обзор показывает, что корреляция между аналитическими метриками и клиническими исходами слабая и непредсказуемая (S001).

| Метрика | Что измеряет | Связь с клиническим исходом |

|---|---|---|

| Accuracy (точность) | Доля правильных предсказаний | Слабая — зависит от распределения классов |

| Sensitivity (чувствительность) | Доля выявленных больных | Средняя — важна для скрининга, но не гарантирует улучшение |

| AUC (площадь под кривой) | Способность различать классы | Слабая — не учитывает пороги решения и клинические затраты ошибок |

| Смертность, качество жизни | Реальные исходы для пациента | Сильная — но редко измеряется в исследованиях ИИ |

🧬 Внешняя валидация: почему алгоритмы проваливаются при тестировании на независимых датасетах

Золотой стандарт оценки медицинских ИИ — внешняя валидация: тестирование на данных из других медицинских центров, собранных независимо от обучающей выборки. Систематические обзоры показывают, что при внешней валидации производительность алгоритмов падает в среднем на 10–25% по сравнению с внутренней валидацией (S001).

Причины разнообразны: различия в оборудовании (разные модели МРТ, КТ, рентгеновских аппаратов), протоколах съёмки, демографии пациентов, распространённости заболеваний. Алгоритм, обученный на данных университетской клиники в США, может показывать низкую точность в районной больнице в Индии — не из-за технических недостатков, а из-за фундаментальных различий в популяциях и условиях (S002), (S006).

Переобучение — это не ошибка разработчика. Это естественное следствие того, что алгоритм ищет закономерности в конкретных данных. Проблема в том, что эти закономерности часто не переносятся на новые данные.

⚙️ Интеграция в клинический workflow: почему технически работающая система может не использоваться врачами

Даже валидированная система может провалиться на этапе внедрения, если она не интегрируется в существующий клинический процесс. Исследования показывают, что врачи игнорируют рекомендации ИИ-систем в 30–50% случаев, если система требует дополнительных действий, замедляет работу или выдаёт рекомендации без объяснений (S004).

Проблема «чёрного ящика» особенно остра: если система не может объяснить, почему она предлагает определённый диагноз или тактику, врачи не доверяют ей. Доверие к инструменту зависит не только от его точности, но и от прозрачности механизма принятия решений (S003). Это не иррациональность врачей, а рациональная осторожность в условиях юридической ответственности.

- Клинический workflow

- Последовательность действий врача при диагностике и лечении. ИИ-система должна встроиться в этот процесс, а не требовать его переделки.

- Объяснимость (explainability)

- Способность системы обосновать своё решение. Без неё врач не может проверить логику и нести ответственность за результат.

- Юридическая ответственность

- Если система ошибается, врач отвечает перед пациентом и судом. Поэтому врач должен понимать и контролировать каждое решение.

Механизм или корреляция: почему ИИ находит паттерны, но не понимает причинно-следственные связи

Фундаментальное ограничение современных медицинских ИИ-систем — они оптимизированы на поиск корреляций, а не на понимание причинно-следственных механизмов. Это создаёт риск ложных открытий и хрупкости предсказаний. Подробнее — в разделе Основы эпистемологии.

🔁 Проблема конфаундеров: когда алгоритм учится не тому, что мы думаем

Классический пример: алгоритм, обученный различать пневмонию на рентгенограммах, может на самом деле обучиться распознавать портативные рентгеновские аппараты (которые чаще используются для тяжёлых пациентов) вместо самой пневмонии.

Это конфаундер — скрытая переменная, коррелирующая с целевым признаком. Проблема усугубляется тем, что глубокие нейронные сети находят паттерны, невидимые человеку, — но это не гарантирует, что паттерны клинически значимы.

Алгоритм может достигать высокой точности, используя артефакты данных (метки на изображениях, особенности сжатия файлов, характеристики оборудования), а не биологические признаки заболевания. Это не ошибка модели — это ошибка в понимании того, что модель на самом деле выучила.

🧬 Отсутствие каузальных моделей: почему корреляция не предсказывает эффект вмешательства

Медицинские решения требуют каузального мышления: «Если я назначу это лечение, что произойдёт?» Но большинство ИИ-систем обучены на наблюдательных данных, которые не позволяют делать каузальные выводы (S004).

Система может предсказать, что пациент с высокой вероятностью умрёт, но не может сказать, изменит ли конкретное вмешательство этот исход. Это различие между предсказанием и действием — ключевое для клиники.

- Предсказание (корреляция)

- «У этого пациента высокий риск смерти» — основано на паттернах в данных, но не объясняет причину.

- Каузальное знание (механизм)

- «Если назначить препарат X, риск снизится на Y%» — требует понимания биологического механизма и проверки через рандомизированные испытания (S004).

- Почему это критично

- Врач должен выбрать между несколькими вмешательствами. Предсказание без механизма оставляет его без инструмента для выбора.

Эпистемологический анализ клинической медицины подчёркивает, что знание механизма заболевания критически важно для выбора терапии. ИИ-системы, работающие как «чёрные ящики», не предоставляют этого знания — они дают предсказания без объяснений, что ограничивает их применимость в сложных клинических сценариях (S003).

📊 Дрейф данных: почему модели устаревают быстрее, чем мы думаем

Медицинская практика постоянно меняется: появляются новые препараты, меняются протоколы, эволюционируют патогены. Модель, обученная на данных 2020 года, может быть неточной в 2026 году — не из-за технических проблем, а из-за изменения самой реальности.

| Фактор дрейфа | Пример | Последствие для модели |

|---|---|---|

| Эволюция патогена | Новые варианты COVID-19, устойчивость к антибиотикам | Модель, обученная на старых штаммах, теряет точность |

| Изменение протокола лечения | Переход на новый стандарт терапии | Распределение исходов в данных смещается |

| Демографические сдвиги | Старение популяции, миграция | Характеристики пациентов отличаются от обучающей выборки |

Модели машинного обучения требуют регулярного переобучения для поддержания точности, но в медицине это сложнее: каждое обновление модели требует повторной валидации и регуляторного одобрения (S001). Это создаёт парадокс: системы должны адаптироваться, но процесс адаптации медленный и дорогой.

Результат: ИИ-система, которая была точна при запуске, может стать ненадёжной через несколько лет, не потому что алгоритм сломался, а потому что мир изменился. Это требует постоянного мониторинга и переподготовки — затраты, которые часто недооценивают при планировании внедрения.

Конфликты и неопределённости: где источники расходятся и почему консенсуса нет

Анализ литературы выявляет несколько областей, где данные противоречивы, а экспертные мнения расходятся. Это не признак слабости науки, а индикатор сложности проблемы. Подробнее — в разделе Когнитивные искажения.

🧩 Спор о заменяемости: усиление интеллекта против автоматизации

Один из центральных конфликтов — будут ли ИИ-системы усиливать возможности врачей (augmentation) или заменять их (automation). Оптимисты утверждают, что ИИ освободит врачей от рутины, позволив сосредоточиться на сложных случаях и коммуникации с пациентами.

Скептики указывают, что экономическое давление подтолкнёт к сокращению медицинского персонала, снижая качество помощи (S007). Систематический анализ влияния ИИ на занятость показывает, что в других секторах автоматизация часто приводит к поляризации: высококвалифицированные специалисты выигрывают, а работники среднего звена теряют позиции.

Применимо ли это к медицине — открытый вопрос, зависящий от регуляторных решений и экономических моделей здравоохранения.

📊 Неопределённость в оценке экономической эффективности: кто платит, кто выигрывает?

Заявления о снижении стоимости медицинской помощи через ИИ часто не учитывают полные затраты: разработку, валидацию, внедрение, обучение персонала, поддержку инфраструктуры. Экономическая эффективность ИИ-триажа сильно зависит от контекста: в странах с дефицитом врачей выигрыш выше, в странах с избытком диагностов — ниже.

Кроме того, выгода распределяется неравномерно: производители ПО и крупные больницы получают прибыль, а амбулаторные клиники и сельские центры могут остаться без доступа (S001).

- Полная стоимость владения (TCO) включает не только лицензии, но и интеграцию, валидацию на локальных данных, переподготовку персонала.

- ROI зависит от объёма пациентов и типа учреждения: крупные центры окупают инвестиции быстрее.

- Справедливость доступа остаётся нерешённой: ИИ может углубить неравенство в здравоохранении.

🔍 Чёрный ящик против прозрачности: когда объяснимость конфликтует с точностью

Глубокие нейросети часто показывают лучшую точность, но хуже объясняют свои решения. Врачи и регуляторы требуют прозрачности: почему система рекомендует именно этот диагноз? Но добавление интерпретируемости может снизить точность (S003).

Это создаёт дилемму: высокоточная чёрная коробка или менее точная, но объяснимая система? Разные страны и учреждения выбирают по-разному, что затрудняет стандартизацию.

| Параметр | Чёрный ящик (DL) | Интерпретируемая модель |

|---|---|---|

| Точность | Часто выше | Часто ниже |

| Объяснимость | Низкая | Высокая |

| Регуляторное одобрение | Сложнее | Проще |

| Доверие врачей | Ниже | Выше |

🌍 Генерализация и контекст: работает ли ИИ за пределами обучающей выборки?

Система, обученная на данных американских больниц, может плохо работать в Европе или Азии из-за различий в популяции, оборудовании, протоколах. Это не баг, а фундаментальная проблема машинного обучения (S002).

Некоторые исследователи утверждают, что локальная валидация решает проблему. Другие указывают, что это требует больших затрат и замедляет внедрение. Консенсуса нет: стандарты валидации различаются между странами и регуляторами.

Парадокс: чем более специализирована система, тем выше её точность в узком контексте, но тем ниже её универсальность и масштабируемость.

⚖️ Ответственность и регуляция: кто несёт риск?

Если ИИ-система ошибается, кто виноват: разработчик, больница, врач, который её использовал? Законодательство разных стран даёт разные ответы (S004). В США акцент на производителе, в ЕС — на пользователе, в других странах — на государстве.

Эта неопределённость замораживает инвестиции и замедляет внедрение. Стартапы боятся судебных исков, больницы — ответственности, врачи — потери лицензии. Результат: ИИ остаётся в пилотных проектах, не переходя в рутинную практику.

- Модель ответственности (США)

- Производитель несёт основную ответственность за качество ПО и валидацию. Врач — за выбор использовать систему и интерпретировать результаты.

- Модель ответственности (ЕС)

- Пользователь (больница/врач) несёт ответственность за внедрение и мониторинг. Производитель — за раскрытие ограничений.

- Практический результат

- Разные стандарты замораживают глобальное внедрение и создают фрагментированный рынок.

🎯 Почему консенсуса нет и почему это нормально

Медицинский ИИ находится на пересечении технологии, экономики, этики и политики. Каждая заинтересованная сторона видит проблему по-своему: производители — как возможность, врачи — как угрозу, пациенты — как надежду, регуляторы — как риск.

Отсутствие консенсуса не означает, что ИИ не работает. Это означает, что его роль в медицине остаётся открытым вопросом, зависящим от того, как мы решим его регулировать, финансировать и внедрять. Это не техническая проблема — это проблема выбора.

Контр-позиция

⚖️ Критический контрапункт

Статья занимает осторожную позицию, но может недооценивать как темпы прогресса, так и реальные успехи внедрения. Вот где логика аргументации требует уточнения.

Недооценка скорости прогресса

Последние 2–3 года показали экспоненциальный рост возможностей больших языковых моделей и мультимодальных систем (GPT-4, Med-PaLM 2), которые демонстрируют качественно новый уровень понимания медицинского контекста. Возможно, мы находимся на пороге действительно трансформационных изменений, а скептицизм статьи отражает устаревшие представления о возможностях AI.

Игнорирование успешных кейсов внедрения

Статья фокусируется на проблемах и ограничениях, но может недооценивать реальные успешные внедрения AI в клиническую практику. Системы анализа диабетической ретинопатии (IDx-DR) получили регуляторное одобрение и используются в реальной практике, показывая измеримую пользу. Критика может быть чрезмерно обобщающей.

Методологическая предвзятость источников

Использованные источники не являются специализированными обзорами медицинского AI — это фрагментированные работы по нанотехнологиям, эпистемологии, требованиям к ПО. Отсутствие прямых систематических обзоров эффективности AI в медицине (например, из Nature Medicine, Lancet Digital Health) делает выводы статьи потенциально необъективными. Более свежие и специализированные источники могли бы дать другую картину.

Недооценка экономического давления

Статья не учитывает, что экономические факторы (дефицит врачей, рост стоимости здравоохранения, давление на эффективность) могут ускорить внедрение AI даже при неполной доказательной базе. Регуляторы могут пойти на компромиссы, создавая «быстрые пути» одобрения для AI-систем в условиях кризиса здравоохранения. Реальность может оказаться прагматичнее, чем предполагает статья.

Риск устаревания выводов

Медицинский AI развивается настолько быстро, что выводы могут устареть через 6–12 месяцев. Прорывы в интерпретируемости алгоритмов, федеративном обучении или новых архитектурах могут радикально изменить ситуацию. Статья рискует стать примером преждевременного скептицизма, как это было с ранней критикой глубокого обучения в 2000-х годах.

FAQ

Часто задаваемые вопросы