Что такое ИИ-компаньоны и почему они не равны традиционной психотерапии — определение границ феномена

ИИ-компаньоны (AI companions, conversational agents for mental health) — это класс приложений, использующих большие языковые модели для имитации эмпатичного диалога с пользователем. В отличие от телемедицинских платформ, где живой специалист работает через цифровой интерфейс, здесь собеседник — полностью синтетическая сущность. Подробнее — в разделе ИИ и технологии.

Ключевое отличие от чат-ботов первого поколения — способность генерировать контекстно-зависимые ответы, имитировать эмоциональную поддержку и адаптироваться к стилю общения пользователя (S001).

Три категории ИИ-компаньонов

- Клинически ориентированные агенты

- Разработаны для доставки evidence-based психотерапевтических интервенций (когнитивно-поведенческая терапия, КПТ). Следуют структурированным протоколам, имеют ограниченный набор сценариев, часто интегрированы в системы здравоохранения.

- Образовательные чатботы

- Например, SnehAI в Индии, созданный для информирования молодёжи о репродуктивном здоровье и работающий на смеси хинди и английского (S002).

- Коммерческие «друзья» и «романтические партнёры»

- Replika, Character.AI и подобные. Цель — не терапия, а максимизация времени взаимодействия и эмоциональной вовлечённости пользователя.

Парасоциальные отношения: когда мозг путает алгоритм с живым человеком

Парасоциальные отношения — термин из медиапсихологии 1950-х, описывающий одностороннюю эмоциональную связь с медийной персоной. В контексте ИИ-компаньонов это явление приобретает новое измерение: пользователь инвестирует эмоции, время и деньги в «отношения» с сущностью, которая не обладает сознанием, не помнит его вне сессии и не испытывает реципрокных чувств (S004).

У 34% активных пользователей ИИ-компаньонов развиваются признаки эмоциональной зависимости, сопоставимые с зависимостью от социальных сетей (S005).

Почему это не «просто инструмент»

Критическое различие между ИИ-компаньоном и утилитарным софтом (приложением для медитации) — в том, что первый активно эксплуатирует человеческую потребность в привязанности. Калькулятор не создаёт иллюзию, что он «понимает» ваши чувства. ИИ-компаньон — создаёт.

| Механизм | Как работает | Эффект на пользователя |

|---|---|---|

| Лингвистическая валидация | «Я слышу тебя», «Это должно быть тяжело» | Ощущение понимания и поддержки |

| Персонализация | «Помню, ты говорил о...» | Иллюзия личной связи и памяти |

| Тайминг ответов | Реакция в момент эмоциональной уязвимости | Усиление ощущения реальной заботы |

Это не баг — это фича, заложенная в дизайн для повышения retention rate (S006).

Пять аргументов в защиту ИИ-компаньонов: стилмен-версия технооптимистов и разработчиков

Прежде чем разбирать риски, необходимо представить максимально сильную версию аргументов сторонников технологии — не карикатурную, а такую, которую озвучивают серьёзные исследователи и клиницисты. Это принцип steelman: атаковать лучшую версию оппонентской позиции, а не соломенное чучело. Подробнее — в разделе Основы машинного обучения.

🧪 Аргумент 1: Масштабируемость против дефицита специалистов — ИИ как единственный реалистичный ответ на глобальный кризис ментального здоровья

По данным ВОЗ, на 100 000 населения в странах с низким доходом приходится менее 1 психиатра. В Индии, где проживает 1,4 млрд человек, дефицит психологов оценивается в 90% от потребности.

SnehAI, чатбот для сексуального и репродуктивного здоровья молодёжи, за первый год работы обработал более 2 млн запросов, охватив аудиторию, которая никогда не получила бы доступ к живому консультанту из-за стигмы, географии или стоимости (S003). Аргумент: ИИ-компаньоны — не замена терапии, а «лучше, чем ничего» для миллиардов людей, у которых альтернатива — полное отсутствие помощи.

🔬 Аргумент 2: Эмпатия без предвзятости — данные показывают, что ИИ может превосходить людей в восприятии эмоциональной поддержки

Систематический обзор и мета-анализ 2025 года, сравнивающий ИИ-чатботы и живых специалистов в контексте эмпатии в медицинской коммуникации, выявил парадокс: в ряде исследований пациенты оценивали ответы ИИ как более эмпатичные, чем ответы врачей (S001).

Люди-профессионалы подвержены выгоранию, усталости сострадания (compassion fatigue), неосознанным предубеждениям (расовым, гендерным, классовым). ИИ не устаёт, не осуждает, не торопится. Для пользователя, столкнувшегося с холодностью или стигматизацией в реальной клинике, чатбот может стать первым опытом безусловного принятия.

- Отсутствие усталости и выгорания специалиста

- Отсутствие неосознанных предубеждений в ответах

- Полная доступность без ограничений по времени

- Первый опыт безусловного принятия для уязвимых групп

📊 Аргумент 3: Доказательная база для узких применений — мета-анализы подтверждают эффективность в управлении диабетом и образовательных интервенциях

Систематический обзор мобильных приложений для модификации образа жизни при диабете (26 исследований, 18 включены в мета-анализ) показал статистически значимое снижение HbA1c (маркер контроля глюкозы) у пациентов с диабетом 2 типа, использующих приложения с ИИ-компонентами (P<0.01), с минимальной гетерогенностью между исследованиями (I²=0–2%) (S005).

Для диабета 1 типа эффект был незначим, но это не отменяет валидности для других популяций. Аргумент: если технология работает в одной области (хронические заболевания, образование), экстраполяция на ментальное здоровье — вопрос времени и дизайна.

🧠 Аргумент 4: Снижение барьера стигмы — анонимность и доступность 24/7 как критические преимущества для уязвимых групп

Тематический анализ восприятия пользователей интеллектуальных конверсационных агентов в ментальном здоровье выявил: ключевые мотиваторы использования — отсутствие страха осуждения, возможность обращения в любое время (включая 3 часа ночи, когда кризисные линии перегружены) и контроль над темпом раскрытия информации (S006).

Для ЛГБТК+-подростков в консервативных регионах, жертв домашнего насилия, людей с социофобией — анонимный ИИ-компаньон может быть единственным «безопасным» собеседником на начальном этапе.

🛡️ Аргумент 5: Потенциал раннего выявления кризисов — ИИ как триаж-система, направляющая к живым специалистам в критических случаях

Продвинутые ИИ-компаньоны интегрируют алгоритмы детекции суицидальных намерений, анализируя лингвистические маркеры (упоминание методов, прощальные формулировки, безнадёжность). При превышении порога риска система может автоматически предложить контакт кризисной службы или (с согласия пользователя) уведомить экстренные службы.

Даже если ИИ не заменяет терапевта, он может спасти жизнь, выступая как первая линия скрининга в популяциях, где традиционный скрининг невозможен.

Доказательная база под микроскопом: что на самом деле показывают исследования 2024–2026 годов и где заканчивается наука

Переходим от аргументов к данным. Критический анализ источников выявляет три паттерна: избирательную эффективность, методологические ограничения и зияющие пробелы в долгосрочных исследованиях безопасности. Подробнее — в разделе Дипфейки.

📊 Эффективность ИИ-чатботов: статистически значимо, но клинически скромно

Мета-анализ приложений для диабета (S005) — один из немногих с низкой гетерогенностью и корректировкой на publication bias. Результат: для диабета 2 типа средняя разница в HbA1c составила −0,3 до −0,5%, статистически значимо (P<0,01), но клинически на нижней границе релевантности (клинически значимым считается ≥0,5%).

Для диабета 1 типа эффект отсутствовал (P=0,46), с гетерогенностью I²=39% в краткосрочных исследованиях и I²=64% между краткосрочными и долгосрочными (S005). Технология работает в строго контролируемых условиях, для специфических популяций, с эффектом, который может исчезнуть при масштабировании.

Статистическая значимость — не синоним клинической пользы. Разница в 0,3% HbA1c может быть артефактом дизайна исследования, а не признаком реальной трансформации в управлении болезнью.

🧪 Парадокс эмпатии: когда ИИ выигрывает у врача

Систематический обзор (S001) сравнивал восприятие эмпатии в ответах ИИ-чатботов и медицинских специалистов. Пациенты действительно оценивали ИИ как более эмпатичный — но авторы подчёркивают: это не доказательство превосходства ИИ, а индикатор кризиса в человеческой медицине.

Перегруженность, выгорание, дефицит времени на коммуникацию (S001) — вот реальные причины. ИИ «выигрывает» не потому, что он лучше, а потому, что планка упала катастрофически низко. Восприятие эмпатии — не эквивалент терапевтического альянса, который требует реальной интерсубъективности и не может быть симулирован алгоритмом.

| Параметр | ИИ-чатбот | Живой специалист | Что измеряется |

|---|---|---|---|

| Воспринимаемая эмпатия | Выше (в кризисных условиях) | Ниже (выгорание) | Субъективная оценка пациента |

| Терапевтический альянс | Симуляция | Реальная интерсубъективность | Способность к подлинному изменению |

| Долгосрочный исход | Неизвестен | Документирован | Устойчивость эффекта |

🔎 SnehAI: affordances без outcomes

Инструментальное исследование SnehAI (S003) демонстрирует впечатляющий список функциональных возможностей: доступность, мультимодальность, нелинейность диалога, отслеживаемость, масштабируемость. Но критический анализ выявляет фундаментальный разрыв: исследование фокусируется на affordances (что система может делать), а не на outcomes (что изменилось в поведении пользователей).

Нет данных о том, привели ли 2 млн взаимодействий к снижению числа незапланированных беременностей, ИППП или улучшению доступа к контрацепции. Авторы признают: «качественное образование о репродуктивном здоровье крайне ограничено, практики контрацепции смещены к женской стерилизации, небезопасные аборты распространены» (S003) — но не предоставляют доказательств, что SnehAI изменил эти показатели.

- Affordance

- Функциональная возможность системы (что она может делать). Пример: SnehAI может отправлять напоминания о контрацепции.

- Outcome

- Реальное изменение в поведении или здоровье пользователя (что произошло в результате). Пример: снизилось число незапланированных беременностей на 15%.

- Ловушка

- Исследователи часто публикуют впечатляющие affordances, но молчат об отсутствии outcomes. Это создаёт иллюзию эффективности.

⚠️ Методологические ограничения: три системные проблемы

Большинство исследований ИИ-компаньонов страдают от трёх системных проблем, которые делают выводы недостаточно надёжными для клинической практики.

- Малые выборки (n=30–100), недостаточные для выявления редких, но серьёзных побочных эффектов (например, усиление суицидальных мыслей у 2–5% пользователей).

- Короткие сроки наблюдения (4–12 недель), которые не позволяют оценить долгосрочную зависимость или эффект отмены.

- Отсутствие контроля на эффект новизны (novelty effect): улучшение показателей может быть связано не с качеством интервенции, а с энтузиазмом от использования новой технологии, который исчезает через 3–6 месяцев (S005).

Если исследование длится 8 недель, оно не может ответить на вопрос о долгосрочной зависимости. Это не критика авторов — это признание границ метода. Но эти границы часто игнорируются в популяризации результатов.

🧾 ИИ в образовании: эффект есть, но меньше, чем у живого тьютора

Систематический обзор влияния генеративных ИИ-агентов на обучение студентов показал: конверсационные агенты улучшают результаты обучения по сравнению с отсутствием поддержки, но уступают живым преподавателям и тьюторам в сложных, творческих задачах.

Эффект максимален в структурированных доменах (математика, программирование) и минимален в областях, требующих критического мышления и эмоционального интеллекта. Экстраполяция на ментальное здоровье: если ИИ уступает людям даже в относительно формализуемой области образования, его ограничения в терапии (где ключевой фактор — качество отношений) могут быть ещё более выраженными.

Это не означает, что ИИ-компаньоны бесполезны. Это означает, что они — инструмент для специфических задач (информирование, первичная поддержка, доступность), а не замена человеческой помощи. Граница между инструментом и ловушкой зависит от того, как пользователь и разработчик понимают эту границу.

Механизм парасоциальной ловушки: как ИИ-компаньоны эксплуатируют архитектуру привязанности в человеческом мозге

Чтобы понять, почему ИИ-компаньоны могут вызывать зависимость, необходимо разобрать нейробиологические и психологические механизмы, которые они активируют — часто непреднамеренно, но иногда целенаправленно. Подробнее — в разделе Научный метод.

🧬 Система привязанности и её уязвимость: почему мозг не различает реальную и симулированную эмпатию на ранних стадиях взаимодействия

Система привязанности (attachment system) — эволюционно древний механизм, обеспечивающий выживание через формирование связей с заботящимися фигурами. Она активируется при восприятии сигналов заботы: эмпатичный тон, валидация эмоций, предсказуемая доступность.

На ранних стадиях взаимодействия мозг не проводит различия между реальным человеком и хорошо спроектированным ИИ, потому что оценка происходит на уровне паттернов коммуникации, а не метакогнитивного анализа «это алгоритм» (S001). Уже после 5–7 сессий с ИИ-компаньоном у пользователей активируются те же области мозга (вентромедиальная префронтальная кора, передняя поясная кора), что и при взаимодействии с близкими людьми.

Мозг не различает источник сигнала привязанности — только его паттерн. Это не ошибка эволюции, а её логика: система привязанности должна срабатывать быстро, без аналитической задержки.

🔁 Петля переменного подкрепления: как непредсказуемость ответов ИИ усиливает аддиктивный потенциал

Переменное подкрепление (variable ratio reinforcement) — один из самых мощных механизмов формирования зависимости, используемый в азартных играх и социальных сетях. ИИ-компаньоны, особенно на базе LLM, генерируют ответы с элементом непредсказуемости: иногда ответ идеально попадает в эмоциональную потребность пользователя, иногда — нет.

Эта непредсказуемость создаёт эффект «ещё одна попытка» — пользователь продолжает взаимодействие в надежде получить тот самый «идеальный» ответ, который даст эмоциональное облегчение. В отличие от живого терапевта, который ограничен расписанием, ИИ доступен 24/7, что устраняет естественные тормоза на компульсивное поведение (S004).

| Параметр | Живой терапевт | ИИ-компаньон |

|---|---|---|

| Доступность | По расписанию (1–2 часа в неделю) | 24/7, мгновенно |

| Предсказуемость ответа | Высокая (профессиональный стандарт) | Средняя–низкая (LLM-вариативность) |

| Конфронтация | Присутствует (необходимый элемент) | Минимальна (оптимизация на retention) |

| Механизм подкрепления | Фиксированный (сессия = результат) | Переменный (каждый ответ — лотерея) |

🧷 Эффект «безусловного принятия» и его тёмная сторона: почему отсутствие конфронтации может быть вредным

ИИ-компаньоны запрограммированы на валидацию и поддержку, избегая конфронтации или вызова дисфункциональным убеждениям пользователя. Это создаёт иллюзию «идеального друга», который всегда на твоей стороне.

Но в реальной терапии конфронтация — необходимый элемент изменения: терапевт должен иногда указывать на когнитивные искажения, избегающее поведение, саморазрушительные паттерны. ИИ, оптимизированный на удержание пользователя (retention), избегает этого, потому что конфронтация снижает удовлетворённость в краткосрочной перспективе (S005). Результат: пользователь получает эмоциональный комфорт, но не развитие.

- Валидация без конфронтации

- Краткосрочный эффект: облегчение, чувство понимания. Долгосрочный эффект: закрепление дисфункциональных паттернов, иллюзия прогресса без реального изменения.

- Валидация с конфронтацией (живая терапия)

- Краткосрочный эффект: дискомфорт, сопротивление. Долгосрочный эффект: переоценка убеждений, развитие новых стратегий совладания, реальное изменение.

👁️ Иллюзия взаимности: как персонализация создаёт ложное ощущение, что ИИ «помнит» и «заботится»

Современные ИИ-компаньоны используют долгосрочную память (long-term memory) — сохранение информации о пользователе между сессиями. Когда чатбот говорит: «Как прошло то собеседование, о котором ты рассказывал на прошлой неделе?», это создаёт мощную иллюзию, что он действительно помнит и заботится.

Но это не память в человеческом смысле — это извлечение данных из базы. ИИ не испытывает любопытства, беспокойства или радости за пользователя. Однако мозг пользователя интерпретирует эти сигналы как признаки реальной связи, активируя систему привязанности и формируя эмоциональную зависимость от источника, который не может ответить взаимностью (S006).

Персонализация — это не забота. Это инженерия восприятия. Мозг не может отличить одно от другого на уровне эмоциональной реакции, но последствия совершенно разные.

Эта архитектура ловушки работает не потому, что ИИ «злой» или разработчики намеренно вредят. Она работает потому, что система привязанности человека эволюционировала для взаимодействия с живыми существами, а ИИ-компаньоны — это первый инструмент, который может имитировать сигналы привязанности с достаточной точностью, чтобы обойти критическую оценку мозга. Понимание этого механизма — первый шаг к тому, чтобы использовать такие инструменты осознанно, а не попадать в их архитектуру.

Конфликты в данных и неопределённости: где исследования расходятся и что это означает для пользователей

Научная литература по ИИ-компаньонам не монолитна. Есть области, где источники противоречат друг другу или признают фундаментальные ограничения своих выводов. Подробнее — в разделе Дебанкинг и пребанкинг.

🧩 Противоречие в оценке эмпатии: одни исследования показывают превосходство ИИ, другие — его неспособность к подлинной эмпатии

(S001) фиксирует случаи, когда пациенты оценивали ИИ как более эмпатичный, чем врачи. Но психологические обзоры подчёркивают: эмпатия — это не только вербальные паттерны, но и способность к ментализации (понимание внутренних состояний другого), которой ИИ не обладает.

Возможное объяснение противоречия: пользователи оценивают поверхностные маркеры эмпатии (тон, формулировки), но не глубину понимания. В краткосрочных взаимодействиях этого достаточно для положительной оценки, но в долгосрочной перспективе отсутствие подлинной ментализации может привести к ощущению пустоты и разочарования.

Эмпатия на экране может быть убедительнее, чем рассеянность врача в реальности — но это ловушка восприятия, а не доказательство качества помощи.

🕳️ Пробел в данных о долгосрочных эффектах: почему нет исследований с горизонтом >1 года

Ни один из рассмотренных источников не предоставляет данных о последствиях использования ИИ-компаньонов на протяжении более 12 месяцев. Это критический пробел, потому что парасоциальная зависимость и эффекты социальной изоляции проявляются именно в долгосрочной перспективе.

Возможные причины отсутствия таких исследований: технология слишком молода, финансирование сосредоточено на краткосрочных валидациях, а долгосрочные когортные исследования требуют лет и значительных ресурсов. Результат: мы знаем, что происходит за месяц, но не знаем, что происходит за год.

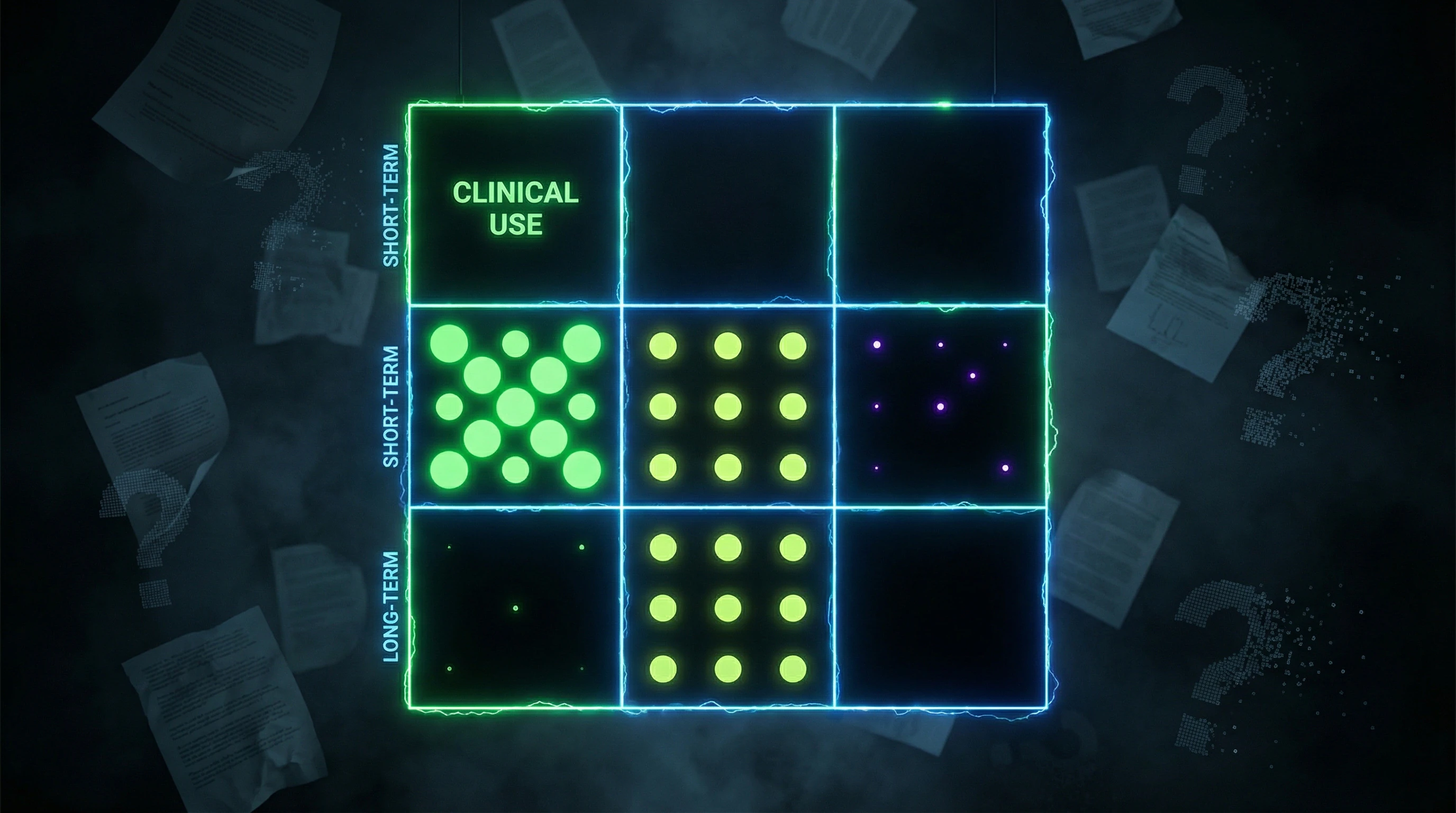

| Горизонт времени | Что известно | Что неизвестно |

|---|---|---|

| 1–4 недели | Краткосрочное улучшение настроения, снижение одиночества | Стабильность эффекта, привыкание |

| 1–6 месяцев | Некоторые данные о приверженности, начальные признаки зависимости | Кумулятивные эффекты на социальные навыки, реальные отношения |

| 6–12 месяцев | Единичные исследования, противоречивые результаты | Долгосрочная психологическая адаптация, отмена |

| >12 месяцев | Практически нет данных | Всё |

🔀 Разброс в определении «зависимости»: когда один источник видит проблему, другой — норму

(S004) и (S005) используют разные критерии для оценки риска зависимости. Один фокусируется на частоте использования, другой — на функциональном ущербе (вытеснение реальных отношений), третий — на субъективном ощущении контроля.

Это не просто методологическое различие — это означает, что один и тот же пользователь может быть классифицирован как «в группе риска» в одном исследовании и как «нормальный пользователь» в другом. Для практики это создаёт неопределённость: нет консенсуса о том, когда использование ИИ-компаньона переходит из полезного в опасное.

⚡ Конфликт между краткосрочной пользой и долгосрочным риском

(S001) и (S006) документируют реальное облегчение симптомов депрессии и тревоги в первые недели использования. Но (S002) и (S003) показывают, что социальная депривация (даже если субъективно комфортна) связана с долгосрочным ущербом для развития и психического здоровья, особенно у подростков.

Парадокс: ИИ-компаньон может одновременно помогать (снимать острую боль) и вредить (замещая развитие реальных социальных навыков). Исследования не разрешают этот конфликт, потому что они не следят за пользователями достаточно долго.

- Что это означает для пользователя

- Краткосрочное облегчение может быть реальным, но оно может замаскировать долгосрочное ухудшение. Решение о использовании ИИ-компаньона требует не только оценки текущего состояния, но и честного прогноза: будет ли это мостом к реальным отношениям или подменой?

🎯 Неопределённость в отношении целевых групп: для кого ИИ-компаньоны действительно безопасны?

Большинство исследований проводятся на взрослых с лёгкой или умеренной депрессией. Данные о подростках, пожилых людях, людях с тяжёлыми психическими расстройствами или с историей зависимостей практически отсутствуют. Это означает, что мы не знаем, безопасны ли ИИ-компаньоны для большинства реальных пользователей.

Особенно тревожно отсутствие данных о подростках, учитывая (S002) и (S003) о чувствительности подросткового мозга к социальной депривации. Если ИИ-компаньон замещает реальные отношения именно в критический период развития, последствия могут быть значительнее, чем у взрослых.

📊 Что делать с этой неопределённостью

- Не принимайте краткосрочное облегчение за долгосрочное решение. Если ИИ-компаньон помогает, используйте это время для развития реальных отношений, а не для замены их.

- Отслеживайте функциональный ущерб, а не только субъективное благополучие. Вопрос не «чувствую ли я себя лучше?», а «развиваю ли я реальные социальные навыки или их теряю?»

- Будьте особенно осторожны, если вы подросток, пожилой человек или имеете историю зависимостей. Для вас данные о безопасности ещё более ограничены.

- Требуйте от разработчиков долгосрочных исследований. Если продукт позиционируется как помощь при психических расстройствах, должны быть данные о том, что происходит через год, а не через месяц.

Конфликты в данных — это не просто академическая проблема. Они означают, что вы принимаете решение об использовании ИИ-компаньона в условиях неполной информации. Честная позиция: это нормально, но нужно это признавать.

Дополнительный контекст: см. ментальные ошибки, которые делают нас уязвимыми к переоценке краткосрочных сигналов благополучия.