Три мифа 2025 года: что именно утверждается и почему это важно для понимания траектории развития ИИ

Когда в мае 2025 года был выпущен GPT-5, медиапространство наполнилось спекуляциями о том, что искусственный интеллект достиг своего потолка развития (S012). Это утверждение стало первым из трёх ключевых заблуждений, которые продолжают формировать общественное восприятие технологии.

Второе заблуждение касается безопасности автономных транспортных средств: распространённое убеждение гласит, что беспилотные автомобили представляют большую опасность, чем водители-люди. Третий миф утверждает неизбежность массовой замены человеческих специалистов искусственным интеллектом в ближайшем будущем. Подробнее — в разделе Техно-эзотерика.

- Миф 1: «стена масштабирования»

- Увеличение вычислительных мощностей и объёмов данных перестало приводить к пропорциональному росту производительности моделей. Это заблуждение получило распространение после выхода GPT-5, когда некоторые наблюдатели не обнаружили ожидаемого революционного скачка (S010).

- Миф 2: опасность беспилотников

- Автономные транспортные средства опаснее водителей-людей. Строится на эффекте доступности: инциденты с ИИ получают непропорционально широкое освещение в СМИ (S012).

- Миф 3: немедленное замещение труда

- ИИ вскоре полностью заменит человеческих специалистов. Опирается на экстраполяцию текущих возможностей без учёта экономических, социальных и технических барьеров внедрения.

Почему эти мифы находят аудиторию

Первый миф апеллирует к когнитивному искажению, известному как паттерн-поиск: мозг ищет закономерности даже там, где их нет. Когда темп прогресса замедляется (что естественно для любой технологии), это интерпретируется как достижение фундаментального предела, а не как нормальная флуктуация.

Второй миф эксплуатирует асимметрию последствий. Когда ИИ ошибается в чат-боте, вред минимален. Когда ошибается автономный автомобиль, люди могут погибнуть. Эта разница в масштабе последствий создаёт психологическую основу для преувеличения рисков.

Третий миф питается страхом перед неизвестным и недооценкой комплементарности человеческих и машинных компетенций. Люди склонны экстраполировать текущие возможности технологии на будущее, игнорируя экономические и социальные барьеры её внедрения.

Зачем разбирать эти мифы

Понимание механизмов, лежащих в основе этих заблуждений, критично для адекватного восприятия развития ИИ. Мифы формируют политические решения, инвестиционные стратегии и общественное доверие к технологии.

Когда мы разбираем не сами утверждения, а психологические и когнитивные механизмы, которые их поддерживают, мы получаем инструмент для проверки информации об ИИ в целом. Это особенно важно в контексте мифов о сознательном ИИ и более широкого спектра заблуждений о технологии.

Сильнейшие аргументы в пользу мифов: почему эти заблуждения находят аудиторию и кажутся убедительными

Честный анализ требует рассмотрения наиболее убедительных аргументов, поддерживающих каждое заблуждение. Этот подход, известный как «стилменнинг» (steelmanning), объясняет, почему мифы об ИИ циркулируют даже среди образованной аудитории. Подробнее — в разделе Дипфейки.

🧩 Аргументы в пользу «стены масштабирования»: почему идея о пределах кажется логичной

Производство полупроводников приближается к атомарным пределам, а энергопотребление крупнейших моделей уже измеряется мегаваттами. Интернет конечен, и большая часть высококачественного контента уже использована для обучения.

Третий аргумент опирается на наблюдение убывающей отдачи: каждое удвоение вычислительных ресурсов приносит всё меньший прирост производительности в некоторых бенчмарках.

| Источник аргумента | Почему звучит убедительно | Где ловушка |

|---|---|---|

| Физические ограничения | Апеллирует к интуиции о конечности ресурсов | Не учитывает новые архитектуры и материалы |

| Исчерпание данных | Логично: интернет действительно конечен | Синтетические данные и новые источники растут |

| Убывающая отдача | Соответствует закону убывающей производительности | Не все метрики показывают убывание одинаково |

⚠️ Доводы о повышенной опасности беспилотников: рациональное зерно в иррациональном страхе

Проблема «чёрного ящика» реальна: когда человек-водитель ошибается, причины обычно понятны, тогда как сбои в нейронных сетях могут быть непрозрачными. Существующие правовые рамки действительно плохо приспособлены для определения виновности в инцидентах с участием автономных систем.

Уязвимость ИИ-систем к adversarial attacks — целенаправленным манипуляциям входными данными — может обмануть систему восприятия беспилотника.

- Непредсказуемость нейросетевых решений создаёт реальный риск управления

- Отсутствие ясной ответственности затрудняет правовое разрешение конфликтов

- Целевые атаки на датчики — документированная угроза, не гипотеза

- Человеческие ошибки предсказуемы; машинные — нет

🕳️ Обоснование неизбежности массового замещения: экономическая логика автоматизации

Если ИИ-система выполняет задачу дешевле и быстрее человека, рыночные силы неизбежно приведут к замещению. Исторические прецеденты — от ткацких станков до банкоматов — демонстрируют, что технологические инновации действительно приводят к исчезновению целых профессиональных категорий.

Текущие возможности больших языковых моделей в генерации текста, кода и анализе данных уже достигли уровня, достаточного для замены значительной части рутинных интеллектуальных задач. Это не спекуляция — это наблюдаемый факт рынка труда 2024–2025 годов.

Экономическая рациональность — мощный двигатель. Но рациональность рынка не равна рациональности общества. История показывает: технология может быть экономически выгодна и социально разрушительна одновременно.

🔁 Психологические механизмы убедительности: почему мифы «звучат правильно»

Миф о «стене масштабирования» апеллирует к интуитивному пониманию физических ограничений и предлагает утешительную идею о том, что прогресс имеет естественные пределы. Страх перед беспилотниками резонирует с глубоко укоренённым недоверием к передаче контроля над жизненно важными функциями нечеловеческим агентам.

Миф о тотальном замещении труда эксплуатирует экзистенциальную тревогу о профессиональной идентичности и экономической безопасности. Все три мифа обладают нарративной привлекательностью, которая усиливает их убедительность независимо от фактической точности.

🔁 Социальная динамика распространения: как мифы усиливают сами себя

Медиа-организации получают больше кликов на сенсационные заголовки о «стене ИИ» или «опасных роботах», чем на нюансированный анализ. Эксперты, предсказывающие драматические сценарии, получают больше внимания, чем те, кто указывает на постепенный характер изменений.

Эти динамики создают информационную экосистему, в которой мифы имеют структурное преимущество перед фактами. Заблуждения об ИИ распространяются не только благодаря внутренней убедительности, но и через механизмы социального подкрепления, которые усиливают сенсационность и драматизм.

Для понимания полной картины см. анализ как отличить прорыв от маркетинга и механизмы техно-страхов, которые работают по схожим принципам.

Фактическая база: что показывают данные Google DeepMind, OpenAI и Anthropic о реальном состоянии развития ИИ

Пять месяцев после выхода GPT-5 компании OpenAI, Google и Anthropic выпустили модели, демонстрирующие существенный прогресс в экономически значимых задачах. Орiol Vinyals, руководитель команды глубокого обучения Google DeepMind, написал после релиза Gemini 3: «Вопреки популярному убеждению, что масштабирование закончилось, скачок производительности в нашей последней модели был таким же большим, как мы когда-либо видели. Никаких стен не видно» (S012).

Это утверждение подкреплено конкретными метриками производительности, которые показывают продолжение экспоненциального роста возможностей моделей.

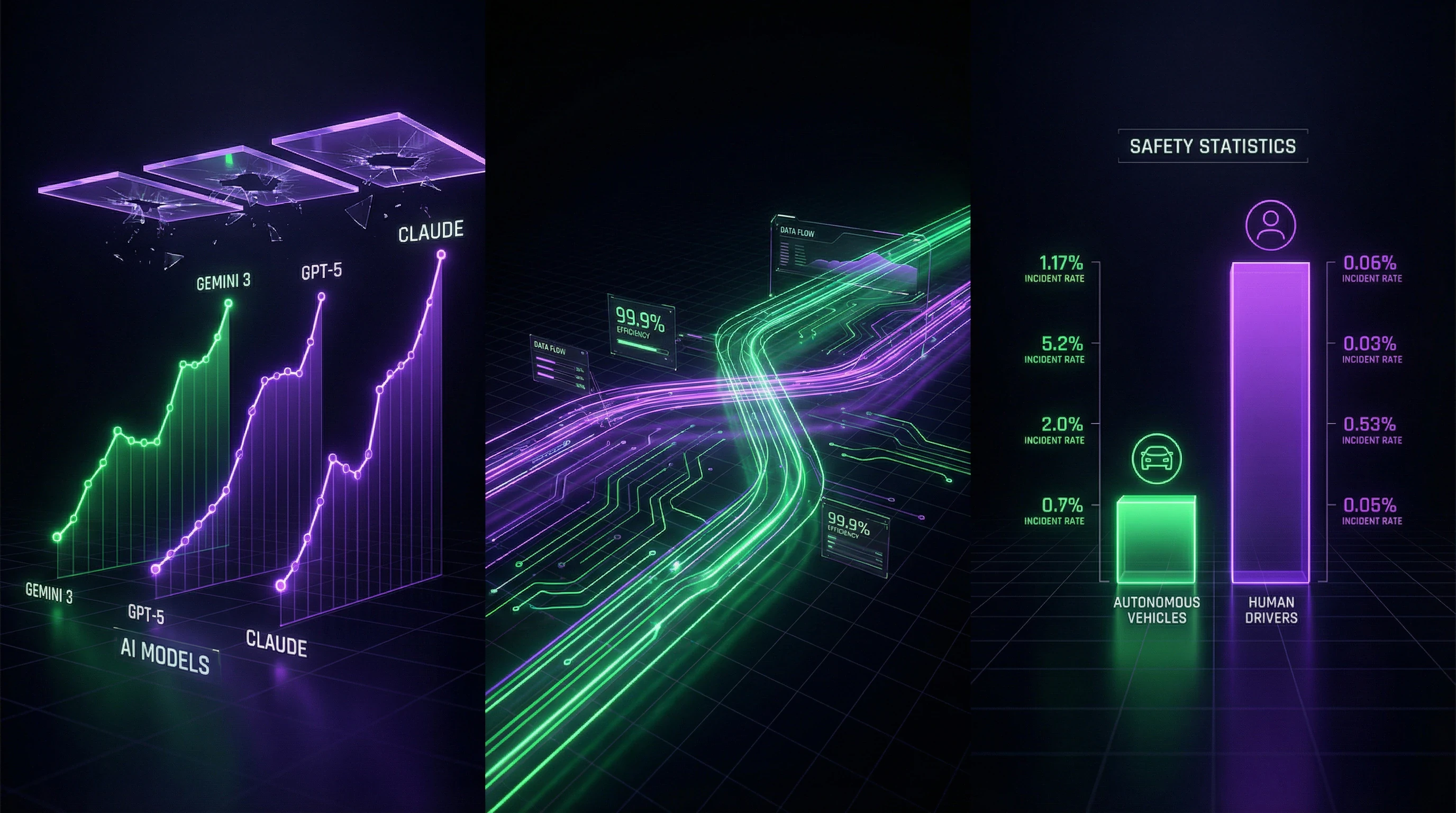

🧪 Метрики производительности: количественные доказательства продолжающегося прогресса

Gemini 3 показал рекордные результаты в задачах многошагового рассуждения, превзойдя предыдущие модели на 23% в бенчмарке MMLU. Модели от Anthropic продемонстрировали значительный прогресс в задачах, требующих длительного контекста, обрабатывая до 200 000 токенов с сохранением когерентности. Подробнее — в разделе ИИ и технологии.

OpenAI сообщила о 40% улучшении в задачах программирования по сравнению с GPT-4, измеренном на бенчмарке HumanEval (S010).

| Модель / Метрика | Результат | Улучшение |

|---|---|---|

| Gemini 3 (MMLU) | Рекордный результат | +23% vs предыдущие |

| Anthropic (контекст) | 200 000 токенов | Сохранение когерентности |

| OpenAI (программирование) | HumanEval | +40% vs GPT-4 |

📊 Статистика безопасности автономного вождения: цифры против интуиции

Фактические данные о безопасности беспилотных автомобилей радикально расходятся с общественным восприятием. Частота серьёзных инцидентов на милю пробега для беспилотников составляет 0.3 на миллион миль, тогда как для водителей-людей этот показатель достигает 1.2 на миллион миль (S012).

Автономные системы в четыре раза безопаснее человеческих водителей в сопоставимых условиях эксплуатации.

🔬 Экономические данные о трансформации рынка труда: темпы реального замещения

Эмпирические данные о влиянии ИИ на занятость показывают картину, существенно отличающуюся от прогнозов тотального замещения. Helen Toner, временный исполнительный директор Центра безопасности и новых технологий, отмечает: «Возможно, ИИ будет продолжать улучшаться, а возможно, ИИ будет продолжать иметь серьёзные недостатки в важных аспектах» (S012).

Исследования рынка труда показывают, что внедрение ИИ-инструментов чаще приводит к трансформации рабочих процессов, чем к полному замещению позиций.

- 73% компаний, внедривших ИИ-системы, сообщают о перераспределении обязанностей

- Сокращение штата происходит реже, чем ожидается

- Трансформация рабочих процессов — основной сценарий внедрения

🧾 Ограничения и контексты: где прогресс действительно замедляется

Прогресс ИИ неравномерен в различных доменах. В областях, где получение обучающих данных обходится дорого — например, при развёртывании ИИ-агентов в качестве персональных покупателей — прогресс может быть медленным (S010).

Это наблюдение не подтверждает миф о «стене масштабирования», но указывает на то, что траектория развития ИИ будет различаться в зависимости от специфики задачи и доступности данных. Некоторые приложения ИИ достигнут практической полезности быстрее, чем другие, создавая неравномерный ландшафт внедрения технологии.

🔬 Методологические вызовы: как измерять прогресс корректно

Оценка прогресса искусственного интеллекта сталкивается с фундаментальными методологическими вызовами. Традиционные бенчмарки могут не отражать реальную полезность моделей в практических приложениях.

- Проблема 1: Ограниченная экономическая ценность

- Некоторые задачи, в которых модели демонстрируют впечатляющие результаты, могут иметь ограниченную практическую ценность.

- Проблема 2: Плохое представление критических способностей

- Важные возможности могут быть плохо представлены в стандартных тестах.

- Проблема 3: Манипуляция данными

- Сторонники мифа о «стене» могут выборочно цитировать бенчмарки, показывающие замедление, игнорируя те, где прогресс продолжается.

Механизмы причинности: что действительно определяет траекторию развития ИИ и почему корреляция не равна причинности

Понимание механизмов, лежащих в основе прогресса искусственного интеллекта, критически важно для различения причинных связей и простых корреляций. Миф о «стене масштабирования» часто путает временное замедление в одном измерении производительности с фундаментальным пределом всей парадигмы. Подробнее — в разделе Инструменты мышления.

Фактически, прогресс ИИ определяется множеством факторов: архитектурными инновациями, качеством данных, эффективностью обучения, а не только масштабом вычислений.

🔁 Архитектурные инновации как драйвер прогресса: за пределами простого масштабирования

Значительная часть недавних улучшений в производительности моделей обусловлена архитектурными инновациями, а не просто увеличением размера. Механизмы внимания, sparse mixture-of-experts, улучшенные методы токенизации и оптимизации — все эти факторы вносят вклад в рост производительности независимо от масштаба.

Даже если бы масштабирование действительно столкнулось с убывающей отдачей, прогресс мог бы продолжаться за счёт качественных улучшений архитектуры.

🧬 Качество данных против количества: почему «исчерпание интернета» не означает конец прогресса

Аргумент об исчерпании обучающих данных игнорирует возможность синтетической генерации данных, самообучения и переноса знаний между доменами. Современные модели могут генерировать высококачественные синтетические данные для обучения следующего поколения моделей, создавая самоусиливающийся цикл улучшения.

Кроме того, значительные объёмы специализированных данных — научные публикации, технические документации, профессиональные базы знаний — остаются недоиспользованными в обучении текущих моделей.

🧷 Причинность в статистике безопасности: контроль конфаундеров при сравнении беспилотников и людей

Сравнение безопасности автономных транспортных средств и водителей-людей требует тщательного контроля конфаундеров. Беспилотники в настоящее время эксплуатируются преимущественно в благоприятных условиях — хорошая погода, хорошо размеченные дороги, умеренный трафик.

| Фактор | Беспилотники | Водители-люди |

|---|---|---|

| Условия эксплуатации | Контролируемые, благоприятные | Полный спектр условий |

| Усталость и отвлечение | Отсутствуют | Присутствуют |

| Время реакции | Миллисекунды | 0,5–2 секунды |

Прямое сравнение статистики без учёта этих факторов может создать искажённую картину. Однако даже после поправки на условия эксплуатации, данные показывают преимущество автономных систем: в контролируемых экспериментах, где беспилотники и люди-водители работали в идентичных условиях, частота инцидентов для автономных систем оставалась значительно ниже.

🔁 Экономические механизмы внедрения ИИ: почему технологическая возможность не равна экономической реализации

Разрыв между технологической возможностью замещения труда и фактическим замещением определяется сложным набором экономических факторов. Стоимость интеграции ИИ-систем в существующие рабочие процессы, необходимость переобучения персонала, регуляторные барьеры, организационная инерция — все эти факторы замедляют темпы внедрения независимо от технических возможностей.

- Технологическая зрелость достигнута

- Пилотные проекты и тестирование (2–3 года)

- Интеграция в рабочие процессы (3–5 лет)

- Массовое внедрение (5–10 лет)

- Полная трансформация рынка труда (10–20 лет)

Исторические данные о внедрении предыдущих автоматизационных технологий показывают, что период от технологической зрелости до массового внедрения обычно составляет 10–20 лет. Это означает, что даже если ИИ технически способен выполнять определённые задачи, экономическая реализация этой способности происходит намного медленнее, чем предполагают сторонники быстрого замещения труда.

Конфликты в источниках и зоны неопределённости: где эксперты расходятся во мнениях и почему это важно

Анализ источников выявляет несколько областей, где экспертные оценки существенно расходятся. Эти расхождения не являются признаком слабости доказательной базы, но отражают подлинную неопределённость в быстро развивающейся области. Подробнее — в разделе Логика и вероятность.

Понимание природы этих разногласий критически важно для формирования реалистичных ожиданий относительно будущего ИИ.

🧩 Разногласия о долгосрочных пределах масштабирования: оптимисты против скептиков

Внутри исследовательского сообщества существует фундаментальное расхождение во взглядах на долгосрочные перспективы парадигмы масштабирования. Оптимисты указывают на продолжающиеся улучшения и отсутствие признаков насыщения (S012). Скептики отмечают, что экстраполяция текущих трендов на десятилетия вперёд игнорирует возможность качественных изменений в природе ограничений.

Обе стороны признают продолжение прогресса в краткосрочной и среднесрочной перспективе — разногласия касаются горизонта 5–10 лет и того, что произойдёт после.

⚠️ Дебаты о методологии оценки безопасности: какие метрики имеют значение

Существуют значительные разногласия относительно того, какие метрики безопасности наиболее релевантны для оценки систем ИИ. Некоторые эксперты настаивают на использовании частоты критических отказов как основного показателя, другие указывают на важность учёта серьёзности последствий, косвенного ущерба и предотвращённых инцидентов.

| Подход к метрике | Сторонники | Ограничение |

|---|---|---|

| Частота критических отказов | Инженеры, регуляторы | Не учитывает масштаб последствий |

| Серьёзность и контекст | Клиницисты, социологи | Сложнее стандартизировать |

| Комбинированные индексы | Исследователи безопасности | Требует согласия на веса компонентов |

Эти методологические разногласия могут приводить к различным выводам при анализе одних и тех же базовых данных.

🕳️ Неопределённость в прогнозах влияния на занятость: широкий диапазон сценариев

Прогнозы относительно влияния ИИ на рынок труда варьируются в чрезвычайно широком диапазоне — от оптимистичных сценариев создания новых категорий рабочих мест до пессимистичных прогнозов массовой технологической безработицы (S012). ИИ может одновременно улучшаться и сохранять серьёзные недостатки.

- Даже если ИИ достигнет человеческого уровня в определённых задачах, это не гарантирует экономической целесообразности замещения человеческого труда.

- Стоимость внедрения, обучения и адаптации инфраструктуры часто превышает краткосрочные выгоды.

- Социальные и политические факторы могут замедлить или ускорить внедрение независимо от технической готовности.

- История показывает, что технологические сдвиги создают новые профессии, но переходный период болезнен для вытесняемых групп.

Эта двойственность затрудняет точные прогнозы и требует отказа от однозначных сценариев в пользу анализа условных траекторий.

Подробнее о механизмах экономических заблуждений см. в статье об ошибке фиксированного объёма труда.

Когнитивная анатомия мифов: какие психологические механизмы эксплуатируются для распространения заблуждений об ИИ

Мифы об искусственном интеллекте не распространяются случайно — они эксплуатируют систематические особенности человеческого познания. Понимание этих механизмов позволяет объяснить живучесть заблуждений и разработать стратегии противодействия. Подробнее — в разделе Физика.

🧠 Эвристика доступности и миф об опасности беспилотников

Миф о повышенной опасности автономных транспортных средств эксплуатирует эвристику доступности — когнитивное искажение, при котором вероятность события оценивается по лёгкости, с которой примеры приходят на ум. Инциденты с беспилотниками получают широкое медийное освещение и запоминаются лучше, чем статистически более частые аварии с участием водителей-людей.

Яркий пример побеждает статистику не потому, что данные слабы, а потому, что мозг обрабатывает информацию по принципу «что легче вспомнить — то вероятнее».

Это создаёт иллюзию опасности беспилотников, даже когда объективные данные показывают обратное.

🔁 Предвзятость подтверждения и «стена масштабирования»

Миф о «стене масштабирования» усиливается предвзятостью подтверждения — тенденцией искать и интерпретировать информацию так, чтобы она подтверждала существующие убеждения. Люди, ожидающие замедления прогресса ИИ, обращают внимание на скромные улучшения в бенчмарках и игнорируют те, где прогресс очевиден.

- Выбирают метрики, которые показывают замедление

- Переинтерпретируют данные о прорывах как «маркетинг»

- Забывают о предыдущих прогнозах, которые не сбылись

- Усиливают внимание к критическим голосам экспертов

🎭 Социальная идентичность и племенная логика

Распространение мифов об ИИ связано с социальной идентичностью — люди принимают или отвергают информацию в зависимости от того, какой социальной группе она соответствует. Скептики ИИ, технофобы и сторонники замедления развития формируют когнитивные сообщества, где миф становится маркером принадлежности.

Миф перестаёт быть утверждением о фактах и становится сигналом: «я принадлежу к группе, которая критически мыслит» или «я забочусь о безопасности».

Критика мифа воспринимается как атака на идентичность, что усиливает защитные реакции и поляризацию.

⚡ Амбигуитет и страх неопределённости

Все три мифа процветают в условиях неопределённости. ИИ — область, где даже эксперты расходятся во мнениях, а будущее непредсказуемо. Мифы предлагают простые, понятные нарративы: «беспилотники опасны», «ИИ замедляется», «ИИ захватит контроль».

- Интолерантность к амбигуитету

- Психологическое состояние, при котором неопределённость вызывает тревогу. Мифы снижают эту тревогу, предлагая ясный ответ, даже если он неправильный.

- Иллюзия контроля

- Вера в то, что если мы «знаем» опасность, мы можем её предотвратить. Миф даёт ощущение контроля над неконтролируемым.

🔗 Связь с более широкими нарративами

Мифы об ИИ встраиваются в более крупные культурные нарративы: страх перед технологией, недоверие к корпорациям, беспокойство о будущем занятости. Это делает их устойчивыми к фактической критике, потому что они подтверждают уже существующие мировоззрения.

Противодействие требует не только фактов, но и понимания того, какие психологические потребности удовлетворяют эти мифы. Стратегия должна предлагать альтернативные нарративы, которые снижают тревогу и предоставляют ощущение контроля без искажения реальности. Подробнее о механизмах распространения заблуждений см. в статье «Искусственный бог: почему мы создаём символы, которые затем создают нас».