Что такое биометрическое распознавание лиц в юридическом и техническом смысле — и почему это не просто «фотография»

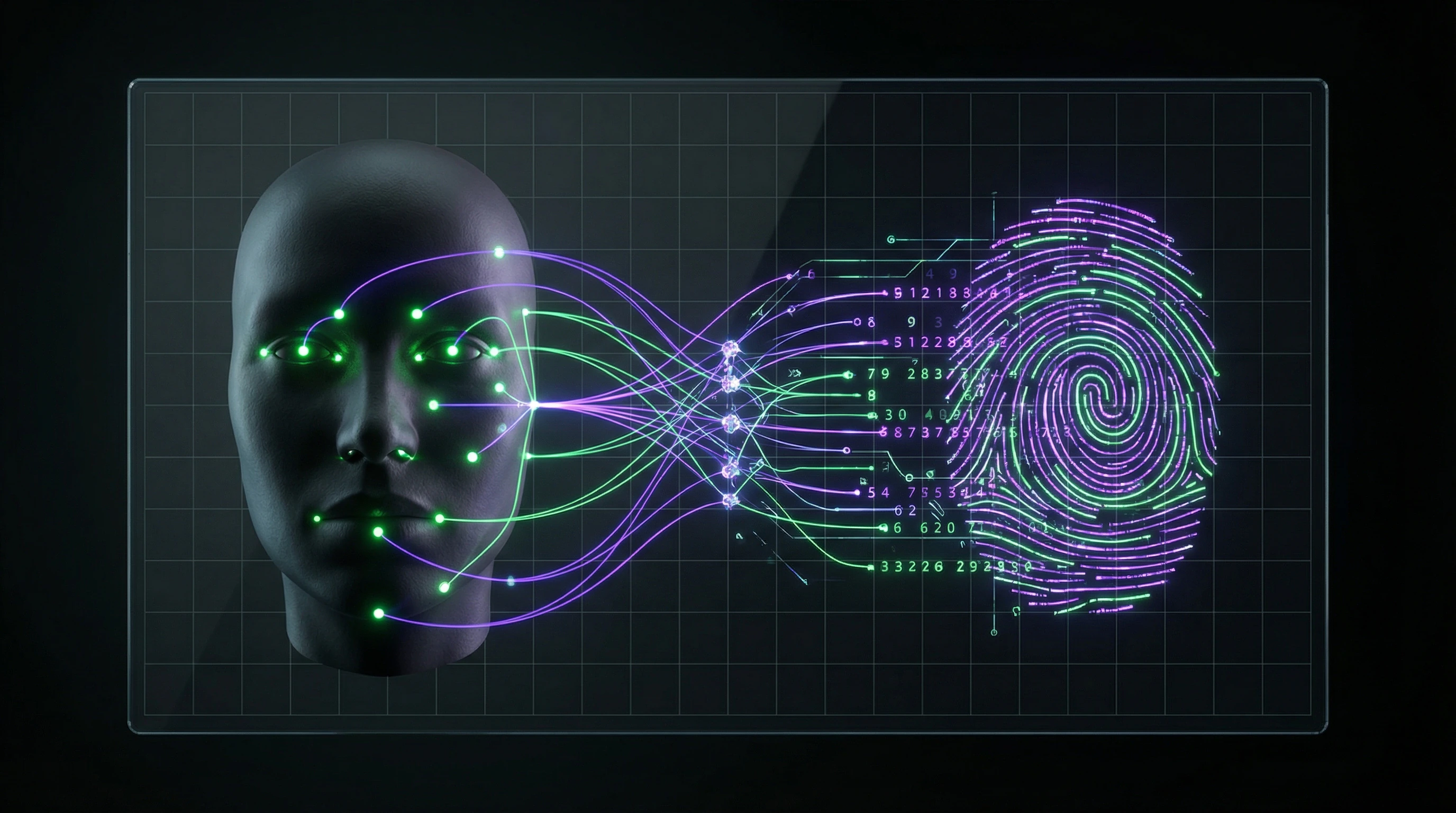

Биометрическое распознавание лиц (facial recognition) — это автоматизированная технология идентификации личности на основе уникальных физиологических характеристик лица. В отличие от фотографии, система создаёт математическую модель: «биометрический шаблон» или «фейспринт» — набор числовых значений, описывающих расстояния между ключевыми точками лица (S001).

Шаблон содержит расстояние между зрачками, ширину носа, глубину глазниц, контур челюсти. Это позволяет сопоставлять лица в разных условиях освещения и ракурсов, но создаёт проблему: лицо невозможно скрыть в публичном пространстве, в отличие от отпечатков пальцев или радужной оболочки глаза. Подробнее — в разделе Основы машинного обучения.

📌 Техническая архитектура: четыре этапа от кадра к решению

- Детекция

- Система отделяет лицо от фона и других объектов в кадре.

- Нормализация

- Коррекция угла наклона, масштаба, освещённости для унификации данных.

- Извлечение признаков

- Нейронная сеть анализирует изображение и создаёт вектор размерностью от 128 до 512 чисел (S001).

- Сопоставление

- Полученный вектор сравнивается с базой данных, вычисляется степень сходства. Если она превышает порог — выдаётся совпадение.

⚖️ Правовая квалификация: почему биометрия требует усиленной защиты

В международном праве биометрические данные — особая категория персональных данных. GDPR относит их к «специальным категориям», обработка которых по общему правилу запрещена (S001).

Исключения возможны только при явном согласии субъекта, защите жизненно важных интересов или выполнении обязательств в сфере трудового права. Российское законодательство также требует письменного согласия на обработку биометрических персональных данных.

🧱 Критическое отличие: невозможность восстановления и замены

Если утекает пароль — его меняют. Если украдена карта — её блокируют. Но биометрический шаблон лица невозможно изменить: человек не может «сменить лицо».

| Идентификатор | Можно ли изменить | Видимость в публичном пространстве |

|---|---|---|

| Пароль | Да, легко | Скрыт |

| Банковская карта | Да, перевыпуск | Скрыта |

| Отпечаток пальца | Нет | Требует физического контакта |

| Лицо (биометрия) | Нет | Видимо всегда и везде |

Однажды скомпрометированные биометрические данные остаются уязвимыми на протяжении всей жизни. Это создаёт уникальные риски, которые отличают биометрию от всех других форм идентификации.

Семь аргументов сторонников массового внедрения facial recognition — и почему они звучат убедительно

Прежде чем анализировать риски, необходимо честно рассмотреть аргументы сторонников. Технология не получила бы столь широкого распространения, если бы не предлагала реальных преимуществ. Понимание логики этих аргументов позволяет оценить, где заканчиваются обоснованные выгоды и начинаются неоправданные риски. Подробнее — в разделе Техно-эзотерика.

🛡️ Аргумент безопасности: предотвращение терактов и розыск преступников

Системы распознавания лиц позволяют в режиме реального времени выявлять лиц, находящихся в розыске, террористов из баз данных, пропавших детей. Биометрическая идентификация происходит мгновенно и не требует сотрудничества со стороны субъекта — в отличие от ручной проверки документов, которая может быть обманута поддельными документами.

Камеры видеонаблюдения, оснащённые системами распознавания, охватывают большие территории — аэропорты, вокзалы, стадионы — где ручной контроль физически невозможен.

⚙️ Аргумент эффективности: снижение издержек и ускорение процессов

Автоматизация идентификации радикально сокращает время прохождения контрольных процедур. В аэропортах пассажиры проходят регистрацию, паспортный контроль и посадку без предъявления документов — достаточно взгляда в камеру.

В банковском секторе биометрическая идентификация ускоряет открытие счетов и проведение операций, снижая риски мошенничества. В корпоративной среде системы контроля доступа устраняют необходимость в физических пропусках, которые могут быть утеряны или переданы третьим лицам.

🧠 Аргумент удобства: бесконтактная идентификация без дополнительных действий

Биометрическое распознавание не требует от пользователя никаких активных действий — не нужно доставать документы, прикладывать палец к сканеру, вводить пароли. Это особенно важно для людей с ограниченными возможностями (S002).

Технология работает на расстоянии, не требует физического контакта с устройством, что актуально в контексте эпидемиологических рисков. Для пожилых людей, которым сложно запоминать пароли, биометрическая идентификация может быть более доступным способом аутентификации.

- Не требует активных действий пользователя

- Работает на расстоянии без физического контакта

- Доступна для людей с ограниченными возможностями

- Снижает когнитивную нагрузку (нет необходимости помнить пароли)

📊 Аргумент точности: современные системы превосходят человеческие возможности

Алгоритмы распознавания лиц на основе глубоких нейронных сетей достигают точности выше 99% на стандартных тестовых наборах данных, превосходя способность человека распознавать лица в сложных условиях (S001).

Системы не подвержены усталости, эмоциональным состояниям, когнитивным искажениям, которые влияют на человеческое восприятие. Они обрабатывают тысячи лиц в секунду и способны распознавать лица при плохом освещении, частичном закрытии, изменении возраста.

Алгоритмы решают задачи, с которыми человек справляется хуже: распознавание в неоптимальных условиях, обработка масштабных потоков данных, отсутствие субъективных ошибок восприятия.

🔁 Аргумент масштабируемости: технология работает на уровне городов и стран

Системы распознавания лиц развёртываются на уровне целых городов, создавая единую сеть видеонаблюдения с возможностью отслеживания перемещений людей. Это позволяет решать задачи, недоступные традиционным методам: поиск пропавших людей по всему городу за минуты, анализ потоков посетителей торговых центров, оптимизация транспортных маршрутов.

Технология масштабируется линейно: добавление новых камер не требует пропорционального увеличения числа операторов.

💎 Аргумент неизбежности: технология уже стала частью инфраструктуры

Распознавание лиц уже интегрировано в критическую инфраструктуру: банковские системы, государственные услуги, транспортные сети, корпоративную безопасность. Отказ от технологии потребует демонтажа существующих систем с огромными издержками и снижением уровня безопасности.

Технология развивается глобально: если одна страна откажется от её использования, это не остановит развитие в других юрисдикциях, но создаст конкурентные недостатки в сферах безопасности и государственного управления.

🧭 Аргумент регулируемости: технология поддаётся правовому контролю

В отличие от анонимного наблюдения, системы биометрической идентификации создают цифровой след, который может быть проверен и проконтролирован. Каждый факт идентификации фиксируется в логах системы с указанием времени, места, оператора.

Это создаёт возможность для аудита и привлечения к ответственности в случае злоупотреблений. Технология может быть настроена с различными уровнями точности и порогами срабатывания, что позволяет балансировать между безопасностью и приватностью. Правовые механизмы, такие как требование судебного ордера для доступа к базам данных, могут ограничить произвольное использование систем (S003).

- Цифровой след

- Каждое действие системы фиксируется с метаданными (время, место, оператор), что теоретически позволяет провести аудит и выявить злоупотребления.

- Настраиваемость параметров

- Уровни точности и пороги срабатывания можно варьировать в зависимости от контекста использования и требуемого баланса между безопасностью и приватностью.

- Судебный контроль

- Требование ордера для доступа к базам данных создаёт формальный барьер против произвольного использования систем.

Все семь аргументов опираются на реальные преимущества технологии. Однако убедительность этих аргументов часто основана на том, что они рассматривают только одну сторону уравнения — выгоды — и игнорируют или минимизируют риски, которые возникают при массовом внедрении. Этика и безопасность ИИ требуют комплексного анализа, а не выбора между удобством и контролем.

Доказательная база: что говорят исследования о точности, ошибках и систематических смещениях алгоритмов распознавания

Заявления о высокой точности требуют критической проверки: в каких условиях проводились тесты, на каких выборках, какие метрики использовались. Особое внимание — систематические ошибки, когда алгоритмы демонстрируют предсказуемо худшую производительность для определённых групп населения. Подробнее — в разделе Синтетические медиа.

📊 Метрики точности: что скрывается за цифрой «99% accuracy»

Заявления о 99% точности требуют понимания контекста. Существуют два режима: верификация (1:1 сравнение — это тот же человек?) и идентификация (1:N поиск — кто этот человек среди N записей?). Верификация обычно точнее, так как система сравнивает два шаблона.

При идентификации в большой базе вероятность ложного срабатывания растёт пропорционально размеру базы (S011). Если система имеет частоту ложных срабатываний 0.1% (точность 99.9%), то при проверке по базе из 1 миллиона записей она выдаст 1000 ложных совпадений.

Точность в лабораторных условиях и точность в реальной эксплуатации — это две разные метрики. Первая измеряет потенциал, вторая — риск.

⚠️ Систематические смещения: расовая и гендерная предвзятость

Множественные исследования выявили значительно более высокую частоту ошибок при идентификации людей с тёмным цветом кожи, женщин, пожилых людей (S012). Причина: обучающие выборки содержат преимущественно изображения белых мужчин среднего возраста.

Нейронная сеть хуже распознаёт лица, отличающиеся от этого «стандарта». Такие смещения создают риски дискриминации: люди из недопредставленных групп чаще становятся жертвами ложных обвинений или не могут получить доступ к услугам из-за сбоев идентификации.

| Группа населения | Типичная проблема | Механизм ошибки |

|---|---|---|

| Люди с тёмной кожей | Высокая частота ложных срабатываний | Недостаточное представление в обучающей выборке |

| Женщины | Ошибки при распознавании с макияжем | Алгоритм обучен на лицах без макияжа или с минимальным |

| Пожилые люди | Несовпадение с молодыми фотографиями в базе | Возрастные изменения черт лица не учтены в модели |

🧪 Условия тестирования vs. реальная эксплуатация

Лабораторные тесты проводятся на тщательно подготовленных наборах: фотографии высокого качества, контролируемое освещение, фронтальные ракурсы, отсутствие окклюзий. В реальных условиях — на улицах, в метро, аэропортах — качество изображений значительно ниже.

Низкое разрешение камер, плохое освещение, произвольные углы съёмки, частичное закрытие лица одеждой или аксессуарами приводят к тому, что реальная точность оказывается существенно ниже заявленной (S011). Разрыв между лабораторией и полем — это не техническая деталь, а источник систематических ошибок в правоприменении.

- Лабораторные условия: контролируемое освещение, фронтальный ракурс, высокое разрешение

- Полевые условия: естественное освещение, произвольные углы, низкое разрешение

- Результат: точность падает на 5–15% в зависимости от системы

- Правовое следствие: обвинения на основе распознавания требуют дополнительной верификации

🔎 Проблема изменения внешности: макияж, старение, медицинские состояния

Системы распознавания уязвимы к изменениям внешности. Макияж, особенно контурирование, может изменить воспринимаемую геометрию лица настолько, что алгоритм не распознает человека. Естественное старение изменяет черты: кожа теряет упругость, появляются морщины, изменяется овал лица.

- Макияж и контурирование

- Изменяет геометрию лица в пространстве признаков алгоритма. Система может не распознать человека, который выглядит иначе, чем на исходной фотографии в базе. Проблема усугубляется, если макияж применён профессионально.

- Естественное старение

- Морщины, изменение овала лица, потеря упругости кожи — всё это смещает биометрический шаблон. Человек, чья фотография в базе была сделана 10 лет назад, может не совпадать с текущим распознаванием.

- Медицинские состояния

- Отёки, травмы, пластические операции изменяют геометрию лица. Это создаёт необходимость регулярного обновления биометрических шаблонов, что усложняет эксплуатацию и создаёт дополнительные риски утечек данных.

Проблема усугубляется тем, что люди часто не знают о необходимости обновления своих биометрических данных. Система может отказать в доступе или выдать ложное совпадение, а человек останется без объяснения причины.

Биометрический шаблон — это не статичный идентификатор, как отпечаток пальца. Это динамичный образ, который меняется с возрастом, здоровьем и выбором человека. Системы, которые игнорируют эту реальность, создают иллюзию точности, а не саму точность.

Связь между этими техническими ограничениями и возвращением физиогномики в эпоху ИИ становится очевидной: алгоритмы повторяют ошибки XIX века, но с видимостью научности. Для понимания этических последствий см. этику и безопасность ИИ.

Механизм работы нейронных сетей в распознавании лиц: почему «чёрный ящик» создаёт правовые проблемы

Понимание технического механизма критично для оценки правовых последствий. Современные системы основаны на глубоких свёрточных нейронных сетях (CNN), обучаемых на миллионах изображений лиц. Подробнее — в разделе Логические ошибки.

Процесс принятия решений внутри нейронной сети остаётся непрозрачным даже для разработчиков — проблема «чёрного ящика», которая создаёт фундаментальные сложности для правового регулирования.

🧠 Архитектура глубоких нейронных сетей: от пикселей до решения

Системы распознавания используют архитектуры типа FaceNet, VGGFace, ArcFace — глубокие нейронные сети с десятками или сотнями слоёв. Первые слои выделяют простые признаки: края, углы, текстуры.

Средние слои комбинируют эти признаки в более сложные паттерны: формы глаз, носа, рта. Глубокие слои создают абстрактные представления, которые уже не имеют прямой визуальной интерпретации — многомерные векторы в пространстве признаков (S001). Финальный слой преобразует эти векторы в компактное представление — биометрический шаблон для сравнения.

- Входной слой: обработка пикселей изображения

- Слои 1–5: выделение локальных признаков (текстуры, края)

- Слои 6–15: комбинирование в региональные паттерны

- Слои 16–25: абстрактные представления лица

- Выходной слой: биометрический шаблон и решение о совпадении

⚙️ Проблема объяснимости: почему система приняла именно это решение

Критическая проблема: невозможность объяснить, почему конкретное решение было принято. Если система идентифицировала человека как совпадающего с записью в базе, невозможно указать, какие именно признаки лица привели к выводу.

Право на объяснение решений, принятых автоматизированными системами, закреплено в GDPR (S002). Но технически реализовать его для глубоких нейронных сетей крайне сложно — это создаёт разрыв между правовым требованием и технической реальностью.

Как человек может оспорить решение, если невозможно понять его основания? Это фундаментальная проблема для справедливости судебного процесса.

🔁 Обучение на данных: откуда берутся миллионы лиц для тренировки

Для обучения эффективной системы требуются миллионы изображений лиц с разметкой. Откуда они берутся? Часто — из публично доступных источников: социальных сетей, фотобанков, видеозаписей.

Многие люди не знают, что их фотографии используются для обучения коммерческих систем. Это нарушает принципы защиты персональных данных (S002). Если обучающая выборка несбалансирована (мало изображений людей определённых этнических групп), это приводит к систематическим смещениям в работе системы.

| Источник данных | Объём | Проблема |

|---|---|---|

| Социальные сети | Миллиарды фото | Отсутствие согласия субъектов |

| Фотобанки | Сотни миллионов | Неясное использование лицензии |

| Видеозаписи (камеры) | Миллионы кадров | Массовое наблюдение без уведомления |

| Государственные базы | Десятки миллионов | Централизованный контроль |

🧷 Adversarial attacks: как обмануть систему распознавания

Нейронные сети уязвимы к adversarial attacks — специально сконструированным возмущениям входных данных, которые заставляют систему принимать неверные решения. Для распознавания лиц это может быть специальный макияж, очки с определённым паттерном, наклейки на лице.

Эти возмущения незаметны для человека, но радикально меняют выход нейронной сети (S003). Существование таких атак демонстрирует, что системы распознавания не являются надёжными в условиях противодействия.

Если злоумышленник знает, как обмануть систему, она теряет свою защитную функцию. Это критично для применений в сфере безопасности — система становится инструментом, который можно обойти, а не надёжным механизмом контроля.

Парадокс: чем более «умной» становится система, тем более специфичными становятся способы её обхода. Это создаёт гонку вооружений между разработчиками защиты и теми, кто ищет уязвимости.

Конфликт интересов: где сталкиваются безопасность общества и право на приватность личности

Биометрическое распознавание лиц находится в эпицентре фундаментального конфликта между коллективной безопасностью и индивидуальной свободой. С одной стороны, государство имеет легитимную обязанность защищать граждан от преступности и терроризма. С другой стороны, массовое наблюдение создаёт риски злоупотреблений, подавления инакомыслия, тотального контроля. Подробнее — в разделе Психология веры.

Этот конфликт не имеет простого решения — он требует тщательного баланса интересов, где каждое решение в пользу одной стороны автоматически ослабляет другую.

🕳️ Презумпция виновности: когда каждый становится подозреваемым

Массовое биометрическое наблюдение инвертирует презумпцию невиновности. В традиционной правовой системе человек считается невиновным, пока его вина не доказана, и наблюдение начинается после возникновения подозрений. Системы массового распознавания лиц работают наоборот: каждый человек в публичном пространстве автоматически сканируется и проверяется по базам данных.

Это означает, что каждый рассматривается как потенциальный преступник, подлежащий проверке. Такой подход фундаментально меняет отношения между гражданином и государством, создавая атмосферу тотального недоверия.

🧩 Эффект охлаждения: как наблюдение подавляет свободу выражения

Осознание того, что твоё лицо постоянно сканируется и твои перемещения отслеживаются, изменяет поведение людей. Это явление называется «эффектом охлаждения» (chilling effect): люди избегают посещать определённые места, участвовать в протестах, встречаться с определёнными людьми, опасаясь последствий.

Даже если система используется только для поиска преступников, сам факт её существования создаёт психологическое давление. Это особенно опасно для свободы собраний и выражения мнений: если участники протеста знают, что их лица будут идентифицированы и записаны, многие откажутся от участия (S001).

| Сценарий | Без массового наблюдения | С массовым наблюдением |

|---|---|---|

| Участие в протесте | Решение основано на убеждениях | Решение включает расчёт рисков идентификации |

| Посещение места встречи | Выбор места свободен | Выбор ограничен опасением записи |

| Общественная активность | Анонимность в толпе | Полная отслеживаемость |

🛡️ Защита уязвимых групп: дети, беженцы, жертвы насилия

Некоторые категории людей особенно уязвимы к рискам биометрического наблюдения. Дети не могут дать информированное согласие на обработку своих биометрических данных, но их лица попадают в системы распознавания через школьные системы безопасности или публичное наблюдение.

- Беженцы и лица, ищущие убежища

- Могут быть идентифицированы и депортированы, если их биометрические данные попадут в руки властей страны, из которой они бежали (S006).

- Жертвы домашнего насилия

- Теряют возможность анонимности, если их лица могут быть найдены через системы распознавания, что облегчает преследователям их поиск (S008).

- Активисты и журналисты

- Становятся уязвимы для целевых репрессий в странах с ограниченной свободой прессы.

⚠️ Риски авторитарного использования: от контроля до репрессий

История показывает, что технологии наблюдения, созданные для борьбы с преступностью, могут быть использованы для политических репрессий. Системы распознавания лиц позволяют идентифицировать участников протестов, отслеживать перемещения оппозиционеров, создавать профили политической активности.

В авторитарных режимах такие системы становятся инструментом подавления инакомыслия. Даже в демократических странах существует риск «сползания функций» (function creep): системы, изначально созданные для узких целей безопасности, постепенно расширяют сферу применения, охватывая всё больше аспектов жизни граждан (S001).

Технология нейтральна, но её применение зависит от политического контекста. Инструмент, безопасный в демократии, становится оружием в руках авторитаризма.

Связанные материалы: Этика и безопасность ИИ: как разработать и использовать ответственно и ИИ-физиогномика и возвращение френологии: почему алгоритмы распознавания лиц повторяют ошибки XIX века.

Международные стандарты защиты биометрических данных: что требуют GDPR, Конвенция 108+ и национальные законодательства

Правовое регулирование биометрического распознавания лиц развивается на нескольких уровнях: международные конвенции, региональные регламенты (такие как GDPR в ЕС), национальные законы. Эти нормы устанавливают принципы обработки биометрических данных, требования к согласию субъектов, ограничения на использование технологии. Подробнее — в разделе Космология и астрономия.

Однако правоприменение остаётся проблемой: технология развивается быстрее, чем законодательство, а контроль за соблюдением норм затруднён.

📌 GDPR: биометрия как специальная категория данных

GDPR (Европейский регламент о защите данных) классифицирует биометрические данные как специальную категорию — наравне с генетической информацией и данными о здоровье (S001). Это означает запрет на обработку без явного согласия субъекта, за исключением узких случаев (безопасность, правоохрана, жизненно важные интересы).

Парадокс GDPR: регламент защищает данные, но не решает проблему систематических ошибок алгоритмов. Даже при полном соблюдении процедур технология может дискриминировать по признакам пола, возраста, этнической принадлежности.

Статья 9 GDPR запрещает обработку биометрических данных для идентификации в публичном пространстве без специального законодательного акта. Это создаёт барьер для массового внедрения facial recognition в аэропортах, на улицах, в торговых центрах.

📌 Конвенция 108+: глобальный минимум

Конвенция 108+ (Совет Европы) устанавливает международный стандарт защиты персональных данных, включая биометрию. Её требования мягче, чем GDPR, но охватывают более широкий круг стран (включая Россию, Украину, Молдову).

- Принцип законности: обработка только на основе закона или согласия

- Принцип пропорциональности: цель должна оправдывать средства

- Принцип прозрачности: субъект должен знать, что его данные обрабатываются

- Право на доступ и исправление: субъект может проверить и оспорить данные

Конвенция 108+ не запрещает facial recognition, но требует, чтобы каждое государство установило собственные ограничения в национальном законодательстве.

📌 Национальные законодательства: фрагментация и пробелы

Разные страны выбирают разные подходы. Франция и Германия ограничивают facial recognition в публичном пространстве. США полагаются на секторальное регулирование (закон о биометрии в Иллинойсе, законы о видеонаблюдении в отдельных штатах).

| Юрисдикция | Подход | Ограничения |

|---|---|---|

| ЕС (GDPR) | Запретительный | Facial recognition в публичном пространстве требует закона |

| США | Секторальный | Зависит от штата и сектора (полиция, коммерция, финтех) |

| Китай | Разрешительный | Минимальные ограничения, широкое использование в системе социального кредита |

| Россия | Смешанный | Конвенция 108+, но национальное законодательство развивается |

Фрагментация создаёт проблему: компании, работающие в нескольких юрисдикциях, должны соблюдать разные стандарты. Это замедляет инновации, но защищает граждан от унификации под самый мягкий стандарт.

Связь с этикой и безопасностью ИИ раскрыта в отдельной статье. Там же обсуждается, как современные алгоритмы повторяют ошибки XIX века.

📌 Проблема правоприменения: технология опережает закон

Даже строгие законы (как GDPR) сталкиваются с проблемой контроля. Как проверить, что компания не использует facial recognition в фоновом режиме? Как доказать дискриминацию, если алгоритм работает как «чёрный ящик»?

- Проблема 1: Асимметрия информации

- Регуляторы не имеют доступа к исходному коду и обучающим данным алгоритмов. Компании могут скрывать ошибки и смещения.

- Проблема 2: Трансграничность

- Данные обрабатываются в облаке, серверы находятся в разных странах. Какой закон применяется? Кто несёт ответственность?

- Проблема 3: Скорость инноваций

- Новые применения facial recognition (дипфейки, синтетические видео) появляются быстрее, чем законодатели успевают реагировать. Обнаружение дипфейков — отдельная проблема.

Вывод: международные стандарты устанавливают принципы, но их реализация зависит от политической воли и технических возможностей контроля. Без прозрачности алгоритмов и независимого аудита даже самые строгие законы остаются на бумаге.