⚖️ Этика искусственного интеллекта

⚖️ Этика искусственного интеллектаЭтические принципы и безопасность искусственного интеллекта в медицинеλ

Исследование моральных норм, информационной безопасности и ответственного применения ИИ-технологий в клинической практике и медицинских исследованиях

Overview

Внедрение искусственного интеллекта в медицину требует строгого соблюдения этических принципов и протоколов безопасности. ИИ-системы для интраоперационной визуализации паращитовидных желез, алгоритмы анализа факторов риска рака молочной железы и системы поддержки принятия решений при лечении возрастной макулярной дегенерации демонстрируют потенциал технологии, но одновременно поднимают вопросы конфиденциальности данных, прозрачности алгоритмов и клинической ответственности. Этические рамки должны обеспечивать баланс между инновациями и защитой прав пациентов, гарантируя, что ИИ остается инструментом поддержки, а не заменой профессионального медицинского суждения.

🛡️ Протокол Лапласа: Все ИИ-системы проходят многоуровневую проверку на соответствие этическим стандартам, включая оценку прозрачности алгоритмов, защиты персональных данных, клинической валидации и соблюдения принципов информированного согласия перед внедрением в практику.

Reference Protocol

Научный фундамент

Доказательная база для критического анализа

Protocol: Evaluation

Проверь себя

Квизы по этой теме скоро появятся

Sector L1

Статьи

Научно-исследовательские материалы, эссе и глубокие погружения в механизмы критического мышления.

⚖️ Этика искусственного интеллекта

⚖️ Этика искусственного интеллекта ⚖️ Этика искусственного интеллекта

⚖️ Этика искусственного интеллекта ⚖️ Этика искусственного интеллекта

⚖️ Этика искусственного интеллекта ⚖️ Этика искусственного интеллекта

⚖️ Этика искусственного интеллекта ⚖️ Этика искусственного интеллекта

⚖️ Этика искусственного интеллекта ⚖️ Этика искусственного интеллекта

⚖️ Этика искусственного интеллекта⚡

Подробнее

Этические принципы применения ИИ в клинической практике: где заканчивается алгоритм и начинается врач

Внедрение искусственного интеллекта в медицину создаёт фундаментальный этический парадокс: технология, призванная улучшить качество помощи, может нарушить базовые принципы врачебной этики, если не учитывать границы её применения. Систематические обзоры применения ИИ-ассистированных систем в хирургии демонстрируют, что технология находится на стадии валидации и не может заменить клиническую экспертизу.

Ключевой вопрос — не «может ли ИИ», а «должен ли ИИ» принимать решения без участия человека в критических клинических ситуациях.

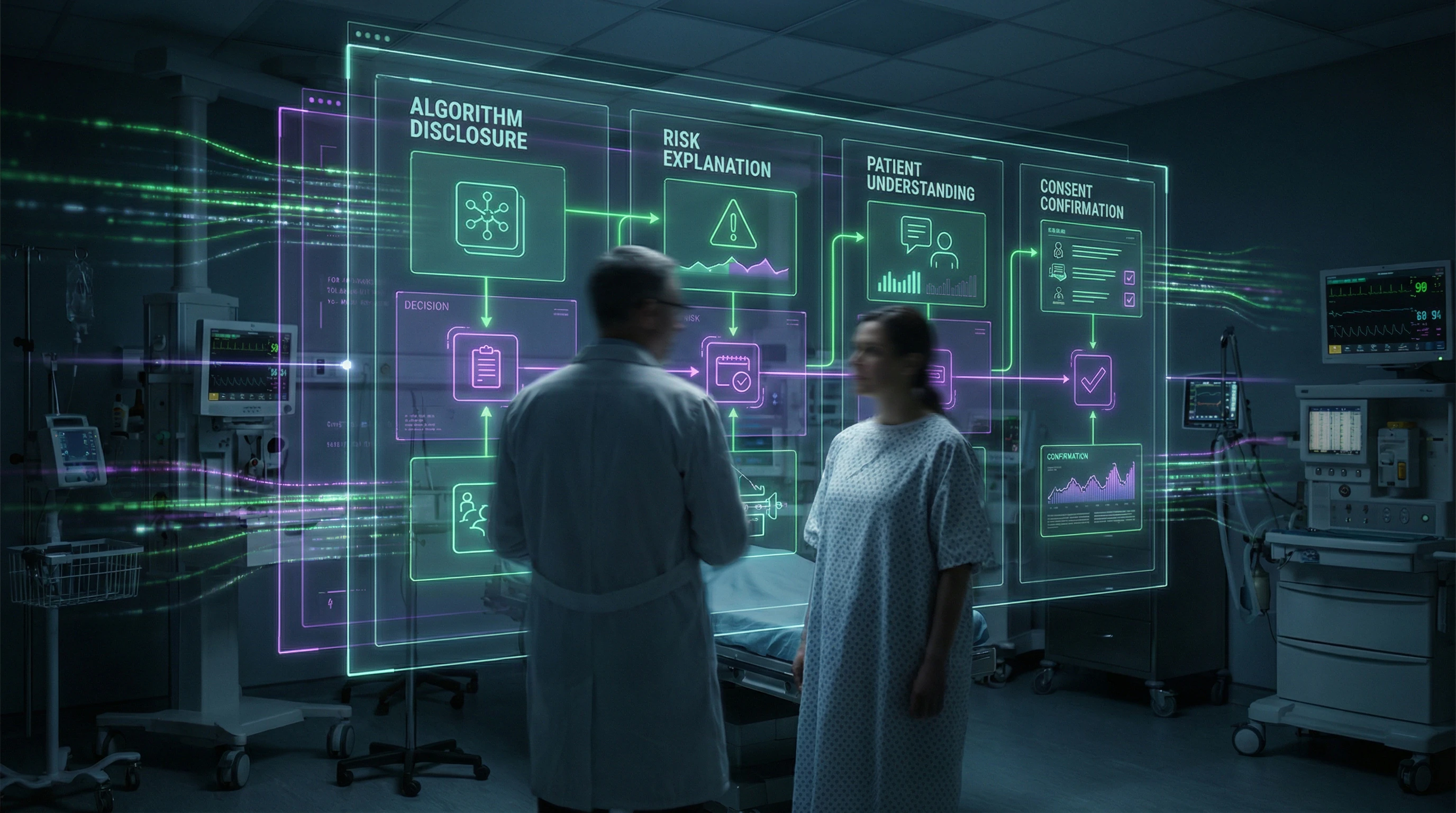

Автономия пациента и информированное согласие в эпоху алгоритмов

Традиционная модель информированного согласия предполагает, что пациент понимает природу предлагаемого вмешательства, но ИИ-системы создают «чёрный ящик», где логика принятия решений остаётся непрозрачной даже для врачей. Исследования AI-ассистированной интраоперационной визуализации для идентификации паращитовидных желёз показывают, что системы компьютерного зрения используют сложные алгоритмы, механизм работы которых не всегда объясним в клинических терминах.

Пациент имеет право знать, что диагностическое или терапевтическое решение основано на алгоритме, а не только на клиническом суждении врача. Без этого знания автономия пациента — его способность принимать информированные решения о собственном здоровье — оказывается нарушенной.

- Протокол получения согласия

- Должен включать объяснение роли ИИ-системы: является ли она вспомогательным инструментом или принимает решения автономно, какова точность алгоритма, какие альтернативные методы существуют.

- Клиническая значимость

- Особенно высока в контексте хирургических вмешательств, где ошибка идентификации анатомических структур может привести к серьёзным осложнениям — например, случайному удалению паращитовидных желёз с последующей гипокальциемией или повреждению возвратного гортанного нерва.

Врач остаётся ответственным за конечное решение, но пациент должен понимать, на основе каких данных это решение принято.

Прозрачность и объяснимость алгоритмов: требование или утопия

Современные ИИ-системы, особенно основанные на глубоком обучении, представляют собой многослойные нейронные сети с миллионами параметров, что делает их решения практически необъяснимыми в традиционном смысле. Систематический обзор AI-ассистированной идентификации паращитовидных желёз указывает на необходимость валидации диагностической производительности этих систем, но не раскрывает механизмы, по которым алгоритм распознаёт ткань.

Врач должен доверять инструменту, не понимая полностью, как он работает — ситуация, аналогичная использованию сложного медицинского оборудования, но с критическим отличием: ИИ влияет на клиническое суждение, а не только на измерение параметров.

Практическое решение лежит в разработке «объяснимого ИИ» (explainable AI, XAI) — систем, которые могут предоставить клинически значимое обоснование своих рекомендаций. Для хирургических приложений это может означать визуализацию областей изображения, которые алгоритм идентифицировал как паращитовидную ткань, с указанием уровня уверенности.

- Данные, на которых система обучалась

- Метрики производительности в валидационных исследованиях

- Известные ограничения и случаи ошибочных результатов

- Условия, при которых рекомендация алгоритма может быть недостоверной

Без этой информации врач не может критически оценить рекомендацию алгоритма и несёт ответственность за решения, принятые на основе непрозрачных данных.

Информационная безопасность медицинских данных: почему утечка — это не только штраф, но и жизни

Медицинские данные — наиболее чувствительная категория персональной информации. Их компрометация приводит не только к нарушению приватности, но и к прямому физическому вреду пациентам.

ИИ-системы требуют массивных датасетов для обучения и валидации. Сетевые мета-анализы эффективности анти-VEGF терапий для неоваскулярной возрастной макулярной дегенерации объединяют данные множества клинических исследований для сравнения визуальных исходов и профилей безопасности различных препаратов. Каждая точка данных — это реальный пациент с уникальной медицинской историей.

| Риск утечки | Последствия |

|---|---|

| Дискриминация при страховании | Отказ в покрытии, повышение премий |

| Дискриминация при найме | Отказ в трудоустройстве на основе медицинского статуса |

| Целенаправленные атаки | Физический вред, шантаж, вымогательство |

Защита персональных данных пациентов: от деидентификации до дифференциальной приватности

Традиционная деидентификация — удаление прямых идентификаторов (имени, адреса, даты рождения) — оказывается недостаточной в эпоху больших данных и машинного обучения.

Систематические обзоры, анализирующие связь между индексом массы тела и риском рака молочной железы по молекулярным подтипам, используют данные, которые включают демографические характеристики, менопаузальный статус, гормональный статус рецепторов и HER2-статус. Комбинация этих характеристик может быть уникальной и позволять реидентификацию даже при удалении имени. Клиническая значимость понимания дифференциальных эффектов ИМТ на различные подтипы рака требует детальных данных — это создаёт напряжение между научной ценностью и защитой приватности.

Дифференциальная приватность — математический метод, добавляющий контролируемый «шум» к данным таким образом, что статистические выводы остаются валидными, но индивидуальные записи не могут быть восстановлены.

Для обучения ИИ-систем идентификации паращитовидных желёз это означает, что алгоритм может учиться на реальных хирургических изображениях без возможности связать конкретное изображение с конкретным пациентом.

Федеративное обучение — ещё один подход, при котором модель обучается локально на данных каждого медицинского учреждения, а в центр передаются только обновления параметров модели, но не сами данные. Эти технологии не являются абсолютной защитой, но значительно повышают порог сложности для потенциальных атак.

Протоколы шифрования и контроля доступа: технические барьеры против человеческого фактора

Большинство утечек медицинских данных происходит не из-за технических уязвимостей, а из-за человеческого фактора: фишинговые атаки, слабые пароли, несанкционированный доступ инсайдеров.

Сетевые мета-анализы, сравнивающие эффективность различных анти-VEGF агентов (афлиберцепт, ранибизумаб, бевацизумаб, бролуцизумаб, фарицимаб), требуют доступа к детальным данным клинических исследований, которые часто хранятся в распределённых системах. Каждая точка доступа — потенциальная уязвимость.

- Принцип минимальных привилегий: каждый пользователь получает доступ только к необходимым данным и только на время выполнения конкретной задачи

- End-to-end шифрование данных в покое и при передаче

- Многофакторная аутентификация для всех пользователей

- Аудит всех обращений к данным с автоматическим выявлением аномальных паттернов доступа

- Регулярные пентесты (тестирование на проникновение)

- Обязательное обучение персонала основам информационной безопасности

Для ИИ-систем, работающих с медицинскими изображениями, критически важно шифрование на уровне хранилища. Интраоперационные изображения паращитовидных желёз содержат не только целевую анатомическую структуру, но и окружающие ткани, по которым потенциально можно идентифицировать пациента.

Технология защиты данных развивается медленнее, чем технология их использования — этот разрыв создаёт окно уязвимости, которое растёт с каждым новым ИИ-приложением в клинике.

ИИ как инструмент поддержки хирургических решений: ассистент, а не автопилот

Фундаментальное заблуждение в дискуссиях об ИИ в хирургии — представление о том, что технология может или должна заменить хирурга. Системы AI-ассистированной интраоперационной визуализации для идентификации паращитовидных желёз позиционируются как вспомогательные инструменты, находящиеся на стадии валидации.

Клиническая потребность в таких системах обусловлена объективной сложностью: случайное удаление или повреждение паращитовидных желёз приводит к гипокальциемии, ошибочная идентификация увеличивает риск повреждения возвратного гортанного нерва. ИИ не принимает решение «удалять или не удалять» — он предоставляет дополнительную информацию для принятия этого решения хирургом.

Интраоперационная идентификация паращитовидных желёз: где компьютерное зрение превосходит человеческое

Системы компьютерного зрения анализируют интраоперационные изображения в режиме реального времени, используя алгоритмы, обученные на тысячах аннотированных хирургических изображений. Преимущество ИИ — способность обрабатывать множество визуальных признаков одновременно: цвет, текстура, васкуляризация, положение относительно других структур.

Человеческий глаз может пропустить тонкие различия, особенно при атипичном расположении железы или изменённой анатомии после предыдущих операций. ИИ сравнивает текущее изображение с обширной базой референсных случаев, что расширяет диагностический спектр.

| Параметр | Возможность ИИ | Ограничение |

|---|---|---|

| Размер паращитовидной железы | Обнаружение структур 3–8 мм в режиме реального времени | Редкие анатомические варианты могут отсутствовать в датасете обучения |

| Визуальные признаки | Одновременный анализ цвета, текстуры, васкуляризации | Сходство с лимфатическими узлами, жировой тканью, тканью щитовидной железы |

| Клинический контекст | Предоставление рекомендации на основе изображения | Отсутствие доступа к предоперационным данным, лабораторным показателям, истории болезни |

Диагностическая производительность системы — это не замена клинического суждения, а его расширение. Только хирург может интегрировать информацию ИИ с полным клиническим контекстом: предоперационными данными визуализации, лабораторными показателями паратгормона, интраоперационными находками.

Границы автоматизации и роль хирурга: почему последнее слово всегда за человеком

Автоматизация в хирургии имеет жёсткие пределы, определяемые не только технологическими ограничениями, но и этическими и юридическими рамками. Технология находится на стадии валидации, что означает: она не готова к автономному применению без надзора опытного специалиста.

Хирургическое решение — это не только идентификация анатомической структуры, но и оценка рисков и пользы конкретного действия для конкретного пациента в конкретной клинической ситуации. ИИ не имеет доступа к полному контексту: истории болезни, предпочтениям пациента, сопутствующим заболеваниям, социальным факторам, которые могут влиять на исход.

Оптимальная модель — «человек в петле» (human-in-the-loop): ИИ предоставляет рекомендацию с указанием уровня уверенности, хирург критически оценивает эту рекомендацию и принимает окончательное решение.

- Система выделяет подозрительную структуру на экране с указанием уровня уверенности.

- Хирург визуально подтверждает находку, оценивает её в контексте окружающей анатомии.

- Хирург принимает решение о дальнейших действиях на основе полного клинического контекста.

- Юридическая ответственность за исход операции лежит на хирурге, а не на алгоритме.

ИИ — это инструмент, расширяющий возможности хирурга, но не заменяющий его экспертизу, опыт и способность к клиническому суждению в условиях неопределённости.

Ответственность и подотчётность в ИИ-системах: кто отвечает, когда алгоритм ошибается

Распределение ответственности между разработчиками и клиницистами

Юридическая модель ответственности за медицинские ИИ-системы остаётся фрагментированной: разработчик несёт ответственность за дефекты продукта, клиницист — за клиническое решение, принятое с использованием этого продукта.

Для систем компьютерного зрения в хирургии паращитовидных желёз это означает: если алгоритм пропускает железу из-за технической ошибки, ответственность может лежать на производителе; если хирург игнорирует корректное предупреждение или слепо следует ложноположительному сигналу без клинической верификации, ответственность переходит на него.

Когда система выдаёт рекомендацию без объяснения логики, клиницист не может оценить её надёжность — это создаёт этическую дилемму: доверять непрозрачному алгоритму или полагаться только на собственный опыт.

Регуляторные органы (FDA, EMA) требуют валидации на независимых датасетах и постмаркетингового мониторинга, но стандарты «достаточной прозрачности» для клинического применения всё ещё формируются.

Юридические аспекты медицинских ошибок при использовании ИИ

Прецедентное право по ИИ-ассистированным медицинским ошибкам практически отсутствует, что создаёт правовую неопределённость для всех участников.

| Сценарий ошибки | Вопрос для суда | Ответственный |

|---|---|---|

| Алгоритм не идентифицировал паращитовидную железу | Технический дефект системы? | Производитель |

| Хирург не прошёл обучение работе с ИИ | Недостаточная подготовка? | Учреждение |

| Хирург проигнорировал предупреждение системы | Клиническая небрежность? | Хирург |

Доктрина информированного согласия требует пересмотра: должен ли пациент быть уведомлён, что в операции используется ИИ-система, каковы её показатели точности, и имеет ли он право отказаться от её применения.

Страховые компании начинают включать ИИ-ассистированные процедуры в полисы профессиональной ответственности, но премии и условия покрытия сильно варьируют, отражая неопределённость рисков.

FIG_02: Модель распределения ответственности в ИИ-ассистированной хирургии

┌─────────────────────────────────────────────────────────────┐ │ УРОВЕНЬ ОТВЕТСТВЕННОСТИ │ СУБЪЕКТ │ ТИП РИСКА │ ├─────────────────────────────────────────────────────────────┤ │ Технический дефект алгоритма │ Разработчик│ Product │ │ Недостаточная валидация │ Регулятор │ Regulatory │ │ Неправильная интерпретация │ Клиницист │ Clinical │ │ Отсутствие обучения персонала │ Учреждение │ Institutional│ │ Игнорирование предупреждений │ Хирург │ Professional│ └─────────────────────────────────────────────────────────────┘

Систематические обзоры и мета-анализы: этика синтеза данных в эпоху информационного изобилия

Минимизация предвзятости публикаций и селективного представления результатов

Publication bias — систематическое искажение, при котором исследования с положительными результатами публикуются чаще, чем с отрицательными или нулевыми, — остаётся главной угрозой валидности мета-анализов.

Для систематического обзора по анти-VEGF терапии при неоваскулярной возрастной макулярной дегенерации это критично: если исследования, показавшие отсутствие различий между препаратами, остаются неопубликованными, сетевой мета-анализ переоценит эффективность одних агентов относительно других.

Методы детекции (воронкообразные графики, тест Эггера, trim-and-fill анализ) имеют ограниченную чувствительность при малом числе исследований — это не баг, а фундаментальное ограничение статистики малых выборок.

Этический протокол для авторов систематических обзоров:

- Поиск неопубликованных данных через регистры клинических исследований (ClinicalTrials.gov, EudraCT).

- Контакт с авторами оригинальных исследований для получения неопубликованных результатов.

- Явное обсуждение потенциального влияния publication bias на выводы.

Прозрачность методологии отбора исследований и анализа подгрупп

Предрегистрация протокола систематического обзора (PROSPERO для медицинских обзоров) фиксирует критерии включения, стратегию поиска и план анализа до начала работы.

Для обзора по связи ИМТ и риска рака молочной железы это означает: авторы должны заранее определить, будут ли они анализировать подгруппы по менопаузальному статусу и молекулярным подтипам, или эти анализы будут exploratory.

Post-hoc анализы подгрупп без предварительной спецификации резко увеличивают риск ложноположительных находок (p-hacking) и должны интерпретироваться как генерирующие гипотезы, а не подтверждающие.

Отчётность следует стандартам PRISMA (Preferred Reporting Items for Systematic Reviews and Meta-Analyses):

- Полная блок-схема отбора исследований.

- Таблицы характеристик включённых и исключённых исследований.

- Оценка риска систематической ошибки для каждого исследования с использованием валидированных инструментов (Cochrane RoB 2, ROBINS-I).

Будущее этики ИИ в персонализированной медицине: от равного доступа к справедливым алгоритмам

Справедливость доступа к ИИ-технологиям и цифровое неравенство

Внедрение ИИ-систем в клиническую практику углубляет существующее неравенство в здравоохранении: технологии концентрируются в крупных академических центрах развитых стран, оставляя периферийные и низкоресурсные учреждения без доступа. Для ИИ-ассистированной идентификации паращитовидных желёз это означает разрыв в качестве помощи — хирурги в хорошо оснащённых клиниках получают инструмент, снижающий риск осложнений, их коллеги в региональных больницах работают без этой поддержки.

Экономические барьеры: высокая стоимость лицензий, необходимость специализированного оборудования (высокоразрешающие камеры, вычислительные мощности) и обучения персонала. Этический ответ требует разработки open-source решений, субсидирования внедрения в низкоресурсных условиях и включения критериев справедливого доступа в регуляторную оценку.

Справедливость в ИИ-медицине — не благотворительность, а условие валидности самой технологии. Система, работающая только для богатых центров, не решает клиническую задачу, а воспроизводит социальное неравенство.

Предотвращение алгоритмической дискриминации и обеспечение репрезентативности данных

Алгоритмическая предвзятость возникает, когда обучающие данные не репрезентативны для популяции, на которой система будет применяться. Если ИИ-модель для идентификации паращитовидных желёз обучена преимущественно на изображениях пациентов европейского происхождения, её точность может быть ниже у пациентов других этнических групп из-за различий в анатомии, пигментации тканей или сопутствующей патологии.

Систематические обзоры должны оценивать демографический состав участников включённых исследований и явно обсуждать ограничения обобщаемости результатов. Для мета-анализа анти-VEGF терапии критично учитывать, что эффективность и безопасность различаются между популяциями из-за генетических факторов, паттернов коморбидности и доступа к мониторингу.

| Уровень проверки | Что оценивать | Красный флаг |

|---|---|---|

| Данные обучения | Демографический состав, географическое происхождение образцов | Более 80% одной этнической группы или региона |

| Валидация | Точность по подгруппам (возраст, пол, этнос, коморбидность) | Разброс точности >5% между подгруппами |

| Регуляция | Явное указание ограничений применимости в инструкции | Отсутствие анализа справедливости в документации |

Регуляторные требования эволюционируют в сторону обязательной оценки справедливости: разработчики должны демонстрировать, что система работает с сопоставимой точностью для всех релевантных подгрупп, или явно указывать ограничения применимости.

Алгоритм, который работает хорошо в среднем, но плохо для меньшинства, — это не прогресс, а систематизированная ошибка. Справедливость — это не дополнение к валидности, а её часть.

FIG_03: Принципы этичного внедрения ИИ в медицину

┌──────────────────────────────────────────────────────────────┐

│ ПРИНЦИП │ РЕАЛИЗАЦИЯ │ МЕТРИКА │

├──────────────────────────────────────────────────────────────┤

│ Прозрачность │ Explainable AI │ SHAP values │

│ Справедливость │ Diverse datasets │ Equity metrics│

│ Подотчётность │ Audit trails │ Decision logs │

│ Безопасность │ Validation studies │ AUC, NPV, PPV │

│ Конфиденциальность │ Federated learning │ Privacy budget│

│ Человеческий контроль│ Human-in-the-loop │ Override rate │

└──────────────────────────────────────────────────────────────┘

↓

КЛИНИЧЕСКАЯ ПОЛЬЗА > ТЕХНОЛОГИЧЕСКИЙ РИСК

Knowledge Access Protocol

FAQ

Часто задаваемые вопросы

Этика ИИ в медицине — это система принципов, регулирующих разработку и применение искусственного интеллекта в клинической практике. Она включает автономию пациента, прозрачность алгоритмов, справедливость доступа и защиту персональных данных. Эти принципы обеспечивают безопасное внедрение технологий при сохранении врачебной ответственности.

ИИ-системы компьютерного зрения анализируют интраоперационные изображения в реальном времени, помогая хирургам распознавать паращитовидные железы. Это снижает риск случайного повреждения или удаления желез, что предотвращает гипокальциемию. Технология остается вспомогательным инструментом, окончательное решение принимает хирург.

Да, информированное согласие обязательно при использовании ИИ-систем в диагностике и лечении. Пациент должен понимать, что алгоритмы участвуют в принятии решений, какие данные обрабатываются и каковы риски. Это соответствует принципу автономии и требованиям медицинской этики.

Нет, это распространенный миф — ИИ не заменяет врачей, а дополняет их работу. Алгоритмы анализируют данные и предлагают варианты, но клиническое мышление, эмпатия и ответственность остаются за специалистом. Систематические обзоры подтверждают, что ИИ эффективен только как инструмент поддержки решений.

Защита обеспечивается протоколами шифрования, контролем доступа и анонимизацией персональных данных пациентов. Системы должны соответствовать требованиям информационной безопасности и законодательству о защите данных. Регулярные аудиты и сертификация подтверждают надежность технологий.

Ответственность распределяется между разработчиками алгоритма, медицинским учреждением и лечащим врачом. Врач несет основную клиническую ответственность, так как принимает окончательное решение на основе рекомендаций ИИ. Юридические аспекты требуют четкой документации процесса принятия решений.

Прозрачность означает, что врачи и пациенты могут понять, как ИИ-система пришла к конкретному выводу или рекомендации. Объяснимые алгоритмы показывают ключевые факторы, влияющие на решение, что повышает доверие. Это критически важно для клинической практики и этической приемлемости технологий.

Оцените прозрачность методологии отбора исследований, наличие протокола и анализа предвзятости публикаций. Качественный мета-анализ указывает критерии включения, базы данных поиска и статистические методы. Систематические обзоры из PubMed обычно проходят строгую экспертную оценку.

Да, алгоритмическая дискриминация возможна, если обучающие данные содержат предвзятость по полу, возрасту, этнической принадлежности или социальному статусу. Это приводит к неравному качеству диагностики и лечения для разных групп. Предотвращение требует разнообразных датасетов и регулярного аудита справедливости алгоритмов.

Нет, это заблуждение — точность ИИ зависит от качества данных, контекста и типа задачи. В некоторых узких областях (например, анализ изображений) алгоритмы показывают высокую точность, но уступают в комплексной оценке. Оптимальный результат достигается при совместной работе врача и ИИ.

Справедливость требует доступности технологий для всех медицинских учреждений независимо от региона и финансирования. Необходимы государственные программы поддержки, стандартизация и обучение специалистов. Это предотвращает цифровое неравенство в качестве медицинской помощи между городами и регионами.

Предвзятость публикаций возникает, когда исследования с положительными результатами публикуются чаще, чем с отрицательными или нейтральными. Это искажает выводы мета-анализа и завышает эффективность вмешательств. Минимизация требует поиска неопубликованных данных и статистических тестов на предвзятость.

Нет, критические решения о жизни и смерти должны оставаться за врачами с учетом этических принципов и человеческого суждения. ИИ может предоставлять прогностическую информацию, но не имеет морального статуса для таких решений. Автоматизация в критических ситуациях этически неприемлема.

ИИ трансформирует роль хирурга из исполнителя в супервизора высокотехнологичных систем, сохраняя за ним окончательный контроль. Алгоритмы помогают в идентификации структур и планировании, но мануальные навыки и клиническое мышление остаются незаменимыми. Это требует новых компетенций в работе с цифровыми инструментами.

Непрозрачные алгоритмы («черные ящики») затрудняют выявление ошибок, снижают доверие врачей и пациентов, создают юридические риски. Невозможность объяснить решение препятствует клиническому обучению и верификации рекомендаций. Это может привести к неправильному лечению и этическим нарушениям.

Этика будет фокусироваться на справедливости доступа к персонализированным технологиям, защите геномных данных и предотвращении дискриминации по генетическим признакам. Потребуются новые регуляторные рамки для балансирования инноваций и прав пациентов. Международное сотрудничество станет ключевым для выработки универсальных стандартов.