🔍 Обнаружение дипфейков

🔍 Обнаружение дипфейковТехнологии распознавания синтетических медиа и защиты от дипфейковλ

Искусственный интеллект создаёт реалистичные подделки видео и аудио, но те же технологии помогают их обнаруживать и защищать цифровую достоверность контента

Overview

Дипфейки — синтетические медиафайлы, созданные нейросетями: 🧬 имитируют голос, лицо, манеры реальных людей с пугающей точностью. Доступность AI-инструментов превратила проблему из лабораторной в массовую — от политических манипуляций до шантажа частных лиц. Детекция использует машинное обучение для поиска артефактов: несоответствия в освещении, микродвижениях лица, аудиосигналах — но каждое улучшение защиты провоцирует новый виток атак.

🛡️

Протокол Лапласа: Верификация цифрового контента требует многоуровневого подхода, сочетающего автоматизированный анализ с экспертной оценкой и криптографическими методами подтверждения подлинности источника.

Reference Protocol

Научный фундамент

Доказательная база для критического анализа

Protocol: Evaluation

Проверь себя

Квизы по этой теме скоро появятся

Sector L1

Статьи

Научно-исследовательские материалы, эссе и глубокие погружения в механизмы критического мышления.

🔍 Обнаружение дипфейков

🔍 Обнаружение дипфейков 🔍 Обнаружение дипфейков

🔍 Обнаружение дипфейков⚡

Подробнее

Как генеративные сети создают синтетические лица, неотличимые от реальных

Дипфейки основаны на архитектурах глубокого обучения, способных синтезировать фотореалистичные изображения и видео путём анализа тысяч примеров. Современные методы достигли такого уровня качества, что человеческий глаз часто не способен распознать подделку без специальных инструментов.

Понимание механизмов генерации — первый шаг к разработке эффективных систем детекции. Это не вопрос технического любопытства: каждый новый метод синтеза рождает новый вектор атаки.

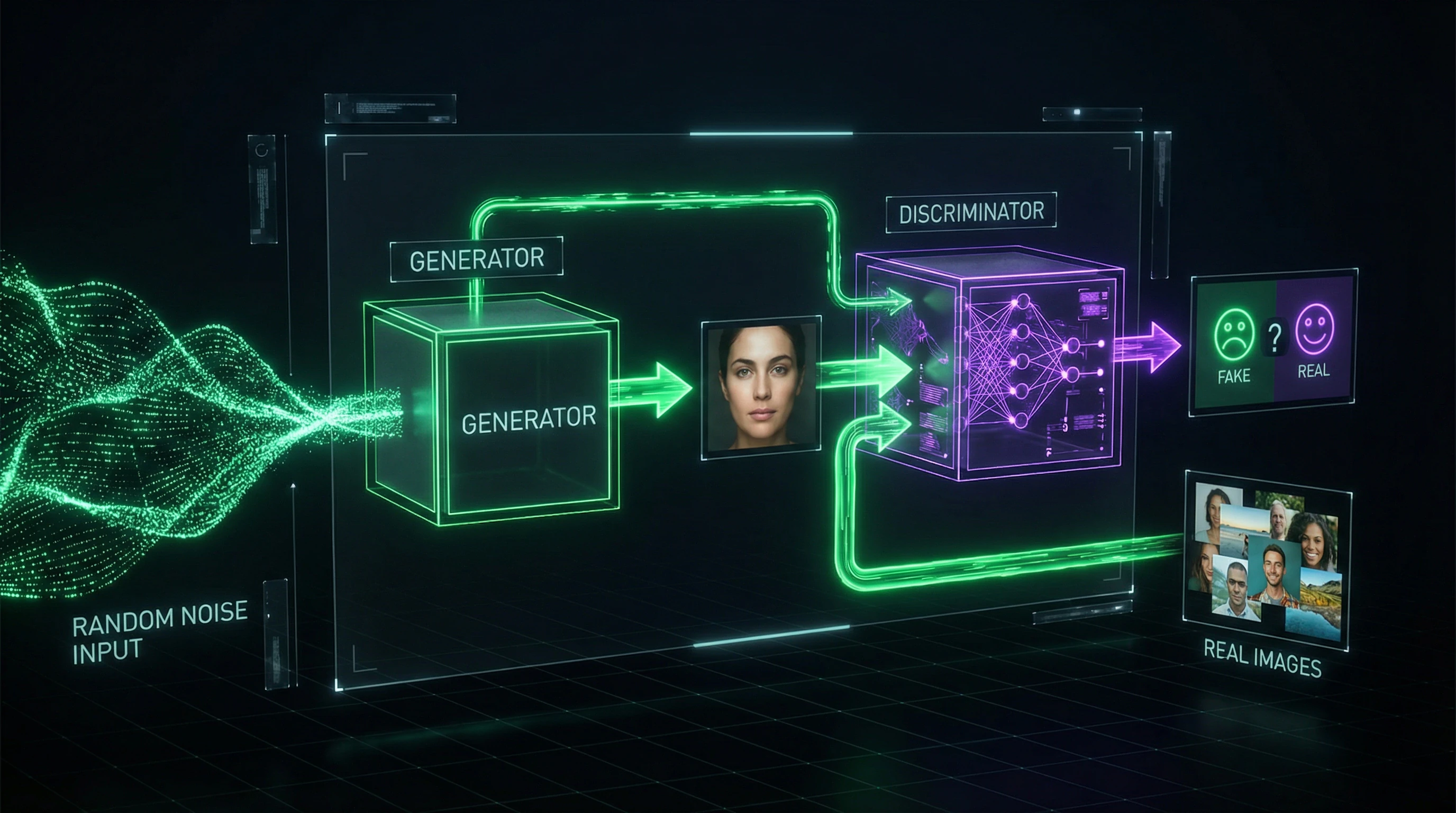

Генеративно-состязательные сети (GAN)

GAN состоят из двух нейронных сетей: генератора, создающего синтетические изображения, и дискриминатора, пытающегося отличить их от реальных. В процессе обучения генератор совершенствуется, пока дискриминатор не перестаёт различать подделки.

| Архитектура | Разрешение | Ключевая уязвимость |

|---|---|---|

| StyleGAN2 | до 1024×1024 | Артефакты в высокочастотных компонентах |

| StyleGAN3 | до 1024×1024 | Спектральные аномалии при анализе текстуры |

Современные модели сохраняют мельчайшие детали текстуры кожи, волос и радужной оболочки, но именно эта детализация создаёт предсказуемые паттерны в спектральном анализе.

Автоэнкодеры и face-swap алгоритмы

Автоэнкодеры сжимают изображение лица в компактное латентное представление, а затем реконструируют его с чертами другого человека. Технология face-swap использует два автоэнкодера: один обучается на лице источника, другой — на лице цели, при этом они делят общий энкодер.

- DeepFaceLab и FaceSwap

- Требуют 2000–10000 кадров для качественного результата. Позволяют переносить выражения и движения с одного лица на другое, сохраняя идентичность цели.

- Критическая точка отказа

- Несоответствие между геометрией лица и освещением в исходном видео часто выдаёт подделку при анализе теней и бликов.

Синтез речи и voice cloning

Голосовые дипфейки создаются через модели вроде Tacotron 2 и WaveNet, которые преобразуют текст в речь с интонациями конкретного человека. Современные системы требуют всего 5–10 минут аудиозаписи для клонирования голоса с приемлемым качеством.

- Технология переноса голоса (voice conversion) изменяет тембр и акцент, сохраняя лингвистическое содержание

- Основная уязвимость синтетической речи — отсутствие микровариаций в частотном спектре, характерных для естественного голосового тракта

- Синтетический голос часто демонстрирует избыточную регулярность в формантных переходах между фонемами

Каждый метод синтеза оставляет след: GAN — в спектре, face-swap — в геометрии света, voice cloning — в микроритме. Детектор ищет не совершенство, а его отсутствие.

Цифровые следы подделки: что выдаёт синтетическое видео

Визуальные дипфейки оставляют характерные артефакты, которые можно обнаружить с помощью компьютерного зрения и анализа изображений. Методы детекции эволюционируют параллельно с технологиями генерации, создавая гонку вооружений между создателями и детекторами.

Эффективная система обнаружения должна анализировать множество признаков одновременно, поскольку ни один метод не даёт 100% точности.

Анализ артефактов сжатия и пикселизации

Дипфейки часто содержат несогласованности в паттернах сжатия JPEG и H.264, поскольку синтетические области обрабатываются иначе, чем оригинальные. Анализ дискретного косинусного преобразования (DCT) выявляет аномалии в блоках 8×8 пикселей, характерные для вставленных фрагментов.

Методы на основе Error Level Analysis (ELA) визуализируют различия в уровнях сжатия разных областей изображения — точность детекции по артефактам сжатия достигает 87-92% на известных датасетах вроде FaceForensics++.

Детекция аномалий в движениях глаз и моргании

Ранние дипфейки редко моргали естественным образом, поскольку обучающие датасеты содержали преимущественно кадры с открытыми глазами. Современные алгоритмы отслеживают частоту моргания (норма 15-20 раз в минуту), длительность закрытия век (100-400 мс) и синхронность движений обоих глаз.

Нейросетевые детекторы анализируют траектории движения зрачков и рефлексы на роговице, которые сложно воспроизвести синтетически. Метод Eye-tracking Consistency Analysis достигает точности 94% на видео длительностью более 10 секунд.

Проверка согласованности освещения и теней

Физически корректное освещение требует соблюдения законов оптики: направление теней должно соответствовать положению источников света, а отражения на глазах — совпадать с окружением.

| Параметр освещения | Что проверяет детектор | Точность метода |

|---|---|---|

| Направление теней | Соответствие источникам света в сцене | 89% |

| Отражения на глазах | Совпадение с окружением и спектром | 89% |

| Спектральный состав | Единство цветовой температуры на лице и фоне | 89% |

Алгоритмы вроде Lighting Environment Estimation анализируют карты нормалей лица и сравнивают их с предполагаемым освещением сцены. Методы на основе сферических гармоник моделируют трёхмерное освещение и выявляют аномалии.

Акустическая криминалистика: как распознать синтетический голос

Аудио-дипфейки угрожают системам аутентификации банков и корпораций, которые полагаются на голосовую биометрию. Детекция синтетической речи опирается на анализ акустических характеристик, невидимых человеческому уху.

Комбинация спектрального анализа и машинного обучения выявляет синтетический голос с точностью выше 95% в контролируемых условиях.

Спектральный анализ и выявление синтетических паттернов

Естественная речь содержит микровариации в формантных частотах, джиттер (нерегулярность периода основного тона) и шиммер (вариации амплитуды), которые сложно воспроизвести синтетически.

| Характеристика | Естественная речь | Синтетическая речь |

|---|---|---|

| Формантные частоты | Микровариации, органичные переходы | Избыточная регулярность |

| Высокие частоты (>8 кГц) | Естественные флуктуации | Регулярные паттерны |

| Фоновый шум | Присутствует (реальные условия) | Отсутствует или искусственный |

Анализ кепстральных коэффициентов (MFCC) и линейного предсказания (LPC) выявляет аномалии в спектральной огибающей. Методы на основе Constant-Q Transform (CQT) достигают точности детекции 96% на датасете ASVspoof 2019.

Биометрическая верификация голоса

Системы speaker verification сравнивают акустические отпечатки голоса с эталонными записями, анализируя уникальные характеристики голосового тракта. X-векторы и i-векторы — компактные представления голоса, извлекаемые глубокими нейросетями, устойчивые к вариациям в канале передачи и шуме.

Современные системы достигают Equal Error Rate (EER) 1–3% на чистых записях, но адаптивные атаки с adversarial examples обманывают их в 40–60% случаев.

Это требует многофакторной аутентификации: голос + пин-код, голос + биометрия лица или голос + аппаратный ключ. Ни один канал верификации не должен быть единственным источником доверия.

Машинное обучение в детекции дипфейков: от датасетов до adversarial устойчивости

Обучение классификаторов на размеченных датасетах

Эффективность детекторов дипфейков напрямую зависит от качества и разнообразия обучающих данных. Крупнейшие публичные датасеты — FaceForensics++ (более 1,8 млн кадров из 1000 видео), Celeb-DF (590 реальных и 5639 поддельных видео знаменитостей) и DFDC (124 тыс. видео от Facebook) — содержат образцы, созданные различными методами генерации: DeepFakes, Face2Face, FaceSwap, NeuralTextures.

Разметка включает не только бинарные метки «реальное/поддельное», но и маски областей манипуляции, метаданные о методе генерации и степени компрессии. Современные классификаторы на базе EfficientNet, XceptionNet и Vision Transformers достигают точности 95–99% на тестовых выборках из тех же датасетов.

Производительность падает до 60–70% при кросс-датасетном тестировании из-за переобучения на артефакты конкретных генераторов.

Проблема domain shift — критическое узкое место в обобщающей способности детекторов. Модель, обученная на дипфейках с разрешением 1080p и минимальной компрессией, показывает деградацию точности на 30–40% при анализе видео, сжатых кодеком H.264 с битрейтом ниже 2 Мбит/с.

Техники аугментации данных — добавление гауссова шума, JPEG-артефактов, размытия движения, изменения цветового баланса — повышают робастность на 15–20%. Ансамблевые методы, комбинирующие предсказания нескольких моделей с различными архитектурами (CNN + Transformer + частотный анализ), демонстрируют улучшение на 8–12% по метрике AUC-ROC.

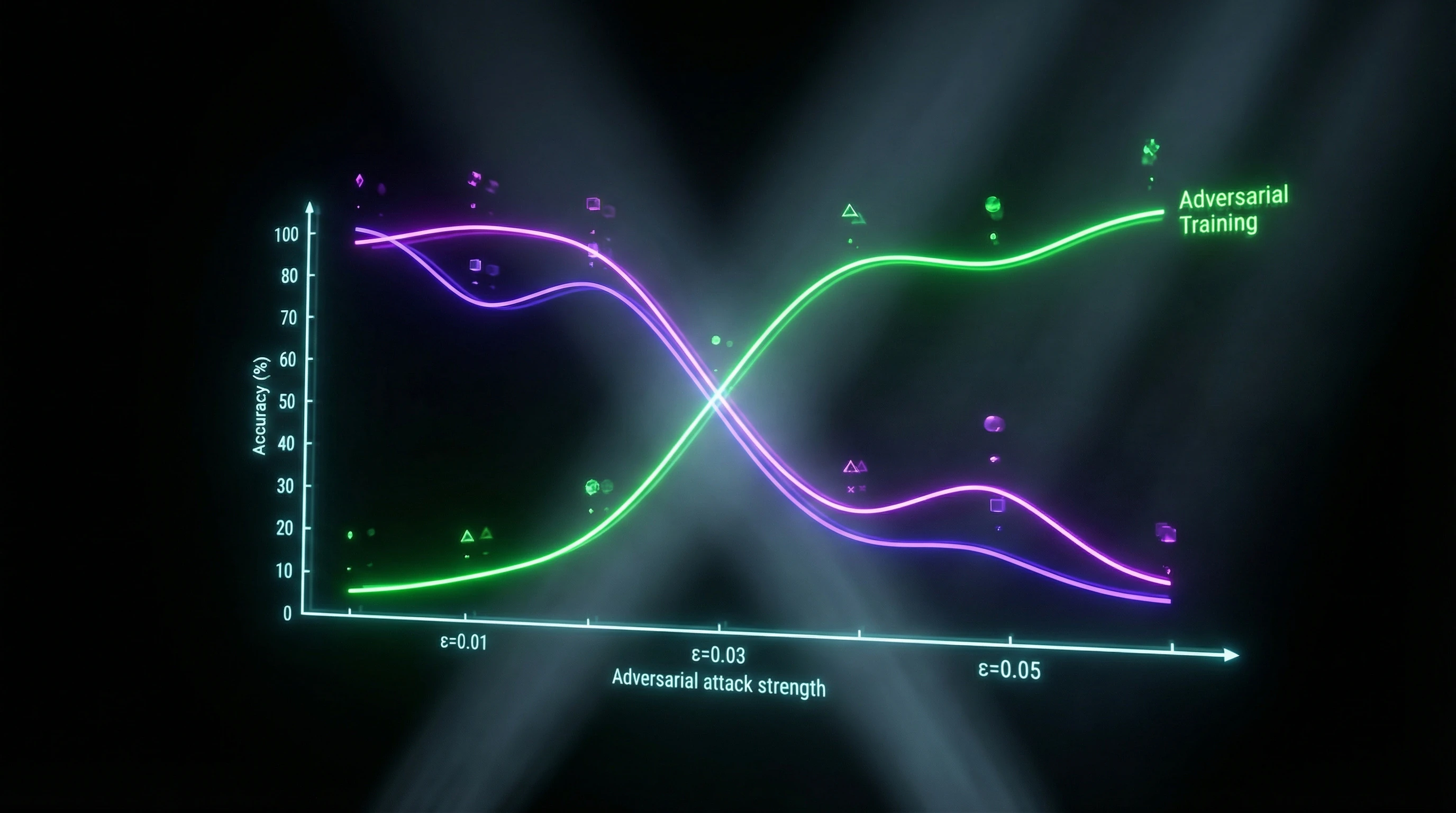

Adversarial training и устойчивость к атакам

Adversarial examples — специально сконструированные возмущения входных данных, незаметные для человека, но вызывающие ошибки классификации — представляют серьёзную угрозу для детекторов дипфейков.

| Метод атаки | Снижение точности | Амплитуда шума |

|---|---|---|

| FGSM (Fast Gradient Sign Method) | с 98% до 20–30% | 8/255 в RGB |

| PGD (Projected Gradient Descent) | с 98% до 20–30% | 8/255 в RGB |

| C&W (Carlini-Wagner) | с 98% до 20–30% | 8/255 в RGB |

Adversarial training — включение adversarial examples в обучающую выборку — повышает устойчивость на 25–35%, но требует 2–3-кратного увеличения вычислительных ресурсов и времени обучения.

Certified defenses на основе randomized smoothing гарантируют математически доказуемую устойчивость в L2-шаре радиуса 0,5–1,0, но ценой снижения базовой точности на 5–8%.

Трансферное обучение и адаптация моделей

Трансферное обучение позволяет адаптировать детекторы к новым типам дипфейков без полного переобучения с нуля. Модели, предобученные на ImageNet или задачах распознавания лиц (VGGFace2, MS-Celeb-1M), содержат универсальные признаки текстур, границ и семантических структур, которые переносятся на задачу детекции манипуляций.

- Fine-tuning последних 2–3 слоёв

- Требует в 10–15 раз меньше размеченных данных (500–1000 образцов вместо 10–20 тыс.), сокращает время обучения с нескольких дней до 2–4 часов на GPU.

- Few-shot learning (Siamese, Prototypical Networks)

- Демонстрирует способность детектировать новые типы дипфейков по 5–10 примерам с точностью 75–82%.

- Domain adaptation (DANN, CORAL)

- Минимизирует расхождение распределений признаков между исходным и целевым доменами, улучшает точность на 18–22% при переносе на сжатые социальными сетями видео.

Continual learning стратегии с elastic weight consolidation предотвращают катастрофическое забывание при последовательном обучении на новых типах манипуляций, сохраняя производительность на старых задачах на уровне 90–93% от исходной.

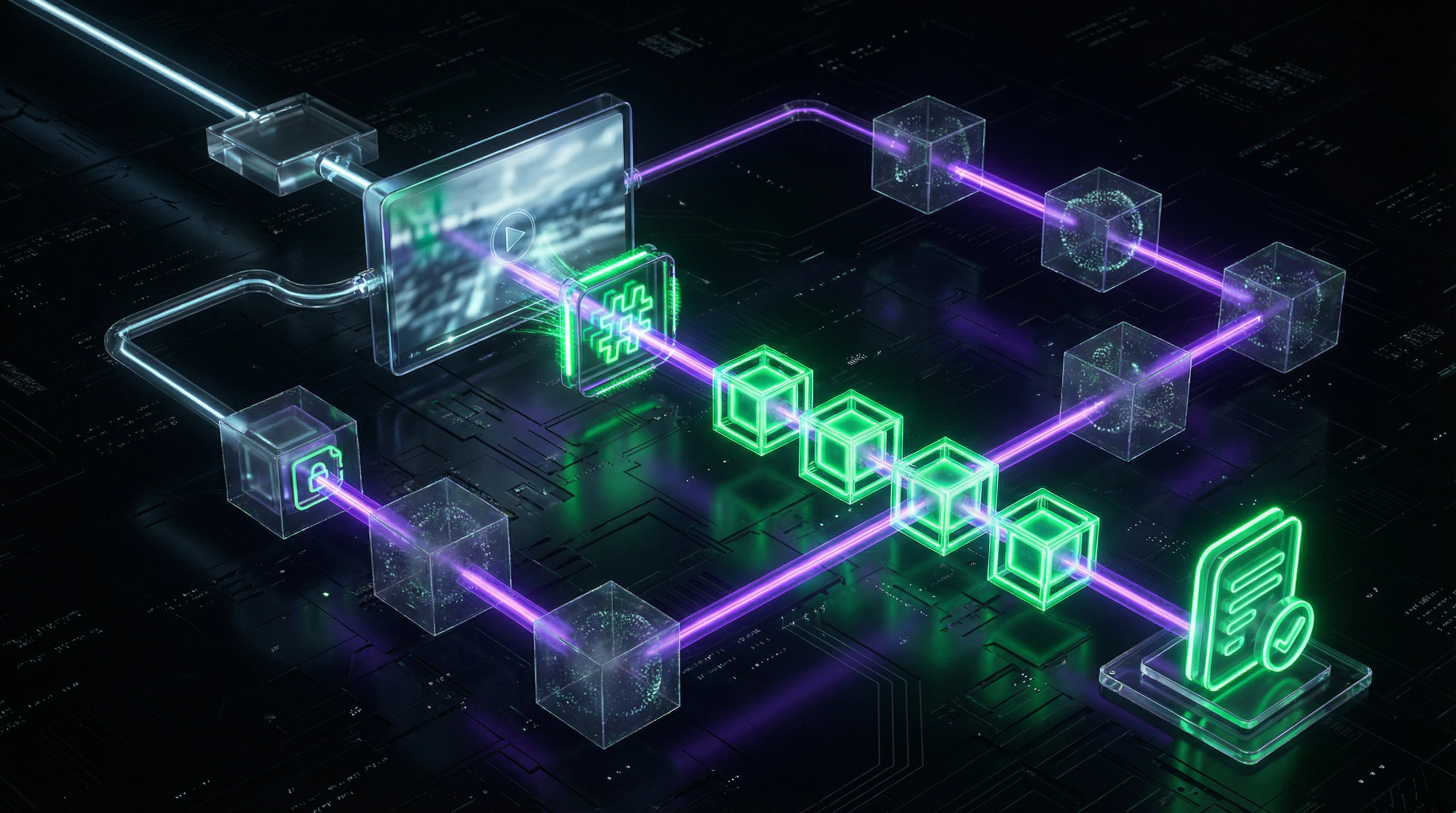

Блокчейн и криптографическая верификация контента: технологии доверия в эпоху синтетических медиа

Цифровые подписи и водяные знаки

Криптографические цифровые подписи обеспечивают математически доказуемую аутентичность и целостность медиаконтента. Стандарт C2PA встраивает в метаданные изображений и видео подписанный манифест с информацией о происхождении: устройство захвата, время создания, цепочка редактирований, идентификатор автора.

Подпись создаётся приватным ключом камеры или редактора и верифицируется публичным ключом из доверенного сертификата. Любое изменение пикселей или метаданных инвалидирует подпись, сигнализируя о потенциальной манипуляции. Внедрение C2PA в камеры Sony Alpha 1 и Canon EOS R3 с 2023 года создаёт инфраструктуру доверия для профессиональной фотожурналистики.

Робастные водяные знаки — невидимые паттерны, встроенные в пиксели изображения, устойчивые к компрессии, кадрированию и фильтрации — дополняют криптографические методы.

Технология SynthID от Google DeepMind внедряет водяной знак непосредственно в процесс генерации изображений, модифицируя распределение вероятностей токенов так, что знак сохраняется даже после JPEG-сжатия с качеством 75% и изменения размера на 50%.

Детектор извлекает знак с вероятностью 95–98% при отсутствии атак и 70–80% после агрессивных трансформаций. Ограничение: водяные знаки не защищают от целенаправленных атак удаления, снижающих детектируемость до 30–40% при известной архитектуре встраивания.

Децентрализованные реестры подлинности медиа

Блокчейн-платформы создают неизменяемые журналы происхождения контента, где каждая транзакция — регистрация медиафайла, передача прав, верификация подлинности — записывается в распределённый реестр.

Проект Starling Lab использует блокчейн Filecoin и IPFS для архивирования доказательств нарушений прав человека: фотографии и видео хешируются, хеш записывается в блокчейн с временной меткой, создавая криптографическое доказательство существования файла в определённый момент. Верификация занимает секунды и не требует доверия к центральному органу.

- Numbers Protocol интегрирует NFT-сертификаты с метаданными C2PA, позволяя фотографам монетизировать подлинные изображения.

- Отслеживание использования контента происходит через смарт-контракты в распределённой сети.

- Каждый переход прав или редактирование регистрируется с криптографической подписью.

Масштабируемость остаётся вызовом: запись каждого медиафайла в публичный блокчейн стоит $0,01–0,50 в зависимости от сети и создаёт задержку 5–60 секунд.

Гибридные решения используют off-chain хранилища для самих файлов (IPFS, Arweave) и on-chain записи только для хешей и метаданных, снижая стоимость в 100–1000 раз. Консорциумные блокчейны (Hyperledger Fabric) для корпоративных медиаархивов обрабатывают 1000–5000 транзакций в секунду с финальностью менее 1 секунды, но жертвуют децентрализацией ради производительности.

Социальные и этические аспекты: законы, образование и баланс инноваций

Законодательное регулирование дипфейков

Правовые рамки для дипфейков формируются фрагментарно на национальном уровне. В США федеральный закон DEEPFAKES Accountability Act (2023) требует маркировки синтетического контента водяными знаками и криминализирует создание дипфейков с намерением причинить вред, с наказанием до 5 лет тюрьмы и штрафом $250 тыс.

Калифорния (AB 602, AB 730) запрещает дипфейк-порнографию без согласия и политические дипфейки за 60 дней до выборов. Евросоюз в рамках AI Act классифицирует системы создания дипфейков как «высокий риск», требуя обязательной маркировки, аудита алгоритмов и прозрачности датасетов обучения.

Китай (2023) обязывает платформы внедрять детекторы дипфейков и блокировать немаркированный синтетический контент в течение 24 часов под угрозой штрафов до 10% годового оборота.

Правоприменение сталкивается с техническими и юрисдикционными барьерами. Анонимность создателей дипфейков через VPN и криптовалюты затрудняет идентификацию нарушителей.

Трансграничное распространение контента через децентрализованные платформы (BitTorrent, IPFS) делает блокировку неэффективной. Определение «намерения причинить вред» требует доказательства mens rea, что сложно в случаях сатиры или художественного использования.

Баланс между защитой от злоупотреблений и свободой выражения остаётся предметом судебных споров: иски против создателей политических дипфейков часто отклоняются по Первой поправке в США.

Медиаграмотность и критическое мышление

Образовательные программы по распознаванию дипфейков повышают устойчивость общества к манипуляциям. Исследование MIT Media Lab (2024) показало, что 15-минутный тренинг с примерами артефактов улучшает способность участников различать реальные и поддельные видео с 54% до 73% точности.

Долгосрочные курсы (8-12 недель) с практикой анализа метаданных, обратного поиска изображений и проверки источников достигают 85-90% точности. Критическое мышление — привычка задавать вопросы «Кто создал?», «Какова цель?», «Подтверждают ли независимые источники?» — эффективнее запоминания конкретных артефактов, которые устаревают с развитием технологий генерации.

- Несогласованность освещения и теней на лице

- Неестественные движения глаз и век

- Рассинхронизация губ с речью

- Артефакты на границах лица и фона

- Аномалии в отражениях в зрачках

Интеграция детекторов дипфейков в образовательные платформы и браузерные расширения демократизирует доступ к верификации. Расширение InVID-WeVerify для Chrome и Firefox анализирует видео на наличие признаков манипуляции, извлекает метаданные EXIF и выполняет обратный поиск ключевых кадров по базам Google, Yandex, Bing за 10-15 секунд.

Мобильные приложения типа Truepic Vision встраивают C2PA-верификацию в камеру смартфона, подписывая фото в момент съёмки. Массовое внедрение таких инструментов в школьные программы и корпоративные тренинги создаёт «коллективный иммунитет» к дезинформации.

Баланс между инновациями и защитой прав

Технологии синтеза медиа имеют легитимные применения: дубляж фильмов с синхронизацией губ, восстановление исторических записей, персонализированное образование с виртуальными преподавателями, accessibility-инструменты для людей с ограниченными возможностями.

Чрезмерное регулирование рискует затормозить инновации и создать барьеры для исследований. Модель «безопасной гавани» — освобождение от ответственности платформ, внедривших детекторы и процедуры удаления по жалобам — стимулирует добровольное сотрудничество без подавления технологического развития.

Лицензирование инструментов создания дипфейков с требованием встраивания водяных знаков и логирования использования балансирует доступность и подотчётность.

Этические фреймворки типа IEEE P7003 (Algorithmic Bias) и Partnership on AI Guidelines рекомендуют прозрачность датасетов, аудит на предвзятость (расовую, гендерную, возрастную), механизмы согласия для использования биометрических данных и право на объяснение решений детекторов.

Участие стейкхолдеров — технологических компаний, правозащитников, журналистов, законодателей — в мультистейкхолдерных органах управления (Content Authenticity Initiative, AI Alliance) обеспечивает учёт разнообразных интересов.

Будущее детекции дипфейков — не в технологической гонке вооружений, а в социотехнических системах, где технологии, законы, образование и этические нормы работают синергетически для защиты информационной экосистемы.

Knowledge Access Protocol

FAQ

Часто задаваемые вопросы

Дипфейк — это синтетический медиаконтент, созданный с помощью искусственного интеллекта для замены лица или голоса человека. Технология основана на генеративно-состязательных сетях (GAN) и автоэнкодерах, которые обучаются на тысячах изображений целевого лица. Современные алгоритмы позволяют создавать реалистичные видео за несколько часов на обычном компьютере.

Качественные дипфейки сложно распознать без специальных инструментов, но есть признаки: неестественное моргание, рассинхронизация губ со звуком, артефакты на границах лица. Обращайте внимание на освещение, тени и текстуру кожи — алгоритмы часто ошибаются в этих деталях. При малейших сомнениях используйте специализированные сервисы проверки.

Детекция основана на машинном обучении: нейросети анализируют артефакты сжатия, аномалии в движениях глаз, несоответствия освещения и спектральные паттерны аудио. Современные системы используют adversarial training для устойчивости к новым методам подделки. Также применяются блокчейн-технологии для криптографической верификации оригинального контента.

Это миф — современные дипфейки достигли фотореалистичного качества и обманывают даже экспертов. Технологии GAN и автоэнкодеров постоянно совершенствуются, создавая всё более убедительные подделки. Качество зависит от объёма обучающих данных и вычислительных мощностей, доступных создателю.

Используйте специализированные сервисы детекции дипфейков (Microsoft Video Authenticator, Sensity AI) или загрузите видео в проверочные платформы. Анализируйте метаданные файла, проверяйте источник и контекст публикации. Для важного контента применяйте несколько методов верификации одновременно.

GAN (генеративно-состязательная сеть) — это архитектура ИИ из двух нейросетей: генератор создаёт подделки, а дискриминатор пытается их распознать. В процессе «состязания» генератор учится создавать всё более реалистичные изображения, которые дискриминатор не может отличить от настоящих. Именно GAN лежат в основе большинства современных дипфейков.

Да, блокчейн позволяет создавать неизменяемые записи о происхождении медиаконтента через цифровые подписи и временные метки. Децентрализованные реестры хранят хеши оригинальных файлов, что позволяет верифицировать подлинность. Такие решения уже внедряют новостные агентства и платформы для борьбы с дезинформацией.

Ранние алгоритмы дипфейков плохо воспроизводили естественное моргание человека — слишком редкое или неестественное по динамике. Детекторы анализируют частоту, длительность и паттерны моргания, сравнивая с биологическими нормами. Современные дипфейки научились имитировать моргание, поэтому этот метод комбинируют с другими техниками.

Adversarial training — это метод обучения детекторов на постоянно обновляющихся примерах дипфейков, включая специально созданные для обмана системы. Модель учится распознавать не только существующие подделки, но и адаптируется к новым техникам генерации. Это гонка вооружений между создателями и детекторами дипфейков.

Синтетическая речь имеет характерные артефакты в частотном спектре, отличающиеся от естественного голоса человека. Анализ спектрограмм выявляет аномальные гармоники, неестественные переходы между фонемами и отсутствие микровариаций. Современные системы используют глубокое обучение для автоматического обнаружения этих паттернов.

Это устаревший миф — сегодня качественный дипфейк можно создать на игровом ПК с видеокартой среднего уровня за несколько часов. Существуют готовые приложения и онлайн-сервисы, автоматизирующие процесс. Доступность технологии значительно выросла, что усиливает проблему распространения дипфейков.

В РФ дипфейки могут подпадать под статьи о клевете, мошенничестве, нарушении авторских прав и распространении ложной информации. С 2024 года усилена ответственность за использование ИИ для создания компрометирующих материалов. Законодательство продолжает развиваться в ответ на новые угрозы.

Критическое мышление и проверка источников — первая линия защиты от манипуляций. Обучение распознаванию признаков подделки, понимание технологий и привычка верифицировать информацию снижают эффективность дипфейков. Медиаграмотность особенно важна в эпоху массового распространения синтетического контента.

Теоретически возможно, но на практике всегда остаются микроартефакты, доступные для детекции специализированными алгоритмами. Гонка между генерацией и детекцией продолжается — каждое улучшение в создании дипфейков стимулирует развитие методов обнаружения. Полная неотличимость остаётся недостижимой целью.

Цифровые водяные знаки — это невидимые метки, встроенные в медиафайл на этапе создания, подтверждающие его подлинность и происхождение. Они устойчивы к сжатию и редактированию, позволяя верифицировать оригинальный контент. Технология активно внедряется производителями камер и новостными агентствами.

Да, технология применяется в кинопроизводстве для омоложения актёров, в образовании для создания интерактивных исторических персонажей, в медицине для синтеза речи людей с нарушениями. Дипфейки помогают в локализации контента и персонализации обучения. Ключевой вопрос — этичное использование с согласия всех сторон.