📊 Основы машинного обучения

📊 Основы машинного обученияФундаментальные принципы и концепции машинного обучения для начинающихλ

Изучите базовые алгоритмы, математические основы и практические методы машинного обучения, которые формируют фундамент современной искусственной интеллектуальности и анализа данных

Overview

Машинное обучение — это способность системы находить закономерности в данных и применять их к новым задачам, минуя жёсткое программирование правил. Математика здесь 🧩 не декорация: линейная алгебра описывает пространства признаков, теория вероятностей — неопределённость, оптимизация — поиск лучших параметров. Освоив эти три блока, вы получите инструментарий для понимания любого алгоритма — от линейной регрессии до трансформеров.

🛡️

Протокол Лапласа: Основы машинного обучения — это не просто набор алгоритмов, а систематический подход к извлечению знаний из данных, требующий понимания статистики, линейной алгебры и оптимизации для построения надежных предсказательных моделей.

Reference Protocol

Научный фундамент

Доказательная база для критического анализа

Protocol: Evaluation

Проверь себя

Квизы по этой теме скоро появятся

Sector L1

Статьи

Научно-исследовательские материалы, эссе и глубокие погружения в механизмы критического мышления.

📊 Основы машинного обучения

📊 Основы машинного обучения⚡

Подробнее

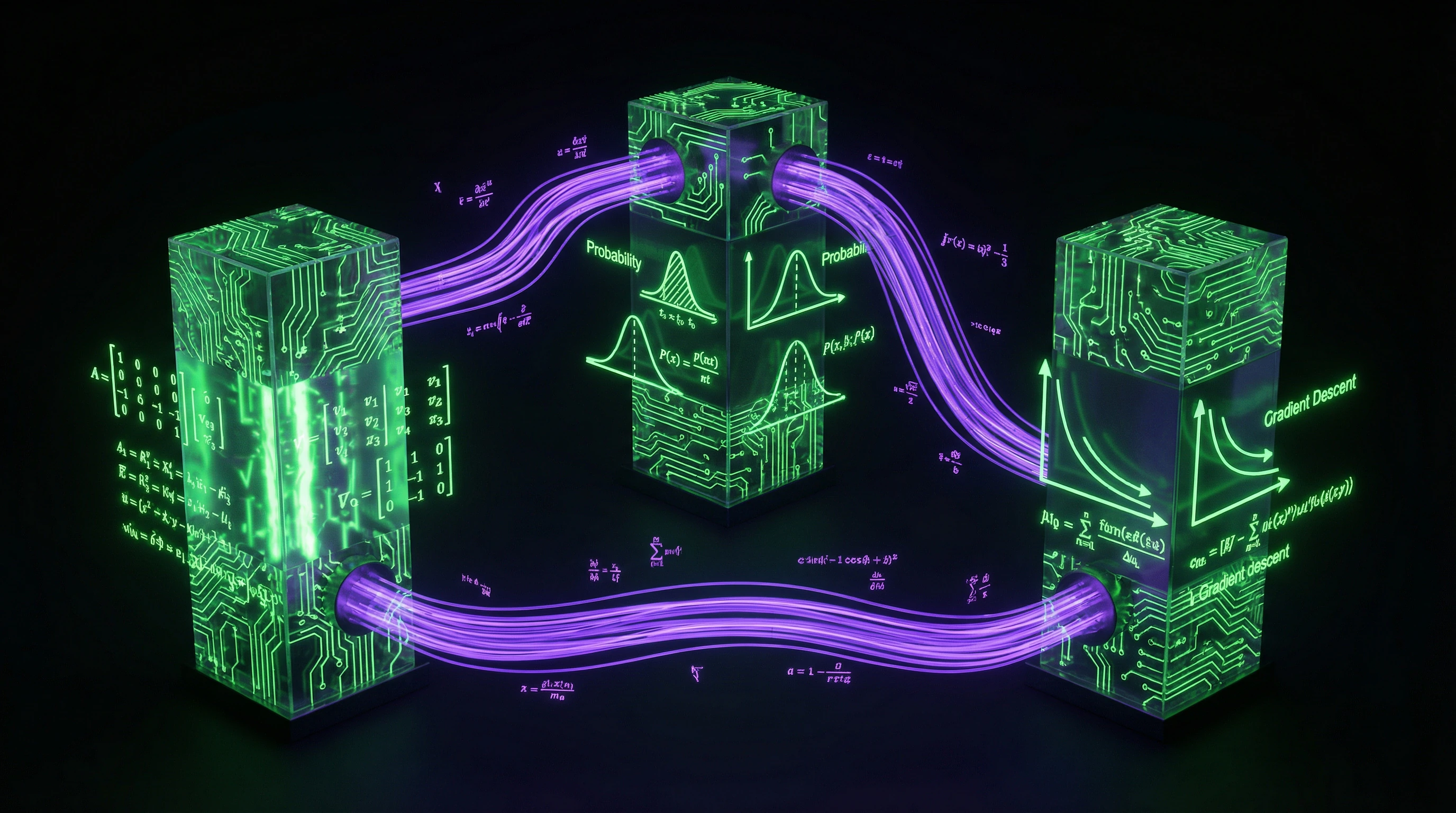

Математические основы машинного обучения: три столпа, без которых алгоритмы не работают

Машинное обучение строится на трёх математических дисциплинах. Каждая решает конкретную задачу: линейная алгебра представляет данные в многомерных структурах, теория вероятностей работает с неопределённостью, методы оптимизации ищут наилучшие параметры модели.

Без понимания этих основ невозможно ни создавать новые алгоритмы, ни грамотно применять существующие.

Линейная алгебра и векторные пространства

Каждый объект данных в машинном обучении — это вектор в многомерном пространстве, где каждое измерение соответствует одному признаку. Операции над матрицами (умножение, транспонирование, собственные векторы) составляют основу нейронных сетей: каждый слой выполняет линейное преобразование входных данных с последующим применением нелинейной функции активации.

- Скалярное произведение

- Измеряет сходство между векторами — критично для классификации и кластеризации.

- Разложение матриц (SVD, PCA)

- Снижает размерность данных и выделяет наиболее значимые признаки.

Теория вероятностей и статистика

Вероятностные модели лежат в основе байесовских методов, где каждое предсказание сопровождается оценкой уверенности модели. Условная вероятность, теорема Байеса и распределения вероятностей необходимы для построения генеративных моделей и работы с неполными данными.

| Инструмент | Применение |

|---|---|

| Статистические критерии (t-тест, хи-квадрат) | Оценка значимости признаков и качества моделей |

| Максимальное правдоподобие | Обучение параметрических моделей (логистическая регрессия, наивный байесовский классификатор) |

Методы оптимизации и градиентный спуск

Обучение модели сводится к поиску параметров, которые минимизируют функцию потерь на обучающих данных. Градиентный спуск — итеративный алгоритм, движущийся в направлении наибыстрейшего убывания функции, вычисляя частные производные по каждому параметру.

- Стохастический градиентный спуск (SGD) — обновляет параметры на каждом примере, быстрее, но шумнее.

- Adam — адаптивная скорость обучения с импульсом, часто сходится быстрее.

- RMSprop — адаптирует скорость обучения для каждого параметра отдельно.

Понимание выпуклости функций и условий сходимости критично для выбора стратегии оптимизации и гиперпараметров обучения.

Типы задач и алгоритмов обучения: как выбрать правильный подход

Машинное обучение делится по типу данных и характеру задачи. Обучение с учителем использует размеченные данные — для каждого примера известен правильный ответ. Обучение без учителя работает с неразмеченными данными и ищет скрытые закономерности.

Выбор подхода зависит не только от наличия разметки, но и от бизнес-задачи, объёма данных и требований к интерпретируемости.

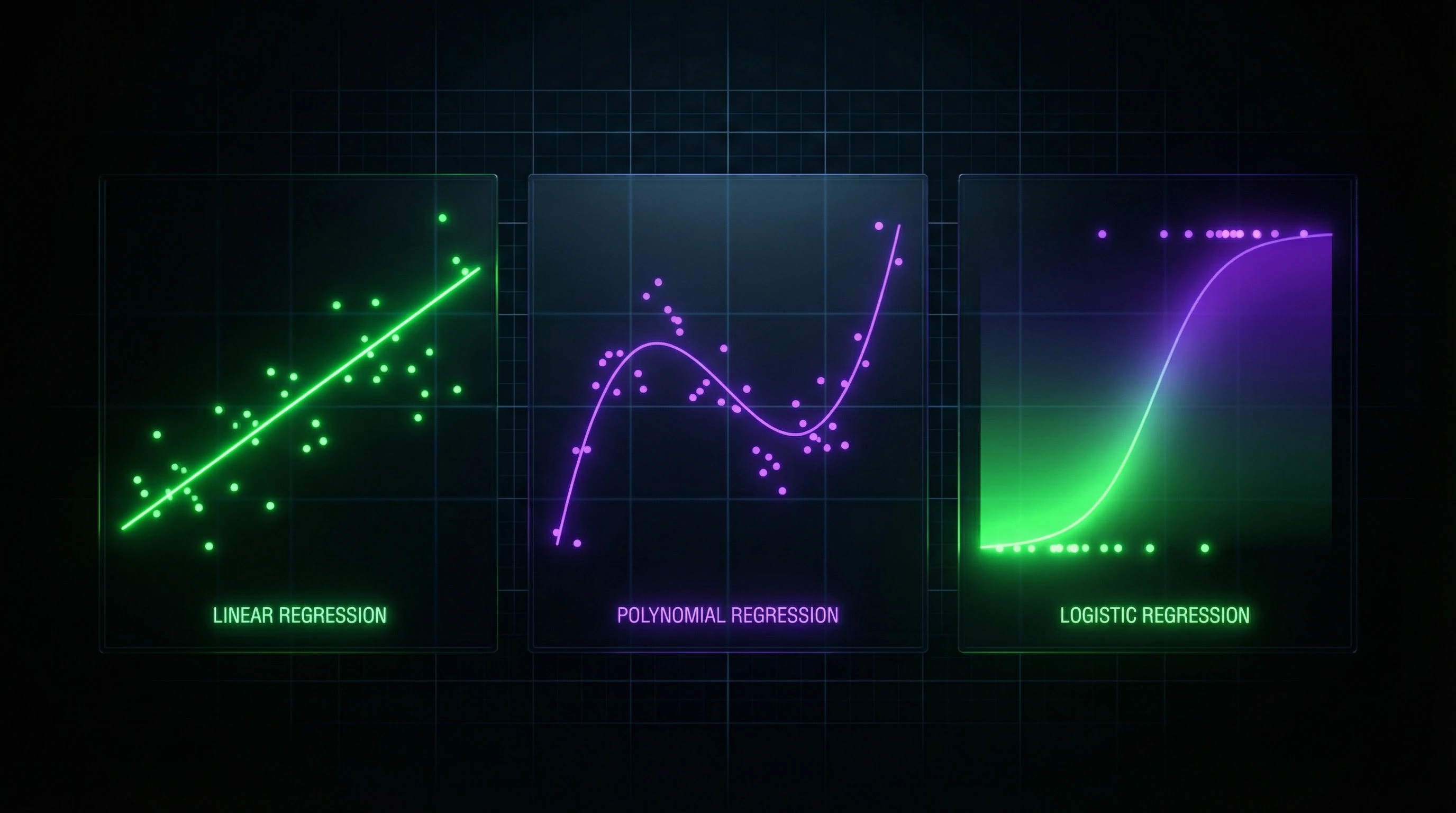

Обучение с учителем: классификация и регрессия

Классификация предсказывает дискретную метку — спам или не спам, кот или собака. Регрессия предсказывает непрерывное число — цену, температуру, объём продаж.

| Тип задачи | Примеры алгоритмов | Метрики качества |

|---|---|---|

| Классификация | Логистическая регрессия, деревья решений, SVM, нейронные сети | Accuracy, precision, recall, F1-score |

| Регрессия | Линейная регрессия, полиномиальные модели, градиентный бустинг | MSE, RMSE, MAE |

Каждый алгоритм имеет свои преимущества в зависимости от размера данных и сложности границы между классами или характера распределения значений.

Обучение без учителя: кластеризация и снижение размерности

Кластеризация группирует объекты по сходству без предварительных категорий — сегментирует клиентов, обнаруживает аномалии, организует большие массивы данных. K-means, иерархическая кластеризация и DBSCAN различаются по способу определения сходства и форме кластеров.

Методы снижения размерности — PCA, t-SNE, UMAP — проецируют данные из высокоразмерного пространства в пространство меньшей размерности, сохраняя важную информацию и позволяя визуализировать структуру.

Эти техники критически важны для работы с данными, содержащими сотни или тысячи признаков, где прямой анализ невозможен.

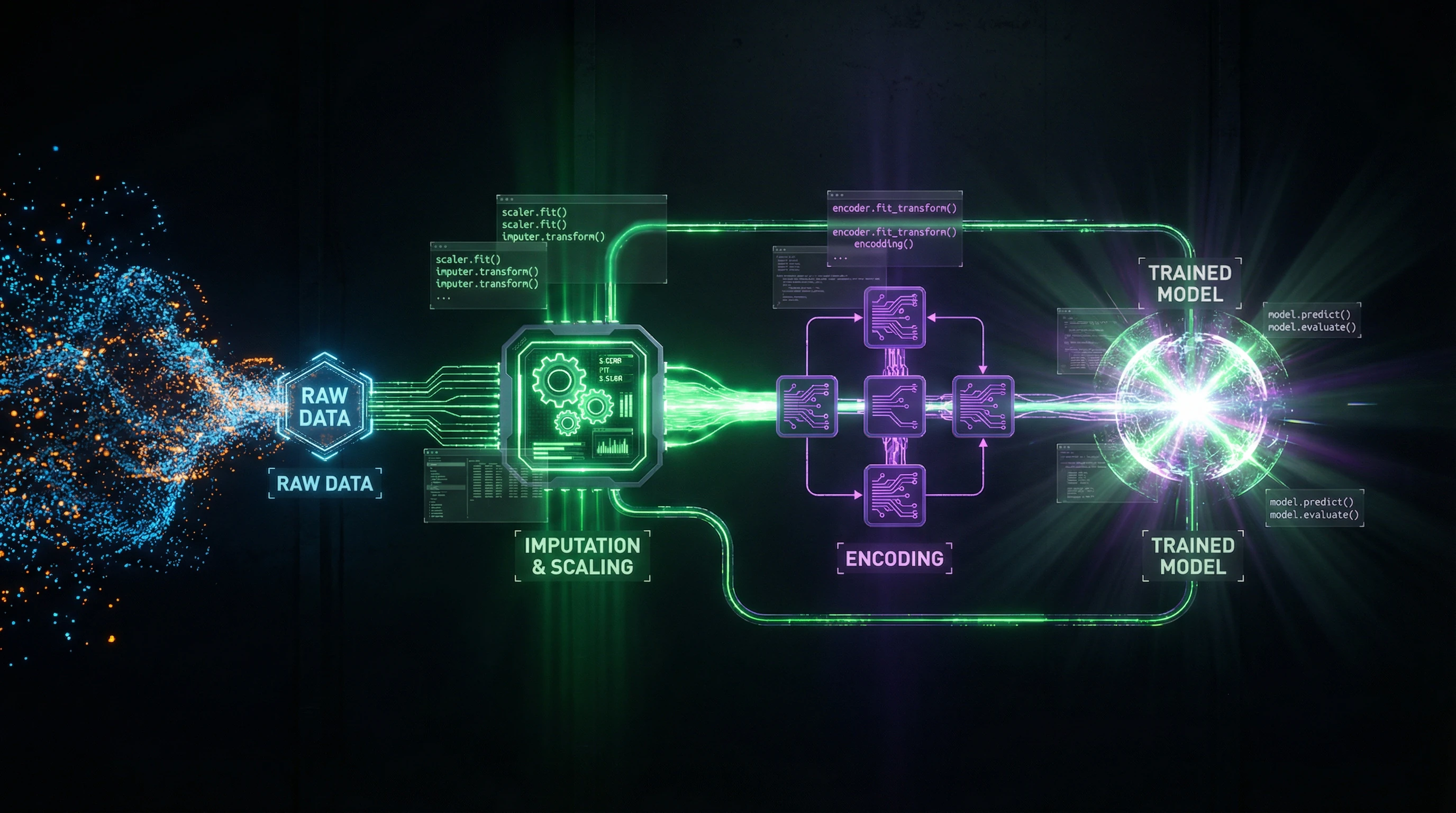

Подготовка и обработка данных: 80% работы, определяющей успех модели

Качество данных напрямую определяет качество обученной модели — даже самый совершенный алгоритм не сможет извлечь полезные закономерности из зашумленных, неполных или неправильно подготовленных данных. Эта работа занимает большую часть времени в реальных проектах машинного обучения, но именно она определяет, будет ли модель работать в продакшене.

Очистка и нормализация данных

Реальные данные содержат пропущенные значения, дубликаты, выбросы и ошибки ввода, которые необходимо обработать до начала обучения. Стратегии работы с пропусками включают удаление строк, заполнение средними или медианными значениями, или использование более сложных методов импутации на основе других признаков.

| Метод нормализации | Формула/диапазон | Когда использовать |

|---|---|---|

| Min-Max scaling | [0, 1] | Когда нужен фиксированный диапазон |

| Стандартизация (Z-score) | Среднее 0, дисперсия 1 | Для алгоритмов, чувствительных к масштабу (градиентный спуск, KNN) |

| Логарифмирование | log(x) | Для степенных распределений и больших диапазонов значений |

Обработка выбросов требует баланса между удалением аномальных значений и сохранением редких, но важных случаев.

Извлечение и инженерия признаков

Инженерия признаков — процесс создания новых информативных признаков из существующих данных на основе доменных знаний и анализа данных. Качественная инженерия признаков часто даёт больший прирост качества модели, чем переход к более сложному алгоритму.

Для временных рядов это может быть извлечение трендов, сезонности и лагов; для текстов — создание n-грамм, TF-IDF весов или эмбеддингов; для изображений — извлечение текстур, краёв и форм.

Преобразования признаков включают полиномиальные признаки для захвата нелинейных зависимостей и one-hot encoding для категориальных переменных.

Разделение данных и кросс-валидация

Правильное разделение данных на обучающую, валидационную и тестовую выборки предотвращает переобучение и даёт честную оценку качества модели на новых данных.

- Стандартное соотношение: 60–70% на обучение, 15–20% на валидацию, 15–20% на финальное тестирование (проводится один раз)

- Кросс-валидация разбивает данные на k частей и обучает k моделей, каждый раз используя разные части для обучения и валидации

- Для временных рядов используется специальная стратегия с сохранением временного порядка

- Для несбалансированных классов применяется стратифицированное разделение, сохраняющее пропорции классов во всех выборках

Кросс-валидация даёт более надёжную оценку качества при ограниченном объёме данных.

Базовые алгоритмы машинного обучения: от регрессии до ансамблей

Линейная регрессия моделирует зависимость целевой переменной как взвешенную сумму признаков плюс свободный член, минимизируя среднеквадратичную ошибку между предсказаниями и реальными значениями.

Метод наименьших квадратов находит оптимальные веса аналитически через псевдообратную матрицу, что делает обучение быстрым, но требует линейной связи между признаками и целью. Логистическая регрессия применяет сигмоидную функцию к линейной комбинации признаков, преобразуя результат в вероятность принадлежности к классу.

Несмотря на название, логистическая регрессия решает задачи классификации, а не регрессии, и особенно эффективна для бинарной классификации с линейно разделимыми классами.

Линейная и логистическая регрессия

Регуляризация добавляет штраф за большие значения весов в функцию потерь. L1-регуляризация (Lasso) использует сумму модулей весов и приводит к разреженным решениям с нулевыми коэффициентами, фактически выполняя отбор признаков.

L2-регуляризация (Ridge) использует сумму квадратов весов и равномерно уменьшает все коэффициенты. Elastic Net комбинирует оба подхода, балансируя между отбором признаков и стабильностью решения через два гиперпараметра.

- Полиномиальная регрессия

- Расширяет линейную модель, создавая новые признаки как степени и произведения исходных. Позволяет моделировать нелинейные зависимости, но резко увеличивает риск переобучения при высоких степенях.

- Стандартизация признаков

- Критически важна для регуляризованных моделей, поскольку штрафы за веса должны быть сопоставимы по масштабу.

Деревья решений и случайные леса

Дерево решений рекурсивно разбивает пространство признаков на прямоугольные области, выбирая на каждом шаге признак и порог, которые максимально уменьшают неопределённость в дочерних узлах, измеряемую через энтропию для классификации или дисперсию для регрессии.

Алгоритм жадно строит дерево сверху вниз, останавливаясь при достижении максимальной глубины, минимального числа объектов в листе или когда дальнейшее разбиение не улучшает качество. Деревья интерпретируемы, работают с категориальными признаками без кодирования и автоматически выполняют отбор признаков.

Деревья склонны к переобучению и нестабильны — малое изменение данных может радикально изменить структуру дерева.

Случайный лес обучает множество деревьев на случайных подвыборках данных (бэггинг) с дополнительной рандомизацией через выбор случайного подмножества признаков в каждом узле. Финальное предсказание получается усреднением для регрессии или голосованием для классификации.

Эта стратегия радикально снижает переобучение и дисперсию предсказаний, сохраняя низкое смещение деревьев, что делает случайные леса одним из самых надёжных алгоритмов общего назначения. Градиентный бустинг строит деревья последовательно, каждое следующее исправляет ошибки предыдущих, обучаясь на градиентах функции потерь.

- Обеспечивает высочайшую точность среди древесных методов

- Требует тщательной настройки learning rate и числа деревьев

- Нуждается в защите от переобучения через ранную остановку

Метод опорных векторов

SVM ищет гиперплоскость, максимизирующую отступ (margin) — расстояние до ближайших объектов разных классов, называемых опорными векторами. Это обеспечивает лучшую обобщающую способность по сравнению с простым разделением классов.

Для линейно неразделимых данных вводится slack-переменная, позволяющая некоторым объектам нарушать отступ с контролируемым штрафом через параметр C, балансирующий между шириной отступа и числом ошибок.

Kernel trick неявно отображает данные в пространство высокой размерности через функции ядра, где классы становятся линейно разделимыми, без явного вычисления координат в новом пространстве.

RBF-ядро создаёт бесконечномерное пространство признаков и особенно эффективно для сложных нелинейных границ, но требует подбора параметра gamma, контролирующего радиус влияния каждого объекта.

Оценка качества моделей: метрики и стратегии валидации

Метрики классификации и регрессии

Для классификации accuracy измеряет долю правильных предсказаний, но бесполезна при несбалансированных классах — модель, предсказывающая только мажоритарный класс, получит высокий accuracy без реальной пользы.

Precision показывает долю истинно положительных среди всех предсказанных положительных (критична, когда ложные срабатывания дороги). Recall — доля найденных положительных среди всех реальных положительных (критична, когда пропуски опасны). F1-score — их гармоническое среднее, балансирующее оба показателя.

| Метрика | Что измеряет | Когда использовать |

|---|---|---|

| ROC-AUC | Способность ранжировать объекты по всем порогам (0.5 = случайный, 1.0 = идеал) | Когда порог классификации неизвестен заранее |

| MAE | Среднее отклонение в исходных единицах, устойчива к выбросам | Регрессия с интерпретируемостью |

| MSE / RMSE | Штрафует большие ошибки; RMSE возвращает масштаб | Регрессия, когда выбросы критичны |

| R² | Доля объяснённой дисперсии (1 = идеал, 0 = среднее, <0 = хуже тривиального) | Регрессия, сравнение моделей |

| MAPE | Ошибка в процентах от реальных значений | Интерпретируемость, но неопределена при нулях |

Переобучение и недообучение

Переобучение возникает, когда модель запоминает шум и случайные закономерности обучающей выборки вместо истинных зависимостей. Результат: отличное качество на train, плохое на test — признак высокой дисперсии.

Недообучение проявляется в низком качестве на обеих выборках из-за недостаточной сложности модели. Модель не способна уловить истинные закономерности — проблема высокого смещения.

Кривые обучения (метрики на train и validation в зависимости от размера выборки) показывают диагноз: при переобучении кривые расходятся с большим разрывом; при недообучении обе остаются на низком уровне; при оптимальной сложности сходятся на высоком качестве.

Регуляризация и выбор гиперпараметров

Регуляризация контролирует сложность модели через штрафы в функции потерь (L1/L2), ограничения на глубину деревьев, dropout в нейросетях или early stopping при мониторинге валидации.

- Grid search: перебирает все комбинации гиперпараметров из заданной сетки, гарантируя оптимум в дискретном пространстве, но требует экспоненциального числа обучений при росте параметров.

- Random search: случайно сэмплирует комбинации из распределений, часто находит хорошие решения быстрее grid search, особенно когда некоторые параметры важнее других.

- Bayesian optimization: строит вероятностную модель зависимости качества от гиперпараметров и итеративно выбирает следующую точку, балансируя исследование и эксплуатацию, минимизируя число дорогостоящих обучений.

Практическое применение и инструменты машинного обучения

Библиотеки Python для ML: scikit-learn, pandas, numpy

NumPy предоставляет многомерные массивы и векторизованные операции, выполняющиеся на порядки быстрее циклов Python благодаря реализации на C. Pandas строит поверх NumPy структуры DataFrame для табличных данных с именованными столбцами, индексами и инструментами фильтрации, группировки, объединения.

Scikit-learn реализует десятки алгоритмов машинного обучения с единообразным API: все модели имеют методы fit() для обучения и predict() для предсказаний, что позволяет экспериментировать с разными алгоритмами, меняя одну строку кода.

- Matplotlib и seaborn визуализируют данные и результаты моделей

- Jupyter Notebook объединяет код, визуализации и текст в единый документ

- Модули scikit-learn: preprocessing для масштабирования, model_selection для кросс-валидации, metrics для оценки качества, pipeline для объединения шагов

Построение пайплайнов обработки данных

Pipeline последовательно применяет трансформации данных и финальную модель, гарантируя одинаковую обработку train и test данных и предотвращая утечку информации.

ColumnTransformer применяет разные трансформации к разным подмножествам признаков: числовые масштабируются StandardScaler, категориальные кодируются OneHotEncoder, текстовые векторизуются TfidfVectorizer — всё в одном объекте.

Pipeline интегрируется с GridSearchCV, позволяя подбирать гиперпараметры как трансформаций, так и модели через единый интерфейс с автоматической кросс-валидацией на каждой комбинации параметров.

FeatureUnion параллельно применяет несколько трансформаций к одним данным и конкатенирует результаты, позволяя комбинировать разные представления признаков.

Custom transformers создаются наследованием от BaseEstimator и TransformerMixin, реализуя методы fit() и transform(). Сериализация через joblib или pickle сохраняет обученный pipeline целиком, включая все параметры трансформаций и веса модели, обеспечивая воспроизводимость и простое развёртывание в продакшн.

Knowledge Access Protocol

FAQ

Часто задаваемые вопросы

Машинное обучение — это раздел искусственного интеллекта, где компьютер учится решать задачи на основе данных, без явного программирования каждого шага. Алгоритмы находят закономерности в примерах и используют их для предсказаний на новых данных. Например, система распознавания лиц учится на тысячах фотографий, а затем определяет людей на новых снимках.

Основа — линейная алгебра (матрицы, векторы), теория вероятностей и математическая статистика. Также важны методы оптимизации, особенно градиентный спуск для обучения моделей. Начинающим достаточно понимания базовых концепций, глубокие знания нужны для разработки новых алгоритмов.

При обучении с учителем модель учится на размеченных данных с известными ответами (например, фото с подписями «кот» или «собака»). Обучение без учителя работает с неразмеченными данными, находя скрытые структуры — кластеры похожих объектов или паттерны. Первый тип используется для классификации и регрессии, второй — для сегментации и снижения размерности.

Это миф — объём данных зависит от задачи и алгоритма. Простые модели (линейная регрессия, деревья решений) эффективно работают на сотнях примеров. Глубокие нейросети действительно требуют миллионы образцов, но техники transfer learning и data augmentation позволяют обучать модели на меньших датасетах с хорошим качеством.

Переобучение — когда модель отлично работает на обучающих данных, но плохо на новых, «запомнив» шум вместо закономерностей. Избежать помогают регуляризация (L1/L2), кросс-валидация, увеличение объёма данных и упрощение модели. Правильное разделение данных на train/validation/test обязательно для контроля переобучения.

Начните с Python и библиотек numpy, pandas для работы с данными. Затем освойте scikit-learn — она содержит готовые алгоритмы и понятную документацию. Практикуйтесь на простых датасетах (Iris, Titanic), постепенно изучая теорию линейной регрессии, деревьев решений и метрик качества.

Основные метрики: accuracy (доля правильных ответов), precision (точность), recall (полнота) и F1-score (их гармоническое среднее). Для несбалансированных классов accuracy обманчива — лучше смотреть на precision/recall. ROC-AUC показывает качество разделения классов при разных порогах вероятности.

Feature engineering — создание новых признаков из исходных данных для улучшения качества модели. Например, из даты можно извлечь день недели, месяц, праздник. Правильная инженерия признаков часто важнее выбора алгоритма, особенно для классических методов ML, которые не извлекают сложные зависимости автоматически.

Регрессия предсказывает непрерывные числовые значения (цена квартиры, температура), классификация — категории или классы (спам/не спам, вид животного). Для регрессии используют метрики MSE, RMSE, MAE, для классификации — accuracy, F1-score. Некоторые алгоритмы (деревья решений, нейросети) решают обе задачи с небольшими модификациями.

В большинстве случаев да, но не всегда. Случайный лес усредняет предсказания множества деревьев, снижая переобучение и дисперсию. Однако он сложнее интерпретировать, медленнее работает и требует больше памяти. Для простых задач с малым количеством данных одно дерево может быть достаточным и более понятным.

Кросс-валидация делит данные на K частей (фолдов), обучает модель на K-1 частях и тестирует на оставшейся, повторяя процесс K раз. Итоговая оценка — среднее по всем фолдам, что даёт надёжную оценку качества. Стандартный выбор — 5 или 10 фолдов, это баланс между точностью оценки и вычислительными затратами.

Нормализация приводит признаки к единому масштабу, что критично для алгоритмов, чувствительных к масштабу (SVM, нейросети, k-NN). Без неё признак с большими значениями (например, доход в рублях) будет доминировать над малыми (возраст). Стандартизация (z-score) и min-max scaling — наиболее популярные методы нормализации.

Существуют no-code платформы (Google AutoML, Azure ML Studio), позволяющие строить модели через интерфейс. Однако для серьёзной работы программирование необходимо — нужно обрабатывать данные, настраивать модели, интегрировать решения. Python с библиотеками scikit-learn — минимальный порог входа, освоить базы можно за несколько недель.

Гиперпараметры — настройки алгоритма, которые задаются до обучения (глубина дерева, learning rate, количество соседей в k-NN). Подбирают через Grid Search (перебор сетки значений) или Random Search (случайный поиск). Важно использовать кросс-валидацию при подборе, чтобы избежать переобучения на валидационной выборке.

Да, классические алгоритмы (логистическая регрессия, SVM, деревья) эффективны на датасетах от 100-1000 примеров. Ключ — правильный выбор модели и регуляризация для предотвращения переобучения. Для очень малых данных (десятки примеров) лучше использовать простые интерпретируемые модели или методы на основе экспертных правил.

SVM ищет оптимальную разделяющую гиперплоскость с максимальным отступом между классами, логистическая регрессия максимизирует вероятность правильной классификации. SVM лучше работает в высокоразмерных пространствах и с kernel trick решает нелинейные задачи. Логистическая регрессия проще интерпретируется и даёт калиброванные вероятности принадлежности к классу.