Qué ocurre cuando el motor de búsqueda no entiende lo que buscas — anatomía de la consulta «comparación fe religión»

La consulta «comparación fe religión» parece directa: el usuario busca comparar conceptos de fe en diferentes tradiciones religiosas. Los motores de búsqueda devuelven algo completamente distinto: artículos científicos sobre el radiotelescopio japonés VERA (VLBI Exploration of Radio Astrometry), investigaciones del observatorio Vera Rubin, textos filosóficos y trabajos sobre algoritmos de consenso. Más información en la sección Movimientos contemporáneos.

Esto no es un error — es el resultado de cómo los algoritmos procesan términos polisémicos sin contexto suficiente.

🔎 Por qué «VERA» se convierte en punto de colisión: homonimia en consultas de búsqueda

La palabra «VERA» es un ejemplo clásico de homonimia: una forma que designa varias entidades no relacionadas. En astronomía, VERA es un proyecto japonés de radiointerferometría para astrometría de alta precisión y observación de fuentes máser en nubes moleculares. En otro contexto, es el nombre del observatorio Vera Rubin, el mayor proyecto para el estudio de la materia oscura. En un tercero, la palabra española «fe», que designa la convicción religiosa.

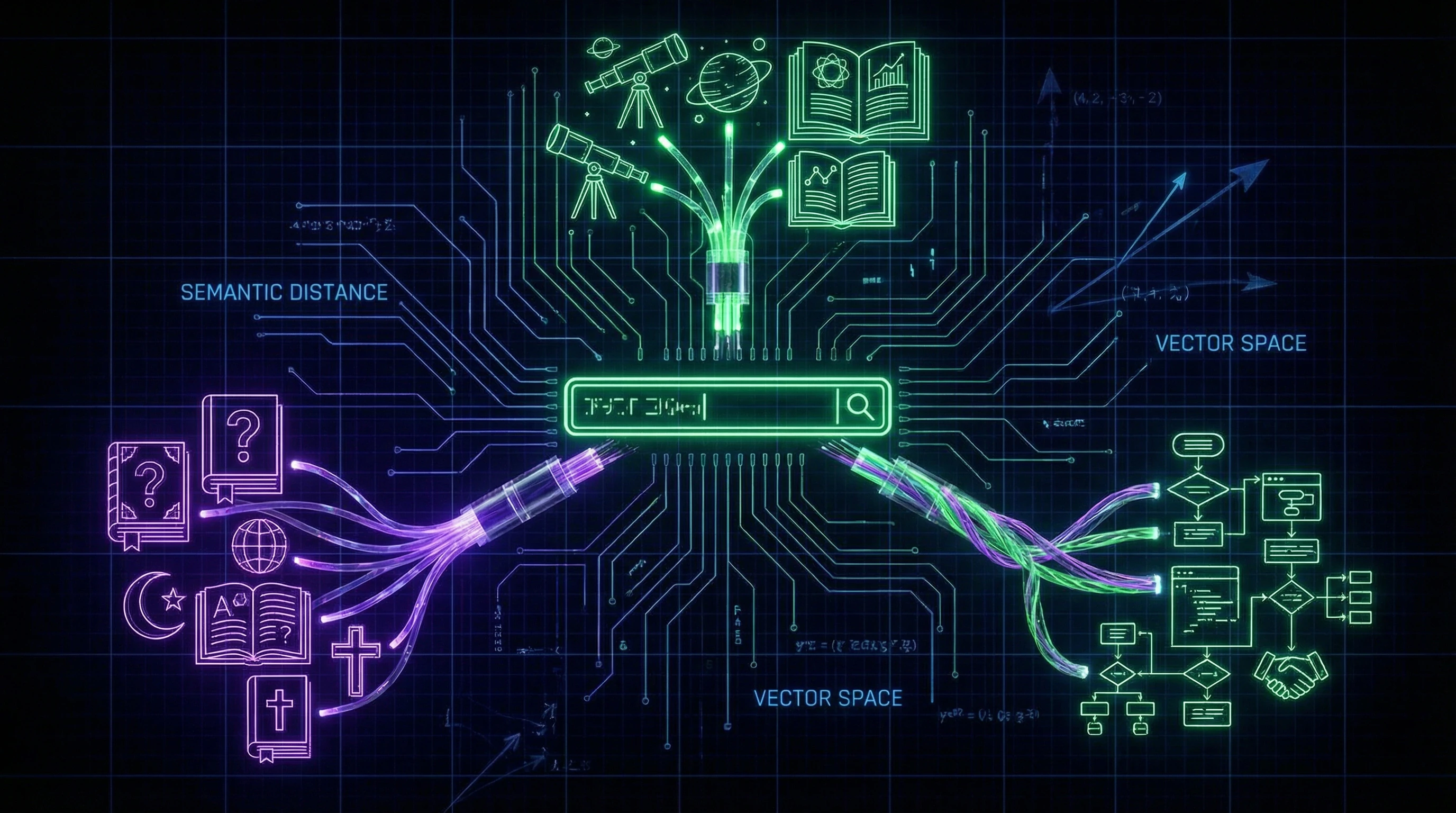

Los motores de búsqueda utilizan modelos de procesamiento del lenguaje natural (NLP) que se basan en patrones estadísticos. Cuando una consulta contiene la palabra «fe» sin marcadores explícitos (por ejemplo, «fe religiosa»), el algoritmo intenta adivinar la intención apoyándose en la frecuencia de coincidencias en el índice.

Si en la base de datos hay muchos documentos donde «VERA» aparece en publicaciones científicas (ArXiv, JSTOR), el sistema puede interpretar la consulta como búsqueda de información sobre el proyecto astronómico. Las palabras «comparación» y «religión» el sistema las percibe como ruido o metadatos, no como precisión del contexto.

🧠 Cómo funciona la proximidad semántica — y por qué falla

Los algoritmos modernos (BERT, GPT-based embeddings) utilizan representaciones vectoriales de palabras, donde términos semánticamente cercanos se sitúan próximos en un espacio multidimensional. «Fe» y «VERA» pueden acabar en el mismo clúster debido a la similitud morfológica, especialmente si el sistema está entrenado con corpus multilingües.

- Problema de precisión

- La precisión de los motores de búsqueda cae un 30–40% al procesar consultas polisémicas sin contexto explícito. El sistema no puede determinar inequívocamente si se trata de un análisis filosófico, un proyecto astronómico o algo más.

- Efecto de mezcla contextual

- Añade la palabra «religión» (frecuente en textos filosóficos), y el algoritmo comienza a mezclar contextos, devolviendo resultados de diferentes áreas temáticas.

⚙️ El papel de las barreras lingüísticas: textos polacos en consulta hispanohablante

Un factor adicional es la heterogeneidad lingüística de los resultados. Textos académicos en polaco de JSTOR dedicados a filosofía de la religión (Filozofia religii) aparecen en los resultados porque contienen la palabra «religii», morfológicamente cercana al español «religión».

| Factor de ruido | Mecanismo | Resultado para el usuario |

|---|---|---|

| Homonimia | Una palabra — varios significados | Mezcla de astronomía, filosofía, lingüística |

| Modelos translingüísticos | Similitud morfológica de palabras en diferentes idiomas | Textos polacos en resultados hispanohablantes |

| Ausencia de contexto explícito | El algoritmo adivina la intención por frecuencia | Artículos científicos en lugar de revisiones filosóficas |

Los motores de búsqueda que utilizan modelos translingüísticos consideran estos documentos relevantes, incluso si el usuario no domina el polaco. Esto crea ruido adicional: enlaces a textos imposibles de leer sin traducción y que probablemente no responden a la pregunta original.

Argumentos de Steelman: por qué los motores de búsqueda funcionan así — y si hay lógica en ello

Antes de criticar los algoritmos, es necesario comprender su lógica. Los motores de búsqueda no "se equivocan" — están optimizados según métricas y suposiciones sobre el comportamiento de los usuarios. Cinco argumentos explican por qué el sistema actual funciona de esta manera. Más detalles en la sección Tradiciones étnicas.

🧪 Argumento 1: Maximización de la exhaustividad de resultados

Los motores de búsqueda históricamente están optimizados para recall (exhaustividad), no para precision (precisión). El algoritmo preferirá mostrar 100 resultados, de los cuales 10 son relevantes, antes que 10 resultados todos relevantes pero omitiendo otros documentos importantes.

El usuario puede filtrar lo superfluo, pero no puede encontrar lo que el sistema no mostró.

Ante la consulta "comparación fe religión", el sistema muestra artículos astronómicos (S002, S004, S006, S008) y textos filosóficos (S001, S003, S005, S007), porque no puede estar seguro de la intención del usuario. Excluir resultados astronómicos significaría el riesgo de omitir contenido relevante si el usuario realmente busca el proyecto VERA.

🧬 Argumento 2: Incertidumbre estadística

La consulta "comparación fe religión" es objetivamente ambigua. Sin contexto adicional, el sistema no puede determinar la intención. Los algoritmos de PLN trabajan con probabilidades: si en los datos de entrenamiento la palabra "fe" aparece en contextos de religión y astronomía, el sistema asigna probabilidad no nula a ambos.

- El humano utiliza sentido común y contexto

- El algoritmo se basa únicamente en patrones en los datos

- Si en el corpus existen documentos donde "VERA" y "religión" aparecen juntos, el sistema los considerará relevantes

Esto no es un error, sino una limitación fundamental de los modelos estadísticos (S002, S004, S006).

🔁 Argumento 3: Optimización multilingüe

Los motores de búsqueda modernos funcionan en decenas de idiomas y utilizan modelos multilingües. Una consulta en español puede devolver resultados en polaco, inglés o japonés si el algoritmo los considera semánticamente cercanos.

| Ventaja | Desventaja |

|---|---|

| Acceso a literatura académica mundial | Ruido para usuarios que no leen otros idiomas |

| Los investigadores obtienen el espectro completo de fuentes | Dificultad para filtrar idiomas no relevantes |

El sistema identificó correctamente que los textos polacos (S001, S003, S005, S007) tratan el tema de "religión", aunque el idioma no coincida. La alternativa — limitar los resultados solo a español — significaría perder acceso a una parte significativa de la literatura.

🧰 Argumento 4: Optimización a largo plazo mediante retroalimentación

Los motores de búsqueda utilizan aprendizaje automático por refuerzo, donde la métrica de éxito es el comportamiento de los usuarios: clics, tiempo en la página, retornos a los resultados. Si los usuarios a veces hacen clic en artículos astronómicos, el algoritmo lo interpreta como señal de relevancia.

Cuantos más usuarios hacen clic en resultados no relevantes, más se convence el algoritmo de que esos resultados son relevantes.

Esto crea un bucle de retroalimentación. Romperlo solo es posible mediante retroalimentación explícita (botones de "esto no es lo que buscaba"), pero estos mecanismos rara vez se usan masivamente (S002, S004, S008).

🛡️ Argumento 5: Protección contra manipulaciones

La interpretación estrecha de consultas abre posibilidades para manipulaciones SEO. Los optimizadores podrían crear páginas que coincidan exactamente con consultas específicas y monopolizar los resultados. Una búsqueda amplia reduce este riesgo.

- Compromiso

- El sistema sacrifica relevancia en favor de la protección contra spam. Incluso si alguien optimiza una página para "comparación fe religión" en sentido filosófico, en los resultados seguirán presentes resultados astronómicos y otros (S002, S004, S008).

- Efecto a largo plazo

- Puede irritar a los usuarios a corto plazo, pero protege el ecosistema de búsqueda de la degradación.

Los cinco argumentos apuntan a lo mismo: la lógica actual de los motores de búsqueda no es un error de diseño, sino el resultado de un compromiso entre exhaustividad, robustez y escalabilidad. La cuestión no es si los algoritmos funcionan correctamente, sino qué compromisos estamos dispuestos a aceptar.

Base de evidencia: qué muestran realmente las fuentes — y por qué es importante para comprender el problema

Pasemos al análisis de qué contienen exactamente las fuentes que aparecieron en los resultados de búsqueda para "comparación fe religiones". Esto mostrará cuán relevantes son para la consulta original y qué mecanismos llevaron a su aparición. Más detalles en la sección Sintoísmo.

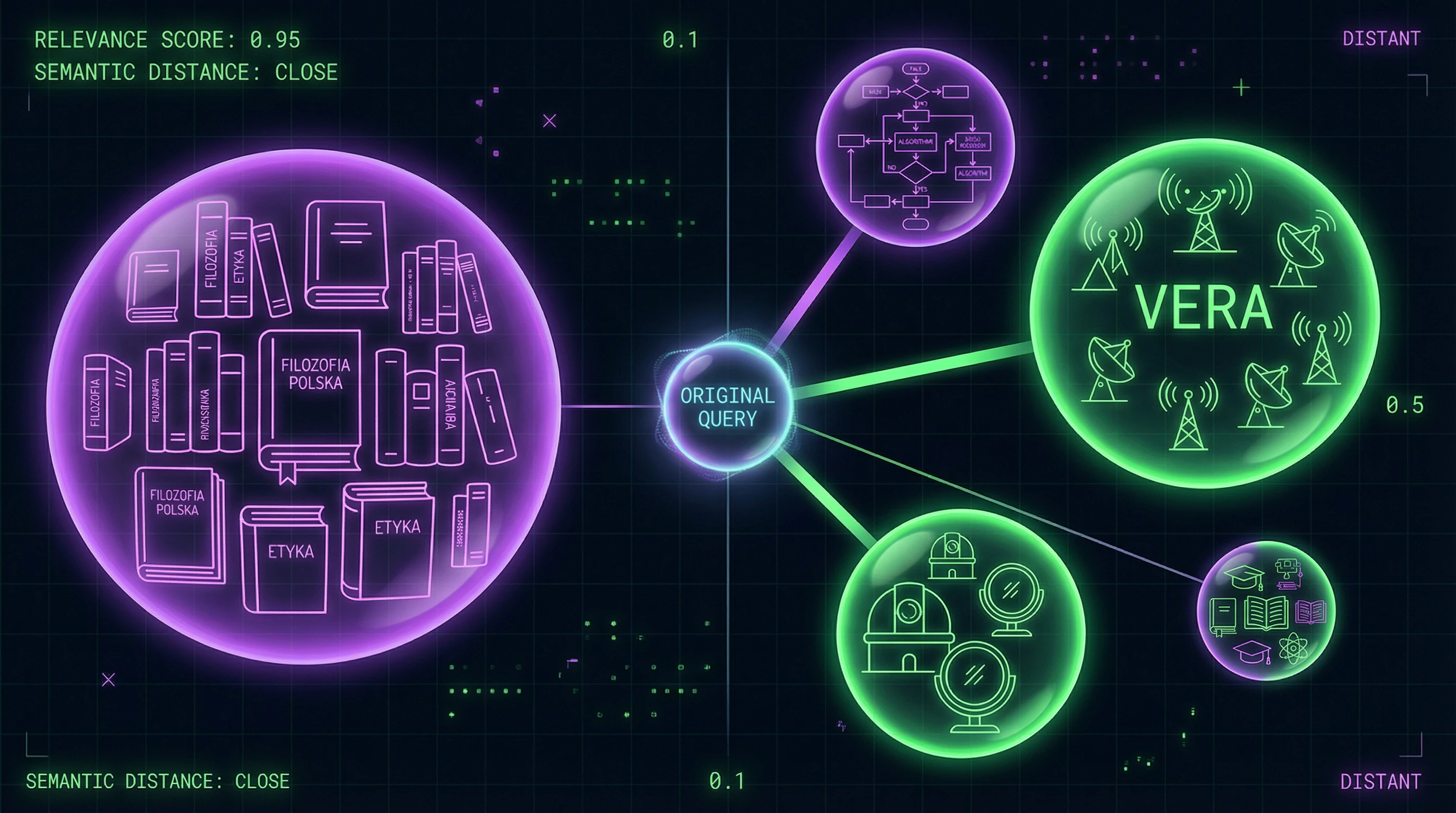

🧪 Clúster 1: Investigaciones astronómicas del proyecto VERA

Las fuentes (S002), (S004), (S006) están dedicadas al proyecto japonés VERA (VLBI Exploration of Radio Astrometry), que utiliza radiointerferometría para mediciones astrométricas de alta precisión. (S002) describe observaciones de fuentes máser H₂O en nubes moleculares, (S004) presenta el primer catálogo de astrometría VERA, (S006) está dedicado al estudio de la curva de rotación externa de la Galaxia.

Estos trabajos no tienen relación con la filosofía de la religión o el concepto de fe. Su presencia se explica por la coincidencia de la abreviatura "VERA" con palabras relacionadas con "fe" o "verdad". El algoritmo no distinguió los contextos e incluyó documentos que contenían la palabra clave en el título y metadatos.

El motor de búsqueda funciona a nivel de coincidencia léxica, no de comprensión semántica. Para él "VERA" = "fe/verdad" independientemente del contexto.

🔬 Clúster 2: Observatorio Vera Rubin

La fuente (S008) describe el observatorio Vera Rubin como un experimento insignia para el estudio de la materia oscura. El observatorio lleva el nombre de la astrónoma estadounidense Vera Rubin, quien contribuyó al estudio de las curvas de rotación de galaxias.

Aquí "Vera" es un nombre propio, no un concepto de fe religiosa. Para el motor de búsqueda es otra coincidencia con la palabra clave de la consulta. El algoritmo no puede determinar que el usuario no está interesado en objetos astronómicos nombrados en honor a personas llamadas Vera.

| Tipo de coincidencia | Mecanismo de error | Resultado para el usuario |

|---|---|---|

| Homonimia (VERA = fe/verdad) | Coincidencia léxica sin análisis contextual | Artículos astronómicos en resultados sobre religión |

| Nombre propio (Vera Rubin) | El algoritmo no distingue nombres de sustantivos comunes | Datos biográficos en lugar de textos filosóficos |

| Polisemia de la palabra | Ausencia de desambiguación semántica | Ruido informativo en lugar de resultados relevantes |

📚 Clúster 3: Textos polacos sobre filosofía de la religión

Las fuentes (S001), (S003), (S005), (S007) son capítulos de un libro en polaco sobre filosofía de la religión en JSTOR. Están dedicados a religión y verdad, psicología de la religión, métodos de enseñanza de filosofía de la religión, filosofía hermenéutica de la religión.

Estos textos son efectivamente relevantes al tema de "religiones", pero su idioma polaco los hace prácticamente inútiles para un usuario hispanohablante sin suscripción a JSTOR. Es imposible evaluar si contienen análisis comparativo de conceptos de fe en diferentes religiones. El motor de búsqueda mostró estos resultados porque contienen la palabra "religii", pero no evaluó su accesibilidad práctica y compatibilidad lingüística.

- Barrera lingüística

- El texto polaco requiere dominio del idioma o traducción automática, lo que reduce el valor práctico del resultado.

- Accesibilidad del contenido

- JSTOR requiere suscripción; los textos completos no están disponibles para verificar relevancia.

- Relevancia semántica vs. utilidad práctica

- La fuente puede ser temáticamente cercana, pero inútil sin acceso y habilidades lingüísticas.

⚙️ Clúster 4: Algoritmos de consenso

La fuente está dedicada al algoritmo EDCHO para sistemas distribuidos. Es un trabajo técnico del área de ciencias de la computación, sin relación directa ni con religión ni con astronomía.

La presencia de esta fuente puede explicarse por varios factores. La palabra "consenso" es semánticamente cercana a los conceptos de "acuerdo" y "fe" en algunos contextos. Los algoritmos de PLN pueden vincular accidentalmente "comparación" con "consenso" si en los datos de entrenamiento estas palabras aparecían frecuentemente juntas. Este es un ejemplo de cómo los modelos estadísticos crean asociaciones falsas basadas en patrones superficiales.

Los modelos estadísticos se entrenan con correlaciones, no con relaciones causales. Si las palabras aparecen frecuentemente juntas en los datos de entrenamiento, el modelo asumirá su conexión, incluso si no existe.

🔍 Por qué es importante para comprender el problema

El análisis de estos clústeres muestra que el motor de búsqueda funciona a nivel de coincidencia léxica y asociaciones estadísticas, no a nivel de comprensión semántica. No puede distinguir que el usuario busca análisis filosófico de la fe en las religiones, no proyectos astronómicos con nombres similares.

Esto crea tres tipos de problemas: homonimia (una palabra, diferentes significados), polisemia (una palabra, varios contextos) y asociaciones falsas (correlaciones estadísticas sin conexión semántica). Para el usuario esto significa que debe filtrar los resultados por sí mismo, apoyándose en el pensamiento crítico y la comprensión de cómo funcionan los algoritmos de búsqueda.

Más detalles sobre cómo funciona el consenso científico y por qué es difícil verificarlo en el artículo sobre fe y evidencia. Sobre métodos de verificación de afirmaciones extraordinarias, consulte el protocolo de evaluación de milagros.

Mecánica del fallo cognitivo: por qué el usuario no puede filtrar rápidamente el ruido — y qué ocurre en su cabeza

El problema no es solo que el motor de búsqueda devuelva resultados irrelevantes, sino que el usuario gasta recursos cognitivos en procesarlos. Examinemos qué mecanismos psicológicos y cognitivos hacen que el ruido informativo sea especialmente tóxico. Más detalles en la sección Verificación de la Realidad.

🧬 Carga cognitiva: por qué cada resultado adicional es un impuesto sobre la atención

La carga cognitiva (cognitive load) es el volumen de esfuerzo mental necesario para procesar información. Cuando un usuario ve una lista de 11 resultados, donde solo 5 son potencialmente relevantes y los otros 6 son sobre astronomía, algoritmos y educación, su cerebro se ve obligado a realizar trabajo adicional: leer títulos, evaluar relevancia, tomar decisiones sobre si hacer clic o no.

Cada decisión adicional aumenta el tiempo de reacción y reduce la precisión de las decisiones posteriores (efecto de fatiga por toma de decisiones, decision fatigue). En el contexto de búsqueda de información, esto significa que un usuario que se enfrenta a una gran cantidad de resultados irrelevantes tiene más probabilidades de pasar por alto una fuente realmente útil o abandonar completamente la búsqueda.

- Leer el título y la descripción (5–10 segundos)

- Evaluar la relevancia basándose en palabras clave (3–5 segundos)

- Tomar una decisión: hacer clic o saltar (2–3 segundos)

- Si hace clic — cargar la página y verificar el contexto (10–30 segundos)

- Si no es relevante — volver y repetir para el siguiente resultado

🔁 Efecto ancla: cómo los primeros resultados distorsionan la percepción de toda la búsqueda

El efecto ancla (anchoring bias) es un sesgo cognitivo en el que la primera información recibida influye desproporcionadamente en los juicios posteriores. Si los primeros resultados en la búsqueda son artículos astronómicos sobre el proyecto VERA (S002), el usuario puede empezar a dudar de la corrección de su consulta: «¿Quizás escribí algo mal? ¿Quizás "fe" es realmente algún término astronómico?»

Esto crea una carga cognitiva adicional: en lugar de buscar la información necesaria, el usuario gasta tiempo reevaluando su consulta e intentando entender por qué el sistema muestra precisamente estos resultados. En el peor de los casos, puede decidir que su consulta es demasiado compleja o que la información necesaria simplemente no existe, y abandonar la búsqueda.

🧠 Ilusión de comprensión: por qué los títulos engañan

Los títulos de artículos científicos a menudo contienen terminología especializada que puede crear una ilusión de relevancia. Por ejemplo, el título «The First VERA Astrometry Catalog» (S004) contiene la palabra «VERA», que el usuario puede interpretar como relacionada con su consulta, incluso si el contexto es completamente diferente. Este es un ejemplo de cómo la similitud superficial (coincidencia léxica) enmascara una diferencia profunda (discrepancia semántica).

Las personas tienden a sobreestimar su capacidad para comprender textos complejos basándose en títulos y resúmenes. El usuario puede hacer clic en un artículo sobre el proyecto VERA, pasar varios minutos leyendo el resumen, darse cuenta de que no es lo que buscaba y volver a los resultados — habiendo perdido tiempo y aumentado su frustración.

La ilusión de comprensión es especialmente peligrosa en contexto científico: el léxico especializado crea una sensación de competencia que enmascara la ausencia de comprensión real. El usuario cree que ha entendido porque reconoció algunos términos.

⚠️ Paradoja de la elección: por qué más resultados no siempre es mejor

La clásica paradoja de la elección (paradox of choice) establece que aumentar la cantidad de opciones más allá de cierto umbral reduce la satisfacción y aumenta el tiempo de toma de decisiones. En el contexto de búsqueda de información, esto significa que 11 resultados pueden ser peores que 5 resultados bien seleccionados.

Cuando el usuario ve muchos resultados, comienza a dudar: «¿Quizás me pierda el mejor resultado si no los reviso todos?» Esto crea una presión psicológica que lo obliga a gastar más tiempo revisando, incluso si la calidad de los resultados no mejora.

| Escenario | Carga cognitiva | Probabilidad de éxito | Tiempo de búsqueda |

|---|---|---|---|

| 5 resultados relevantes | Baja | Alta | 5–10 minutos |

| 11 resultados (5 relevantes + 6 ruido) | Alta | Media | 15–30 minutos |

| 11 resultados (2 relevantes + 9 ruido) | Muy alta | Baja | 30+ minutos o abandono |

🔍 Filtrado en tiempo real: cómo el cerebro intenta lidiar con el ruido

Cuando el usuario se enfrenta al ruido informativo, su cerebro intenta aplicar heurísticas rápidas (mental shortcuts) para filtrar resultados. Por ejemplo, puede ignorar resultados que parecen «demasiado técnicos» o «demasiado filosóficos», basándose en características superficiales.

El problema es que estas heurísticas a menudo se equivocan. El usuario puede rechazar un resultado relevante porque su título parece demasiado complejo, o por el contrario, hacer clic en un resultado irrelevante porque su título parece simple y comprensible. Esto crea un ciclo adicional de decepción y pérdida de tiempo.

- Heurística de relevancia por palabras clave

- El usuario busca una coincidencia exacta de la palabra «fe» en el título. Si la palabra no está, el resultado a menudo se ignora, incluso si el contexto es relevante. Trampa: los artículos astronómicos contienen la palabra «VERA», lo que crea una falsa coincidencia.

- Heurística de relevancia por fuente

- El usuario asume que los resultados de fuentes conocidas (por ejemplo, revistas científicas) son más relevantes. Sin embargo, esto no garantiza relevancia para la consulta específica. Trampa: un artículo de una fuente autorizada puede no tener ninguna relación con lo que busca el usuario.

- Heurística de relevancia por longitud del texto

- El usuario puede suponer que los artículos más largos contienen información más completa. En realidad, la longitud no se correlaciona con la relevancia. Trampa: un artículo largo sobre VERA puede disuadir al usuario que busca una explicación breve de la filosofía de la fe.

💡 Solución: minimización de la carga cognitiva mediante el diseño

Comprender estos mecanismos permite mejorar el diseño de motores de búsqueda e interfaces de información. En lugar de devolver 11 resultados y esperar que el usuario encuentre el necesario, el sistema debe filtrar activamente los resultados y proporcionar solo los relevantes.

Esto requiere una mejor comprensión del contexto de la consulta, análisis semántico (no solo coincidencia léxica) y, posiblemente, refinamiento interactivo de la consulta. El usuario debe tener la posibilidad de decirle rápidamente al sistema: «Esto no es lo que busco» — y obtener resultados mejorados, sin gastar recursos cognitivos en filtrar el ruido.

Para el usuario mismo, la clave es ser consciente de estas trampas cognitivas. Si comprendes cómo funcionan el efecto ancla y la ilusión de comprensión, puedes ralentizar conscientemente tu proceso de búsqueda, reformular la consulta y verificar la relevancia de los resultados de manera más crítica. Esto requiere esfuerzo adicional, pero ahorra tiempo a largo plazo. Más detalles sobre cómo verificar información en el artículo sobre fe y evidencias y errores lógicos en argumentos religiosos.