Qué es un «milagro científico» y por qué nuestro cerebro cree en él tan fácilmente: definiendo los límites de lo extraordinario

El término «milagro científico» es un oxímoron que enmascara la incomprensión de la naturaleza de la ciencia. La ciencia no se ocupa de milagros; se ocupa de fenómenos reproducibles y verificables, explicables dentro de modelos teóricos existentes o nuevos. Más información en la sección Creencias indígenas.

Una afirmación extraordinaria es una declaración que contradice el corpus establecido de conocimiento y requiere revisar principios fundamentales. Por ejemplo, la afirmación sobre transmisión instantánea de información mediante entrelazamiento cuántico contradice la teoría especial de la relatividad y requiere pruebas extraordinarias (S001).

El cerebro humano no evolucionó para evaluar significancia estadística, sino para tomar decisiones rápidas en condiciones de incertidumbre. Vemos patrones donde no los hay, atribuimos relaciones causales a correlaciones aleatorias y confiamos más en las autoridades que en los datos.

Incluso los científicos profesionales están sujetos a sesgos cognitivos al interpretar resultados, especialmente al trabajar con valores p y significancia estadística (S001), (S003).

🔎 Tres tipos de afirmaciones extraordinarias

El primer tipo amplía las teorías existentes sin refutarlas. El descubrimiento de la libertad asintótica en la cromodinámica cuántica fue extraordinario, pero no contradijo los principios fundamentales de la teoría cuántica de campos.

El segundo tipo requiere una revisión radical de las leyes fundamentales: violación de las leyes de la termodinámica, transmisión de información superlumínica, efectos cuánticos macroscópicos en biología. Tales afirmaciones requieren no solo resultados estadísticamente significativos, sino también un mecanismo teórico que explique por qué todos los experimentos anteriores no los detectaron.

El tercer tipo son intentos de vincular la ciencia moderna con textos filosóficos o religiosos antiguos. Aunque el análisis histórico de ideas filosóficas tiene valor, presentar textos antiguos como anticipación de la mecánica cuántica generalmente se basa en interpretación retrospectiva e ignora el contexto de origen de estas ideas.

- Apofenia

- Tendencia a ver patrones significativos en datos aleatorios: un sesgo cognitivo especialmente peligroso al analizar afirmaciones extraordinarias.

- Prueba extraordinaria

- No solo un resultado estadísticamente significativo, sino datos reproducibles, un mecanismo teórico e integración en el corpus existente de conocimiento.

🧱 La frontera entre escepticismo y dogmatismo

La historia de la ciencia está llena de ejemplos donde ideas revolucionarias encontraron resistencia: heliocentrismo, mecánica cuántica. Pero estas ideas triunfaron no por el carisma de sus autores, sino gracias a pruebas experimentales reproducibles y modelos teóricos que explicaban más fenómenos que las teorías anteriores.

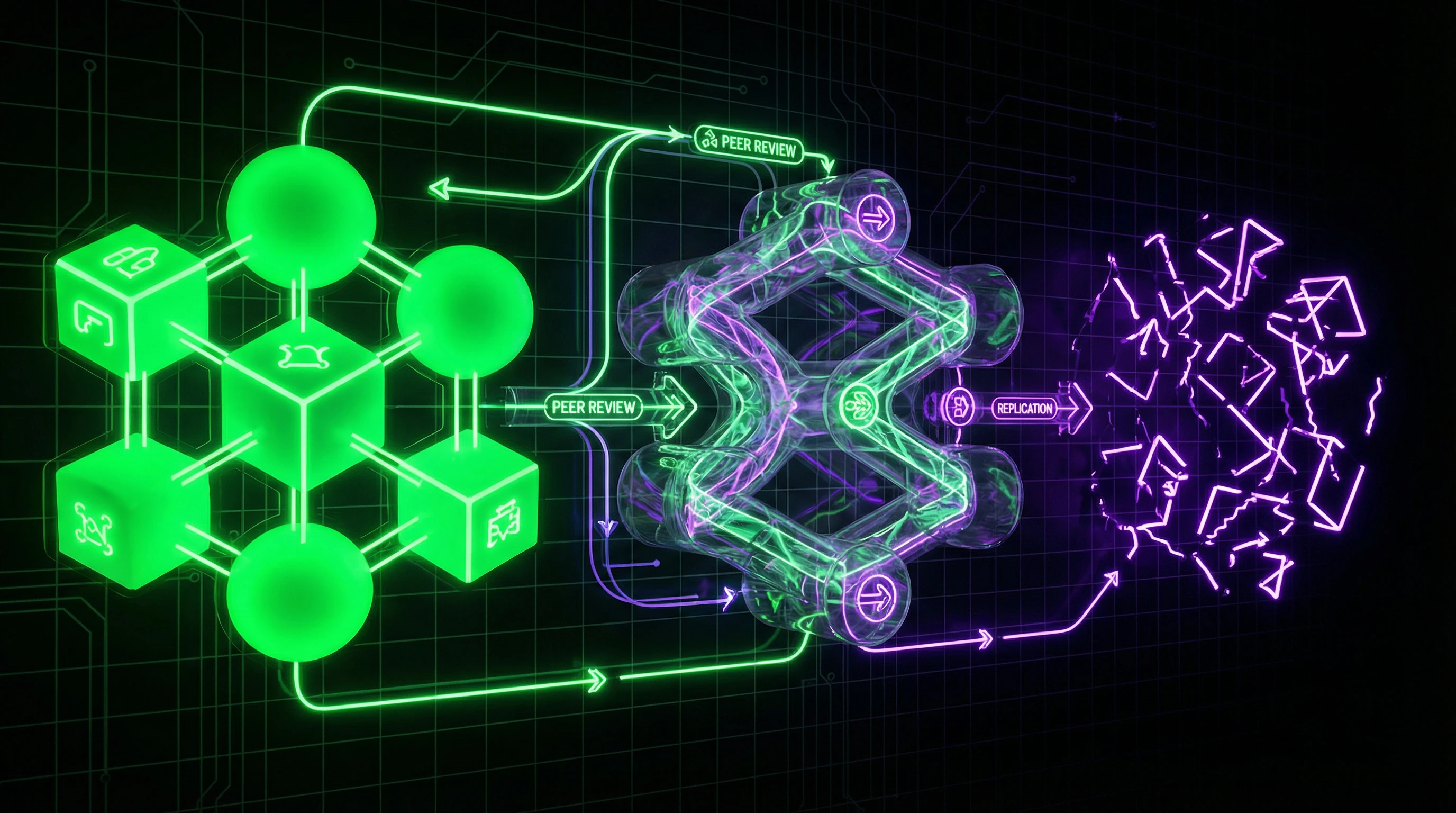

Principio clave: una afirmación extraordinaria debe pasar por múltiples verificaciones independientes: reproducción en diferentes laboratorios, análisis teórico, integración en el corpus existente de conocimiento.

El sistema de peer review, a pesar de sus deficiencias, sigue siendo el mejor mecanismo de filtrado de afirmaciones científicas (S006). La transparencia del proceso no introduce sesgo sistemático, aunque crea nuevos desafíos.

| Señal de escepticismo saludable | Señal de dogmatismo |

|---|---|

| Requiere datos reproducibles | Rechaza datos sin análisis |

| Busca mecanismo teórico | Niega el mecanismo a priori |

| Verifica mediante fuentes independientes | Se basa en la autoridad |

La conexión con la fe y las pruebas muestra cómo funciona el consenso científico cuando es atacado. Comprender las falacias lógicas ayuda a proteger el pensamiento crítico de la manipulación.

El hombre de acero: los siete argumentos más sólidos a favor de afirmaciones extraordinarias y por qué merecen consideración seria

Antes de desmantelar afirmaciones extraordinarias, es necesario construir su versión más sólida — esto se llama principio del "hombre de acero" (steelman), lo opuesto al "hombre de paja". Solo refutando la forma más convincente del argumento podemos estar seguros de nuestras conclusiones. Examinemos siete categorías de argumentos que se utilizan con mayor frecuencia para respaldar afirmaciones extraordinarias. Más información en la sección Islam.

🧪 Argumento de anomalías reproducibles: cuando el experimento se repite pero no se explica

El argumento más sólido a favor de una afirmación extraordinaria es una anomalía experimental reproducible. Si varios laboratorios independientes obtienen el mismo resultado inesperado, esto requiere explicación. Ejemplo clásico: los experimentos con neutrinos que supuestamente se movían más rápido que la luz (posteriormente resultó ser un error de medición). Importante: la reproducibilidad no garantiza la corrección de la interpretación, pero excluye la fluctuación aleatoria como explicación.

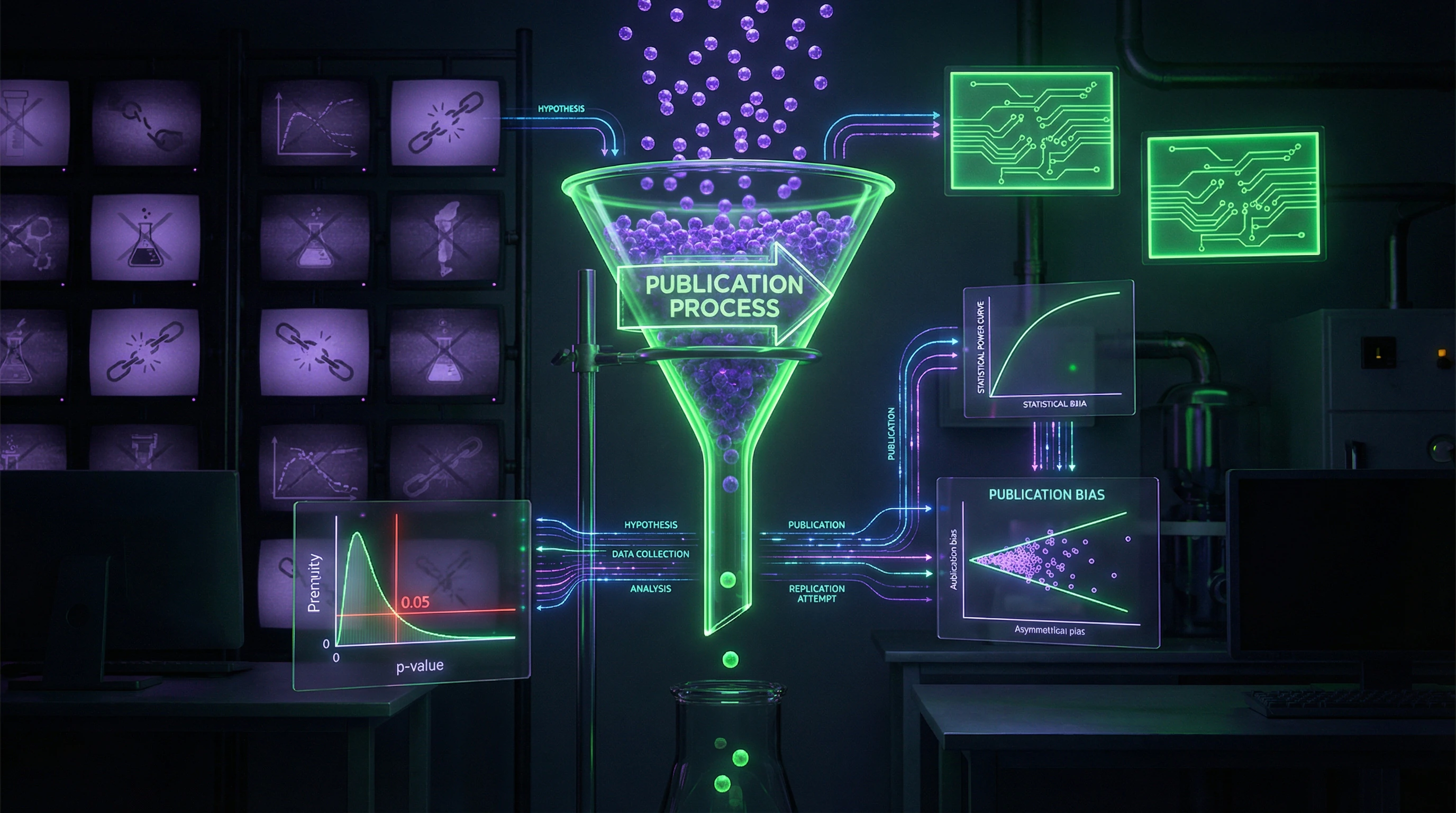

📊 El problema es que la verdadera reproducibilidad es rara. Las investigaciones muestran que en ciencias biológicas y naturales una parte significativa de los resultados no se reproduce en experimentos repetidos (S001, S003). Esto no solo se debe al fraude, sino también a problemas más sutiles: p-hacking (manipulación de datos para lograr significancia estadística), sesgo de publicación (publicación solo de resultados positivos) y potencia estadística insuficiente de los experimentos.

🧬 Argumento de elegancia teórica: cuando un nuevo modelo explica más con menos

El segundo argumento sólido es la elegancia teórica y el poder explicativo. Si una nueva teoría explica todo lo que explicaba la antigua, más fenómenos adicionales, y lo hace con menos suposiciones, merece consideración seria. El principio de la navaja de Occam funciona precisamente así: no multipliques entidades sin necesidad.

Ejemplo de biología informacional: la investigación sobre el número óptimo de bases en el código genético (S005) muestra cómo el enfoque de teoría de la información puede explicar por qué el ADN utiliza exactamente cuatro bases, ni más ni menos. No es una afirmación extraordinaria en sentido estricto, pero demuestra cómo la elegancia teórica puede señalar principios profundos de organización de sistemas biológicos.

🔁 Argumento de líneas convergentes de evidencia: cuando diferentes métodos conducen a la misma conclusión

⚠️ El tercer argumento es la convergencia de líneas independientes de evidencia. Si la misma conclusión se deriva de experimentos de diferentes tipos, modelos teóricos y observaciones en distintos contextos, esto fortalece significativamente su credibilidad. Por ejemplo, la existencia de materia oscura se confirma mediante lentes gravitacionales, curvas de rotación de galaxias, anisotropía de la radiación cósmica de fondo y simulaciones computacionales de formación de estructuras en el universo.

Sin embargo, la convergencia puede ser ilusoria si todos los métodos comparten el mismo sesgo sistemático. La revisión sistemática del uso de contexto en detección de objetos (S008) muestra cómo diferentes algoritmos de aprendizaje automático pueden dar resultados similares no porque modelen correctamente la realidad, sino porque explotan los mismos artefactos en los datos de entrenamiento.

🧠 Argumento de plausibilidad mecanicista: cuando existe un camino teórico de causa a efecto

El cuarto argumento es la existencia de un mecanismo plausible. Incluso si los datos experimentales son ambiguos, la presencia de un mecanismo teórico detallado que explique cómo la causa conduce al efecto fortalece la afirmación. Esto es especialmente importante en biología y medicina, donde los ensayos controlados aleatorizados no siempre son posibles.

Problema: la plausibilidad es subjetiva y depende de los marcos teóricos existentes. Lo que parece plausible dentro de un paradigma puede ser absurdo en otro. La revisión del enfoque de partición para interpretar la mecánica cuántica (S007) ilustra cómo interpretaciones alternativas pueden ser internamente consistentes pero diferir radicalmente de las visiones dominantes.

📊 Argumento de potencia estadística: cuando el tamaño de la muestra excluye la casualidad

🔬 El quinto argumento es la potencia estadística suficiente. Si un experimento tiene un gran tamaño de muestra y potencia estadística correctamente calculada, la probabilidad de un resultado falso positivo disminuye. Esto es especialmente importante en el contexto de la crisis de reproducibilidad en la ciencia, donde muchos estudios tienen potencia insuficiente para detectar efectos reales (S001, S003).

Sin embargo, la alta potencia estadística no protege contra errores sistemáticos. Una muestra grande puede medir con alta precisión la magnitud incorrecta si el diseño del experimento contiene sesgo sistemático. Además, en la era del big data es fácil encontrar correlaciones estadísticamente significativas pero prácticamente sin sentido.

🧷 Argumento del consenso de expertos: cuando los especialistas en el campo están de acuerdo

El sexto argumento es el consenso de la comunidad experta. Si la mayoría de especialistas en el campo relevante respaldan la afirmación, esto es un argumento de peso a su favor. El método Delphi, utilizado para alcanzar consenso en investigaciones médicas (S009), muestra cómo un proceso estructurado puede ayudar a los expertos a llegar a acuerdos sobre cuestiones complejas.

⚠️ Pero el consenso no es garantía de verdad. La historia de la ciencia conoce muchos ejemplos donde el consenso fue erróneo: desde la teoría del flogisto hasta la eugenesia. Además, en algunos campos el consenso puede formarse bajo la influencia de factores sociales, políticos o económicos no relacionados con evidencia científica.

🔎 Argumento de poder predictivo: cuando la teoría predice fenómenos nuevos e inesperados

El séptimo y más sólido argumento es el poder predictivo. Si una teoría predice nuevos fenómenos que luego se descubren experimentalmente, esto es un testimonio poderoso a su favor. Ejemplos clásicos: la predicción de Einstein de la desviación de la luz en un campo gravitacional, la predicción de antipartículas por Dirac, la predicción del bosón de Higgs.

Distinción importante: las explicaciones postdictivas (cuando la teoría explica hechos ya conocidos) son mucho más débiles que las predictivas. Es fácil ajustar un modelo a datos existentes, pero mucho más difícil predecir algo que nadie ha visto aún. Por eso el preregistro de hipótesis y planes de análisis se está convirtiendo en estándar en la ciencia moderna.

Anatomía de la evidencia: cómo evaluar la calidad de los datos científicos en la era del ruido informativo y los preprints

Ahora que hemos construido al hombre de acero, es hora de desmontarlo. La evaluación de la calidad de la evidencia científica requiere un enfoque sistemático que considere no solo la significancia estadística, sino también el diseño del estudio, los sesgos potenciales, la reproducibilidad y la integración teórica. Más detalles en la sección Nuevos movimientos religiosos.

📊 Jerarquía de la evidencia: desde metaanálisis hasta anécdotas, y por qué no es absoluta

La jerarquía tradicional sitúa en la cima las revisiones sistemáticas y metaanálisis de ensayos controlados aleatorizados (ECA), seguidos de ECA individuales, estudios de cohortes, estudios de casos y controles, y en la base, descripciones de casos individuales y opiniones de expertos. Esta jerarquía es útil, pero no absoluta.

La calidad de una revisión sistemática depende de la calidad de los estudios incluidos (S008). Un metaanálisis de experimentos mal diseñados no proporcionará conclusiones fiables, mientras que un estudio observacional bien planificado puede ser más informativo que un ECA deficiente.

- Revisión sistemática — verificación de todos los estudios disponibles sobre un tema con criterios de inclusión claros

- Metaanálisis — combinación estadística de resultados de múltiples estudios

- Ensayo controlado aleatorizado — distribución aleatoria de participantes en grupos

- Estudio de cohortes — seguimiento de un grupo de personas con una característica común

- Estudio de casos y controles — comparación de personas con y sin el resultado de interés

- Descripción de caso — descripción detallada de uno o varios pacientes

🧾 Valores p y significancia estadística: por qué p < 0.05 no significa "demostrado"

Uno de los errores más comunes es equiparar la significancia estadística con la importancia práctica o la veracidad de la hipótesis. El valor p muestra la probabilidad de obtener los datos observados (o más extremos) bajo la condición de que la hipótesis nula sea verdadera.

El valor p no es la probabilidad de que la hipótesis nula sea verdadera, ni la probabilidad de que el resultado sea casual. Es una probabilidad condicional bajo el supuesto de que la hipótesis nula es verdadera.

El umbral p < 0.05 es una convención arbitraria, no una frontera mágica entre verdad y falsedad (S001, S003). En pruebas múltiples (cuando se verifican muchas hipótesis simultáneamente) la probabilidad de resultados falsos positivos aumenta drásticamente. Correcciones como Bonferroni ayudan, pero no resuelven completamente el problema.

🔁 Reproducibilidad como estándar de oro: la crisis de replicación y qué significa para evaluar afirmaciones

La reproducibilidad —la capacidad de obtener el mismo resultado al repetir un experimento— se considera el estándar de oro del método científico. La crisis de replicación de los últimos años ha demostrado que una parte significativa de los resultados publicados no se reproduce, especialmente en psicología, medicina y biología (S001, S003).

| Causa de irreproducibilidad | Mecanismo | Cómo detectarla |

|---|---|---|

| Potencia estadística insuficiente | El tamaño de la muestra es demasiado pequeño para detectar el efecto | Verificar el cálculo de potencia en la metodología |

| Flexibilidad en el análisis de datos | El investigador elige el análisis que produce un resultado significativo | Comparar el preregistro con el análisis publicado |

| Sesgo de publicación | Solo se publican resultados significativos | Búsqueda de preprints y resultados negativos |

| HARKing | La hipótesis se formula después de obtener los resultados | Verificar la lógica de la hipótesis y el diseño |

La irreproducibilidad no siempre significa fraude. A menudo es resultado de errores honestos y problemas estructurales en el sistema de publicaciones científicas.

🧷 Peer review como filtro: qué puede y qué no puede hacer, y por qué la revisión abierta cambia las reglas del juego

El sistema de peer review es el principal mecanismo de control de calidad en la ciencia. Antes de la publicación, el artículo pasa por la revisión de varios expertos que evalúan la metodología, el análisis de datos y las conclusiones. Sin embargo, este sistema dista de ser perfecto.

La revisión abierta (cuando se conocen los nombres de los revisores) no necesariamente introduce un sesgo sistemático, pero puede cambiar la dinámica de interacción (S006). Puede reducir la agresividad de la crítica y hacer el proceso más constructivo. Importante: el peer review no garantiza la corrección de los resultados, solo verifica que la metodología cumpla con los estándares del campo.

🔬 Preprints y revisión postpublicación: el nuevo ecosistema de comunicación científica y sus riesgos

El modelo tradicional de publicación científica —envío a revista, peer review, publicación— toma meses o años. Los preprints (versiones de artículos en acceso abierto antes de la revisión formal) han revolucionado la comunicación científica, acelerando la difusión de resultados.

Sin embargo, los preprints crean nuevos riesgos. Resultados no verificados pueden ser captados por los medios y presentados como hechos establecidos. Durante la pandemia de COVID-19 esto llevó a la difusión de numerosas afirmaciones erróneas basadas en preprints de baja calidad (S006). La revisión postpublicación (cuando el artículo se discute y critica después de la publicación) resuelve parcialmente este problema, pero requiere la participación activa de la comunidad científica.

🧭 Conflictos de interés y financiación: cómo el dinero distorsiona las conclusiones científicas, incluso cuando los investigadores son honestos

Los conflictos de interés son situaciones en las que el investigador tiene incentivos financieros o personales que pueden influir en el diseño, la realización o la interpretación del estudio. Un ejemplo clásico son los estudios financiados por compañías farmacéuticas, que tienen mayor probabilidad de mostrar resultados positivos para los fármacos de esas compañías.

Un conflicto de interés no significa automáticamente que los resultados sean incorrectos. Pero requiere mayor vigilancia al evaluar la evidencia.

La transparencia de la financiación, el preregistro de protocolos de investigación y el acceso abierto a los datos son mecanismos que ayudan a reducir la influencia de los conflictos de interés. Un enfoque estructurado para lograr el consenso experto puede ayudar a minimizar el sesgo en el proceso de evaluación de la evidencia.

Al evaluar afirmaciones extraordinarias, presta atención a la financiación, la afiliación de los autores y la disponibilidad de datos abiertos. Esto no prueba un error, pero indica la necesidad de verificación adicional.

Mecanismos de la ilusión: por qué la correlación no equivale a causalidad, y cómo los factores de confusión crean patrones falsos

Incluso los datos convincentes pueden ocultar la ilusión de una relación causal. Esto es crítico al evaluar afirmaciones extraordinarias, que a menudo se basan en observaciones en lugar de experimentos controlados. Más información en la sección Falacias lógicas.

🔁 Correlación vs. causalidad: trampas clásicas y métodos modernos de inferencia causal

«La correlación no implica causalidad» es un principio conocido, pero su mecanismo requiere análisis. Dos variables se correlacionan por tres razones: A causa B, B causa A, o una tercera variable C causa ambas.

Los métodos modernos de inferencia causal —variables instrumentales, diseño de regresión discontinua, control sintético— permiten extraer conclusiones sobre causalidad a partir de datos observacionales. Pero requieren supuestos fuertes que a menudo son imposibles de verificar. El experimento controlado aleatorizado sigue siendo el estándar de oro: la asignación aleatoria de participantes elimina las diferencias sistemáticas.

🧩 Factores de confusión y variables ocultas: cómo un tercer factor crea la ilusión

Un factor de confusión es una variable relacionada tanto con la supuesta causa como con el efecto, creando una falsa apariencia de conexión entre ellos. Ejemplo clásico: la correlación entre el consumo de helado y los ahogamientos. Ambos son causados por el calor —un tercer factor.

El factor de confusión funciona como un director invisible: empuja ambas variables en la misma dirección, y el observador solo ve su movimiento sincronizado, interpretándolo como causalidad.

En medicina, los factores de confusión son especialmente peligrosos. Los pacientes que toman vitaminas suelen ser más saludables no por las vitaminas, sino porque ya cuidan su salud —hacen ejercicio, comen mejor, se hacen chequeos regulares. La salud causa la toma de vitaminas, no al revés.

Para controlar los factores de confusión se utiliza la estratificación (división en subgrupos), análisis de regresión o emparejamiento (matching). Pero todos estos métodos requieren que conozcas el factor de confusión de antemano. Las variables ocultas —aquellas de las que no sospechas— siguen siendo una amenaza invisible.

📊 Causalidad inversa y relaciones cíclicas: cuando el efecto se convierte en causa

La causalidad inversa ocurre cuando el supuesto efecto en realidad causa la causa. La depresión se correlaciona con bajos ingresos, pero los bajos ingresos pueden causar depresión, y la depresión puede llevar a la pérdida de empleo y reducción de ingresos.

| Escenario | Correlación visible | Mecanismo real | Cómo verificar |

|---|---|---|---|

| Vitaminas y salud | Las personas que toman vitaminas son más saludables | Las personas saludables toman vitaminas | Experimento aleatorizado |

| Oración y recuperación | Quienes rezan se recuperan más frecuentemente | Pacientes menos graves rezan; médicos tratan mejor a creyentes | Control de gravedad, diseño doble ciego |

| Redes sociales y soledad | Usuarios activos están más solos | Personas solitarias buscan consuelo en redes | Estudio longitudinal con desfase temporal |

Las relaciones cíclicas complican aún más el panorama. La pobreza causa estrés, el estrés reduce las capacidades cognitivas, lo que dificulta salir de la pobreza. El sistema se autorrefuerza, y es imposible señalar una única causa.

🎯 Sesgo de selección: cuando la muestra de datos crea la ilusión por sí misma

El sesgo de selección (selection bias) surge cuando el método de selección de datos distorsiona sistemáticamente los resultados. Si estudias la eficacia de un tratamiento solo en pacientes que lo completaron, excluyes a quienes lo abandonaron por efectos secundarios o ineficacia.

Los pacientes supervivientes parecen más saludables de lo que realmente son. Esto se llama sesgo del superviviente. En afirmaciones extraordinarias, el sesgo de selección funciona especialmente bien: las personas a quienes ayudó el tratamiento milagroso hablan de él; quienes no obtuvieron ayuda permanecen en silencio.

- Sesgo de publicación

- Los estudios con resultados positivos se publican más frecuentemente que aquellos con resultados negativos. Esto crea la ilusión de que el efecto existe, aunque en realidad la mitad de los estudios no lo encontraron.

- Sesgo de memoria

- Las personas recuerdan mejor los eventos que confirman sus creencias. Si crees en un tratamiento milagroso, recordarás los casos en que funcionó y olvidarás los casos en que no ayudó.

- Sesgo de pruebas múltiples

- Si pruebas 100 hipótesis, aproximadamente 5 serán «significativas» simplemente por azar (con nivel de significancia 0,05). Si publicas solo estas 5, el lector ve un 100% de éxito.

Para controlar el sesgo de selección es necesario definir claramente los criterios de inclusión y exclusión antes de iniciar el estudio, utilizar análisis por intención de tratar (intention-to-treat) y registrar el estudio en registros abiertos.

🔍 Cómo distinguir causalidad de ilusión: lista de verificación práctica

- ¿Existe una explicación alternativa mediante un factor de confusión? Nombra tres posibles terceros factores.

- ¿Puede haber causalidad inversa? ¿Es lógicamente posible que el efecto cause la causa?

- ¿Cómo se seleccionaron los datos? ¿Quién está incluido, quién excluido, por qué?

- ¿Existe un mecanismo? Si A causa B, debe haber una cadena biológica o física de eventos.

- ¿Es reproducible? ¿Se ha encontrado en diferentes poblaciones, países, períodos temporales?

- ¿Existe relación dosis-respuesta? ¿Si hay más A, hay más B? ¿O el efecto es igual con cualquier cantidad de A?

- ¿Predice el futuro? Si la causalidad es real, debe funcionar en nuevos datos.

Las afirmaciones extraordinarias a menudo no superan ni siquiera los primeros tres puntos de esta lista. Esto no significa que sean falsas, pero sí que la evidencia es insuficiente para concluir causalidad.