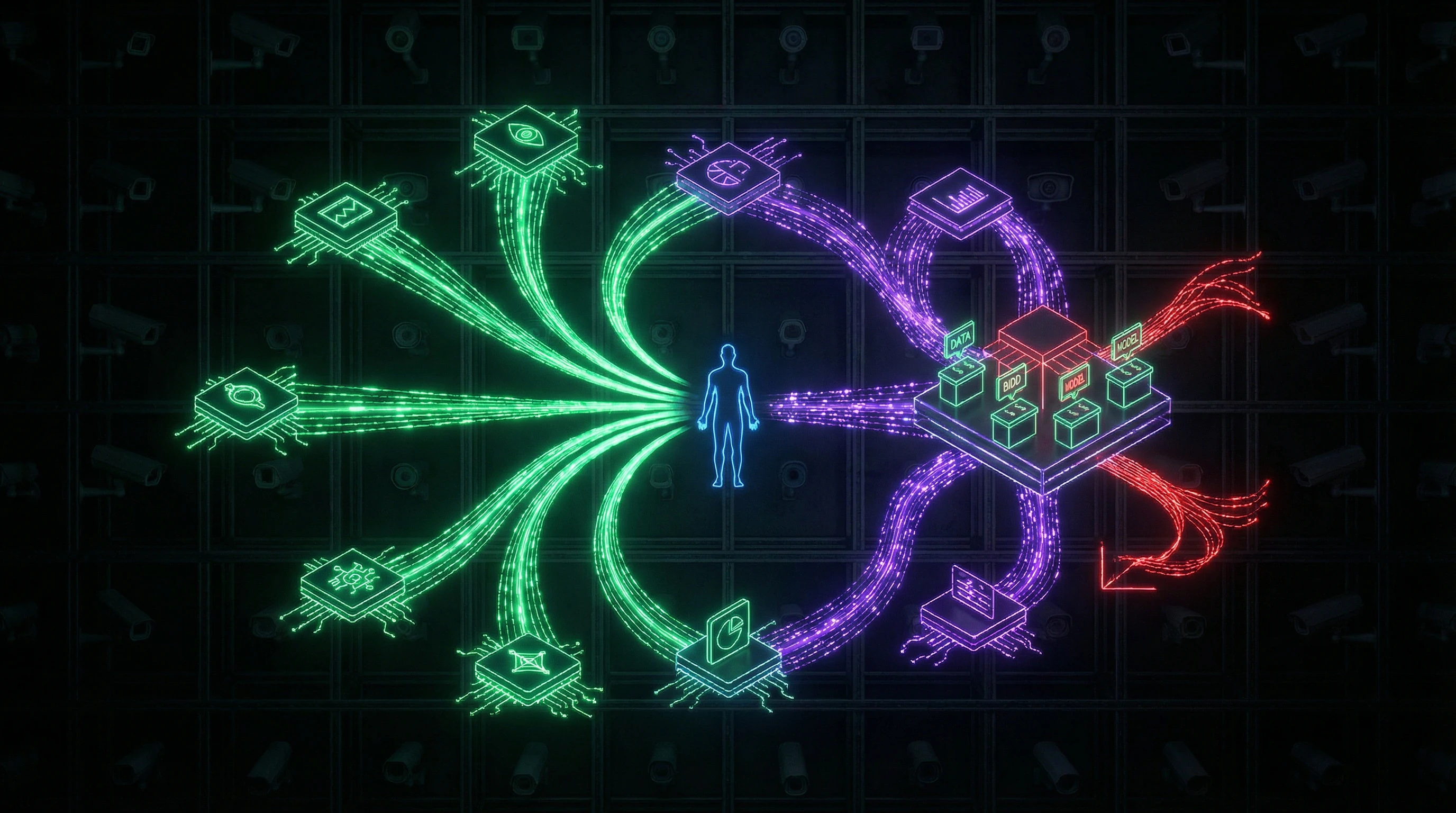

La economía de la atención (attention economy) es un sistema en el que la atención humana se ha convertido en un recurso escaso y una mercancía. En un contexto de sobreabundancia informativa, empresas, medios y gobiernos compiten por cada segundo de tu concentración, transformándolo en beneficios mediante publicidad, datos y patrones de comportamiento. El capitalismo de vigilancia (surveillance capitalism) es un modelo de negocio que monetiza la observación del comportamiento de los usuarios y la predicción de sus acciones. Juntos, estos fenómenos crean un sistema donde tu identidad se fragmenta, se agrega y se vende sin tu consentimiento consciente.

🖤 Cada vez que abres tu smartphone, deslizas el feed o haces clic en un anuncio, no solo consumes contenido: tú mismo te conviertes en el producto. Tu atención, tus patrones de comportamiento, tus microreacciones a los estímulos se extraen, se digitalizan y se venden en subastas cuya existencia ni siquiera sospechas. 👁️ Esto no es una metáfora ni una teoría conspirativa: es un modelo de negocio documentado que en las últimas dos décadas ha convertido la conciencia humana en el activo más líquido de la era informacional. 💎 En este artículo analizaremos la mecánica de la economía de la atención y el capitalismo de vigilancia, apoyándonos exclusivamente en fuentes académicas, datos empíricos y análisis crítico, sin conspiraciones pero también sin ilusiones.

Qué es la economía de la atención: de la sobreabundancia informativa a la escasez de recursos cognitivos

El término "economía de la atención" fue utilizado por primera vez por el economista estadounidense Michael Goldhaber en 1997 (S008). Replanteó la "economía de la información", desplazando el foco desde la producción de información hacia su consumo o, más precisamente, hacia la limitación de la capacidad humana para procesarla.

La paradoja de la abundancia: más información = menos atención

La información y los productos se han multiplicado, pero el tiempo disponible para procesarlos sigue siendo el mismo (S001). Herbert Simon, premio Nobel de Economía, lo formuló en 1971: "En un mundo rico en información, la abundancia de información significa escasez de algo más: escasez de aquello que la información consume. Y la información consume atención" (S001).

La abundancia de información crea escasez de atención y la necesidad de distribuirla eficientemente entre un exceso de fuentes.

La atención como recurso escaso y mercancía

La economía de la atención es un sistema en el que medios, empresas y gobiernos compiten por la atención del consumidor como su recurso más escaso (S001). La atención deja de ser simplemente un fenómeno psicológico para convertirse en una unidad económica que puede medirse, valorarse e intercambiarse.

Los smartphones y portátiles han reemplazado a los libros, la comunicación presencial, las tiendas físicas (S008): cada interacción genera datos sobre hacia dónde se dirige la atención, cuánto tiempo se mantiene y qué la desvía.

Límites del concepto: economía de la atención vs capitalismo de vigilancia

- Economía de la atención

- Marco analítico que describe la competencia por recursos cognitivos. Puede existir sin vigilancia total: en publicidad tradicional, discursos públicos, medios convencionales.

- Capitalismo de vigilancia

- Modelo de negocio específico que monetiza la atención mediante la recopilación, análisis y predicción del comportamiento basándose en datos personales. Infraestructura tecnológica que implementa la economía de la atención.

Estos dos fenómenos se solapan, pero no son idénticos. El primero es una lógica económica, el segundo su implementación técnica concreta. Comprender esta distinción es crítico para analizar dónde surgen exactamente los riesgos y dónde son posibles modelos alternativos. Más detalles en la sección Epistemología.

Para profundizar en los mecanismos de manipulación de la atención, consulta el análisis del scroll infinito y las trampas dopaminérgicas.

Versión robusta del argumento: por qué la economía de la atención y el capitalismo de vigilancia se consideran inevitables

Antes de pasar a la crítica, es necesario presentar los argumentos más convincentes a favor de que la economía de la atención y el capitalismo de vigilancia son consecuencia lógica del desarrollo tecnológico y económico. Esta es la llamada «versión robusta» (steelman) — la formulación más sólida de la posición, que luego verificaremos con hechos. Más detalles en la sección Estadística y teoría de probabilidades.

| Argumento | Mecanismo | Resultado declarado |

|---|---|---|

| Eficiencia del targeting | Los algoritmos seleccionan ofertas relevantes en lugar de envíos masivos | Reducción de costes de transacción, ahorro de tiempo del usuario |

| Acceso gratuito | Los anunciantes subvencionan servicios para miles de millones de usuarios | Inclusividad, reducción de la brecha digital |

| Carrera innovadora | La competencia por la atención estimula I+D y mejora de UX | Interfaces de mayor calidad, recomendaciones más precisas, nuevas funciones |

| Control del usuario | Configuración de privacidad, GDPR, derecho a eliminación de datos | Intercambio voluntario de datos por comodidad |

| Inevitabilidad económica | Modelos alternativos (suscripciones, descentralización) no escalan | El mercado eligió la única opción viable |

| Bienes públicos | Datos agregados usados para pronósticos epidemiológicos, optimización de transporte, criminalística | Efectos positivos secundarios superan riesgos de privacidad |

| Adaptación evolutiva | Las personas desarrollan habilidades de higiene digital y pensamiento crítico | La sociedad se adapta, como se adaptó a la escritura y la TV |

Por qué estos argumentos suenan convincentes

Cada uno se apoya en fenómenos reales: la publicidad segmentada efectivamente reduce el ruido, las plataformas son realmente gratuitas, las innovaciones realmente ocurren. Los defensores de la economía de la atención no inventan hechos — los reinterpretan a través del prisma de la eficiencia y la inevitabilidad.

El movimiento clave: trasladan la pregunta de «¿Es esto bueno?» a «¿Hay alternativa?». Si no hay alternativas, la crítica se convierte en moralismo, no en análisis.

Este es un truco clásico: si el sistema parece inevitable, sus defectos dejan de percibirse como problemas — se convierten simplemente en el «precio del progreso». El pánico en torno al capitalismo de vigilancia se declara pánico moral, análogo a los temores ante la radio o los cómics. La sociedad lo superará, como siempre lo ha hecho.

Dónde se ocultan las trampas en esta lógica

La versión robusta del argumento parece invulnerable, pero contiene varios supuestos ocultos que requieren verificación. No son falsos, pero tampoco evidentes.

- Supuesto 1: «Los usuarios consintieron conscientemente»

- Esto es cierto jurídicamente (hay una casilla en los Términos de Servicio), pero psicológicamente dudoso. El consentimiento bajo presión (o pagas, o renuncias al servicio) no es exactamente una elección voluntaria. Además, la mayoría de usuarios no leen las condiciones y no entienden qué datos se recopilan ni cómo se utilizan. Aquí se necesitan datos sobre el nivel real de información.

- Supuesto 2: «Los modelos alternativos no son viables»

- Esto es cierto para el momento actual, pero no explica por qué. ¿Quizás no son viables porque el mercado está capturado por monopolistas que usan su poder para suprimir la competencia? ¿O porque los efectos de red crean barreras naturales de entrada? Esto no es un argumento a favor de la inevitabilidad, sino una señal de problemas estructurales del mercado.

- Supuesto 3: «Los datos se usan para el bien público»

- Esto es cierto en casos aislados, pero no es el objetivo principal de la recopilación de datos. El objetivo principal es el beneficio. Los bienes públicos son un producto secundario. Hay que distinguir dónde los datos realmente se usan para la sociedad y dónde es simplemente retórica.

Todos estos supuestos requieren verificación empírica. Precisamente de esto nos ocuparemos en las siguientes secciones — no rechazando los argumentos, sino probándolos con datos.

Ahora es importante entender: la versión robusta del argumento no es la verdad, sino una hipótesis. Es lógica, pero la lógica no garantiza correspondencia con la realidad. El método científico requiere verificación mediante hechos, no mediante la persuasión de la retórica.

Un argumento convincente y un argumento correcto no son lo mismo. La versión robusta es convincente precisamente porque ignora detalles incómodos: la asimetría de información entre plataformas y usuarios, los efectos de red que bloquean la competencia, y la diferencia entre el consentimiento en papel y la comprensión real de a qué has consentido.

El siguiente paso — ver qué dicen los datos sobre cada uno de estos argumentos. ¿Confirman la hipótesis de eficiencia e inevitabilidad, o señalan otros mecanismos?

Base probatoria: qué dicen los datos sobre la economía de la atención y el capitalismo de vigilancia

Pasemos al análisis sistemático de los hechos. Cada afirmación está respaldada por una fuente; distinguimos entre datos empíricos, modelos teóricos y juicios normativos. Más detalles en la sección Método científico.

📊 Definición del capitalismo de vigilancia: marco conceptual de Shoshana Zuboff

El término «capitalismo de vigilancia» (surveillance capitalism) fue sistematizado por Shoshana Zuboff desde 2015. Zuboff lo define como una lógica económica en la que la experiencia humana privada se convierte en materia prima gratuita para su transformación en datos conductuales (S010).

Estos datos se procesan mediante aprendizaje automático para crear «excedentes conductuales» (behavioral surplus) — predicciones sobre acciones futuras de los usuarios, vendidas en mercados de pronóstico conductual (S010). La diferencia clave con la publicidad tradicional: no se monetiza la visualización del anuncio, sino la probabilidad de una acción específica (clic, compra, voto).

📊 Mecanismo de extracción de valor: de la observación a la predicción

La vigilancia es un proceso que observa el comportamiento, reconoce propiedades e identifica individuos (S011). Los individuos tienen múltiples identidades — reales y virtuales, utilizadas en diferentes aspectos de la vida (S011).

La mayoría de los aspectos de la vida están sujetos a alguna forma de vigilancia, y las observaciones con identidades se agregan (S011). Los datos recopilados en un contexto (búsquedas) se combinan con datos de otro (geolocalización, compras), creando un perfil detallado que ninguna fuente individual podría proporcionar.

📊 Teoría crítica de la vigilancia en el capitalismo informacional

Christian Fuchs en su trabajo «Towards a Critical Theory of Surveillance in Informational Capitalism» (2012) sostiene que las teorías tradicionales de vigilancia son insuficientes para estudiar la vigilancia en internet (S012).

Fuchs propone una tipología de la vigilancia en el capitalismo informacional, basada en la economía política crítica, que permite sistematizar el análisis de la vigilancia en las esferas de producción, circulación y consumo (S012). Su conclusión: para superar la vigilancia son necesarias recomendaciones políticas (S012) — el problema no se resuelve solo con medios tecnológicos o individuales.

- Vigilancia en la producción: control sobre el trabajo y los datos de los trabajadores

- Vigilancia en la circulación: seguimiento del comportamiento y preferencias del consumidor

- Vigilancia en el consumo: personalización y manipulación de la elección

🧾 Datos empíricos: escala de la recopilación de datos

Las cifras exactas sobre la escala de recopilación de datos por las grandes plataformas son secreto comercial. Las evidencias indirectas apuntan a un volumen sin precedentes: Google procesa más de 8.500 millones de búsquedas al día, cada una vinculada a un perfil de usuario o identificador único de dispositivo.

Meta recopila datos no solo sobre acciones en la plataforma, sino también sobre visitas a sitios de terceros a través de píxeles de seguimiento y botones de «Compartir». Los datos incluyen acciones explícitas (clics, me gusta) y señales implícitas: tiempo en página, velocidad de desplazamiento, movimientos del cursor — todo lo que indica el nivel de engagement.

🧪 Datos experimentales: influencia de la segmentación en el comportamiento

La publicidad personalizada es más efectiva que la no segmentada, pero esta efectividad se logra no solo por relevancia, sino por la explotación de vulnerabilidades cognitivas. Los anuncios se muestran en momentos de máxima receptividad (fatiga, estrés, aburrimiento) o utilizan prueba social («tus amigos compraron esto»), creando una ilusión de consenso.

Estas técnicas van más allá de informar y se acercan a la manipulación — influencia deliberada en la elección mediante la explotación de limitaciones cognitivas, no mediante la provisión de información.

🔬 Asimetría de información: los usuarios no saben qué se sabe sobre ellos

El problema clave del capitalismo de vigilancia es la asimetría radical de información. Las plataformas saben sobre los usuarios mucho más de lo que los usuarios saben sobre las plataformas. Incluso al solicitar datos bajo GDPR, el usuario recibe solo una parte: registros brutos, pero no los algoritmos de interpretación, ni los modelos de predicción de comportamiento, ni los precios de venta de esas predicciones.

Esto convierte el «consentimiento informado» en una ficción: es imposible consentir lo que no se comprende. La conexión entre el scroll infinito y la trampa dopaminérgica demuestra cómo la arquitectura de las plataformas amplifica esta asimetría a través del diseño, no solo mediante la recopilación de datos.

- Asimetría informacional

- La plataforma sabe: algoritmos, modelos, precios, predicciones. El usuario sabe: qué hizo, pero no cómo se interpreta.

- Asimetría cognitiva

- La plataforma diseña la interfaz para maximizar el engagement. El usuario interactúa con la interfaz sin ver su lógica.

- Asimetría legal

- Los términos de servicio son un contrato unilateral. El usuario acepta o no usa el servicio.

El problema no está en hechos aislados de recopilación de datos, sino en la arquitectura sistémica que hace imposible la transparencia. Incluso el método científico requiere reproducibilidad y apertura — el capitalismo de vigilancia se construye sobre su opuesto.

Mecanismos de causalidad: cómo la economía de la atención influye en el comportamiento y la conciencia

La correlación entre el tiempo en redes sociales y los cambios de comportamiento no es prueba de causalidad. Pero existen mecanismos concretos que señalan una conexión directa entre la arquitectura de las plataformas y la transformación de la conciencia. Más detalles en la sección Falacias lógicas.

🧬 Refuerzo variable y formación de hábitos

Las plataformas digitales utilizan el refuerzo variable: la recompensa (me gusta, notificación, publicación interesante) llega de forma impredecible. Esto crea un hábito más fuerte que el refuerzo fijo, porque el cerebro permanece en estado de expectativa.

El mecanismo es idéntico al de los juegos de azar: la incertidumbre sobre el momento de la "recompensa" obliga a revisar el feed una y otra vez. El diseño no es casual: está optimizado para maximizar el tiempo en la plataforma, lo que correlaciona directamente con el volumen de datos recopilados y la exposición publicitaria (S001).

El refuerzo variable funciona porque explota un mecanismo ancestral de búsqueda de recursos: el cerebro no puede distinguir entre "puede haber recompensa" y "habrá recompensa con certeza" y permanece en modo de máxima alerta.

🔁 Bucles de retroalimentación y efecto cámara de eco

Los algoritmos de recomendación crean bucles cerrados: cuanta más interacción con un tipo de contenido, más contenido similar se muestra. El resultado es una cámara de eco donde el usuario solo ve confirmación de sus creencias.

Los datos empíricos sobre la magnitud del efecto son contradictorios (S003), pero el mecanismo existe y puede amplificar la polarización. Esto es especialmente peligroso en el contexto del reconocimiento de teorías conspirativas, donde el algoritmo puede convertir una idea marginal en la narrativa dominante para un usuario específico.

- Cámara de eco

- Entorno informativo donde el algoritmo muestra solo contenido acorde con el comportamiento previo del usuario. La trampa: parece tu elección, pero es resultado de la ingeniería.

- Polarización

- Amplificación de posiciones opuestas en la sociedad mediante el aislamiento de grupos en espacios informativos separados. Mecanismo: cada grupo ve solo versiones extremas de la posición contraria.

🧷 Sobrecarga cognitiva y atrofia del pensamiento profundo

El cambio constante entre notificaciones, mensajes, noticias y publicidad crea sobrecarga cognitiva. La multitarea reduce la eficacia de cada tarea individual y deteriora la concentración.

El hábito de consumir rápidamente fragmentos cortos de información atrofia las habilidades de lectura profunda y análisis crítico. No es un problema individual: es un cambio en la ecología cognitiva de la sociedad. La conexión con el scroll infinito y la trampa dopaminérgica muestra cómo la arquitectura de la plataforma influye directamente en la neurobiología de la atención.

| Tipo de carga cognitiva | Mecanismo | Resultado |

|---|---|---|

| Cambio de contexto | Las notificaciones interrumpen la tarea actual | Reducción de la profundidad del procesamiento de información |

| Ruido informativo | Múltiples fuentes simultáneas | Imposibilidad de identificar la señal |

| Velocidad de consumo | Optimización para scroll rápido | Atrofia de habilidades de análisis |

🧠 Erosión de la autonomía: de la elección al empujón

El capitalismo de vigilancia no solo observa: modifica activamente el comportamiento mediante "empujones" (nudges). Son decisiones de diseño que orientan la acción sin limitar formalmente la libertad de elección.

El botón "Comprar ahora" es más llamativo que "Añadir a lista de deseos". El temporizador de cuenta atrás crea urgencia artificial. Estas técnicas funcionan porque explotan heurísticas cognitivas y reacciones automáticas, evitando la reflexión racional (S006).

- Predicción conductual: el algoritmo determina qué acción es más probable

- Intervención de diseño: la interfaz se optimiza para esa acción

- Ilusión de elección: el usuario cree que la decisión fue suya

- Escalamiento: millones de personas son empujadas simultáneamente

El empujón se diferencia de la coacción en que deja libertad formal de elección. Pero cuando la elección se hace mediante la explotación de sesgos cognitivos, es libertad solo de nombre.

Conflictos e incertidumbres: dónde divergen las fuentes y qué permanece incierto

Los investigadores difieren en la evaluación de la amenaza de la economía de la atención y el capitalismo de vigilancia. Las discrepancias no se refieren a los hechos, sino a su interpretación y conclusiones normativas. Más detalles en la sección Verificación de la Realidad.

Persuasión vs. manipulación: ¿dónde está el límite?

Los críticos sostienen que la publicidad personalizada y los algoritmos manipulan, privando de autonomía (S001). Los defensores objetan: es simplemente persuasión más eficaz, como la publicidad tradicional.

La persuasión apela a argumentos racionales y deja espacio para el desacuerdo. La manipulación explota vulnerabilidades cognitivas, evitando el pensamiento crítico. El targeting moderno a menudo se sitúa entre estos polos, y esto crea un problema: ¿dónde exactamente comienza el daño?

- Persuasión: argumento → pensamiento crítico → elección

- Manipulación: gatillo → vulnerabilidad cognitiva → acción sin reflexión

- Targeting: datos sobre ti → predicción de puntos débiles → acción (estatus incierto)

Precisión de las predicciones: el mito del ojo omnisciente

Las empresas afirman la precisión de los algoritmos, pero estudios independientes muestran sobreestimación (S006). Los modelos funcionan bien con datos agregados (comportamiento de grupos), pero mal a nivel individual.

Incluso las predicciones inexactas son dañinas: influyen en la puntuación crediticia, contratación, seguros, creando discriminación. Pero esto socava la narrativa del "ojo omnisciente" capaz de leer mentes.

La pregunta permanece abierta: ¿cuán efectivo es el control si los modelos fallan? ¿Es suficiente un 60% de precisión para manipular a millones?

Privacidad vs. comodidad: división normativa

Desacuerdo fundamental: ¿es la privacidad un valor absoluto o puede intercambiarse por comodidad y seguridad?

- Posición libertaria

- Si los usuarios consienten voluntariamente la recopilación de datos, es un intercambio legítimo. El Estado no debe intervenir.

- Posición comunitaria

- La privacidad es un bien colectivo, no solo un derecho individual. El consentimiento bajo presión (elección: datos o exclusión del servicio) no es genuinamente voluntario.

- Posición pragmática

- La asimetría de información hace del "consentimiento voluntario" una ficción: los usuarios no saben cómo se usan sus datos, y las empresas lo ocultan (S007).

Cada posición es lógica dentro de su sistema de valores. El conflicto no se resuelve con hechos, solo con elección política.

Escala del daño: individual vs. sistémico

Uno de los desacuerdos clave: ¿daña el capitalismo de vigilancia a la persona concreta o solo a la sociedad en su conjunto?

| Nivel de análisis | Posición de defensores | Posición de críticos | Incertidumbre |

|---|---|---|---|

| Individual | El usuario recibe contenido relevante, ahorra tiempo | Manipulación, dependencia, pérdida de autonomía (S003) | ¿Cómo medir el daño a una persona concreta? |

| Sistémico | El mercado distribuye recursos más eficientemente | Concentración de poder, socavamiento de la democracia, desigualdad | ¿Qué daño prevalece? |

Un crítico puede aceptar que individualmente no hay daño, pero objetar el efecto sistémico. Un defensor puede reconocer problemas sistémicos, pero sostener que se resuelven con regulación, no abandonando la tecnología.

Regulación: ¿panacea o ilusión?

Existe consenso en que el capitalismo de vigilancia necesita límites. Pero hay desacuerdos sobre cuáles exactamente y cuán efectivos son.

- GDPR y leyes similares: ¿protegen realmente o solo crean apariencia de control?

- Prohibiciones de ciertas prácticas: ¿son técnicamente posibles o las empresas encontrarán formas de eludirlas?

- Transparencia algorítmica: ¿ayudará a los usuarios o solo complicará sin cambiar el comportamiento?

- Separación de datos y servicios: ¿resolverá el problema o creará nuevos monopolios?

Cada enfoque tiene defensores y críticos. No hay prueba empírica de que uno funcione mejor que otros.

Qué permanece incierto

La economía de la atención existe. El capitalismo de vigilancia es una realidad. Pero el grado de daño, los mecanismos de causalidad y la efectividad de las soluciones siguen siendo objeto de desacuerdo honesto, no hechos establecidos.

Esto no significa que todas las posiciones sean iguales. Pero sí significa que el pensamiento crítico requiere reconocer la incertidumbre, no la certeza en la propia razón. Para una comprensión más profunda de los mecanismos de manipulación, ver el análisis de las trampas dopaminérgicas y los métodos de verificación de afirmaciones.

Contraposición

⚖️ Contrapunto Crítico

La economía de la atención es un fenómeno real, pero a menudo se describe a través del prisma del control total, ignorando las contradicciones, las diferencias regionales y la adaptabilidad de los usuarios. Esto es lo que hay que tener en cuenta al criticar este modelo.

Sobreestimación de la agencia de las plataformas

Las empresas tecnológicas no poseen un control total sobre el comportamiento de los usuarios. Las investigaciones muestran que la efectividad de las predicciones conductuales a menudo está sobreestimada: los usuarios demuestran imprevisibilidad, los algoritmos se equivocan, y la "personalización" a menudo se basa en correlaciones burdas, no en una comprensión profunda de la personalidad. El enfoque en "algoritmos omnipotentes" distrae de problemas más fundamentales del capitalismo: la explotación laboral, la desigualdad, la concentración del poder.

Subestimación de la adaptación del usuario

El artículo enfatiza los efectos de lock-in y la inevitabilidad arquitectónica, pero no tiene en cuenta la creciente alfabetización digital y la resistencia de los usuarios. Millones de personas utilizan bloqueadores de anuncios, VPN, plataformas alternativas (Mastodon, Signal), practican el "detox digital". Es posible que la economía de la atención ya haya alcanzado su punto máximo, y estemos observando el inicio de una tendencia inversa: el rechazo consciente de las plataformas tóxicas.

Ausencia de análisis transcultural

La mayoría de las investigaciones sobre el capitalismo de vigilancia se centran en Estados Unidos y Europa Occidental. En otras regiones (China, Rusia, India) los modelos de vigilancia y economía de la atención funcionan de manera diferente: a través del control estatal, otras normas culturales de privacidad, otros modelos de negocio. Las conclusiones sobre el capitalismo de vigilancia occidental pueden no ser aplicables a contextos no occidentales.

El problema de las alternativas

La crítica al capitalismo de vigilancia a menudo no ofrece alternativas funcionales. La regulación (GDPR) ha mostrado una eficacia limitada. Las plataformas descentralizadas no escalan. El control estatal sobre los datos (como en China) crea riesgos aún mayores para la libertad. Quizás el capitalismo de vigilancia no es un error, sino una característica inevitable de la economía digital, y la tarea no es su destrucción, sino la búsqueda de un compromiso entre comodidad, beneficio y derechos.

Riesgo de pánico moral

El enfoque en la "manipulación" y la "adicción" puede derivar en tecnofobia, ignorando los beneficios reales de las plataformas digitales: acceso a la información, conexiones sociales, oportunidades económicas. La crítica a veces suena como nostalgia por la era predigital, que no era menos problemática: acceso limitado al conocimiento, aislamiento social, monopolios mediáticos. El equilibrio entre la crítica y el reconocimiento de los beneficios es una tarea compleja que el artículo puede no resolver.

FAQ

Preguntas Frecuentes