Qué es la «radicalización algorítmica» y por qué este término se ha convertido en un arma en las guerras de información

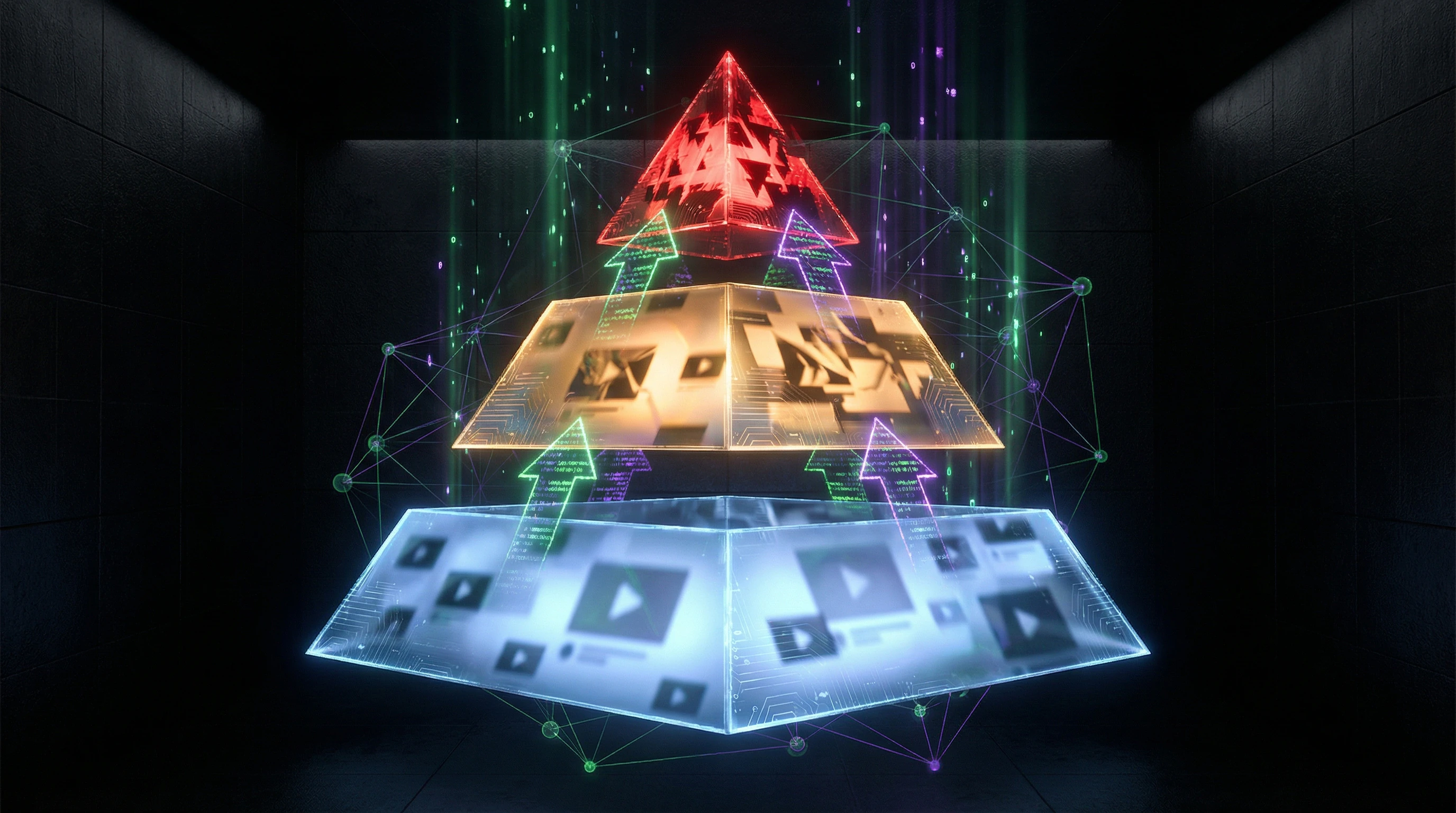

El término «radicalización algorítmica» describe un proceso hipotético mediante el cual los sistemas de recomendación de plataformas de vídeo dirigen sistemáticamente a los usuarios desde contenido moderado hacia contenido extremista a través de una cadena de recomendaciones progresivamente radicalizadoras. El concepto de «pipeline de radicalización» (radicalization pipeline) presupone la existencia de un camino predecible: el usuario comienza viendo contenido político mainstream, el algoritmo le recomienda material más provocador, luego contenido abiertamente extremista, y finalmente la persona queda atrapada en una burbuja informativa de ideas radicales (S010).

Esta narrativa se ha convertido en central en los debates sobre la economía de la atención y la responsabilidad de las plataformas. Pero tras la popularidad del concepto se esconde una crisis metodológica: la mayoría de estudios no distinguen entre correlación y causalidad, se apoyan en evidencias anecdóticas en lugar de datos cuantitativos e ignoran explicaciones alternativas.

Tres componentes de la narrativa del «pipeline»

- Jerarquía de contenido

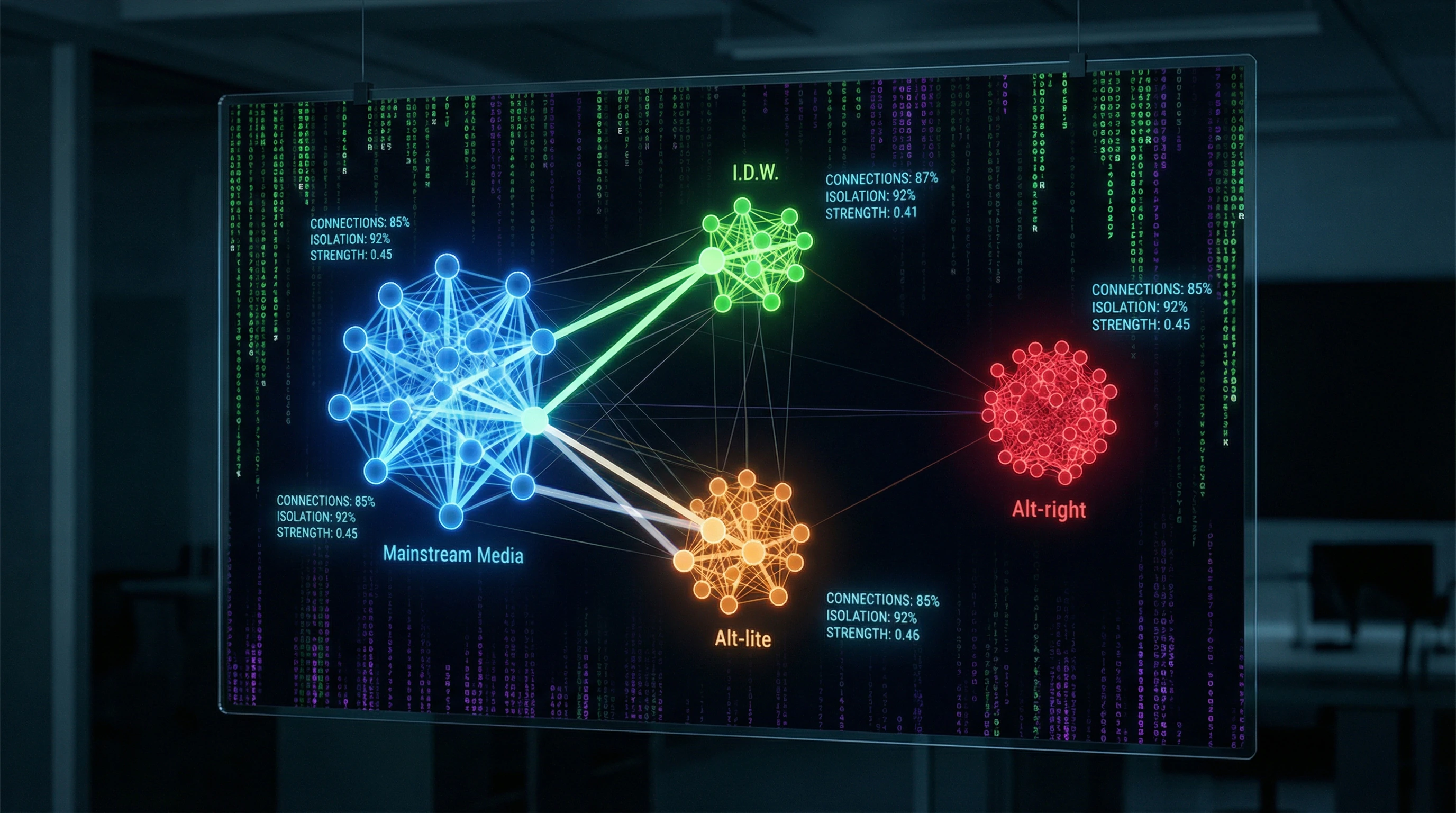

- Existe una escalera clara de lo moderado a lo extremista: Intellectual Dark Web (I.D.W.) — intelectuales que critican la agenda progresista; Alt-lite — populistas de derecha con retórica provocadora; Alt-right — defensores abiertos de la supremacía blanca y el antisemitismo (S010).

- Promoción activa de transiciones

- El algoritmo de YouTube recomienda contenido más radical a usuarios que ven contenido moderado, creando un flujo dirigido de una categoría a otra.

- Sistematicidad del proceso

- Este mecanismo no funciona aleatoriamente, sino que constituye el principal motor de la radicalización online en la plataforma.

La radicalización como concepto científico: más allá del determinismo tecnológico

La radicalización se define como «el proceso mediante el cual un individuo o grupo adopta creencias ideológicas extremistas y/o disposición a usar la violencia para alcanzar objetivos políticos» (S002). Distinción clave: la radicalización de opiniones no equivale a la radicalización de acciones.

Las investigaciones muestran que la radicalización es un proceso multifactorial que incluye predisposiciones personales, entorno social, contexto político y eventos desencadenantes (S005). Intentar reducir este fenómeno complejo a la acción mecánica de un algoritmo de recomendaciones simplifica el problema hasta el nivel del determinismo tecnológico.

La radicalización de opiniones no equivale a la radicalización de acciones. Ver contenido provocador no es lo mismo que adoptar una ideología extremista o estar dispuesto a la violencia.

La trampa metodológica: anécdotas en lugar de datos

La mayoría de publicaciones sobre el «pipeline de radicalización» en YouTube se basan en métodos cualitativos: análisis de casos individuales, entrevistas con ex extremistas, investigaciones periodísticas. Ejemplo típico: la historia de una persona que afirma que «YouTube le arrastró hacia la Alt-right mediante recomendaciones». Más detalles en la sección Fundamentos de epistemología.

Estas narrativas poseen un poderoso impacto emocional, pero no pueden servir como prueba de un efecto sistemático. El problema de representatividad permanece sin resolver: ¿cuántos usuarios recibieron las mismas recomendaciones pero no se radicalizaron? ¿Cuál es la frecuencia base de radicalización entre usuarios que no recibieron tales recomendaciones?

| Pregunta | Respuesta requerida | Estado en la literatura |

|---|---|---|

| ¿Qué proporción de usuarios recibió recomendaciones pero no se radicalizó? | Datos cuantitativos con grupo de control | Ausente |

| ¿Difiere la trayectoria de radicalización en usuarios con recomendaciones de quienes no las recibieron? | Análisis comparativo con control de variables | Raro |

| ¿Qué papel juegan las convicciones previas del usuario en la elección de contenido? | Análisis de sesgo de selección | Ignorado |

Sin grupo de control y datos cuantitativos es imposible separar correlación de causalidad. Esto no es pedantería metodológica: es el fundamento sobre el que se construye toda la lógica de la prueba (S010).

Versión de acero del argumento: siete razones más convincentes a favor de la existencia del pipeline algorítmico

Antes de analizar las pruebas contra la hipótesis del "pipeline de radicalización", es necesario presentar honestamente los argumentos más sólidos a su favor. La honestidad intelectual requiere construir una "versión de acero" (steelman) de la posición opuesta — no una caricatura, sino la formulación más convincente posible. Más información en la sección Epistemología.

🔥 Primer argumento: la lógica económica de maximización del engagement conduce inevitablemente a la radicalización

El modelo de negocio de YouTube se basa en maximizar el tiempo de visualización, lo que impacta directamente en los ingresos publicitarios. El algoritmo está optimizado para predecir qué vídeo mantendrá al usuario en la plataforma durante más tiempo.

El contenido emocionalmente cargado y provocador genera mayor engagement que el matizado y equilibrado. El contenido radical es un "superestímulo" para un sistema configurado para el engagement. Esto no es mala intención de los desarrolladores, sino una consecuencia inevitable de la función de optimización.

El incentivo estructural del algoritmo para recomendar material cada vez más provocador está integrado en la propia arquitectura de la plataforma, orientada a la economía de la atención.

📈 Segundo argumento: el crecimiento documentado de canales extremistas se correlaciona con cambios en el algoritmo de recomendaciones

Los investigadores registran un crecimiento explosivo de la audiencia de canales populistas de derecha y extremistas en YouTube durante el período 2015-2018 (S002, S003). Este crecimiento coincide con cambios en el algoritmo de recomendaciones que YouTube implementó para aumentar el tiempo de visualización.

Los canales Alt-lite y Alt-right reportaron un aumento drástico de suscriptores y visualizaciones precisamente a través de recomendaciones, no mediante búsquedas o enlaces externos. La correlación temporal entre cambios algorítmicos y crecimiento de contenido extremista sugiere una relación causal.

🎯 Tercer argumento: testimonios de ex-extremistas sobre el papel de YouTube en su radicalización

Numerosas personas que han pasado por procesos de desradicalización describen YouTube como factor clave en su desplazamiento ideológico (S004). Relatan detalladamente cómo comenzaron viendo vídeos sobre feminismo o inmigración, recibieron recomendaciones de críticos más radicales de estos fenómenos, y luego contenido abiertamente racista.

Estos testimonios son consistentes entre sí y describen un patrón recurrente. Rechazarlos como "anecdóticos" significa ignorar la experiencia vivida de personas que se enfrentaron directamente al fenómeno.

- Inicio: vídeos sobre fenómenos sociales (contenido neutral)

- Recomendaciones: crítica con perspectiva más aguda

- Profundización: contenido abiertamente ideologizado

- Resultado: transición a comunidades extremistas

🧬 Cuarto argumento: los mecanismos psicológicos de personalización amplifican el efecto de cámara de eco

El algoritmo de personalización crea un feed de recomendaciones único para cada usuario basado en su historial de visualización. Si un usuario comienza a ver contenido de determinada orientación ideológica, el algoritmo lo interpreta como preferencia y recomienda más contenido similar.

Esto crea un efecto de cámara de eco: el usuario se encuentra cada vez menos con puntos de vista alternativos y se sumerge más profundamente en una burbuja ideológica. La personalización convierte un interés casual en un bucle de retroalimentación autorrefor zante.

🌐 Quinto argumento: datos multiplataforma muestran que YouTube es la principal fuente de tráfico hacia sitios extremistas

El análisis del tráfico de referencia hacia sitios web y foros extremistas muestra que YouTube es una de las mayores fuentes de nuevos visitantes (S005). Los usuarios pasan de YouTube a plataformas como 4chan, 8chan, Gab, donde la radicalización continúa de forma más intensa.

YouTube funciona como un "embudo" — atrae a una audiencia amplia con contenido moderado, luego dirige a los usuarios más receptivos hacia el ecosistema de plataformas extremistas. Sin YouTube, muchos de estos usuarios nunca habrían descubierto la existencia de comunidades radicales.

🛠️ Sexto argumento: documentos internos de YouTube confirman que la empresa conocía el problema

Investigaciones periodísticas y filtraciones de documentos internos muestran que empleados de YouTube advirtieron repetidamente a la dirección de que el algoritmo de recomendaciones promovía contenido extremista (S008). Los ingenieros propusieron cambios que reducirían este efecto, pero la dirección los rechazó por temor a que disminuyera el engagement y los ingresos.

Esto evidencia que el problema es real y fue reconocido dentro de la empresa, pero los intereses económicos prevalecieron sobre las consideraciones éticas.

⚖️ Séptimo argumento: tiradores masivos y terroristas citaron YouTube como fuente de radicalización

En manifiestos y declaraciones de varios asesinos en masa de los últimos años se menciona YouTube como plataforma donde conocieron la ideología de supremacía blanca o antisemitismo (S006). El tirador de Christchurch, el terrorista de Pittsburgh y otros criminales describieron su camino de radicalización comenzando con la visualización de vídeos en YouTube.

Cuando la violencia extremista se vincula directamente con la plataforma, esto exige tomar en serio la hipótesis de radicalización algorítmica, independientemente de los datos estadísticos. La conexión entre tecnología y daño real se vuelve innegable.

Auditoría cuantitativa: qué reveló el mayor estudio de 2 millones de recomendaciones de YouTube

En 2019, investigadores de la Escuela Politécnica Federal de Lausana realizaron el primer estudio cuantitativo a gran escala de la hipótesis del "pipeline de radicalización" en YouTube. El trabajo, publicado en la conferencia ACM FAT* (Fairness, Accountability, and Transparency), analizó más de 2 millones de recomendaciones de vídeos y canales, recopiladas entre mayo y julio de 2019 (S003).

Este estudio marcó un punto de inflexión en el debate, ya que por primera vez proporcionó datos empíricos a gran escala en lugar de evidencia anecdótica. Más información en la sección Falacias lógicas.

Metodología: cómo los investigadores mapearon el ecosistema del contenido político

Los investigadores crearon un conjunto de datos de 792 canales, divididos en cuatro categorías: Media (canales de noticias mainstream); Intellectual Dark Web — intelectuales que critican la ideología progresista; Alt-lite (populistas de derecha con retórica provocadora); Alt-right (defensores explícitos de la supremacía blanca) (S003).

Para cada canal se recopilaron recomendaciones de dos tipos: recomendaciones de vídeo (qué vídeos sugiere YouTube después de ver uno) y recomendaciones de canal (qué canales sugiere YouTube en la página del canal). Se analizó la probabilidad de transición entre categorías a través de las recomendaciones.

Resultado clave: ausencia de evidencia sustancial de un pipeline sistemático

La conclusión principal del estudio: en 2019 no existía evidencia cuantitativa sustancial del supuesto pipeline (S003). El análisis mostró que las recomendaciones de vídeo de YouTube rara vez dirigen a los usuarios desde contenido moderado hacia contenido extremista.

El contenido Alt-right prácticamente no aparece en las recomendaciones de vídeo incluso para usuarios que ven Alt-lite o Intellectual Dark Web. Esto significa que el algoritmo no crea una ruta automática desde contenido moderado hacia contenido extremista.

Los investigadores descubrieron que el contenido Alt-lite es accesible desde canales Intellectual Dark Web a través de recomendaciones, pero los vídeos Alt-right solo son accesibles mediante recomendaciones de canal, no a través de recomendaciones de vídeos específicos (S003).

Matiz: diferencia entre recomendaciones de vídeo y recomendaciones de canal

El estudio reveló una diferencia crítica entre dos tipos de recomendaciones:

| Tipo de recomendación | Visibilidad para el usuario | Conexión entre categorías | Acción requerida |

|---|---|---|---|

| Recomendaciones de vídeo | Panel lateral, final del vídeo (alta) | Débil | Visualización pasiva |

| Recomendaciones de canal | Página del canal (baja) | Fuerte entre I.D.W., Alt-lite, Alt-right | Transición activa a la página del canal |

Las recomendaciones de canal requieren una acción deliberada del usuario: acceder a la página del canal y consultar la sección de recomendaciones. No es un "pipeline" pasivo, sino el resultado de una búsqueda activa de contenido similar.

Dinámica temporal: cambios en el algoritmo tras la presión pública

El estudio se realizó en 2019, después de que YouTube introdujera cambios en su algoritmo de recomendaciones en respuesta a las críticas. En enero de 2019, YouTube anunció medidas para reducir las recomendaciones de "contenido limítrofe" — material que no viola las normas de la plataforma, pero se encuentra en el límite.

Esto significa que el estudio captura el estado del algoritmo después de los ajustes, no durante el período 2015–2018, cuando supuestamente el "pipeline" funcionaba más activamente. Los críticos del estudio señalan esto como una limitación: es posible que el pipeline existiera anteriormente, pero fue eliminado para cuando se realizó el estudio.

La relación entre la economía de la atención y el diseño de plataformas muestra que los cambios algorítmicos suelen seguir a la presión pública, no precederla. Esto crea un problema metodológico: los estudios realizados después de los ajustes no pueden confirmar ni refutar completamente las hipótesis sobre el comportamiento del algoritmo en el pasado.

Mecanismo o mito: por qué la correlación entre visualización y radicalización no demuestra causalidad

Incluso si los estudios demostraran que los usuarios que ven contenido extremista en YouTube realmente se radicalizan, esto no probaría que el algoritmo de recomendaciones sea la causa de la radicalización. Más información en la sección Sesgos cognitivos.

Problema fundamental: correlación no implica causalidad. Observar una relación entre dos fenómenos no indica nada sobre la dirección de la influencia ni sobre la existencia de terceros factores.

🔁 Problema de causalidad inversa: la radicalización precede a la visualización, no la sigue

Las personas que ya tienen opiniones radicales o predisposición hacia ellas buscan activamente contenido correspondiente en YouTube. El algoritmo no las empuja hacia el extremismo — simplemente satisface de manera eficiente una demanda existente.

Los estudios sobre radicalización muestran que el proceso generalmente comienza con experiencias personales, entorno social o eventos políticos, no con el consumo de medios (S002, S005). El contenido online puede amplificar y legitimar opiniones ya existentes, pero rara vez las crea desde cero.

- El usuario experimenta una crisis personal (económica, social, de identidad)

- Se forma una predisposición hacia ciertas explicaciones y comunidades

- Búsqueda activa de contenido que corresponda a esta predisposición

- El algoritmo recomienda material relevante (porque el usuario lo busca)

- El observador ve la correlación y erróneamente la atribuye al algoritmo

🧬 Variables de confusión: terceras variables que explican tanto la visualización como la radicalización

Múltiples factores influyen simultáneamente en la elección de contenido y en la radicalización: autoritarismo, necesidad de cierre cognitivo, aislamiento social, inestabilidad económica, polarización política en la sociedad.

| Variable de confusión | Influencia en visualización de contenido | Influencia en radicalización |

|---|---|---|

| Crisis económica | Búsqueda de explicaciones en conspiraciones | Amenaza al estatus, búsqueda de enemigos |

| Aislamiento social | Comunidades online como sustituto | Vulnerabilidad a la influencia grupal |

| Rasgos autoritarios de personalidad | Preferencia por jerarquías claras y enemigos | Receptividad a narrativas autoritarias |

Sin controlar estas variables de confusión es imposible aislar el efecto del algoritmo. Una persona que atraviesa una crisis económica puede simultáneamente buscar explicaciones en teorías conspirativas y ver contenido correspondiente. El algoritmo no creó su vulnerabilidad — simplemente proporcionó contenido que resuena con ansiedades ya existentes.

🎲 Problema de selección: quién se convierte en objeto de estudios sobre radicalización

La mayoría de estudios cualitativos sobre el papel de YouTube en la radicalización se basan en entrevistas con personas que ya han pasado por radicalización y desradicalización. Esto crea un sesgo sistemático de supervivencia.

- Sesgo de supervivencia en el contexto de radicalización

- Escuchamos las historias de quienes se radicalizaron, pero no escuchamos las historias de millones de usuarios que vieron contenido similar y no se radicalizaron. Quizás YouTube recomendó contenido extremista a millones de personas, pero solo se radicalizaron aquellos que ya tenían predisposición.

- Tasa base

- Sin saber cuántas personas recibieron recomendaciones pero no se radicalizaron, es imposible evaluar el efecto real del algoritmo. Si el 0,01% de quienes recibieron la recomendación se radicalizaron, no es lo mismo que si se hubiera radicalizado el 50%.

⚙️ Poder algorítmico y responsabilidad moral: aspecto filosófico de la causalidad

Los estudios filosóficos sobre el poder algorítmico plantean la cuestión de si siquiera es posible atribuir a los algoritmos un papel causal en los procesos sociales (S007). El algoritmo es una herramienta que implementa los objetivos de sus creadores y refleja las preferencias de los usuarios.

Atribuir al algoritmo la capacidad autónoma de "radicalizar" personas antropomorfiza la tecnología y redistribuye la responsabilidad. Los actores reales son: desarrolladores que eligieron la función de optimización; directivos que priorizaron el beneficio sobre la seguridad; usuarios que eligen ver determinado contenido. El discurso sobre la "radicalización algorítmica" puede servir como una forma conveniente de evitar cuestiones más complejas sobre las causas sociales del extremismo y sobre la economía de la atención que estimula la polarización independientemente del algoritmo.

Conflictos en la base de evidencia: dónde divergen los estudios y qué significa esto

La literatura científica sobre el papel de YouTube en la radicalización demuestra divergencias significativas en sus conclusiones. Estas divergencias no son casuales: reflejan diferencias fundamentales en metodología, marcos temporales y alcance geográfico. Más detalles en la sección Fuentes y evidencia.

🧪 Cualitativos versus cuantitativos: por qué la metodología determina las conclusiones

Los estudios cualitativos, basados en entrevistas y análisis de casos individuales, respaldan la hipótesis del "pipeline de radicalización" (S002). Los estudios cuantitativos, que analizan grandes conjuntos de datos sobre recomendaciones, no encuentran evidencia sustancial de un efecto sistemático (S001, S003).

Esta divergencia revela una trampa en la interpretación de datos: los métodos cualitativos identifican la existencia del fenómeno (sí, algunas personas se radicalizan a través de YouTube), pero no evalúan su prevalencia. Los métodos cuantitativos evalúan la frecuencia, pero pueden pasar por alto los matices de las trayectorias individuales.

Pregunta clave: ¿es la radicalización algorítmica un efecto sistemático que afecta a una proporción significativa de usuarios, o una excepción rara que recibe atención desproporcionada debido al dramatismo de casos individuales?

La conexión con la economía de la atención es directa: eventos raros pero extremos reciben mayor cobertura mediática, lo que crea la ilusión de su frecuencia.

📅 Factor temporal: cambios algorítmicos y evolución del problema

Estudios de diferentes períodos llegan a conclusiones distintas porque el propio objeto de estudio ha cambiado. Trabajos de 2015–2018 documentan un efecto de "pipeline" más fuerte que investigaciones de 2019–2020, tras la implementación por YouTube de medidas para reducir recomendaciones de contenido limítrofe (S007).

Esto crea un problema metodológico: no podemos simplemente promediar resultados de estudios de diferentes períodos, ya que describen versiones distintas del algoritmo. Es críticamente importante distinguir entre afirmaciones sobre cómo funcionaba el algoritmo en el pasado y afirmaciones sobre cómo funciona ahora.

| Período | Carácter de las conclusiones | Razón de las diferencias |

|---|---|---|

| 2015–2018 | Efecto fuerte de "pipeline" | Algoritmo optimizado para engagement, sin filtros de extremismo |

| 2019–2020 | Efecto débil o ausente | Implementadas medidas para reducir recomendaciones de contenido limítrofe |

| 2021–2024 | Requiere nuevos estudios | Cambios adicionales en el sistema de recomendaciones |

🌍 Limitaciones geográficas y lingüísticas: el problema de la generalización

La abrumadora mayoría de estudios se centra en contenido en inglés y usuarios de EE.UU. y Europa Occidental. Los patrones de recomendaciones pueden diferir sustancialmente en otros contextos lingüísticos y culturales.

Investigaciones sobre radicalización en Asia Central muestran que la propaganda online juega un papel, pero su efectividad depende fuertemente del contexto político y social local (S005). Generalizar conclusiones obtenidas con material en inglés a la audiencia global de YouTube es metodológicamente incorrecto.

- Contexto anglófono

- Alta competencia de contenido, sistema de moderación desarrollado, diversidad de plataformas alternativas. El algoritmo puede ser menos radicalizante simplemente porque la competencia por la atención es mayor.

- Contextos no anglófonos

- Menos moderación, menos plataformas alternativas, audiencias más homogéneas. Posiblemente, el "pipeline de radicalización" funciona de manera diferente o más efectiva.

- Conclusión

- Afirmaciones globales sobre YouTube requieren investigaciones que abarquen al menos 5–10 idiomas y contextos culturales. La base de evidencia actual no proporciona esto.

La conexión con la epistemología es evidente: no podemos hacer conclusiones universales a partir de datos locales sin indicar explícitamente los límites de aplicabilidad.

Anatomía cognitiva del mito: qué trampas mentales hacen tan convincente la narrativa del "pipeline"

¿Por qué la hipótesis del "conducto de radicalización" ha alcanzado tal difusión, a pesar de la ausencia de pruebas cuantitativas convincentes? La respuesta reside en los sesgos cognitivos que hacen esta narrativa psicológicamente irresistible. Más detalles en la sección Astrología.

El primer sesgo es la ilusión de causalidad. Cuando alguien observa que una persona vio vídeos sobre política y luego expresó opiniones radicales, el cerebro automáticamente conecta los eventos mediante una relación causa-efecto. Pero esto ignora terceras variables: creencias previas, entorno social, circunstancias vitales.

El algoritmo de YouTube se convierte en chivo expiatorio de fenómenos que existían mucho antes de su aparición. Es cognitivamente económico: en lugar de analizar una realidad social compleja, señalamos un único botón.

El segundo es el sesgo de confirmación. Investigadores y periodistas buscan ejemplos de radicalización a través de YouTube y los encuentran. Pero no cuentan los millones de personas que ven los mismos vídeos y permanecen moderadas. (S003) demostró precisamente esto: las recomendaciones no crean una ruta radical, la amplifican para quienes ya están predispuestos.

- Una persona con opiniones radicales busca contenido acorde a sus convicciones

- El algoritmo recomienda contenido similar (es su función)

- El observador ve una cadena de vídeos y concluye: el algoritmo radicalizó a la persona

- En realidad: el algoritmo reflejó una trayectoria ya existente

El tercero es el atractivo narrativo. La historia del "conducto" tiene una estructura clara: villano (algoritmo), víctima (usuario), salvación (regulación). Es un arquetipo que funciona en medios, política y ciencia. Las teorías conspirativas a menudo vencen a las aburridas conclusiones estadísticas precisamente porque cuentan una mejor historia.

El cuarto es el pánico moral. Cada nuevo medio de comunicación genera temor: la imprenta supuestamente corrompía a la juventud, la televisión supuestamente volvía pasivas a las personas, internet supuestamente destruía la sociedad. YouTube cayó en este ciclo. (S002) documenta cómo la narrativa mediática sobre el "rabbit hole" se formó antes de que aparecieran los datos.

- Efecto halo

- Si la fuente (investigador, periodista, organización) es autoridad en un área, sus afirmaciones en otra parecen más convincentes. Los científicos informáticos hablan de algoritmos — suena a hecho, aunque puede ser especulación.

- Disponibilidad de información

- Las historias dramáticas sobre radicalización son más fáciles de recordar que las estadísticas sobre el 99% de usuarios que no se radicalizaron. El cerebro usa la disponibilidad como proxy de frecuencia.

El quinto es el interés institucional. A los investigadores les resulta más fácil obtener financiación para un proyecto sobre "peligros de los algoritmos" que sobre "los algoritmos funcionan como se espera". A los periodistas les resulta más fácil escribir un artículo sobre una amenaza que sobre la ausencia de amenaza. A los políticos les resulta más fácil regular a un enemigo visible que resolver problemas sociales.

No es una conspiración — son incentivos estructurales. La economía de la atención premia el sensacionalismo. El sistema científico premia la novedad. La política premia las soluciones simples.

Resultado: la narrativa del "conducto" se vuelve autosostenible. Cada nuevo estudio, incluso si refuta la hipótesis, se interpreta como confirmación. (S007) utilizó bots contrafactuales y demostró que las recomendaciones de YouTube no causan radicalización. Pero la conclusión a menudo se reformula como "YouTube puede radicalizar si las condiciones son favorables" — lo cual ya no es falsable.

La inmunología cognitiva aquí requiere una cosa: distinguir entre "el algoritmo puede amplificar tendencias existentes" y "el algoritmo crea radicalización". Lo primero es probable. Lo segundo — no está probado. Y esta distinción importa para las políticas, la investigación y tu propio pensamiento.