Qué es la falacia de la caja negra y por qué no se reduce al simple desconocimiento del mecanismo de funcionamiento

La falacia de la caja negra (black box fallacy) es un sesgo cognitivo en el que una persona forma una valoración extrema de un sistema (confianza total o rechazo total) basándose exclusivamente en la opacidad de su funcionamiento interno, ignorando los datos empíricos sobre su eficacia, fiabilidad y contexto de aplicación. Más información en la sección Pensamiento crítico.

No es simplemente desconocimiento: es sustituir el análisis de resultados por el análisis de la accesibilidad de información sobre el proceso.

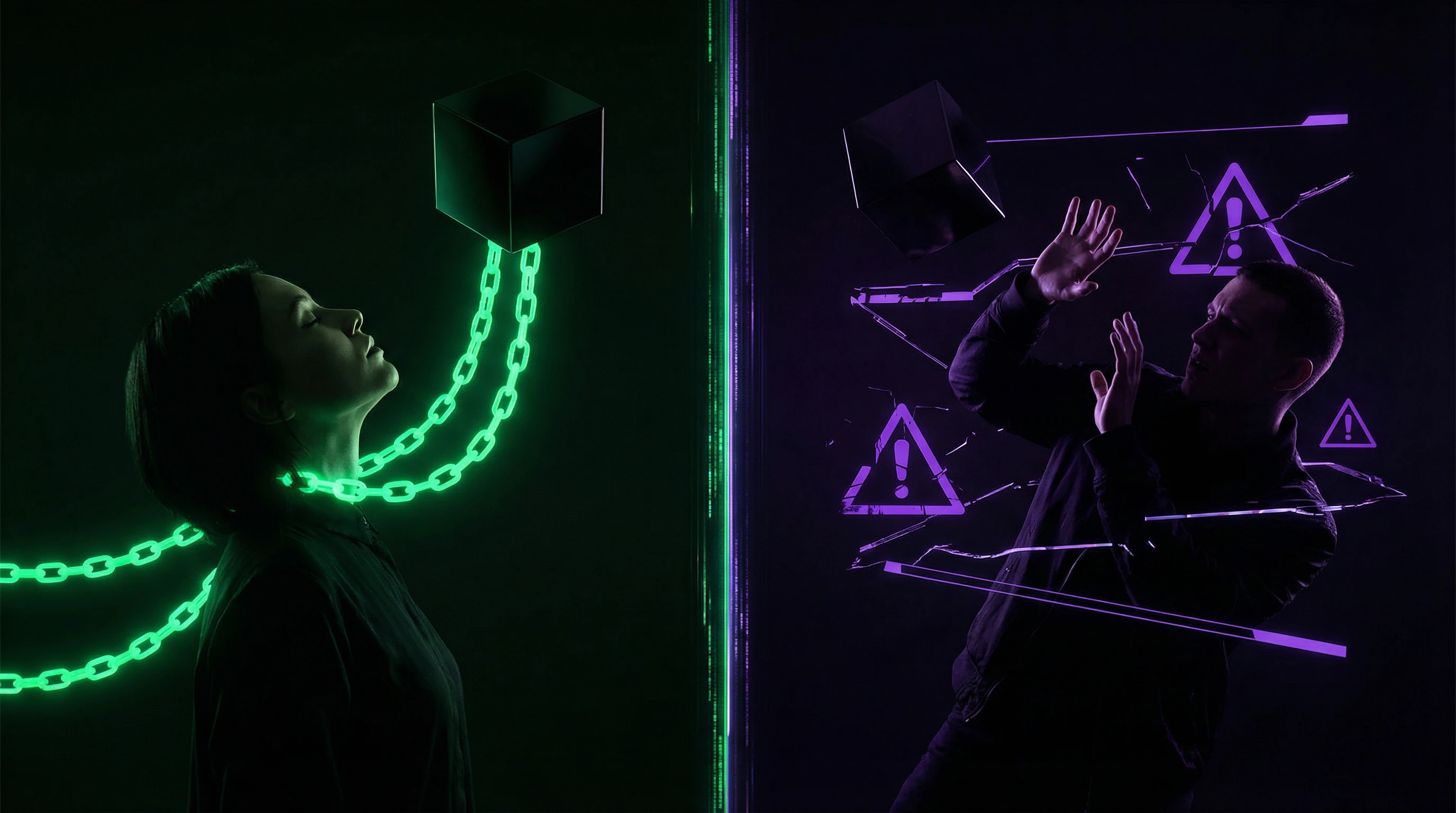

🧩 Dos polos de una misma falacia: confianza ciega y rechazo paranoico

La falacia se manifiesta en dos formas opuestas. La primera: confianza ciega en la autoridad de la opacidad: "Es un sistema complejo, no entiendo cómo funciona, por tanto debe ser correcto". La segunda: rechazo paranoico: "No veo qué hay dentro, por tanto es un engaño/peligro/manipulación".

Ambas formas comparten una sustitución: en lugar de evaluar la validez de los datos de salida, la reproducibilidad de los resultados y la adecuación del sistema a la tarea, la persona evalúa únicamente el grado de comprensión del mecanismo.

⚠️ Por qué no es lo mismo que la heurística de disponibilidad o el efecto halo

La falacia de la caja negra se diferencia de sesgos cognitivos relacionados. La heurística de disponibilidad opera con la facilidad de recuperar ejemplos de la memoria. El efecto halo transfiere la valoración de una cualidad a otras.

- Falacia de la caja negra

- se activa precisamente por la opacidad del proceso y conduce a ignorar los datos empíricos sobre los resultados. Una persona puede saber que el sistema falla en el 30% de los casos, pero seguir confiando en él porque "el algoritmo es complejo". O al contrario: el sistema demuestra un 95% de precisión, pero se rechaza porque "no se entiende cómo lo hace".

🔎 Límites de aplicabilidad del término: dónde existe la falacia y dónde no

No todo uso de un sistema opaco constituye una falacia. Si tomas aspirina sin conocer el mecanismo de inhibición de la ciclooxigenasa, pero te basas en metaanálisis de eficacia y perfil de seguridad, es una delegación racional en la experticia.

| Escenario | Base de la decisión | ¿Es una falacia? |

|---|---|---|

| Médico prescribe fármaco solo porque "es un desarrollo nuevo, mecanismo complejo" | Opacidad del proceso | Sí — ignora ausencia de ECA |

| Paciente rechaza vacuna con eficacia demostrada | "No entiendo qué hay dentro" | Sí — desplaza análisis de evidencia |

| Paciente toma fármaco basándose en metaanálisis, sin conocer el mecanismo | Datos empíricos sobre resultados | No — delegación racional |

La falacia surge cuando la opacidad se convierte en el criterio único o principal de evaluación, desplazando el análisis de la evidencia.

Cinco argumentos más sólidos de que la opacidad de los sistemas realmente crea un problema de confianza

Las preocupaciones sobre los sistemas opacos no son infundadas. Existen riesgos reales asociados con delegar decisiones a sistemas cuyo funcionamiento interno no está disponible para verificación. Más información en la sección Estadística y teoría de probabilidades.

🧪 Argumento 1: Imposibilidad de auditoría y reproducibilidad de resultados en áreas críticas

Cuando un sistema toma decisiones que afectan la vida y la salud (diagnóstico médico, algoritmos judiciales de evaluación de riesgos, sistemas de gestión de infraestructura crítica), la imposibilidad de auditar su lógica crea un problema real de responsabilidad.

Si un algoritmo recomienda denegar la libertad condicional o prescribe quimioterapia, pero nadie puede explicar en base a qué características se tomó la decisión, resulta imposible identificar un error sistemático o sesgo antes de que cause daño.

🔬 Argumento 2: La historia de la medicina está llena de ejemplos de métodos "efectivos" que resultaron perjudiciales

La sangría "funcionó" durante siglos — los pacientes a veces se recuperaban, los médicos observaban correlación. La lobotomía recibió el Premio Nobel. La talidomida pasó ensayos clínicos.

La opacidad del mecanismo combinada con un efecto observable no garantiza seguridad. La exigencia de comprender el mecanismo es una lección de la historia: la correlación sin comprensión de la causalidad puede enmascarar daños que se manifestarán más tarde o en otras condiciones.

📊 Argumento 3: Los sistemas algorítmicos pueden reproducir y amplificar sesgos ocultos

Los modelos opacos de aprendizaje automático, entrenados con datos históricos, codifican sesgos raciales, de género y socioeconómicos sin hacerlos explícitos.

- Un sistema de evaluación de riesgo crediticio puede discriminar por código postal

- Un sistema de reclutamiento — por nombre

- Un sistema de diagnóstico médico — por acceso a exámenes previos

Sin transparencia, estos sesgos son imposibles de detectar y corregir antes de escalar el sistema.

⚠️ Argumento 4: La asimetría de información crea espacio para la manipulación

Cuando el desarrollador del sistema conoce sus limitaciones pero el usuario no, surge el problema clásico de información asimétrica. El fabricante de una IA diagnóstica puede saber que el sistema solo funciona en ciertos grupos demográficos o tipos de imágenes, pero venderlo como una solución universal.

Sin transparencia en la metodología, datos de entrenamiento y validación, el usuario no puede evaluar la aplicabilidad real del sistema a su contexto. Esto es especialmente peligroso en la tecno-esotérica, donde la opacidad a menudo sirve como marcador de supuesto "avance".

🧠 Argumento 5: Delegar decisiones a sistemas opacos atrofia la experiencia

Si los médicos comienzan a confiar en las recomendaciones de un sistema de apoyo a la toma de decisiones sin comprender su lógica, gradualmente pierden la capacidad de tomar decisiones de forma autónoma. Esto crea fragilidad: ante un fallo del sistema, su indisponibilidad o aplicación en una situación no estándar, el experto queda indefenso.

- La opacidad acelera la atrofia porque no deja posibilidad de aprendizaje mediante la comprensión de la lógica del sistema

- El experto pierde la capacidad de evaluar críticamente las recomendaciones

- La organización se vuelve dependiente de una caja negra en lugar de desarrollar competencia

Qué dicen las revisiones sistemáticas y metaanálisis sobre la eficacia real de los sistemas opacos en medicina y educación

Pasando de los argumentos a las evidencias, es necesario separar dos cuestiones: si los sistemas opacos funcionan (eficacia empírica) y si es posible hacerlos transparentes sin perder eficacia (viabilidad técnica). Los metaanálisis de los últimos años ofrecen respuestas sorprendentes a ambas.

📊 Los chatbots de IA demuestran mayor empatía que los médicos en estudios controlados

Una revisión sistemática que compara chatbots de IA y profesionales médicos en el contexto de la empatía en la atención al paciente reveló una paradoja: en condiciones controladas, los sistemas de IA mostraron niveles más altos de empatía percibida que los médicos humanos (S004). Esto no significa que la IA "sienta" — las respuestas estructuradas, consistentes y pausadas del algoritmo fueron percibidas por los pacientes como más atentas que las consultas apresuradas de especialistas sobrecargados.

La opacidad del mecanismo no impidió que el sistema superara al humano en un criterio medible de calidad de interacción.

🧪 Los sistemas de apoyo a la decisión clínica (CDSS) mejoran la precisión diagnóstica con la integración adecuada

El análisis de la eficacia de los CDSS muestra una mejora significativa en la precisión diagnóstica y reducción de errores médicos, pero solo cuando se integran correctamente en el proceso clínico y se capacita al personal (S010). El factor clave no es la transparencia del algoritmo, sino la transparencia del proceso de uso: el médico debe entender qué datos considera el sistema, qué limitaciones tiene, cómo integrar las recomendaciones en el razonamiento clínico.

La opacidad del algoritmo interno no fue un factor crítico para la eficacia.

🔎 La precisión diagnóstica de la IA en cribado supera al humano en tareas altamente especializadas

Un metaanálisis de la precisión diagnóstica de la IA para el cribado de condiciones específicas demuestra que en tareas altamente especializadas (detección de retinopatía diabética, identificación de signos tempranos de cáncer de pulmón en TC) los sistemas de IA alcanzan sensibilidad y especificidad comparables o superiores a las de especialistas experimentados (S011). Críticamente importante: estos resultados se obtuvieron en condiciones donde los médicos no comprendían la lógica interna del algoritmo, pero podían evaluar sus datos de salida e integrarlos en el proceso diagnóstico.

- El sistema trabaja en una tarea estrecha y bien definida

- Los datos de salida están validados en cohortes independientes

- El médico puede evaluar el resultado en el contexto del cuadro clínico

- El mecanismo permanece opaco, pero esto no reduce su utilidad

🧬 Análisis cognitivo de tareas (CTA) en cirugía: revelar la caja negra del pensamiento experto mejora el aprendizaje

Una revisión sistemática del impacto del análisis cognitivo de tareas en la educación quirúrgica muestra el lado opuesto del problema: cuando la "caja negra" del pensamiento experto del cirujano se revela mediante un análisis estructurado de los procesos cognitivos de toma de decisiones, la eficacia del aprendizaje aumenta significativamente (S005). El metaanálisis de 12 estudios identificó un tamaño de efecto grande a favor del entrenamiento con CTA en comparación con métodos tradicionales.

Esto demuestra que la transparencia del proceso de pensamiento del experto es críticamente importante para la transferencia de experiencia, incluso si el propio experto no puede verbalizar todas sus decisiones sin un análisis estructurado. Más detalles en la sección Debunking y prebunking.

⚙️ Papel pronóstico de la RM: cuando la opacidad del proceso biológico no impide la utilidad clínica

Los estudios sobre el papel pronóstico de la resonancia magnética muestran que los biomarcadores de RM pueden predecir resultados de enfermedades con alta precisión, incluso cuando el mecanismo biológico exacto de la relación entre el signo visualizado y el resultado permanece poco claro (S012). Los médicos utilizan estos modelos pronósticos sin comprender completamente la fisiopatología, pero basándose en correlaciones validadas.

Este es un uso racional de la opacidad: el mecanismo no está claro, pero la reproducibilidad, validación en cohortes independientes y utilidad clínica están demostradas.

Mecanismo del error: cómo la opacidad explota heurísticas evolutivas y crea la ilusión de comprensión

El error de la caja negra no surge en el vacío: explota varias características fundamentales de la cognición humana, formadas por la evolución para resolver problemas en condiciones de información y tiempo limitados. Más detalles en la sección Verificación de la Realidad.

🧩 Heurística «complejidad = competencia» y sus raíces evolutivas

En el entorno social de nuestros ancestros, la complejidad de una explicación a menudo correlacionaba con la experiencia: un chamán capaz de dar una explicación compleja de una enfermedad probablemente poseía mayor experiencia que quien daba una simple. Esta heurística funcionaba porque la complejidad era una señal costosa: difícil de falsificar sin conocimiento real.

Pero en el mundo moderno la complejidad es fácil de imitar: jerga pseudocientífica, diagramas complejos, algoritmos de múltiples pasos pueden crear la apariencia de experiencia sin su contenido. La opacidad del sistema activa esta heurística: «No lo entiendo, por tanto es complejo, por tanto los creadores son competentes».

La complejidad dejó de ser señal de competencia: se convirtió en herramienta de manipulación. La opacidad permite hacer pasar la imitación por realidad.

🔁 Ilusión de profundidad explicativa y sobrevaloración de la propia comprensión

Las personas sistemáticamente sobrestiman la profundidad de su comprensión de los mecanismos causales. Cuando alguien puede nombrar un sistema («es una red neuronal», «es un ordenador cuántico», «es blockchain»), a menudo cree erróneamente que entiende cómo funciona.

La opacidad del sistema paradójicamente refuerza esta ilusión: la ausencia de detalles permite llenar los vacíos con modelos mentales simplificados que parecen suficientes. La persona no es consciente de los límites de su desconocimiento porque el sistema no proporciona información que pudiera exponer esos límites.

- Nombró el sistema: sintió comprensión

- La opacidad oculta los vacíos en esa comprensión

- La ausencia de datos contradictorios refuerza la ilusión

- El pensamiento crítico se desactiva

⚠️ Asimetría de confianza: por qué es más fácil creer en la magia que verificar estadísticas

Verificar datos empíricos sobre la eficacia del sistema requiere esfuerzo cognitivo: hay que encontrar estudios, evaluar su metodología, entender estadísticas, considerar el contexto. Aceptar por fe o rechazar basándose en la opacidad requiere cero esfuerzo.

Evolutivamente estamos configurados para minimizar el gasto cognitivo. La opacidad crea asimetría: el camino de menor resistencia es la valoración extrema (confianza total o rechazo total), no el análisis laborioso de evidencias.

| Escenario | Coste cognitivo | Resultado |

|---|---|---|

| Verificar estudios sobre eficacia | Alto | Juicio fundamentado |

| Creer en la opacidad como señal de calidad | Nulo | Ilusión de comprensión |

| Rechazar el sistema como «caja negra» | Nulo | Escepticismo infundado |

🧬 Factor de confusión contextual: cuando la opacidad correlaciona con novedad y complejidad de la tarea

Los sistemas opacos a menudo se aplican en áreas nuevas y complejas donde aún no existen estándares de evaluación establecidos. Esto crea un factor de confusión: los malos resultados pueden ser consecuencia no de la opacidad, sino de la inmadurez de la tecnología o de su aplicación incorrecta.

Los buenos resultados pueden ser consecuencia no de la calidad del sistema, sino de una cuidadosa selección de tareas donde funciona. Sin controlar este factor de confusión es imposible separar el efecto de la opacidad del efecto de la novedad. Esto es especialmente crítico en áreas donde el misticismo tecnológico ya ha creado terreno fértil para la sobrevaloración de capacidades.

Dónde la evidencia es sólida y dónde persisten las lagunas: análisis honesto de las limitaciones de los datos actuales

El análisis crítico requiere reconocer no solo lo que sabemos, sino también lo que no sabemos. Las revisiones sistemáticas y metaanálisis tienen sus propias limitaciones que deben considerarse al interpretar los resultados. Más información en la sección Lógica y probabilidad.

📊 Sesgo de publicación: solo se ven los éxitos

Los estudios que demuestran alta eficacia de sistemas de IA se publican con mayor frecuencia que aquellos con resultados nulos o negativos. Esto crea un sesgo sistemático en los metaanálisis: las estimaciones de eficacia pueden estar infladas entre un 20-40% dependiendo del área.

El problema se agrava porque muchos sistemas de IA son desarrollados por empresas comerciales que controlan el acceso a los datos y pueden publicar resultados selectivamente. Sin acceso a los protocolos de estudios no publicados, es imposible evaluar la verdadera magnitud de este sesgo.

Si solo se ven los éxitos, el mapa de eficacia se convierte en un mapa de marketing, no de realidad.

🔬 Heterogeneidad: diferentes estudios hablan diferentes idiomas

Diferentes estudios utilizan diferentes métricas de eficacia, diferentes poblaciones, diferentes condiciones de aplicación (S001, S003, S007). Esto dificulta la comparación directa y la generalización de resultados.

Para los sistemas de IA el problema es especialmente agudo: no hay consenso sobre cómo evaluar la "explicabilidad" o "transparencia", no existen benchmarks estándar para comparar sistemas en condiciones clínicas reales. Un investigador puede considerar un sistema "explicable" si proporciona coeficientes; otro exigirá un trazado completo de la lógica de decisión.

- Métrica A: precisión en conjunto de prueba

- Métrica B: sensibilidad y especificidad

- Métrica C: tiempo de toma de decisión

- Métrica D: concordancia con opinión experta

- Métrica E: satisfacción del usuario

Cada métrica responde a una pregunta diferente. Sin estandarización es imposible determinar qué sistema es mejor.

⚠️ Brecha entre laboratorio y clínica

La mayoría de estudios se realizan en condiciones controladas: datasets cuidadosamente seleccionados, protocolos estandarizados, ausencia de presión temporal. La práctica clínica real difiere radicalmente: datos incompletos, casos no estándar, necesidad de decisiones rápidas, integración con flujos de trabajo existentes.

La eficacia demostrada en un estudio puede no reproducirse en condiciones reales. Los datos sistemáticos sobre resultados a largo plazo de la implementación de sistemas de IA en la práctica rutinaria son aún insuficientes. Esto no significa que los sistemas sean ineficaces — significa que no sabemos qué tan bien funcionan donde realmente se utilizan.

| Parámetro | Estudio controlado | Práctica real |

|---|---|---|

| Calidad de datos | Alta, estandarizada | Incompleta, variable |

| Presión temporal | Ausente | Alta |

| Integración con flujo de trabajo | Ideal | Frecuentemente conflictiva |

| Selección de casos | Representativa | Sesgada (casos graves) |

🧪 Atrofia de la experticia: teoría sin datos

El argumento sobre la atrofia de la experticia al delegar decisiones en sistemas opacos está teóricamente fundamentado, pero empíricamente poco confirmado. No existen estudios a largo plazo que rastreen cambios en las habilidades cognitivas de médicos que utilizan sistemas de apoyo a la decisión, comparados con un grupo control.

No hay datos sobre cómo cambia la capacidad de tomar decisiones en situaciones no estándar tras años de uso de asistentes de IA. Esta es una laguna crítica: si la atrofia es real, sus efectos pueden manifestarse años después, cuando retroceder sea imposible. Solo podemos especular, apoyándonos en sesgos cognitivos y psicología evolutiva.

Conocemos el mecanismo, pero no la magnitud. Esto es más peligroso que no saber nada.

Fortalezas de la base de evidencia: la eficacia de sistemas de IA en tareas específicas y bien definidas (diagnóstico por imágenes, cribado) está confirmada por múltiples estudios. Debilidades: efectos a largo plazo, impacto en habilidades cognitivas, eficacia clínica real, mecanismos de error al delegar decisiones — todo esto permanece en la sombra.

Anatomía cognitiva del error: qué sesgos se explotan exactamente y cómo interactúan

El error de la caja negra no es un sesgo aislado, sino un nodo en una red de vulnerabilidades cognitivas interconectadas. Comprender esta red es necesario para desarrollar contramedidas efectivas. Más información en la sección Errores y sesgos de la IA.

🧩 Efecto halo tecnológico: transferencia de prestigio al sistema concreto

Si los sistemas de IA en general se asocian con progreso e innovación, esta valoración positiva se transfiere al sistema concreto sin analizar sus características individuales. "Es IA" se convierte en fundamento suficiente para confiar.

La opacidad refuerza el efecto: la ausencia de detalles impide descubrir que el sistema concreto puede estar mal diseñado, insuficientemente validado o aplicado incorrectamente. Esto es especialmente peligroso en el contexto del tecno-esoterismo, donde el lenguaje tecnológico se convierte en fuente de autoridad por sí mismo.

⚠️ Error de atribución de agencia: atribuir intenciones y comprensión al sistema

Las personas tienden a atribuir agencia (intenciones, objetivos, comprensión) a sistemas que demuestran comportamiento complejo. Cuando un chatbot de IA da una respuesta empática, es fácil olvidar que es resultado de optimización estadística, no de comprensión emocional.

La opacidad refuerza esta ilusión: si no vemos el mecanismo, es más fácil imaginar que hay "comprensión" dentro. Esto lleva a sobrevalorar la fiabilidad del sistema: confiamos en él como confiaríamos en un experto que comprende, aunque el sistema no posee la flexibilidad ni la comprensión contextual humana.

🔁 Bucle de confirmación: cómo el uso del sistema refuerza la confianza en él

Cada aplicación exitosa del sistema (incluso una coincidencia casual) se interpreta como confirmación de su competencia. Los fallos se reatribuyen: error del usuario, contexto incorrecto, consulta insuficientemente precisa — todo excepto el sistema mismo.

- El usuario aplica el sistema y obtiene un resultado

- El resultado se interpreta como éxito (incluso si es coincidencia)

- La confianza en el sistema crece

- El usuario aplica el sistema en situaciones más complejas

- Los fallos se explican por factores externos, no por limitaciones del sistema

- El ciclo se repite, la confianza se consolida

La opacidad bloquea la salida de este ciclo: no hay forma de verificar si el sistema realmente funciona mejor que el azar, o si es la heurística de disponibilidad — recordamos los éxitos y olvidamos los fallos.

🎯 Interacción de sesgos: sinergia de vulnerabilidades

Estos tres mecanismos no actúan independientemente. El efecto halo crea la confianza inicial, el error de atribución de agencia hace que el sistema sea psicológicamente "vivo" y responsable, y el bucle de confirmación consolida ambos efectos.

Añade la ignorancia de la tasa base — el usuario no sabe con qué frecuencia el sistema se equivoca en general — y obtienes la tormenta perfecta: el sistema se percibe como competente, comprensivo y fiable, aunque en realidad es simplemente una caja negra que a veces produce resultados útiles.

La opacidad no es simplemente ausencia de información. Es un catalizador activo que transforma procesos cognitivos normales en errores sistemáticos de juicio.