Teoría del internet muerto: de una publicación anónima al pánico masivo — qué se afirma exactamente y por qué importa

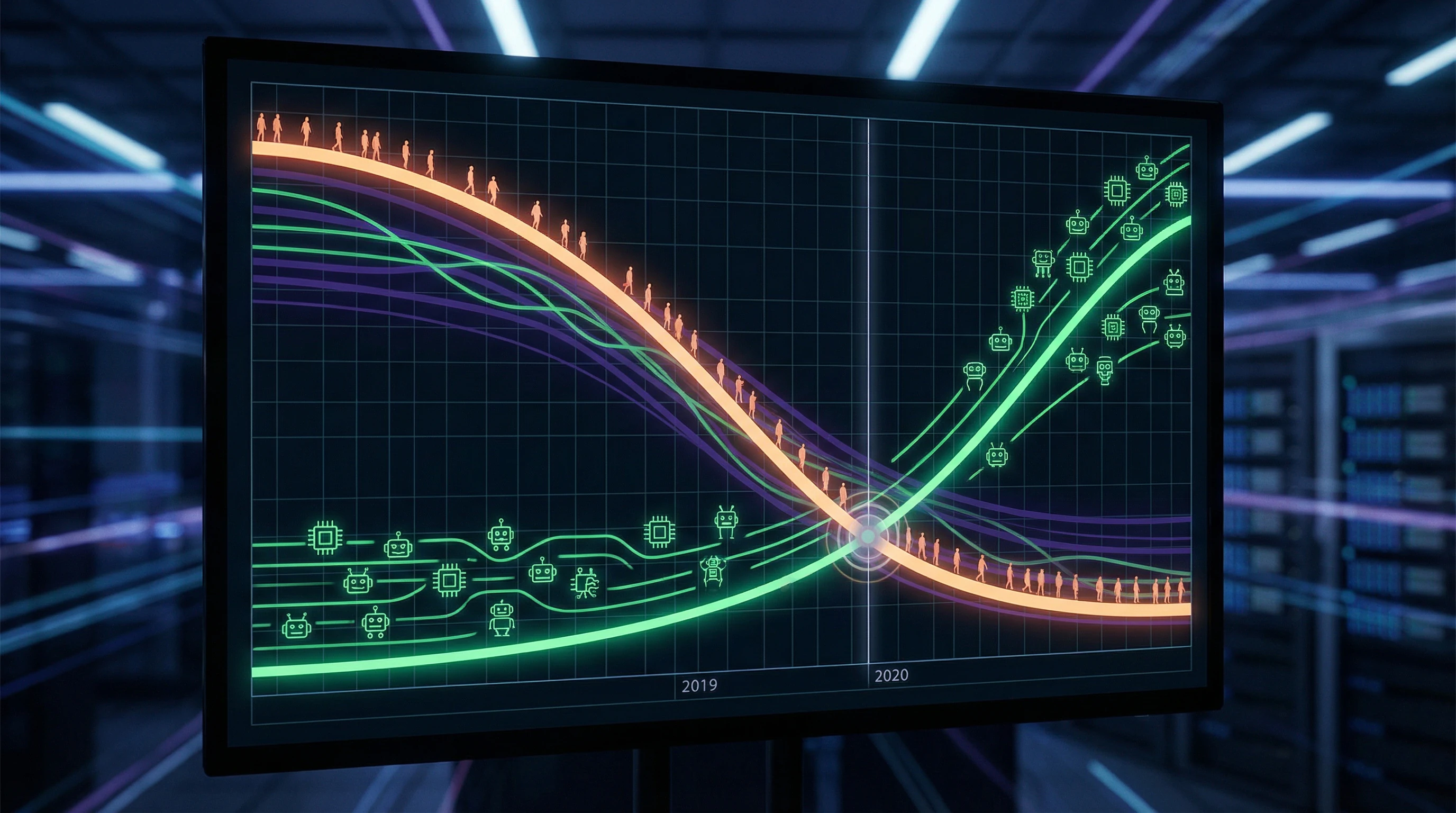

La Teoría del Internet Muerto (Dead Internet Theory) es una hipótesis conspirativa que sostiene que una parte significativa de la actividad online, el contenido y las interacciones no son generadas por personas reales, sino por bots, algoritmos e inteligencia artificial. Según esta teoría, internet "murió" aproximadamente en 2016–2017, cuando los sistemas automatizados alcanzaron una masa crítica y comenzaron a dominar sobre la presencia humana. Más información en la sección Errores Mentales.

Los defensores de la teoría afirman que corporaciones y gobiernos mantienen intencionadamente la ilusión de un internet vivo para manipular la opinión pública, vender publicidad y controlar el espacio informativo.

Internet no solo cambió — supuestamente dejó de ser un espacio de comunicación humana y se convirtió en un teatro de sombras, donde las personas interactúan con simulaciones.

⚠️ Afirmaciones clave de la teoría: qué se considera exactamente "muerto"

La teoría se basa en cuatro afirmaciones interrelacionadas. La mayoría de comentarios en redes sociales supuestamente son escritos por bots, no por usuarios reales. Una proporción significativa del contenido — artículos, vídeos, publicaciones — es generada por algoritmos para crear apariencia de actividad.

- Tendencias y fenómenos virales

- Supuestamente son creados y mantenidos artificialmente por sistemas automatizados, en lugar de surgir orgánicamente de los intereses humanos.

- Proporción de actividad

- Las personas reales constituyen una minoría de la actividad online, sus interacciones se ahogan en un mar de ruido sintético.

🧩 Contexto histórico: cómo una publicación anónima se convirtió en fenómeno cultural

La primera exposición sistemática de la teoría apareció en el foro Agora Road's Macintosh Cafe en 2021, aunque elementos aislados circulaban en imageboards desde 2016. La publicación describía internet como un "espacio muerto", donde los algoritmos imitan la actividad humana de forma tan convincente que la mayoría de usuarios no perciben la sustitución.

La teoría se propagó rápidamente en Reddit, Twitter y YouTube, donde resonó entre personas que experimentaban "fatiga digital" y sensación de irrealidad en las interacciones online. Para 2023, tras el lanzamiento de ChatGPT y el crecimiento explosivo de la IA generativa, la teoría cobró nuevo impulso — ya no como conspiración, sino como descripción de la realidad observable.

| Período | Estatus de la teoría | Detonante de difusión |

|---|---|---|

| 2016–2020 | Hipótesis marginal en imageboards | Crecimiento de bots en redes sociales |

| 2021 | Conspiración sistematizada | Publicación en Macintosh Cafe |

| 2023–2024 | Observación cuasicientífica | Crecimiento explosivo de IA generativa |

🔎 Límites del análisis: qué verificamos y qué no verificamos

En este artículo nos centramos en las afirmaciones verificables de la teoría: la proporción de contenido automatizado, estadísticas de bots, datos sobre medios sintéticos. No examinamos elementos conspiratorios sobre "conspiración global" o "asesinato intencional de internet" — estas afirmaciones no son empíricamente verificables.

Nuestra tarea es separar las tendencias observables de los sesgos cognitivos y mostrar dónde termina la estadística y comienza la interpretación paranoide. Esto no significa que la teoría sea completamente falsa — más bien, mezcla fenómenos reales con conclusiones erróneas sobre sus causas y magnitud.

La versión más sólida de la teoría: los siete argumentos más convincentes a favor del «internet muerto» — y por qué no pueden ignorarse

Antes de analizar la teoría, es necesario presentarla en su forma más sólida — el llamado «steelman argument». Este es un enfoque intelectualmente honesto: tomamos los mejores argumentos de los defensores de la teoría, los depuramos de emociones y conspiraciones, y verificamos hasta qué punto se corresponden con los datos. Más información en la sección Pensamiento crítico.

A continuación, las siete observaciones más convincentes que alimentan la teoría del internet muerto.

⚠️ Primer argumento: crecimiento exponencial de bots en redes sociales

Las estadísticas sobre bots en redes sociales son realmente preocupantes. Según diversas estimaciones, entre el 15% y el 60% de las cuentas en Twitter (antes del cambio de marca a X) eran automatizadas o semiautomatizadas.

Facebook elimina regularmente miles de millones de cuentas falsas cada trimestre — en 2022 la compañía bloqueó más de 1.600 millones de cuentas en tres meses. Instagram lucha contra bots que generan comentarios, likes y suscripciones.

Si las plataformas eliminan miles de millones de bots, ¿cuántos más quedan sin detectar? Estas cifras no son secretas — se publican en los informes de las propias plataformas.

🧩 Segundo argumento: el contenido sintético se ha vuelto indistinguible del humano

Con la aparición de GPT-3, GPT-4 y otros modelos de lenguaje grandes, la frontera entre texto humano y texto de máquina se ha difuminado. Las investigaciones muestran que las personas no pueden distinguir de forma fiable el texto escrito por IA del humano — la precisión de identificación ronda el 50%, lo que equivale a una adivinación aleatoria.

Los modelos generativos crean artículos, publicaciones en redes sociales, comentarios que pasan la moderación y se perciben como auténticos. Si no podemos distinguir el contenido sintético, ¿cómo podemos estar seguros de que nos comunicamos con personas?

🔁 Tercer argumento: aumento del contenido «vacío» y granjas de contenido

Internet está saturado de contenido de baja calidad, creado para SEO y monetización publicitaria. Las granjas de contenido generan miles de artículos al día, utilizando plantillas y automatización.

YouTube está lleno de vídeos generados automáticamente — recopilaciones, resubidas, locuciones robotizadas. TikTok e Instagram Reels muestran infinitas variaciones del mismo contenido, creado según plantillas algorítmicas.

- El contenido se crea por crear, no por significado

- La creatividad humana se convierte en una rara excepción

- Los algoritmos optimizan para viralidad, no para calidad

📊 Cuarto argumento: manipulación de tendencias y viralidad artificial

Están documentados casos en los que tendencias en redes sociales fueron creadas artificialmente mediante botnets y campañas coordinadas. Actores políticos utilizan sistemas automatizados para promover hashtags, desacreditar oponentes, crear la ilusión de apoyo masivo.

Las agencias de marketing venden «viralidad» como servicio, utilizando redes de bots para inflar visualizaciones, likes y compartidos. Si las tendencias pueden comprarse, ¿cómo podemos confiar en lo que vemos en el feed?

🧠 Quinto argumento: fenómeno de «desrealización digital» en usuarios

Muchos usuarios reportan una sensación subjetiva de «irrealidad» en las interacciones online. Los comentarios parecen plantillas, los diálogos — repetitivos, las reacciones — predecibles.

Los psicólogos registran un aumento de la «fatiga digital» y la sensación de que «todos alrededor son bots». Esta experiencia subjetiva no es una prueba, pero es masiva y persistente.

El inconsciente colectivo puede reconocer la naturaleza cambiada de internet antes de que los datos lo registren. Pero la sensación subjetiva y la realidad objetiva son cosas diferentes.

🕳️ Sexto argumento: deterioro de la calidad de búsqueda y aumento del spam SEO

Google y otros buscadores ofrecen cada vez más resultados de baja calidad, generados automáticamente. Los artículos optimizados para SEO, creados por IA, desplazan el contenido original.

Los usuarios se quejan de que la búsqueda se ha vuelto «inútil» — las primeras páginas están llenas de publicidad, spam y granjas de contenido. Internet se optimiza para algoritmos, no para personas, lo que lo hace menos útil para las necesidades humanas.

⚙️ Séptimo argumento: incentivos económicos para la automatización de contenido

Crear contenido con personas es caro y lento. La automatización es barata y escalable. Las plataformas publicitarias pagan por visualizaciones y clics, independientemente de quién los genere.

- Lógica económica

- Impulsa la sustitución de personas por algoritmos. En un sistema capitalista, donde el contenido es mercancía, su industrialización es inevitable.

- «Internet muerto»

- No es una conspiración, sino el resultado natural de fuerzas de mercado, cuando la escalabilidad vence a la calidad.

Base de evidencia: qué dicen los datos sobre la proporción real de contenido sintético — cifras, investigaciones, hechos sin emociones

De los argumentos pasamos a datos verificables. Más detalles en la sección Fuentes y evidencias.

🧪 Estadísticas de bots: qué muestran las investigaciones de tráfico

Imperva, empresa de ciberseguridad, publica anualmente informes sobre la composición del tráfico de internet. En 2022, aproximadamente el 47.4% de todo el tráfico web fue generado por bots — tanto "buenos" (rastreadores de búsqueda, sistemas de monitoreo) como "malos" (scrapers, spam-bots, ataques DDoS). La proporción de bots "malos" representó el 30.2% del tráfico total.

El tráfico no equivale a contenido. Los bots generan múltiples solicitudes, pero esto no significa que creen contenido visible para las personas.

📊 Contenido sintético en redes sociales: datos de las plataformas

Twitter estimaba la proporción de bots en un 5% de las cuentas activas, pero investigadores independientes mencionaban entre 9–15%. Elon Musk, al disputar la compra de la plataforma, afirmaba que la proporción real podría alcanzar el 20% o más. Facebook eliminó 1.9 mil millones de cuentas falsas durante el Q2 2022 — aproximadamente el 5% de su base total de usuarios.

Instagram lucha contra sistemas automatizados que generan comentarios y likes, pero no publica cifras exactas. El problema de los bots es real, pero la escala depende de la metodología de conteo.

🧾 IA generativa y contenido textual: investigaciones sobre su prevalencia

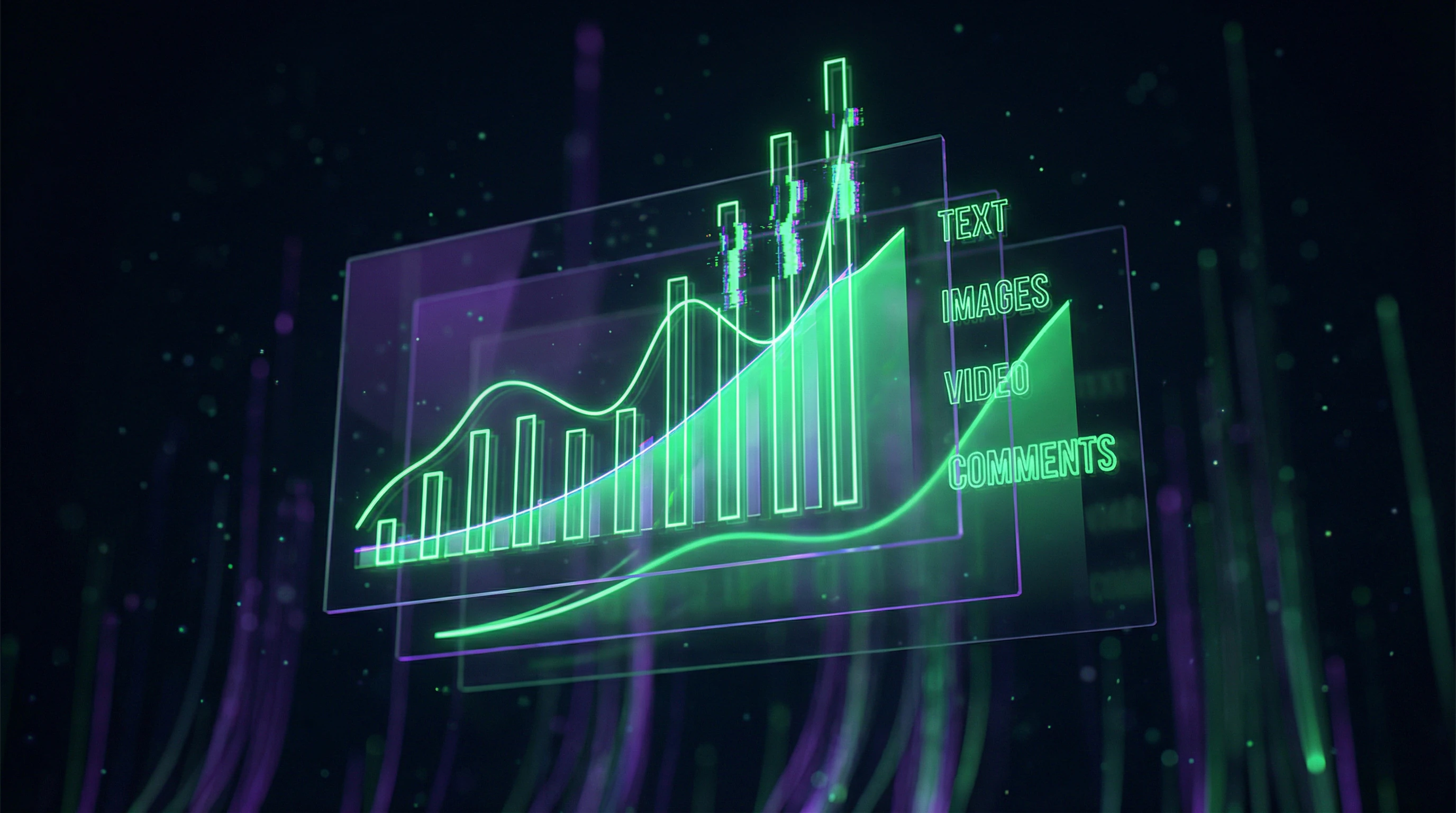

Tras el lanzamiento de ChatGPT en noviembre de 2022, la proporción de texto generado por IA comenzó a crecer exponencialmente. Un estudio de Originality.AI (2023) mostró: aproximadamente el 10–15% de los nuevos artículos en el segmento anglófono contienen signos de generación por IA.

| Nicho de contenido | Proporción de contenido IA | Fiabilidad de detección |

|---|---|---|

| Internet general | 10–15% | 70–80% |

| Contenido SEO, reseñas, agregadores de noticias | 40–60% | 60–70% |

La metodología de detección de texto generado por IA es imperfecta — los resultados falsos positivos y falsos negativos representan el 20–30%. Las cifras exactas son desconocidas, pero la tendencia es evidente: el texto sintético se está convirtiendo en norma.

🔬 Imágenes y vídeos sintéticos: datos sobre deepfakes y modelos generativos

Los modelos generativos (Midjourney, DALL-E, Stable Diffusion para imágenes; Runway, Synthesia para vídeos) han hecho accesible masivamente la creación de medios sintéticos. Un estudio de Sensity AI mostró: la cantidad de vídeos deepfake se duplica cada seis meses.

- En 2023 se registraron más de 95,000 vídeos deepfake (la mayoría de contenido pornográfico).

- Estos son solo los casos detectados.

- Las imágenes sintéticas para ilustraciones, publicidad, redes sociales no pueden contabilizarse con precisión — son indistinguibles de fotografías y no se marcan.

🧬 Limitaciones metodológicas: por qué las cifras exactas son imposibles

Todos los datos presentados tienen limitaciones serias. La detección de bots y contenido generado por IA es imperfecta — los algoritmos mejoran constantemente, evadiendo los sistemas de detección.

- Problema 1: Incentivos de las plataformas

- Las plataformas no están interesadas en publicar cifras exactas — una alta proporción de bots reduce la confianza de anunciantes e inversores.

- Problema 2: Definición difusa

- ¿Qué se considera contenido sintético? ¿Texto editado por IA? ¿Imagen con filtros? ¿Vídeo con subtítulos automáticos? Estas preguntas no tienen respuestas inequívocas, haciendo que cualquier estimación sea aproximada.

- Problema 3: Volúmenes ocultos

- La mayor parte del contenido sintético permanece sin detectar — especialmente en sistemas cerrados, redes corporativas y canales privados.

Conclusión: los datos confirman el crecimiento del contenido sintético, pero las escalas exactas permanecen desconocidas. Esto no significa que la teoría del internet muerto sea correcta — significa que internet realmente está cambiando, y la ignorancia de las frecuencias base en la interpretación de estos datos conduce a conclusiones erróneas.

Mecanismo del fenómeno: relaciones causales frente a correlaciones — por qué internet cambia y quién es responsable

El crecimiento del contenido automatizado es un hecho. ¿Pero es resultado de una conspiración o consecuencia natural de la tecnología y la economía? Analizamos las relaciones causales. Más información en la sección Psicología de la creencia.

⚙️ Economía de la atención: por qué la automatización es inevitable

Internet monetiza la atención. Las plataformas publicitarias pagan por visualizaciones, clics, tiempo en página — cuanto más contenido, más oportunidades para mostrar publicidad.

Un humano crea un artículo al día. La IA crea mil en una hora. La elección de la plataforma es obvia no porque sea malintencionada, sino porque es eficiencia de mercado. Las plataformas optimizan según sus modelos de negocio, no "matan" internet intencionadamente.

🔁 Determinismo tecnológico: el desarrollo de la IA como proceso inevitable

La IA generativa es resultado de décadas de investigación, no una conspiración repentina. GPT-3 (2020), GPT-4 (2023), Stable Diffusion y Midjourney (2022) se desarrollaron abiertamente: artículos científicos, código abierto, mejora predecible de calidad y reducción de costes.

La teoría del internet muerto interpreta el progreso tecnológico como un plan malicioso, ignorando que es la trayectoria natural del desarrollo de la IA.

🧩 Factores de confusión: otros elementos que explican los cambios observados

La sensación de "muerte" puede explicarse no por el aumento de bots, sino por algo completamente diferente. La curación algorítmica crea burbujas de filtros — los usuarios ven patrones repetitivos. La comercialización llevó a la estandarización: todos siguen las mismas reglas SEO, creando una ilusión de uniformidad.

El crecimiento del número de usuarios diluyó la calidad — más personas crean contenido, pero el nivel medio disminuye. Estos factores no están relacionados con bots, pero crean sensaciones subjetivas similares.

| Observación | Explicación mediante bots | Causas alternativas |

|---|---|---|

| El contenido parece repetitivo | Los bots generan texto uniforme | Los algoritmos muestran contenido similar; estandarización SEO |

| Menos voces originales | Los bots silencian a las personas | La comercialización desplazó a los aficionados; concentración de plataformas |

| La calidad del contenido medio cayó | Los bots llenan internet de basura | Más usuarios = más contenido medio; democratización de la creación |

| Más difícil encontrar contenido de nicho | Los bots desplazaron a autores de nicho | Los algoritmos priorizan lo popular; economía de escala |

🎯 Dónde termina la correlación y comienza la causa

Correlación: internet cambia, la IA se desarrolla — ambos procesos van en paralelo. Causa: ¿la IA provoca cambios en internet? ¿O internet genera demanda de IA? ¿O ambos fenómenos son consecuencia de un tercer factor (capitalismo, escalado de plataformas)?

La teoría del internet muerto toma la correlación y la declara causa, añadiendo intención (conspiración). Es el error clásico de sesgo cognitivo: vemos un patrón → suponemos un agente → le atribuimos un objetivo.

- Cadena causal (real)

- Incentivos económicos → inversiones en IA → progreso tecnológico → implementación en plataformas → cambio de contenido

- Cadena causal (teoría del internet muerto)

- Conspiración → implementación deliberada de bots → muerte de internet → control de información

- Por qué la segunda versión es más atractiva

- Es más simple (un agente en lugar de un sistema de factores), explica la sensación de pérdida de control, ofrece un enemigo en lugar de incertidumbre

La realidad es más compleja: internet cambia porque su economía requiere escalado, y la IA es una herramienta de escalado. No es una conspiración, es lógica de mercado. Pero esto no significa que los cambios sean inofensivos o que no se puedan criticar — simplemente la crítica debe dirigirse a los incentivos económicos, no a enemigos imaginarios.

Conflictos e incertidumbres: dónde difieren las fuentes y por qué no existe una respuesta única

Las investigaciones sobre la proporción de bots y contenido sintético arrojan resultados contradictorios. Diferentes metodologías, diferentes definiciones, diferentes marcos temporales: todo esto conduce a estimaciones que oscilan entre el 5% y el 60%. Más detalles en la sección Falacias lógicas.

🔎 Definición de «bot»: ¿agente técnico o actor social?

El problema principal es la ausencia de una definición única de «bot». Técnicamente, es cualquier programa automatizado que interactúa con servicios web: rastreadores de búsqueda de Google, sistemas de monitorización, notificaciones automáticas.

En el contexto de la teoría del internet muerto, «bot» significa un sistema que imita el comportamiento humano para manipular o engañar. Estas definiciones no se superponen.

Los estudios que utilizan una definición amplia arrojan cifras altas; una definición estrecha produce cifras bajas. Esta es una incertidumbre metodológica que no puede eliminarse sin consenso.

📊 El problema de la medición: ¿cómo contar lo que se oculta?

Los bots y sistemas de IA se perfeccionan constantemente para evitar la detección. Esto crea un problema fundamental: solo podemos contar los casos detectados, pero no sabemos cuántos permanecen sin detectar.

Diferentes estudios utilizan diferentes métodos de detección: análisis conductual, patrones lingüísticos, firmas técnicas. Ningún método es 100% fiable.

- Análisis conductual: seguimiento de patrones de actividad, pero los bots aprenden a imitar ritmos humanos

- Patrones lingüísticos: análisis de texto, pero la IA generativa se vuelve indistinguible del lenguaje humano

- Firmas técnicas: verificación de metadatos e IP, pero se enmascaran fácilmente mediante proxies y VPN

🧾 Dinámica temporal: el problema de una realidad que cambia rápidamente

La situación cambia tan rápido que las investigaciones quedan obsoletas en el momento de su publicación. Los datos de 2022 no reflejan la realidad de 2024, cuando la IA generativa se convirtió en una herramienta masiva.

Cualquier estimación de la proporción de contenido sintético es una instantánea que pierde vigencia en pocos meses. Siempre analizamos el pasado, no el presente.

- Retraso de investigación

- Desde la recopilación de datos hasta la publicación transcurren entre 6 y 18 meses. Durante ese tiempo, la tecnología de IA avanza varias generaciones.

- Retraso de adaptación

- Tan pronto como se publica un estudio sobre un método de detección, los creadores de bots ya están trabajando en cómo eludirlo.

- Retraso de concienciación

- El público conoce el problema cuando ya ha pasado a una nueva fase de desarrollo.

Estos tres retrasos crean un efecto de «perseguir la cola»: describimos la realidad de ayer mientras la de hoy ya es diferente. No existe una respuesta única a la pregunta «¿cuál es la proporción de contenido sintético?» no porque los investigadores sean incompetentes, sino porque la pregunta misma presupone una realidad estática que no existe.

Anatomía cognitiva del mito: qué mecanismos psicológicos transforman la observación en conspiracionismo

La teoría del internet muerto es un ejemplo clásico de cómo observaciones reales se transforman en pensamiento conspirativo. Analizamos los sesgos cognitivos que alimentan esta teoría. Más información en la sección Karma y reencarnación.

⚠️ Reconocimiento de patrones y apofenia: ver conexiones donde no las hay

El cerebro humano está evolutivamente configurado para buscar patrones: esto ayudaba a sobrevivir, reconociendo amenazas. Pero esta capacidad falla, creando la ilusión de patrones en datos aleatorios.

La apofenia es la percepción de conexiones significativas entre fenómenos no relacionados. Los defensores de la teoría del internet muerto ven "pruebas" por todas partes: comentarios repetitivos, publicaciones similares, respuestas estandarizadas. Pero estos fenómenos se explican simplemente: las personas se copian entre sí, usan los mismos memes, siguen tendencias.

La apofenia convierte lo banal en "prueba de conspiración" y cuantos más datos hay, más "coincidencias" encuentra el cerebro.

🕳️ Sesgo de confirmación: buscar solo lo que confirma la hipótesis

Cuando alguien acepta la teoría del internet muerto, comienza a buscar confirmaciones e ignorar refutaciones. ¿Encontró un comentario estandarizado? "¡Es un bot!" ¿Vio una publicación original? "Excepción rara".

Este filtro cognitivo hace la teoría irrefutable: cualquier dato se interpreta a su favor. El sesgo de confirmación es un error sistemático que refuerza creencias independientemente de los hechos.

🧠 Agencia e intencionalidad: atribuir intenciones a procesos impersonales

Las personas tienden a ver intenciones y agentes donde actúan procesos impersonales. El crecimiento de la automatización en internet es resultado de incentivos económicos y desarrollo tecnológico, no un plan malicioso de alguien.

Pero el cerebro exige un enemigo, un coordinador, un conspirador. Las fuerzas impersonales del mercado y los algoritmos se experimentan como confabulación. Esto no es paranoia: es el funcionamiento normal del sistema de reconocimiento de agentes, que se activa con demasiada frecuencia.

- Observación: el contenido se ha vuelto más homogéneo y automatizado

- Interpretación: esto no es lógica de mercado, sino el plan de alguien

- Búsqueda de agente: ¿quién puede ser? ¿Empresas de IA? ¿El Estado? ¿Corporaciones?

- Refuerzo: cualquier nuevo hecho se convierte en "prueba" del plan

📊 Heurística de disponibilidad: recordamos lo llamativo, olvidamos lo típico

Los ejemplos llamativos de bots, publicaciones copiadas y comentarios extraños son fáciles de recordar y parecen frecuentes. Millones de publicaciones normales pasan desapercibidas: no provocan emociones.

La heurística de disponibilidad nos hace sobrestimar la frecuencia de lo que es fácil de recordar. Unos pocos ejemplos llamativos de bots crean la impresión de que los bots están en todas partes.

🎯 Ignorar la tasa base: olvidar el contexto

Incluso si el 5% de internet es contenido sintético, esto no significa que internet esté "muerto". Pero cuando alguien se concentra en ese 5%, olvida el 95% de contenido vivo.

Ignorar la tasa base es el desprecio sistemático del contexto y la escala. La teoría del internet muerto funciona exactamente así: toma un fenómeno real (el crecimiento del contenido IA) e ignora su verdadera escala.

⚫⚪ Pensamiento dicotómico: sin matices

La teoría del internet muerto supone una dicotomía: o internet está vivo, o está muerto. O el contenido es humano, o es de bots. Pero la realidad es más compleja: el contenido puede estar parcialmente automatizado, parcialmente humano, ser híbrido.

La falsa dicotomía simplifica el mundo, haciéndolo más comprensible, pero menos preciso. Los fenómenos complejos requieren modelos complejos, no elegir entre dos extremos.

El mito del internet muerto no es una mentira. Es una observación real, filtrada a través de sesgos cognitivos que transforman una verdad parcial en conspiración absoluta.