Negligencia de la tasa base: ceguera cognitiva que convierte herramientas precisas en generadores de errores

La negligencia de la tasa base (base rate neglect) es un sesgo cognitivo sistemático en el que las personas ignoran la prevalencia estadística de un evento en la población general, centrándose en información específica sobre un caso concreto (S001).

La Enciclopedia de Psicología Social lo define como un error en los juicios probabilísticos: los individuos desestiman la información sobre la frecuencia del evento en la población y se basan en detalles llamativos pero estadísticamente menos significativos. Más información en la sección Fuentes y evidencias.

Estructura del error: tres componentes que crean la ilusión de precisión

La estructura clásica incluye tres elementos:

- Tasa base (prior probability)

- Prevalencia del evento en la población — por ejemplo, el 0.1% de la población tiene la enfermedad X.

- Sensibilidad del test (true positive rate)

- El test identifica correctamente al 99% de los enfermos.

- Especificidad del test (true negative rate)

- El test identifica correctamente al 99% de los sanos.

La mente humana se centra intuitivamente en la sensibilidad y especificidad, percibiendo una "precisión del 99%" como garantía, e ignora completamente la rareza de la propia enfermedad.

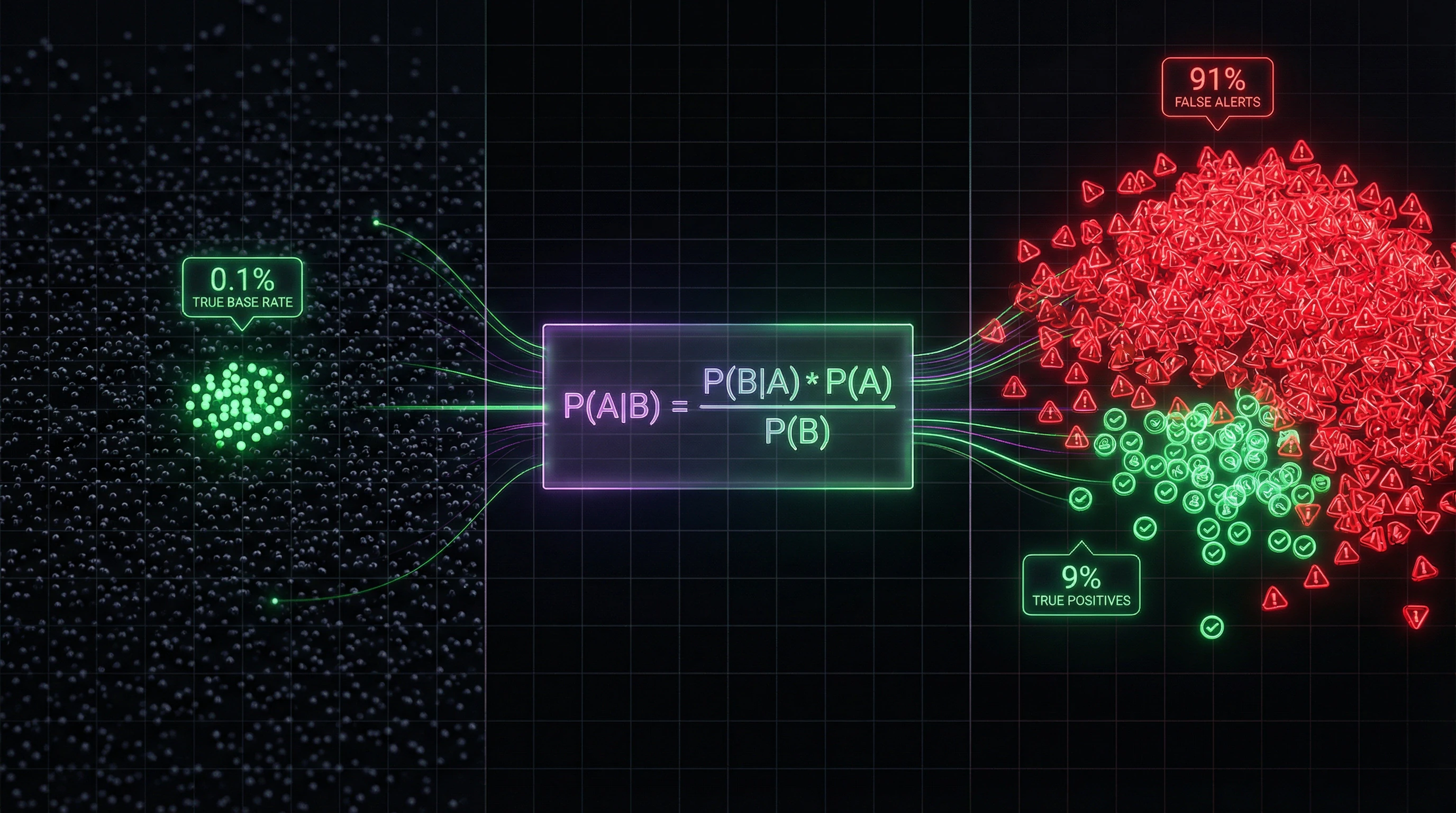

Por qué una precisión del 99% puede significar un 90% de falsas alarmas

Ejemplo concreto: la enfermedad afecta a 1 persona de cada 1000 (tasa base 0.1%). El test tiene 99% de sensibilidad y 99% de especificidad. Probamos a 100.000 personas.

| Grupo | Cantidad | Resultado del test | Número de personas |

|---|---|---|---|

| Enfermos (0.1%) | 100 | Verdaderos positivos (99%) | 99 |

| Sanos (99.9%) | 99.900 | Falsos positivos (1%) | 999 |

| Total de resultados positivos | 1.098 | ||

Probabilidad de que una persona con resultado positivo esté realmente enferma: 99 / 1.098 ≈ 9%. Probabilidad de falsa alarma: 999 / 1.098 ≈ 91%.

Límites del fenómeno: del error individual al problema sistémico

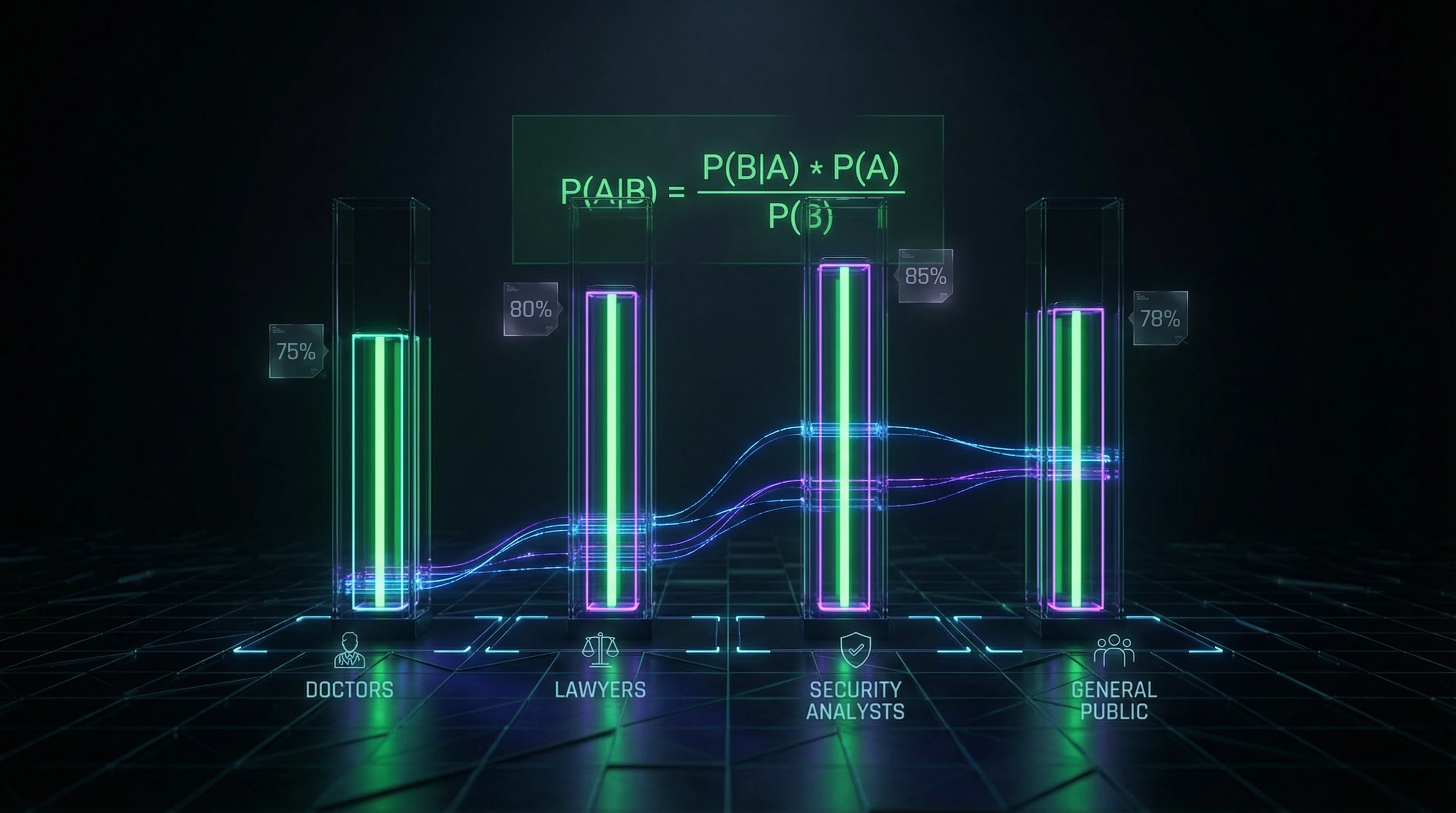

La negligencia de la tasa base no es simplemente un error individual de juicio. Este error afecta a profesionales: los médicos interpretan incorrectamente los resultados de pruebas de cribado, los jueces sobreestiman la probabilidad de culpabilidad basándose en dictámenes periciales, los especialistas en ciberseguridad generan avalanchas de falsas alarmas (S001).

El fenómeno se manifiesta en cualquier situación que requiera integrar información estadística base con datos concretos sobre un caso — desde la evaluación de riesgos hasta el diagnóstico médico y la valoración de amenazas de seguridad.

Siete argumentos que hacen que ignorar la frecuencia base sea tan convincente y peligroso

Ignorar la frecuencia base no es resultado de estupidez. Es consecuencia de características profundas de la cognición humana que en la mayoría de situaciones funcionan eficientemente, pero en el contexto de juicios probabilísticos crean distorsiones sistemáticas. Más detalles en la sección Fundamentos de epistemología.

⚠️ Argumento 1: La información concreta es psicológicamente más vívida que la estadística abstracta

El cerebro evolucionó para procesar eventos concretos y tangibles, no distribuciones abstractas. La información de que "la prueba dio positivo específicamente en tu caso" se percibe como más relevante que la información abstracta de que "en la población esta enfermedad es poco frecuente" (S001).

La vivacidad psicológica del caso concreto suprime el contexto estadístico: no es un error de lógica, sino una característica de la arquitectura de la atención.

⚠️ Argumento 2: La representatividad domina sobre la probabilidad en juicios intuitivos

Las personas evalúan la probabilidad de un evento no por su frecuencia estadística, sino por cuán "representativo" es: cuánto corresponde a un prototipo o estereotipo (S002). Si los síntomas o resultados de la prueba "se parecen" a la enfermedad, el cerebro automáticamente eleva la estimación de probabilidad, ignorando la frecuencia base.

La heurística de representatividad es una forma rápida pero sistemáticamente sesgada de juzgar, que trabaja en tu contra en eventos raros.

⚠️ Argumento 3: La experiencia profesional crea la ilusión de que la frecuencia base "ya está considerada"

Médicos, abogados, analistas de seguridad a menudo asumen que su experiencia compensa automáticamente la necesidad de considerar explícitamente las frecuencias base. El experto piensa: "Sé que es una enfermedad rara, pero los síntomas son tan específicos que la frecuencia base no aplica".

Esto es una ilusión: las matemáticas del teorema de Bayes no dependen de la opinión experta sobre la "especificidad" del caso (S004).

⚠️ Argumento 4: Los sistemas de formación se enfocan en la precisión de la prueba, no en la interpretación de resultados

La educación médica enseña a evaluar la sensibilidad y especificidad de pruebas diagnósticas, pero rara vez entrena la habilidad de integrar estos indicadores con la frecuencia base de la enfermedad en una población específica. Los especialistas en ciberseguridad aprenden a configurar sistemas de detección de intrusiones para máxima sensibilidad, pero no para minimizar falsos positivos considerando la frecuencia real de ataques.

Los sistemas educativos reproducen el error a nivel institucional.

⚠️ Argumento 5: La asimetría de consecuencias crea motivación para ignorar la frecuencia base

En medicina, pasar por alto una enfermedad rara pero peligrosa se percibe como un error más grave que causar pánico con un diagnóstico falso positivo. En ciberseguridad, perder un ataque real es más catastrófico que generar miles de falsas alarmas.

| Área | Resultado falso negativo | Resultado falso positivo | Presión del sistema |

|---|---|---|---|

| Medicina | El paciente no recibirá tratamiento para enfermedad rara | El paciente pasará por examen innecesario | Aumentar sensibilidad |

| Ciberseguridad | Un ataque real pasará desapercibido | Falsa alarma distraerá a analistas | Aumentar sensibilidad |

Esta asimetría crea presión institucional hacia la "precaución excesiva": aumentar la sensibilidad de los sistemas sin considerar que con baja frecuencia base esto conduce a una avalancha de falsos positivos.

⚠️ Argumento 6: Los efectos en cascada en cadenas de decisiones amplifican el error inicial

El error de frecuencia base en una etapa se convierte en dato de entrada para la siguiente. Un médico que recibe un resultado falso positivo de una prueba de cribado prescribe un examen más invasivo, que tiene sus propios riesgos y puede generar nuevos falsos positivos.

Un analista de seguridad que responde a una falsa alarma del sistema de detección de intrusiones puede interpretar actividad normal como sospechosa, creando una cascada de conclusiones erróneas.

⚠️ Argumento 7: La ausencia de retroalimentación hace el error invisible para los profesionales

Un médico que derivó a un paciente con resultado falso positivo a examen adicional rara vez conoce el diagnóstico final: el paciente va con otro especialista. El analista de seguridad no recibe retroalimentación sistemática sobre cuántas de sus alarmas fueron falsas.

- Sin retroalimentación explícita, los profesionales no pueden calibrar sus estimaciones intuitivas de probabilidad.

- El error se reproduce infinitamente, integrándose en la rutina.

- El profesional permanece convencido de la corrección de su enfoque porque no ve el panorama completo de las consecuencias.

Esto crea un ciclo cerrado: el error permanece invisible, por lo tanto no se corrige, por lo tanto se reproduce nuevamente.

Base empírica: qué muestran los estudios sobre la negligencia de la tasa base

El fenómeno de la negligencia de la tasa base fue descrito sistemáticamente por primera vez en una serie de experimentos de Kahneman y Tversky en los años 70 y desde entonces se ha reproducido en cientos de estudios en diversos contextos, desde experimentos de laboratorio hasta análisis de decisiones profesionales reales (S001).

📊 Experimentos clásicos: cómo las personas ignoran la estadística incluso cuando se presenta explícitamente

En el estudio original de Kahneman y Tversky, se presentó a los participantes el siguiente problema: "En una ciudad, el 85% de los taxis son verdes y el 15% son azules. Un testigo de un accidente afirma haber visto un taxi azul. La fiabilidad del testigo ha sido verificada: identifica correctamente el color en el 80% de los casos. ¿Cuál es la probabilidad de que el taxi fuera realmente azul?" La respuesta correcta según el teorema de Bayes: aproximadamente 41%. La respuesta típica de los participantes: 80%: ignoraban completamente la tasa base (85% de taxis verdes) y se centraban únicamente en la fiabilidad del testigo (S001).

Las personas no integran la información. Sustituyen un cálculo complejo por una regla simple: "El testigo es fiable al 80%, por tanto la respuesta es 80%". No es un error de cálculo. Es una renuncia al cálculo.

📊 Diagnóstico médico: los médicos cometen el mismo error que los no especialistas

Un estudio en el que se presentó a médicos una tarea de interpretación de resultados de mamografía mostró una negligencia masiva de la tasa base. Se informó a los participantes: la tasa base de cáncer de mama en la población de cribado es del 1%, la sensibilidad de la mamografía es del 90%, la tasa de falsos positivos es del 9%. Pregunta: ¿cuál es la probabilidad de cáncer con un resultado positivo? Respuesta correcta: aproximadamente 9%. Respuesta mediana de los médicos: 75%. La mayoría de los médicos sobrestimaron la probabilidad de cáncer en 8 veces, ignorando la baja tasa base (S002).

No es un problema de competencia. Los médicos conocen la estadística. El problema es que la heurística de disponibilidad y la concreción del caso clínico pesan más que las cifras abstractas. Más información en la sección Alfabetización mediática.

📊 Ciberseguridad: avalancha de falsas alarmas como consecuencia de ignorar la tasa base de ataques

Una revisión sistemática de la aplicación de sistemas de detección de intrusiones (IDS) en ciberseguridad mostró que ignorar la tasa base de ataques reales conduce a una proporción catastrófica de alarmas falsas y verdaderas (S004). Con una tasa base típica de ataques del 0,01% (1 ataque por cada 10.000 eventos) y una sensibilidad del IDS del 99%, un sistema con una tasa de falsos positivos del 1% generará 100 falsas alarmas por cada ataque real.

| Parámetro | Valor | Consecuencia |

|---|---|---|

| Tasa base de ataques | 0,01% | Los ataques son raros |

| Sensibilidad IDS | 99% | Detecta el 99% de ataques reales |

| Falsos positivos | 1% | 100 falsos por 1 real |

Los analistas de seguridad subestiman sistemáticamente la magnitud de este problema, centrándose en la "alta precisión" del sistema (99%) e ignorando la rareza de los ataques reales (S004).

📊 Sistema judicial: dictámenes periciales y sobrestimación de la probabilidad de culpabilidad

El análisis del uso de dictámenes periciales probabilísticos en procesos judiciales (por ejemplo, coincidencia de ADN, peritaje balístico) mostró que jurados y jueces sobrestiman sistemáticamente la probabilidad de culpabilidad, ignorando la tasa base de delitos en la población. Si un perito informa que "la probabilidad de coincidencia aleatoria de ADN es de 1 entre un millón", los jurados lo interpretan como "la probabilidad de inocencia es de 1 entre un millón", ignorando completamente la probabilidad a priori de que una persona aleatoria de la población haya cometido dicho delito (S002).

- Falacia del fiscal

- Confusión entre P(coincidencia | culpable) y P(culpable | coincidencia). La primera es cercana a 1, la segunda depende de la tasa base de delitos y otros sospechosos.

- Por qué es peligroso

- Una persona inocente puede ser condenada si su ADN coincide casualmente con el ADN en la escena del crimen, y el tribunal ignora que en la población hay millones de personas con ADN similar.

🧾 Metaanálisis: robustez del efecto en diferentes poblaciones y contextos

Un metaanálisis de estudios sobre negligencia de la tasa base mostró que el efecto es robusto en diferentes culturas, grupos de edad y niveles educativos (S001). La magnitud del efecto varía según la forma de presentación de la información: cuando la tasa base se presenta en forma de frecuencias naturales (por ejemplo, "10 de cada 1000") en lugar de porcentajes (por ejemplo, "1%"), el error disminuye, pero no desaparece completamente.

- Las frecuencias naturales reducen el error en un 20-40%, pero no lo eliminan

- La visualización (diagramas, gráficos) ayuda más que el texto

- Incluso con el formato óptimo, una parte significativa de los participantes continúa ignorando la tasa base

- La educación y la experiencia atenúan, pero no anulan el efecto

🔬 Correlatos neurocognitivos: qué sistemas cerebrales están implicados en el error

Estudios de neuroimagen mostraron que las tareas que requieren integrar la tasa base con información concreta activan la corteza prefrontal dorsolateral, un área relacionada con la memoria de trabajo y el control cognitivo (S005). Los participantes que tienen en cuenta exitosamente la tasa base demuestran mayor activación de esta área, lo que indica que la respuesta correcta requiere suprimir la respuesta intuitiva y realizar un esfuerzo analítico explícito.

La respuesta correcta requiere recursos cognitivos que en condiciones reales a menudo no están disponibles debido a la carga, el estrés o la falta de tiempo. El error no es estupidez. Es un ahorro de energía cerebral que se vuelve peligroso en situaciones de alto riesgo.

Esto explica por qué el pensamiento grupal intensifica la negligencia de la tasa base: en grupo, la presión social suprime el esfuerzo analítico aún más.

Mecanismo del error: por qué el cerebro ignora sistemáticamente la tasa base

Ignorar la tasa base no es un error casual, sino una consecuencia sistemática de la arquitectura de la cognición humana. Comprender el mecanismo es crítico para desarrollar estrategias efectivas de prevención. Más información en la sección Sesgos cognitivos.

🧬 Heurística de representatividad: juicio rápido en lugar de cálculo lento

Kahneman y Tversky demostraron que las personas evalúan la probabilidad de un evento no mediante la aplicación formal del teorema de Bayes, sino a través de la heurística de representatividad: «¿Cuánto se parece A a B?» (S001). Si los síntomas de un paciente «se parecen» al cuadro típico de una enfermedad, el cerebro automáticamente aumenta la estimación de probabilidad de esa enfermedad, ignorando su rareza.

Esta heurística funciona rápidamente y en la mayoría de situaciones produce resultados aceptables, pero se equivoca sistemáticamente en situaciones con baja tasa base y alta especificidad de información. La similitud con el prototipo se vuelve más fuerte que la realidad estadística.

El cerebro pregunta: «¿A qué se parece esto?» — no: «¿Con qué frecuencia ocurre esto?»

🧬 Competencia de sistemas: Sistema 1 intuitivo versus Sistema 2 analítico

En términos del modelo de dos sistemas de Kahneman, ignorar la tasa base es el dominio del rápido Sistema 1 intuitivo sobre el lento Sistema 2 analítico. El Sistema 1 genera automáticamente una respuesta basada en representatividad y disponibilidad de información.

El Sistema 2 es capaz de aplicar el teorema de Bayes y considerar la tasa base, pero esto requiere esfuerzo explícito, tiempo y motivación. En condiciones de carga cognitiva, escasez de tiempo o ausencia de una señal clara sobre la necesidad de pensamiento analítico, el Sistema 2 no se activa, y domina la respuesta errónea del Sistema 1 (S004).

| Sistema 1 (intuitivo) | Sistema 2 (analítico) |

|---|---|

| Automático, rápido | Requiere esfuerzo, lento |

| Se basa en similitud y disponibilidad | Aplica lógica formal |

| Activo por defecto | Se activa ante necesidad explícita |

| Ignora la tasa base | Considera la tasa base |

🔁 Efecto de encuadre: cómo el formato de presentación de información modula el error

Las investigaciones mostraron que el formato de presentación de información probabilística influye críticamente en la frecuencia del error de tasa base (S002). Cuando la información se presenta en forma de porcentajes o probabilidades («1% de la población tiene la enfermedad, el test tiene 99% de precisión»), el error es máximo.

Cuando la misma información se presenta en forma de frecuencias naturales («de 1000 personas, 10 tienen la enfermedad, el test identifica correctamente a 9 de ellas y marca erróneamente a 10 sanas»), el error se reduce significativamente. Esto indica que el cerebro humano está evolutivamente adaptado para procesar frecuencias, no probabilidades abstractas.

- Frecuencias naturales

- Representación de información en forma de números concretos de una población (por ejemplo, «de 1000»). Activa el Sistema 2 y reduce el error de tasa base en 50–70%.

- Probabilidades abstractas

- Representación en forma de porcentajes o fracciones decimales. Permanece en modo Sistema 1, el error es máximo.

🧬 Distorsiones motivacionales: cuando lo deseado influye en la evaluación de lo probable

Ignorar la tasa base se intensifica por factores motivacionales. Si una persona teme cierta enfermedad, tiende a sobreestimar su probabilidad incluso con baja tasa base y síntomas inespecíficos.

Si un analista de seguridad está bajo presión de «no dejar pasar un ataque», tiende a interpretar cualquier anomalía como amenaza, ignorando la baja tasa base de ataques reales. La motivación distorsiona no solo la interpretación de información, sino la propia disposición a aplicar pensamiento analítico (S001).

El miedo y la presión no solo distorsionan el juicio — desactivan el pensamiento analítico de raíz.

La conexión con la heurística de disponibilidad aquí es directa: los eventos motivacionalmente significativos parecen más frecuentes de lo que realmente son, lo que refuerza adicionalmente ignorar la tasa base.

Conflictos en los datos y límites de certeza: donde la evidencia diverge

El efecto de frecuencia base es robusto, pero las condiciones de su manifestación y las formas de superarlo siguen siendo objeto de desacuerdo científico. Tres debates clave muestran dónde diverge la evidencia y por qué no existe una solución universal. Más detalles en la sección Verificación de la Realidad.

Experiencia: ¿escudo o ilusión?

Los médicos diagnosticadores experimentados cometen el error de frecuencia base con menos frecuencia que los principiantes (S009). Pero basta con reformular la tarea en términos abstractos y la diferencia desaparece (S011).

La experiencia funciona solo si el profesional dispone de un modelo mental explícito para integrar la frecuencia base, y ese modelo se activa por el contexto. En situaciones atípicas, la experiencia no protege.

Un médico acostumbrado a los protocolos diagnósticos de su especialidad puede tener en cuenta automáticamente la prevalencia de la enfermedad. Pero si la tarea se formula como un acertijo lógico abstracto, su cerebro cambia al modo "principiante" y el error regresa.

Formación: un efecto que no perdura

Los entrenamientos breves sobre el teorema de Bayes mejoran los resultados en las tareas siguientes, pero el efecto no se transfiere a nuevos contextos y se desvanece con el tiempo (S011). Los programas intensivos con práctica repetida y retroalimentación muestran resultados más sostenidos, pero requieren recursos significativos (S010).

| Tipo de intervención | Efecto inmediato | Transferencia a nuevos contextos | Sostenibilidad en el tiempo |

|---|---|---|---|

| Entrenamiento breve (explicación + ejemplos) | Presente | Débil | Se desvanece |

| Programa intensivo (práctica + retroalimentación) | Presente | Más fuerte | Más sostenido |

El problema: el cerebro aprende el contexto, no el principio. Enseñar a una persona a calcular según Bayes en el laboratorio no significa que lo hará en la consulta médica o al evaluar riesgos en el trabajo.

Formato de datos: las frecuencias naturales no son una panacea

La presentación de información en forma de frecuencias naturales (por ejemplo, "10 de 1000" en lugar de "1%") reduce consistentemente el error de frecuencia base (S011). Pero incluso con el formato óptimo, el 30-40% de los participantes continúan ignorando la frecuencia base.

- Frecuencias naturales

- Formato que facilita la comprensión intuitiva de probabilidades (por ejemplo, "50 de 10.000 pacientes"). Funciona mejor que los porcentajes, pero no es universal.

- Contexto real

- En protocolos médicos, informes de seguridad y documentos financieros, la información a menudo se presenta en porcentajes o probabilidades. Cambiar el formato requiere cambios sistémicos en la documentación y la formación.

Incluso si reformateas los datos perfectamente, el sistema en el que circulan esos datos puede trabajar en tu contra. Un médico recibirá el resultado de una prueba en forma de frecuencias naturales, pero la historia clínica electrónica requerirá la entrada en porcentajes, y el ciclo se cierra.

Estos tres debates apuntan a una cosa: no hay una cura universal. Cada solución funciona en condiciones específicas y requiere apoyo constante. Ignorar la frecuencia base no es simplemente un error cognitivo que pueda corregirse con una sola intervención. Es un problema sistémico, integrado en cómo aprendemos, cómo se organiza la información y cómo tomamos decisiones bajo presión.

Anatomía cognitiva de la manipulación: qué sesgos explota la omisión de la tasa base

La omisión de la tasa base no solo conduce a errores involuntarios, sino que puede ser explotada deliberadamente para manipular la percepción de riesgos y la toma de decisiones. Más información en la sección Ocultación de datos por farmacéuticas.

⚠️ Explotación mediante presentación selectiva de la precisión del test

Los fabricantes de pruebas diagnósticas, sistemas de seguridad o algoritmos de aprendizaje automático suelen promocionar una "precisión del 99%" o "alta sensibilidad", omitiendo la tasa base del evento (S001). Esto no es un error: es una estrategia.

Cuando la probabilidad del evento es baja (enfermedad rara, intrusión poco frecuente), la alta precisión del test se convierte en una ilusión de fiabilidad. El consumidor escucha "99%" e ignora el contexto en el que la mayoría de los resultados positivos son falsos positivos.

La manipulación funciona no porque la información sea falsa, sino porque es incompleta. El dato sigue siendo cierto, pero sin la tasa base se convierte en un arma.

🎯 Tres mecanismos de explotación

- Divulgación selectiva. Se comunica la sensibilidad (proporción de verdaderos positivos), pero no la especificidad o el valor predictivo positivo.

- Anclaje emocional. "Precisión del 99%" suena como una garantía, activando la heurística de disponibilidad: la cifra llamativa desplaza el contexto estadístico.

- Validación social. Cuando la mayoría cree en la fiabilidad del test (debido a la omisión de la tasa base), el pensamiento grupal refuerza la ilusión (S004).

🔗 Relación con otros sesgos cognitivos

La omisión de la tasa base rara vez actúa de forma aislada. Se entrelaza con la falsa dicotomía (el test funciona o no funciona), con el sesgo de confirmación (buscamos datos que respalden el primer resultado positivo) y con la desinformación, que oculta deliberadamente las tasas base.

Resultado: un sistema en el que herramientas precisas se convierten en generadoras de errores, y las personas en víctimas de su propia incapacidad para integrar el contexto estadístico.