Caos terminológico: por qué "revisión sistemática" y "metaanálisis" no son sinónimos, pero todos actúan como si lo fueran

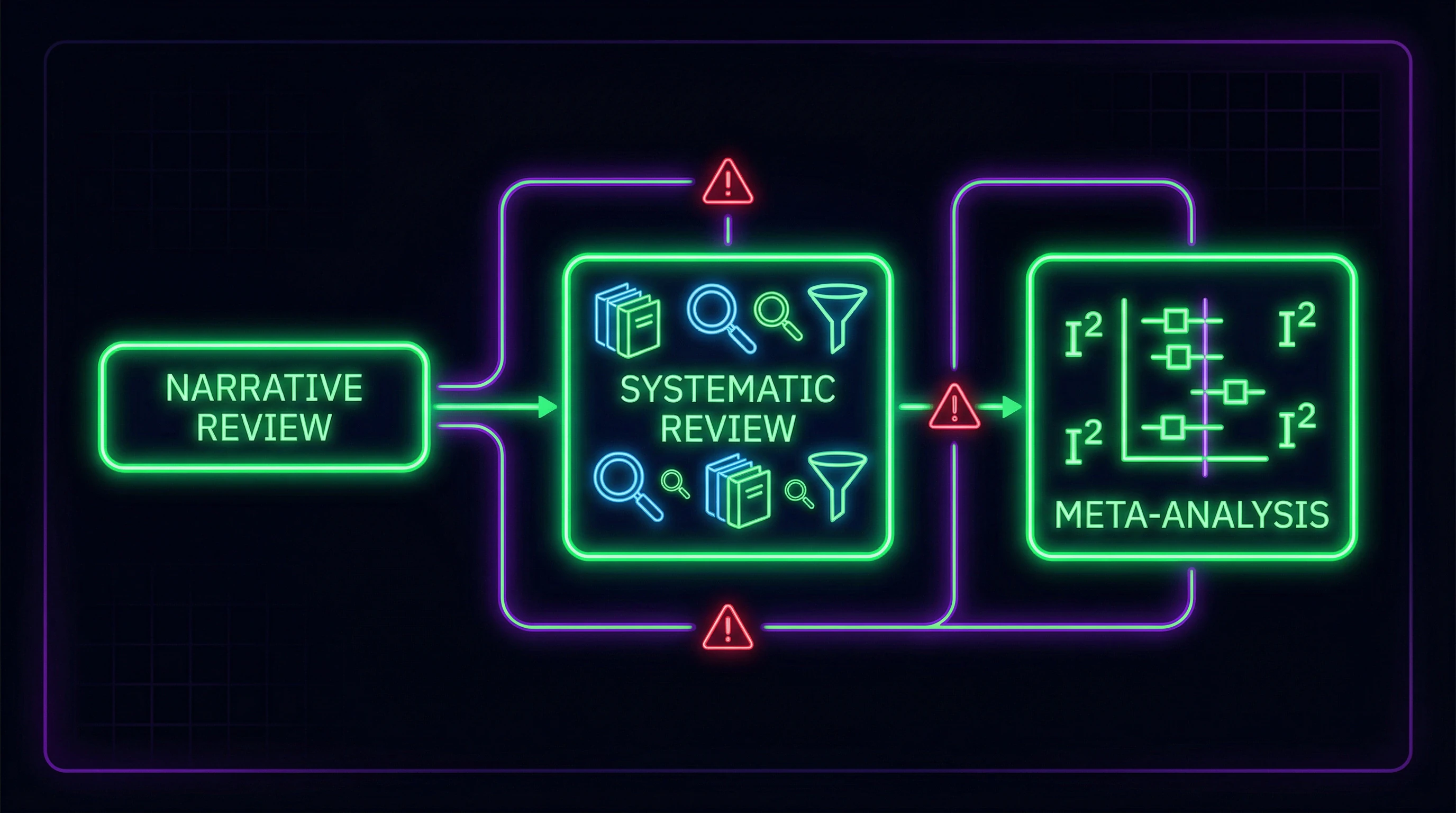

El primer y más común error en la literatura científica es usar los términos "revisión sistemática" y "metaanálisis" como conceptos intercambiables. Una revisión sistemática representa un proceso integral de búsqueda y selección de todos los estudios relevantes sobre un tema específico utilizando criterios de inclusión y exclusión estrictamente definidos (S010).

El metaanálisis es un método estadístico para combinar datos cuantitativos de una revisión sistemática (S010). Punto crítico: el metaanálisis es imposible sin una revisión sistemática previa, pero una revisión sistemática puede existir sin metaanálisis, cuando los datos son demasiado heterogéneos o los estudios proporcionan solo información cualitativa.

- Revisión sistemática

- Marco metodológico de búsqueda y selección de estudios con criterios predeterminados. Garantiza reproducibilidad y transparencia en la síntesis de evidencia.

- Metaanálisis

- Combinación estadística de datos cuantitativos. Requiere homogeneidad de datos y evaluación correcta de la heterogeneidad.

- Scoping review

- Enfoque sistemático con alcance más amplio de la pregunta de investigación (S010). Ideal para áreas nuevas e identificación de direcciones para investigaciones futuras.

Por qué la confusión terminológica destruye la comunicación científica

La mezcla de conceptos crea una ilusión de rigor donde no existe. Los investigadores a menudo llaman a su trabajo "revisión sistemática con metaanálisis" sin realizar ni una búsqueda sistemática ni un análisis estadístico correcto.

El resultado: publicaciones que parecen evidencia de alta calidad, pero que en realidad representan una revisión selectiva de la literatura con una combinación arbitraria de datos incomparables.

Criterios de diferenciación: protocolo de identificación

| Elemento | Revisión sistemática | Metaanálisis |

|---|---|---|

| Protocolo | Registrado previamente | Incluye plan estadístico |

| Búsqueda | Sistemática en múltiples BD | De la revisión sistemática |

| Criterios | Definidos antes de iniciar búsqueda | Definidos antes del análisis |

| Evaluación de calidad | Riesgo de sesgo por dos revisores | Análisis de heterogeneidad y sesgo de publicación |

| Datos | Cualitativos o cuantitativos | Solo cuantitativos, combinables |

Una revisión sistemática sin metaanálisis sigue siendo un estudio válido. Un metaanálisis sin revisión sistemática es manipulación estadística, no ciencia. Más detalles en la sección Pensamiento crítico.

Siete argumentos sólidos a favor de requisitos metodológicos estrictos en las revisiones sistemáticas

Antes de analizar por qué la mayoría de las revisiones no superan la verificación de calidad, es necesario comprender por qué los requisitos son tan estrictos. No se trata de pedantería académica: cada requisito protege contra un tipo específico de sesgo sistemático. Más información en la sección Sesgos mentales.

🧪 Primer argumento: la reproducibilidad como base del método científico

Una revisión sistemática busca sintetizar la evidencia sobre un tema específico mediante un análisis estructurado, exhaustivo y reproducible de la literatura (S010). Reproducibilidad significa que un equipo independiente de investigadores, siguiendo el mismo protocolo, debe obtener un conjunto idéntico de estudios incluidos.

Esto es fundamental para desarrollar una comprensión informada del tema, permitiendo extraer conclusiones basadas en evidencia para orientar futuras investigaciones, decisiones políticas y práctica clínica (S010).

📊 Segundo argumento: prevención de la selección sesgada de datos

Sin una búsqueda sistemática y criterios claros de inclusión, los investigadores inevitablemente seleccionan estudios que confirman su hipótesis. No se trata necesariamente de manipulación malintencionada: el sesgo de confirmación opera automáticamente.

El enfoque sistemático con registro previo del protocolo hace imposible la selección sesgada. Un protocolo publicado antes de iniciar el análisis es un ancla que impide que las conclusiones deriven hacia el resultado deseado.

🧾 Tercer argumento: la evaluación del riesgo de sesgo como protección contra datos basura

Para ensayos controlados aleatorizados, la herramienta revisada Cochrane Risk of Bias (RoB-2) es ampliamente reconocida como estándar (S010). La herramienta de Cochrane Collaboration para evaluar el riesgo de sesgo en estudios aleatorizados proporciona una evaluación estructurada de la calidad metodológica (S009).

Sin esta evaluación, una revisión sistemática puede combinar ensayos clínicos aleatorizados de alta calidad con estudios donde la aleatorización fue violada, el cegamiento estuvo ausente y los datos se reportaron selectivamente.

🔁 Cuarto argumento: la cuantificación de la heterogeneidad previene promedios sin sentido

La cuantificación de la heterogeneidad en metaanálisis (S009) permite determinar cuánto difieren entre sí los resultados de los estudios incluidos. Combinar datos de estudios con alta heterogeneidad sin analizarla es un error estadístico equivalente a promediar la temperatura de los pacientes en un hospital: se obtendrá un número, pero carecerá de sentido.

- Calcular I²: la proporción de variación explicada por heterogeneidad, no por azar

- Si I² > 75%, la heterogeneidad es alta y se requiere análisis de las fuentes de diferencias

- Si la heterogeneidad es inexplicable, combinar datos es inadmisible

- Usar modelo de efectos aleatorios en lugar de fijos si hay heterogeneidad presente

🧬 Quinto argumento: evaluación crítica de la calidad de estudios no aleatorizados

La evaluación crítica de la escala Newcastle-Ottawa para valorar la calidad de estudios no aleatorizados en metaanálisis (S009) muestra que incluso las herramientas ampliamente utilizadas tienen limitaciones. Sin embargo, la ausencia de cualquier evaluación de calidad de estudios observacionales hace inútil una revisión sistemática.

Es imposible distinguir un estudio de cohortes bien conducido de un análisis retrospectivo con múltiples fuentes de sesgo sin una evaluación estructurada.

🧰 Sexto argumento: la solidez de una revisión sistemática está directamente vinculada a la calidad de los estudios incluidos

Aunque algunos temas pueden contar con numerosos ensayos controlados aleatorizados de alta calidad, otros pueden estar limitados a series de casos u otros diseños de investigación con niveles de evidencia más bajos (S010). La solidez de una revisión sistemática está directamente vinculada a la calidad de los estudios incluidos (S010).

Una revisión sistemática de estudios de baja calidad sigue siendo evidencia de baja calidad. La metodología no puede convertir basura en oro: solo puede mostrar honestamente que lo que tenemos delante es basura.

🛡️ Séptimo argumento: protección contra el sesgo de publicación

Los estudios con resultados positivos se publican con mayor frecuencia que aquellos con resultados negativos o nulos. Sin una búsqueda sistemática de datos no publicados, registros de ensayos clínicos y literatura gris, un metaanálisis sobreestimará sistemáticamente el efecto de la intervención.

No es un problema teórico: en algunas áreas de la medicina, el sesgo de publicación cambia completamente las conclusiones sobre la eficacia del tratamiento. La búsqueda debe incluir bases de datos de ensayos clínicos, tesis doctorales, actas de congresos y contacto directo con los autores.

Anatomía paso a paso de una revisión sistemática de calidad: qué debe incluir y qué casi nunca está presente

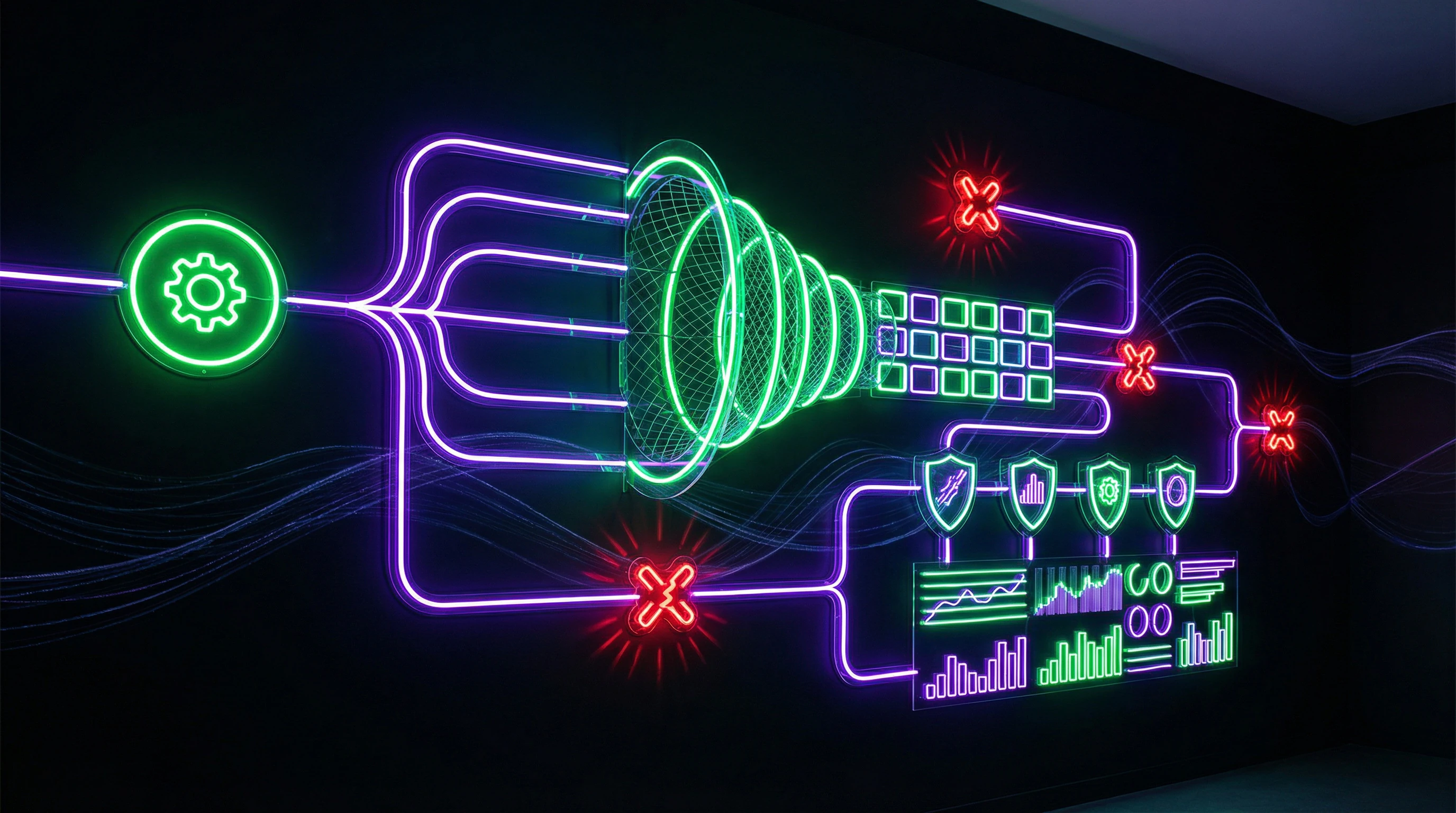

Una revisión sistemática no es simplemente una recopilación de artículos. Es un protocolo con siete etapas críticas, cada una con requisitos claros y puntos de fallo (S010).

La mayoría de las "revisiones sistemáticas" publicadas omiten o simplifican al menos tres de ellas. Resultado: conclusiones que parecen evidencia, pero no lo son. Más detalles en la sección Alfabetización mediática.

📌 Etapa primera: formulación de la pregunta de investigación y registro previo del protocolo

La pregunta de investigación debe ser específica y claramente definida (S010). El formato PICO (Población, Intervención, Comparación, Resultado) estructura la pregunta clínica de modo que los criterios de inclusión sean objetivos y no ajustados al resultado deseado.

El protocolo debe registrarse en PROSPERO antes de iniciar la búsqueda bibliográfica. Esto imposibilita cambiar los criterios de inclusión después de que los investigadores hayan visto los resultados — el principal mecanismo de p-hacking a nivel de revisiones sistemáticas.

🔬 Etapa segunda: estrategia de búsqueda sistemática en múltiples bases de datos

La búsqueda abarca al menos tres grandes bases (PubMed, Embase, Cochrane Library), más literatura gris, registros de ensayos clínicos, búsqueda manual en listas de referencias de artículos clave. La estrategia debe ser reproducible — otro investigador obtendrá los mismos resultados con los mismos términos de búsqueda y filtros.

Si la búsqueda se limita a una sola base o idioma de publicación, ya existe sesgo de selección sistemático.

🧾 Etapa tercera: cribado independiente por dos revisores

Dos revisores evalúan independientemente cada estudio según los criterios de inclusión. Cualquier incertidumbre se incluye en el cribado de texto completo para evitar exclusiones prematuras (S010).

Los conflictos se resuelven mediante discusión, consenso o un tercer revisor. Este requisito protege contra la subjetividad — un revisor puede pasar por alto un estudio relevante o interpretar incorrectamente los criterios.

🧪 Etapa cuarta: extracción estructurada de datos usando formularios predefinidos

El formulario de extracción se desarrolla y prueba antes de iniciar el trabajo. Incluye todas las variables para el análisis más información para evaluar el riesgo de sesgo. La extracción la realizan independientemente dos revisores con posterior comparación y resolución de discrepancias.

- Por qué es crítico

- Si el formulario se diseña después de revisar varios artículos, el investigador ya sabe qué datos "confirman" su hipótesis. El formulario predefinido bloquea esta trampa.

- Dónde falla en la práctica

- Un revisor extrae datos, el segundo verifica selectivamente. O el formulario contiene campos abiertos que permiten interpretar los mismos datos de manera diferente.

🔁 Etapa quinta: evaluación del riesgo de sesgo usando herramientas validadas

Para ensayos controlados aleatorizados se usa RoB-2, para estudios observacionales — Newcastle-Ottawa Scale o ROBINS-I (S010). La evaluación la realizan independientemente dos revisores y se documenta.

Los resultados se presentan en tablas y gráficos que muestran la distribución de riesgos por dominios. Esto permite al lector ver qué estudios tienen alto riesgo de sesgo y por qué.

📊 Etapa sexta: síntesis estadística con evaluación de heterogeneidad

Si los datos permiten realizar un metaanálisis, es necesario elegir el modelo (efectos fijos o aleatorios) basándose en la heterogeneidad esperada. Luego calcular la estimación combinada del efecto con intervalos de confianza.

- Evaluar heterogeneidad (I², τ², estadística Q)

- Realizar análisis de sensibilidad — excluir estudios con alto riesgo de sesgo y recalcular resultados

- Evaluar sesgo de publicación sistemático (gráficos de embudo, pruebas de Egger/Begg)

- Realizar análisis de subgrupos si está previsto en el protocolo

🧬 Etapa séptima: evaluación de la certeza de la evidencia (GRADE)

El sistema GRADE evalúa la calidad de la evidencia en cuatro niveles: alta, moderada, baja, muy baja (S010). La evaluación considera riesgo de sesgo, inconsistencia de resultados, evidencia indirecta, imprecisión de estimaciones, sesgo de publicación sistemático.

Alta calidad de evidencia no significa que el efecto sea grande o clínicamente significativo. Significa que investigaciones futuras difícilmente cambiarán la estimación del efecto. Baja calidad significa que el siguiente estudio podría cambiar completamente las conclusiones.

La relación entre rigor metodológico y fiabilidad de conclusiones es directa. Cada etapa omitida es una puerta abierta al sesgo sistemático. Más sobre los mecanismos cognitivos que llevan a los investigadores a ignorar estos requisitos en el conjunto de herramientas de pensamiento crítico.

Anatomía cognitiva de las revisiones pseudosistemáticas: qué trampas mentales llevan a los investigadores a ignorar la metodología

Los mecanismos psicológicos que conducen a la creación de revisiones sistemáticas de baja calidad operan de forma automática e imperceptible. Su identificación es el primer paso para la prevención. Más información en la sección Energía del ADN y mecánica cuántica.

🧩 Sesgo de confirmación: por qué los investigadores solo ven lo que quieren ver

El sesgo cognitivo de confirmación lleva a los investigadores a centrarse desproporcionadamente en estudios que confirman su hipótesis e ignorar datos contradictorios. Sin una búsqueda sistemática y criterios de inclusión predefinidos, este sesgo opera automáticamente.

Un investigador que busca evidencia de la eficacia de un método encuentra tres estudios confirmatorios y se detiene. Una búsqueda sistemática habría identificado otros veinte, la mitad de los cuales muestra ausencia de efecto.

🕳️ Ilusión de validez: cuando la cantidad de estudios crea una falsa sensación de fiabilidad

Reunir un gran número de estudios genera una sensación psicológica de fiabilidad de las conclusiones, incluso si todos esos estudios son de baja calidad. Un metaanálisis de 50 estudios mal realizados sigue siendo basura sistematizada.

- Trampa de la cantidad

- El número de estudios en una revisión no se correlaciona con la calidad de la conclusión. El criterio es el rigor metodológico de cada estudio incluido y la transparencia del proceso de selección.

- Dónde se manifiesta

- Las revisiones que presumen de "análisis de más de 200 estudios" a menudo ocultan la ausencia de criterios de exclusión y una selección sesgada.

🧠 Efecto ancla: cómo los primeros estudios encontrados determinan la dirección de toda la revisión

Los investigadores que comienzan con una búsqueda no sistemática se "anclan" en los primeros estudios encontrados y luego buscan datos confirmatorios. Una búsqueda sistemática con estrategia predeterminada neutraliza este efecto.

La conexión con las herramientas de pensamiento aquí es directa: el ancla es una herramienta cognitiva que debe reconocerse y controlarse mediante protocolo, no confiando en la intuición del investigador.

⚙️ Falacia de planificación: por qué los investigadores subestiman el tiempo y los recursos

Una revisión sistemática de calidad requiere cientos de horas de trabajo de un equipo de al menos tres personas. Los investigadores subestiman sistemáticamente estos requisitos y eligen enfoques "simplificados" que destruyen el rigor metodológico.

- Búsqueda bibliográfica en más de 5 bases de datos (no en Google Scholar)

- Evaluación independiente de cada estudio por dos revisores

- Documentación de las razones de exclusión de cada estudio

- Evaluación del riesgo de sesgo mediante herramientas estandarizadas

- Análisis de heterogeneidad antes de combinar datos

El resultado de omitir estos pasos son publicaciones que se denominan revisiones sistemáticas, pero que en realidad son revisiones selectivas de la literatura. La diferencia entre ellas no es una cuestión de terminología, sino de fiabilidad de las conclusiones.

Análisis de la base de evidencia: qué dicen los datos sobre la calidad de las revisiones sistemáticas modernas

El análisis de las revisiones sistemáticas publicadas muestra problemas sistémicos con la calidad metodológica en la mayoría de áreas de la medicina y la ciencia. Más detalles en la sección Miedos en torno al 5G.

📊 Datos empíricos sobre la frecuencia de violaciones metodológicas

Los estudios que evalúan la calidad de las revisiones sistemáticas publicadas encuentran consistentemente que una proporción significativa de publicaciones no cumple con los requisitos metodológicos básicos.

Ausencia de registro previo del protocolo, búsqueda incompleta de literatura, falta de evaluación independiente por dos revisores, ausencia de evaluación del riesgo de sesgo: estas violaciones ocurren en el 40–70% de las "revisiones sistemáticas" publicadas dependiendo del área.

El defecto metodológico en la mayoría de casos no es resultado del desconocimiento, sino consecuencia del ahorro de tiempo y recursos. El investigador sabe lo que debe hacer, pero elige el atajo.

🔬 Ejemplos específicos de farmacogenética: variabilidad en la dosificación de warfarina

La revisión sistemática y metaanálisis de la influencia del genotipo CYP2C9 en los requerimientos de dosis de warfarina (S003) demuestra metodología correcta: búsqueda sistemática en múltiples bases de datos, uso de software validado para metaanálisis, inclusión de estudio aleatorizado de dosificación de warfarina orientada por genotipo, análisis de heterogeneidad entre estudios.

Este ejemplo muestra que existen revisiones de calidad. La cuestión no es la imposibilidad, sino la prevalencia.

🧾 Datos de gastroenterología: pérdida de respuesta a terapia anti-TNFα

La revisión sistemática con metaanálisis de pérdida de respuesta y necesidad de intensificación de dosis anti-TNFα en enfermedad de Crohn (S009) sigue estándares metodológicos estrictos: uso de la declaración PRISMA (elementos preferidos de reporte para revisiones sistemáticas y metaanálisis), aplicación de la herramienta Cochrane Collaboration para evaluación del riesgo de sesgo, evaluación cuantitativa de heterogeneidad.

El estudio analiza datos de grandes ECA, incluyendo ACCENT I (terapia de mantenimiento con infliximab) y CHARM (adalimumab para mantenimiento de respuesta clínica y remisión).

- Registro previo del protocolo en PROSPERO

- Búsqueda en mínimo 3 bases de datos (MEDLINE, Embase, Cochrane)

- Evaluación independiente de calidad por dos revisores

- Evaluación formal del riesgo de sesgo según Cochrane

- Análisis de heterogeneidad (estadística I²)

🧬 Datos mecanísticos: relación entre niveles del fármaco y respuesta clínica

El nivel sérico mínimo postinducción de infliximab y la reducción del nivel de proteína C reactiva están relacionados con respuesta sostenida a largo plazo al infliximab: análisis retrospectivo del estudio ACCENT I (S009).

La proteína C reactiva es un indicador del nivel sérico de infliximab en la predicción de pérdida de respuesta en pacientes con enfermedad de Crohn. Estos datos muestran que las revisiones sistemáticas de calidad no solo combinan datos, sino que también analizan conexiones mecanísticas entre biomarcadores y resultados clínicos.

La diferencia entre revisión y metaanálisis se manifiesta precisamente aquí: la revisión puede identificar un patrón, el metaanálisis cuantificarlo, pero solo la revisión de calidad comprenderá por qué existe.

🔁 Análisis de velocidad y magnitud de respuesta de inducción

La respuesta y remisión a los 18 meses de terapia con certolizumab pegol en pacientes con enfermedad de Crohn activa no dependen de la velocidad y magnitud de la inducción: análisis de PRECISE 2 y 3 (S009).

Este tipo de análisis solo es posible en el marco de una revisión sistemática de calidad que incluye extracción detallada de datos sobre parámetros temporales de respuesta al tratamiento. Esto requiere no solo recopilar cifras, sino comprender la lógica clínica de los estudios.

Relaciones causales versus correlaciones: por qué la mayoría de los metaanálisis no pueden distinguir estos conceptos

Uno de los problemas fundamentales de las revisiones sistemáticas modernas es la incapacidad de distinguir entre relaciones causales y simples correlaciones, especialmente al combinar estudios observacionales.

🔬 El problema de los factores de confusión en estudios observacionales

Incluso un metaanálisis de calidad de estudios observacionales no puede eliminar los sesgos sistemáticos inherentes a los estudios incluidos. Si todos los estudios de cohortes en un metaanálisis no controlaron un factor de confusión importante, la estimación combinada estará sistemáticamente sesgada.

Las herramientas de evaluación de calidad (por ejemplo, Newcastle-Ottawa) miden el rigor metodológico, pero no pueden compensar la falta de control de variables críticas en los datos originales.

🧬 Plausibilidad biológica como condición necesaria pero insuficiente

La existencia de un mecanismo biológicamente plausible no demuestra una relación causal. Las revisiones sistemáticas deben discutir explícitamente qué criterios de causalidad se cumplen para las asociaciones observadas.

- Criterios de Bradford Hill para causalidad:

- Fuerza de la asociación — magnitud del efecto y significación estadística

- Consistencia — reproducibilidad en diferentes poblaciones y condiciones

- Especificidad — la causa produce un efecto concreto, no múltiples resultados

- Secuencia temporal — la causa precede al efecto

- Gradiente biológico — relación dosis-respuesta

- Coherencia — concordancia con hechos conocidos

- Evidencia experimental — estudios controlados confirman el mecanismo

📊 Heterogeneidad como indicador de moderadores ocultos

Una alta heterogeneidad estadística (I² > 75%) indica la presencia de moderadores del efecto no considerados. En lugar de simplemente señalar la alta heterogeneidad, una revisión sistemática de calidad debe realizar análisis de subgrupos y metarregresión para identificar las fuentes de variabilidad.

- Calcular I² y el estadístico Q para evaluar la heterogeneidad

- Realizar análisis de subgrupos según características clave (edad, sexo, duración de la intervención)

- Ejecutar metarregresión para identificar moderadores continuos

- Discutir qué variables no medidas pueden explicar la variabilidad restante

- Indicar si la heterogeneidad identificada reduce la confianza en las conclusiones

🧾 Secuencia temporal en datos longitudinales

Para establecer una relación causal es necesario demostrar que la supuesta causa precede al efecto en el tiempo. Los metaanálisis de estudios transversales no pueden establecer la secuencia temporal, lo que limita las conclusiones causales.

Las revisiones sistemáticas deben indicar explícitamente estas limitaciones en lugar de hacer afirmaciones causales basadas en datos correlacionales. La separación de estudios por diseño (ensayos controlados aleatorizados, cohortes, transversales) y el análisis independiente de cada grupo es el estándar mínimo para una interpretación honesta.

Conflictos e incertidumbres: dónde difieren las fuentes y por qué es crítico para la interpretación

Una revisión sistemática de calidad no oculta las discrepancias entre estudios, sino que las convierte en elemento central del análisis.

🧩 Discrepancias en la evaluación del riesgo de sesgo entre revisores

Cualquier conflicto en la fase de evaluación de calidad se resuelve mediante discusión y consenso entre dos revisores o un tercer árbitro (S010). Sin embargo, la revisión sistemática debe informar sobre la frecuencia y tipos de discrepancias: una alta frecuencia indica criterios de evaluación poco claros o subjetividad del instrumento.

Silenciar los desacuerdos entre revisores es ocultar una vulnerabilidad metodológica. La transparencia sobre los conflictos aumenta la confianza en las conclusiones.

Cuando los revisores difieren en la evaluación de un mismo estudio, es una señal: o los criterios son imprecisos, o el instrumento requiere revisión. Documentar estos casos es parte de una metodología honesta.

🔬 Resultados contradictorios entre ECA y estudios observacionales

Los ensayos controlados aleatorizados y los estudios observacionales a menudo arrojan conclusiones opuestas. Esto indica errores sistemáticos en los datos observacionales (confusión, selección) o diferencias reales en poblaciones e intervenciones.

Una revisión de calidad realiza análisis separados por diseño de estudio y discute las causas de las discrepancias, en lugar de promediarlas en una sola cifra. Esto requiere análisis crítico de mecanismos, no combinación mecánica de datos.

📊 Inconsistencia entre comparaciones directas e indirectas

En metaanálisis en red, la comparación directa (A vs B en un estudio) puede diferir de la indirecta (A vs C y C vs B, de donde inferimos A vs B). Grandes discrepancias indican violación del supuesto de transitividad o diferencias ocultas en las poblaciones.

- Verificar si coinciden las características de pacientes en comparaciones directas e indirectas

- Evaluar si difieren dosis, duración o tipos de intervenciones

- Realizar análisis de sensibilidad excluyendo estudios con mayor discrepancia

- Discutir si la discrepancia puede explicarse por diferencias clínicamente significativas

Si las discrepancias permanecen inexplicadas, esto es una limitación, no un motivo para ignorar el problema.