Trampas cognitivas y falacias lógicas: donde termina la heurística y comienza la catástrofe

El término «sesgo cognitivo» (cognitive bias) describe desviaciones sistemáticas en el procesamiento de información, originadas por limitaciones en la arquitectura cerebral. Las falacias lógicas (logical fallacies) son violaciones de las reglas formales de inferencia que invalidan un argumento independientemente de la veracidad de las premisas. Más información en la sección Errores mentales.

La frontera entre ambos es difusa: el sesgo de confirmación (confirmation bias) impulsa a buscar únicamente datos que respalden nuestras creencias, y luego la falacia lógica «post hoc ergo propter hoc» transforma correlación en causalidad.

🧩 Tres niveles de fallo: percepción, inferencia, acción

Las trampas cognitivas operan en tres niveles de la toma de decisiones.

- Nivel de percepción

- La heurística de disponibilidad (availability heuristic) lleva a sobreestimar la probabilidad de eventos fáciles de recordar: los accidentes aéreos parecen frecuentes porque tienen alta visibilidad mediática, aunque estadísticamente son raros.

- Nivel de inferencia

- La falacia de la tasa base (base rate fallacy) ignora las probabilidades a priori: un médico ve un test positivo para una enfermedad rara y establece el diagnóstico, olvidando que con baja prevalencia la mayoría de los positivos son falsos (S005).

- Nivel de acción

- La escalada de compromiso (sunk cost fallacy) impulsa a continuar un proyecto fallido porque «ya se ha invertido tanto».

🔎 Por qué las decisiones rápidas son campo de batalla entre el sistema 1 y el sistema 2

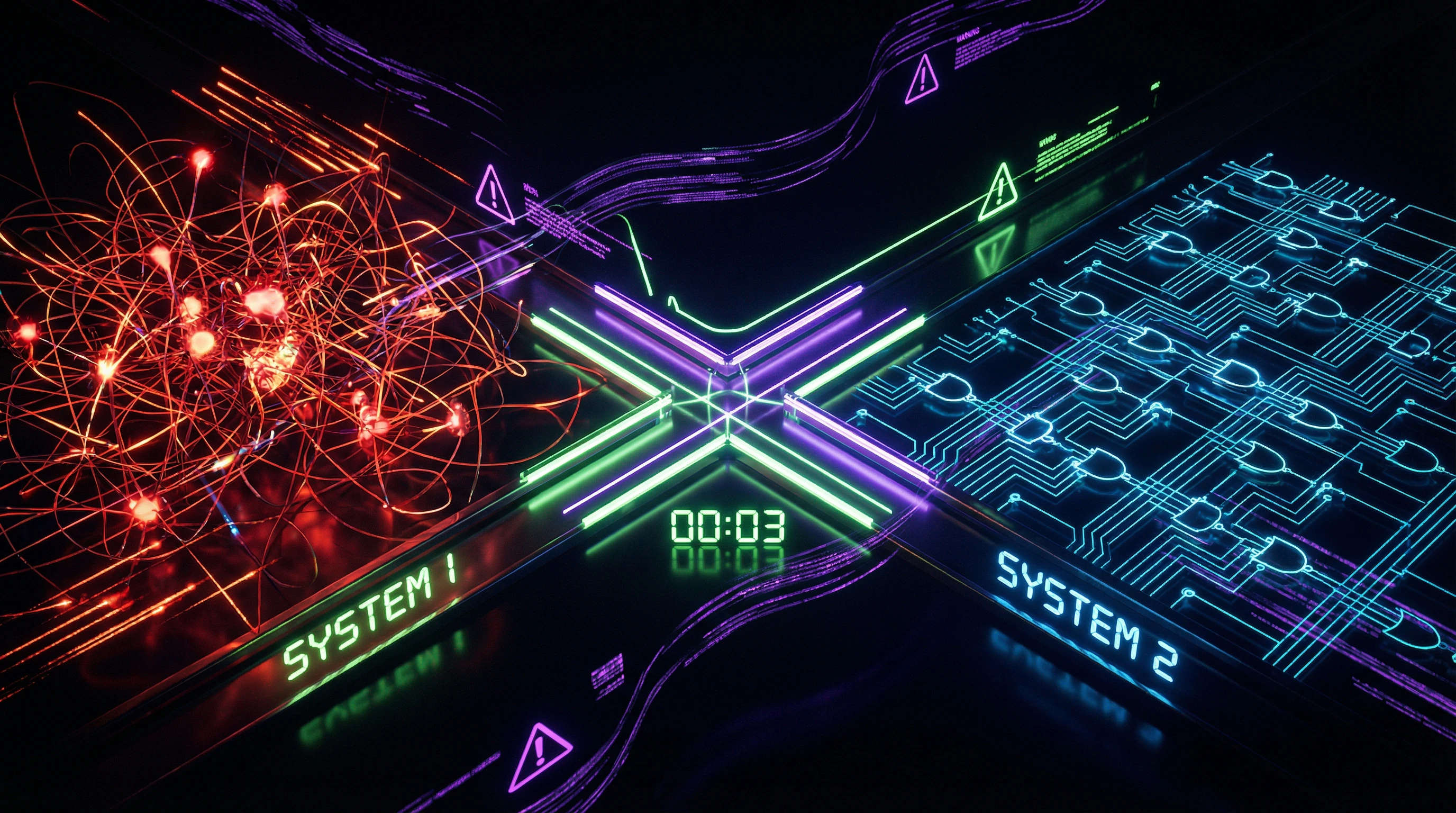

Daniel Kahneman dividió el pensamiento en dos sistemas: Sistema 1 (rápido, automático, emocional) y Sistema 2 (lento, analítico, demandante de energía). Bajo presión temporal el Sistema 2 se desactiva: el cerebro economiza glucosa.

Las negociaciones diplomáticas, donde cada segundo de silencio se interpreta como señal, se convierten en campo de pruebas para trampas: el efecto ancla (anchoring) determina todo el rango de negociación, y el error fundamental de atribución (fundamental attribution error) atribuye la rigidez del oponente a su carácter, no a la presión situacional (S001).

⚙️ Heurísticas como arma: cuando la simplificación se convierte en manipulación

La heurística de representatividad (representativeness heuristic) lleva a juzgar la probabilidad por similitud con un prototipo: «Parece programador, entonces probablemente lo sea», ignorando que hay más bibliotecarios en la población.

| Heurística | Mecanismo | Campo de manipulación |

|---|---|---|

| Representatividad | Juzgar por similitud con prototipo | Estereotipos en publicidad y contratación |

| Afecto | Vincular evaluación de riesgo con carga emocional | Imagen positiva evita análisis (energía verde, nuevas tecnologías) |

En marketing, la heurística de representatividad se transforma en estereotipización: las imágenes publicitarias explotan prototipos para eludir el pensamiento analítico. La heurística del afecto vincula la evaluación de riesgo con la carga emocional: tecnologías con imagen positiva se perciben como seguras, incluso si los datos son ambiguos.

Más información sobre cómo identificar estos errores en el manual de falacias lógicas.

La versión de acero del argumento: por qué las trampas cognitivas no son un error, sino una adaptación

Antes de analizar los errores, es necesario reconocer: las heurísticas existen porque funcionan. En condiciones de incertidumbre y recursos limitados (tiempo, información, capacidad computacional del cerebro) proporcionan soluciones "suficientemente buenas" con un coste mínimo. Más detalles en la sección Debunking y prebunking.

La crítica debe considerar la racionalidad ecológica: la correspondencia entre estrategia y entorno. Esto no es una justificación, sino un contexto.

- Las heurísticas triunfan en condiciones de alta incertidumbre y ruido

- Las heurísticas sociales coordinan acciones colectivas

- La economía cognitiva es una ventaja evolutiva

- Los errores lógicos pueden ser retóricamente efectivos

- La especificidad contextual hace que la crítica universal carezca de sentido

- El modelo cuántico de decisiones explica la "irracionalidad" como racionalidad de otro orden

- Las consultas reducen errores mediante el aumento de información mutua

Las heurísticas triunfan en condiciones de alta incertidumbre y ruido

Las heurísticas simples (por ejemplo, "elige lo reconocible") a menudo superan a los modelos estadísticos complejos en tareas reales con datos ruidosos. Los modelos complejos se sobreajustan al ruido, mientras que las heurísticas lo ignoran.

En medicina, el diagnóstico rápido por patrones salva vidas cuando no hay tiempo para un análisis completo: un médico experimentado "ve" un infarto por el conjunto de signos implícitos más rápido que un algoritmo procesa un ECG (S005).

Las heurísticas sociales coordinan acciones colectivas

La heurística "haz lo que hace la mayoría" parece conformismo, pero resuelve el problema de coordinación sin gestión centralizada. En condiciones de pánico (incendio, atentado) seguir a la multitud puede ser la estrategia óptima: no tienes tiempo para analizar planos de evacuación.

El comportamiento colectivo agrega información distribuida. El problema surge cuando el entorno cambia más rápido que la heurística se adapta: la multitud corre hacia una salida bloqueada porque "todos corren hacia allí".

La economía cognitiva es una ventaja evolutiva

El cerebro consume el 20% de la energía del cuerpo con solo el 2% de su masa. El pensamiento analítico es energéticamente costoso: no puede mantenerse activado constantemente.

Las heurísticas son una caché que permite tomar miles de microdecisiones al día (qué ponerse, qué ruta elegir, en quién confiar) sin quemar glucosa. Criticar las heurísticas sin considerar esta limitación es como criticar la caché de un procesador por no almacenar toda la base de datos.

Los errores lógicos pueden ser retóricamente efectivos

El argumentum ad populum es formalmente erróneo, pero socialmente persuasivo: apela a la necesidad de pertenencia. En diplomacia y política, la fuerza retórica del argumento es más importante que su validez lógica (S001).

La falacia de la "pendiente resbaladiza" puede estar justificada si existen mecanismos de escalada: por ejemplo, el primer compromiso realmente crea un precedente para los siguientes. El objetivo de la retórica no es demostrar la verdad, sino inclinar a la audiencia hacia la acción.

La especificidad contextual hace que la crítica universal carezca de sentido

Lo que es un error en un área puede ser la norma en otra. En ciencia, post hoc ergo propter hoc es un error grave, pero en diagnóstico médico la secuencia temporal de síntomas es un signo diagnóstico clave.

- Efecto Dunning-Kruger

- La sobreestimación de competencia por parte de principiantes se critica en ciencia, pero en la cultura startup la "autoconfianza ingenua" puede ser una ventaja: permite iniciar un proyecto que un experto habría rechazado como poco realista.

- Errores lógicos en el discurso

- Las personas inteligentes creen en tonterías no porque sean tontas, sino porque el contexto y la retórica redefinen la lógica. Más detalles en errores lógicos en el discurso.

El modelo cuántico de decisiones explica la "irracionalidad" como racionalidad de otro orden

La teoría clásica de toma de decisiones predice que las personas maximizan la utilidad esperada. Pero los experimentos muestran violaciones sistemáticas: el efecto de orden, donde la secuencia de preguntas cambia las respuestas, y el efecto de disyunción, donde conocer el resultado cambia las preferencias de forma ilógica.

El modelo cuántico de agentes sociales explica esto mediante la superposición de estados y la interferencia de probabilidades (S003). Las decisiones no están determinadas hasta el momento de la "medición" (pregunta), y el contexto colapsa la función de onda de las preferencias. Esto no es un error, sino otra matemática.

Las consultas reducen errores mediante el aumento de información mutua

Las paradojas de la teoría clásica de decisiones (por ejemplo, la paradoja de Ellsberg, donde las personas prefieren probabilidades conocidas a desconocidas) se debilitan cuando los agentes se consultan entre sí. El intercambio de información aumenta la información mutua entre agentes, lo que reduce la entropía de las decisiones y disminuye la influencia de los sesgos cognitivos (S003).

Las decisiones colectivas suelen ser más precisas que las individuales, no por la "sabiduría de las masas", sino porque la interferencia informacional cancela las fluctuaciones aleatorias.

Esto explica por qué los errores lógicos son menos peligrosos en sistemas abiertos donde es posible el diálogo y la verificación cruzada. El aislamiento amplifica las distorsiones; la conectividad las neutraliza.

Base empírica: qué dicen las investigaciones de 2025 sobre los mecanismos de las trampas cognitivas

Los datos empíricos sobre sesgos cognitivos se acumulan desde los años 70, pero solo en los últimos años han surgido modelos que explican por qué la teoría clásica de la racionalidad falla sistemáticamente. El cambio clave: pasar de describir errores a comprender sus mecanismos. Más información en la sección Pensamiento crítico.

Teoría cuántica de decisiones: por qué el modelo clásico es paradójico

La teoría clásica de la utilidad esperada asume que las preferencias son estables e independientes del orden de las preguntas. Los experimentos muestran lo contrario: si primero se pregunta "¿Eres feliz en tu matrimonio?" y luego "¿Qué tan feliz eres en general?", la correlación entre respuestas es alta. Si se invierte el orden, la correlación cae.

Este es el efecto de orden (order effect), inexplicable en el modelo clásico (S003). El modelo cuántico de decisiones introduce la no conmutatividad: medir un parámetro cambia el estado del sistema, afectando la medición del otro. Matemáticamente se describe mediante operadores de proyección en espacio de Hilbert, las mismas ecuaciones que en mecánica cuántica (S003).

El orden de las preguntas no es un simple artefacto del cuestionario. Es una propiedad fundamental: medir un aspecto reconfigura el estado mental para el siguiente.

Paradoja de Ellsberg e incertidumbre: por qué evitamos probabilidades desconocidas

En la paradoja de Ellsberg se presentan dos urnas: la primera con 50 bolas rojas y 50 negras (distribución conocida), la segunda con 100 bolas de proporción desconocida. La mayoría prefiere apostar por la primera urna, incluso con ganancias idénticas, violando el axioma de independencia de la teoría clásica.

El modelo cuántico lo explica mediante entropía: la incertidumbre de la segunda urna aumenta la entropía de la decisión, percibida como riesgo. Cuando los agentes se consultan, el intercambio de información reduce la entropía y la preferencia por la primera urna se debilita (S003). Las decisiones grupales muestran menor sensibilidad a la paradoja de Ellsberg.

Especificidad contextual en diagnóstico médico: cuando las heurísticas matan

La investigación sobre razonamiento clínico mostró que factores contextuales (hora del día, fatiga del médico, orden de llegada de pacientes) influyen sistemáticamente en la precisión diagnóstica (S005). El efecto de disponibilidad lleva al médico a diagnosticar lo que vio recientemente.

Si por la mañana hubo tres casos de neumonía, el cuarto paciente con tos recibirá el mismo diagnóstico, aunque los síntomas difieran. El error de tasa base es especialmente peligroso con enfermedades raras: una prueba con sensibilidad del 99% y especificidad del 99% para una enfermedad con prevalencia del 0,1% genera 90% de falsos positivos, pero los médicos lo ignoran, enfocándose en la "precisión del 99%" (S005).

- Efecto de disponibilidad

- Un caso visto recientemente se convierte en ancla para interpretar nuevos datos. Mecanismo: las redes neuronales activadas permanecen excitadas, reduciendo el umbral de activación para patrones similares.

- Error de tasa base

- Ignorar la probabilidad inicial del evento en favor de la especificidad de la prueba. Peligroso en medicina: enfermedad rara + prueba precisa = mayoría de resultados positivos son falsos.

Fracasos diplomáticos: cómo las trampas cognitivas destruyen negociaciones

El análisis de casos diplomáticos reveló trampas típicas: efecto ancla (la primera oferta define el rango de negociación), error de atribución (la rigidez del oponente se atribuye al carácter, no a la situación), escalada de compromisos (S001). La crisis de los misiles de 1962: ambas partes interpretaron las acciones del otro bajo el prisma de intenciones hostiles, ignorando la presión situacional.

Solo la comunicación directa (línea directa Kennedy-Jrushchov) redujo la entropía informacional y permitió evitar la escalada.

Evidence-based management: por qué la hiperracionalidad también es una trampa

La crítica al evidence-based management muestra una paradoja: exigir pruebas rigurosas para cada decisión puede paralizar la acción (S002). En condiciones de incertidumbre (startup en nicho nuevo) simplemente no hay datos; esperarlos significa perder la ventana de oportunidad.

El EBM funciona en entornos estables (medicina, ingeniería), pero en contextos cambiantes (negocio tecnológico, geopolítica) las heurísticas y la intuición experta pueden ser más efectivas. El error no está en usar heurísticas, sino en la incapacidad de alternar entre modos de pensamiento según el contexto (S002).

La hiperracionalidad bajo incertidumbre no es virtud, es parálisis. Las heurísticas existen porque funcionan en tiempo real.

Sistemas automatizados de decisión: nuevas trampas de viejos errores

Los sistemas automatizados de decisión heredan los sesgos cognitivos de sus creadores a través de datos y algoritmos. Si la muestra de entrenamiento contiene prejuicios históricos (por ejemplo, un algoritmo de contratación entrenado con datos donde el 90% de candidatos exitosos son hombres), el sistema reproducirá la discriminación.

El sesgo de confirmación se codifica en la elección de métricas: si se optimiza la precisión ignorando falsos negativos, el sistema omitirá casos raros pero críticos. El ethics-based auditing propone verificación estructurada de conformidad con normas éticas, pero es un mecanismo "blando": la tarea principal de los auditores no es castigar, sino estimular la reflexión ética en etapas clave del desarrollo.

Más sobre errores lógicos codificados en algoritmos en errores lógicos: aprendemos a identificar sofismas y correlación no es causalidad.

Mecanismos de sabotaje: cómo los atajos mentales convierten la velocidad en vulnerabilidad

Comprender el mecanismo es la clave para la protección. Las trampas cognitivas no funcionan al azar: explotan características arquitectónicas del cerebro, prioridades evolutivas e instintos sociales. Más detalles en la sección Estadística y teoría de probabilidades.

El análisis de las cadenas causales muestra dónde exactamente se quiebra la racionalidad.

🔁 Efecto de disponibilidad: por qué los eventos mediáticos distorsionan la evaluación de riesgos

La heurística de disponibilidad evalúa la probabilidad de un evento según la facilidad con que los ejemplos vienen a la mente. Los eventos vívidos y emocionalmente cargados (atentados, accidentes aéreos, ataques de tiburones) se recuerdan mejor y se activan más rápido que los estadísticamente frecuentes pero aburridos (enfermedades cardiovasculares, accidentes de tráfico).

Los medios amplifican el efecto: la cobertura de eventos raros pero dramáticos crea una ilusión de frecuencia. La gente teme volar, pero no teme conducir, aunque el riesgo de morir en un accidente de tráfico es órdenes de magnitud mayor.

En los negocios esto lleva a sobrevalorar los "cisnes negros" y subestimar los riesgos rutinarios — la estrategia se enfoca en amenazas visibles, ignorando las sistémicas.

🧷 Efecto ancla: cómo el primer número captura todo el rango de negociación

El anchoring effect funciona mediante priming: el primer número que escuchas (incluso si es aleatorio) se convierte en el punto de referencia para todas las evaluaciones posteriores.

Experimento clásico: se hacía girar una ruleta a los participantes (número aleatorio de 0 a 100), y luego se les pedía estimar la proporción de países africanos en la ONU. Quienes obtuvieron 10 dieron una estimación de ~25%, quienes obtuvieron 65 — ~45%. La ruleta no tenía relación con la pregunta, pero el ancla funcionó.

- En negociaciones

- La primera oferta determina el rango de regateo. Si el vendedor menciona un precio de 100.000€, el acuerdo final estará más cerca de esa cifra que si hubiera comenzado con 50.000€.

- Protección

- Hacer la primera oferta uno mismo o rechazar explícitamente el ancla: «Esa cifra no es relevante, comencemos con un análisis del mercado».

🧩 Error de tasa base: por qué los médicos hacen diagnósticos incorrectos con pruebas precisas

La base rate fallacy ignora la probabilidad a priori (tasa base) y se enfoca en información específica. Una prueba para una enfermedad rara (prevalencia 0.1%) con sensibilidad del 99% y especificidad del 99% da resultado positivo.

Respuesta intuitiva: probabilidad de enfermedad ~99%. Respuesta correcta (teorema de Bayes): ~9% (S005).

| Grupo | Tamaño | Resultado de prueba | Cantidad |

|---|---|---|---|

| Enfermos (0.1%) | 10 de 10.000 | Positivo (99%) | ~10 |

| Sanos (99.9%) | 9.990 de 10.000 | Falso positivo (1%) | ~100 |

| Probabilidad de enfermedad con prueba positiva | 10 / (10+100) ≈ 9% | ||

Los médicos sistemáticamente ignoran la tasa base, enfocándose en la «precisión del 99% de la prueba». Esto lleva a hiperdiagnóstico y tratamiento innecesario.

🔁 Escalada de compromiso: por qué los costes hundidos matan proyectos

La sunk cost fallacy obliga a continuar un proyecto fallido porque «ya se ha invertido tanto». El cerebro percibe el abandono como admisión de error, lo que activa centros de dolor (corteza cingulada anterior).

Racionalmente: los costes hundidos no deben influir en la decisión — solo importan los beneficios y costes futuros. Pero emocionalmente: abandono = pérdida de prestigio, admisión de incompetencia.

En las corporaciones esto se amplifica por el pensamiento grupal: un equipo que ha invertido años en un proyecto no puede admitir el fracaso sin destruir su identidad.

Ejemplo: Concorde — los gobiernos británico y francés continuaron financiando el proyecto deficitario porque detenerlo significaba admitir un error a nivel nacional.

🧬 Error fundamental de atribución: por qué vemos carácter, no situación

El fundamental attribution error sobrevalora el papel de factores personales y subestima los situacionales. Si alguien es grosero, pensamos «es un grosero», no «quizás tiene un día difícil».

Mecanismo: evaluar factores situacionales requiere información adicional y esfuerzo cognitivo, mientras que la atribución al carácter es rápida y automática.

- Observamos comportamiento (posición dura del oponente)

- Rápidamente atribuimos al carácter (hostilidad, agresión)

- Ignoramos factores situacionales (presión política interna, limitaciones)

- Tomamos decisión basada en modelo incompleto (las negociaciones fracasan) (S001)

Protección: modelar explícitamente las restricciones situacionales. Preguntarse: «¿Qué factores pueden obligarlo a actuar así?» — esto cambia la atención del Sistema 1 al Sistema 2.

Más detalles sobre errores lógicos y sus mecanismos — y cómo se integran en el discurso.

Conflictos e incertidumbres: dónde divergen las fuentes y por qué es importante

La honestidad científica exige reconocer: no todas las cuestiones están resueltas. Las fuentes divergen en la evaluación de cuán universales son los sesgos cognitivos, cuán susceptibles son de corrección y en qué contextos las heurísticas están justificadas. Más detalles en la sección Epistemología.

Tres nudos de desacuerdo que determinarán cómo actuarás en adelante.

- Universalidad vs. contextualidad. (S003) sostiene que las heurísticas son una herramienta adaptativa que funciona en la mayoría de escenarios. Pero (S001) demuestra: el razonamiento motivado y los filtros ideológicos son tan poderosos que las reglas "universales" se quiebran bajo la presión de las convicciones. Conclusión: la heurística funciona hasta que se activa la defensa de la identidad.

- Corrección mediante formación vs. inevitabilidad estructural. (S002) propone formas alternativas de evaluación, sugiriendo plasticidad en los procesos cognitivos. Sin embargo, (S004) señala las limitaciones rígidas de la memoria de trabajo: el recurso es finito y ninguna formación lo expandirá físicamente.

- Aprendizaje asociativo vs. proposicional. (S005) redefine el mecanismo: el aprendizaje humano no es meramente asociativo, es proposicional (estructurado lógicamente). Esto significa que las trampas no son solo activaciones automáticas, sino resultado de juicios mal construidos.

Los desacuerdos entre fuentes no son una debilidad de la ciencia, sino un mapa de la realidad. Cada conflicto señala un caso límite donde tu modelo del mundo puede fallar.

Sentido práctico: no busques un truco universal. En su lugar, identifica errores lógicos en tus propios juicios y distingue correlación de causalidad en cada decisión concreta.