❌ Falacias lógicas

❌ Falacias lógicasAnálisis lógico-probabilístico: de Boole a los sistemas modernosλ

Investigación de la unidad fundamental entre lógica y teoría de la probabilidad para el análisis de fiabilidad, seguridad y toma de decisiones bajo incertidumbre

Overview

La lógica y la probabilidad representan dos herramientas fundamentales del conocimiento, unificadas ya en 1854 por George Boole en su obra "Las leyes del pensamiento". El análisis lógico-probabilístico combina el rigor de la deducción con la cuantificación de la incertidumbre, creando un poderoso aparato metodológico para resolver problemas prácticos. Este campo abarca los fundamentos teóricos del álgebra booleana, la lógica probabilística, el análisis de fiabilidad de sistemas complejos y las implementaciones computacionales modernas.

🛡️ Protocolo Laplace: La lógica y la probabilidad no compiten, sino que se complementan — la lógica clásica trabaja con certeza, la lógica probabilística la extiende al dominio de la incertidumbre, manteniendo rigor matemático desde 1854.

Reference Protocol

Base Científica

Marco basado en evidencia para análisis crítico

Navigation Matrix

Subsecciones

[logical-fallacies]

Falacias lógicas

Los sesgos sistemáticos en el razonamiento están presentes en todas partes —desde la investigación científica hasta las decisiones cotidianas— pero se pueden aprender a reconocer y prevenir.

Explorar

[stats-probability]

Estadística y teoría de la probabilidad

Disciplinas matemáticas fundamentales para el análisis de datos, la toma de decisiones y la comprensión de fenómenos aleatorios en ciencia, negocios y vida cotidiana

Explorar

[thinking-tools]

Herramientas de pensamiento

Herramientas visuales y conceptuales que ayudan a estructurar problemas complejos, hacer visible el pensamiento y desarrollar habilidades cognitivas de orden superior en la educación y la práctica profesional

Explorar

Protocol: Evaluation

Ponte a Prueba

Cuestionarios sobre este tema próximamente

Sector L1

Artículos

Materiales de investigación, ensayos y profundizaciones en los mecanismos del pensamiento crítico.

❌ Falacias lógicas

❌ Falacias lógicas ❌ Falacias lógicas

❌ Falacias lógicas ❌ Falacias lógicas

❌ Falacias lógicas ❌ Falacias lógicas

❌ Falacias lógicas 🛠️ Herramientas de pensamiento

🛠️ Herramientas de pensamiento 🛠️ Herramientas de pensamiento

🛠️ Herramientas de pensamiento ❌ Falacias lógicas

❌ Falacias lógicas 📈 Estadística y teoría de la probabilidad

📈 Estadística y teoría de la probabilidad 📈 Estadística y teoría de la probabilidad

📈 Estadística y teoría de la probabilidad ❌ Falacias lógicas

❌ Falacias lógicas ❌ Falacias lógicas

❌ Falacias lógicas⚡

Más Información

Fundamentos históricos: de Boole a Poretsky

Boole 1854: la lógica encuentra la probabilidad

George Boole en «Las leyes del pensamiento» (1854) estableció por primera vez una conexión matemática rigurosa entre las estructuras lógicas y la teoría de probabilidades. El álgebra booleana se convirtió en la base común para ambas disciplinas: las mismas operaciones funcionaban con proposiciones lógicas y eventos probabilísticos.

Esto no fue un ejercicio teórico. Esta unificación sentó las bases para todos los desarrollos posteriores en lógica probabilística durante más de 170 años.

Las operaciones lógicas de conjunción, disyunción y negación tienen análogos directos en la teoría de probabilidades como operaciones sobre eventos. El álgebra booleana proporcionó un lenguaje matemático unificado donde los valores de verdad y las medidas probabilísticas se procesan en un mismo sistema formal.

Esta dualidad permitió desarrollar métodos de análisis cuantitativo de sistemas lógicos bajo incertidumbre.

Poretsky: cálculo clásico de probabilidades

P.S. Poretsky desarrolló el enfoque clásico del cálculo de probabilidades para eventos aleatorios, que sigue siendo un método fundamental en la teoría moderna. Sus trabajos se centraron en algoritmos rigurosos para calcular probabilidades de eventos complejos mediante combinaciones lógicas de eventos elementales.

- Grupo de eventos incompatibles

- Concepto fundamental de Poretsky donde los eventos no pueden ocurrir simultáneamente. Esto garantiza inferencias cuantitativas precisas en sistemas lógicos donde la certeza absoluta es inalcanzable.

El enfoque clásico de Poretsky no fue reemplazado por métodos modernos, sino que se convirtió en la base sobre la cual se construyen nuevos enfoques, incluyendo el álgebra de tuplas y los modelos semánticos.

Fundamentos teóricos del análisis lógico-probabilístico

El álgebra booleana como estructura común

El álgebra booleana es una estructura matemática universal que sirve simultáneamente a la lógica clásica y a la teoría de probabilidades. En lógica opera con valores de verdad (verdadero/falso), en probabilidad con eventos con medidas de 0 a 1.

Esta dualidad refleja la profunda conexión entre el razonamiento deductivo bajo certeza y el inductivo bajo incertidumbre.

| Operación | Contexto lógico | Contexto probabilístico |

|---|---|---|

| Conjunción (Y) | Producto lógico | Intersección de eventos |

| Disyunción (O) | Suma lógica | Unión de eventos |

| Negación (NO) | Inversión de valor | Complemento del evento |

La estructura isomórfica de las operaciones permite aplicar métodos lógicos a problemas probabilísticos y viceversa, creando una base metodológica unificada.

Lógica y probabilidad no son incompatibles: son herramientas complementarias que operan sobre la misma base algebraica.

Lógica probabilística e inferencias cuantitativas

La lógica probabilística extiende la lógica clásica generalizando los valores de verdad a valores probabilísticos. A cada proposición se le asigna un valor numérico que refleja el grado de confianza en su veracidad.

Las reglas de inferencia incluyen la evaluación cuantitativa de la incertidumbre, combinando el razonamiento deductivo con evidencia estadística.

- Preservación de la estructura lógica al incorporar incertidumbre

- Combinación de reglas deductivas con medidas probabilísticas

- Aplicación al razonamiento bajo información incompleta

Las inferencias cuantitativas se diferencian del análisis estadístico puro en que preservan la estructura lógica al incorporar incertidumbre. Este enfoque encuentra aplicación en herramientas de pensamiento para inteligencia artificial y aprendizaje automático.

La lógica probabilística une la fuerza normativa de la lógica con la flexibilidad empírica de la probabilidad: un elemento básico de toda acción y análisis.

Metodología del modelado lógico-probabilístico

Cálculo de probabilidades en sistemas lógicos

El cálculo lógico-probabilístico es un marco matemático para calcular probabilidades de eventos complejos expresados mediante combinaciones lógicas de eventos elementales. Integra el análisis estructural de dependencias lógicas con la evaluación cuantitativa de probabilidades.

Herramienta estándar en ingeniería de fiabilidad, análisis de riesgos y evaluación de seguridad de infraestructuras críticas. Contrariamente a la creencia popular, no es un aparato puramente teórico: las aplicaciones prácticas abarcan análisis de fiabilidad de sistemas complejos, modelado cuantitativo de riesgos, reconocimiento de patrones y clasificación.

- Análisis estructural: identificación de dependencias lógicas entre componentes del sistema

- Evaluación cuantitativa: asignación de probabilidades a eventos elementales

- Cálculo: obtención de probabilidades de eventos complejos mediante operaciones lógicas

- Validación: verificación de consistencia y reproducibilidad de conclusiones

La metodología proporciona medidas cuantitativas precisas de incertidumbre, haciendo riguroso el razonamiento en escenarios donde la certeza absoluta es inalcanzable. Esto es crítico para el pensamiento ingenieril al trabajar con sistemas complejos.

Requisito de máxima especificidad y ambigüedad estadística

El requisito de máxima especificidad (RMS) es una regla formalizada para eliminar problemas de ambigüedad estadística (SAP). Garantiza que cuando existen múltiples interpretaciones probabilísticas posibles de una estructura lógica, se selecciona la más específica, minimizando la incertidumbre.

Problema: la estructura lógica admite múltiples distribuciones probabilísticas compatibles con los datos disponibles. Solución: RMS resuelve estas ambigüedades de manera sistemática, asegurando la consistencia de las inferencias probabilísticas.

Especialmente crítico en inferencia probabilística semántica, donde la integración de significado y probabilidad requiere reglas estrictas para eliminar incertidumbres interpretativas. Sin RMS, el mismo escenario lógico puede generar diferentes inferencias probabilísticas según la interpretación elegida, haciendo el análisis poco fiable.

| Escenario | Sin RMS | Con aplicación de RMS |

|---|---|---|

| Múltiples distribuciones compatibles con datos | Elección arbitraria o implícita | Se selecciona la más específica |

| Reproducibilidad de inferencias | No garantizada | Garantizada |

| Incertidumbres interpretativas | Permanecen sin resolver | Se eliminan sistemáticamente |

RMS transforma el análisis probabilístico de un arte (donde experiencia e intuición deciden) en una disciplina ingenieril con resultados reproducibles. Es la base para la verificación de realidad en modelos lógico-probabilísticos.

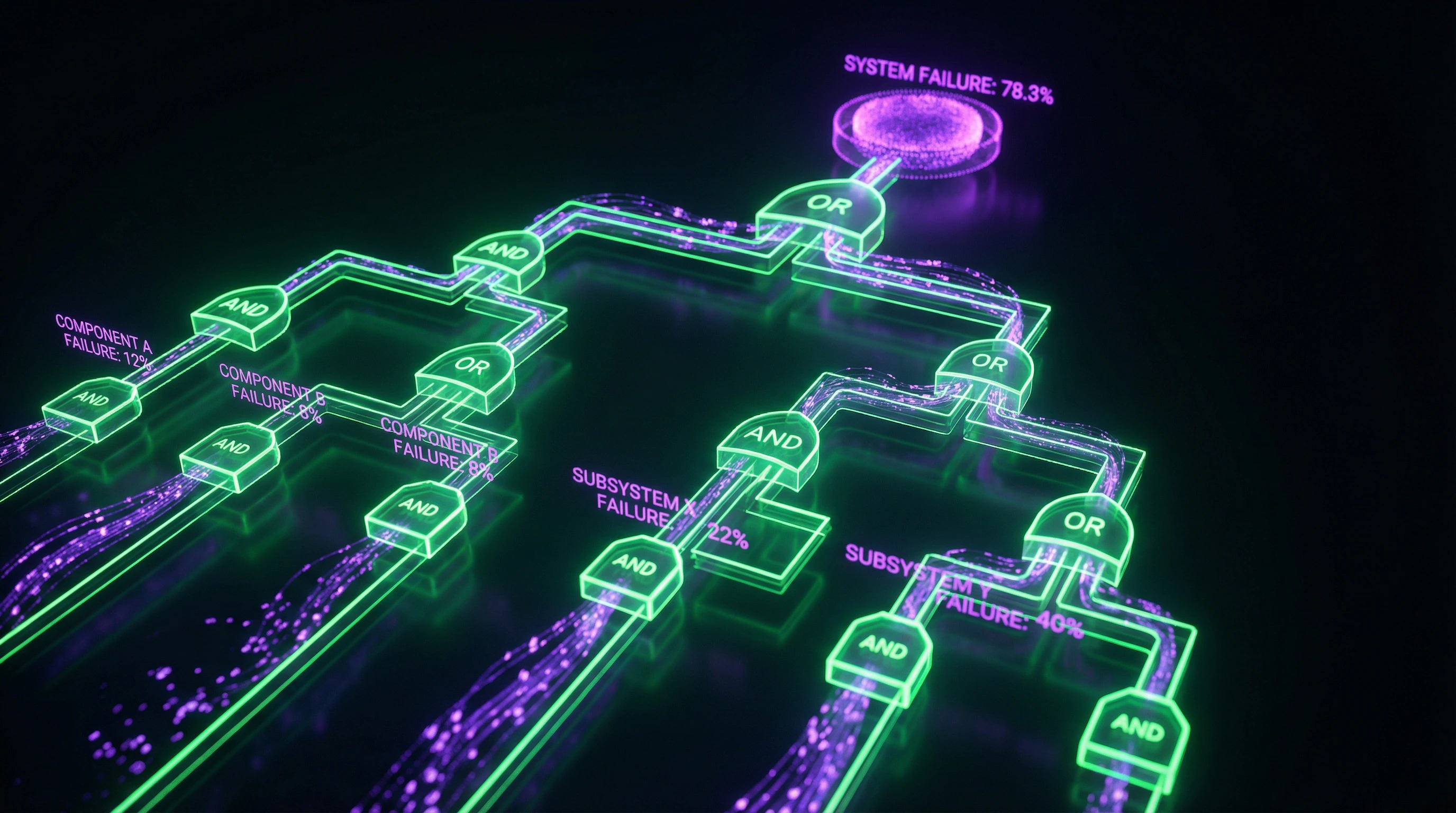

Aplicación en el análisis de fiabilidad y seguridad de sistemas técnicos complejos

Evaluación de la supervivencia de sistemas complejos mediante modelos lógico-probabilísticos

El análisis lógico-probabilístico es un método estándar para evaluar la fiabilidad, supervivencia y seguridad de sistemas técnicos complejos. Combina modelos lógicos estructurales con características probabilísticas de fallos de componentes, permitiendo cuantificar la probabilidad de eventos críticos.

La supervivencia del sistema es la capacidad de mantener la funcionalidad ante fallos parciales. Esto requiere analizar todas las combinaciones posibles de fallos de componentes mediante álgebra booleana.

- Construir un árbol de fallos: operadores lógicos (Y, O, NO) conectan eventos básicos con características probabilísticas.

- Aplicar álgebra de tuplas para el cálculo eficiente de probabilidades, especialmente crítico para sistemas con miles de componentes.

- Identificar rutas críticas de fallo y optimizar la redundancia para aumentar la fiabilidad general.

Análisis cuantitativo de riesgos en infraestructura crítica

La evaluación cuantitativa de riesgos requiere integrar modelos lógicos de amenazas con distribuciones probabilísticas de su materialización. El enfoque lógico-probabilístico formaliza la conexión entre eventos iniciadores, estados intermedios y consecuencias finales mediante expresiones lógicas estructuradas.

Las probabilidades se asignan a eventos básicos basándose en datos estadísticos, evaluaciones de expertos o modelos físicos. Luego se aplica el cálculo probabilístico para calcular los riesgos finales.

El método es especialmente efectivo para analizar la seguridad de infraestructura crítica, donde es necesario considerar múltiples escenarios de fallo y sus interacciones. El requisito de máxima especificidad elimina ambigüedades estadísticas ante datos incompletos, garantizando evaluaciones de riesgo consistentes.

Los resultados del análisis se utilizan para priorizar medidas de reducción de riesgos y justificar inversiones en seguridad basándose en criterios cuantitativos.

Enfoques computacionales modernos para la lógica probabilística

Álgebra de tuplas para inferencia probabilística eficiente

El álgebra de tuplas es un marco computacional para el razonamiento probabilístico que proporciona algoritmos eficientes para estructuras lógicas complejas. Las distribuciones probabilísticas se representan como tuplas: conjuntos ordenados de valores correspondientes a diferentes estados lógicos del sistema.

Las operaciones algebraicas sobre tuplas corresponden directamente a operaciones lógicas (conjunción, disyunción, negación), permitiendo calcular eficientemente las probabilidades resultantes. La ventaja del método radica en su eficiencia computacional para sistemas con gran número de variables, donde los métodos clásicos resultan inaplicables debido a la explosión combinatoria.

- Representar las distribuciones probabilísticas como tuplas de estados lógicos

- Aplicar operaciones algebraicas correspondientes a conectivas lógicas

- Procesar grupos de eventos incompatibles como unidad fundamental

- Calcular las probabilidades resultantes sin enumerar todas las combinaciones

El álgebra de tuplas encuentra aplicación en reconocimiento de patrones, clasificación y otras áreas que requieren inferencia probabilística en estructuras lógicas complejas.

Inferencia probabilística semántica y eliminación de ambigüedades

La inferencia probabilística semántica integra el contenido significativo con medidas probabilísticas, proporcionando modelos de razonamiento más ricos. Este enfoque extiende la lógica probabilística clásica mediante la inclusión de relaciones semánticas entre conceptos, considerando información contextual en las inferencias probabilísticas.

Problema de ambigüedad estadística: la estructura lógica admite múltiples distribuciones probabilísticas compatibles con los mismos datos observables. El requisito de máxima especificidad resuelve sistemáticamente esta ambigüedad, seleccionando la distribución más informativa que minimiza la entropía respetando todas las restricciones.

La consistencia de las inferencias probabilísticas es crítica para la inteligencia artificial y el aprendizaje automático, de ella depende la fiabilidad de los sistemas de toma de decisiones. La formalización del requisito de máxima especificidad en términos de lógica y probabilidad elimina los problemas que surgen ante múltiples interpretaciones de los datos.

Aplicaciones interdisciplinares y perspectivas de desarrollo de la integración entre lógica y probabilidad

Inteligencia artificial y aprendizaje automático bajo incertidumbre

La lógica probabilística constituye el fundamento para el razonamiento bajo incertidumbre en sistemas de IA. Permite combinar el razonamiento deductivo con el aprendizaje inductivo a partir de datos.

Las redes bayesianas y los modelos gráficos probabilísticos se derivan directamente de los principios de la lógica probabilística. Operan en reconocimiento de patrones, procesamiento de lenguaje natural, planificación y toma de decisiones con información incompleta.

- La inferencia probabilística semántica interpreta el significado junto con la cuantificación de la incertidumbre

- Las estructuras lógicas transparentes con estimaciones probabilísticas hacen explicables las decisiones de IA

- La fiabilidad del sistema depende de la integración de lógica y probabilidad en la arquitectura

Teoría de la decisión y aplicaciones económicas

La lógica y la probabilidad son elementos básicos de todas las acciones y análisis. John Maynard Keynes demostró el papel fundamental del razonamiento probabilístico en el análisis económico y la elección bajo incertidumbre.

La integración de estructuras lógicas de preferencias con estimaciones probabilísticas de resultados crea una base matemáticamente rigurosa para la elección racional.

| Área de aplicación | Tarea | Instrumento |

|---|---|---|

| Ingeniería financiera | Valoración de derivados, gestión de carteras | Análisis lógico-probabilístico de riesgos |

| Riesgo sistémico | Cuantificación de interdependencias | Modelos probabilísticos de agentes |

| Economía conductual | Consideración de limitaciones cognitivas | Integración de desviaciones de la racionalidad |

Las perspectivas de desarrollo apuntan hacia una integración más profunda de los aspectos conductuales de la toma de decisiones con modelos probabilísticos formales que consideren las desviaciones sistemáticas de la racionalidad.

Knowledge Access Protocol

FAQ

Preguntas Frecuentes

Es una metodología que combina estructuras lógicas (álgebra booleana) con la teoría de probabilidades para la evaluación cuantitativa de la incertidumbre. Se aplica al análisis de fiabilidad, supervivencia y seguridad de sistemas complejos, donde la lógica describe la estructura y las probabilidades las características cuantitativas de los eventos.

George Boole en 1854 en su obra «Las leyes del pensamiento». Creó la base matemática que vincula las operaciones lógicas con los cálculos probabilísticos, lo que se convirtió en el fundamento de los métodos modernos. La contribución de Poretsky desarrolló el cálculo probabilístico clásico para eventos aleatorios.

La lógica probabilística preserva la estructura del razonamiento lógico, extendiendo los valores de verdad a probabilidades. Combina el razonamiento deductivo con el inductivo, a diferencia del análisis estadístico puro de datos. Esto permite formalizar razonamientos en condiciones de incertidumbre.

No, es un mito. Se complementan mutuamente: la lógica clásica trabaja con certeza, la probabilidad con incertidumbre. La integración matemáticamente rigurosa existe desde 1854 y está confirmada por 170 años de práctica aplicada.

En ingeniería de fiabilidad, evaluación de riesgos, inteligencia artificial y teoría de la toma de decisiones. El método es estándar para el análisis de seguridad de sistemas técnicos complejos, programación probabilística y aprendizaje automático. También se utiliza en economía para modelar decisiones bajo incertidumbre.

Un requisito formalizado en sistemas lógico-probabilísticos para eliminar problemas de ambigüedad estadística (SAP). Garantiza la selección de la inferencia probabilística más específica entre las alternativas posibles. Es crítico para la corrección de la inferencia probabilística semántica.

Se utiliza el cálculo lógico-probabilístico: primero se construye un modelo lógico de eventos mediante funciones booleanas, luego se aplican las reglas de cálculo de probabilidades. Para eventos incompatibles las probabilidades se suman, para dependientes se utilizan probabilidades condicionales. El álgebra de tuplas automatiza estos cálculos.

Un conjunto de eventos que no pueden ocurrir simultáneamente. Concepto fundamental en modelado probabilístico, donde la suma de probabilidades de tales eventos no supera la unidad. Se utiliza para construir modelos lógico-probabilísticos correctos de sistemas.

Se construye un modelo lógico de fallos de componentes (árbol de fallos o función booleana), luego se calcula la probabilidad de fallo del sistema a través de las probabilidades de fallo de los elementos. El método considera las conexiones estructurales y dependencias entre componentes. Permite evaluar cuantitativamente la supervivencia y seguridad.

Sirve como estructura matemática común para la lógica y la probabilidad. Las operaciones booleanas (Y, O, NO) describen las conexiones lógicas de eventos, y las medidas probabilísticas se asignan a los resultados de estas operaciones. Esto garantiza la unidad metodológica desde 1854.

Sí, es uno de los enfoques principales para el razonamiento bajo incertidumbre. Las redes bayesianas, la programación probabilística y la lógica difusa se basan en estos principios. Se aplica en aprendizaje automático, sistemas expertos y robótica para la toma de decisiones.

Integración de relaciones semánticas con estimaciones probabilísticas en sistemas lógicos. Permite realizar inferencias considerando tanto la estructura lógica del conocimiento como el grado de certeza en ellas. Requiere formalización de la semántica mediante medidas probabilísticas.

No, es un error. La lógica probabilística conserva las reglas de inferencia lógica, extendiéndolas a la incertidumbre, mientras que la estadística se centra en el análisis de datos. Unifica deducción e inducción en un sistema formal único.

Proporciona un marco computacional moderno para automatizar el razonamiento probabilístico. Las tuplas representan combinaciones de eventos y sus probabilidades, las operaciones algebraicas ejecutan cálculos lógico-probabilísticos. Simplifica la implementación de modelos complejos en software.

Sí, es un enfoque estándar en el análisis cuantitativo de riesgos. El modelo lógico describe escenarios de amenazas, las probabilidades evalúan su materialización, el resultado es una medida cuantitativa del riesgo. Se aplica en seguridad industrial, finanzas y gestión de proyectos.

Desarrollo hacia IA, sistemas autónomos y big data. Integración con aprendizaje automático para IA explicable, aplicación en computación cuántica y sistemas distribuidos. La interdisciplinariedad asegura crecimiento de aplicaciones en medicina, economía y ciencias sociales.