Qué son la revisión sistemática y el metaanálisis: definiciones que ocultan una diferencia crítica

La revisión sistemática es un proceso estructurado de búsqueda, selección y evaluación crítica de todos los estudios disponibles sobre una cuestión específica, ejecutado según un protocolo predeterminado (S003). El metaanálisis es un método estadístico de combinación de resultados cuantitativos de múltiples estudios para obtener una estimación sumaria del efecto (S008).

La diferencia clave: la revisión sistemática puede existir sin metaanálisis, pero el metaanálisis sin revisión sistemática pierde rigor metodológico. Más detalles en la sección Chipización y gobierno mundial.

- Revisión sistemática

- Búsqueda y evaluación protocolizada de todos los estudios disponibles. Garantiza exhaustividad, pero no garantiza calidad de los datos originales.

- Metaanálisis

- Combinación estadística de resultados. Aumenta la precisión de la estimación del efecto, pero no corrige errores sistemáticos en los estudios originales.

🔎 Por qué la confusión entre términos genera falsa certeza

El estudio sobre resistencia antibiótica de H. pylori en Rusia fue registrado en PROSPERO y siguió las recomendaciones PRISMA 2020, lo que formalmente cumple los criterios de revisión sistemática (S001). Sin embargo, el registro previo del protocolo no garantiza la calidad de los estudios incluidos: solo documenta las intenciones de los autores.

Cuando vemos la frase «revisión sistemática y metaanálisis», el cerebro automáticamente asigna a los resultados el máximo nivel de evidencia, ignorando la cuestión de la heterogeneidad de los datos originales.

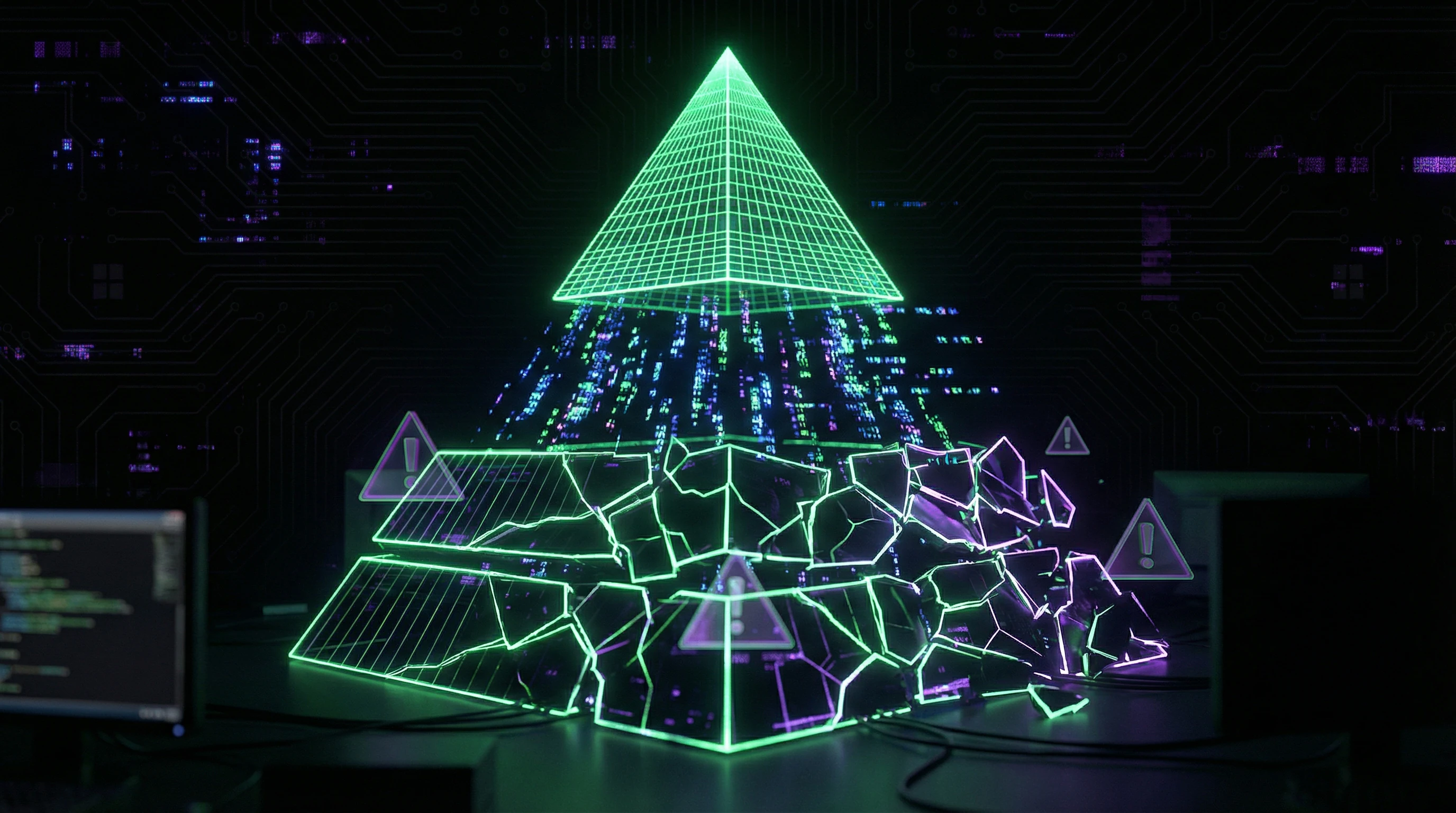

🧱 Jerarquía de evidencias: dónde se sitúa el metaanálisis y qué hay por encima

La pirámide tradicional de la medicina basada en evidencia sitúa las revisiones sistemáticas y metaanálisis en la cúspide, por encima de los ensayos controlados aleatorizados (ECA) y estudios de cohortes. Pero esta jerarquía solo funciona cuando se cumplen condiciones críticas: homogeneidad de poblaciones, estandarización de métodos de medición, ausencia de sesgos sistemáticos en los estudios originales.

| Condición | Cumplida | Resultado |

|---|---|---|

| Poblaciones homogéneas | Sí | El metaanálisis refuerza la evidencia |

| Poblaciones homogéneas | No | El metaanálisis enmascara heterogeneidad |

| Métodos estandarizados | Sí | Resultados comparables |

| Métodos estandarizados | No | Combinación de lo incomparable |

Un metaanálisis de estudios de baja calidad no se convierte en evidencia de alta calidad: se convierte en una estimación precisa del sesgo sistemático.

⚙️ Protocolo PRISMA 2020: qué garantiza y qué no garantiza

Las recomendaciones PRISMA definen un estándar de reporte, pero no un estándar de calidad de los datos originales (S001). Un estudio puede seguir PRISMA perfectamente y aun así combinar poblaciones incomparables, utilizar métodos diagnósticos obsoletos o ignorar factores de confusión críticos.

- Exhaustividad de búsqueda (MEDLINE, EMBASE, índices regionales) — cumple requisitos

- Transparencia de criterios de inclusión — documentada

- Calidad de estudios originales — no garantizada

- Comparabilidad de poblaciones — no verificada por PRISMA

- Ausencia de factores de confusión — queda a criterio de los autores

La exhaustividad de búsqueda no equivale a exhaustividad de evidencias. Esta distinción es crítica para comprender el metanivel de la base de evidencia.

Cinco argumentos a favor del metaanálisis: por qué la metodología parece inexpugnable

Antes de analizar las limitaciones, es necesario comprender la fuerza del método. El metaanálisis resuelve problemas reales de la ciencia médica, e ignorar estas ventajas significa perder el contexto en el que trabajan los investigadores. Más detalles en la sección Ocultación de datos por las farmacéuticas.

🔬 Aumento de la potencia estadística: cuando las muestras pequeñas se combinan en una grande

Un estudio individual con una muestra de 50 pacientes puede no detectar un efecto estadísticamente significativo del tratamiento. Un metaanálisis de 20 estudios similares (n=1000) aumenta la potencia y permite identificar un efecto real, aunque pequeño.

En un estudio de análisis cognitivo de tareas (CTA) en educación quirúrgica, el metaanálisis de 12 investigaciones mostró un gran efecto de entrenamiento a favor del CTA en comparación con los métodos tradicionales de enseñanza (S007). Ninguno de estos 12 estudios por separado tenía suficiente potencia para tal conclusión.

📊 Resolución de contradicciones: cuando los estudios arrojan resultados diferentes

Cuando un ECA muestra la eficacia de una intervención y otro la ausencia de efecto, los clínicos se encuentran en una situación de incertidumbre. El metaanálisis permite cuantificar la heterogeneidad de los resultados y determinar si la diferencia es aleatoria o sistemática.

Esto es especialmente importante en áreas con alta variabilidad poblacional, como la resistencia a antibióticos, donde las diferencias regionales pueden ser críticas (S001).

🧪 Identificación de efectos en subgrupos: cuando el tratamiento no funciona para todos

El metaanálisis permite realizar análisis de subgrupos que son imposibles en un estudio individual debido a la insuficiente potencia. Por ejemplo, se puede evaluar si el efecto de un antibiótico varía según la edad de los pacientes, la región de residencia o el método de diagnóstico de resistencia.

En un metaanálisis ruso sobre H. pylori, los autores pudieron evaluar los cambios temporales de resistencia durante un período de 15 años, lo que habría sido imposible en un solo estudio (S001).

🧾 Estandarización de la evidencia: cuando se necesita una evaluación única para las guías clínicas

Las guías clínicas requieren una evaluación sistematizada de toda la evidencia disponible. El metaanálisis proporciona una evaluación cuantitativa resumida que puede utilizarse para formular recomendaciones.

- La conclusión del estudio ruso de que Rusia supera el umbral de resistencia a claritromicina del 15%, establecido por el Consenso de Maastricht VI, influye directamente en la revisión de las estrategias empíricas de tratamiento (S001).

- Sin metaanálisis, tal conclusión se basaría en la evaluación subjetiva de estudios individuales.

⚙️ Revisiones sistemáticas vivas: cuando la evidencia se actualiza en tiempo real

El concepto de revisiones sistemáticas vivas (living systematic reviews) y metaanálisis prospectivos resuelve el problema de la obsolescencia de la evidencia (S002). En lugar de un documento estático que queda obsoleto un año después de su publicación, la revisión viva se actualiza continuamente a medida que aparecen nuevos estudios.

La metodología ALL-IN meta-analysis propone una infraestructura para tales actualizaciones, lo que es especialmente importante en áreas de rápido desarrollo, como la evaluación de la empatía de chatbots de IA en medicina (S004).

Análisis crítico de la base de evidencia: qué muestran realmente los metaanálisis y qué ocultan

Pasamos a estudios concretos para mostrar la brecha entre las declaraciones metodológicas y las limitaciones reales. Más detalles en la sección Movimiento de ciudadanos soberanos.

🧪 Caso H. pylori en España: cuando un metaanálisis revela un problema crítico

La revisión sistemática de Andreev et al. evaluó la resistencia antibiótica de Helicobacter pylori basándose en 15 años de investigación (S001). La búsqueda se realizó en MEDLINE/PubMed, EMBASE, Russian Science Citation Index y Google Scholar según PRISMA 2020, registrada previamente en PROSPERO.

Conclusión principal: España supera el umbral de resistencia a claritromicina del 15% establecido por el Consenso de Maastricht VI (S001). Esto requiere revisar las estrategias empíricas de tratamiento e impacta directamente en la elección de terapia de primera línea.

Sin embargo, los detalles metodológicos no revelados en el resumen son críticamente importantes: ¿qué métodos de determinación de resistencia se utilizaron? ¿Análisis culturales, moleculares o fenotípicos? Las diferencias en los métodos conducen a diferencias sistemáticas en las estimaciones.

📊 Análisis cognitivo de tareas en cirugía: cuando un metaanálisis muestra un gran efecto

La revisión sistemática de Alexander Coombs sobre análisis cognitivo de tareas (CTA) en educación quirúrgica abarcó 12 estudios (S007). El metaanálisis mostró una mejora significativa en conocimientos procedimentales y habilidades técnicas en residentes que utilizaron CTA, comparado con métodos tradicionales.

El tamaño del efecto fue grande, identificando el CTA como un complemento altamente efectivo al entrenamiento tradicional (S007).

- Pregunta crítica: ¿qué se midió como «habilidades técnicas»?

- ¿Evaluaciones estructuradas objetivas (OSATS), tiempo de ejecución, frecuencia de errores o valoraciones subjetivas de instructores? La heterogeneidad de resultados es el principal problema de los metaanálisis en educación, donde la estandarización de mediciones es significativamente menor que en estudios clínicos.

🧬 Chatbots de IA versus médicos: metaanálisis de empatía en atención médica

La revisión sistemática que compara la empatía de chatbots de IA y profesionales médicos presenta especial interés por la complejidad de medir empatía (S004). La empatía es un constructo multidimensional: componentes cognitivos, emocionales y conductuales.

¿Cómo combinar estudios que utilizan diferentes escalas de empatía, diferentes tipos de interacciones (texto, voz, video) y diferentes poblaciones de pacientes?

Un metaanálisis puede dar una estimación cuantitativa precisa, pero esta precisión es ilusoria si los estudios originales miden diferentes constructos bajo el mismo nombre. La homogeneidad estadística (I² bajo) no garantiza homogeneidad conceptual.

🔎 Metaanálisis en red: cuando se comparan intervenciones nunca comparadas directamente

El metaanálisis en red permite comparar múltiples intervenciones, incluso si nunca se compararon directamente (S005). Si existen ECA que comparan A vs B y B vs C, el metaanálisis en red estima la efectividad relativa de A vs C a través del comparador común B.

Esto se basa en el supuesto crítico de transitividad: las poblaciones, diseños de estudios y definiciones de resultados son suficientemente similares para que la comparación indirecta sea válida.

| Escenario | Problema | Consecuencia |

|---|---|---|

| A vs B en enfermedad leve; B vs C en grave | Violación de transitividad | Comparación indirecta A vs C sistemáticamente sesgada |

| Diferentes poblaciones (edad, sexo, comorbilidades) | Heterogeneidad de modificadores de efecto | Efecto promediado no representativo de ningún subgrupo |

| Diferentes intervalos temporales de observación | Incomparabilidad temporal | El efecto puede ser artefacto de diferentes períodos de seguimiento |

⚠️ Análisis de mediación en revisiones sistemáticas: cuando la causalidad se vuelve especulación

Las revisiones sistemáticas de análisis de mediación enfrentan desafíos únicos (S008). El análisis de mediación explica a través de qué mecanismos una intervención afecta el resultado: ¿la actividad física reduce la depresión directamente o mediante la mejora de la calidad del sueño?

Combinar análisis de mediación requiere que todos los estudios midan los mismos mediadores con los mismos métodos y utilicen los mismos modelos estadísticos.

En la práctica esto rara vez se cumple. Las diferencias en operacionalización de mediadores, intervalos temporales de medición y enfoques estadísticos hacen que el metaanálisis de efectos de mediación sea extremadamente vulnerable a errores sistemáticos. El resultado puede ser estadísticamente significativo, pero la interpretación causal permanece especulativa.

Este problema es especialmente agudo en análisis de meta-nivel, donde el intento de generalizar mecanismos de acción de intervenciones a menudo conduce a artefactos de agregación.

Mecanismos y confusores: por qué la correlación en el metaanálisis no equivale a causalidad

El metaanálisis combina resultados de estudios, pero no puede corregir las limitaciones fundamentales del diseño de esos estudios. Si todos los estudios incluidos son observacionales, el metaanálisis sigue siendo observacional, con todas las limitaciones inherentes para establecer causalidad. Más detalles en la sección Alfabetización mediática.

🧬 El problema de los confusores no medidos: lo que no entró en el modelo

En el metaanálisis de resistencia antibiótica de H. pylori, los confusores críticos pueden ser: uso previo de antibióticos en la población, disponibilidad de antibióticos sin receta, diferencias regionales en las cepas de H. pylori, métodos de cultivo y determinación de resistencia (S001). Si los estudios incluidos no controlaron estos factores o los controlaron de manera diferente, la estimación agregada de resistencia mezclará la resistencia real con diferencias sistemáticas en la metodología.

Un confusor no medido es una variable que influye en el resultado, pero no fue registrada en el estudio. No puede controlarse estadísticamente y permanece como fuente de sesgo sistemático para siempre.

🔁 Dinámica temporal: cuando agregar datos de 15 años enmascara tendencias

El metaanálisis ruso de H. pylori evaluó cambios temporales en la resistencia durante 15 años (S001). Pero si la resistencia creció de forma no lineal —por ejemplo, un aumento brusco en los últimos 5 años— la estimación agregada de todo el período puede subestimar la situación actual.

La metarregresión por año de publicación puede resolver parcialmente este problema, pero solo si el número de estudios es suficiente para detectar la tendencia temporal. Sin este análisis, se obtiene una cifra promediada que no refleja la realidad ni en el pasado ni en el presente.

🧷 Sesgo de publicación: cuando los resultados negativos no se publican

Los estudios que no encontraron alta resistencia o no mostraron eficacia de la intervención se publican con menor frecuencia que los estudios con resultados "positivos" (S008). Esto crea un sesgo de publicación (publication bias) que infla las estimaciones agregadas del efecto en el metaanálisis.

- Los métodos de evaluación del sesgo de publicación (funnel plot, test de Egger) tienen baja potencia con pocos estudios.

- Pueden dar resultados falsos negativos: no detectar el sesgo que realmente está presente.

- Incluso si se detecta el sesgo, su magnitud no puede estimarse con precisión.

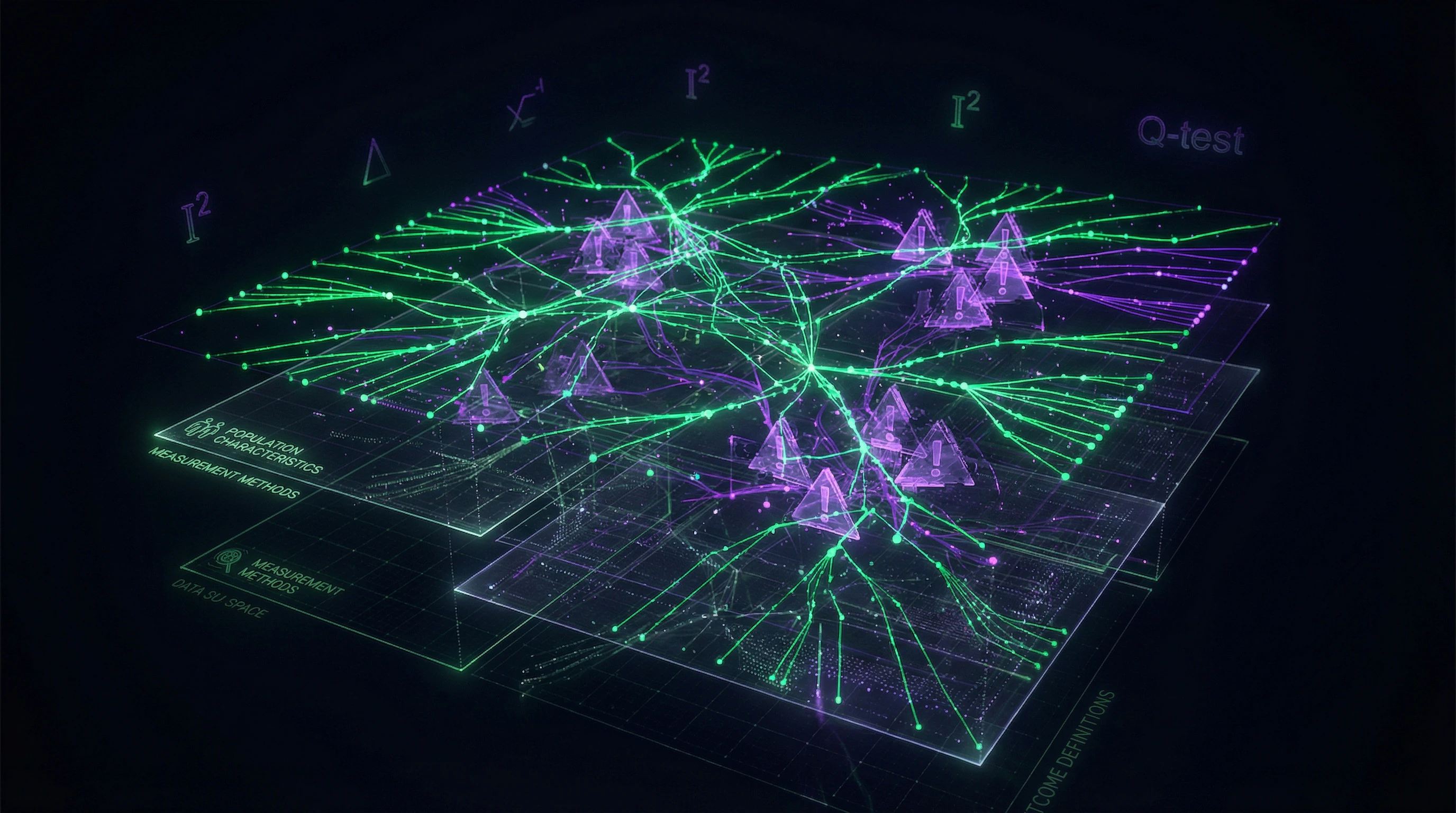

⚙️ Heterogeneidad de poblaciones: cuando "pacientes con H. pylori" son poblaciones diferentes

Los pacientes con H. pylori en Madrid, Barcelona y Valencia pueden diferir en factores genéticos, hábitos dietéticos, acceso a atención médica y uso previo de antibióticos. Combinar datos de estas regiones en un metaanálisis supone que estas diferencias no afectan la resistencia, lo cual puede ser una suposición incorrecta.

La prueba estadística de heterogeneidad (I², Q-test) evalúa la variabilidad de los resultados, pero no explica sus fuentes. Un I² alto dice: "Aquí algo no está bien", pero no dice qué exactamente.

Conflictos e incertidumbres: dónde difieren las fuentes y por qué es importante

Incluso las revisiones sistemáticas de alta calidad pueden llegar a conclusiones diferentes sobre la misma cuestión. Comprender las fuentes de estas discrepancias es fundamental para interpretar los resultados. Más información en la sección Sesgos cognitivos.

🧩 Diferencias en los criterios de inclusión: cómo la definición de la población cambia el resultado

Dos metaanálisis sobre el mismo tema pueden utilizar diferentes criterios de inclusión de estudios. Uno puede incluir solo ensayos controlados aleatorizados, otro puede incluir ensayos controlados aleatorizados y estudios de cohortes. Uno puede limitarse a pacientes adultos, otro puede incluir todos los grupos de edad.

Estas diferencias no son errores: reflejan diferentes preguntas de investigación. Pero el lector que ve dos metaanálisis con conclusiones contradictorias puede no entender que están respondiendo a preguntas diferentes. Esto es especialmente peligroso en el contexto de interpretaciones metanivel, donde la contradicción entre fuentes a menudo se percibe como señal de conspiración o conocimiento oculto.

🔬 Diferencias en los métodos estadísticos: efecto fijo vs efecto aleatorio

Un metaanálisis puede utilizar un modelo de efecto fijo (asume que todos los estudios estiman un único efecto verdadero) o un modelo de efecto aleatorio (asume que el efecto verdadero varía entre estudios).

El modelo de efecto fijo proporciona intervalos de confianza más estrechos y muestra resultados estadísticamente significativos con mayor frecuencia, pero solo es válido en ausencia de heterogeneidad. El modelo de efecto aleatorio es más conservador, pero puede subestimar el efecto cuando hay pocos estudios.

La elección entre ellos no es neutral: el mismo conjunto de datos puede dar conclusiones opuestas dependiendo del método elegido (S002).

📊 Diferencias en la definición de resultados: cuando la «eficacia» se mide de manera diferente

En el metaanálisis de educación quirúrgica, la «eficacia» del CTA se midió a través del conocimiento procedimental y las habilidades técnicas (S007). Pero, ¿qué pasa si algunos estudios midieron el conocimiento mediante pruebas escritas y otros mediante evaluaciones de simulación?

¿Qué pasa si las habilidades técnicas se evaluaron por el tiempo de ejecución del procedimiento en algunos estudios y por la frecuencia de errores en otros? Combinar estos resultados heterogéneos en un solo metaanálisis crea la ilusión de un constructo único de «eficacia», que en realidad es un compuesto de mediciones incomparables.

- Verificar si los autores utilizaron resultados primarios (definidos previamente) o secundarios (seleccionados post hoc)

- Comparar las definiciones del mismo resultado en diferentes estudios

- Evaluar cuán heterogéneos son los métodos de medición en los estudios combinados

- Buscar signos de cherry-picking: si los autores incluyeron solo aquellos resultados que mostraron efecto

Cuando dos metaanálisis difieren, la primera pregunta no es «quién tiene razón», sino «a qué preguntas diferentes están respondiendo». Esto requiere leer la metodología, no solo el resumen. Es precisamente aquí donde las interpretaciones paranormales a menudo prevalecen: la contradicción entre fuentes se percibe como prueba de conocimiento oculto, y no como resultado de elecciones metodológicas.

Anatomía cognitiva del mito: qué trampas mentales nos hacen confiar ciegamente en el metaanálisis

El metaanálisis explota varios sesgos cognitivos que hacen sus resultados especialmente convincentes, incluso cuando las limitaciones metodológicas son evidentes. Más información en la sección Moderación y control de calidad.

⚠️ Heurística de representatividad: cuando la cantidad de estudios crea la ilusión de exhaustividad

Un metaanálisis de 20 estudios parece más convincente que un solo estudio, independientemente de la calidad de esos 20. El cerebro utiliza la cantidad como proxy de calidad — un ejemplo clásico de heurística de representatividad.

Si los 20 estudios tienen alto riesgo de sesgo sistemático, combinarlos no reduce ese riesgo — proporciona una estimación precisa del sesgo.

🕳️ Ilusión de precisión: cuando los intervalos de confianza estrechos enmascaran la incertidumbre

El metaanálisis proporciona una estimación combinada con un intervalo de confianza que a menudo es más estrecho que los intervalos de los estudios individuales. Esto crea una ilusión de precisión.

Un intervalo de confianza estrecho refleja solo la incertidumbre estadística (error aleatorio), ignorando la incertidumbre sistemática (sesgo, heterogeneidad, confusores no medidos). La incertidumbre real puede ser significativamente mayor.

🧠 Efecto halo metodológico: cuando PRISMA y PROSPERO generan falsa confianza

Mencionar el seguimiento de las directrices PRISMA 2020 y el registro previo en PROSPERO crea un efecto halo — la suposición de alta calidad (S001).

- PRISMA

- Estándar de reporte, no estándar de calidad. Un estudio puede seguir PRISMA perfectamente e incluir estudios de baja calidad o hacer inferencias causales infundadas.

- PROSPERO

- El registro reduce el riesgo de reporte selectivo, pero no garantiza la calidad del protocolo.

🔁 Cascada de confianza: cómo el metaanálisis se cita sin evaluación crítica

Tras la publicación de un metaanálisis, sus resultados suelen citarse en guías clínicas, libros de texto y artículos de revisión sin reevaluación crítica. Cada cita subsecuente refuerza la credibilidad percibida.

- El metaanálisis original se publica con limitaciones metodológicas

- Las guías clínicas citan el resultado sin mencionar las limitaciones

- Libros de texto y revisiones repiten la cita de las guías

- El resultado se convierte en «hecho aceptado», aunque la base de evidencia siga siendo débil

El mecanismo funciona como una trampa de metanivel: cada capa de citación aleja al lector de los datos originales y los detalles metodológicos.

Protocolo de evaluación crítica de revisiones sistemáticas en cinco minutos: checklist para profesionales

Cualquier revisión sistemática o metaanálisis no es una sentencia definitiva, sino una hipótesis empaquetada en metodología. Antes de aceptar sus conclusiones, es necesario verificar tres capas: diseño del estudio, calidad de los datos y lógica de interpretación.

A continuación, un conjunto mínimo de preguntas que filtran el 80% de las revisiones problemáticas en pocos minutos de lectura.

- Criterios de inclusión: ¿específicos o difusos? Si los autores incluyeron estudios con diferentes poblaciones, dosificaciones, duraciones o mediciones, esto no es síntesis sino promediación de ruido. Revisa la tabla de características de los estudios (normalmente en el apéndice). Si la dispersión es amplia, la heterogeneidad (I²) será alta y el resultado combinado pierde sentido.

- Fuente de financiación y conflictos de interés de los autores. Los metaanálisis patrocinados por el fabricante de un fármaco o dispositivo sistemáticamente sobreestiman el efecto (S008). Esto no significa necesariamente falsificación; a menudo opera la citación selectiva y la interpretación sesgada.

- Sesgo de publicación: ¿se verificó el "cajón de archivos"? Los autores debieron buscar estudios no publicados (a través de registros, cartas a autores, conferencias). Si no lo hicieron, el resultado está inflado. El gráfico en embudo (funnel plot) en el apéndice es el primer signo de honestidad.

- Calidad de los estudios incluidos: ¿aleatorizados u observacionales? Un metaanálisis de 50 estudios observacionales es más débil que un buen ensayo controlado aleatorizado (S003). Verifica cuántos estudios tuvieron bajo riesgo de sesgo (según la escala Cochrane Risk of Bias). Si es menos de la mitad, el resultado no es fiable.

- Heterogeneidad (I²): por encima del 50% es bandera roja. Esto significa que más de la mitad de la variación en los resultados se explica por diferencias entre estudios, no por azar. Con I² > 75%, el resultado combinado es casi inútil. Los autores debieron realizar análisis de subgrupos o metarregresión para identificar la fuente de las diferencias.

- Tamaño del efecto: ¿clínicamente significativo o estadísticamente significativo? El intervalo de confianza es el indicador principal. Si el IC 95% incluye cero o cruza el umbral de significancia clínica, la conclusión es indeterminada. El número necesario a tratar (NNT) debe estar explícitamente indicado.

- Análisis de sensibilidad: ¿es robusto el resultado? Los autores debieron excluir un estudio a la vez y recalcular el resultado. Si la conclusión cambia radicalmente, es señal de inestabilidad. También verifica si se realizó análisis solo para ensayos aleatorizados (sin estudios observacionales).

- Registro del protocolo: ¿fue registrado antes de comenzar? PROSPERO (para revisiones sistemáticas) u Open Science Framework son el estándar. Si no hay protocolo, los autores pudieron cambiar los criterios de inclusión durante el análisis (p-hacking a nivel de revisión).

Si la revisión no responde a 5–6 preguntas de las 8, sus conclusiones son preliminares. Esto no significa que sean incorrectas, pero requieren verificación con datos independientes o ensayos aleatorizados.

Consejo práctico: comienza por el resumen y la tabla de características de los estudios. Si ya se observa alta heterogeneidad o tipos mixtos de estudios, a menudo no es necesario profundizar en la metodología: el resultado ya está comprometido.

Recuerda: el metaanálisis es una herramienta de síntesis, no una herramienta de verdad. Su valor depende de la calidad de los datos de entrada y la honestidad de los autores. La lectura crítica toma 5–10 minutos y frecuentemente previene decisiones erróneas.