Pizzagate y QAnon como herederos del pánico satánico: continuidad estructural de las narrativas conspirativas

La teoría conspirativa Pizzagate surgió en octubre de 2016 en el foro 4chan en el contexto de la filtración de correos electrónicos del presidente de la campaña electoral de Hillary Clinton, John Podesta. Los usuarios interpretaron las menciones de pizza y otros alimentos como mensajes codificados sobre pedofilia y tráfico de menores, supuestamente llevados a cabo por demócratas de alto rango a través de la pizzería Comet Ping Pong (S007).

La teoría QAnon, aparecida en 2017, amplió esta narrativa a escala global: una fuente anónima «Q» afirmaba que el presidente Trump libraba una guerra secreta contra una cábala internacional de pedófilos satanistas que controlaban gobiernos y medios de comunicación (S006).

⚠️ Estructura arquetípica de las acusaciones: de McMartin a Comet Ping Pong

Las investigaciones demuestran una conexión estructural directa entre estas teorías contemporáneas y el pánico satánico de los años 1980. En 1983, el caso McMartin Preschool en California inició una ola de acusaciones de abuso ritual satánico infantil en guarderías de toda América.

A pesar de la ausencia de pruebas físicas y el posterior reconocimiento de que los métodos de interrogatorio infantil eran manipulativos, el pánico condujo a cientos de procesos judiciales. QAnon reproduce elementos idénticos: acusaciones de pedofilia contra las élites, apelación a la protección infantil, construcción de una red oculta del mal y exigencia de vigilancia por parte de ciudadanos «despiertos» (S004).

El pánico satánico de los años 1980 y QAnon comparten una misma arquitectura: el enemigo es invisible, las pruebas de su actividad están codificadas, y la creencia en la teoría se convierte en marcador de vigilancia moral.

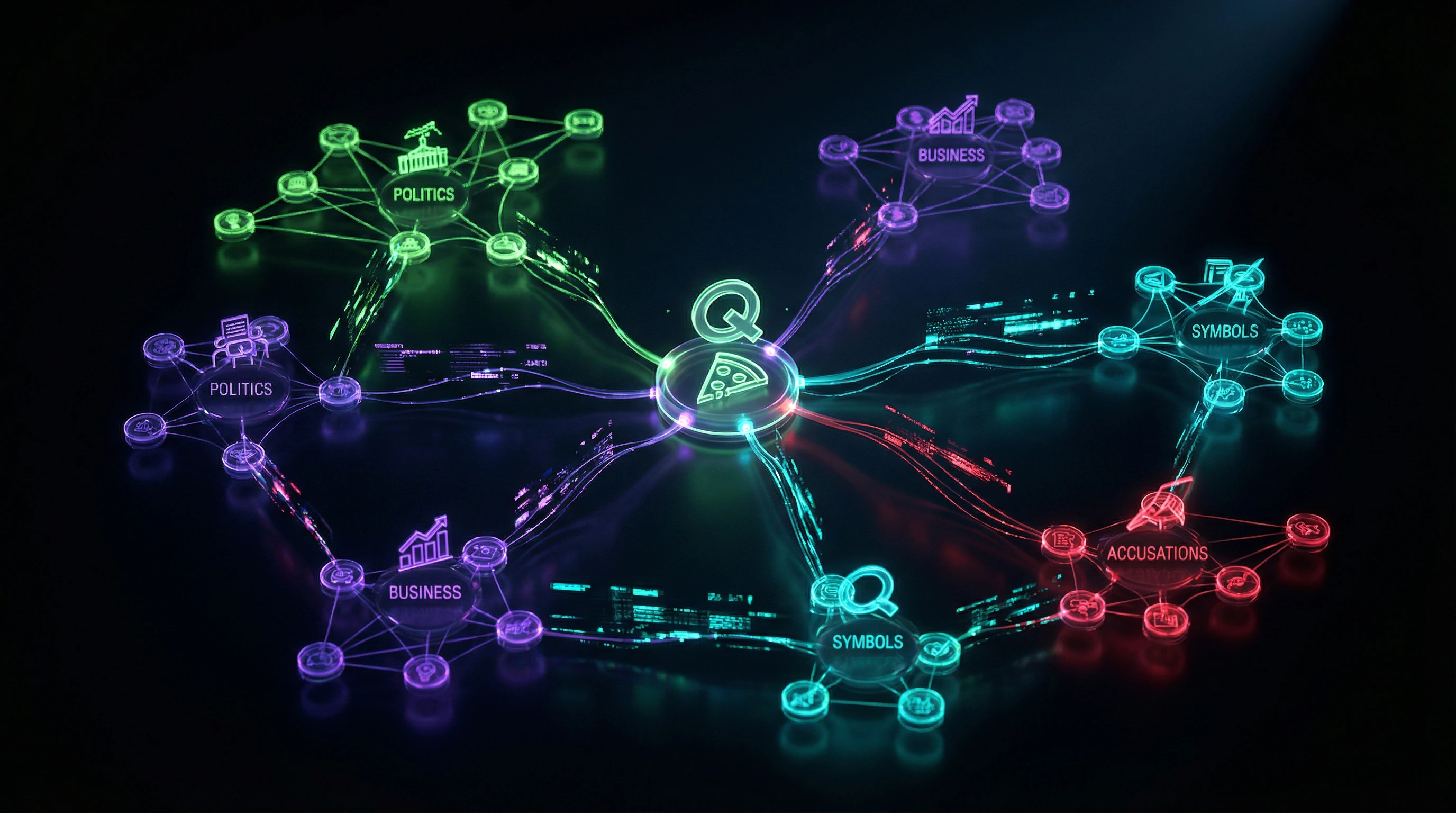

🧩 Conectividad multidominio como mecanismo clave

Pizzagate se basa en la interpretación de «conocimiento oculto» para vincular dominios no relacionados: política, negocios, arte, simbología y pedofilia (S002). La teoría utiliza «códigos» arbitrarios: la palabra «pizza» se interpreta como designación de niñas menores, «hotdog» como niños, «cheese» como niñas pequeñas.

| Dominio | Conexión en la narrativa | Mecanismo de interpretación |

|---|---|---|

| Política | Correos de Podesta | Búsqueda de «códigos» en correspondencia ordinaria |

| Negocios | Pizzería Comet Ping Pong | Transformación de un local real en centro de la red |

| Simbología | Logotipos, geometría | Búsqueda de «signos ocultos» en el diseño |

| Arte | Obras de artistas conocidos de las élites | Interpretación como «confesiones» de crímenes |

🔁 De los foros al mainstream: evolución de memes en tiempo real

Pizzagate surgió mediante un proceso colectivo en foros anónimos, donde los usuarios interpretaban conjuntamente los correos filtrados, creando conexiones cada vez más complejas (S002). Este proceso demuestra las características de la «protesta posverdad» (S005), donde la implicación emocional y la identidad grupal importan más que la precisión fáctica.

QAnon intensificó esta dinámica mediante mecánicas de juego: los «drops» de Q eran enigmas que requerían descifrado colectivo, creando la sensación de participar en una investigación y acceder a conocimiento exclusivo (S006).

- Investigación colectiva

- Los usuarios de foros «descifran» conjuntamente los materiales, creando la ilusión de método científico. Cada participante se convierte en «investigador», lo que refuerza el compromiso con la teoría.

- Mecánica de juego de enigmas

- Los «drops» incompletos y ambiguos de Q permiten que cada uno encuentre su propia explicación. La ambigüedad se convierte en ventaja, no en defecto.

- Exclusividad del conocimiento

- Los participantes creen poseer información inaccesible para la conciencia de masas. Esto crea una barrera psicológica contra la crítica y las refutaciones fácticas.

Análisis Steelman: siete argumentos que hacen las teorías conspirativas convincentes para millones

Para comprender la resistencia de Pizzagate y QAnon al fact-checking, es necesario examinar los argumentos más sólidos que presentan los defensores de estas teorías. El enfoque Steelman requiere representar la posición del oponente en su forma más convincente antes de su análisis crítico. Más información en la sección Desconfianza farmacéutica.

🧱 Argumento de los escándalos reales: Epstein como prueba de sistematicidad

Los defensores señalan casos reales de explotación sexual por parte de élites, especialmente el caso de Jeffrey Epstein, financiero condenado por tráfico de menores y que mantenía vínculos con numerosos políticos, empresarios y celebridades. Su muerte en prisión en 2019, oficialmente reconocida como suicidio, generó sospechas masivas de asesinato para ocultar información comprometedora.

Este escándalo real se utiliza como prueba de que "existen redes de pedofilia de élite", y por tanto, Pizzagate y QAnon podrían ser ciertos. La lógica: si un caso así es real, ¿por qué no podrían serlo otras acusaciones?

🔎 Argumento de la simbología: "demasiadas coincidencias"

Los conspiracionistas señalan el uso de ciertos símbolos en logotipos, arte y redes sociales de personas vinculadas a las acusaciones. Por ejemplo, el triángulo espiral, que el FBI efectivamente incluyó en un documento de 2007 sobre símbolos de pedófilos, fue encontrado en el logotipo de una empresa relacionada con el propietario de Comet Ping Pong (S007).

Los defensores de la teoría afirman que la probabilidad de coincidencia casual de múltiples "marcadores" es estadísticamente insignificante, por lo tanto, los símbolos se usan intencionalmente para comunicación dentro de la red.

🧠 Argumento del "conocimiento oculto": las élites se comunican en clave

Tesis central: las personas influyentes no discutirán abiertamente actividades criminales, por lo que usan códigos. Las menciones de comida en los correos de Podesta se interpretan como tales códigos. Los defensores señalan formulaciones supuestamente extrañas ("¿jugar al dominó sobre queso o sobre pasta?") como prueba de comunicación codificada (S007).

Las personas normales no escriben así, por tanto es un código; si es un código, se oculta algo ilegal; dado el contexto de otras "pruebas", debe tratarse de pedofilia.

📊 Argumento de la escala del movimiento: millones no pueden equivocarse

Para 2020, QAnon se había convertido en un movimiento masivo con millones de seguidores en todo el mundo. La investigación de Voat, plataforma a la que migraron los seguidores de QAnon tras los baneos en Reddit, mostró una comunidad activa con miles de publicaciones y comentarios, demostrando un sistema complejo de interpretaciones de los "drops" de Q (S006).

- Si la teoría fuera completamente absurda, no podría atraer a tanta gente

- Los seguidores incluyen profesionales con formación

- La masividad se percibe como validación: "no podemos estar todos locos"

⚙️ Argumento de la censura: "si no hay nada que ocultar, ¿por qué lo eliminan?"

La eliminación de contenido de QAnon y Pizzagate de las principales plataformas (Twitter, Facebook, YouTube) se interpreta no como lucha contra la desinformación, sino como prueba de que la teoría es correcta. La lógica: si la teoría es falsa, es fácil refutarla con hechos; si en lugar de refutación se aplica censura, significa que la teoría toca una verdad que quieren ocultar.

Cada baneo de cuenta o eliminación de vídeo se percibe como confirmación de la existencia de la conspiración. Este mecanismo es especialmente efectivo en el contexto del pensamiento conspirativo, donde cualquier oposición se interpreta como parte de la conspiración.

🧬 Argumento del estatus insider de Q: predicciones específicas

Los seguidores de QAnon señalan casos en los que los "drops" de Q supuestamente predecían eventos o contenían información que posteriormente se confirmaba. Por ejemplo, la mención de ciertos temas días antes de su aparición en las noticias. Esto se interpreta como prueba de que Q realmente tiene acceso a información privilegiada de alto nivel.

La investigación mostró que los seguidores buscan activamente tales "coincidencias" (qoincidences) y crean complejos grafos de conexiones entre drops y eventos (S006).

🛡️ Argumento de la protección infantil: imperativo moral de actuar

El argumento emocionalmente más poderoso: incluso si la probabilidad de veracidad de la teoría es baja, las consecuencias son tan graves (salvar niños del abuso) que es moralmente necesario investigar cualquier sospecha. Este argumento apela al valor universal de protección infantil y crea un dilema moral: rechazar la teoría significa arriesgarse a ignorar abuso real.

- Mecanismo de acción

- El imperativo moral bloquea el pensamiento crítico: dudar de la teoría se percibe como irresponsabilidad

- Paralelo histórico

- El pánico satánico de los años 1980-90 demostró que precisamente este imperativo moral hacía las acusaciones especialmente resistentes al escepticismo (S004)

- Resultado

- La teoría queda protegida contra la refutación: cualquier objeción se interpreta como intento de proteger a los criminales

Base empírica: qué muestran las investigaciones sistemáticas sobre narrativas conspirativas

Las investigaciones académicas sobre Pizzagate y QAnon proporcionan datos empíricos sobre los mecanismos de difusión, la estructura de las narrativas y las características de las comunidades, permitiendo separar los hechos documentados de las especulaciones. Más información en la sección Movimiento de ciudadanos soberanos.

📊 Análisis automatizado de estructuras narrativas: datos de 4chan y fuentes periodísticas

Un estudio que utilizó un pipeline automatizado para detectar marcos narrativos conspiratorios analizó publicaciones de 4chan y artículos periodísticos sobre Pizzagate (S002). La metodología consideró las publicaciones como muestras de subgrafos de una red narrativa latente, formalizando la tarea como un problema de estimación de modelo latente.

Hallazgo clave: Pizzagate demuestra una conectividad multidominio sistemática — la teoría vincula política, negocios, arte y criminalidad mediante la interpretación de "conocimiento oculto" (S002). Los investigadores plantearon la hipótesis de que este enfoque multidominio es un rasgo distintivo de las teorías conspirativas, diferenciándolas de los escándalos políticos ordinarios, que suelen permanecer dentro de un solo dominio.

La conectividad multidominio no es un artefacto casual, sino un rasgo estructural que hace que la narrativa conspirativa sea más "pegajosa": cada nuevo dominio añade una capa de plausibilidad y amplía la audiencia.

🔬 Evolución de memes en 4chan: de la interpretación a la movilización

Un análisis detallado del desarrollo de Pizzagate en 4chan mostró cómo la teoría evolucionó en tiempo real mediante un proceso colectivo (S003). El estudio documentó la transición desde la interpretación inicial de correos filtrados hasta la creación de complejos "mapas de conexiones", la identificación de "sospechosos" y los llamados a la acción.

Aspecto crítico: la teoría no fue creada de forma centralizada, sino que surgió mediante un proceso distribuido donde cada participante añadía elementos que luego eran aceptados o rechazados por la comunidad. Este proceso demuestra características de "protesta posverdad", donde la construcción colectiva de la narrativa es más importante que la verificación factual (S007).

| Etapa evolutiva | Característica | Función en la comunidad |

|---|---|---|

| Interpretación | Búsqueda de significados ocultos en filtraciones | Activación cognitiva |

| Mapeo | Visualización de conexiones entre actores | Coordinación social |

| Identificación | Asignación de roles a personas concretas | Anclaje psicológico |

| Movilización | Llamados a la acción (investigación, protesta) | Transición al mundo offline |

🧾 Investigación de QAnon en Voat: estructura comunitaria y toxicidad del contenido

Un estudio exploratorio de QAnon en la plataforma Voat analizó 10 millones de publicaciones y comentarios del subverse /v/GreatAwakening (S006). QAnon surgió en 2017 en 4chan, sosteniendo la idea de que políticos influyentes, aristócratas y celebridades están involucrados en una red pedófila global.

Hallazgos clave: los gobiernos están controlados por "titiriteros", y los funcionarios elegidos democráticamente sirven como fachada falsa de la democracia (S006). La visualización del grafo mostró que algunos temas relacionados con QAnon están estrechamente vinculados con Pizzagate y los llamados "drops" de Q.

Descubrimiento inesperado: las discusiones en /v/GreatAwakening resultaron ser menos tóxicas que en la comunidad general de Voat (S006). Esto muestra que las comunidades QAnon no se caracterizan necesariamente por alta agresividad en la comunicación, lo que puede explicar su atractivo para una audiencia más amplia.

- Baja toxicidad en comunidades cerradas

- Cuando un grupo comparte una narrativa única, la comunicación interna se vuelve más cortés — el enemigo está fuera, no dentro.

- Paradoja del atractivo

- La ausencia de agresión dentro del grupo puede servir como filtro: las personas que buscan conflicto se van; permanecen quienes buscan pertenencia y significado.

🧬 Análisis comparativo con el pánico satánico: paralelismos estructurales

Investigaciones específicamente dedicadas a la conexión de QAnon con el pánico satánico de los años 80 revelaron profundos paralelismos estructurales (S004). Ambas olas se caracterizan por acusaciones contra élites o figuras de autoridad de abuso sistemático de menores y afirmaciones sobre la existencia de redes ocultas que utilizan simbolismo y rituales.

Ambas olas apelan al deber moral de proteger a los niños como justificación de medidas extraordinarias y demuestran resistencia a las refutaciones mediante el mecanismo de "ausencia de pruebas como prueba de encubrimiento". Las consecuencias reales para los acusados incluyen carreras destruidas y procesamientos judiciales.

Diferencia crítica: las teorías modernas se difunden a través de plataformas digitales con una velocidad y escala inalcanzables en los años 80. El pánico satánico requería meses para propagarse entre ciudades; QAnon alcanza millones en días.

⚙️ Perspectiva sociotécnica de la lucha contra la desinformación: por qué el fact-checking no es suficiente

La investigación sobre enfoques sociotécnicos para combatir la desinformación muestra las limitaciones del fact-checking tradicional (S005). El problema no es solo el acceso a la información correcta, sino también los factores cognitivos, sociales y tecnológicos que hacen a las personas susceptibles a narrativas conspirativas.

Los investigadores subrayan la necesidad de un enfoque multinivel: comprender los sesgos cognitivos explotados por la desinformación; considerar la dinámica social de grupos donde las teorías conspirativas se convierten en marcadores de identidad; analizar los mecanismos algorítmicos de las plataformas que amplifican la difusión de contenido emocionalmente cargado (S005).

- Simplemente proporcionar hechos suele ser ineficaz cuando la teoría cumple funciones psicológicas para sus seguidores

- La función social (pertenencia al grupo) a menudo supera la función cognitiva (explicación del mundo)

- Los algoritmos de las plataformas amplifican el contenido emocional independientemente de su veracidad

- Las intervenciones deben abordar los tres niveles simultáneamente, de lo contrario el efecto es mínimo

Mecanismos de impacto: por qué las narrativas conspirativas capturan la conciencia a pesar de los hechos

Comprender los mecanismos causales que hacen convincentes a Pizzagate y QAnon requiere analizar los factores cognitivos, sociales y tecnológicos que crean condiciones ideales para la propagación de teorías conspirativas. Más información en la sección Pirámides financieras y estafas.

🧩 Reconocimiento de patrones y apofenia: el cerebro que ve conexiones en todas partes

El cerebro humano está evolutivamente configurado para detectar patrones, una capacidad crítica para la supervivencia. Sin embargo, esta capacidad conduce a la apofenia: la percepción de conexiones significativas entre fenómenos no relacionados.

Las teorías conspirativas explotan este mecanismo proporcionando abundante material para el reconocimiento de patrones: símbolos, coincidencias de fechas, "códigos" lingüísticos. La investigación sobre Pizzagate mostró cómo los seguidores conectaban sistemáticamente dominios no relacionados mediante la interpretación de "conocimiento oculto" (S002).

Cuanto más buscas conexiones, más encuentras, no porque existan, sino porque la atención selectiva y el sesgo de confirmación crean un ciclo autorreforzante de convicción.

🔁 Mecánica de juego y recompensa: QAnon como realidad alternativa

QAnon utiliza mecánicas similares a los juegos de realidad alternativa (ARG): "drops" enigmáticos que requieren descifrado colectivo, creando la sensación de participar en una investigación (S006).

Esta estructura proporciona recompensa constante: cada "descifrado" genera un pico de dopamina por la sensación de descubrimiento, reconocimiento social de la comunidad y refuerzo de la identidad grupal. El análisis de Voat mostró complejos grafos de conexiones entre drops de Q y eventos, creados por la comunidad (S006): una creatividad colectiva que proporciona satisfacción independientemente de la veracidad factual.

- Enigma → descifrado colectivo → reconocimiento social

- Cada "insight" → pico de dopamina → refuerzo de identidad

- Sin final → juego infinito → compromiso constante

🧷 Aislamiento epistémico: sistemas de creencias autosostenibles

Las teorías conspirativas construyen sistemas epistémicamente cerrados donde cualquier refutación se integra como confirmación.

- Ausencia de pruebas

- se interpreta como prueba de ocultamiento

- Refutaciones de fuentes oficiales

- se consideran parte de la conspiración

- Demandas de pruebas

- se rechazan como ingenuidad o complicidad

La investigación mostró que los seguidores de QAnon perciben a los gobiernos como controlados por "titiriteros", y las instituciones democráticas como un escaparate falso (S006). En este sistema de coordenadas, cualquier información de fuentes convencionales queda automáticamente desacreditada, creando un aislamiento epistémico total.

👁️ Ilusión de conocimiento privilegiado: superioridad epistémica

Las teorías conspirativas proporcionan la sensación de acceso a "conocimiento oculto", inaccesible para las masas "dormidas". Esto crea un sentimiento de superioridad epistémica: "yo conozco la verdad que otros no ven".

El análisis de Pizzagate mostró que la teoría se basa en la interpretación de "conocimiento oculto" para conectar dominios (S002). Los seguidores de QAnon se llaman a sí mismos "despiertos" (awakened), contraponiéndose a las "ovejas" (sheeple) que creen ciegamente en las narrativas oficiales.

No es solo una convicción cognitiva, sino una identidad que proporciona sentido y estatus. Renunciar a la teoría significa perder ese estatus especial y admitir que has sido engañado: una elección psicológicamente dolorosa.

🔬 Amplificación algorítmica: aceleración tecnológica de la propagación

Las plataformas de redes sociales utilizan algoritmos optimizados para el engagement que amplifican desproporcionadamente contenido emocionalmente cargado y polarizante. Las teorías conspirativas, que provocan indignación, miedo y repudio moral, obtienen ventaja algorítmica.

La investigación sobre la evolución de Pizzagate mostró cómo la teoría se propagó en tiempo real a través de 4chan, luego migró a Twitter, Facebook y YouTube (S003). Cada plataforma añadió sus propios mecanismos de amplificación: los algoritmos de recomendación de YouTube creaban "madrigueras de conejo" que conducían de contenido moderado a extremo; los algoritmos de Facebook formaban cámaras de eco donde los usuarios solo veían contenido confirmatorio.

| Plataforma | Mecanismo de amplificación | Efecto |

|---|---|---|

| 4chan | Anonimato + ausencia de moderación | Rápido surgimiento y mutación de la teoría |

| YouTube | Algoritmos de recomendación | "Madrigueras de conejo" de moderado a extremo |

| Cámaras de eco + validación social | Refuerzo grupal de creencias | |

| Plataformas alternativas | Moderación mínima | Migración tras baneos, mayor radicalización |

La investigación sobre QAnon en Voat mostró que tras los baneos en plataformas convencionales, la comunidad migró a plataformas alternativas con aún menos moderación (S006). La tecnología no es neutral: estructura qué ideas se propagan, quién las ve y con qué frecuencia.

La conexión con los sesgos cognitivos muestra que estos mecanismos funcionan no a pesar de nuestro pensamiento, sino a través de sus canales naturales. Comprender los mecanismos conspiratorios requiere analizar no solo el contenido de las teorías, sino también la arquitectura de las plataformas que las propagan.

Conflictos de datos y zonas de incertidumbre: donde la evidencia se contradice

Un análisis honesto requiere reconocer las áreas donde las investigaciones arrojan resultados contradictorios o donde los datos son insuficientes para conclusiones definitivas. Más información en la sección Estadística y teoría de probabilidades.

🧾 Toxicidad de las comunidades QAnon: datos contradictorios

La investigación sobre QAnon en Voat encontró que las discusiones en /v/GreatAwakening eran menos tóxicas que en la comunidad general de Voat (S006). Esto contradice la percepción generalizada de las comunidades QAnon como especialmente agresivas.

Sin embargo, esto podría ser un artefacto de la plataforma específica o del período de investigación. Otros estudios han documentado casos de violencia y amenazas relacionadas con QAnon, incluido el asalto al Capitolio.

La toxicidad puede variar entre plataformas y subgrupos dentro del movimiento, o puede manifestarse no en agresividad textual, sino en disposición a acciones reales.

🔎 Efectividad del desmentido: resultados mixtos

Las investigaciones sobre la efectividad de la verificación de hechos y el desmentido muestran resultados mixtos. Simplemente proporcionar datos a menudo es insuficiente: se activa el efecto boomerang, donde la refutación refuerza la creencia original.

Sin embargo, el desmentido dirigido que considera los motivos psicológicos muestra mayor efectividad. La diferencia en los resultados depende del método, la audiencia y el contexto de difusión de la información.

- La verificación de hechos universal a menudo es ineficaz o contraproducente

- El enfoque personalizado que reconoce las raíces emocionales de la creencia funciona mejor

- El efecto a largo plazo permanece poco claro: se necesitan estudios longitudinales

📊 Rol de las plataformas y algoritmos: datos contradictorios

Algunos estudios señalan el papel decisivo de los algoritmos de recomendación en la difusión de narrativas conspirativas (S001). Otros encuentran que las conexiones sociales y la confianza en la fuente juegan un papel más significativo que el filtrado algorítmico.

Probablemente ambos mecanismos funcionan simultáneamente, pero su peso varía según la plataforma, la demografía de usuarios y el tipo de contenido.

| Factor | Nivel de evidencia | Zona de incertidumbre |

|---|---|---|

| Amplificación algorítmica | Medio | Peso relativo a las redes sociales |

| Confianza social | Alto | Cómo interactúa con los algoritmos |

| Vulnerabilidad emocional | Alto | Qué emociones son más críticas |

| Nivel educativo | Bajo | Paradoja: personas educadas también creen |

🔗 Relación entre creencia en conspiraciones y daño real

Existe correlación entre adhesión a narrativas conspirativas y disposición a la violencia (S004), pero la relación causal permanece controvertida. ¿Es la conspiración causa o síntoma de una alienación más profunda?

Los datos muestran que no todos los creyentes en conspiraciones pasan a la acción. Los mecanismos de control mental y el aislamiento social pueden ser factores intermedios, pero su papel requiere estudio adicional.

- Conflicto de datos

- Existe correlación entre creencia y violencia, pero la mayoría de creyentes no cometen actos violentos.

- Posible explicación

- La conspiración es condición necesaria pero no suficiente para la radicalización. Se necesitan factores adicionales: aislamiento social, trauma personal, influencia de líderes.

⏳ Efectos a largo plazo: datos insuficientes

La mayoría de investigaciones sobre narrativas conspirativas son instantáneas en un momento específico. ¿Cómo salen las personas de las comunidades conspirativas? ¿Qué factores contribuyen a la reevaluación de creencias? Esto permanece poco estudiado.

La investigación (S006) comienza a llenar este vacío, pero los datos sobre trayectorias a largo plazo de creyentes siguen siendo insuficientes para conclusiones fiables.