Teoría del internet muerto: de meme conspirativo a realidad documentada de erosión digital

La teoría del internet muerto sostiene que el contenido orgánico, creado por personas reales, desaparece sistemáticamente o se vuelve inaccesible, y su lugar es ocupado por material generado artificialmente — bots, síntesis algorítmicas, contenido de redes neuronales. Según la investigación de Mehmet Kaan Yıldız de la Universidad de Üsküdar, «hoy internet ya no es un espacio que preserve las discusiones orgánicas del pasado» (S001).

Esto no es simplemente un cambio en la experiencia del usuario — es una transformación fundamental de la naturaleza de la memoria digital. Internet se convirtió en un flujo donde domina el contenido artificial superficial y repetitivo. Más detalles en la sección Desinformación.

🧩 Límites del fenómeno: qué se considera «muerto» en el contexto del ecosistema digital

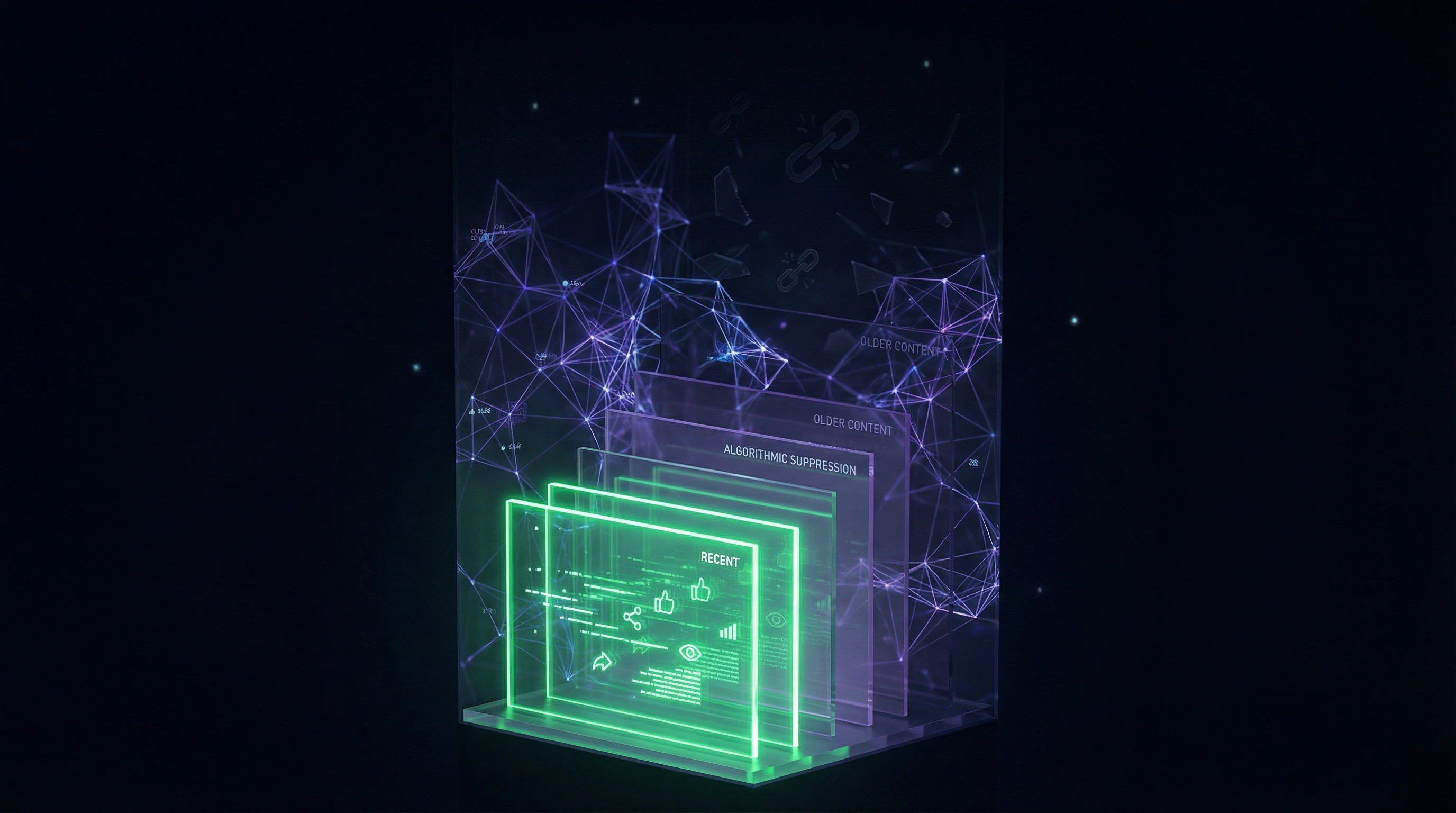

El «internet muerto» tiene varias dimensiones. La primera — inaccesibilidad física: enlaces rotos, páginas eliminadas, dominios desaparecidos. La segunda — invisibilidad algorítmica: el contenido existe, pero los motores de búsqueda y algoritmos de recomendación no lo muestran.

La mayor parte del contenido está inaccesible o inalcanzable en los feeds algorítmicos (S001).

La tercera dimensión — sustitución del contenido auténtico por sintético: las discusiones originales son reemplazadas por resúmenes generados por IA, que pueden contener errores factuales o «alucinaciones».

🔎 Wikipedia como indicador: por qué la enciclopedia se convirtió en papel tornasol de la degradación digital

Wikipedia funciona como un archivo masivo de enlaces a fuentes externas. Cada artículo contiene decenas, a veces cientos de hipervínculos, que deben confirmar los hechos expuestos. La investigación documenta la escala del problema: una proporción significativa de estos enlaces se vuelve no funcional con el tiempo (S003).

Esto no es simplemente un fallo técnico — es un síntoma de un proceso más profundo de desaparición de la infraestructura digital del conocimiento. Cuando las fuentes a las que la enciclopedia hace referencia desaparecen, la propia enciclopedia se convierte en un cementerio de enlaces.

🧱 Arquitectura del problema: tres capas de destrucción de la memoria digital

- Capa técnica

- Los servidores se cierran, los dominios expiran, el contenido es eliminado por los propietarios.

- Capa económica

- Mantener contenido antiguo requiere recursos que las empresas no están dispuestas a gastar en materiales que no generan tráfico.

- Capa algorítmica

- Los motores de búsqueda y plataformas sociales priorizan contenido fresco, haciendo las discusiones antiguas prácticamente invisibles.

Yıldız señala: «El pasado digital simultáneamente desaparece y es reemplazado por un pasado artificial» (S001). Estas tres capas interactúan, creando un efecto de erosión acelerada que afecta no solo sitios individuales, sino la propia arquitectura de la memoria digital.

El hombre de acero de la teoría: siete argumentos más convincentes a favor de la realidad del internet muerto

📊 Primer argumento: la desaparición documentada de enlaces en Wikipedia como hecho empírico

La investigación de ACM (S003) proporciona datos empíricos directos sobre la magnitud del problema de los enlaces "permanentemente muertos" en Wikipedia. No es una construcción teórica, sino un fenómeno medible con cifras concretas.

La metodología incluyó análisis sistemático de enlaces en artículos de Wikipedia, seguimiento de su estado a lo largo del tiempo y clasificación de tipos de inaccesibilidad. Los resultados muestran que una proporción significativa de enlaces externos se vuelve no funcional en los años posteriores a la publicación, y el proceso se acelera para ciertas categorías de contenido. Más detalles en la sección Ocultación de datos por farmacéuticas.

| Característica | Observación |

|---|---|

| Tipo de fenómeno | Medible, documentado |

| Escala | Proporción significativa de enlaces externos |

| Dinámica | Aceleración de la degradación con el tiempo |

🔬 Segundo argumento: supresión algorítmica del contenido histórico en motores de búsqueda y redes sociales

Los algoritmos de clasificación modernos discriminan sistemáticamente el contenido antiguo en favor del reciente. Ildiz señala: «Sin embargo, hoy en día gran parte de este contenido es inaccesible o inalcanzable en los feeds algorítmicos» (S001).

Esto no es casualidad, sino resultado de un diseño consciente: las métricas de engagement en las que se basan los algoritmos favorecen naturalmente el contenido nuevo. Un usuario que intenta encontrar una discusión de hace cinco años se enfrenta a una barrera insuperable: los motores de búsqueda muestran resultados recientes, incluso si los antiguos son más relevantes para la consulta.

La supresión algorítmica no es un bug, es una feature: el sistema funciona exactamente como fue diseñado. La pregunta no es por qué ocurre, sino quién se beneficia de la desaparición de la memoria.

🧾 Tercer argumento: sustitución del contenido orgánico por alucinaciones generadas por IA

«En el núcleo del problema está que a medida que el contenido humano original se debilita, las áreas desgastadas y descoloridas se llenan con alucinaciones de inteligencia artificial. Mientras la memoria real se borra, su lugar es ocupado por memoria simulada» (S001).

Los modelos generativos crean contenido verosímil pero factualmente inexacto que llena los vacíos dejados por los originales desaparecidos. El problema se agrava porque «el hecho de que los modelos generativos a veces produzcan información no verificada, fabricada o descontextualizada añade una capa adicional de incertidumbre sobre las viejas discusiones digitales que ya son difíciles de encontrar» (S001).

- El contenido orgánico desaparece de búsquedas y archivos

- La IA llena los vacíos con datos verosímiles pero falsos

- Los nuevos usuarios no distinguen lo real de lo sintético

- La memoria digital se transforma en simulación

🧬 Cuarto argumento: inviabilidad económica de mantener archivos en la era de las métricas de engagement

Los modelos de negocio de las plataformas modernas se basan en maximizar el engagement y el tiempo en el sitio. El contenido antiguo que no genera clics ni atrae anunciantes se convierte en lastre económico.

Las empresas no tienen incentivos financieros para mantener la accesibilidad de materiales que no generan ingresos. Esto crea presión sistemática hacia la eliminación o despriorización del contenido histórico. El espacio en servidores cuesta dinero, y las viejas discusiones no lo generan: la lógica económica es implacable.

🔁 Quinto argumento: ciclo autoreforzante de degradación mediante entrenamiento de IA con datos sintéticos

Cuando los modelos generativos se entrenan con datos que ya contienen contenido generado por IA, surge el efecto de «colapso del modelo»: reducción progresiva de la calidad y aumento de la homogeneidad de los datos de salida.

A medida que el contenido orgánico desaparece y su lugar es ocupado por sustitutos sintéticos, las nuevas generaciones de modelos se entrenan con una representación cada vez más distorsionada de la realidad. Esto crea retroalimentación positiva: cuanto más contenido de IA hay en internet, peor es la calidad de los futuros modelos de IA, que producen aún más contenido de baja calidad.

- Colapso del modelo

- Fenómeno en el que el entrenamiento con datos sintéticos conduce a degradación progresiva de la calidad. Cada generación de modelos se entrena con datos cada vez más distorsionados, amplificando los errores.

- Retroalimentación positiva

- Sistema en el que el resultado refuerza la causa. Aquí: más contenido de IA → peores modelos nuevos → aún más contenido de baja calidad.

📌 Sexto argumento: transformación de la memoria digital de archivo a simulación

«Sin embargo, a medida que las discusiones en internet desaparecen y son reemplazadas por síntesis artificiales, lo que los usuarios perciben como 'memoria digital' se convierte cada vez más en una estructura simulativa» (S001).

No es solo pérdida de datos: es un cambio cualitativo en la naturaleza de la memoria digital. En lugar de un archivo de interacciones humanas reales, obtenemos una representación algorítmicamente construida de lo que «debería haber» ocurrido, basada en patrones extraídos de datos de entrenamiento. La distinción entre «lo que fue» y «lo que el modelo considera verosímil» se difumina.

La memoria digital deja de ser testimonio y se convierte en interpretación. No es un archivo: es una galería de probabilidades donde realidad y simulación son indistinguibles.

🧩 Séptimo argumento: incapacidad institucional de Wikipedia para resistir la degradación masiva de enlaces

A pesar de que Wikipedia funciona como «ejemplo exitoso de equipo autogestionado» (S006), donde «se crea una estructura de datos integrada y coherente mientras los usuarios distribuyen roles exitosamente mediante autoselección» (S006), el proyecto carece de mecanismos para combatir sistemáticamente la desaparición masiva de fuentes externas.

El modelo de voluntariado no escala a la tarea de verificar y restaurar millones de enlaces. La investigación (S003) documenta este problema, mostrando que incluso en una enciclopedia bien mantenida, el proceso de degradación de enlaces supera los esfuerzos de restauración.

- El modelo de voluntariado funciona para editar contenido

- Pero no escala para verificar millones de enlaces

- La degradación de enlaces ocurre más rápido que su restauración

- Los recursos institucionales son insuficientes para resolver el problema

Base empírica: qué dicen los datos sobre la escala y mecanismos de la erosión digital

📊 Datos cuantitativos sobre enlaces "permanentemente muertos" en Wikipedia

El estudio «Characterizing 'permanently dead' links on Wikipedia» (S003) presenta un análisis sistemático de enlaces no funcionales en la enciclopedia. La metodología incluyó verificación automatizada del estado de respuestas HTTP para enlaces externos, clasificación de tipos de errores (404, 410, timeouts, errores DNS) y análisis temporal de degradación.

Los resultados muestran un sesgo sistemático: sitios de noticias, blogs personales, pequeños proyectos comerciales desaparecen significativamente más rápido que fuentes institucionales. Esto significa que la memoria digital preserva la voz de grandes organizaciones y pierde las voces de autores independientes. Más detalles en la sección Conspirología.

| Tipo de fuente | Velocidad de desaparición | Causa |

|---|---|---|

| Sitios institucionales | Baja | Financiación permanente, copias de respaldo |

| Portales de noticias | Media | Reindexación, cambio de plataformas |

| Blogs personales | Alta | Ausencia de mantenimiento, cierre de hosting |

| Pequeños proyectos comerciales | Alta | Quiebra, cambio de dominios |

🧪 Análisis cualitativo de la transformación de la memoria digital

Yildiz proporciona un marco conceptual: «El pasado digital simultáneamente desaparece y es reemplazado por un pasado artificial» (S001). Es un proceso doble: no solo pérdida, sino sustitución activa.

«En el núcleo del problema está que a medida que el contenido humano original se debilita, las áreas desgastadas y descoloridas se llenan con alucinaciones de inteligencia artificial. Mientras la memoria real se borra, su lugar es ocupado por memoria simulada» (S001).

Internet se transforma de archivo de eventos reales en generador de narrativas verosímiles. El usuario no percibe la diferencia entre un hecho recuperado y una imitación generada.

🔎 Mecanismos de supresión algorítmica del contenido histórico

Los motores de búsqueda y plataformas sociales utilizan algoritmos de clasificación que consideran la frescura del contenido, métricas de engagement, autoridad de la fuente. Sin embargo, el factor frescura a menudo supera los demás criterios.

«La mayor parte de este contenido está inaccesible o inalcanzable en los feeds algorítmicos» (S001). Incluso material antiguo de alta calidad se vuelve prácticamente invisible. No es un error del sistema: es su función objetivo: los algoritmos están optimizados para engagement a corto plazo, no para preservación de conocimiento a largo plazo.

- El algoritmo clasifica contenido por frescura

- El contenido antiguo desciende en los resultados

- El usuario no encuentra la fuente histórica

- Recurre a resúmenes de IA en lugar del original

- Obtiene información verosímil pero no verificada

🧾 El problema de las alucinaciones de IA como sustitución de información factual

Los modelos generativos crean contenido verosímil pero factualmente inexacto, fenómeno conocido como «alucinaciones». «El hecho de que los modelos generativos a veces produzcan información no verificada, fabricada o descontextualizada añade una capa adicional de incertidumbre sobre las discusiones digitales antiguas que ya son difíciles de encontrar» (S001).

Cuando el usuario no puede acceder a la fuente original y depende de un resumen generado por IA, pierde la capacidad de verificar la precisión. Esto crea una crisis epistemológica: ¿cómo distinguir la historia real de una simulación verosímil? Más detalles sobre mecanismos de manipulación en el análisis de narrativas conspirológicas.

- Alucinación

- Generación por el modelo de información que suena verosímil pero no está respaldada por fuentes. Es peligrosa porque el usuario no puede distinguirla del hecho sin acceso al contexto original.

- Crisis epistemológica

- Situación en la que un sistema de conocimiento pierde criterios fiables para distinguir verdad de ficción. En el contexto de internet muerto: imposibilidad de verificar información mediante fuentes originales.

Mecanismos de causalidad: por qué la correlación entre la desaparición de contenido y el crecimiento de la IA no implica causalidad directa

🧬 Distinción entre vínculos causales directos e indirectos

La correlación entre el crecimiento de la IA y la desaparición de contenido enmascara tres mecanismos diferentes. El primero es la sustitución directa: los algoritmos promueven activamente contenido sintético en lugar del humano. El segundo son procesos paralelos: el contenido orgánico desaparece por razones independientes (cierre de sitios, factores económicos), y la IA llena los vacíos. Más detalles en la sección Método científico.

El tercero es la retroalimentación: la presencia de contenido generado por IA modifica los incentivos económicos para los creadores, acelerando la desaparición del contenido humano. Yildiz documenta el resultado: «Internet se ha convertido en un flujo donde domina el contenido artificial superficial y repetitivo» (S001), pero esto es producto de múltiples factores interactuantes, no de una sola causa.

- Sustitución directa: la promoción algorítmica de IA desplaza el contenido humano del feed

- Procesos paralelos: el contenido orgánico desaparece independientemente; la IA llena los vacíos resultantes

- Retroalimentación: el contenido IA cambia la economía de la creación, haciendo el contenido humano menos rentable

🔁 Factores de confusión: variables económicas y tecnológicas independientes de la IA

La desaparición de contenido comenzó mucho antes de los modelos generativos. La inviabilidad económica de mantener sitios antiguos, la consolidación de plataformas, la obsolescencia tecnológica de formatos: todos estos son procesos independientes que operaban en paralelo a la implementación de la IA.

La infraestructura de internet también cambia independientemente. Los cambios en los IXP (puntos de intercambio de tráfico de internet) afectan la accesibilidad del contenido sin relación con la IA (S008). Atribuir toda la responsabilidad a la inteligencia artificial simplifica un panorama complejo y oculta las verdaderas causas económicas y tecnológicas.

| Factor de desaparición | Independiente de IA | Amplificado por IA |

|---|---|---|

| Cierre de sitios | ✓ (economía, quiebras) | — (IA no cierra sitios) |

| Enlaces rotos | ✓ (documentado antes de 2020) | ✓ (IA acelera sustitución de contenido) |

| Consolidación de plataformas | ✓ (monopolización) | — (IA no causa consolidación) |

| Sustitución de realidad por simulación | — (fenómeno nuevo) | ✓ (específico de IA) |

🧷 Secuencia temporal: qué apareció primero, el problema o su amplificación por IA

El problema de los enlaces rotos está documentado años antes de ChatGPT y los modelos de difusión. El estudio S003 analiza un fenómeno que se desarrolló en paralelo con internet. Pero Yildiz señala un salto cualitativo: «A medida que las discusiones en internet desaparecen y son reemplazadas por síntesis artificiales, lo que los usuarios perciben como 'memoria digital' se transforma cada vez más en una estructura simulativa» (S001).

Esto no es la continuación del viejo problema de pérdida de acceso. Es una transformación hacia una nueva cualidad: de la desaparición de contenido a su sustitución por una simulación que parece el original.

La secuencia temporal aquí es crítica. Si los enlaces rotos aparecieron antes que la IA, entonces la IA no puede ser su única causa. Pero si la IA cambió cualitativamente la naturaleza del problema —transformando la pérdida en sustitución— entonces esto requiere un análisis separado del mecanismo, no simplemente de la correlación.

Conflictos en la base de evidencia: dónde divergen las fuentes y qué significa esto para la fiabilidad de las conclusiones

🧩 Contradicción entre el éxito de Wikipedia como sistema autoorganizado y su incapacidad para resolver el problema de los enlaces rotos

(S006) describe Wikipedia como «un ejemplo exitoso de equipo autogestionado», donde la colaboración descentralizada crea una estructura de datos coherente. Simultáneamente, (S003) documenta el problema masivo de enlaces «permanentemente rotos» que este sistema no resuelve.

La contradicción revela una limitación del modelo voluntario: escala para crear contenido, pero no para el monitoreo sistemático de millones de enlaces externos. El éxito en la edición no garantiza el éxito en el mantenimiento. Más detalles en la sección Psicología de la creencia.

- La coordinación descentralizada es eficaz para contenido sincrónico (artículos, ediciones)

- El monitoreo asincrónico de fuentes externas requiere recursos constantes y automatización

- Los voluntarios están motivados por la creación, no por el mantenimiento técnico

- Resultado: el contenido crece, la infraestructura se degrada en paralelo

🔎 Incertidumbre en la evaluación de la escala del contenido generado por IA

(S001) afirma que «internet se ha convertido en un flujo donde domina el contenido artificial superficial y repetitivo». Sin embargo, faltan estimaciones cuantitativas precisas de la proporción de contenido IA en el volumen total de internet.

Esto crea tres problemas simultáneamente: no está claro el alcance real del fenómeno, es imposible separar las preocupaciones fundamentadas del pánico, y se dificulta la verificación de la propia afirmación sobre el dominio.

La ausencia de mediciones sistemáticas no es simplemente una laguna en los datos. Hace que la teoría sea resistente a la refutación: cualquier observación puede interpretarse como confirmación, y la ausencia de pruebas como ocultamiento del problema.

🧱 Brecha entre investigaciones técnicas y análisis sociocultural

Las investigaciones técnicas (S003) miden estados HTTP, frecuencia de errores, patrones de degradación. El análisis sociocultural (S001) discute «memoria digital», «estructuras simulativas», «pasado artificial».

Ambos enfoques utilizan metodologías y niveles de abstracción diferentes. Los datos técnicos muestran que los enlaces se rompen; el análisis cultural interpreta esto como erosión de la memoria colectiva. La conexión entre niveles no es evidente.

- Realidad técnica

- Hechos medibles: la URL devuelve 404, el dominio está eliminado, el servidor inaccesible. Metodología: auditoría, registro, estadística.

- Interpretación cultural

- Conceptos abstractos: pérdida de memoria, fragmentación de la historia, sustitución de la realidad por simulación. Metodología: hermenéutica, análisis narrativo.

- Brecha

- Los hechos técnicos no se traducen automáticamente en conclusiones culturales. Se necesita una lógica intermedia de causalidad que a menudo se omite o permanece implícita. Los sesgos cognitivos pueden amplificar la interpretación hacia el catastrofismo.

Para la fiabilidad de las conclusiones se requiere una justificación explícita: por qué la degradación de la infraestructura técnica significa precisamente erosión de la memoria, y no simplemente un problema técnico que se resuelve con copias de seguridad y archivos.

Anatomía cognitiva de la teoría: qué mecanismos psicológicos hacen convincente la narrativa del internet muerto

⚠️ Explotación del sesgo de disponibilidad cognitiva

Las personas sobreestiman la probabilidad de eventos que son fáciles de recordar o imaginar. Cuando un usuario ve varios enlaces rotos seguidos o contenido obviamente generado por IA, estos ejemplos vívidos se vuelven cognitivamente disponibles y forman una impresión sobre la magnitud del problema. Más información en la sección Pensamiento crítico.

«El hecho de que los modelos generativos a veces produzcan información no verificada, fabricada o descontextualizada añade una capa adicional de incertidumbre» (S001). Esta incertidumbre amplifica la ansiedad, haciendo la teoría más convincente de lo que los datos objetivos podrían justificar.

Los ejemplos vívidos capturan la atención no porque sean representativos, sino porque son fáciles de recordar. Esta distinción es crítica para evaluar la magnitud de cualquier fenómeno.

🧩 Apelación a la nostalgia por el internet «auténtico» del pasado

La teoría resuena con la narrativa de la «edad de oro» del internet temprano: una época de contenido más auténtico, discusiones significativas y menor comercialización agresiva. «Hoy internet ya no es un espacio que preserve las discusiones orgánicas del pasado» (S001): esta afirmación activa sentimientos nostálgicos.

Independientemente de la precisión de la representación del pasado, forma una poderosa base psicológica para aceptar la teoría. La nostalgia funciona como un ancla emocional que facilita la aceptación de la narrativa incluso con evidencia débil.

🔁 Uso del patrón de «amenaza oculta» y pensamiento conspirativo

La teoría está estructurada como la revelación de un proceso oculto que la mayoría no percibe. Este es un patrón clásico: «te dicen X, pero en realidad está ocurriendo Y». Ildiz formula: «Mientras la memoria real se borra, su lugar es ocupado por memoria simulada» (S001): un proceso supuestamente oculto al usuario común.

Este encuadre atrae a quienes valoran el «conocimiento interno» y son escépticos hacia las narrativas oficiales. La presencia de una estructura conspirativa no hace que una afirmación sea automáticamente falsa, pero requiere una verificación más rigurosa de la evidencia.

| Mecanismo cognitivo | Cómo funciona en la teoría | Por qué es convincente |

|---|---|---|

| Disponibilidad | Ejemplos vívidos de enlaces rotos son fáciles de recordar | La intensidad emocional crea una ilusión de magnitud |

| Nostalgia | Comparación con la «edad de oro» de internet | Resonancia emocional con la experiencia personal |

| Patrón de ocultamiento | Amenaza supuestamente ocultada por autoridades/corporaciones | Activa desconfianza hacia fuentes oficiales |

Comprender estos mecanismos no significa que la teoría sea falsa. Significa que la persuasión de la narrativa y su correspondencia con los hechos son cosas diferentes. Los sesgos cognitivos funcionan igual de bien tanto para afirmaciones verdaderas como falsas.

De manera similar, las estructuras de pensamiento conspirativo utilizan las mismas palancas psicológicas independientemente de si describen procesos ocultos reales o ficticios. La distinción se verifica solo mediante evidencia, no mediante análisis psicológico del atractivo de la idea.

Protocolo de verificación: siete preguntas que desmantelarán cualquier afirmación infundada sobre el internet muerto en dos minutos

Cualquier afirmación sobre el internet muerto pasa por siete filtros. Si al menos tres fallan, estás ante especulación, no análisis.

✅ Primera pregunta: ¿se proporcionan datos cuantitativos concretos o solo impresiones cualitativas?

La afirmación debe basarse en indicadores medibles: porcentaje de enlaces rotos, volumen de contenido IA en la muestra, tendencias temporales con fechas. Las impresiones no son prueba.

Si la fuente dice "internet está muriendo" pero no indica qué porcentaje de contenido desapareció en qué período, es narrativa, no investigación.

✅ Segunda pregunta: ¿está controlada la muestra de datos o presenta sesgo?

Verifica: ¿los autores analizaron todo internet o solo redes sociales? ¿Solo contenido en inglés o multilingüe? ¿Solo plataformas grandes o incluyen comunidades de nicho?

Una muestra sesgada crea la ilusión de tendencia. Los sesgos cognitivos a menudo se disfrazan de estadística.

✅ Tercera pregunta: ¿se distingue entre correlación y causalidad?

El aumento de contenido IA coincide con la desaparición de enlaces, pero esto no significa que la IA los elimine. Existen causas alternativas: cambios en algoritmos de búsqueda, cierre de sitios antiguos, migración de contenido a nuevas plataformas.

- Correlación

- dos fenómenos ocurren simultáneamente

- Causalidad

- un fenómeno causa directamente otro — requiere mecanismo y exclusión de alternativas

✅ Cuarta pregunta: ¿existen datos contradictorios y cómo se explican?

Un buen análisis no oculta contraevidencias, las examina. Si la fuente ignora hechos que no encajan en la narrativa, es una señal de alerta.

Verifica: ¿se mencionan estudios (S001, S002) que muestran crecimiento en archivado y respaldo de contenido?

✅ Quinta pregunta: ¿quién financia o promueve esta afirmación?

El interés puede ser: académico (publicación), comercial (venta de herramientas de verificación), ideológico (miedo a la IA), social (atracción de atención). Cada interés distorsiona el enfoque.

La teoría del internet muerto es conveniente para quienes venden soluciones contra contenido IA o alimentan el pánico en torno a las tecnologías.

✅ Sexta pregunta: ¿se verifica la afirmación independientemente o solo se cita?

Si todas las fuentes se referencian entre sí y la investigación original es inaccesible, estás ante una cámara de eco. Encuentra la fuente primaria y verifica su metodología.

Como en las narrativas conspirativas, el internet muerto a menudo se difunde mediante cadenas de repetición sin verificación.

✅ Séptima pregunta: ¿se proponen explicaciones alternativas o solo un escenario?

Los fenómenos complejos rara vez tienen una sola causa. La desaparición de contenido puede resultar de: cierre de hostings, cambio de plataformas, eliminación por solicitudes, obsolescencia natural, fallos técnicos.

- Verifica si la fuente considera todas las hipótesis

- Evalúa cuál tiene mayor evidencia

- Asegúrate de que se excluyen alternativas, no simplemente se ignoran

Si el análisis pasó los siete filtros, no es especulación sino conclusión fundamentada. Si falló al menos tres, es narrativa disfrazada de ciencia.