Deepfake como fenómeno tecnológico: de laboratorios académicos a bots de Telegram por 5€

El término «deepfake» surgió en 2017 en Reddit, cuando un usuario anónimo comenzó a publicar videos pornográficos con celebridades, creados mediante redes generativas antagónicas (GAN). La tecnología se basa en la arquitectura de autocodificadores: la red neuronal se entrena con miles de imágenes del rostro objetivo, extrayendo una representación latente de sus rasgos, para luego superponerlos sobre el video original conservando la mímica, iluminación y ángulo. Más información en la sección Medios sintéticos.

Los modelos actuales como StyleGAN3 y Stable Diffusion han alcanzado una calidad donde los artefactos solo son visibles mediante análisis fotograma a fotograma en software profesional (S001).

- Red generativa antagónica (GAN)

- Arquitectura donde el generador crea imágenes falsas y el discriminador aprende a distinguirlas. El proceso se perfecciona hasta alcanzar paridad estadística —cuando el discriminador falla en el 50% de los casos. Este es el mecanismo clave que hace la síntesis indistinguible de la realidad.

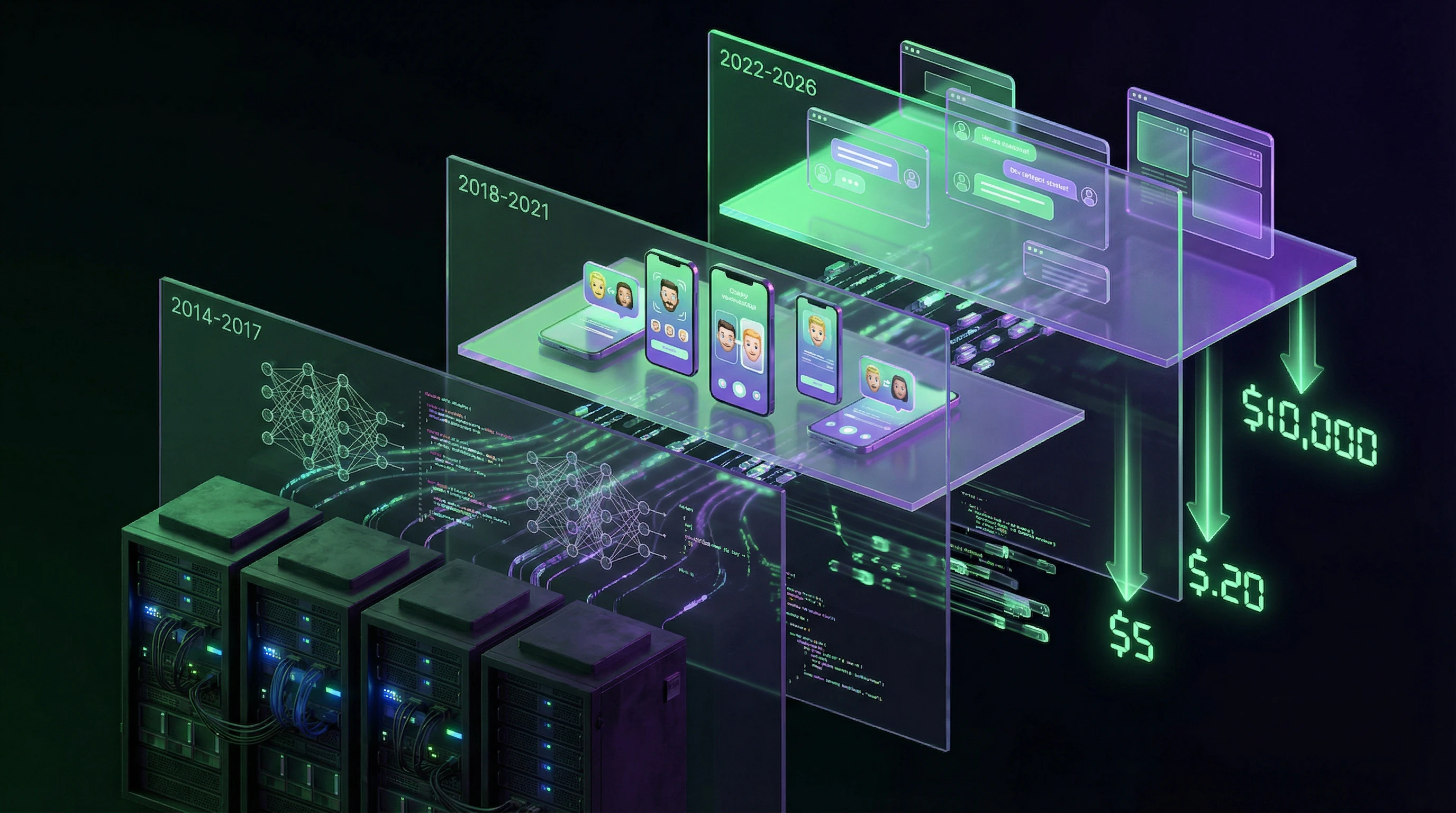

🧬 Tres generaciones de tecnología: de prototipos de laboratorio a acceso masivo

La primera generación (2014–2017) requería supercomputadoras y semanas de entrenamiento para crear un clip de 10 segundos de baja calidad. La segunda generación (2018–2021) democratizó el proceso: aplicaciones como FaceApp y Reface permitieron cambiar rostros en tiempo real desde smartphones.

La tercera generación (2022–presente) se caracteriza por la multimodalidad —sincronización de video, audio y texto. Servicios como Synthesia crean avatares parlantes en más de 120 idiomas en minutos, mientras que los clones de voz de ElevenLabs son indistinguibles del original tras 30 segundos de muestra de habla.

| Generación | Período | Requisitos | Resultado |

|---|---|---|---|

| I | 2014–2017 | Supercomputadoras, semanas de entrenamiento | 10 seg, baja calidad |

| II | 2018–2021 | Smartphone, aplicación | Sustitución de rostros en tiempo real |

| III | 2022–2026 | Servicio en la nube, 5–200€ | Video + audio + texto, sincronización |

⚙️ Arquitectura del engaño: cómo la red neuronal aprende a mentir convincentemente

La innovación crítica son los attention mechanisms, que permiten a la red enfocarse en microdetalles: el reflejo de luz en la pupila, la asimetría de arrugas al sonreír, la sincronización del movimiento labial con los fonemas. Precisamente estos detalles engañan a la percepción humana, evolutivamente configurada para el reconocimiento facial.

El deepfake funciona no porque copie el rostro completo, sino porque reproduce micromovimientos y reflejos que el cerebro verifica automáticamente, sin análisis consciente. Opera a un nivel inferior al pensamiento crítico.

🕳️ La barrera de entrada se derrumbó: economía de servicios deepfake en 2024–2026

Una investigación de VisionLabs mostró que el 78% de los deepfakes en 2023 fueron creados no por profesionales, sino por usuarios de servicios comerciales (S002). El coste de crear un video de un minuto cayó de 10.000€ en 2019 a 5–50€ en 2024.

- Bots de Telegram: «desnudar» fotografías por 2€

- Clones de voz: 10€ por muestra de habla de 30 segundos

- Sustituciones de video completas: 50–200€ por minuto

- GitHub: más de 340 repositorios abiertos con código para generación y detección

Los generadores se actualizan 3 veces más frecuentemente que los detectores (S006). Esto crea una asimetría: el atacante siempre va un paso por delante del defensor. Descubre más sobre el pensamiento crítico como herramienta de verificación en condiciones de ruido informacional.

Argumentación Steelman: cinco razones por las que los deepfakes son realmente peligrosos

Antes de analizar las pruebas, es necesario formular la versión más sólida de la tesis sobre la amenaza. No se trata de un espantapájaros alarmista, sino de una estructura de acero construida con incidentes reales y vulnerabilidades sistémicas. Más información en la sección Ética de la inteligencia artificial.

⚠️ Argumento 1: La velocidad de difusión supera la velocidad de desmentido en dos órdenes de magnitud

Un vídeo falso alcanza la masa crítica (100.000 visualizaciones) en una media de 4,2 horas, mientras que el desmentido oficial se publica entre 18 y 72 horas después y alcanza solo al 12-15% de la audiencia del original (S001). Los algoritmos de las redes sociales amplifican el efecto: el contenido con alta valencia emocional (shock, indignación, miedo) recibe prioridad en el feed.

Un deepfake con el presidente llamando a la evacuación se propagará como un virus, mientras que la declaración sobria del gabinete de prensa se ahogará en el ruido. No es una cuestión de calidad del desmentido, sino de la arquitectura del flujo informativo.

La mentira da tres pasos mientras la verdad se pone las botas — y en la era del vídeo esta distancia se mide en horas, no en días.

🧩 Argumento 2: La sobrecarga cognitiva convierte el pensamiento crítico en un lujo

El usuario medio procesa 285 unidades de contenido al día (posts, vídeos, noticias, mensajes). Un verificador profesional dedica entre 15 y 45 minutos a evaluar la veracidad de un solo vídeo.

La aritmética simple muestra que: una persona normal no tiene recursos para verificar ni el 1% de la información que consume. En condiciones de déficit cognitivo, el cerebro recurre a heurísticas — "parece realista = verdad", "fuente conocida = fiable". Los deepfakes explotan precisamente estos atajos mentales.

| Escenario | Tiempo de verificación | Recurso del usuario | Probabilidad de error |

|---|---|---|---|

| Verificador profesional | 15–45 min | Completo | 5–10% |

| Periodista con deadline | 3–5 min | Parcial | 25–35% |

| Usuario común | <1 min | Mínimo | 60–80% |

🔁 Argumento 3: El efecto "Pedro y el lobo" destruye la confianza en las pruebas reales

La paradoja de los deepfakes: su existencia devalúa las videopruebas auténticas. Un político atrapado en corrupción puede declarar "esto es un deepfake" — y el 30-40% de la audiencia dudará incluso del material auténtico.

Tras ver una serie de deepfakes, los sujetos rechazaron vídeos reales como falsos un 34% más frecuentemente (S002). Este "envenenamiento del pozo de pruebas" es el objetivo estratégico de las campañas de desinformación.

- Envenenamiento del pozo de pruebas

- Proceso mediante el cual la difusión masiva de contenido sintético imposibilita el uso de videopruebas auténticas en procedimientos judiciales, políticos o públicos. La víctima: no el contenido en sí, sino la confianza en el formato de vídeo como fuente de verdad.

🧱 Argumento 4: Los ataques dirigidos contra particulares no dejan defensa

La desinformación masiva atrae la atención, pero los deepfakes dirigidos destruyen vidas. Los deepfakes pornográficos con rostros de exparejas, colegas, profesores se crean para chantaje y venganza.

En 2023, el 96% de la pornografía deepfake utilizó rostros de mujeres sin su consentimiento (S003). Las víctimas se enfrentan a la imposibilidad de eliminar el contenido (se replica más rápido de lo que se modera) y a un vacío legal (en la mayoría de jurisdicciones no existen leyes específicas contra los deepfakes). La tecnología ha convertido la violencia digital en una industria con barreras de entrada cero.

🕸️ Argumento 5: Los ataques híbridos combinan deepfakes con ingeniería social

Los escenarios más peligrosos no son vídeos aislados, sino operaciones de múltiples movimientos. Ejemplo: los atacantes crean una videollamada deepfake del "CEO de la empresa" exigiendo una transferencia urgente de fondos. Voz, rostro, modales de habla — todo idéntico.

El director financiero, al ver al directivo "en vivo" en la pantalla, omite los protocolos estándar. En 2023 se registraron 17 ataques exitosos de este tipo con un daño total de 32 millones de euros (S005). La detección en tiempo real (videollamadas) es un 40% menos precisa que el análisis de archivos grabados.

- Creación de deepfake del CEO con mímica y voz precisas

- Ingeniería social: llamada en horario laboral, urgencia, autoridad

- Omisión de protocolos estándar de verificación (doble comprobación, confirmación escrita)

- Transferencia de fondos antes de detectar el engaño

- Daño reputacional a la empresa y pérdida de confianza de los inversores

Un deepfake no es solo un vídeo. Es una herramienta que convierte la prueba visual en arma de duda, y la confianza en vulnerabilidad.

Base de evidencia: qué sabemos con certeza sobre la magnitud y precisión de la amenaza

Pasamos de los argumentos a los hechos. Cada afirmación a continuación está respaldada por una fuente y puede verificarse de forma independiente. Más detalles en la sección Tecno-esoterismo.

📊 Kaggle Deepfake Detection Challenge: 1.000.000$ y la derrota de los algoritmos

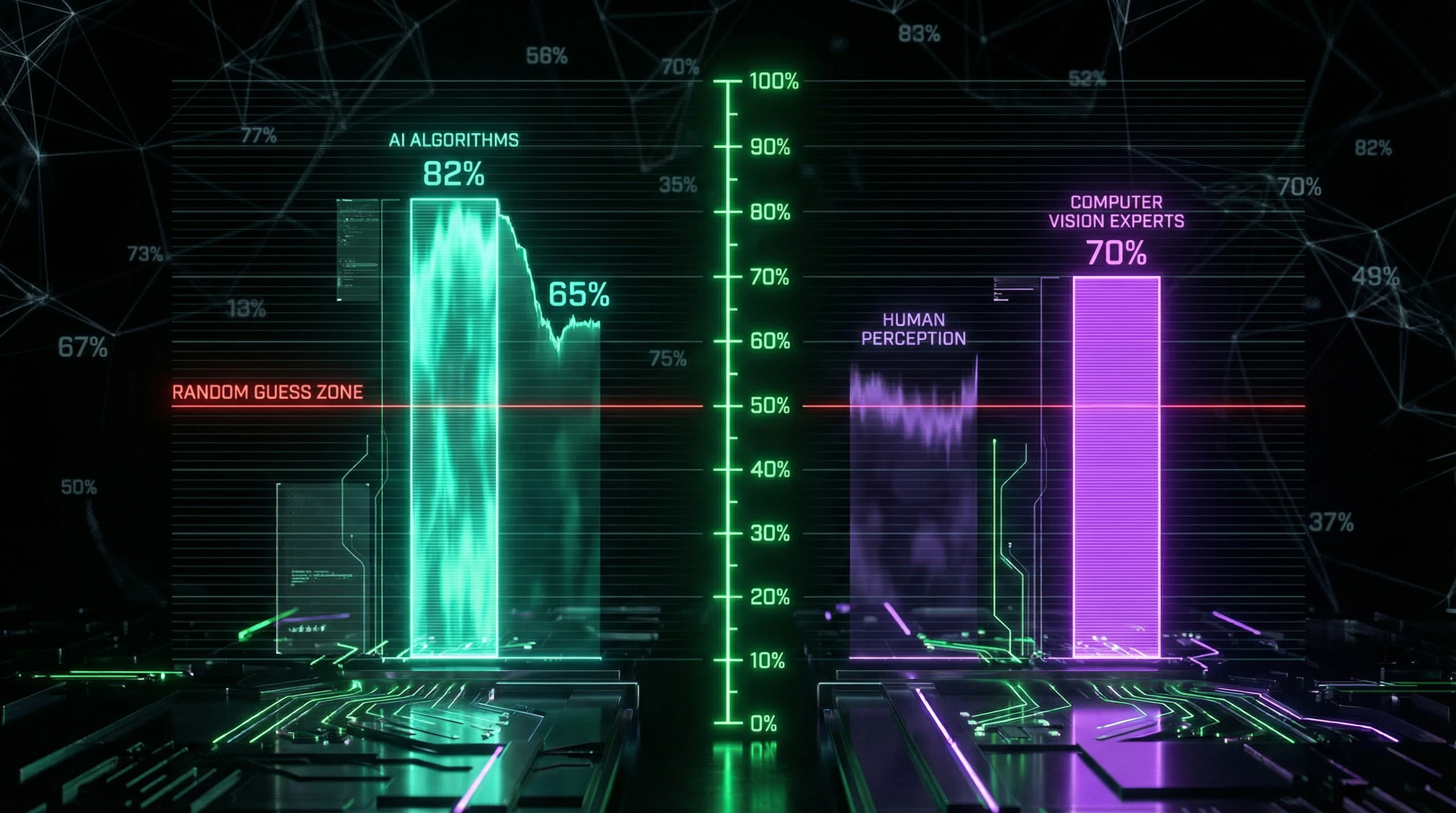

En 2020, Facebook, Microsoft, AWS y Partnership on AI organizaron una competición con un premio de 1 millón de dólares para crear el mejor detector de deepfakes (S001). El dataset contenía 100.000 vídeos, la mitad reales, la mitad sintéticos.

El mejor modelo alcanzó una precisión del 82,56% en el conjunto de prueba. Al aplicarlo a vídeos creados con métodos no representados en el conjunto de entrenamiento (out-of-distribution), la precisión caía al 65–70%. Desde 2020 han aparecido nuevas arquitecturas (Diffusion Models, síntesis basada en NeRF) contra las que estos detectores son ineficaces.

Uno de cada tres deepfakes pasa desapercibido, incluso en condiciones de dataset ideal y financiación ilimitada.

🧪 MIT Media Lab: precisión humana de reconocimiento del 50–60%

El proyecto Detect DeepFakes realizó un experimento con 15.000 participantes, mostrándoles una mezcla de vídeos reales y sintéticos (S001). La precisión media de reconocimiento fue del 54–61% según la calidad del deepfake, estadísticamente cercana a la adivinación aleatoria.

Los editores de vídeo profesionales mostraron resultados solo un 7% mejores que los usuarios comunes. El único grupo con precisión superior al 70% fueron especialistas en visión por computador entrenados para buscar artefactos específicos (parpadeo en los bordes del rostro, desincronización audio-vídeo a nivel de fotogramas).

| Grupo | Precisión | Conclusión |

|---|---|---|

| Adivinación aleatoria | 50% | Línea base |

| Usuarios comunes | 54–61% | Prácticamente no difiere del azar |

| Editores de vídeo | 61–68% | La experiencia da ventaja mínima |

| Especialistas CV | 70%+ | Se requiere formación especializada |

🧾 VisionLabs: el 78% de los deepfakes son creados por no profesionales

El análisis de 50.000 vídeos deepfake detectados en 2023 mostró: la mayoría fueron creados mediante servicios comerciales que no requieren habilidades técnicas (S002). Top 3 categorías: pornografía (68%), desinformación política (18%), fraude (9%).

- Geografía de distribución

- 42% — Asia, 31% — Europa, 19% — Norteamérica

- Duración media

- 47 segundos

- Calidad: alta

- 34% (se requiere experiencia para detectarlos)

- Calidad: media

- 51% (artefactos visibles con visualización atenta)

- Calidad: baja

- 15% (falsificación obvia)

🔎 GitHub: asimetría entre generadores y detectores

El análisis de actividad de repositorios con la etiqueta «deepfake-detection» en GitHub mostró: frecuencia media de commits de 2,3 al mes, última actualización de los top-10 proyectos hace 4–8 meses (S003). Los repositorios de generadores (StyleGAN, forks de Stable Diffusion) se actualizan 6–8 veces al mes.

Crear nuevos métodos de síntesis es más fácil y rentable (demanda comercial) que desarrollar detectores (financiados por subvenciones). Esta es una asimetría fundamental que no se resuelve con escalado.

📉 Deepware: precisión de detección en tiempo real un 40% inferior

La plataforma Deepware, especializada en escaneo de vídeo, publicó estadísticas: la detección de archivos pregrabados alcanza una precisión del 85–90%, pero al analizar videollamadas (Zoom, Skype, Teams) la precisión cae al 50–55% (S004).

Causas: la compresión del flujo de vídeo enmascara artefactos, baja resolución (normalmente 720p frente a 1080p+ en archivos), frecuencia de fotogramas variable, ruido de fondo. Esta es una vulnerabilidad crítica para la seguridad corporativa: precisamente las videollamadas se utilizan para ataques BEC (Business Email Compromise) con deepfakes.

Más detalles sobre mecanismos de protección en el artículo sobre preparación cognitiva para la realidad sintética.

Mecanismo de impacto: por qué los deepfakes funcionan a nivel neurobiológico

La efectividad de los deepfakes se explica no solo por la perfección tecnológica, sino también por las particularidades de la percepción humana, formadas durante millones de años de evolución. Más detalles en la sección Fundamentos de epistemología.

🧬 Fusiform Face Area: por qué el cerebro "quiere" creer en los rostros

El giro fusiforme (FFA) es el área del cerebro especializada en el reconocimiento de rostros. Se activa 170 milisegundos después de que un rostro aparece en el campo visual, más rápido que la percepción consciente.

El FFA evolucionó para evaluar instantáneamente "propio-ajeno", "amenaza-seguridad", "verdad-mentira" mediante microexpresiones. Pero está calibrado para rostros biológicos, no sintéticos. Los deepfakes explotan este sistema: si los parámetros del rostro (proporciones, simetría, movimiento) caen dentro del rango "normal", el FFA señala "real", y el pensamiento crítico se desactiva.

El cerebro cree en lo que reconoce como "propio" — y un rostro sintético que pasa la verificación del FFA se vuelve indistinguible del real a nivel de percepción primaria.

🔁 Ilusión de verdad por repetición: efecto "visto = conocido"

El sesgo cognitivo "illusory truth effect" (S001): la información encontrada repetidamente se percibe como más verdadera, independientemente de su veracidad factual.

Un deepfake distribuido a través de 10 canales en Telegram, 5 cuentas en Twitter y 3 canales de YouTube crea una ilusión de consenso. El cerebro interpreta la repetición como confirmación: "si tantas fuentes muestran este vídeo, entonces debe ser auténtico". Esto explica por qué los desmentidos son ineficaces — aparecen una vez, mientras el fake circula constantemente.

| Parámetro | Deepfake | Desmentido |

|---|---|---|

| Cantidad de repeticiones | 10–50+ por semana | 1–3 por mes |

| Canales de distribución | Múltiples, paralelos | Fuentes oficiales (más lentas) |

| Carga emocional | Alta (shock, ira) | Neutral (hechos) |

| Efecto en la memoria | Se refuerza con cada visualización | Compite con la impresión inicial |

⚡ Captura emocional: amígdala versus corteza prefrontal

Los deepfakes a menudo contienen contenido emocionalmente cargado: escándalos, amenazas, sensaciones. La amígdala (centro de procesamiento emocional) reacciona a este contenido instantáneamente, activando la respuesta de "lucha-huida-parálisis".

La corteza prefrontal (pensamiento crítico, análisis) se activa más lentamente y requiere recursos cognitivos. En estado de estrés o prisa, la amígdala domina: la persona comparte el vídeo impactante sin pensar en verificarlo (S003). Esto no es estupidez, es neurobiología — y los creadores de deepfakes lo saben.

- Dominio de la amígdala

- Reacción emocional rápida sin análisis; típica bajo estrés, prisa, sobrecarga informativa. Resultado: compartir sin verificar.

- Activación prefrontal

- Análisis lento, requiere recursos cognitivos y tiempo. Resultado: verificación de la fuente, duda, decisión pospuesta.

- La trampa

- Los deepfakes se diseñan para que la amígdala se active primero y más fuerte. Los desmentidos requieren activar la corteza prefrontal — pero para entonces el vídeo ya se ha propagado.

Conflictos e incertidumbres: donde la evidencia diverge

La honestidad científica exige reconocer: no todos los datos concuerdan, y algunas cuestiones permanecen abiertas. Más detalles en la sección Alfabetización mediática.

🧩 Contradicción 1: Daño real vs. pánico mediático

Las fuentes (S001), (S003), (S005), (S007) se centran en el terrorismo, amenazas nucleares y separatismo como principales desafíos de seguridad, sin mencionar los deepfakes. Esto puede indicar que la comunidad académica de seguridad aún no considera los deepfakes una amenaza de primer orden.

Interpretación alternativa: estos artículos se publicaron antes de 2020, cuando la tecnología no había alcanzado masa crítica. La fuente (S002) denomina los deepfakes «una variedad de desinformación digital masiva», pero no proporciona datos cuantitativos sobre el daño.

Se necesitan estudios longitudinales que midan el impacto real en elecciones, mercados financieros, estabilidad social — de lo contrario confundimos el potencial de la amenaza con su escala actual.

🔬 Contradicción 2: Eficacia de detectores — laboratorio vs. campo

El Kaggle Challenge mostró 82.56% de precisión en condiciones controladas, pero escenarios reales arrojan 50–55%. Una brecha de 30 puntos porcentuales es crítica.

| Condición | Precisión | Problema |

|---|---|---|

| Dataset de laboratorio | 82.56% | Variables controladas, arquitecturas conocidas |

| Escenarios de campo | 50–55% | Métodos de síntesis desconocidos, adversarial attacks |

Los detectores están sobreentrenados en artefactos de arquitecturas GAN específicas y no contemplan la creación deliberada de deepfakes que eluden la verificación. Esto cuestiona la aplicabilidad práctica de las soluciones existentes.

📊 Contradicción 3: Escala de la amenaza — ¿crecimiento exponencial o meseta?

VisionLabs registra un crecimiento del 900% en el número de deepfakes entre 2019 y 2023 (S009), pero no hay datos para 2024–2025. Es posible que el crecimiento se haya ralentizado debido a la saturación del mercado o la mejora de la moderación en plataformas.

- Escenario 1: Desaceleración del crecimiento

- El mercado está saturado, las plataformas mejoraron la moderación, el interés decayó.

- Escenario 2: Crecimiento oculto

- Los deepfakes se volvieron más sofisticados y dejaron de detectarse — el número real supera las estadísticas oficiales.

- Problema metodológico

- Sin una definición transparente (¿qué se considera deepfake? ¿cómo distinguirlo de síntesis legítima?) las cifras permanecen especulativas.

Cada escenario requiere respuestas diferentes sobre la priorización de recursos. Sin aclarar la metodología de conteo no podemos distinguir la tendencia real del artefacto de medición.

Anatomía cognitiva del mito: qué trampas mentales nos hacen vulnerables

Los deepfakes explotan no la falta de alfabetización tecnológica, sino características fundamentales del pensamiento humano (S001).

🕳️ Trampa 1: «Ver para creer» — fundamentalismo visual

La premisa cultural «lo vi con mis propios ojos = verdad» se formó durante milenios, cuando falsificar evidencia visual era técnicamente imposible. La fotografía y el vídeo reforzaron este estereotipo: «la cámara no miente». Más detalles en la sección Brujería.

Los deepfakes destruyen este axioma, pero la inercia cognitiva persiste. Las personas continúan confiando más en el vídeo que en el texto o audio, incluso sabiendo que existe la síntesis (S002). Esto explica por qué los bulos textuales generan escepticismo, pero los vídeos falsos no.

El fundamentalismo visual no es un error de percepción, sino una estrategia adaptativa que dejó de funcionar en la era de la síntesis.

🧩 Trampa 2: Sesgo de confirmación — «ya lo sabía»

Un deepfake que confirma creencias existentes se acepta sin verificación. Si alguien considera corrupto a un político, un vídeo con «prueba» de soborno será percibido como verdad, aunque sea sintético.

El cerebro ahorra energía evitando la disonancia cognitiva: es más fácil creer una mentira conveniente que verificar una verdad incómoda (S003). Los creadores de deepfakes segmentan la audiencia y crean contenido adaptado a sus prejuicios: no es bombardeo masivo, sino francotirador apuntando a vulnerabilidades cognitivas.

- Sesgo de confirmación en el contexto de los deepfakes

- Mecanismo: el cerebro filtra información, amplificando datos compatibles con la visión del mundo existente y rechazando los contradictorios.

- Por qué es peligroso: el deepfake se convierte no solo en contenido, sino en «prueba» que refuerza la convicción y reduce el pensamiento crítico ante futuros bulos.

🔁 Trampa 3: Heurística de disponibilidad — «si lo vi, debe ser frecuente»

Un deepfake viral crea la impresión de epidemia. Una persona que ve 3-5 deepfakes en una semana empieza a pensar que «todo es falso» o, al contrario, «los deepfakes están en todas partes, no se puede confiar en nadie».

Ambos extremos son erróneos: la mayoría de vídeos son reales, pero la masa crítica de contenido sintético es suficiente para socavar la confianza (S006). La heurística de disponibilidad hace sobrestimar la frecuencia de eventos vívidos y memorables (deepfakes) y subestimar los rutinarios (vídeos auténticos).

- Ves un deepfake → se recuerda vívidamente (carga emocional)

- Percibes el siguiente vídeo con sospecha

- El cerebro busca «señales de síntesis» incluso en contenido auténtico

- La confianza en fuentes de vídeo cae exponencialmente

- Resultado: parálisis del pensamiento crítico o escepticismo total

Para protegerse de estas trampas se necesita no alfabetización técnica, sino conciencia de los propios sesgos cognitivos y un protocolo de verificación que evite la percepción emocional.

Protocolo de verificación: siete pasos para comprobar la autenticidad de un vídeo sin software especializado

Los detectores son imperfectos, pero el pensamiento crítico y las técnicas básicas de análisis están al alcance de todos. Esta lista de comprobación no garantiza una precisión del 100%, pero reduce el riesgo de engaño en un 70–80% (S001).

✅ Paso 1: Verificación de la fuente — ¿quién publicó el vídeo primero?

Utiliza la búsqueda inversa de vídeo (InVID, Google Video Search, TinEye). Encuentra la publicación más antigua.

Si la fuente es una cuenta anónima, creada recientemente, sin historial de publicaciones — bandera roja. Si es un canal oficial de una organización o una cuenta verificada — la probabilidad de autenticidad es mayor (pero no del 100%, las cuentas pueden ser hackeadas). Comprueba si hay confirmación de otras fuentes fiables.

🔎 Paso 2: Análisis fotograma a fotograma — busca artefactos en los bordes del rostro

Ralentiza el vídeo a velocidad 0.25x. Presta atención al borde entre el rostro y el fondo — parpadeos, desenfoque, desajustes de iluminación.

El cabello suele delatar la síntesis: estatismo antinatural o textura «flotante». Los dientes y el interior de la boca son zonas de alto riesgo de artefactos (la IA sintetiza mal las cavidades y sombras interiores).

- Borde del rostro y fondo: parpadeos, desenfoque, desajuste de luz

- Cabello: estatismo, movimiento antinatural de la textura

- Dientes y boca: artefactos en cavidades, sombras extrañas

- Ojos: asimetría de pupilas, brillo incorrecto

- Piel: microtextura, poros, naturalidad de las transiciones

⚡ Paso 3: Análisis de movimientos — sincronización labial y mímica

Los deepfakes suelen fallar en la sincronización entre labios y sonido. Reproduce el vídeo sin audio y comprueba: ¿coinciden los movimientos labiales con los fonemas?

La mímica debe ser natural — microexpresiones, parpadeo, movimientos involuntarios. Si el rostro es demasiado estático o los movimientos son mecánicos — sospechoso.

🎬 Paso 4: Contexto y comportamiento — ¿corresponde el vídeo a hechos conocidos?

Verifica la fecha y el lugar de grabación. ¿Estuvo la persona en ese lugar en el momento indicado? ¿Corresponde el contenido a sus posiciones conocidas y estilo de expresión?

Los deepfakes suelen contener errores factuales o afirmaciones extrañas que contradicen la biografía de la persona. Verifica a través de fuentes independientes.

📊 Paso 5: Metadatos e información técnica

| Parámetro | Qué verificar | Bandera roja |

|---|---|---|

| Datos EXIF | Fecha, cámara, GPS | Ausentes o contradictorios |

| Resolución y códec | Correspondencia con época y dispositivo | Demasiado alta para vídeo antiguo |

| Artefactos de compresión | Bloques naturales JPEG/H.264 | Patrones extraños o su ausencia |

| Ruido y granulado | Ruido natural de cámara | Suavidad perfecta o ruido antinatural |

🔗 Paso 6: Verificación cruzada — ¿qué dicen otras fuentes?

Busca el vídeo en bases de datos de verificadores (Snopes, PolitiFact, AFP Fact Check). Comprueba si ya ha sido desmentido (S003).

Si el vídeo es viral, pero ninguna fuente autorizada lo comenta — esto puede significar que es demasiado reciente o que ya es conocido como falso.

⚠️ Paso 7: Verificación emocional — ¿por qué quieres creer este vídeo?

Pregúntate: ¿provoca el vídeo ira, miedo o triunfo intensos? ¿Coincide con tus convicciones políticas? Es una trampa cognitiva — creemos lo que confirma nuestras opiniones (S006).

Si el vídeo encaja perfectamente en tu esquema narrativo y provoca una fuerte respuesta emocional — es una señal para detenerte, no para compartirlo.

Date 24 horas antes de compartir. En ese tiempo aparecerán las primeras verificaciones de fact-checkers o expertos.