🔍 Detección de deepfakes

🔍 Detección de deepfakesTecnologías de detección de medios sintéticos y protección contra deepfakesλ

La inteligencia artificial crea falsificaciones realistas de vídeo y audio, pero esas mismas tecnologías ayudan a detectarlas y proteger la autenticidad digital del contenido

Overview

Los deepfakes son archivos multimedia sintéticos creados por redes neuronales: 🧬 imitan la voz, el rostro y los gestos de personas reales con una precisión alarmante. La accesibilidad de las herramientas de IA ha transformado el problema de algo experimental a un fenómeno masivo, desde manipulaciones políticas hasta chantajes a particulares. La detección utiliza aprendizaje automático para buscar artefactos: inconsistencias en la iluminación, micromovimientos faciales, señales de audio, pero cada mejora en la protección provoca una nueva ola de ataques.

🛡️

Protocolo Laplace: La verificación de contenido digital requiere un enfoque multinivel que combine análisis automatizado con evaluación experta y métodos criptográficos de confirmación de autenticidad de la fuente.

Reference Protocol

Base Científica

Marco basado en evidencia para análisis crítico

Protocol: Evaluation

Ponte a Prueba

Cuestionarios sobre este tema próximamente

Sector L1

Artículos

Materiales de investigación, ensayos y profundizaciones en los mecanismos del pensamiento crítico.

🔍 Detección de deepfakes

🔍 Detección de deepfakes 🔍 Detección de deepfakes

🔍 Detección de deepfakes⚡

Más Información

Cómo las redes generativas crean rostros sintéticos indistinguibles de los reales

Los deepfakes se basan en arquitecturas de aprendizaje profundo capaces de sintetizar imágenes y vídeos fotorrealistas mediante el análisis de miles de ejemplos. Los métodos actuales han alcanzado tal nivel de calidad que el ojo humano a menudo no puede reconocer la falsificación sin herramientas especializadas.

Comprender los mecanismos de generación es el primer paso para desarrollar sistemas de detección eficaces. No es una cuestión de curiosidad técnica: cada nuevo método de síntesis genera un nuevo vector de ataque.

Redes Generativas Antagónicas (GAN)

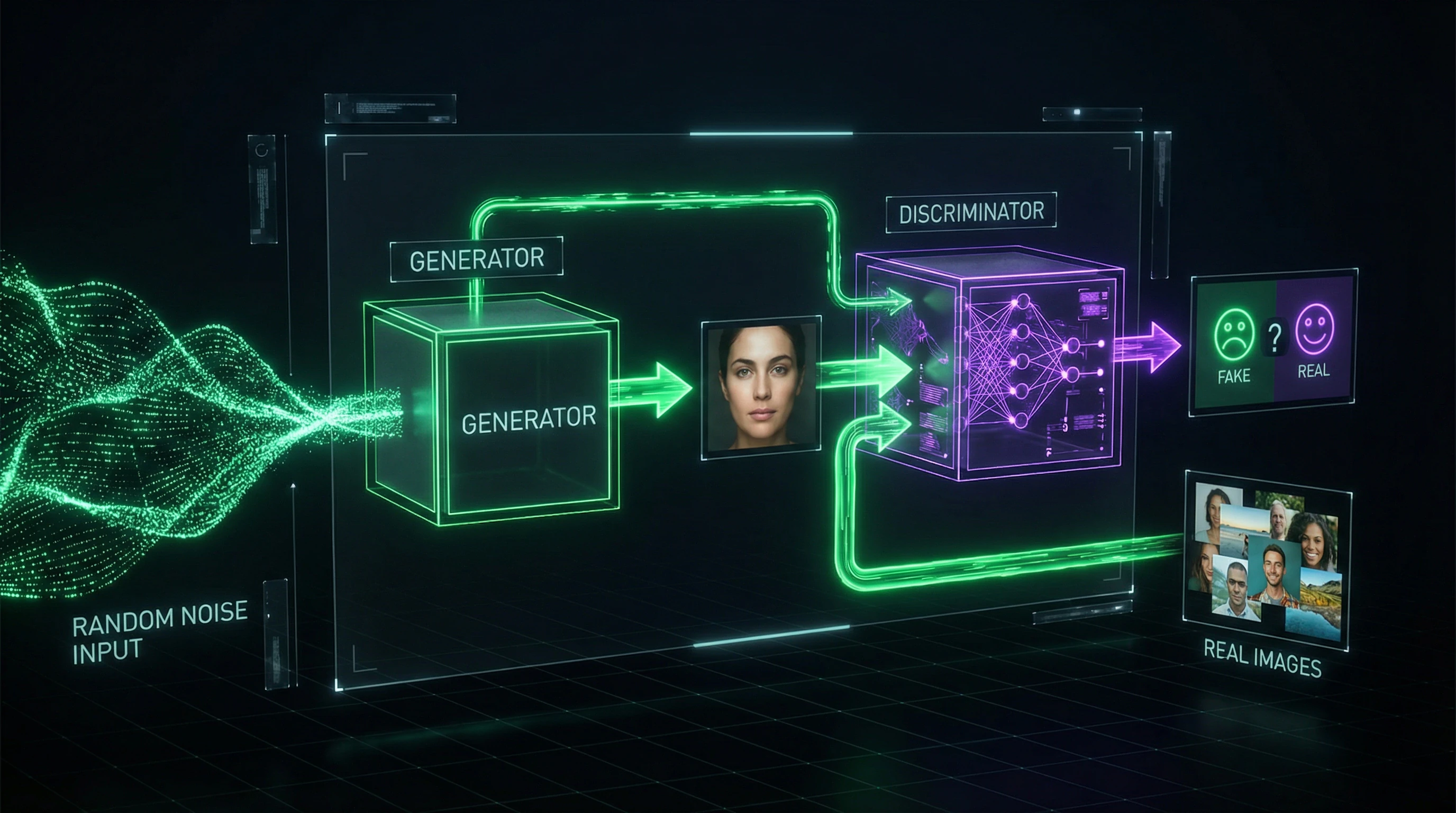

Las GAN constan de dos redes neuronales: un generador que crea imágenes sintéticas y un discriminador que intenta distinguirlas de las reales. Durante el entrenamiento, el generador se perfecciona hasta que el discriminador deja de diferenciar las falsificaciones.

| Arquitectura | Resolución | Vulnerabilidad clave |

|---|---|---|

| StyleGAN2 | hasta 1024×1024 | Artefactos en componentes de alta frecuencia |

| StyleGAN3 | hasta 1024×1024 | Anomalías espectrales en análisis de textura |

Los modelos actuales preservan los detalles más minuciosos de la textura de la piel, el cabello y el iris, pero precisamente esta detallización crea patrones predecibles en el análisis espectral.

Autocodificadores y algoritmos de face-swap

Los autocodificadores comprimen la imagen de un rostro en una representación latente compacta y luego la reconstruyen con los rasgos de otra persona. La tecnología face-swap utiliza dos autocodificadores: uno se entrena con el rostro de origen, otro con el rostro objetivo, compartiendo ambos un codificador común.

- DeepFaceLab y FaceSwap

- Requieren entre 2000 y 10000 fotogramas para obtener un resultado de calidad. Permiten transferir expresiones y movimientos de un rostro a otro, manteniendo la identidad del objetivo.

- Punto crítico de fallo

- La discordancia entre la geometría del rostro y la iluminación en el vídeo original a menudo delata la falsificación al analizar sombras y reflejos.

Síntesis de voz y clonación vocal

Los deepfakes de voz se crean mediante modelos como Tacotron 2 y WaveNet, que convierten texto en habla con las entonaciones de una persona específica. Los sistemas actuales requieren apenas 5-10 minutos de grabación de audio para clonar una voz con calidad aceptable.

- La tecnología de conversión de voz (voice conversion) modifica el timbre y el acento, preservando el contenido lingüístico

- La principal vulnerabilidad del habla sintética es la ausencia de microvariaciones en el espectro de frecuencias, características del tracto vocal natural

- La voz sintética a menudo muestra una regularidad excesiva en las transiciones formánticas entre fonemas

Cada método de síntesis deja una huella: las GAN en el espectro, el face-swap en la geometría de la luz, la clonación vocal en el micrritmo. El detector no busca la perfección, sino su ausencia.

Huellas digitales de la falsificación: qué delata al vídeo sintético

Los deepfakes visuales dejan artefactos característicos que pueden detectarse mediante visión por computador y análisis de imágenes. Los métodos de detección evolucionan paralelamente a las tecnologías de generación, creando una carrera armamentística entre creadores y detectores.

Un sistema de detección eficaz debe analizar múltiples indicadores simultáneamente, ya que ningún método ofrece una precisión del 100%.

Análisis de artefactos de compresión y pixelación

Los deepfakes suelen contener inconsistencias en los patrones de compresión JPEG y H.264, ya que las áreas sintéticas se procesan de forma diferente a las originales. El análisis de la transformada discreta del coseno (DCT) revela anomalías en bloques de 8×8 píxeles, características de fragmentos insertados.

Los métodos basados en Error Level Analysis (ELA) visualizan diferencias en los niveles de compresión de distintas áreas de la imagen — la precisión de detección por artefactos de compresión alcanza el 87-92% en conjuntos de datos conocidos como FaceForensics++.

Detección de anomalías en movimientos oculares y parpadeo

Los primeros deepfakes rara vez parpadeaban de forma natural, ya que los conjuntos de datos de entrenamiento contenían predominantemente fotogramas con ojos abiertos. Los algoritmos actuales rastrean la frecuencia de parpadeo (norma 15-20 veces por minuto), duración del cierre palpebral (100-400 ms) y sincronía de movimientos de ambos ojos.

Los detectores basados en redes neuronales analizan trayectorias de movimiento pupilar y reflejos en la córnea, difíciles de reproducir sintéticamente. El método Eye-tracking Consistency Analysis alcanza una precisión del 94% en vídeos de más de 10 segundos.

Verificación de coherencia de iluminación y sombras

Una iluminación físicamente correcta requiere cumplir las leyes de la óptica: la dirección de las sombras debe corresponder a la posición de las fuentes de luz, y los reflejos en los ojos deben coincidir con el entorno.

| Parámetro de iluminación | Qué verifica el detector | Precisión del método |

|---|---|---|

| Dirección de sombras | Correspondencia con fuentes de luz en la escena | 89% |

| Reflejos en los ojos | Coincidencia con entorno y espectro | 89% |

| Composición espectral | Uniformidad de temperatura de color en rostro y fondo | 89% |

Algoritmos como Lighting Environment Estimation analizan mapas de normales del rostro y los comparan con la iluminación supuesta de la escena. Los métodos basados en armónicos esféricos modelan la iluminación tridimensional y revelan anomalías.

Criminalística acústica: cómo reconocer una voz sintética

Los deepfakes de audio amenazan los sistemas de autenticación de bancos y corporaciones que dependen de la biometría vocal. La detección de voz sintética se basa en el análisis de características acústicas invisibles al oído humano.

La combinación de análisis espectral y aprendizaje automático detecta voz sintética con una precisión superior al 95% en condiciones controladas.

Análisis espectral e identificación de patrones sintéticos

El habla natural contiene microvariaciones en frecuencias formánticas, jitter (irregularidad del periodo del tono fundamental) y shimmer (variaciones de amplitud), difíciles de reproducir sintéticamente.

| Característica | Habla natural | Habla sintética |

|---|---|---|

| Frecuencias formánticas | Microvariaciones, transiciones orgánicas | Regularidad excesiva |

| Altas frecuencias (>8 kHz) | Fluctuaciones naturales | Patrones regulares |

| Ruido de fondo | Presente (condiciones reales) | Ausente o artificial |

El análisis de coeficientes cepstrales (MFCC) y predicción lineal (LPC) revela anomalías en la envolvente espectral. Los métodos basados en Constant-Q Transform (CQT) alcanzan una precisión de detección del 96% en el conjunto de datos ASVspoof 2019.

Verificación biométrica de voz

Los sistemas de speaker verification comparan huellas acústicas de voz con grabaciones de referencia, analizando características únicas del tracto vocal. Los x-vectores e i-vectores — representaciones compactas de voz extraídas por redes neuronales profundas, resistentes a variaciones en el canal de transmisión y ruido.

Los sistemas actuales alcanzan un Equal Error Rate (EER) del 1–3% en grabaciones limpias, pero ataques adaptativos con adversarial examples los engañan en el 40–60% de los casos.

Esto requiere autenticación multifactor: voz + código PIN, voz + biometría facial o voz + llave hardware. Ningún canal de verificación debe ser la única fuente de confianza.

Aprendizaje automático en la detección de deepfakes: de los datasets a la robustez adversarial

Entrenamiento de clasificadores con datasets etiquetados

La eficacia de los detectores de deepfakes depende directamente de la calidad y diversidad de los datos de entrenamiento. Los datasets públicos más grandes —FaceForensics++ (más de 1,8 millones de fotogramas de 1000 vídeos), Celeb-DF (590 vídeos reales y 5639 falsos de celebridades) y DFDC (124 mil vídeos de Facebook)— contienen muestras creadas mediante diversos métodos de generación: DeepFakes, Face2Face, FaceSwap, NeuralTextures.

El etiquetado incluye no solo marcas binarias «real/falso», sino también máscaras de áreas manipuladas, metadatos sobre el método de generación y el grado de compresión. Los clasificadores modernos basados en EfficientNet, XceptionNet y Vision Transformers alcanzan una precisión del 95–99% en conjuntos de prueba de los mismos datasets.

El rendimiento cae al 60–70% en pruebas entre datasets debido al sobreajuste a artefactos de generadores específicos.

El problema del domain shift es un cuello de botella crítico en la capacidad de generalización de los detectores. Un modelo entrenado con deepfakes en resolución 1080p y compresión mínima muestra una degradación de precisión del 30–40% al analizar vídeos comprimidos con códec H.264 a bitrates inferiores a 2 Mbps.

Las técnicas de aumento de datos —adición de ruido gaussiano, artefactos JPEG, desenfoque de movimiento, cambios en el balance de color— incrementan la robustez en un 15–20%. Los métodos de ensemble, que combinan predicciones de varios modelos con diferentes arquitecturas (CNN + Transformer + análisis de frecuencia), demuestran una mejora del 8–12% en la métrica AUC-ROC.

Adversarial training y resistencia a ataques

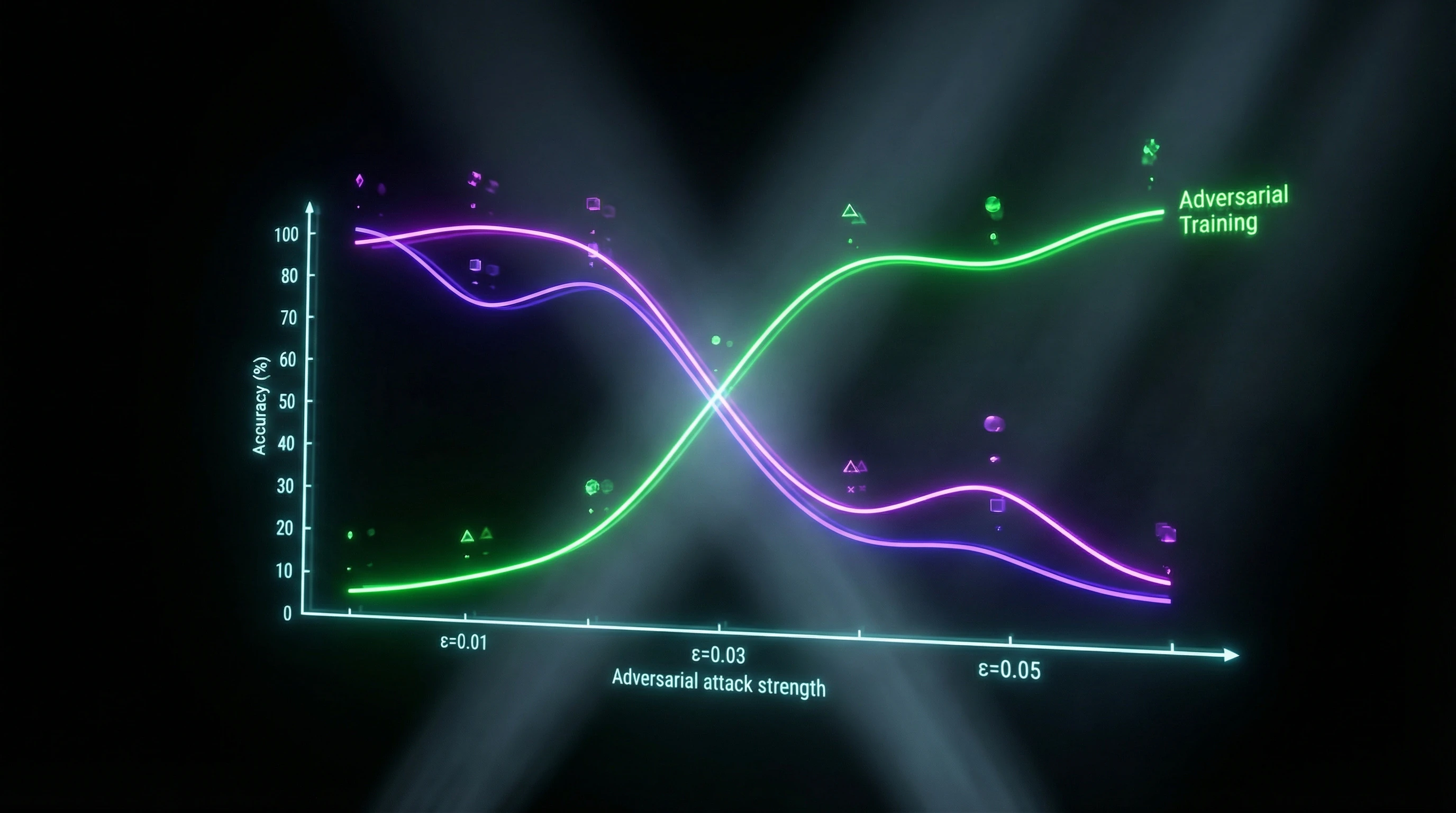

Los adversarial examples —perturbaciones de datos de entrada especialmente construidas, imperceptibles para el ser humano pero que causan errores de clasificación— representan una amenaza seria para los detectores de deepfakes.

| Método de ataque | Reducción de precisión | Amplitud de ruido |

|---|---|---|

| FGSM (Fast Gradient Sign Method) | del 98% al 20–30% | 8/255 en RGB |

| PGD (Projected Gradient Descent) | del 98% al 20–30% | 8/255 en RGB |

| C&W (Carlini-Wagner) | del 98% al 20–30% | 8/255 en RGB |

El adversarial training —inclusión de adversarial examples en el conjunto de entrenamiento— aumenta la resistencia en un 25–35%, pero requiere multiplicar por 2–3 los recursos computacionales y el tiempo de entrenamiento.

Las certified defenses basadas en randomized smoothing garantizan una robustez matemáticamente demostrable en una esfera L2 de radio 0,5–1,0, pero al coste de reducir la precisión base en un 5–8%.

Transfer learning y adaptación de modelos

El transfer learning permite adaptar detectores a nuevos tipos de deepfakes sin reentrenamiento completo desde cero. Los modelos preentrenados en ImageNet o tareas de reconocimiento facial (VGGFace2, MS-Celeb-1M) contienen características universales de texturas, bordes y estructuras semánticas que se transfieren a la tarea de detección de manipulaciones.

- Fine-tuning de las últimas 2–3 capas

- Requiere entre 10–15 veces menos datos etiquetados (500–1000 muestras en lugar de 10–20 mil), reduce el tiempo de entrenamiento de varios días a 2–4 horas en GPU.

- Few-shot learning (Siamese, Prototypical Networks)

- Demuestra capacidad para detectar nuevos tipos de deepfakes con 5–10 ejemplos con una precisión del 75–82%.

- Domain adaptation (DANN, CORAL)

- Minimiza la divergencia de distribuciones de características entre dominio origen y destino, mejora la precisión en un 18–22% al transferir a vídeos comprimidos por redes sociales.

Las estrategias de continual learning con elastic weight consolidation previenen el olvido catastrófico durante el entrenamiento secuencial con nuevos tipos de manipulaciones, manteniendo el rendimiento en tareas antiguas al 90–93% del nivel original.

Blockchain y verificación criptográfica de contenido: tecnologías de confianza en la era de los medios sintéticos

Firmas digitales y marcas de agua

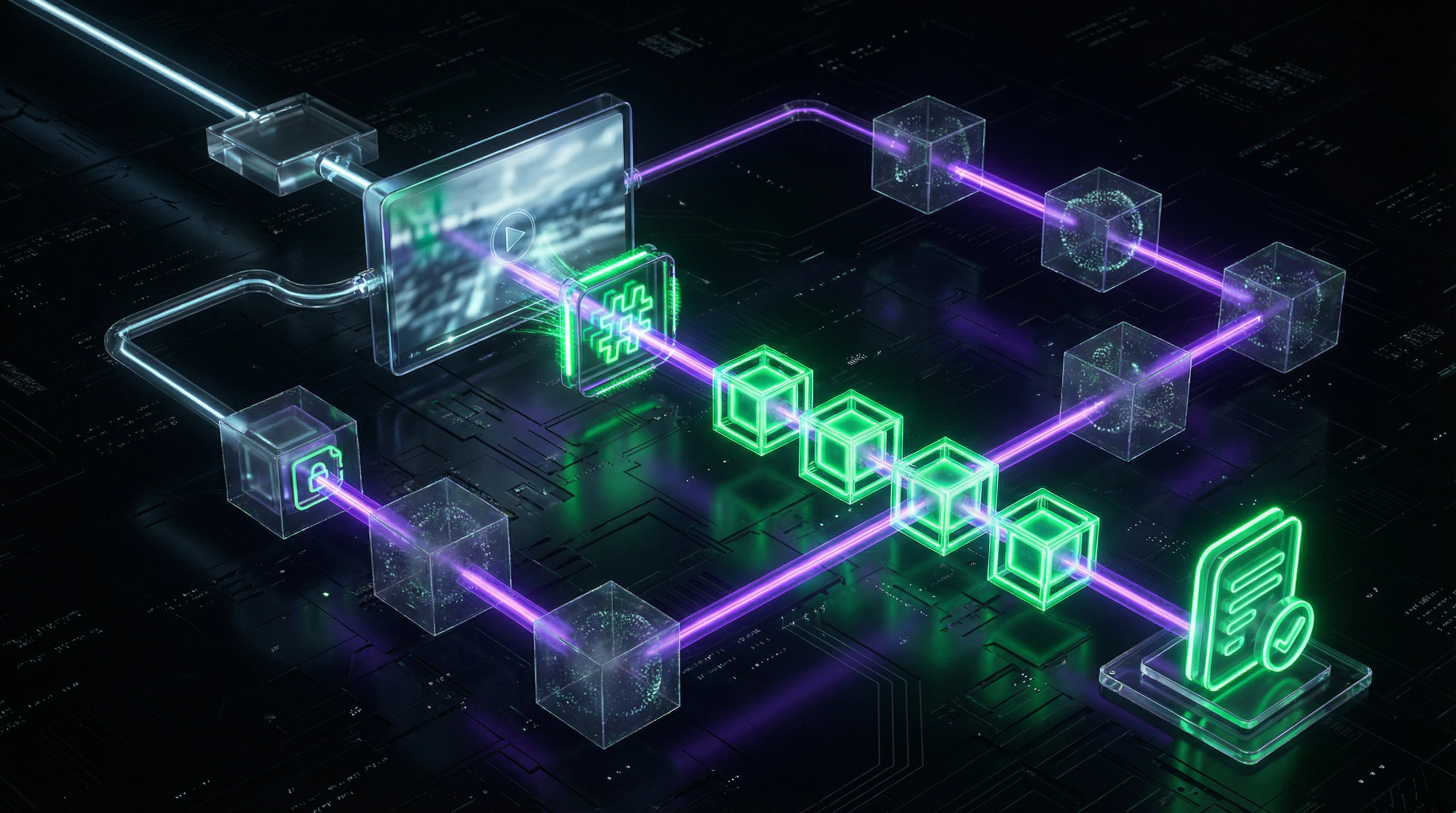

Las firmas digitales criptográficas proporcionan autenticidad e integridad matemáticamente demostrables del contenido multimedia. El estándar C2PA integra en los metadatos de imágenes y vídeos un manifiesto firmado con información sobre el origen: dispositivo de captura, momento de creación, cadena de ediciones, identificador del autor.

La firma se crea con la clave privada de la cámara o editor y se verifica con la clave pública de un certificado confiable. Cualquier modificación de píxeles o metadatos invalida la firma, señalizando una potencial manipulación. La implementación de C2PA en cámaras Sony Alpha 1 y Canon EOS R3 desde 2023 crea una infraestructura de confianza para el fotoperiodismo profesional.

Las marcas de agua robustas —patrones invisibles integrados en los píxeles de la imagen, resistentes a compresión, recorte y filtrado— complementan los métodos criptográficos.

La tecnología SynthID de Google DeepMind integra la marca de agua directamente en el proceso de generación de imágenes, modificando la distribución de probabilidades de tokens de modo que la marca se conserva incluso después de compresión JPEG con calidad del 75% y cambio de tamaño del 50%.

El detector extrae la marca con una probabilidad del 95–98% en ausencia de ataques y del 70–80% tras transformaciones agresivas. Limitación: las marcas de agua no protegen contra ataques dirigidos de eliminación, reduciendo la detectabilidad al 30–40% cuando se conoce la arquitectura de integración.

Registros descentralizados de autenticidad de medios

Las plataformas blockchain crean registros inmutables del origen del contenido, donde cada transacción —registro de archivo multimedia, transferencia de derechos, verificación de autenticidad— se registra en un libro mayor distribuido.

El proyecto Starling Lab utiliza blockchain Filecoin e IPFS para archivar pruebas de violaciones de derechos humanos: fotografías y vídeos se hashean, el hash se registra en blockchain con marca temporal, creando una prueba criptográfica de la existencia del archivo en un momento determinado. La verificación toma segundos y no requiere confianza en un órgano central.

- Numbers Protocol integra certificados NFT con metadatos C2PA, permitiendo a fotógrafos monetizar imágenes auténticas.

- El seguimiento del uso del contenido ocurre mediante contratos inteligentes en red distribuida.

- Cada transferencia de derechos o edición se registra con firma criptográfica.

La escalabilidad sigue siendo un desafío: registrar cada archivo multimedia en blockchain público cuesta 0,01–0,50€ según la red y genera una latencia de 5–60 segundos.

Las soluciones híbridas utilizan almacenamiento off-chain para los archivos mismos (IPFS, Arweave) y registros on-chain solo para hashes y metadatos, reduciendo el coste en 100–1000 veces. Los blockchains de consorcio (Hyperledger Fabric) para archivos multimedia corporativos procesan 1000–5000 transacciones por segundo con finalidad inferior a 1 segundo, pero sacrifican descentralización por rendimiento.

Aspectos sociales y éticos: legislación, educación y equilibrio entre innovación

Regulación legislativa de los deepfakes

Los marcos legales para los deepfakes se están formando de manera fragmentada a nivel nacional. En EE.UU., la ley federal DEEPFAKES Accountability Act (2023) exige el marcado de contenido sintético con marcas de agua y criminaliza la creación de deepfakes con intención de causar daño, con penas de hasta 5 años de prisión y multas de 250.000€.

California (AB 602, AB 730) prohíbe la pornografía deepfake sin consentimiento y los deepfakes políticos 60 días antes de las elecciones. La Unión Europea, mediante la AI Act, clasifica los sistemas de creación de deepfakes como de "alto riesgo", exigiendo marcado obligatorio, auditoría de algoritmos y transparencia en los conjuntos de datos de entrenamiento.

China (2023) obliga a las plataformas a implementar detectores de deepfakes y bloquear contenido sintético no marcado en 24 horas bajo amenaza de multas de hasta el 10% de la facturación anual.

La aplicación de la ley enfrenta barreras técnicas y jurisdiccionales. El anonimato de los creadores de deepfakes mediante VPN y criptomonedas dificulta la identificación de infractores.

La distribución transfronteriza de contenido a través de plataformas descentralizadas (BitTorrent, IPFS) hace que el bloqueo sea ineficaz. Determinar la "intención de causar daño" requiere prueba de mens rea, lo cual es complejo en casos de sátira o uso artístico.

El equilibrio entre protección contra abusos y libertad de expresión sigue siendo objeto de disputas judiciales: las demandas contra creadores de deepfakes políticos a menudo se desestiman por la Primera Enmienda en EE.UU.

Alfabetización mediática y pensamiento crítico

Los programas educativos para reconocer deepfakes aumentan la resistencia de la sociedad a las manipulaciones. Un estudio del MIT Media Lab (2024) mostró que un entrenamiento de 15 minutos con ejemplos de artefactos mejora la capacidad de los participantes para distinguir videos reales de falsos del 54% al 73% de precisión.

Los cursos a largo plazo (8-12 semanas) con práctica en análisis de metadatos, búsqueda inversa de imágenes y verificación de fuentes alcanzan una precisión del 85-90%. El pensamiento crítico —el hábito de hacer preguntas como "¿Quién lo creó?", "¿Cuál es el propósito?", "¿Lo confirman fuentes independientes?"— es más efectivo que memorizar artefactos específicos, que quedan obsoletos con el desarrollo de las tecnologías de generación.

- Inconsistencia en iluminación y sombras en el rostro

- Movimientos oculares y de párpados antinaturales

- Desincronización de labios con el habla

- Artefactos en los bordes entre rostro y fondo

- Anomalías en reflejos en las pupilas

La integración de detectores de deepfakes en plataformas educativas y extensiones de navegador democratiza el acceso a la verificación. La extensión InVID-WeVerify para Chrome y Firefox analiza videos en busca de signos de manipulación, extrae metadatos EXIF y realiza búsqueda inversa de fotogramas clave en bases de Google, Yandex, Bing en 10-15 segundos.

Aplicaciones móviles como Truepic Vision integran verificación C2PA en la cámara del smartphone, firmando fotos en el momento de la captura. La adopción masiva de estas herramientas en programas escolares y capacitaciones corporativas crea "inmunidad colectiva" contra la desinformación.

Equilibrio entre innovación y protección de derechos

Las tecnologías de síntesis de medios tienen aplicaciones legítimas: doblaje de películas con sincronización labial, restauración de grabaciones históricas, educación personalizada con profesores virtuales, herramientas de accesibilidad para personas con discapacidad.

Una regulación excesiva corre el riesgo de frenar la innovación y crear barreras para la investigación. El modelo de "puerto seguro" —exención de responsabilidad para plataformas que implementan detectores y procedimientos de eliminación por denuncias— incentiva la cooperación voluntaria sin suprimir el desarrollo tecnológico.

El licenciamiento de herramientas de creación de deepfakes con requisito de marcas de agua integradas y registro de uso equilibra accesibilidad y rendición de cuentas.

Marcos éticos como IEEE P7003 (Algorithmic Bias) y Partnership on AI Guidelines recomiendan transparencia en conjuntos de datos, auditoría de sesgos (raciales, de género, de edad), mecanismos de consentimiento para uso de datos biométricos y derecho a explicación de decisiones de detectores.

La participación de actores interesados —empresas tecnológicas, defensores de derechos, periodistas, legisladores— en órganos de gobernanza multipartita (Content Authenticity Initiative, AI Alliance) asegura la consideración de diversos intereses.

El futuro de la detección de deepfakes no está en una carrera armamentística tecnológica, sino en sistemas sociotécnicos donde tecnologías, leyes, educación y normas éticas trabajen sinérgicamente para proteger el ecosistema informativo.

Knowledge Access Protocol

FAQ

Preguntas Frecuentes

Un deepfake es contenido multimedia sintético creado mediante inteligencia artificial para reemplazar el rostro o la voz de una persona. La tecnología se basa en redes generativas antagónicas (GAN) y autocodificadores que se entrenan con miles de imágenes del rostro objetivo. Los algoritmos actuales permiten crear vídeos realistas en pocas horas con un ordenador convencional.

Los deepfakes de calidad son difíciles de reconocer sin herramientas especializadas, pero existen indicios: parpadeo antinatural, desincronización de labios con el audio, artefactos en los bordes del rostro. Preste atención a la iluminación, las sombras y la textura de la piel: los algoritmos suelen fallar en estos detalles. Ante la mínima duda, utilice servicios especializados de verificación.

La detección se basa en aprendizaje automático: redes neuronales analizan artefactos de compresión, anomalías en movimientos oculares, inconsistencias de iluminación y patrones espectrales de audio. Los sistemas actuales emplean adversarial training para resistir nuevos métodos de falsificación. También se aplican tecnologías blockchain para verificación criptográfica del contenido original.

Es un mito: los deepfakes actuales han alcanzado calidad fotorrealista y engañan incluso a expertos. Las tecnologías GAN y autocodificadores se perfeccionan constantemente, creando falsificaciones cada vez más convincentes. La calidad depende del volumen de datos de entrenamiento y la capacidad computacional disponible para el creador.

Utilice servicios especializados de detección de deepfakes (Microsoft Video Authenticator, Sensity AI) o cargue el vídeo en plataformas de verificación. Analice los metadatos del archivo, compruebe la fuente y el contexto de publicación. Para contenido importante, aplique varios métodos de verificación simultáneamente.

GAN (red generativa antagónica) es una arquitectura de IA compuesta por dos redes neuronales: el generador crea falsificaciones y el discriminador intenta reconocerlas. En el proceso de "competición", el generador aprende a crear imágenes cada vez más realistas que el discriminador no puede distinguir de las auténticas. Precisamente las GAN son la base de la mayoría de deepfakes actuales.

Sí, blockchain permite crear registros inmutables sobre el origen del contenido multimedia mediante firmas digitales y marcas temporales. Los registros descentralizados almacenan hashes de archivos originales, lo que permite verificar la autenticidad. Estas soluciones ya están siendo implementadas por agencias de noticias y plataformas para combatir la desinformación.

Los primeros algoritmos de deepfakes reproducían mal el parpadeo natural humano: demasiado infrecuente o antinatural en su dinámica. Los detectores analizan la frecuencia, duración y patrones de parpadeo, comparándolos con normas biológicas. Los deepfakes actuales han aprendido a imitar el parpadeo, por lo que este método se combina con otras técnicas.

Adversarial training es un método de entrenamiento de detectores con ejemplos constantemente actualizados de deepfakes, incluyendo los creados específicamente para engañar al sistema. El modelo aprende a reconocer no solo falsificaciones existentes, sino que se adapta a nuevas técnicas de generación. Es una carrera armamentística entre creadores y detectores de deepfakes.

El habla sintética presenta artefactos característicos en el espectro de frecuencias que difieren de la voz humana natural. El análisis de espectrogramas revela armónicos anómalos, transiciones antinaturales entre fonemas y ausencia de microvariaciones. Los sistemas actuales utilizan aprendizaje profundo para detectar automáticamente estos patrones.

Es un mito obsoleto: hoy en día se puede crear un deepfake de calidad en un PC gaming con una tarjeta gráfica de gama media en pocas horas. Existen aplicaciones listas para usar y servicios online que automatizan el proceso. La accesibilidad de la tecnología ha aumentado significativamente, lo que intensifica el problema de la difusión de deepfakes.

En España, los deepfakes pueden estar sujetos a artículos sobre difamación, fraude, violación de derechos de autor y difusión de información falsa. Desde 2024 se ha reforzado la responsabilidad por el uso de IA para crear materiales comprometedores. La legislación continúa evolucionando en respuesta a las nuevas amenazas.

El pensamiento crítico y la verificación de fuentes son la primera línea de defensa contra las manipulaciones. Aprender a reconocer señales de falsificación, comprender las tecnologías y desarrollar el hábito de verificar la información reduce la efectividad de los deepfakes. La alfabetización mediática es especialmente importante en la era de la difusión masiva de contenido sintético.

Teóricamente es posible, pero en la práctica siempre quedan microartefactos detectables mediante algoritmos especializados. La carrera entre generación y detección continúa: cada mejora en la creación de deepfakes estimula el desarrollo de métodos de detección. La indistinguibilidad total sigue siendo un objetivo inalcanzable.

Las marcas de agua digitales son marcas invisibles integradas en un archivo multimedia durante su creación, que confirman su autenticidad y procedencia. Son resistentes a la compresión y edición, permitiendo verificar el contenido original. La tecnología está siendo implementada activamente por fabricantes de cámaras y agencias de noticias.

Sí, la tecnología se aplica en la producción cinematográfica para rejuvenecer actores, en educación para crear personajes históricos interactivos, en medicina para sintetizar el habla de personas con trastornos. Los deepfakes ayudan en la localización de contenido y personalización del aprendizaje. La cuestión clave es el uso ético con el consentimiento de todas las partes.