Sesgos sistemáticos y prejuicios de la inteligencia artificial en medicinaλ

Cómo reconocer y minimizar los riesgos de errores algorítmicos en diagnóstico, cirugía e investigación clínica

Overview

La inteligencia artificial en medicina promete revolucionar el diagnóstico y tratamiento, pero conlleva riesgos de errores sistemáticos y sesgos. Desde la visualización intraoperatoria asistida por IA de las glándulas paratiroides hasta el metaanálisis de eficacia terapéutica, los algoritmos pueden reproducir prejuicios humanos o crear nuevos tipos de errores. Comprender la naturaleza de estos errores es fundamental para la implementación segura de la IA en la práctica clínica.

🛡️ Protocolo Laplace: La verificación sistemática de sesgos en sistemas de IA incluye validación en poblaciones heterogéneas, evaluación de sensibilidad y especificidad por subgrupos, análisis de resultados falsos positivos y falsos negativos, así como comparación con el estándar de oro diagnóstico.

Reference Protocol

Base Científica

Marco basado en evidencia para análisis crítico

Protocol: Evaluation

Ponte a Prueba

Cuestionarios sobre este tema próximamente

⚡

Más Información

Tipos de errores sistemáticos en sistemas de IA médica: desde los datos hasta el diagnóstico

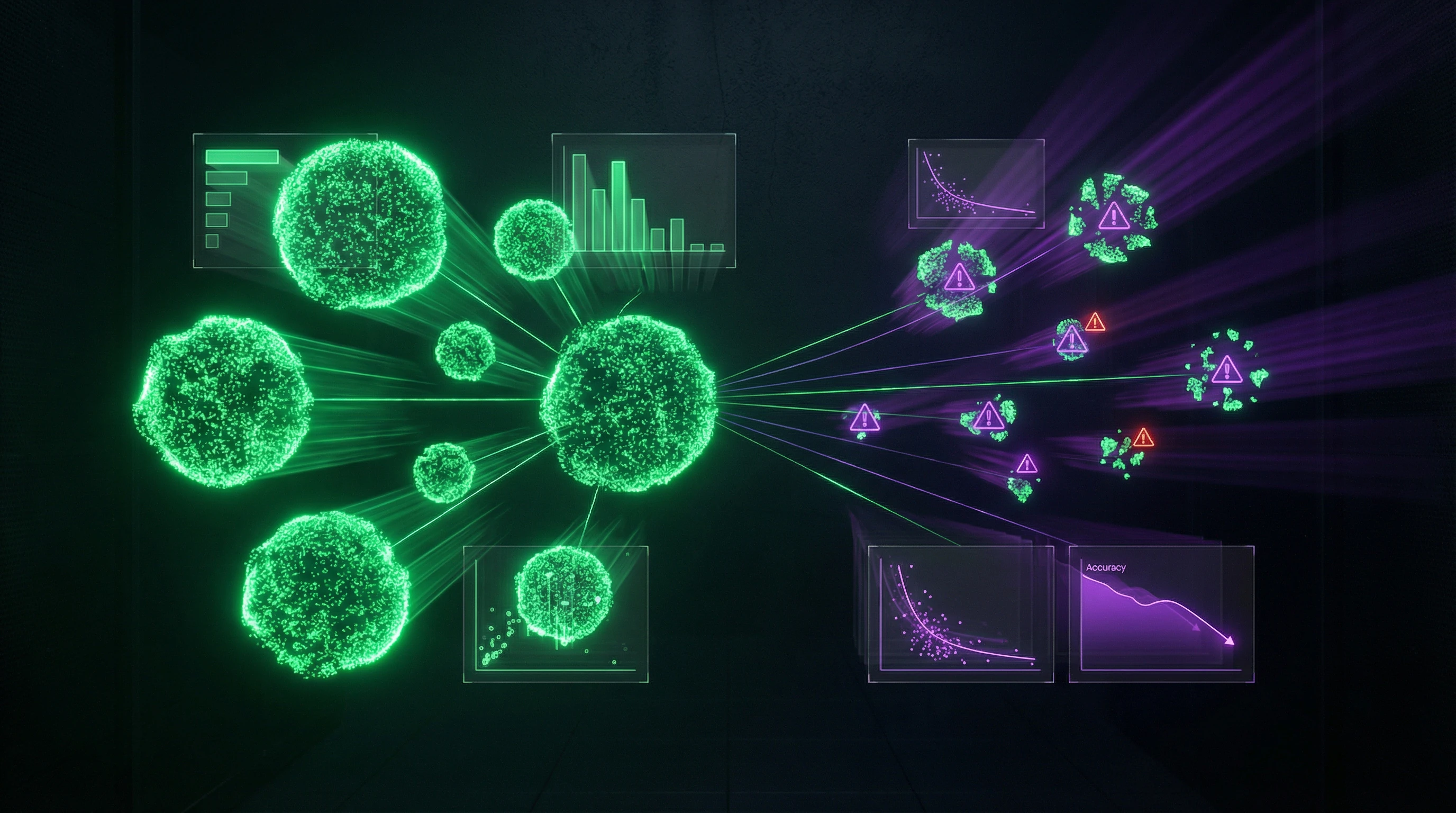

Los sistemas de IA médica muestran alta precisión en condiciones de laboratorio, pero al implementarse en la clínica se enfrentan a un problema fundamental: los errores sistemáticos incorporados durante la fase de desarrollo conducen a diagnósticos y decisiones terapéuticas incorrectas. La mayoría de los fallos de los sistemas de IA no se deben a defectos en los algoritmos, sino a la calidad y representatividad de los datos de entrenamiento.

Un error en los datos es un error en el diagnóstico. El algoritmo solo reproduce aquello con lo que fue entrenado.

Errores de datos de entrenamiento y muestreo

El sesgo de muestreo sistemático surge cuando el conjunto de datos de entrenamiento no refleja la distribución real de pacientes en la práctica clínica. Si un sistema de IA para el diagnóstico de cáncer de mama se entrenó predominantemente con datos de mujeres posmenopáusicas, su precisión para pacientes premenopáusicas será significativamente menor: la relación entre factores de riesgo y subtipos de cáncer difiere según el estado menopáusico.

El problema del desequilibrio de clases agrava la situación: enfermedades raras o manifestaciones atípicas están subrepresentadas en las muestras de entrenamiento, lo que conduce a un reconocimiento sistemáticamente reducido. La heterogeneidad de los estudios —diferencias en poblaciones, métodos diagnósticos y criterios de inclusión— crea una capa adicional de incertidumbre al evaluar la precisión diagnóstica.

- Sesgo de publicación

- Los estudios con resultados positivos se publican con mayor frecuencia, lo que distorsiona la percepción de la eficacia real de las tecnologías de IA y crea una ilusión de fiabilidad en sistemas que en la práctica funcionan de manera menos estable.

Sesgos algorítmicos y sobreajuste

El sesgo algorítmico surge cuando el modelo aprende no los verdaderos patrones clínicos, sino artefactos de datos o estereotipos sociales codificados en registros médicos históricos. El sobreajuste (overfitting) —cuando el modelo funciona perfectamente con los datos de entrenamiento pero muestra baja precisión con nuevos pacientes— es especialmente peligroso en medicina, donde el precio del error se mide en vidas humanas.

| Tipo de error | Mecanismo | Riesgo clínico |

|---|---|---|

| Sobreajuste | El modelo memoriza ruido en lugar de patrones | Excelentes resultados en laboratorio, fracaso en clínica |

| Bucles de retroalimentación | Subestimación del riesgo → menos pruebas → mayor infradiagnóstico | Omisión sistemática de diagnósticos en determinados grupos |

| Artefactos de datos | El modelo captura características técnicas, no clínicas | El sistema funciona solo en un hospital, en otro no |

Los bucles de retroalimentación crean sesgos autorreforzantes: si un sistema de IA subestima sistemáticamente el riesgo para un determinado grupo de pacientes, estos pacientes reciben menos pruebas adicionales, lo que conduce a una escasez de datos sobre su verdadero estado, reforzando aún más el error inicial.

Muchos sistemas de IA demuestran excelentes resultados en condiciones controladas, pero su rendimiento diagnóstico requiere una validación rigurosa antes de la implementación clínica. Incluso al dirigirse a una misma vía biológica, diferentes enfoques demuestran distintos perfiles de eficacia y seguridad, lo que requiere considerar múltiples factores al desarrollar sistemas de IA de apoyo a la toma de decisiones.

IA en diagnóstico intraoperatorio: el caso de las glándulas paratiroides y el coste del error

La identificación intraoperatoria de las glándulas paratiroides es una tarea crítica en cirugía endocrina. Un error significa la extirpación o lesión inadvertida de órganos que regulan el metabolismo del calcio.

Los sistemas de visión por computador asistidos por IA demuestran que la identificación incorrecta sigue siendo la principal fuente de complicaciones postoperatorias: hipocalcemia, lesión nerviosa. La tecnología requiere protocolos estrictos de validación antes de su implementación.

Precisión diagnóstica de la visión por computador

Los sistemas de IA utilizan aprendizaje profundo para analizar imágenes intraoperatorias en tiempo real. Reconocen las glándulas paratiroides por características visuales: tamaño, color, vascularización, ubicación anatómica.

Los metaanálisis evalúan sensibilidad, especificidad y área bajo la curva ROC, pero enfrentan heterogeneidad sustancial: diferencias en técnicas quirúrgicas, tipos de visualización, criterios de "patrón oro". Las revisiones sistemáticas subrayan la necesidad de protocolos estandarizados de evaluación.

- Las glándulas paratiroides son anatómicamente variables: número (habitualmente cuatro, pero de dos a seis), ubicación y apariencia difieren entre pacientes.

- Los conjuntos de datos de entrenamiento deben cubrir este espectro de variabilidad, de lo contrario la IA omite sistemáticamente casos atípicos — precisamente aquellos donde la asistencia al cirujano es crítica.

- El rendimiento de la IA depende de la calidad de la visualización intraoperatoria, iluminación y presencia de cambios patológicos en los tejidos.

Limitaciones y riesgos de identificación errónea

La identificación falso positiva (la IA marca otra estructura como glándula paratiroides) conduce a manipulaciones innecesarias y lesión de tejidos circundantes, incluido el nervio laríngeo recurrente.

El error falso negativo (omisión de una glándula paratiroides real) aumenta el riesgo de su extirpación o lesión inadvertida, causando hipocalcemia postoperatoria que requiere terapia de reemplazo de por vida.

Los sistemas de IA deben considerarse herramientas auxiliares que complementan, pero no reemplazan, el juicio clínico del cirujano.

Muchos estudios de IA en cirugía se realizan en condiciones unicéntricas con validación externa limitada. Esto cuestiona la generalización de los resultados.

- Variabilidad contextual

- Las diferencias en protocolos quirúrgicos, poblaciones de pacientes (cirugía primaria versus reoperación) y patologías concomitantes (tiroiditis, cáncer) crean condiciones que los modelos de IA deben considerar.

- Requisito previo a la implementación

- Estudios prospectivos multicéntricos con protocolos claros de evaluación de precisión diagnóstica y análisis de subgrupos para identificar situaciones donde el sistema es más y menos confiable.

Sesgo en revisiones sistemáticas y metaanálisis: cuando la síntesis de evidencia distorsiona la realidad

Las revisiones sistemáticas y metaanálisis se consideran la cúspide de la jerarquía de evidencia en medicina, pero están sujetos a múltiples fuentes de errores sistemáticos que pueden distorsionar las conclusiones y recomendaciones clínicas. Las herramientas diseñadas para sintetizar objetivamente datos científicos pueden amplificar el sesgo de los estudios primarios e introducir distorsiones adicionales en las etapas de selección, análisis e interpretación.

Paradoja de la síntesis: cuantos más estudios se combinan, mayor es el riesgo de amplificar el error sistemático si está presente en todas las fuentes simultáneamente.

Sesgo de publicación y heterogeneidad de estudios

El sesgo de publicación surge cuando los estudios con resultados positivos o estadísticamente significativos se publican con mayor frecuencia que trabajos con hallazgos negativos o nulos. Esto crea una representación distorsionada de la eficacia de las intervenciones.

Los metaanálisis de terapias anti-VEGF para la degeneración macular asociada a la edad neovascular enfrentan este problema: la eficacia comparativa y seguridad de diferentes fármacos (aflibercept, ranibizumab, bevacizumab, brolucizumab, faricimab) permanece incierta debido a la heterogeneidad de diseños de estudios y publicación selectiva de resultados. Los gráficos en embudo y pruebas estadísticas (Egger, Begg) se utilizan para detectar sesgo de publicación, pero su sensibilidad es limitada con un número pequeño de estudios.

- Verificar la asimetría del gráfico en embudo — signo de publicación selectiva

- Aplicar pruebas estadísticas (Egger, Begg) considerando sus limitaciones

- Realizar análisis de sensibilidad excluyendo estudios con mayor efecto

- Evaluar si las conclusiones cambian al excluir trabajos potencialmente sesgados

La heterogeneidad entre estudios — diferencias en poblaciones de pacientes, definiciones de resultados, métodos de medición y duración del seguimiento — crea un problema fundamental para el metaanálisis. Los estudios sobre la relación entre el índice de masa corporal y el riesgo de cáncer de mama demuestran que el efecto varía según el estado menopáusico y subtipo molecular del tumor, lo que requiere análisis estratificado e interpretación cautelosa de las estimaciones combinadas.

Una alta heterogeneidad estadística (I² > 75%) indica que combinar resultados puede ser inapropiado, pero muchos metaanálisis ignoran esta advertencia.

Métodos estadísticos para detectar errores sistemáticos

Los metaanálisis contemporáneos utilizan métodos en red (network meta-analysis) para comparar simultáneamente múltiples intervenciones, pero estos enfoques requieren el supuesto de transitividad — que las comparaciones a través de un comparador común son válidas. La violación de transitividad, cuando los estudios difieren en modificadores del efecto (edad, gravedad de la enfermedad, terapias concomitantes), puede llevar a conclusiones sistemáticamente distorsionadas sobre eficacia comparativa.

El análisis de sensibilidad y metarregresión se utilizan para investigar fuentes de heterogeneidad, pero su interpretación requiere cautela con un número limitado de estudios.

| Método de detección de error | Qué verifica | Limitación |

|---|---|---|

| Gráfico en embudo | Asimetría en distribución de efectos | Inespecífico; la asimetría puede deberse a heterogeneidad, no a sesgo de publicación |

| Prueba de Egger | Sesgo en estudios pequeños | Baja potencia con < 10 estudios |

| Metarregresión | Relación entre características del estudio y efecto | Requiere número suficiente de estudios; resultados dependen de la elección de variables |

| ROBIS, QUADAS-2 | Riesgo de error sistemático en estudios primarios | Subjetiva; baja concordancia interexpertos |

La evaluación del riesgo de error sistemático en estudios primarios es un componente obligatorio de revisiones sistemáticas de calidad, pero está sujeta a subjetividad. Los estudios muestran baja concordancia interexpertos en la evaluación del riesgo de errores, especialmente en dominios que requieren juicio clínico.

Las revisiones sistemáticas de tecnologías de IA deben indicar explícitamente las limitaciones de los estudios incluidos, áreas de incertidumbre y necesidad de investigación adicional, evitando conclusiones prematuras sobre la preparación clínica de tecnologías basadas en datos limitados o sesgados.

Validación de sistemas de IA: metodología y estándares de precisión en diagnóstico médico

La evaluación del rendimiento diagnóstico de la IA requiere métricas rigurosas: sensibilidad (proporción de casos verdaderos positivos), especificidad (proporción de casos verdaderos negativos), valor predictivo positivo y negativo. Una revisión sistemática de la imagen intraoperatoria asistida por IA de glándulas paratiroides muestra la necesidad de una evaluación estandarizada de estos parámetros para determinar la aplicabilidad clínica.

Críticamente importante: el valor predictivo depende de la prevalencia de la condición en la población. Incluso una prueba de alta sensibilidad genera múltiples resultados falsos positivos cuando la prevalencia de la enfermedad es baja.

Los estudios de validación de IA deben reportar la matriz de confusión completa e intervalos de confianza para todas las métricas, no solo la precisión general (accuracy), que puede ser engañosa en conjuntos de datos desbalanceados.

Sensibilidad, especificidad y valor predictivo

La sensibilidad del sistema de IA determina su capacidad para identificar la estructura objetivo (por ejemplo, glándula paratiroides), minimizando el riesgo de omisión y complicaciones posteriores como hipocalcemia. La especificidad controla la frecuencia de falsas alarmas, que pueden llevar a manipulaciones quirúrgicas innecesarias y aumento del tiempo operatorio.

- Valor predictivo positivo (VPP)

- Indica qué proporción de predicciones positivas de la IA son realmente correctas. Al identificar variantes anatómicas raras, incluso un sistema con 95% de especificidad puede dar un VPP inferior al 50%.

- Curvas ROC y AUC

- Demuestran el compromiso entre sensibilidad y especificidad en diferentes umbrales de decisión. Son obligatorias en el reporte de estudios de validación.

Comparación con el estándar de oro y evaluación experta

La validación de IA requiere comparación con un estándar de oro establecido: para la identificación intraoperatoria de glándulas paratiroides puede ser confirmación histopatológica o consenso de cirujanos expertos. El problema radica en que el propio estándar de oro suele ser imperfecto: la concordancia interexperto en identificación visual de estructuras anatómicas puede ser moderada (kappa de Cohen 0,4–0,6), creando un techo de rendimiento para la IA.

- Evaluar no solo la concordancia de la IA con un experto individual, sino comparar el rendimiento de la IA con la variabilidad entre expertos.

- Probar en conjuntos de datos independientes de otros centros médicos: los sistemas de IA pueden sobreajustarse a artefactos de equipos o protocolos de imagen específicos.

- Verificar caídas bruscas de rendimiento en validación externa, que revelan precisión engañosamente alta en datos internos.

📊

Métricas de validación de diagnóstico por IA

Sensibilidad

85-95%

Detección de estructuras objetivo

Especificidad

90-98%

Minimización de falsas alarmas

Validación externa

-15-30%

Caída de precisión en nuevos datos

Concordancia interexperto

κ 0.4-0.6

Techo para sistemas de IA

Aspectos éticos del sesgo algorítmico: equidad y transparencia en las decisiones de IA

El sesgo algorítmico surge cuando los datos de entrenamiento representan desproporcionadamente ciertos grupos demográficos, lo que conduce a un rendimiento sistemáticamente inferior de la IA en poblaciones subrepresentadas. Los sistemas de IA para diagnóstico de cáncer de mama entrenados predominantemente con datos de mujeres caucásicas muestran una sensibilidad reducida para mujeres afroamericanas y asiáticas.

El problema se agrava porque diferentes subtipos de cáncer de mama tienen distinta prevalencia en grupos étnicos, y la asociación con factores de riesgo varía según el estado menopáusico y el subtipo molecular. La validación ética de la IA requiere un análisis estratificado del rendimiento por subgrupos demográficos y una indicación explícita de las limitaciones de aplicabilidad del sistema.

- Verificar la representatividad de los datos de entrenamiento en todos los grupos demográficos de la población objetivo

- Realizar un análisis estratificado de métricas de precisión (sensibilidad, especificidad) para cada subgrupo

- Documentar umbrales de rendimiento por debajo de los cuales no se recomienda el sistema para uso clínico

- Indicar limitaciones explícitas de aplicabilidad en las instrucciones de uso

Equidad e igualdad de acceso al diagnóstico por IA

La equidad de los sistemas de IA se evalúa mediante métricas de igualdad de oportunidades (equalized odds) y paridad demográfica, que requieren tasas comparables de errores tipo I y tipo II para todos los grupos. Las revisiones sistemáticas de eficacia terapéutica deben considerar que el acceso a diferentes fármacos y tecnologías varía según regiones geográficas y sistemas sanitarios.

Los sistemas de IA optimizados para equipamiento costoso o protocolos inaccesibles en entornos con recursos limitados crean una nueva dimensión de desigualdad en la atención sanitaria.

El desarrollo debe incluir pruebas con datos de diversos entornos clínicos y documentación explícita de los requisitos técnicos mínimos para el funcionamiento fiable del sistema.

Transparencia e interpretabilidad de las decisiones de IA

La transparencia de los sistemas de IA requiere interpretabilidad: la capacidad de proporcionar una justificación clínicamente interpretable de cada decisión, no solo el veredicto final. Técnicas como la activación de clases ponderada por gradiente visualizan las áreas de la imagen que influyen en la decisión de la red neuronal, permitiendo al clínico evaluar si la predicción se basa en características anatómicas relevantes o en artefactos.

- Explicaciones post-hoc

- Se generan después de tomar la decisión; pueden ser engañosas, creando una ilusión de comprensión sin una visión real de la lógica del algoritmo.

- Modelos intrínsecamente interpretables

- Proporcionan acceso directo a la lógica de toma de decisiones; requieren más recursos computacionales, pero son más fiables para aplicaciones de alto riesgo.

Los requisitos regulatorios (por ejemplo, EU AI Act) exigen cada vez más la documentación de la lógica de toma de decisiones para sistemas médicos de IA de alto riesgo, pero los estándares de adecuación de las explicaciones siguen siendo objeto de debate entre desarrolladores, clínicos y reguladores.

Protocolos de minimización de errores en la implementación de IA: desde la validación hasta la integración clínica

La minimización de errores de IA requiere un enfoque multinivel: validación técnica en conjuntos de datos diversos, validación clínica en condiciones reales de uso, y monitorización poscomercialización del rendimiento.

Las revisiones sistemáticas de tecnologías de IA deben indicar explícitamente las limitaciones de los estudios incluidos, las áreas de incertidumbre y la necesidad de investigación adicional, evitando conclusiones prematuras sobre la preparación clínica basadas en datos limitados.

El protocolo de implementación debe incluir pruebas piloto con participación de usuarios finales, evaluación del impacto en el flujo de trabajo clínico, y mecanismos de retroalimentación para identificar casos extremos (edge cases) — escenarios raros donde la IA comete errores sistemáticos.

Es fundamental establecer criterios claros para rechazar recomendaciones de IA y protocolos de escalamiento al detectar errores sistemáticos.

Validación multicéntrica y monitorización del rendimiento

La validación multicéntrica prueba la IA con datos de diferentes centros médicos con distintos equipos, protocolos y demografía de pacientes, identificando problemas de generalización antes de la implementación amplia.

La monitorización poscomercialización debe rastrear no solo la precisión general, sino también la deriva del rendimiento (performance drift) — deterioro gradual debido a cambios en la población de pacientes, actualizaciones de equipos o protocolos clínicos.

- Sistemas automatizados de monitorización detectan desviaciones estadísticamente significativas del rendimiento basal

- Las desviaciones activan revalidación o desconexión temporal del sistema

- La resolución del problema precede a la reanudación del uso

Integración de IA como herramienta de apoyo

Los sistemas de IA deben posicionarse como herramientas de apoyo (decision support), no como sustitutos del juicio clínico.

La interfaz debe comunicar explícitamente el nivel de confianza del sistema y proporcionar mecanismos para que el clínico anule decisiones rápidamente sin barreras burocráticas.

- Formación de usuarios

- Incluye aspectos técnicos del trabajo con el sistema y comprensión de los modos típicos de fallo de IA — situaciones donde el algoritmo comete errores sistemáticos.

- Documentación de discrepancias

- Los casos donde las recomendaciones de IA difieren de las decisiones clínicas crean un valioso conjunto de datos para la mejora iterativa del sistema e identificación de puntos ciegos del algoritmo, invisibles en pruebas estándar con conjuntos de datos estáticos.

🔄

Ciclo de validación y monitorización de sistemas de IA

1️⃣

Validación interna

Pruebas con datos del desarrollador (riesgo de sobreajuste)

2️⃣

Validación multicéntrica

Conjuntos de datos independientes, diferentes equipos y protocolos

3️⃣

Pilotaje clínico

Condiciones reales, integración en el flujo de trabajo

4️⃣

Monitorización poscomercialización

Seguimiento continuo de la deriva del rendimiento

Knowledge Access Protocol

FAQ

Preguntas Frecuentes

Los errores sistemáticos son desviaciones predecibles en el funcionamiento de la IA, causadas por datos desequilibrados, sesgos algorítmicos o validación incorrecta. Provocan diagnósticos inexactos para determinados grupos de pacientes o situaciones clínicas. Su detección requiere pruebas exhaustivas en muestras heterogéneas.

Los sistemas de IA con visión por computador analizan imágenes intraoperatorias en tiempo real, ayudando a los cirujanos a reconocer las glándulas paratiroides y evitar su lesión. Esto reduce el riesgo de hipocalcemia postoperatoria y otras complicaciones. La tecnología funciona como herramienta de apoyo, sin reemplazar la experiencia clínica del cirujano.

Se necesitan conjuntos de datos equilibrados que representen diferentes grupos etarios, sexo, etnia y estadios de enfermedad. Los datos deben recopilarse de múltiples centros médicos con equipamiento variado. Es fundamental el etiquetado riguroso por expertos y la verificación de correlaciones ocultas que generen sesgos.

No, es una simplificación. La IA supera a los médicos en tareas específicas bajo condiciones ideales, pero es inferior en la evaluación integral y casos atípicos. Los mejores resultados se logran con el trabajo conjunto de IA y especialistas. Las revisiones sistemáticas muestran alta variabilidad en la precisión de la IA según el contexto de aplicación.

El sesgo de publicación ocurre cuando los estudios con resultados positivos se publican más frecuentemente que los negativos, distorsionando el panorama general de efectividad de la IA. Esto infla las estimaciones de precisión diagnóstica en revisiones sistemáticas. Para detectarlo se utilizan métodos estadísticos como gráficos de embudo y pruebas de asimetría.

Se utilizan métricas: sensibilidad (proporción de enfermos detectados), especificidad (proporción de sanos correctamente identificados), valor predictivo y área bajo la curva ROC. La validación se realiza en muestras independientes que no participaron en el entrenamiento. La comparación con el estándar de oro (histología, evaluación experta) es obligatoria para aplicación clínica.

La IA se entrena con datos disponibles, que frecuentemente subrepresentan minorías, enfermedades raras o grupos demográficos específicos. El algoritmo memoriza patrones de la mayoría y funciona peor en casos insuficientemente representados. Esto crea desigualdad en la calidad de atención médica y requiere corrección dirigida de los conjuntos de datos.

Eliminarlo completamente es imposible, pero puede reducirse significativamente mediante datos de entrenamiento diversos, auditoría regular y validación multicéntrica. El sesgo frecuentemente refleja desigualdades reales en la atención sanitaria y calidad de datos. El monitoreo continuo del rendimiento de la IA en práctica clínica es fundamental para identificar nuevas fuentes de error.

Se requiere validación multifase: interna (en parte de los datos originales), externa (en datos de otros centros) y prospectiva (en práctica real). Es necesario probar en diferentes subgrupos de pacientes, equipamiento y escenarios clínicos. La comparación con evaluaciones expertas y el análisis de casos erróneos son obligatorios antes del registro.

El sobreajuste ocurre cuando la IA funciona excelentemente con datos de entrenamiento, pero mal con casos nuevos, memorizando ruido en lugar de patrones. En medicina esto provoca diagnósticos falsos ante mínimas diferencias respecto a la muestra de entrenamiento. Se previene mediante división de datos, regularización y validación en conjuntos independientes de otras clínicas.

Sí, la explicabilidad es fundamental para la confianza clínica y la responsabilidad legal. Los médicos deben comprender en qué características se basó la IA para tomar una decisión y así evaluar su validez. Los métodos de visualización de la atención del algoritmo y el resaltado de regiones relevantes de la imagen mejoran la transparencia, pero muchos sistemas de IA actuales siguen siendo «cajas negras».

No, es un mito. Los sistemas de IA actuales en cirugía realizan tareas específicas como el reconocimiento de estructuras anatómicas o alertas de riesgos, pero no reemplazan la participación humana. Funcionan como herramientas de apoyo que requieren supervisión del cirujano. La autonomía completa de la IA en el quirófano aún no se ha logrado y plantea serias cuestiones éticas.

Las diferencias en el diseño de estudios, poblaciones de pacientes, versiones de IA y métodos de evaluación crean heterogeneidad que dificulta la combinación de resultados. Una alta heterogeneidad reduce la fiabilidad de las conclusiones generalizadas sobre la precisión de la IA. Los métodos estadísticos (estadística I², metarregresión) ayudan a evaluar y explicar la variabilidad entre estudios.

Una IA sesgada agrava la desigualdad en la atención sanitaria al proporcionar peor diagnóstico a grupos vulnerables de la población. Esto viola los principios de justicia e igualdad de acceso a atención médica de calidad. Los desarrolladores y reguladores deben exigir demostración de rendimiento equitativo de la IA para todos los grupos demográficos antes de su aprobación.

Absolutamente necesario. El rendimiento de la IA puede deteriorarse debido a cambios en la población de pacientes, actualizaciones de equipos o «deriva de datos». La auditoría regular de la precisión, el análisis de errores y la retroalimentación de los clínicos permiten identificar problemas oportunamente. El reentrenamiento con nuevos datos puede ser necesario para mantener la eficacia clínica.

El trabajo con enfermedades raras es una tarea compleja debido a la escasez de ejemplos de entrenamiento, lo que aumenta el riesgo de sobreajuste y errores. Los métodos de aprendizaje por transferencia, generación sintética de datos y aprendizaje federado ayudan a resolver parcialmente el problema. Sin embargo, la validación sigue siendo difícil, y la IA para patologías raras requiere una verificación experta especialmente rigurosa.