Qué promete exactamente el mito de la singularidad — y por qué la definición se diluye cada vez que intentan fijarla

El concepto de singularidad tecnológica se remonta a los trabajos del matemático Vernor Vinge (1993) y del futurista Ray Kurzweil, pero en tres décadas el término ha experimentado múltiples transformaciones. En sentido estricto, la singularidad describe el momento en que la inteligencia artificial alcance la capacidad de automejora recursiva — creando versiones más inteligentes de sí misma que, a su vez, crearán versiones aún más inteligentes, desencadenando una reacción en cadena incontrolable de crecimiento de inteligencia (S004). La metáfora matemática se toma prestada de la física de los agujeros negros, donde singularidad designa el punto en el que las leyes conocidas dejan de funcionar.

El problema comienza con la operacionalización. La investigación demuestra cómo el término se aplica a cualquier cambio rápido en sistemas tecnológicos, perdiendo especificidad (S003). Los autores utilizan "singularidad" para describir el momento en que las plataformas educativas digitales alcanzan una masa crítica de adopción — una definición radicalmente distinta del concepto original de automejora recursiva de IA.

No es un caso único: en la literatura académica el término se aplica a la revolución humanitario-tecnológica (S002), a cualquier "punto de no retorno" en sistemas sociales, a momentos de rápida digitalización. Si singularidad puede significar tanto el crecimiento explosivo de IA superhumana, como simplemente la rápida adopción de nuevas tecnologías, como un momento decisivo en educación, entonces el término pierde fuerza predictiva y analítica.

⚠️ Tres definiciones incompatibles que coexisten en un mismo discurso

- Despegue duro (Hard Takeoff)

- Momento en que la IA alcanza el nivel de inteligencia humana (AGI) y luego en un período breve (días, horas) transita hacia inteligencia superhumana (ASI) mediante automejora recursiva. Versión clásica de Vinge-Kurzweil, que supone ruptura de continuidad y pérdida de control humano.

- Despegue suave (Soft Takeoff)

- Aceleración gradual del progreso tecnológico, en la que la IA se vuelve cada vez más capaz, pero sin salto brusco. La transición hacia inteligencia superhumana toma años o décadas, dejando tiempo para adaptación y regulación. Más cercano a la realidad observable, pero pierde el dramatismo del "punto de no retorno".

- Singularidad metafórica

- Cualquier momento de cambios rápidos e irreversibles en sistemas tecnológicos o sociales, sin vinculación a IA o automejora. Precisamente esta versión domina en las fuentes (S002), (S003), (S004), donde singularidad se usa como sinónimo de "revolución", "transformación" o "momento decisivo".

La imprecisión de la definición no es un defecto del concepto de singularidad — es su característica clave, que garantiza su supervivencia. La pregunta "¿otra revolución planetaria o singularidad única?" permanece abierta precisamente porque los criterios de distinción no están establecidos.

Si la singularidad tuviera parámetros claros y medibles, podría verificarse y potencialmente refutarse. Pero la flexibilidad del término permite a los defensores del concepto redefinirla cada vez que las predicciones no se cumplen: si el despegue duro no ocurre, pueden cambiar al despegue suave; si tampoco se observa, pueden declarar singularidad a cualquier aceleración de innovaciones.

Es un mecanismo familiar de la historia de otros mitos: el concepto permanece convincente exactamente mientras su definición permanece difusa. En cuanto aparece la posibilidad de verificación, el mito o se transforma, o pierde audiencia. La singularidad eligió el primer camino. Más detalles en la sección Fundamentos del aprendizaje automático.

Los siete argumentos más convincentes a favor de la inevitabilidad de la singularidad — y por qué funcionan a nivel intuitivo

Antes de analizar la base probatoria, es necesario presentar honestamente los argumentos más sólidos de los defensores del concepto de singularidad. Esto no es un hombre de paja — es la versión más robusta de la posición (steelman), que explica por qué la idea resuena entre investigadores, ingenieros e inversores serios. Más información en la sección Medios sintéticos.

📊 Argumento 1: Trayectoria empírica de crecimiento exponencial de la potencia computacional

La Ley de Moore, que describe la duplicación del número de transistores en un chip cada 18–24 meses, estuvo vigente desde 1965 hasta principios de la década de 2020. Los defensores de la singularidad señalan que si el crecimiento exponencial de la potencia computacional continúa (mediante nuevas arquitecturas, computación cuántica, chips neuromórficos), alcanzar una potencia computacional equivalente al cerebro humano (~10^16 operaciones por segundo) será cuestión de tiempo.

Si a esto se añade la mejora de algoritmos, que también demuestra un crecimiento exponencial de eficiencia, la aparición de AGI parece inevitable en un futuro previsible. Este argumento es sólido porque se basa en tendencias históricas observables: la potencia computacional realmente creció exponencialmente durante décadas, y muchos avances en IA (desde el reconocimiento de imágenes hasta los modelos de lenguaje) fueron posibles precisamente gracias al escalado computacional.

| Período | Fuente de crecimiento | Atractivo intuitivo |

|---|---|---|

| 1965–2000 | Ley de Moore (transistores) | Hecho histórico, fácil de extrapolar |

| 2000–2020 | Computación paralela, GPU | Progreso visible en IA coincide con aumento de potencia |

| 2020+ | Arquitecturas cuánticas, neuromórficas | Nuevas tecnologías prometen un salto aún mayor |

🧠 Argumento 2: Posibilidad en principio de automejora recursiva

Si la IA alcanza un nivel en el que pueda comprender y mejorar su propio código (o desarrollar algoritmos de aprendizaje automático más eficientes), surge una retroalimentación positiva: cada mejora hace que el sistema sea más capaz de la siguiente mejora. La inteligencia humana está limitada por constantes biológicas (velocidad de transmisión neuronal, volumen de memoria de trabajo, esperanza de vida), pero la IA no tiene tales limitaciones.

Teóricamente, el sistema puede funcionar 24/7, escalarse horizontalmente (copiarse en múltiples servidores), intercambiar conocimientos instantáneamente. El argumento apela a la lógica: si la automejora es posible en principio, y si la IA no tiene las limitaciones biológicas del ser humano, entonces el proceso recursivo puede acelerarse hasta chocar con los límites físicos de la computación (termodinámica, velocidad de la luz).

El contraargumento requiere demostrar que la automejora es imposible o que existen barreras no evidentes — una posición más compleja de defender que simplemente extrapolar la lógica de retroalimentación.

🔬 Argumento 3: Precedentes de crecimiento explosivo en la evolución y la historia

Los defensores de la singularidad señalan ejemplos históricos de transiciones de fase: la aparición del lenguaje en Homo sapiens, la revolución neolítica, la revolución industrial, la revolución digital. Cada transición estuvo acompañada de una aceleración del ritmo de cambios.

Si se construye un gráfico de "tiempo entre revoluciones", demuestra una reducción de intervalos — desde millones de años entre transiciones biológicas hasta décadas entre transiciones tecnológicas. La extrapolación de esta tendencia sugiere que la siguiente transición (aparición de IA superhumana) podría ocurrir en años o incluso meses. La inducción no garantiza resultados futuros, pero intuitivamente el patrón parece convincente.

⚙️ Argumento 4: Incentivos económicos para crear IA cada vez más potente

La economía global invierte cientos de miles de millones de dólares en el desarrollo de IA. Las empresas que primero creen AGI obtendrán una ventaja competitiva colosal — la posibilidad de automatizar el trabajo intelectual, acelerar la investigación científica, dominar cualquier sector.

Esta carrera crea un poderoso imperativo económico para continuar escalando modelos, aumentar datasets, mejorar arquitecturas. Incluso si investigadores individuales son conscientes de los riesgos, la lógica del mercado empuja a la industria hacia adelante. Las inversiones en IA realmente crecen exponencialmente, y la competencia entre laboratorios (OpenAI, DeepMind, Anthropic, empresas chinas) se intensifica.

Los incentivos económicos son un poderoso predictor de comportamiento, y es difícil imaginar que la carrera se detenga voluntariamente.

🧬 Argumento 5: Ausencia de barreras fundamentales para AGI

El cerebro humano es un sistema físico que obedece las leyes de la física y la química. Si la inteligencia surge de procesos materiales (y no de un alma inmaterial), entonces en principio puede reproducirse en otro sustrato.

Ya sabemos que las redes neuronales son capaces de aprender, generalizar, resolver problemas. Los modelos de lenguaje actuales demuestran emergent abilities — capacidades que no fueron explícitamente programadas, sino que surgieron al escalar. Si no hay una barrera fundamental, entonces AGI es una cuestión de ingeniería y recursos, no de imposibilidad en principio.

- Materialismo: cerebro = máquina, la máquina puede copiarse

- Emergent abilities: capacidades surgen al escalar, no programadas explícitamente

- El contraargumento requiere postular inmaterialidad o barreras desconocidas

🕳️ Argumento 6: Asimetría de riesgos — el precio del error es demasiado alto

Incluso si la probabilidad de un despegue duro de la singularidad es baja (digamos, 5–10%), las consecuencias potenciales son tan catastróficas (riesgo existencial para la humanidad) que ignorar la amenaza es irracional. Esta es una aplicación del principio de precaución: con apuestas altas, incluso una probabilidad baja requiere atención seria.

Los defensores señalan que no podemos permitirnos equivocarnos — si la singularidad ocurre y no estamos preparados, las consecuencias son irreversibles. Lógica de seguro: pagamos una prima incluso si la probabilidad de catástrofe es pequeña. Emocionalmente, el argumento se refuerza con el miedo a perder el control y la amenaza existencial.

👁️ Argumento 7: Consenso experto sobre la posibilidad de AGI en un futuro previsible

Las encuestas a investigadores de IA muestran que una parte significativa de expertos considera probable la aparición de AGI en los próximos 20–50 años. Aunque las estimaciones varían, el pronóstico mediano apunta a 2040–2060.

Si los expertos que trabajan en el campo consideran AGI alcanzable, esto es un testimonio de peso. Los defensores de la singularidad señalan que el escepticismo a menudo proviene de personas alejadas de la investigación de vanguardia, mientras que quienes ven el progreso desde dentro son más optimistas (o pesimistas, según la perspectiva) respecto a la velocidad de desarrollo. El argumento apela a la autoridad de expertos — una heurística que generalmente funciona bien.

El problema es que los pronósticos expertos sobre tecnologías futuras históricamente no son fiables, pero intuitivamente tendemos a confiar en la opinión de profesionales.

Los siete argumentos funcionan a nivel intuitivo porque cada uno apela a diferentes mecanismos cognitivos: extrapolación de tendencias, lógica de retroalimentación, patrones históricos, incentivos económicos, materialismo, gestión de riesgos, autoridad de expertos. Juntos crean una narrativa convincente que explica por qué la idea de singularidad resuena incluso entre escépticos.

Qué muestran los datos de 2024–2025: tres gráficos que no confirman el despegue exponencial

Pasando de los argumentos teóricos a la verificación empírica, es necesario analizar qué está ocurriendo con el desarrollo de la IA en la realidad. Si la singularidad se aproxima, deberíamos observar ciertos indicadores: aceleración del ritmo de progreso, aparición de capacidades cualitativamente nuevas, señales de automejora recursiva. Más detalles en la sección IA y tecnologías.

Los datos de los últimos dos años pintan un panorama más complejo.

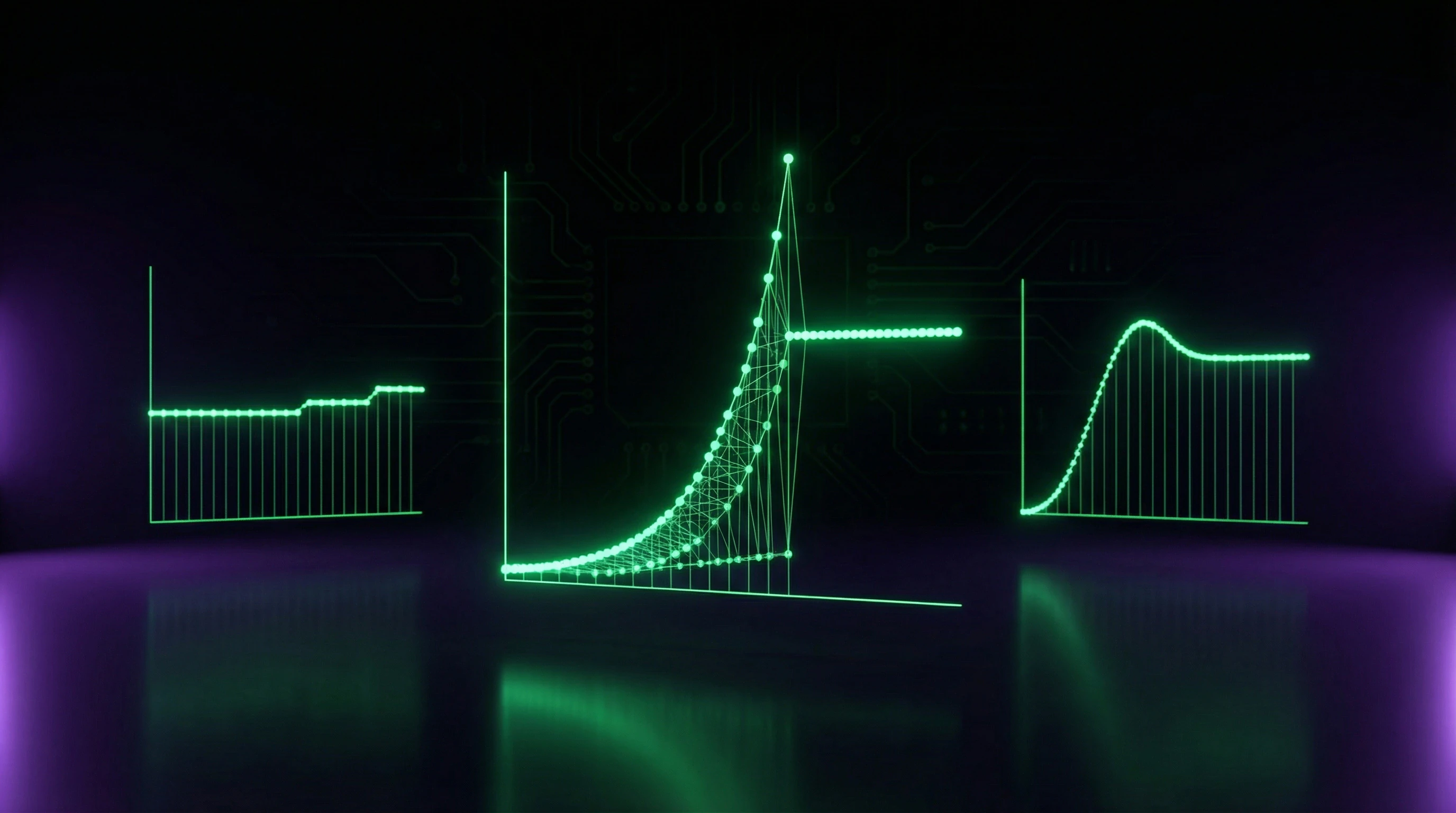

📊 Indicador 1: Desaceleración del crecimiento de rendimiento de los modelos de lenguaje al escalar

Entre 2020 y 2023 se observó un progreso impresionante: desde GPT-3 (175 mil millones de parámetros) hasta GPT-4 y competidores con billones de parámetros. Sin embargo, el análisis de benchmarks muestra que el incremento de rendimiento por unidad de aumento computacional ha comenzado a disminuir.

Los modelos se vuelven más grandes y costosos de entrenar, pero la mejora en la calidad de los resultados no sigue la trayectoria exponencial anterior. Este fenómeno, conocido como ley de rendimientos decrecientes del escalado, sugiere que simplemente aumentar el tamaño del modelo y del dataset no garantiza un crecimiento proporcional de capacidades (S010).

| Período | Característica del progreso | Indicador |

|---|---|---|

| 2020–2022 | Crecimiento exponencial del rendimiento | Cada duplicación de parámetros → salto significativo de calidad |

| 2023–2025 | Desaceleración de retornos | Billones de parámetros → mejoras marginales |

Una revisión sistemática de los enfoques actuales demuestra que incluso los sistemas de IA más avanzados enfrentan limitaciones fundamentales en la comprensión del contexto, las relaciones causales y la transferencia de conocimiento a nuevos dominios (S010). Si nos estuviéramos acercando a la AGI, deberíamos esperar mejoras precisamente en estas áreas.

🧪 Indicador 2: Ausencia de señales de automejora recursiva en los sistemas existentes

Un elemento clave del escenario de despegue duro es la capacidad de la IA para mejorar sus propios algoritmos. En la práctica, los sistemas actuales de aprendizaje automático no demuestran tal capacidad.

Los modelos de lenguaje pueden generar código, pero no pueden diseñar de forma autónoma nuevas arquitecturas de redes neuronales, optimizar el proceso de entrenamiento o mejorar sus propios pesos sin intervención humana. Todos los avances de los últimos años (transformers, reinforcement learning from human feedback, chain-of-thought prompting) fueron realizados por investigadores humanos, no por los propios modelos.

Los intentos de crear sistemas capaces de mejora automática de algoritmos (AutoML, neural architecture search) han mostrado éxito limitado. La brecha entre "optimización dentro del paradigma" y "creación de un nuevo paradigma" sigue siendo enorme.

Estos sistemas pueden optimizar hiperparámetros o buscar arquitecturas eficientes en un espacio de búsqueda definido, pero no son capaces de avances conceptuales que requieran repensar enfoques fundamentales.

🧾 Indicador 3: Estabilización de inversiones y transición del hype a la implementación práctica

Tras el pico de hype en torno a la IA generativa en 2023, el mercado comenzó a moderarse. Las inversiones continúan creciendo, pero el ritmo de crecimiento se ha desacelerado, y el foco se ha desplazado de crear modelos cada vez más grandes a la implementación práctica y monetización de las tecnologías existentes.

- Alto coste de inferencia

- Barrera económica para la adopción masiva; las empresas buscan formas de reducir costes, no escalar capacidades.

- Complejidad de integración

- La IA requiere reelaboración de procesos existentes; no es una revolución, sino un desafío de ingeniería.

- Problemas de fiabilidad

- Alucinaciones, comportamiento impredecible: señales de que los sistemas siguen siendo herramientas, no agentes.

Este patrón es típico de los ciclos tecnológicos: tras el entusiasmo inicial llega la fase del "valle de la desilusión" (según el modelo Gartner Hype Cycle). Si la singularidad estuviera cerca, observaríamos la dinámica opuesta: aceleración de inversiones, declaraciones de pánico sobre pérdida de control, medidas urgentes de los reguladores.

En cambio, la industria transita hacia un modo de normalización: la IA se convierte en una herramienta habitual, no en una amenaza revolucionaria. Esto corresponde a la lógica de transformación gradual, no de transición abrupta.

🔎 Análisis cualitativo: por qué las "emergent abilities" no son prueba de la aproximación de la AGI

Los defensores de la singularidad a menudo señalan las emergent abilities: capacidades que aparecen súbitamente en grandes modelos de lenguaje al alcanzar cierta escala, pero están ausentes en versiones menores. Los ejemplos incluyen capacidad aritmética, razonamiento lógico, traducción a idiomas no representados en los datos de entrenamiento.

Esto se interpreta como señal de un salto cualitativo, presagio de transiciones más dramáticas. Sin embargo, el análisis detallado muestra que muchas "emergent abilities" son artefactos de la elección de métricas y umbrales de evaluación.

- Los investigadores utilizan métricas binarias (pasó/no pasó el test) en lugar de continuas.

- Al recalcular con métricas continuas, la aparición "súbita" resulta ser una mejora gradual.

- Las capacidades cruzan un umbral arbitrario, creando la ilusión de un salto.

- Las capacidades mejoran suavemente con la escala, no aparecen de la nada.

Esto no niega el progreso impresionante, pero cuestiona la interpretación como salto cualitativo. El patrón es más consistente con progreso incremental que con aproximación a la singularidad.

Mecanismos de causalidad: por qué la correlación entre potencia computacional e inteligencia no es lineal

Uno de los argumentos centrales de los defensores de la singularidad se basa en la extrapolación: si la potencia computacional crece exponencialmente, y si la inteligencia se correlaciona con la potencia computacional, entonces la inteligencia de la IA también debería crecer exponencialmente. Esta lógica contiene varios supuestos ocultos que no resisten el análisis. Más detalles en la sección Errores mentales.

🧬 Problema 1: La inteligencia no se reduce a potencia computacional — el papel de la arquitectura y los algoritmos

El cerebro humano funciona a una frecuencia de ~200 Hz (velocidad de transmisión de impulsos nerviosos), órdenes de magnitud más lento que los procesadores modernos (gigahercios). Sin embargo, el cerebro resuelve tareas con las que la IA tiene dificultades o no puede resolver en absoluto: comprensión del mundo físico, inteligencia social, creatividad, transferencia de conocimientos.

La eficiencia de la inteligencia está determinada no por la velocidad de cálculo, sino por la arquitectura de procesamiento de información. Duplicar procesadores sin cambiar el algoritmo a menudo produce un incremento sublineal de rendimiento.

Esto señala una diferencia fundamental: la inteligencia biológica está optimizada para la eficiencia energética y la adaptabilidad, no para la potencia computacional absoluta. Las redes neuronales modernas requieren un crecimiento exponencial de parámetros para un incremento lineal de calidad — un fenómeno conocido como scaling plateau.

🔄 Problema 2: Ley de rendimientos decrecientes en el escalado

Los datos de 2023–2024 muestran que el aumento del tamaño del modelo produce cada vez menos incremento de rendimiento por cada duplicación del volumen de cálculos. Esto no es casualidad — es consecuencia de que la calidad de los datos de entrenamiento es finita, y las limitaciones arquitectónicas de los transformers se hacen visibles al escalar.

- Primeros 10 mil millones de parámetros: incremento significativo de capacidades

- 100 mil millones de parámetros: incremento notable, pero desacelerándose

- 1 billón de parámetros: mejoras marginales en la mayoría de tareas

- Escalado adicional: requiere arquitecturas cualitativamente nuevas, no simplemente más cálculos

Esto significa que el crecimiento exponencial de la potencia computacional no se transforma en crecimiento exponencial de la inteligencia. La curva se aplana.

⚙️ Problema 3: La inteligencia es multidimensional, la potencia computacional es unidimensional

La inteligencia incluye: lógica, intuición, comprensión social, planificación, aprendizaje con muestras pequeñas, transferencia de conocimientos, metacognición. La potencia computacional es simplemente la cantidad de operaciones por segundo. La correlación entre ellas existe, pero no es causal ni monotónica.

- Inteligencia lógica

- Puede mejorar con mayor potencia computacional, pero choca con limitaciones algorítmicas (NP-completitud, indecidibilidad).

- Inteligencia social

- Requiere no cálculos, sino modelos de comportamiento humano, que no se pueden obtener simplemente aumentando parámetros.

- Creatividad

- Depende de la arquitectura de búsqueda en el espacio de soluciones, no de la velocidad de exploración de variantes.

Intentar resolver todos los problemas de la IA mediante el escalado es un error categorial. Es como intentar mejorar la música aumentando el volumen.

🎯 Por qué el mito de la correlación lineal es tan convincente

La extrapolación funciona a nivel intuitivo: vemos que la potencia computacional crece, vemos que la IA mejora, y asumimos que existe una relación causa-efecto. Pero esto es post hoc ergo propter hoc — una falacia lógica.

La correlación entre potencia computacional y rendimiento de la IA existe, pero enmascara una causa más profunda: la mejora de arquitecturas, algoritmos y datos. Cuando estos factores se estabilizan, la potencia computacional pierde su poder mágico.

Esto explica por qué las predicciones sobre la singularidad en 2030, 2040 o 2050 se posponen constantemente. Cada vez que el escalado deja de funcionar, los defensores de la singularidad buscan una nueva fuente de crecimiento exponencial — computadoras cuánticas, chips neuromórficos, nuevas arquitecturas. Pero esto ya no es extrapolación, sino búsqueda de salvación del mito.

La realidad: la IA se desarrollará, pero mediante saltos cualitativos en arquitectura y comprensión, no mediante escalado infinito. Esto es más lento, menos dramático, pero mucho más probable. Más detalles sobre cómo fallaron las predicciones en el análisis de las predicciones de Kurzweil.