La hipótesis de la simulación sostiene que nuestra realidad podría ser un programa informático. A pesar de su popularidad en la cultura popular y entre entusiastas tecnológicos, esta idea enfrenta un problema fundamental: es irrefutable e inverificable. Filósofos y científicos señalan que la hipótesis de la simulación no ofrece un mecanismo de verificación, no genera predicciones y no puede distinguirse de explicaciones alternativas de la realidad. Esto la convierte en un experimento mental interesante, pero no en una teoría científica.

👁️ Imagina una idea que simultáneamente captura la imaginación de millones, inspira películas taquilleras y debates filosóficos, pero que resulta absolutamente inútil para la ciencia. La hipótesis de la simulación se ha convertido en un fenómeno cultural del siglo XXI, penetrando desde círculos académicos hasta la conciencia colectiva a través de «Matrix», las declaraciones de Elon Musk e innumerables podcasts. Sin embargo, tras su atractiva fachada se esconde un problema fundamental: esta idea no puede ser ni demostrada ni refutada. Existe en una categoría especial de afirmaciones que los filósofos denominan «irrefutables», y precisamente esto la hace científicamente estéril, a pesar de todo su atractivo intelectual.

🧩 Qué afirma exactamente la hipótesis de la simulación — y por qué los límites de esta afirmación están difuminados hasta resultar irreconocibles

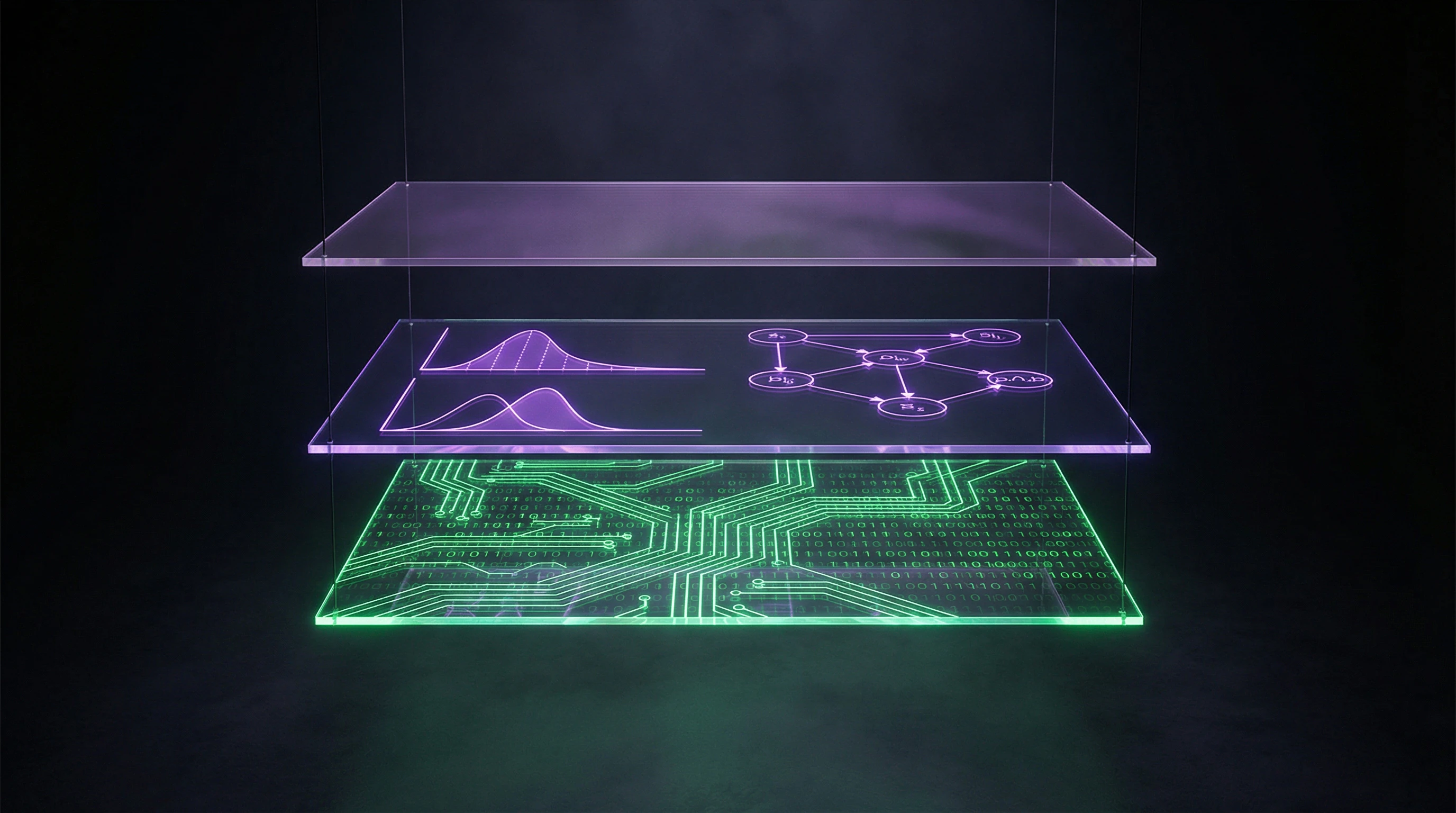

En su forma básica, la hipótesis de la simulación propone que la realidad que observamos no es un universo físico fundamental, sino una simulación computacional creada por una civilización o entidad más avanzada. Nick Bostrom (2003) propuso un trilema: o bien las civilizaciones se extinguen antes de alcanzar la madurez tecnológica, o bien las civilizaciones avanzadas no están interesadas en crear simulaciones, o bien nos encontramos en una simulación (S001).

Tres versiones de la hipótesis con consecuencias radicalmente diferentes

Problema crítico: la «hipótesis de la simulación» no es una afirmación única. Existen al menos tres versiones distintas que a menudo se mezclan en las discusiones populares. Más detalles en la sección Deepfakes.

- Versión débil

- Es técnicamente posible crear una simulación de seres conscientes. Esta es una afirmación sobre la viabilidad en principio, no sobre la probabilidad.

- Versión media

- Tales simulaciones serán creadas en grandes cantidades. Añade una suposición sobre motivación y escala.

- Versión fuerte

- Con alta probabilidad nos encontramos en una de esas simulaciones ahora mismo. Esta es ya una afirmación concreta sobre nuestra realidad (S001).

David Chalmers intentó dar a la hipótesis una forma más rigurosa mediante el concepto de «ontología digital de la conciencia». Pero incluso este intento se enfrenta al problema de la operacionalización: ¿cómo definimos exactamente una «simulación»?

Si una simulación es indistinguible de la «realidad base» en todos los parámetros observables, ¿en qué consiste la diferencia sustancial entre estos conceptos?

El problema de la demarcación: dónde termina la física y comienza la metafísica

La hipótesis de la simulación se equilibra en la frontera entre afirmación empírica y especulación metafísica. A diferencia de las teorías científicas, que hacen predicciones concretas sobre fenómenos observables, la hipótesis de la simulación no ofrece un mecanismo que permita distinguir un universo «simulado» de uno «real». Esto la sitúa en la misma categoría que el escenario escéptico clásico de Descartes sobre el genio maligno o la versión moderna del «cerebro en una cubeta» (S003).

Para que una hipótesis tenga valor científico, debe ser falsable — deben existir observaciones potenciales que puedan refutarla. La hipótesis de la simulación, por lo general, se formula de tal manera que cualquier observación puede explicarse dentro de su marco.

| Observación | Explicación dentro de la hipótesis |

|---|---|

| Se descubre una anomalía en la física | Es un bug en la simulación |

| Las leyes físicas funcionan perfectamente | La simulación funciona correctamente |

| Se encuentra una estructura discreta del espacio | Son los píxeles de la simulación |

| El espacio es continuo | La simulación usa coordenadas continuas |

Esta estructura hace que la hipótesis sea inmune a la refutación — cualquier resultado puede interpretarse como confirmación (S003).

Por qué la versión popular de la hipótesis no es lo que discuten los filósofos

Existe una brecha significativa entre la discusión académica sobre la hipótesis de la simulación y su versión popular. En la cultura de masas, la hipótesis a menudo se presenta como una afirmación concreta sobre la naturaleza de la realidad con consecuencias potencialmente verificables — la búsqueda de «glitches» en las leyes físicas o de una estructura discreta del espacio-tiempo.

Los filósofos académicos, como Chalmers, discuten la hipótesis en el contexto del problema de la conciencia y la teoría computacional de la mente — un nivel de abstracción completamente diferente (S001). Los emprendedores tecnológicos y divulgadores a menudo presentan la hipótesis como si tuviera consecuencias prácticas o incluso una estimación probabilística («50% de probabilidad de que estemos en una simulación»), sin especificar en qué premisas exactamente se basan estas estimaciones y qué hipótesis alternativas se consideran.

La versión popular de la hipótesis de la simulación no es una afirmación filosófica sobre la naturaleza de la conciencia, sino un mito tecnológico que toma prestada la terminología de la discusión académica, pero pierde su estructura lógica.

Cinco argumentos más sólidos a favor de la hipótesis de la simulación — y por qué no la convierten en teoría científica

Antes de criticar la hipótesis de la simulación, es necesario presentarla en su forma más convincente — esto se llama «steelmanning». Los defensores plantean varios argumentos intelectualmente serios que merecen consideración atenta. Más información en la sección Errores y sesgos de la IA.

🔬 Argumento desde la potencia computacional y el crecimiento exponencial de las tecnologías

Durante los últimos 70 años, la potencia computacional ha crecido exponencialmente, siguiendo la ley de Moore. Si extrapolamos esta tendencia siglos o milenios hacia adelante, las civilizaciones futuras poseerán recursos que superarán los actuales en muchos órdenes de magnitud.

Con suficiente potencia, la simulación de universos enteros con todos sus procesos físicos se vuelve técnicamente factible. El desarrollo de la realidad virtual y los videojuegos demuestra que la brecha entre simulación y realidad se reduce constantemente.

📊 Argumento probabilístico de Bostrom: si las simulaciones son posibles, debe haber muchas

El argumento central se basa en un razonamiento probabilístico. Si las civilizaciones tecnológicamente maduras son capaces de crear simulaciones de seres conscientes y están interesadas en crear múltiples simulaciones de este tipo, entonces un simple cálculo muestra que la inmensa mayoría de seres conscientes deben encontrarse en simulaciones, no en la realidad base.

Matemáticamente: si una civilización base crea N simulaciones, y cada una contiene M seres conscientes, entonces la proporción de seres simulados respecto a los «reales» es N×M a 1. Con valores grandes de N y M, la probabilidad de que un ser elegido al azar se encuentre en la realidad base tiende a cero.

🧠 Argumento desde la teoría computacional de la consciencia y el funcionalismo

El tercer argumento se apoya en el funcionalismo — la posición de que la consciencia está definida no por el sustrato (neuronas biológicas), sino por la organización funcional y los procesos computacionales (S001). Si esto es cierto, la consciencia puede implementarse en cualquier sustrato computacional suficientemente complejo, incluidos los ordenadores digitales.

Si la consciencia es un proceso computacional, entonces una consciencia simulada será consciencia real, no una imitación. Los seres simulados tendrán experiencia subjetiva genuina, indistinguible de la experiencia de seres en la realidad base.

🕳️ Argumento desde la mecánica cuántica y la naturaleza discreta de la realidad

Algunos defensores señalan características de la mecánica cuántica como posibles indicios de la naturaleza simulada de la realidad. La incertidumbre cuántica, el principio de superposición y el colapso de la función de onda al observar se interpretan como optimizaciones de recursos computacionales: el sistema no calcula el estado exacto de una partícula hasta que resulta necesario.

Los enfoques teóricos de la gravedad cuántica sugieren una estructura discreta del espacio-tiempo a escalas de Planck — análogo a la estructura pixelada de una pantalla de ordenador. Aunque estas ideas permanecen especulativas, se utilizan para apoyar la intuición sobre la naturaleza «digital» de la física.

⚙️ Argumento desde el ajuste fino de las constantes físicas

El último argumento está relacionado con el problema del ajuste fino de las constantes físicas fundamentales. Los valores observados de la constante cosmológica, las proporciones de masas de partículas elementales y las constantes de interacción se encuentran en un rango muy estrecho que permite la existencia de estructuras complejas y vida.

El más mínimo cambio en estos valores haría el universo inhabitable. La hipótesis de la simulación se propone como explicación: los parámetros de nuestro universo fueron elegidos por los creadores específicamente para garantizar fenómenos interesantes, incluida la vida y la consciencia.

- Los cinco argumentos se basan en la extrapolación de tendencias actuales (crecimiento computacional, desarrollo de RV) hacia un futuro incierto.

- El argumento probabilístico de Bostrom requiere aceptar tres premisas no demostradas simultáneamente.

- El funcionalismo es una posición filosófica, no un hecho establecido sobre la naturaleza de la consciencia.

- La mecánica cuántica se interpreta a través del prisma de la optimización computacional, pero esta no es la única interpretación.

- El ajuste fino se explica mediante múltiples hipótesis alternativas (multiverso, principio antrópico).

La fuerza de estos argumentos radica en que son lógicamente coherentes y se apoyan en fenómenos reales. La debilidad está en que ninguno ofrece una forma de distinguir la simulación de la realidad — y este es un requisito fundamental para una hipótesis científica.

Cada argumento es convincente de forma aislada, pero juntos crean una ilusión de poder explicativo. En realidad describen una posibilidad, no una probabilidad, y no ofrecen un mecanismo de verificación.

Esto distingue la hipótesis de la simulación de las teorías científicas, que no solo explican fenómenos, sino que predicen consecuencias observables que permiten refutarlas. Los mitos sobre la IA consciente a menudo se construyen con la misma lógica: descripción convincente de una posibilidad sin mecanismo de verificación.

Por qué ninguno de estos argumentos convierte la hipótesis en una afirmación científica verificable

A pesar de la sofisticación intelectual de los argumentos presentados, todos adolecen de un problema fundamental: no ofrecen ningún método de verificación empírica de la hipótesis de la simulación. Cada argumento se basa en premisas filosóficas no demostradas, realiza saltos lógicos que no se derivan de las premisas presentadas, o simplemente reformula el problema sin resolverlo. Más detalles en la sección Tecno-esoterismo.

📊 La extrapolación del progreso tecnológico no constituye prueba

El argumento basado en la potencia computacional asume que las tendencias actuales en el desarrollo tecnológico continuarán indefinidamente. Sin embargo, la historia de la ciencia está repleta de ejemplos de tecnologías que alcanzaron límites fundamentales.

La Ley de Moore ya se está desacelerando debido a efectos cuánticos a escalas pequeñas. Existen límites teóricos de la computación relacionados con la termodinámica y la mecánica cuántica (límite de Bremermann, límite de Bekenstein).

Incluso asumiendo un crecimiento ilimitado de la potencia computacional, esto no demuestra que la simulación de seres conscientes sea técnicamente posible. No sabemos si la consciencia es una función computable y, de serlo, qué recursos computacionales se requieren para simularla.

Es posible que existan obstáculos fundamentales para la simulación de la consciencia que no puedan superarse simplemente aumentando la potencia computacional (S001).

🧩 El argumento probabilístico de Bostrom contiene premisas ocultas

El trilema de Bostrom parece un razonamiento lógico riguroso, pero se basa en varias premisas implícitas, cada una de las cuales puede cuestionarse.

- Primera premisa: espacio probabilístico de realidades

- El argumento asume que podemos aplicar razonamientos probabilísticos de manera significativa a la cuestión de en qué "realidad" nos encontramos. Esto requiere la existencia de algún espacio probabilístico en el que se pueda definir una medida sobre diferentes tipos de realidades, una suposición que en sí misma es metafísica y carece de justificación evidente (S003).

- Segunda premisa: principio de indiferencia

- El argumento asume que debemos considerarnos seleccionados aleatoriamente del conjunto de todos los seres conscientes. Este principio es problemático en el contexto de razonamientos antrópicos y conduce a paradojas conocidas, como la paradoja del Juicio Final. Los filósofos señalan que la aplicación de razonamientos probabilísticos a cuestiones sobre la naturaleza fundamental de la realidad requiere justificación adicional que Bostrom no proporciona (S003).

🧠 El funcionalismo sobre la consciencia sigue siendo una posición filosófica no demostrada

El argumento basado en la teoría computacional de la consciencia depende completamente de la veracidad del funcionalismo, una teoría filosófica sobre la naturaleza de la consciencia. Sin embargo, el funcionalismo es solo una de muchas teorías competidoras sobre la consciencia, y enfrenta objeciones serias.

El famoso experimento mental de John Searle, la "Habitación China", se dirige precisamente contra el funcionalismo, argumentando que el procesamiento sintáctico de símbolos (computación) no puede generar comprensión semántica ni experiencia subjetiva (S001).

Incluso si el funcionalismo fuera correcto, esto no resuelve la cuestión de si podemos determinar si estamos en una simulación. Si la consciencia simulada es indistinguible de la consciencia "real" en todas sus características internas, entonces la distinción entre ambas se vuelve puramente externa y posiblemente carente de significado práctico.

Chalmers reconoce este problema, sugiriendo que en cierto sentido la realidad simulada es "auténtica" para sus habitantes (S001). Para más información sobre las trampas filosóficas de la consciencia, véase el análisis de los mitos sobre la IA consciente.

⚠️ La mecánica cuántica no proporciona evidencia de simulación

La interpretación de la mecánica cuántica como indicio de simulación es un ejemplo clásico de apofenia: la percepción de patrones donde no los hay. La indeterminación cuántica y el colapso de la función de onda tienen múltiples interpretaciones dentro de la física estándar (interpretación de Copenhague, interpretación de muchos mundos, de Broglie-Bohm, etc.), ninguna de las cuales requiere la suposición de una simulación.

En cuanto a la discreción del espacio-tiempo, esta sigue siendo una cuestión abierta en la gravedad cuántica. Algunos enfoques (gravedad cuántica de bucles) proponen discreción, otros (teoría de cuerdas) no. Pero incluso si el espacio-tiempo fuera discreto a escalas de Planck, esto no constituye prueba de simulación: es simplemente una propiedad fundamental de la física.

La analogía con los píxeles de una pantalla de ordenador es superficial y carece de poder explicativo. La discreción de la física no requiere explicación mediante simulación, del mismo modo que las propiedades ondulatorias de la materia no requieren explicación mediante ondas en un medio.

Para más detalles sobre el misticismo cuántico y sus falacias lógicas, véase el análisis del misticismo cuántico.

Problema fundamental de la irrefutabilidad — y por qué esto aniquila el valor científico de la hipótesis

El problema central de la hipótesis de la simulación no radica en que sea incorrecta, sino en que es irrefutable. Esto la coloca en una categoría especial de afirmaciones que los filósofos de la ciencia consideran científicamente estériles. Karl Popper formuló el criterio de falsabilidad como línea de demarcación entre ciencia y no-ciencia: una teoría científica debe hacer predicciones que puedan ser refutadas mediante observaciones. Más información en la sección Verificación de la Realidad.

🔎 Qué hace que una afirmación sea irrefutable y por qué es problemático

Una afirmación irrefutable es aquella compatible con cualquier observación posible. El ejemplo clásico es la afirmación «Dios existe y actúa en el mundo, pero sus acciones son indistinguibles de los procesos naturales». Tal afirmación es imposible de refutar porque cualquier observación puede interpretarse como compatible con ella.

La hipótesis de la simulación tiene la misma estructura: afirma la existencia de una realidad «externa» (los creadores de la simulación) que por definición es inaccesible para la observación desde dentro de la simulación (S003).

Si una teoría es compatible con cualquier observación, no explica nada. La explicación requiere excluir alternativas — una teoría debe indicar no solo lo que observamos, sino también lo que no deberíamos observar si la teoría fuera correcta.

La hipótesis de la simulación no hace tales predicciones (S003). El problema de la irrefutabilidad no radica en que tales afirmaciones sean necesariamente falsas, sino en que carecen de poder explicativo.

📊 La hipótesis de la simulación y el escepticismo clásico: el mismo problema

Los filósofos señalan que la hipótesis de la simulación es una versión moderna de los escenarios escépticos clásicos, como el genio maligno de Descartes o el «cerebro en una cubeta». Descartes propuso un experimento mental: ¿y si todo lo que percibimos es una ilusión creada por un genio maligno que engaña nuestros sentidos?

La versión moderna: ¿y si somos cerebros en cubetas conectados a un ordenador que genera todas nuestras experiencias? (S003)

| Escenario | Estructura del problema | Por qué no es científico |

|---|---|---|

| Genio maligno de Descartes | Un agente externo crea una ilusión perfecta | No hay forma de distinguir el engaño de la realidad |

| Cerebro en una cubeta | Un ordenador genera todas las experiencias | La ilusión perfecta es indistinguible de la realidad |

| Hipótesis de la simulación | Los creadores ejecutaron nuestra realidad como un programa | La realidad externa es inaccesible para la observación |

Estos escenarios son filosóficamente interesantes porque nos obligan a reflexionar sobre la naturaleza del conocimiento y la justificación de las creencias. Pero no son hipótesis científicas porque no ofrecen una forma de distinguir el estado «engañado» del «no engañado» (S003).

🧬 Por qué «buscar glitches» no es un programa científico

Algunos entusiastas de la hipótesis de la simulación proponen buscar «glitches» o anomalías en las leyes físicas como prueba de la naturaleza simulada de la realidad. Esta idea es atractiva, pero enfrenta varios problemas.

En primer lugar, ¿qué se considera exactamente un «glitch»? Cualquier anomalía en los datos puede explicarse como un error de medición, como indicación de nueva física, o como un «glitch en la simulación». Sin un criterio independiente para distinguir estas interpretaciones, la búsqueda de glitches no constituye una prueba de la hipótesis.

- Error de medición

- Problema en el instrumento o metodología, requiere repetir el experimento

- Nueva física

- Fenómeno que requiere ampliar las teorías existentes, se verifica mediante predicciones

- Glitch en la simulación

- Interpretación que no hace nuevas predicciones ni excluye alternativas

En segundo lugar, incluso si descubriéramos una anomalía inexplicable, esto no sería prueba de una simulación — sería simplemente una anomalía inexplicable. La historia de la ciencia está llena de ejemplos de anomalías que finalmente recibieron explicación dentro de teorías ampliadas o nuevas (precesión del perihelio de Mercurio, momento magnético anómalo del electrón, etc.). Interpretar una anomalía como «glitch en la simulación» es una suposición adicional que requiere justificación.

⚙️ El problema de la subdeterminación de la teoría por los datos

Los filósofos de la ciencia conocen desde hace tiempo el problema de la subdeterminación: los mismos datos pueden ser explicados por varias teorías competidoras. La hipótesis de la simulación es un caso extremo de este problema.

Cualquier observación que podamos hacer dentro de la simulación es compatible tanto con la hipótesis de la simulación como con la hipótesis de que vivimos en una realidad base. No hay forma lógica de elegir entre ellas basándose en los datos.

Esto significa que la hipótesis de la simulación no puede ser ni confirmada ni refutada empíricamente. Permanece en el ámbito de la metafísica, no de la ciencia. La ciencia requiere no solo la posibilidad lógica de una teoría, sino también su capacidad de excluir alternativas mediante predicciones y observaciones.

Un problema relacionado — los mitos sobre la IA consciente a menudo se basan en una lógica similar: si no podemos distinguir la consciencia de su imitación, entonces la distinción se vuelve filosófica, no científica. Análogamente, si no podemos distinguir la simulación de la realidad, esta distinción queda fuera de los límites de la ciencia.

🔬 Por qué esto aniquila el valor científico

El valor científico de una teoría radica en su capacidad de orientar investigaciones, hacer nuevas predicciones y excluir alternativas. La hipótesis de la simulación no hace nada de esto. No predice ningún fenómeno que no fuera predicho por teorías alternativas. No excluye ninguna observación que fuera excluida por teorías alternativas.

Además, la hipótesis de la simulación no orienta la investigación en nuevas direcciones. Los físicos, biólogos y otros científicos no la utilizan para planificar experimentos o desarrollar nuevos métodos. Permanece en el ámbito de la filosofía popular y la ciencia ficción, no en el de la actividad científica activa.

Esto no significa que la hipótesis de la simulación sea inútil como idea filosófica. Puede ser útil para reflexionar sobre la naturaleza de la realidad, la consciencia y el conocimiento. Pero como hipótesis científica, está muerta al nacer — no porque sea incorrecta, sino porque es irrefutable y no hace predicciones que puedan ser verificadas.