Anatomía del mito: qué hace que un concepto erróneo sobre IA sea tan persistente y por qué los argumentos racionales son ineficaces contra él

Un mito sobre inteligencia artificial no es simplemente una afirmación falsa. Es una construcción cognitiva autosostenible que explota características fundamentales del pensamiento humano: el miedo a lo desconocido, la tendencia a simplificar sistemas complejos y la necesidad de narrativas que expliquen cambios tecnológicos rápidos (S005).

Los mitos sobre IA se propagan más rápido que la información factual precisamente porque ofrecen respuestas emocionales simples a cuestiones técnicas complejas (S005).

⚠️ Tres componentes de un mito persistente

- Anclaje emocional

- Miedo a perder el empleo, ansiedad ante tecnología incontrolable o euforia por promesas de transformación empresarial instantánea. La emoción es el filtro primario de percepción de información.

- Modelo mental simplificado

- Reducción de un sistema complejo a una sola característica: «la IA reemplaza personas», «la IA siempre es objetiva», «la IA es magia». La simplificación reduce la carga cognitiva, pero distorsiona la realidad (S001).

- Refuerzo social

- Repetición del mito a través de medios, marketing corporativo y opiniones expertas sin verificación de fundamentos. La autoridad de la fuente reemplaza la verificación de hechos (S003).

🧩 Por qué los líderes empresariales son especialmente vulnerables

Los directivos de empresas se encuentran en la zona de máximo riesgo: deben tomar decisiones estratégicas sobre inversiones en IA sin formación técnica profunda, bajo presión de competidores y expectativas de accionistas (S003).

La falta de tiempo para verificar información, la dependencia de fuentes secundarias y la carga cognitiva obligan a confiar en heurísticas en lugar de análisis. El 67% de los líderes empresariales reconocen haber tomado decisiones sobre IA basándose en información incompleta o distorsionada (S004).

🔁 Bucle de confirmación: cómo el mito crea realidad

El aspecto más peligroso de los mitos sobre IA es su capacidad para crear profecías autocumplidas. Una empresa que cree en el mito «la IA es demasiado cara para nosotros» no invierte en la tecnología, se queda atrás de sus competidores y obtiene confirmación: «¿Ven? No podemos permitírnoslo» (S004).

| Mito | Acción de la empresa | Resultado | «Confirmación» |

|---|---|---|---|

| «La IA es demasiado cara» | Rechazo de inversiones | Retraso frente a competidores | «No podemos permitírnoslo» |

| «La IA reemplazará a todos» | Atmósfera de miedo, sabotaje | Fracaso del proyecto | «La IA es peligrosa para nosotros» |

Este bucle de retroalimentación hace que el mito sea prácticamente invulnerable a la crítica externa: se confirma por sus propias consecuencias. Los argumentos racionales no funcionan porque no abordan el anclaje emocional ni ofrecen una narrativa alternativa. Más detalles en la sección Ética de la inteligencia artificial.

Desmontar mitos no requiere refutación, sino reconstrucción: reemplazar el modelo simplificado por uno más preciso, el anclaje emocional por mecanismos concretos, el refuerzo social por hechos verificables. Es trabajo de inmunología cognitiva, no de retórica.

Mito primero: «La IA es una varita mágica que resolverá instantáneamente todos los problemas empresariales sin esfuerzo de nuestra parte»

Este error conceptual es el más costoso para las empresas. Launch Consulting lo denomina «mito de la transformación mágica» y señala que es precisamente el que conduce al mayor número de fracasos en proyectos de IA (S003). Las compañías esperan que la implementación de IA optimice automáticamente los procesos, aumente los beneficios y resuelva problemas estructurales, sin requerir cambios en la organización, los datos o la estrategia.

🔬 Realidad: La IA es un amplificador de procesos existentes, no su sustituto

Blue Prism subraya: la eficacia de la IA depende directamente de la calidad de su integración en los flujos de trabajo existentes y de su alineación con los objetivos estratégicos de la organización (S001). La IA no crea estrategia: la ejecuta más rápido y a mayor escala.

Launch Consulting aporta un dato crítico: la IA prospera con datos, y sin datos de calidad, estructurados y relevantes, cualquier sistema generará resultados inútiles o perjudiciales (S003). La investigación muestra que el 70% de los proyectos de IA fallidos fracasaron no por la tecnología, sino por una mala preparación de datos y la ausencia de un objetivo empresarial claro.

- La calidad de los datos determina la calidad del resultado: basura entra = basura sale.

- El objetivo estratégico debe formularse ANTES de elegir la tecnología, no después.

- La integración con procesos existentes requiere rediseñar el workflow, no simplemente añadir una nueva herramienta.

📊 El precio de la ilusión: tres categorías de pérdidas por creer en la solución mágica

La primera categoría son las pérdidas financieras directas por inversiones injustificadas. Las empresas gastan recursos en implementar soluciones de IA sin una auditoría previa de procesos, obtienen un sistema que automatiza operaciones ineficientes y se sorprenden por la ausencia de ROI (S001).

La segunda son las oportunidades perdidas: mientras la organización espera la «magia», los competidores implementan metódicamente IA en procesos concretos y bien preparados, obteniendo ventajas reales (S003). La tercera es el daño reputacional: el fracaso de un proyecto de IA de alto perfil genera resistencia interna a la tecnología durante años (S004).

El fracaso de un proyecto de IA no es solo dinero gastado. Es la pérdida de confianza en la tecnología dentro de la organización y la congelación de todas las iniciativas posteriores, incluso si están justificadas.

⚙️ Mecanismo del error: por qué el marketing de los proveedores de IA refuerza el mito

Arion Research señala el papel de los proveedores de soluciones de IA en mantener este mito (S004). Los materiales de marketing a menudo prometen «transformación en 90 días», «automatización sin programación» y «ROI inmediato», omitiendo la necesidad de preparar datos, formar al personal, ajustar iterativamente los modelos e integrar con sistemas legacy.

No es engaño en sentido jurídico, pero sí la creación de expectativas irreales que garantizan la decepción. ProfileTree señala: las empresas que implementaron IA con éxito invirtieron en promedio entre 6 y 18 meses en preparar la infraestructura antes de lanzar el primer algoritmo productivo (S008).

Cf. también: IA en medicina: cómo distinguir el avance del marketing y ChatGPT y la ola de avances en IA: dónde termina la realidad y comienza el ruido publicitario.

Mito segundo: «La IA reemplazará completamente los empleos humanos y hará innecesarias la mayoría de las profesiones»

Este mito es el más cargado emocionalmente y utilizado políticamente. Blue Prism lo denomina «mito del reemplazo total» y señala que bloquea la implementación de IA con más fuerza que cualquier limitación técnica (S001). El miedo a perder el empleo genera resistencia en todos los niveles organizacionales, desde empleados de base hasta sindicatos y reguladores.

🧪 Datos frente al miedo: qué muestran las investigaciones sobre el impacto real de la IA en el empleo

El Foro Económico Mundial proyecta la creación de 97 millones de nuevos empleos para 2025 (S011). Esto no significa ausencia de pérdidas —algunas posiciones desaparecerán efectivamente—, pero el balance general es positivo.

El impacto principal de la IA es la transformación de roles existentes, no su eliminación (S004). Las operaciones rutinarias se automatizan, liberando tiempo para análisis, toma de decisiones y trabajo creativo.

La IA no reemplaza personas, potencia el talento humano. La IA sobresale en el procesamiento de grandes volúmenes de datos y la ejecución de operaciones repetitivas, pero depende críticamente del contexto humano, la evaluación ética y el pensamiento estratégico (S003).

🧬 Nuevos roles: qué profesiones crea la IA y por qué son más de lo que parece

Roles directos creados por la industria de IA: especialistas en IA, científicos de datos, ingenieros de aprendizaje automático, especialistas en ética de IA, auditores de algoritmos (S011).

Los roles indirectos amplían el espectro: gestores de transformación de procesos, especialistas en preparación de datos, entrenadores de modelos de IA, intérpretes de resultados para negocio, diseñadores de interfaces humano-máquina (S010).

- Abogados especializados en regulación de IA

- Psicólogos que estudian la interacción humano-IA

- Especialistas en detección y eliminación de sesgos algorítmicos (S008)

⚠️ La amenaza real: no el reemplazo, sino la falta de preparación para la transformación

El peligro no radica en que la IA quite empleos, sino en que trabajadores y organizaciones no se preparen para los cambios (S009). Las empresas que no invierten en recualificación de personal enfrentarán una crisis de empleo —no porque la IA haya reemplazado personas, sino porque las personas no adquirieron las competencias para trabajar con IA.

Las organizaciones exitosas utilizan la IA para el upskilling de empleados y la creación de nuevos roles enfocados en la colaboración con tecnologías de IA (S004). Es una elección estratégica, no una inevitabilidad tecnológica.

Mito tercero: «Todas las tecnologías de IA son iguales — son solo nombres diferentes para lo mismo»

Este error es especialmente peligroso para los líderes empresariales que toman decisiones sobre inversiones. Arion Research lo denomina «mito de la monoliticidad de la IA» y señala que conduce a la elección de tecnologías inadecuadas para tareas específicas (S004). Los directivos piensan en la IA como una tecnología única, pero en realidad es un término paraguas que abarca un amplio espectro de métodos, herramientas y capacidades con diferentes aplicaciones y limitaciones.

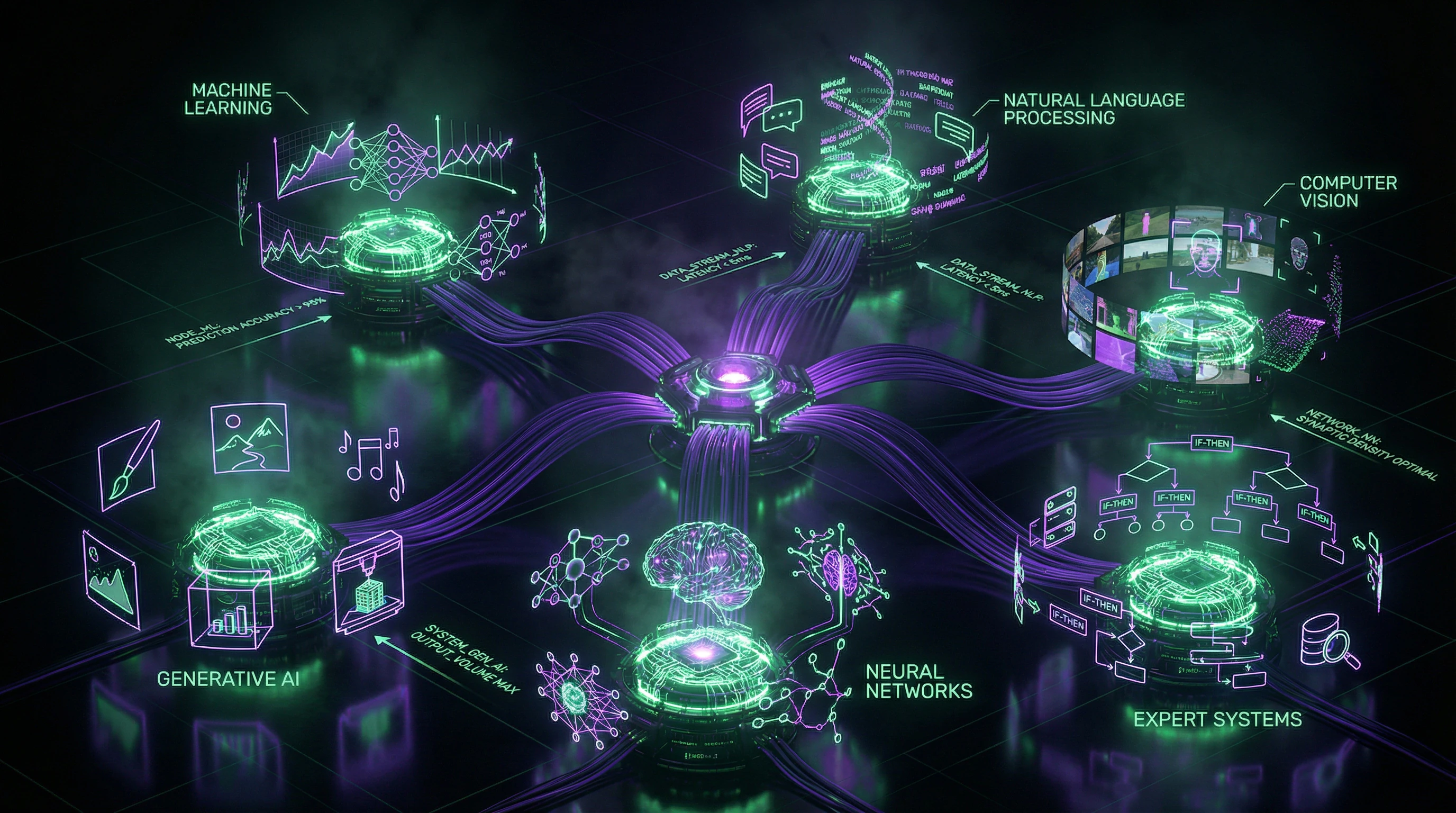

🔎 Taxonomía de la realidad: seis categorías principales de IA

Arion Research identifica las categorías clave: aprendizaje automático (ML), procesamiento del lenguaje natural (NLP), visión por computador, IA generativa, redes neuronales y sistemas expertos (S004). Cada categoría resuelve tareas específicas y requiere diferentes datos, infraestructura y experiencia.

| Categoría | Tarea principal | Datos de entrada | Salida |

|---|---|---|---|

| Aprendizaje automático (ML) | Analítica predictiva, clasificación | Datos numéricos estructurados | Probabilidad, clase, puntuación |

| NLP | Trabajo con texto y voz | Texto, audio | Significado, clasificación, traducción |

| Visión por computador | Análisis de imágenes y vídeo | Imágenes, flujo de vídeo | Objetos, coordenadas, anomalías |

| IA generativa | Creación de contenido | Indicaciones textuales, ejemplos | Texto, imágenes, código |

| Redes neuronales | Reconocimiento de patrones complejos | Datos multidimensionales | Representaciones ocultas, predicciones |

| Sistemas expertos | Toma de decisiones formalizada | Hechos, reglas del dominio | Decisión con explicación |

📊 Consecuencias prácticas: cómo la elección incorrecta mata el proyecto

Error típico: una empresa elige IA generativa para una tarea que requiere clasificación precisa, y obtiene resultados creativos pero inexactos (S012). Una organización implementa aprendizaje profundo para una regresión simple, pagando de más por recursos computacionales y obteniendo un modelo imposible de interpretar.

Otro escenario: una empresa intenta usar un modelo NLP entrenado en inglés para analizar documentación técnica especializada en otro idioma y se sorprende de la baja calidad (S012). Blue Prism subraya: la IA generativa es adecuada para resolver tareas significativas, especialmente en automatización y mejora de la eficiencia de sistemas legacy y modernos, pero no es una solución universal (S001).

Elegir la categoría incorrecta de IA no es un error técnico, sino estratégico. Conduce a pérdida de inversiones, frustración del equipo y descrédito de la IA en la organización.

🧰 Criterios de selección: cinco preguntas para determinar la categoría adecuada

- Naturaleza de los datos de entrada: ¿números estructurados, texto, imágenes, series temporales?

- Tipo de salida: ¿clasificación, predicción, generación, optimización?

- Requisitos de interpretabilidad: ¿es necesario explicar cada decisión o basta con precisión general?

- Limitaciones de recursos: ¿qué capacidad computacional y tiempo de entrenamiento están disponibles?

- Disponibilidad de datos: ¿cuántos ejemplos etiquetados existen para el entrenamiento?

Launch Consulting señala: las respuestas a estas cinco preguntas determinan la categoría adecuada de IA con una precisión del 80–90% (S003). Omitir este análisis es la principal causa de fracasos en la implementación.

Mito cuarto: «Implementar IA es demasiado caro y complejo para nuestra organización»

Este mito bloquea la adopción de IA en pequeñas y medianas empresas, creando una ventaja competitiva para las grandes corporaciones. Arion Research lo denomina «mito de la inaccesibilidad» y señala que se basa en percepciones obsoletas sobre el coste y la complejidad de las tecnologías de IA (S004).

La realidad ha cambiado en los últimos cinco años gracias a la computación en la nube y los modelos preentrenados (S004). Los avances en computación en la nube y la disponibilidad de modelos de IA preentrenados han hecho que la IA sea más accesible que nunca (S004).

🔬 Revolución de la accesibilidad: cómo las plataformas en la nube transformaron la economía de la IA

Muchas herramientas de IA en la nube ofrecen una barrera de entrada baja y escalabilidad adecuada tanto para pequeñas como para grandes empresas (S004). Launch Consulting subraya: gracias a la computación en la nube y los frameworks de IA de código abierto, organizaciones de cualquier tamaño pueden acceder a soluciones de IA por una fracción del coste histórico (S003).

Blue Prism añade: ahora la mayoría de las organizaciones pueden beneficiarse de la IA sin costes elevados (S001).

📊 Coste real: tres modelos de precios y su aplicabilidad

ProfileTree identifica tres modelos principales de acceso a la IA (S008).

- APIs en la nube con pago por uso: la empresa paga solo por las consultas reales al modelo, sin inversión en infraestructura. El coste comienza desde céntimos por mil consultas para modelos básicos.

- Modelos preentrenados con ajuste fino: la organización toma un modelo listo (a menudo gratuito o económico) y lo reentrena con sus propios datos. Los costes se centran principalmente en recursos computacionales para el entrenamiento, que pueden alquilarse temporalmente.

- Soluciones totalmente personalizadas: desarrollo desde cero que requiere un equipo de especialistas e inversiones significativas. Este modelo solo es necesario para tareas únicas donde las soluciones existentes no funcionan.

La mayoría de las necesidades empresariales se resuelven con los dos primeros modelos (S008).

⚙️ Complejidad oculta: dónde surgen realmente los problemas

Bernard Marr (Forbes) señala las fuentes reales de complejidad: no la tecnología de IA en sí, sino la integración con sistemas existentes, la gestión del cambio organizacional y el aseguramiento de la calidad de los datos (S010). Launch Consulting confirma: la barrera del coste no es tan alta como antes, pero la barrera de la preparación organizacional sigue siendo significativa (S003).

Las empresas subestiman la necesidad de formar al personal, rediseñar procesos y crear una cultura que apoye la experimentación con IA (S003). No es un desafío técnico, sino organizacional, y ahí es donde se esconde el coste real de la implementación.

| Barrera | Naturaleza del problema | Estrategia de superación |

|---|---|---|

| Coste de la tecnología | Sobrevalorado; soluciones en la nube económicas | Comience con APIs en la nube, pague por uso |

| Integración con sistemas | Requiere rediseño de procesos | Proyectos piloto en tareas aisladas |

| Competencias del equipo | Falta de conocimiento, no escasez de personas | Formación de empleados existentes, no contratación de expertos |

| Cultura organizacional | Miedo al fracaso, conservadurismo | Apoyo a la experimentación, transparencia de resultados |

Arion Research recomienda: comience con proyectos piloto de pequeña escala, utilice soluciones en la nube ya disponibles e invierta en desarrollar competencias de IA entre los empleados existentes, en lugar de contratar expertos externos costosos (S004).

Si le interesa cómo distinguir avances reales del ruido de marketing en áreas relacionadas, consulte IA en medicina: cómo distinguir el avance del marketing. Más información en la sección Deepfakes.

Mito cinco: «La IA es completamente objetiva y libre de sesgos, a diferencia de los humanos»

Este es uno de los mitos más peligrosos, porque crea una falsa sensación de seguridad. Blue Prism lo llama «mito de la objetividad maquinal» y advierte: ningún sistema puede ser completamente objetivo, del mismo modo que ninguna persona puede estar libre de la influencia del mundo que la rodea (S001). La IA hereda y a menudo amplifica los sesgos presentes en los datos de entrenamiento (S001).

Un algoritmo no es un juez, es un espejo. Si en el espejo se refleja una sociedad sesgada, el reflejo será sesgado.

🧬 Mecanismo del sesgo: cómo las distorsiones humanas se codifican en algoritmos

El problema fundamental es simple: los modelos de IA se entrenan con datos, y los sesgos humanos pueden existir inicialmente en esos datos (S004). Si los datos históricos de contratación muestran preferencia por determinados grupos demográficos, el sistema de IA entrenado con esos datos reproducirá y amplificará ese sesgo (S004).

Blue Prism añade: los sesgos injustos de la IA surgen cuando una aplicación de IA se desarrolla con prejuicios humanos inherentes (S001). Los algoritmos de IA deben actualizarse regularmente y someterse a auditorías para evitar sesgos y garantizar la precisión (S011).

🔬 Casos documentados: tres categorías de discriminación algorítmica

ProfileTree clasifica los tipos de sesgo de la IA (S008):

- Sesgo en los datos: el conjunto de entrenamiento no es representativo de la población real. Un sistema de reconocimiento facial entrenado predominantemente con imágenes de un grupo racial muestra baja precisión para otros grupos (S008).

- Sesgo en el diseño del algoritmo: la elección de la métrica de optimización o la arquitectura del modelo favorece implícitamente determinados resultados. Un sistema de puntuación crediticia optimizado solo para minimizar impagos puede denegar sistemáticamente crédito a grupos con menor historial crediticio, incluso si son solventes (S008).

- Sesgo en la interpretación: los resultados de la IA se utilizan sin considerar el contexto. Un sistema de predicción de reincidencia cuyas puntuaciones de riesgo se usan mecánicamente, sin tener en cuenta factores sociales (S008).

Cada categoría requiere enfoques diferentes para la detección y corrección. Ignorar cualquiera de ellas conduce a discriminación sistemática disfrazada de «objetividad».

🛡️ Protocolo de protección: cinco prácticas obligatorias para minimizar el sesgo

| Práctica | Qué hace | Por qué es crítico |

|---|---|---|

| Diversidad de datos de entrenamiento | Búsqueda activa e inclusión de datos de grupos subrepresentados (S004) | Sin esto, el modelo es ciego a segmentos enteros de la realidad |

| Monitoreo regular de sesgos | Pruebas automatizadas que verifican diferencias en el rendimiento para distintos grupos demográficos (S004) | El sesgo no es visible hasta que se mide |

| Adaptabilidad | Disposición para corregir el sistema al detectar problemas (S004) | Un algoritmo estático se degrada a medida que cambia la realidad |

| Mecanismos de protección (guardrails) | Prevención de problemas; señalización de comportamiento injusto (S001) | El sistema debe poder decirse «no» a sí mismo |

| Transparencia de decisiones | Auditores y usuarios comprenden por qué el sistema tomó una decisión concreta (S011) | Una caja negra no es objetividad, es irresponsabilidad |

Estas prácticas no garantizan la perfección, pero transforman la IA de una caja negra en un sistema que puede auditarse, criticarse y mejorarse. Este es el único camino hacia un uso responsable.

Más información sobre cómo el marketing oculta las limitaciones reales de las tecnologías en el artículo sobre IA en medicina y el análisis de la ola de avances en IA. Más detalles en la sección Detección de deepfakes.

Mito sexto: «La IA no requiere nada más que datos — simplemente carga la información y obtén resultados»

Esta simplificación ignora la importancia crítica de la calidad, relevancia y gestión de datos (S001). Datos sucios — basura entra, basura sale.

Un sistema de IA no trabaja con información en general, sino con patrones específicos en conjuntos específicos. Si los datos contienen errores, omisiones, registros obsoletos o sesgos de muestra — el modelo aprenderá a reproducir estos defectos con precisión matemática. Más detalles en la sección Estadística y teoría de probabilidades.

La calidad de los datos determina el techo de calidad del resultado. Ningún algoritmo puede extraer señal del ruido si el ruido es todo lo que le has dado.

Segunda capa: los datos necesitan preparación. Esto significa normalización, codificación de categorías, tratamiento de valores faltantes, eliminación de valores atípicos, balanceo de clases (si es necesario). Cada paso — una decisión que afecta al resultado.

Tercera capa: relevancia. Los datos de ventas de café no ayudarán a predecir la demanda de energía eléctrica. Es necesario entender qué variables están realmente relacionadas con el fenómeno objetivo y cuáles son ruido o artefactos de correlación.

- Auditoría de fuentes de datos: de dónde provienen, cómo se recopilaron, quién los verificó

- Verificación de completitud: hay valores faltantes, cómo se distribuyen, por qué surgieron

- Análisis de sesgos: es la muestra representativa, o refleja solo parte de la realidad

- Validación de relevancia: están las características relacionadas con el objetivo o es correlación espuria

- Monitoreo de deriva: cambian los patrones en los datos con el tiempo

Cuarta capa: gestión. Los datos necesitan versionado, documentación, control de acceso, actualización. Si cargaste un dataset hace un año y lo olvidaste — el modelo trabaja con datos muertos.

Quinta capa: ética y regulación. Si los datos contienen información sobre categorías protegidas (raza, género, salud), es necesario entender cómo esto afecta la equidad de los resultados (S005). Esto no es un problema técnico — es un problema de responsabilidad.

«Simplemente carga los datos» — es como decirle a un cirujano: «Simplemente toma el bisturí». La herramienta existe, pero sin diagnóstico, preparación y experiencia el resultado será catastrófico.

Coste real: la preparación de datos a menudo ocupa el 60–80% del tiempo del proyecto. Esto no es un error, es una característica. Las organizaciones que lo entienden obtienen sistemas funcionales. Las que lo ignoran obtienen fracasos costosos.