Qué entendemos exactamente por "avance en IA" — y por qué esta definición es crítica para el análisis

Antes de evaluar ChatGPT, necesitamos establecer criterios claros. El término "avance" en el contexto de la IA ha perdido significado operacional — algunos llaman avance a la mejora de métricas en benchmarks, otros solo a innovaciones arquitectónicas fundamentales, otros a la adopción masiva en la vida cotidiana. Más detalles en la sección Ética y seguridad de la IA.

Sin definición comparamos lo incomparable. Un experto ve una revolución, otro un chatbot sobrevalorado — y ambos tienen razón, simplemente hablan de cosas diferentes.

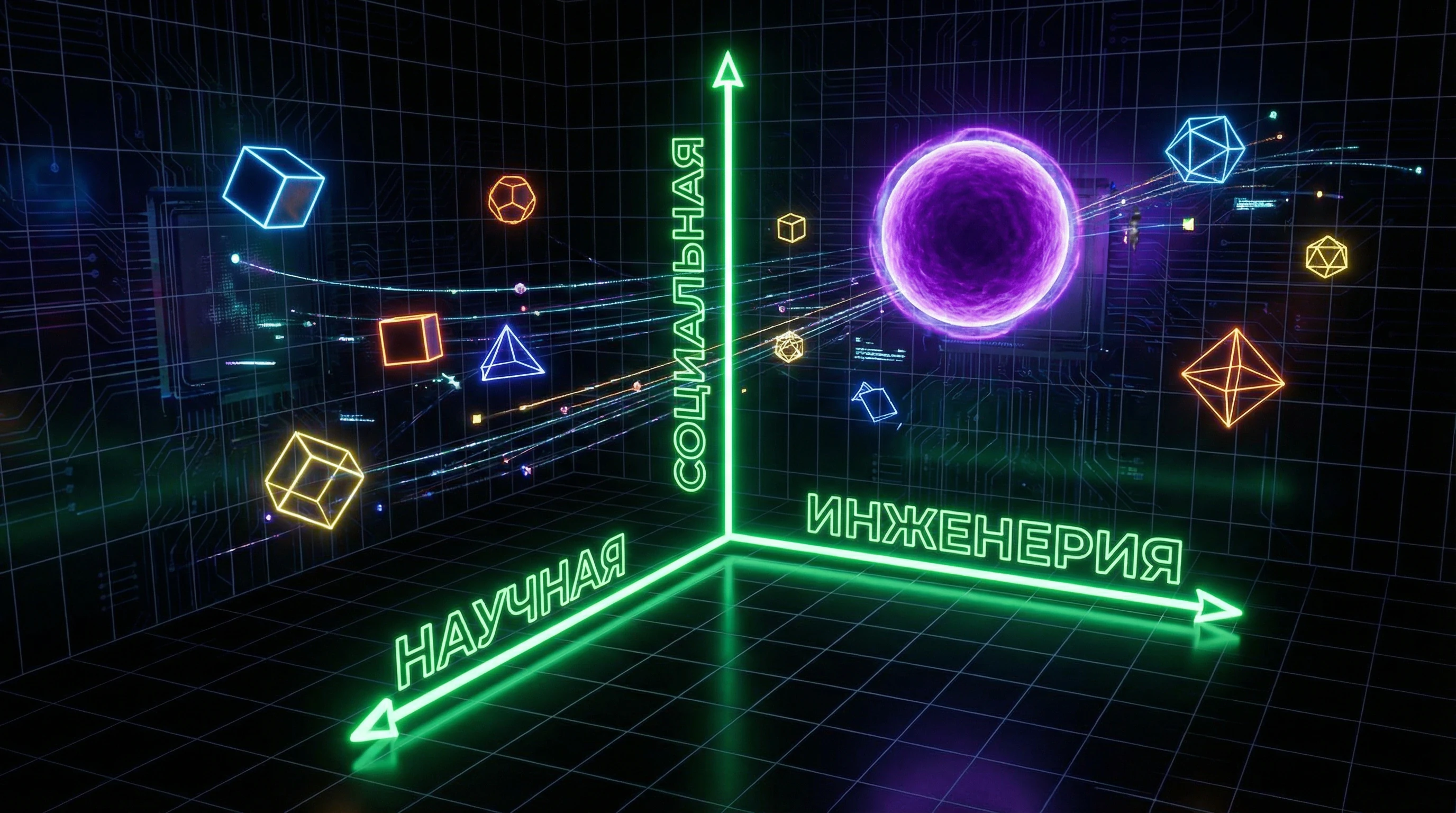

🔎 Tres dimensiones del avance tecnológico

- Avance científico

- Expansión fundamental de la comprensión teórica — nuevo algoritmo, arquitectura o principio de aprendizaje que abre capacidades antes inalcanzables. Criterios: publicación en revistas revisadas por pares de primer nivel, reproducibilidad por grupos independientes, expansión de fronteras teóricas.

- Avance ingenieril

- Salto cualitativo en la implementación práctica — escalabilidad, eficiencia, fiabilidad, accesibilidad de enfoques existentes. Criterios: mejora de métricas clave en órdenes de magnitud, reducción de costes o consumo energético en múltiplos, nuevos niveles de escalabilidad.

- Avance social

- Transición de la tecnología desde laboratorios al uso masivo, cambio en el comportamiento de millones de personas, creación de nuevos mercados (S001). Criterios: crecimiento exponencial de la base de usuarios, cambio de prácticas establecidas, aparición de nuevas profesiones, reacción regulatoria.

⚠️ Asimetría de ChatGPT: dónde es avance y dónde no

ChatGPT demuestra una asimetría interesante. Desde el punto de vista científico, la arquitectura de transformers fue presentada en 2017, GPT-3 apareció en 2020. ChatGPT no contiene principios algorítmicos fundamentalmente nuevos.

El avance ingenieril es evidente: OpenAI creó un sistema que procesa millones de consultas simultáneas con latencia y coste aceptables. El avance social es indiscutible — por primera vez la IA generativa se convirtió en herramienta masiva, accesible para cualquier persona con navegador (S001).

La popularidad no es prueba de innovación científica. El iPhone fue un avance social e ingenieril, pero no contenía principios científicos fundamentalmente nuevos. Análogamente, ChatGPT puede ser un avance ingenieril y social sin revolución científica.

🎯 Por qué esta confusión tiene consecuencias prácticas

Periodistas y marketers mezclan sistemáticamente las tres dimensiones, usando el éxito social (cantidad de usuarios, atención mediática) como prueba de avance científico. Este es un error categorial clásico.

- Inversores que toman decisiones basadas en el hype mediático sobrevaloran el potencial a corto plazo y subestiman los desafíos a largo plazo.

- Investigadores cuyas subvenciones dependen de la retórica "revolucionaria" experimentan presión para exagerar la novedad de sus trabajos.

- Instituciones educativas que se apresuran a implementar IA arriesgan invertir en herramientas que no resuelven problemas pedagógicos reales (S006).

📊 Aplicación de criterios a ChatGPT

| Dimensión | Estado | Justificación |

|---|---|---|

| Científico | Ausente | Principios básicos conocidos desde hace años; problemas fundamentales (alucinaciones, ausencia de comprensión verdadera, imposibilidad de aprendizaje en tiempo real) permanecen sin resolver |

| Ingenieril | Parcial | La escalabilidad impresiona, pero las limitaciones arquitectónicas no han sido superadas |

| Social | Incondicional | La tecnología cambió el discurso público sobre IA y creó una nueva clase de aplicaciones (S001) |

Esta asimetría explica por qué los expertos dan evaluaciones opuestas: se enfocan en dimensiones diferentes. Para el análisis de las secciones restantes del artículo hay que recordar: ChatGPT es un éxito social e ingenieril, no una revolución científica. Esto cambia todas las conclusiones posteriores sobre su impacto y potencial.

La versión de acero del argumento: cinco razones contundentes a favor del carácter revolucionario de ChatGPT

La honestidad intelectual exige comenzar con la versión más sólida de la posición contraria. Antes de criticar el revuelo en torno a ChatGPT, es necesario formular los argumentos más convincentes a favor de que se trata realmente de una tecnología revolucionaria. El principio del «hombre de acero» (opuesto al «hombre de paja») implica construir la versión más sólida de la posición del oponente, no una caricatura débil de ella. Más información en la sección IA y tecnologías.

🔬 Primer argumento: velocidad de adopción masiva sin precedentes como indicador de valor real

ChatGPT alcanzó 100 millones de usuarios activos en 2 meses, más rápido que cualquier aplicación de consumo en la historia. Para comparar: TikTok necesitó 9 meses, Instagram 2,5 años, Facebook 4,5 años.

Este crecimiento exponencial no puede explicarse solo por el marketing o la curiosidad. Millones de personas continúan usando ChatGPT diariamente para resolver tareas reales: escribir código, redactar documentos, aprender, crear. Si la tecnología no proporcionara valor real, las tasas de retención de usuarios serían bajas. En cambio, observamos un crecimiento sostenido e integración en flujos de trabajo (S001).

La velocidad de adopción de ChatGPT en el sector corporativo no tiene precedentes. Las mayores empresas del mundo, desde Microsoft hasta Salesforce, están integrando tecnologías GPT en sus productos. No son inversiones especulativas, sino decisiones estratégicas basadas en aumentos medibles de productividad.

📊 Segundo argumento: salto cualitativo en la accesibilidad de la IA para no programadores

Antes de ChatGPT, usar modelos avanzados de aprendizaje automático requería experiencia técnica: conocimiento de Python, comprensión de APIs, habilidades de ingeniería de prompts. ChatGPT democratizó el acceso a la IA, haciéndola accesible mediante lenguaje natural.

Esto no es una mejora incremental, es un salto cualitativo análogo a la transición de la línea de comandos a la interfaz gráfica en los años 80. Millones de personas que nunca escribieron código ahora pueden usar las capacidades de grandes modelos de lenguaje para automatizar tareas, analizar información, generar contenido (S001).

- Aprendizaje asistido por IA

- Los estudiantes usan ChatGPT no solo para copiar, sino también para estudiar en profundidad conceptos complejos, obtener explicaciones personalizadas, practicar idiomas (S006). La tecnología ha creado una nueva categoría de prácticas educativas que potencialmente puede transformar el enfoque del aprendizaje.

🧬 Tercer argumento: capacidades emergentes como signo de transición cualitativa

Los grandes modelos de lenguaje demuestran capacidades emergentes: habilidades que no fueron explícitamente programadas y surgen solo al alcanzar cierta escala. GPT-3 y GPT-4 muestran capacidad para razonamientos de múltiples pasos, resolver problemas matemáticos, escribir código funcional, comprender contexto a un nivel inalcanzable para generaciones anteriores de modelos.

Esto no es simplemente una mejora cuantitativa de métricas, es una transición cualitativa donde el sistema comienza a demostrar comportamiento que recuerda la inteligencia humana en dominios específicos. Los críticos objetan que sigue siendo predicción estadística del siguiente token, no comprensión verdadera. Pero funcionalmente la diferencia se vuelve irrelevante si el sistema resuelve tareas que antes requerían inteligencia humana.

La cuestión filosófica sobre la «comprensión real» puede ser menos importante que el hecho práctico: ChatGPT supera muchas pruebas que tradicionalmente usábamos para evaluar la inteligencia.

💎 Cuarto argumento: catalizador para todo el ecosistema de innovación en IA

Incluso si ChatGPT en sí no es un avance científico fundamental, ha catalizado una ola de innovación en áreas relacionadas. Han surgido cientos de startups construyendo aplicaciones especializadas basadas en la API de GPT. Los competidores (Google Bard, Anthropic Claude, Meta LLaMA) aceleraron el desarrollo de sus propios modelos.

La comunidad investigadora intensificó el trabajo sobre problemas fundamentales: alucinaciones, interpretabilidad, alineación con valores humanos. ChatGPT creó un «momento Sputnik» para la IA, un evento que movilizó recursos y atención de toda la industria (S001).

- Los gobiernos desarrollan marcos regulatorios para la IA

- Las instituciones educativas revisan sus programas de estudio

- La comunidad jurídica debate cuestiones de derechos de autor y responsabilidad

- Los filósofos vuelven a cuestiones fundamentales sobre la naturaleza de la inteligencia y la conciencia

Independientemente de si ChatGPT en sí es un avance, sin duda se ha convertido en el detonante de cambios sistémicos en la sociedad.

⚙️ Quinto argumento: transformación económica y nuevos modelos de negocio

ChatGPT creó una nueva categoría económica: «IA como servicio» para el mercado masivo. OpenAI demuestra que es posible monetizar grandes modelos de lenguaje mediante suscripciones (20€/mes por ChatGPT Plus) y acceso API, creando un modelo de negocio sostenible.

Esto resuelve un problema crítico que atormentó a la industria de la IA durante décadas: cómo convertir avances de investigación en productos rentables. La valoración de OpenAI en más de 80.000 millones de euros no es pura especulación, se basa en ingresos reales e impacto medible en la productividad del sector corporativo.

| Modelo de negocio | Ventaja | Escalabilidad |

|---|---|---|

| Suscripción (20€/mes) | Ingresos predecibles, conexión directa con el usuario | Limitada por capacidad de pago |

| Acceso API | Integración en sistemas corporativos, efectos de red | Exponencial con crecimiento del ecosistema |

| Foundation model | Base universal para miles de aplicaciones | Dominio de pocos grandes actores |

ChatGPT demostró la viabilidad del modelo «foundation model», un modelo base universal que puede adaptarse para miles de aplicaciones especializadas. Esto crea efectos de red y economías de escala que pueden llevar al dominio de pocos grandes actores en la infraestructura de IA, de manera análoga a cómo AWS domina la computación en la nube. Las consecuencias económicas de este cambio pueden ser más significativas que los detalles técnicos de los modelos mismos.

Base empírica: qué dicen los datos sobre las capacidades reales y limitaciones de ChatGPT

Los estudios empíricos pintan un panorama más complejo que las narrativas de marketing. Más detalles en la sección Tecno-esoterismo.

📊 Benchmarks y métricas: qué miden realmente los tests estándar de IA

OpenAI publica resultados impresionantes: GPT-4 alcanza el percentil 90 en el examen de abogacía (Bar Exam) y el percentil 89 en SAT Math. Pero el análisis crítico revela tres problemas sustanciales (S001).

El primero es la «contaminación de datos»: los ejemplos de prueba podrían haber estado presentes en el corpus de entrenamiento, sobreestimando los resultados. El segundo: los benchmarks miden habilidades limitadas de reconocimiento de patrones, no comprensión profunda. El modelo puede responder correctamente una pregunta de física simplemente reconociendo patrones estadísticos en la formulación, sin comprensión conceptual de las leyes.

El tercer problema es crítico: los tests estándar no reflejan condiciones reales — faltan restricciones temporales, consecuencias por errores, presión contextual. Esto crea un sesgo sistemático hacia la sobreestimación.

🧪 Estudios de rendimiento en tareas reales

Un estudio del MIT y Stanford (2023) mostró: el uso de GPT-4 por programadores aumenta la velocidad en un 55%, la calidad del código mejora un 40% según evaluaciones de expertos. Pero los resultados varían radicalmente.

| Tipo de tarea | Mejora de productividad | Fiabilidad del resultado |

|---|---|---|

| Operaciones rutinarias (CRUD, algoritmos básicos) | +80% | Alta |

| Complejidad media (integración, optimización) | +40% | Media |

| Decisiones arquitectónicas | +10% | Baja |

En escritura académica hay una paradoja: los estudiantes escriben más rápido con menos errores gramaticales, pero demuestran comprensión más superficial y menor originalidad argumentativa (S006). La tecnología es simultáneamente un avance en eficiencia y una degradación en profundidad de aprendizaje.

⚠️ Errores sistemáticos y alucinaciones

Las alucinaciones — generación de información plausible pero factualmente incorrecta — son un problema crítico. GPT-4 alucina en el 15–20% de respuestas a preguntas fácticas (S001).

- Fabricación de fuentes

- El modelo «cita» artículos científicos que no existen. Peligroso en medicina y derecho, donde el error tiene consecuencias.

- Distorsión de hechos

- Mezcla de detalles de diferentes eventos, creación de narrativas híbridas que suenan convincentes.

- Inconsistencias lógicas

- Afirmaciones contradictorias dentro de una misma respuesta, que el usuario puede no detectar en una lectura rápida.

- Errores temporales

- Información obsoleta presentada como actual. Especialmente peligroso en campos que cambian rápidamente.

Críticamente: las alucinaciones no son aleatorias — surgen sistemáticamente con mayor frecuencia en áreas donde los datos de entrenamiento fueron de menor calidad o contradictorios. En medicina y derecho la frecuencia alcanza el 30%. El modelo produce información incorrecta con alta confianza, sin indicadores de incertidumbre.

🧾 Análisis comparativo: ChatGPT frente a alternativas

La evaluación objetiva requiere comparación no con un ideal abstracto, sino con alternativas reales. En programación, GitHub Copilot supera al autocompletado tradicional de IDEs, pero es inferior a programadores experimentados en decisiones arquitectónicas. En diagnóstico médico, GPT-4 muestra resultados al nivel de estudiantes de medicina, muy por debajo de médicos en ejercicio en casos raros.

Paradoja de competencia: ChatGPT es más efectivo como amplificador para especialistas de nivel medio. Para principiantes es peligroso — no reconocen las alucinaciones. Para expertos suele ser redundante — resuelven tareas más rápido por sí mismos que formulando prompts y verificando resultados (S001).

🔎 Estudios a largo plazo: sostenibilidad de efectos y adaptación

La mayoría de estudios se centran en efectos a corto plazo. Los datos a largo plazo revelan un panorama más complejo: el entusiasmo inicial a menudo se convierte en decepción cuando los usuarios enfrentan las limitaciones.

Un estudio de adaptación de estudiantes a asistentes de IA mostró que tras 6 meses se forman tres grupos (S006):

- Dependientes (30%) — dejan de desarrollar habilidades propias, confían en la IA incluso en tareas simples.

- Integradores (50%) — usan la IA estratégicamente para acelerar rutinas, manteniendo foco en tareas complejas.

- Abandonadores (20%) — cesan el uso por decepción en la calidad o consideraciones éticas.

El impacto a largo plazo de ChatGPT será más diferenciado de lo que predicen optimistas y pesimistas. La tecnología no es universal — su efecto depende del contexto, competencia del usuario y tipo de tarea. Esto requiere verificación sistemática de la realidad en lugar de pronósticos abstractos.

Mecanismos de influencia: cómo ChatGPT transforma los procesos cognitivos y las prácticas laborales

Más allá de las métricas directas de productividad se encuentra una cuestión más fundamental: ¿cómo cambia el uso de ChatGPT nuestras formas de pensar, resolver problemas y organizar el trabajo? Comprender estos mecanismos es crucial para evaluar las consecuencias a largo plazo de esta tecnología. Más información en la sección Falacias lógicas.

🧬 Descarga cognitiva versus atrofia de habilidades: dónde está el límite

Utilizar ChatGPT para tareas rutinarias libera recursos cognitivos para problemas más complejos: es el efecto clásico de descarga cognitiva, análogo al uso de una calculadora para aritmética. Sin embargo, existe el riesgo de atrofiar habilidades básicas que sirven como fundamento para la expertise de nivel superior.

Un programador que nunca ha escrito bucles manualmente puede no comprender las sutilezas de la complejidad algorítmica. Un escritor que depende de la IA para estructurar argumentos puede no desarrollar habilidades de pensamiento crítico.

- Para expertos que ya poseen comprensión profunda, la descarga cognitiva de tareas rutinarias aumenta la productividad sin pérdida de calidad.

- Para principiantes, la descarga prematura impide la formación de modelos mentales necesarios para la expertise.

- Punto crítico: una habilidad debe automatizarse mediante la práctica antes de poder delegarse a una herramienta.

Esto crea un dilema pedagógico (ver sesgos cognitivos): un sistema que acelera el trabajo de profesionales experimentados puede ralentizar el desarrollo de principiantes. (S001) muestra que organizaciones que implementaron ChatGPT sin replantear la formación enfrentaron una paradoja: la productividad aumentó, pero la calidad de las decisiones de nuevos empleados disminuyó.

🔄 Desplazamiento de responsabilidad e ilusión de competencia

Cuando la IA genera una respuesta, el usuario a menudo pasa del modo creación al modo verificación. Este es un cambio fundamental en la posición cognitiva.

La verificación requiere menos recursos mentales que la generación y crea una ilusión de comprensión. La persona ve un texto plausible, lo acepta y asume que entiende el problema. En realidad, solo ha validado una coincidencia superficial con sus expectativas.

| Modo | Carga cognitiva | Riesgo de error | Efecto a largo plazo |

|---|---|---|---|

| Creación (sin IA) | Alta | Errores visibles | Desarrollo de expertise |

| Verificación (con IA) | Baja | Errores ocultos | Ilusión de competencia |

(S003) señala que estudiantes que usan ChatGPT para escribir ensayos a menudo no pueden explicar sus propios argumentos. Han pasado por el texto, pero no por el pensamiento.

⚙️ Transformación de prácticas laborales: del dominio a la gestión del flujo

En profesiones donde ChatGPT se convierte en herramienta estándar, ocurre un cambio en la definición de competencia. En lugar de saber escribir código o texto, se valora la capacidad de formular consultas, interpretar resultados e integrarlos en un contexto más amplio.

Esto no es malo en sí mismo: es una redefinición de la habilidad. Pero crea una nueva prueba de realidad: ¿cómo asegurarse de que una persona realmente comprende el área temática si su trabajo principal es gestionar la IA?

El peligro no es que la IA reemplace a los expertos, sino que la expertise se desplace del dominio temático a la gestión de la herramienta, y nadie note cuándo ocurre la sustitución.

(S007) documenta que en prácticas de RRHH ya ha ocurrido esta transformación: el especialista en selección de personal ahora dedica tiempo a optimizar prompts en lugar de desarrollar intuición sobre candidatos. La productividad aumentó, pero la profundidad del juicio disminuyó.

🎯 Dinámica social: del dominio individual a la dependencia colectiva

Cuando ChatGPT se convierte en estándar, no usarlo comienza a parecer irracional. Esto crea un efecto social similar a los efectos de red: el valor de la herramienta crece con el número de usuarios, pero simultáneamente crece la presión sobre quienes desean permanecer independientes.

Organizaciones donde todos usan ChatGPT comienzan a estructurar el trabajo en torno a esta herramienta. Quienes se niegan se convierten en outsiders. No es una conspiración: es la dinámica natural de adaptación a un nuevo estándar.

- Efecto de red

- El valor de la herramienta crece con el número de usuarios, pero crea presión sobre la minoría que no la utiliza.

- Dependencia del camino

- Una organización que ha invertido en procesos orientados a ChatGPT no puede volver fácilmente a alternativas, incluso si resultan mejores.

- Pérdida de alternativas

- Cuando una herramienta domina, desaparecen los incentivos para desarrollar enfoques competidores, y con ellos desaparece el seguro contra su fallo.

(S004) muestra que estudiantes que comenzaron a usar ChatGPT rara vez vuelven a métodos tradicionales, incluso cuando sería más beneficioso. No es pereza: es una elección racional bajo presión social.

Riesgo a largo plazo: si todo el ecosistema educativo y laboral está optimizado para ChatGPT, cualquier fallo en su disponibilidad o calidad creará una crisis sistémica, no una molestia local.