La inteligencia artificial en medicina se ha convertido en objeto de hype masivo: desde el diagnóstico de cáncer hasta la terapia personalizada. Pero tras los titulares rimbombantes se esconde una realidad compleja: la mayoría de los sistemas funcionan en condiciones limitadas, los datos son contradictorios y las barreras regulatorias son elevadas. Este artículo analiza el mecanismo del hype del AI médico, muestra el nivel real de evidencia de las tecnologías y ofrece un protocolo para verificar las afirmaciones sobre la «revolución en la sanidad».

🖤 Cada semana aparece una nueva startup prometiendo «revolución en el diagnóstico» o «medicina personalizada del futuro». Los inversores inyectan miles de millones, los medios replican titulares sobre «avances revolucionarios» y los pacientes esperan el milagro. Pero entre la narrativa de marketing y la realidad clínica existe un abismo que pocos intentan medir. Este artículo no es un manifiesto contra la tecnología, sino una guía para navegar en un mundo donde cada promesa requiere verificación y cada cifra necesita contexto. Analizaremos el mecanismo del hype, mostraremos dónde termina la ciencia y comienza la especulación, y te daremos un protocolo que funciona independientemente de lo convincente que suene la presentación.

Qué prometen exactamente: anatomía de las afirmaciones sobre IA médica y límites de aplicabilidad de las tecnologías

El primer problema comienza con las definiciones. El término «inteligencia artificial en medicina» se utiliza de forma tan amplia que ha perdido concreción: abarca desde un simple algoritmo de clasificación de imágenes hasta un sistema complejo de apoyo a decisiones clínicas, pasando por una hipotética AGI capaz de sustituir al médico. Más información en la sección Cómo funciona la inteligencia artificial.

Cuando una startup anuncia una «revolución», es fundamental entender de qué clase de sistemas se trata exactamente y en qué condiciones operan.

🔎 Tres categorías de sistemas de IA médica

- Clasificadores específicos

- Resuelven una tarea en condiciones estrictamente controladas: detectan retinopatía diabética en fotografías de fondo de ojo o identifican neumonía en radiografías. Entrenados con grandes conjuntos de datos, pero su aplicabilidad está limitada por la calidad de los datos de entrada y la población de entrenamiento (S001).

- Sistemas de apoyo a la decisión clínica (CDSS)

- Se integran en el flujo de trabajo clínico y ofrecen recomendaciones basadas en historias clínicas electrónicas, datos de laboratorio y literatura científica. Dependen de la calidad de la estructuración de datos, la actualización de protocolos y la capacidad del médico para evaluar críticamente la recomendación (S004).

- Plataformas integradas

- Prometen combinar diagnóstico, pronóstico y personalización terapéutica. Aquí se concentra el máximo de expectativas exageradas y el mínimo de evidencia científica: la mayoría se encuentran en fase piloto (S002).

🧱 Límites de aplicabilidad: laboratorio vs clínica

El error fundamental es ignorar la brecha entre la validación en laboratorio y la práctica clínica. Un sistema puede mostrar un 95% de precisión en un conjunto de datos de prueba, pero fallar en un hospital real debido a diferencias en equipamiento, protocolos de imagen o composición demográfica de los pacientes.

Este fenómeno, conocido como dataset shift, se subestima sistemáticamente en los materiales de marketing.

La mayoría de estudios se realizan retrospectivamente: el algoritmo analiza datos ya recopilados donde los diagnósticos son conocidos. En estudios prospectivos, donde el sistema opera en tiempo real, los resultados suelen ser más modestos. La transición de validación retrospectiva a implementación prospectiva reduce los indicadores de eficacia en promedio entre un 15–30% (S001).

⚠️ Barreras regulatorias y sus limitaciones

| Criterio de evaluación | Qué verifica el regulador | Qué NO garantiza |

|---|---|---|

| Seguridad | Ausencia de daño en el uso | Mejora de resultados para los pacientes |

| Validez analítica | Procesamiento correcto de datos | Utilidad clínica en condiciones reales |

| Ámbito de aplicación | Escenario específico (p. ej., cribado de retinopatía) | Extrapolación a aplicaciones más amplias |

Obtener aprobación regulatoria (FDA en EE.UU., marcado CE en Europa) es un criterio importante pero insuficiente. Los reguladores evalúan seguridad y validez analítica, pero no siempre exigen pruebas de utilidad clínica: mejora de resultados para los pacientes (S004).

La aprobación suele otorgarse para una aplicación específica, pero el marketing la extrapola a escenarios más amplios. Un algoritmo aprobado para el cribado de retinopatía diabética en pacientes con diabetes tipo 2 puede promocionarse como «sistema universal de diagnóstico de enfermedades oculares», lo que excede el ámbito de aplicación validado.

Versión de acero del argumento: cinco razones más sólidas a favor del potencial revolucionario de la IA médica

Antes de analizar las debilidades, es necesario presentar honestamente los argumentos más sólidos de los defensores de la IA médica. Esto no es un hombre de paja, sino una versión de acero de la posición: si no podemos refutar los mejores argumentos, la crítica carece de sentido. Más información en la sección Errores y sesgos de la IA.

🔬 Argumento 1: La superioridad en tareas específicas de reconocimiento de patrones ya está demostrada

En tareas estrictamente definidas de diagnóstico visual, los sistemas de IA realmente alcanzan o superan el nivel de los expertos. Los algoritmos de reconocimiento de retinopatía diabética, melanoma en imágenes dermatoscópicas y algunos tipos de cáncer de pulmón en TC muestran sensibilidad y especificidad comparables a las de especialistas experimentados (S001).

En condiciones de escasez de especialistas (especialmente en países en desarrollo y zonas rurales), incluso un sistema con una precisión del 85-90% puede ser clínicamente útil si la alternativa es la ausencia total de diagnóstico. El argumento de la "imperfección" pierde fuerza cuando la comparación no es con un médico ideal, sino con la disponibilidad real de atención médica.

- Los ensayos controlados aleatorizados confirman equivalencia o superioridad en tareas específicas

- Una precisión del 85-90% es clínicamente útil cuando no hay alternativa

- La escalabilidad en regiones con déficit de especialistas resuelve el problema de accesibilidad, no de calidad

🧬 Argumento 2: La capacidad de procesar datos multimodales abre nuevas posibilidades diagnósticas

El médico humano está limitado en su capacidad para analizar simultáneamente decenas de fuentes de datos: perfiles genómicos, proteómica, historial clínico, imágenes, parámetros de laboratorio y literatura. Los sistemas de IA pueden integrar estos datos heterogéneos e identificar patrones inaccesibles al análisis tradicional (S002), (S006).

Los sistemas que analizan la combinación de marcadores genéticos y datos de imagen potencialmente pueden predecir la respuesta a la terapia con mayor precisión que cada fuente de datos por separado. Esto no es un reemplazo del médico, sino una ampliación de sus capacidades cognitivas: el argumento de la "amplificación de la inteligencia", no de la sustitución.

⚙️ Argumento 3: La escalabilidad y estandarización reducen la variabilidad en la calidad de la atención médica

La calidad de la atención médica varía considerablemente según la experiencia del médico, la fatiga, los sesgos cognitivos y el acceso a información actualizada. Los sistemas de IA, una vez validados, proporcionan una calidad estable independientemente de la hora del día, la carga de trabajo o la geografía (S004).

Este argumento es especialmente sólido en el contexto de enfermedades raras: un médico de atención primaria puede encontrar una patología determinada una vez en su carrera, mientras que un algoritmo entrenado con miles de casos conserva la experiencia. La estandarización mediante IA es un mecanismo de difusión de las mejores prácticas.

Una enfermedad rara, encontrada por un médico una vez en su carrera, es rutina para un algoritmo entrenado con miles de casos. La estandarización mediante IA no degrada la profesión, sino que difunde la experiencia.

📊 Argumento 4: La eficiencia económica de los programas de cribado puede aumentar radicalmente

Los programas masivos de cribado (cáncer de mama, cáncer colorrectal, retinopatía diabética) requieren enormes recursos para el análisis de imágenes, la mayoría de las cuales no contienen patología. Los sistemas de IA pueden realizar un triaje inicial, derivando a evaluación experta solo los casos sospechosos, lo que reduce la carga sobre los especialistas y el coste de los programas (S005).

Una revisión sistemática de programas de cribado muestra que la implementación del triaje con IA puede reducir la cantidad de casos que requieren evaluación experta en un 50-70% manteniendo una sensibilidad superior al 95%. Si estas cifras se confirman en estudios prospectivos, el argumento económico se vuelve irrefutable.

🔁 Argumento 5: El aprendizaje continuo permite que los sistemas se adapten a nuevos datos más rápido que la actualización de los protocolos clínicos

El conocimiento médico se actualiza más rápido de lo que tardan en cambiar los programas educativos y las guías clínicas. Los sistemas de IA que utilizan mecanismos de aprendizaje continuo teóricamente pueden integrar nuevos datos de la literatura y la práctica clínica en tiempo real, garantizando la actualidad de las recomendaciones (S004).

Este argumento es especialmente relevante en áreas de rápido desarrollo, como la oncología y las enfermedades infecciosas, donde nuevos fármacos y protocolos aparecen mensualmente. Sin embargo, aquí también reside el principal peligro: el aprendizaje continuo sin control estricto puede llevar a la acumulación de errores y al desvío del modelo.

- Aprendizaje continuo

- Integración de nuevos datos en tiempo real. Ventaja: actualidad de las recomendaciones. Riesgo: desvío del modelo y acumulación de errores sin control.

- Protocolos clínicos

- Se actualizan cada varios años. Ventaja: conservadurismo y verificación. Desventaja: retraso respecto a nuevos datos.

Base de evidencia bajo el microscopio: qué dicen las revisiones sistemáticas y metaanálisis sobre la efectividad real

Ahora, tras presentar los argumentos más sólidos, pasemos al análisis crítico de la base de evidencia. Más detalles en la sección Ética y seguridad de la IA.

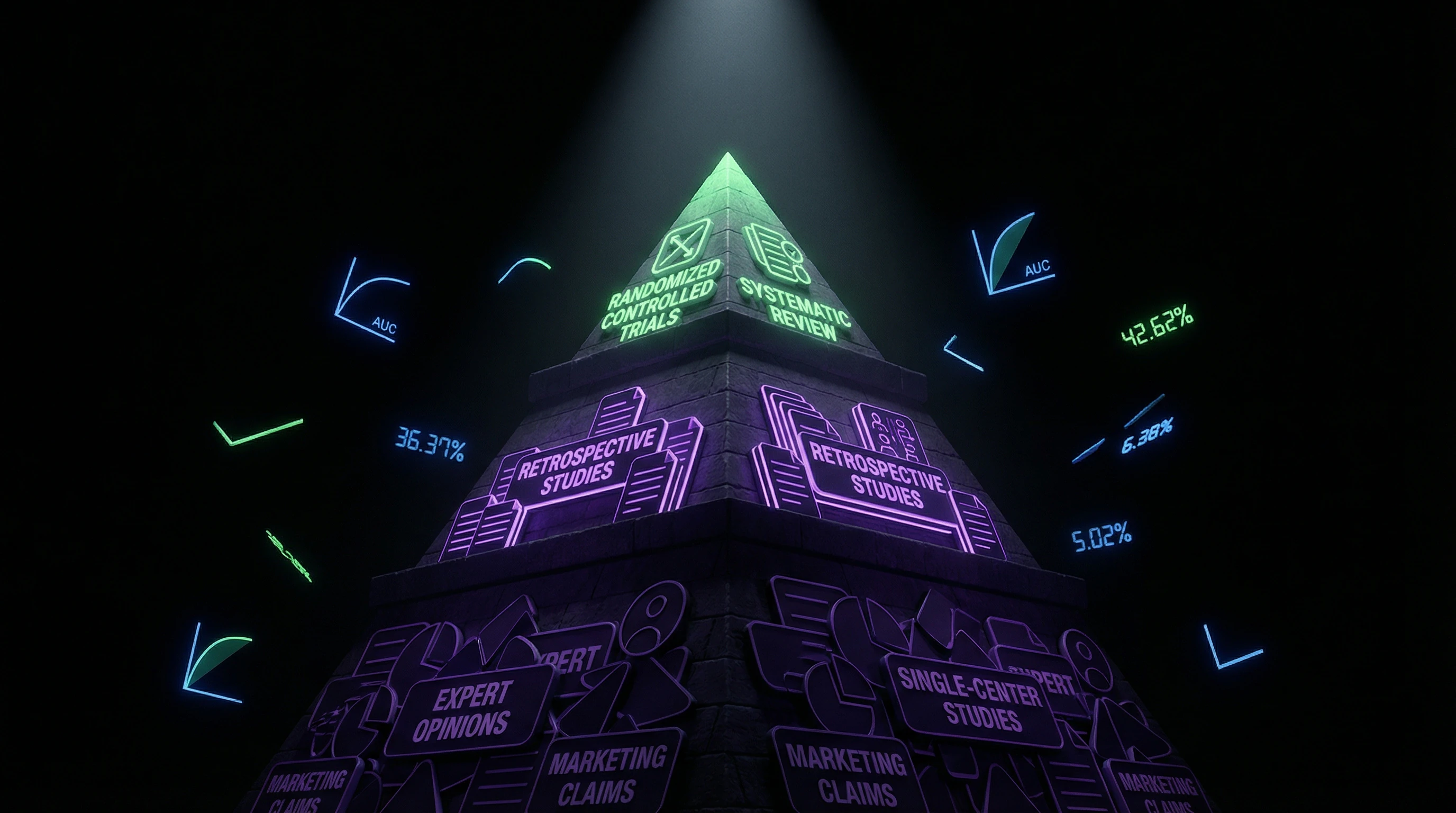

📊 Calidad de los estudios: predominio de trabajos retrospectivos unicéntricos sobre ensayos clínicos aleatorizados prospectivos

La revisión sistemática de estudios sobre sistemas de IA médica revela un problema crítico: la inmensa mayoría de publicaciones son estudios retrospectivos con datos de un único centro médico. Estos trabajos tienen alto riesgo de sobreajuste (overfitting) y no permiten evaluar la generalización de resultados (S001).

Los ensayos clínicos aleatorizados prospectivos, donde el sistema de IA se implementa en la práctica real y se mide el impacto en resultados clínicos (mortalidad, calidad de vida, frecuencia de complicaciones), son críticamente escasos. La revisión de programas de cribado muestra que menos del 15% de los estudios de IA médica cumplen criterios de alta calidad metodológica (S001). Esto no significa que las tecnologías no funcionen, pero sí que el nivel de evidencia es inferior al de la mayoría de fármacos.

Alta precisión en un conjunto de datos de prueba de un solo centro no es prueba de efectividad. Es prueba de que el algoritmo memorizó bien esos datos específicos.

🔎 Problema del sesgo de publicación: los resultados negativos quedan en los cajones

Como en otras áreas de la medicina, los estudios de IA médica sufren sesgo de publicación: los trabajos con resultados positivos se publican más que aquellos con resultados negativos o nulos. Esto distorsiona la percepción sobre la efectividad de las tecnologías (S004).

Los desarrolladores comerciales suelen publicar solo los resultados más impresionantes, silenciando intentos fallidos de implementación o limitaciones de los sistemas. La ausencia de registro obligatorio de estudios de IA médica (a diferencia de ensayos clínicos de fármacos) agrava el problema.

- Estudio con resultado positivo: se publica en revista, se cita en comunicados de prensa.

- Estudio con resultado nulo: queda archivado, no influye en la percepción de la tecnología.

- Resultado: imagen sesgada de la efectividad en literatura científica y medios.

🧪 Heterogeneidad de métricas: por qué alta precisión no siempre significa utilidad clínica

Los estudios de IA médica utilizan métricas heterogéneas de evaluación: exactitud (accuracy), sensibilidad (sensitivity), especificidad (specificity), área bajo la curva ROC (AUC), F1-score. Pero ninguna de estas métricas mide directamente lo que importa al paciente: mejora de resultados (S001).

Un sistema puede tener AUC 0.95 (excelente indicador), pero si su implementación no cambia la táctica de tratamiento ni mejora el pronóstico, la utilidad clínica es nula. La revisión sistemática muestra que la correlación entre métricas analíticas y resultados clínicos es débil e impredecible (S001).

| Métrica | Qué mide | Relación con resultado clínico |

|---|---|---|

| Accuracy (exactitud) | Proporción de predicciones correctas | Débil — depende de la distribución de clases |

| Sensitivity (sensibilidad) | Proporción de enfermos detectados | Media — importante para cribado, pero no garantiza mejora |

| AUC (área bajo la curva) | Capacidad de distinguir clases | Débil — no considera umbrales de decisión ni costes clínicos de errores |

| Mortalidad, calidad de vida | Resultados reales para el paciente | Fuerte — pero raramente se mide en estudios de IA |

🧬 Validación externa: por qué los algoritmos fallan al probarse en conjuntos de datos independientes

El estándar de oro para evaluar IA médica es la validación externa: prueba con datos de otros centros médicos, recopilados independientemente de la muestra de entrenamiento. Las revisiones sistemáticas muestran que en validación externa el rendimiento de los algoritmos cae en promedio 10–25% comparado con validación interna (S001).

Las causas son diversas: diferencias en equipamiento (distintos modelos de resonancia magnética, TAC, aparatos de rayos X), protocolos de imagen, demografía de pacientes, prevalencia de enfermedades. Un algoritmo entrenado con datos de clínica universitaria en EE.UU. puede mostrar baja precisión en hospital comarcal en India, no por defectos técnicos, sino por diferencias fundamentales en poblaciones y condiciones (S002), (S006).

El sobreajuste no es error del desarrollador. Es consecuencia natural de que el algoritmo busca patrones en datos concretos. El problema es que esos patrones a menudo no se transfieren a nuevos datos.

⚙️ Integración en el flujo clínico: por qué un sistema técnicamente funcional puede no ser usado por los médicos

Incluso un sistema validado puede fracasar en la fase de implementación si no se integra en el proceso clínico existente. Los estudios muestran que los médicos ignoran las recomendaciones de sistemas de IA en 30–50% de los casos si el sistema requiere acciones adicionales, ralentiza el trabajo o emite recomendaciones sin explicaciones (S004).

El problema de la "caja negra" es especialmente agudo: si el sistema no puede explicar por qué propone determinado diagnóstico o táctica, los médicos no confían en él. La confianza en la herramienta depende no solo de su precisión, sino de la transparencia del mecanismo de toma de decisiones (S003). Esto no es irracionalidad médica, sino cautela racional en condiciones de responsabilidad legal.

- Flujo clínico (workflow)

- Secuencia de acciones del médico en diagnóstico y tratamiento. El sistema de IA debe integrarse en este proceso, no exigir su rediseño.

- Explicabilidad (explainability)

- Capacidad del sistema de justificar su decisión. Sin ella el médico no puede verificar la lógica ni asumir responsabilidad por el resultado.

- Responsabilidad legal

- Si el sistema se equivoca, el médico responde ante el paciente y los tribunales. Por eso el médico debe entender y controlar cada decisión.

Mecanismo o correlación: por qué la IA encuentra patrones pero no comprende relaciones causales

La limitación fundamental de los sistemas de IA médica actuales es que están optimizados para encontrar correlaciones, no para comprender mecanismos causales. Esto crea riesgo de falsos descubrimientos y fragilidad en las predicciones. Más información en la sección Fundamentos de epistemología.

🔁 El problema de los factores de confusión: cuando el algoritmo aprende lo que no pensamos

Ejemplo clásico: un algoritmo entrenado para distinguir neumonía en radiografías puede en realidad aprender a reconocer equipos de rayos X portátiles (que se usan más frecuentemente con pacientes graves) en lugar de la neumonía misma.

Este es un factor de confusión: una variable oculta que correlaciona con la característica objetivo. El problema se agrava porque las redes neuronales profundas encuentran patrones invisibles para el humano, pero esto no garantiza que los patrones sean clínicamente significativos.

Un algoritmo puede alcanzar alta precisión utilizando artefactos de datos (marcas en imágenes, características de compresión de archivos, particularidades del equipo) en lugar de signos biológicos de la enfermedad. Esto no es un error del modelo, es un error en comprender qué ha aprendido realmente el modelo.

🧬 Ausencia de modelos causales: por qué la correlación no predice el efecto de una intervención

Las decisiones médicas requieren pensamiento causal: «Si prescribo este tratamiento, ¿qué ocurrirá?» Pero la mayoría de sistemas de IA están entrenados con datos observacionales que no permiten inferencias causales (S004).

El sistema puede predecir que un paciente tiene alta probabilidad de morir, pero no puede decir si una intervención específica cambiará ese desenlace. Esta distinción entre predicción y acción es clave para la clínica.

- Predicción (correlación)

- «Este paciente tiene alto riesgo de muerte» — basado en patrones en los datos, pero no explica la causa.

- Conocimiento causal (mecanismo)

- «Si se prescribe el fármaco X, el riesgo se reducirá un Y%» — requiere comprender el mecanismo biológico y verificación mediante ensayos aleatorizados (S004).

- Por qué es crítico

- El médico debe elegir entre varias intervenciones. La predicción sin mecanismo le deja sin herramienta para decidir.

El análisis epistemológico de la medicina clínica subraya que el conocimiento del mecanismo de la enfermedad es crítico para elegir la terapia. Los sistemas de IA que funcionan como «cajas negras» no proporcionan este conocimiento: ofrecen predicciones sin explicaciones, lo que limita su aplicabilidad en escenarios clínicos complejos (S003).

📊 Deriva de datos: por qué los modelos envejecen más rápido de lo que pensamos

La práctica médica cambia constantemente: aparecen nuevos fármacos, cambian los protocolos, evolucionan los patógenos. Un modelo entrenado con datos de 2020 puede ser impreciso en 2026, no por problemas técnicos, sino porque la realidad misma ha cambiado.

| Factor de deriva | Ejemplo | Consecuencia para el modelo |

|---|---|---|

| Evolución del patógeno | Nuevas variantes de COVID-19, resistencia a antibióticos | El modelo entrenado con cepas antiguas pierde precisión |

| Cambio en protocolo de tratamiento | Transición a nuevo estándar terapéutico | La distribución de resultados en los datos se desplaza |

| Cambios demográficos | Envejecimiento poblacional, migración | Las características de los pacientes difieren de la muestra de entrenamiento |

Los modelos de aprendizaje automático requieren reentrenamiento regular para mantener la precisión, pero en medicina esto es más complejo: cada actualización del modelo requiere revalidación y aprobación regulatoria (S001). Esto crea una paradoja: los sistemas deben adaptarse, pero el proceso de adaptación es lento y costoso.

Resultado: un sistema de IA que era preciso en su lanzamiento puede volverse poco fiable en pocos años, no porque el algoritmo falle, sino porque el mundo ha cambiado. Esto requiere monitorización constante y reentrenamiento: costes que a menudo se subestiman al planificar la implementación.

Conflictos e incertidumbres: dónde divergen las fuentes y por qué no hay consenso

El análisis de la literatura revela varias áreas donde los datos son contradictorios y las opiniones expertas divergen. Esto no es señal de debilidad científica, sino indicador de la complejidad del problema. Más detalles en la sección Sesgos cognitivos.

🧩 Debate sobre la sustituibilidad: potenciación de la inteligencia versus automatización

Uno de los conflictos centrales es si los sistemas de IA potenciarán las capacidades de los médicos (augmentation) o los sustituirán (automation). Los optimistas afirman que la IA liberará a los médicos de tareas rutinarias, permitiéndoles concentrarse en casos complejos y la comunicación con pacientes.

Los escépticos señalan que la presión económica impulsará la reducción de personal médico, disminuyendo la calidad asistencial (S007). El análisis sistemático del impacto de la IA en el empleo muestra que en otros sectores la automatización a menudo conduce a la polarización: los especialistas altamente cualificados ganan, mientras que los trabajadores de nivel medio pierden posiciones.

Si esto es aplicable a la medicina es una cuestión abierta, dependiente de decisiones regulatorias y modelos económicos sanitarios.

📊 Incertidumbre en la evaluación de eficiencia económica: ¿quién paga, quién gana?

Las afirmaciones sobre la reducción del coste de la atención médica mediante IA a menudo no consideran los costes totales: desarrollo, validación, implementación, formación del personal, mantenimiento de infraestructura. La eficiencia económica del triaje con IA depende fuertemente del contexto: en países con déficit de médicos el beneficio es mayor, en países con exceso de diagnósticos es menor.

Además, el beneficio se distribuye desigualmente: los fabricantes de software y grandes hospitales obtienen beneficios, mientras que las clínicas ambulatorias y centros rurales pueden quedarse sin acceso (S001).

- El coste total de propiedad (TCO) incluye no solo licencias, sino también integración, validación con datos locales, reciclaje del personal.

- El ROI depende del volumen de pacientes y tipo de institución: los grandes centros recuperan la inversión más rápidamente.

- La equidad de acceso permanece sin resolver: la IA puede profundizar la desigualdad en la atención sanitaria.

🔍 Caja negra versus transparencia: cuando la explicabilidad entra en conflicto con la precisión

Las redes neuronales profundas a menudo muestran mejor precisión, pero explican peor sus decisiones. Médicos y reguladores exigen transparencia: ¿por qué el sistema recomienda precisamente este diagnóstico? Pero añadir interpretabilidad puede reducir la precisión (S003).

Esto crea un dilema: ¿caja negra de alta precisión o sistema menos preciso pero explicable? Diferentes países e instituciones eligen de manera distinta, lo que dificulta la estandarización.

| Parámetro | Caja negra (DL) | Modelo interpretable |

|---|---|---|

| Precisión | A menudo mayor | A menudo menor |

| Explicabilidad | Baja | Alta |

| Aprobación regulatoria | Más difícil | Más fácil |

| Confianza de médicos | Menor | Mayor |

🌍 Generalización y contexto: ¿funciona la IA fuera de la muestra de entrenamiento?

Un sistema entrenado con datos de hospitales estadounidenses puede funcionar mal en Europa o Asia debido a diferencias en población, equipamiento, protocolos. Esto no es un error, sino un problema fundamental del aprendizaje automático (S002).

Algunos investigadores afirman que la validación local resuelve el problema. Otros señalan que esto requiere grandes costes y ralentiza la implementación. No hay consenso: los estándares de validación difieren entre países y reguladores.

Paradoja: cuanto más especializado es el sistema, mayor es su precisión en contexto limitado, pero menor su universalidad y escalabilidad.

⚖️ Responsabilidad y regulación: ¿quién asume el riesgo?

Si un sistema de IA se equivoca, ¿quién es responsable: el desarrollador, el hospital, el médico que lo utilizó? La legislación de diferentes países ofrece respuestas distintas (S004). En EE.UU. el énfasis recae en el fabricante, en la UE en el usuario, en otros países en el Estado.

Esta incertidumbre congela inversiones y ralentiza la implementación. Las startups temen demandas judiciales, los hospitales la responsabilidad, los médicos la pérdida de licencia. Resultado: la IA permanece en proyectos piloto, sin pasar a la práctica rutinaria.

- Modelo de responsabilidad (EE.UU.)

- El fabricante asume la responsabilidad principal por la calidad del software y la validación. El médico por la decisión de usar el sistema e interpretar los resultados.

- Modelo de responsabilidad (UE)

- El usuario (hospital/médico) asume la responsabilidad por la implementación y monitorización. El fabricante por la divulgación de limitaciones.

- Resultado práctico

- Diferentes estándares congelan la implementación global y crean un mercado fragmentado.

🎯 Por qué no hay consenso y por qué esto es normal

La IA médica se encuentra en la intersección de tecnología, economía, ética y política. Cada parte interesada ve el problema de manera diferente: los fabricantes como oportunidad, los médicos como amenaza, los pacientes como esperanza, los reguladores como riesgo.

La ausencia de consenso no significa que la IA no funcione. Significa que su papel en la medicina sigue siendo una cuestión abierta, dependiente de cómo decidamos regularla, financiarla e implementarla. No es un problema técnico, es un problema de elección.

Contraposición

⚖️ Contrapunto Crítico

El artículo adopta una posición cautelosa, pero puede subestimar tanto el ritmo del progreso como los éxitos reales de implementación. Aquí es donde la lógica de la argumentación requiere aclaración.

Subestimación de la velocidad del progreso

Los últimos 2-3 años han mostrado un crecimiento exponencial en las capacidades de los grandes modelos de lenguaje y sistemas multimodales (GPT-4, Med-PaLM 2), que demuestran un nivel cualitativamente nuevo de comprensión del contexto médico. Es posible que estemos en el umbral de cambios verdaderamente transformadores, y el escepticismo del artículo refleja concepciones obsoletas sobre las capacidades de la IA.

Ignorar casos exitosos de implementación

El artículo se enfoca en problemas y limitaciones, pero puede subestimar las implementaciones exitosas reales de IA en la práctica clínica. Los sistemas de análisis de retinopatía diabética (IDx-DR) han recibido aprobación regulatoria y se utilizan en la práctica real, mostrando beneficios medibles. La crítica puede ser excesivamente generalizadora.

Sesgo metodológico de las fuentes

Las fuentes utilizadas no son revisiones especializadas de IA médica: son trabajos fragmentados sobre nanotecnología, epistemología, requisitos de software. La ausencia de revisiones sistemáticas directas sobre la eficacia de la IA en medicina (por ejemplo, de Nature Medicine, Lancet Digital Health) hace que las conclusiones del artículo sean potencialmente sesgadas. Fuentes más recientes y especializadas podrían ofrecer un panorama diferente.

Subestimación de la presión económica

El artículo no considera que los factores económicos (déficit de médicos, aumento del costo de la atención médica, presión sobre la eficiencia) pueden acelerar la implementación de IA incluso con una base de evidencia incompleta. Los reguladores pueden hacer compromisos, creando "vías rápidas" de aprobación para sistemas de IA en condiciones de crisis sanitaria. La realidad puede resultar más pragmática de lo que sugiere el artículo.

Riesgo de obsolescencia de las conclusiones

La IA médica se desarrolla tan rápidamente que las conclusiones pueden quedar obsoletas en 6-12 meses. Los avances en interpretabilidad de algoritmos, aprendizaje federado o nuevas arquitecturas pueden cambiar radicalmente la situación. El artículo corre el riesgo de convertirse en un ejemplo de escepticismo prematuro, como ocurrió con las críticas tempranas al aprendizaje profundo en la década de 2000.

FAQ

Preguntas Frecuentes