�� En 2025, tres conceptos erróneos sobre la inteligencia artificial continúan circulando en el espacio mediático con una persistencia digna de mejor causa. El mito del "muro de escalado", el temor a los vehículos autónomos como más peligrosos que los conductores humanos, y la convicción de una inminente sustitución total de especialistas — cada una de estas afirmaciones encuentra audiencia, a pesar de los datos contradictorios de Google DeepMind, OpenAI y Anthropic. Este artículo analiza los mecanismos de origen de los mitos, muestra los datos fácticos y propone un protocolo de verificación de información sobre IA. �� No nos limitaremos a una simple refutación — en su lugar, analizaremos la anatomía cognitiva de los conceptos erróneos y construiremos un protocolo de defensa para la evaluación crítica de noticias sobre inteligencia artificial.

�� Tres mitos de 2025: qué se afirma exactamente y por qué es importante para comprender la trayectoria de desarrollo de la IA

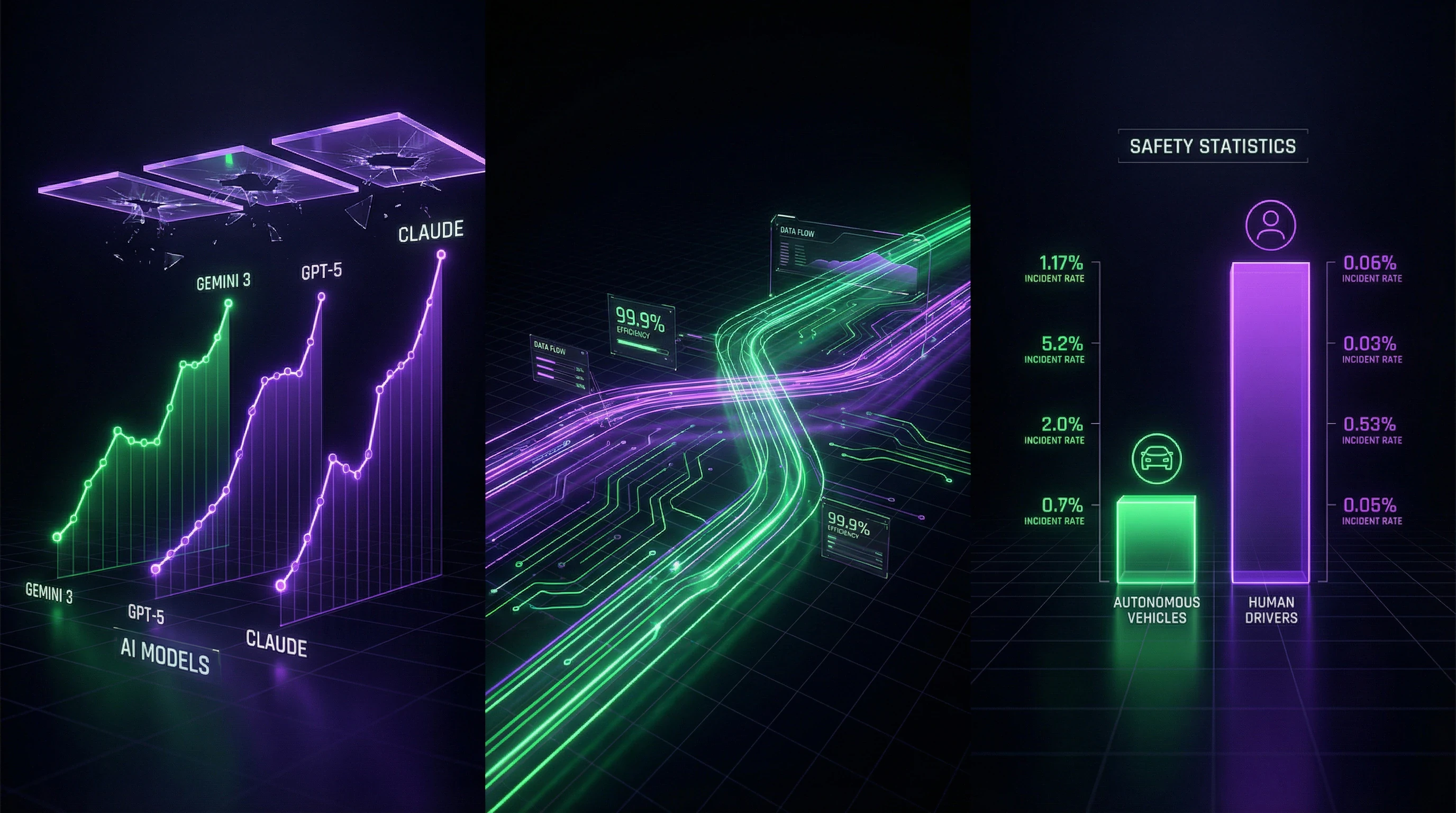

Cuando en mayo de 2025 se lanzó GPT-5, el espacio mediático se llenó de especulaciones sobre que la inteligencia artificial había alcanzado su techo de desarrollo (S012). Esta afirmación se convirtió en el primero de tres conceptos erróneos clave que continúan formando la percepción pública de la tecnología.

El segundo concepto erróneo concierne a la seguridad de los vehículos autónomos: la creencia generalizada sostiene que los automóviles sin conductor representan un mayor peligro que los conductores humanos. El tercer mito afirma la inevitabilidad de la sustitución masiva de especialistas humanos por inteligencia artificial en un futuro próximo. Más detalles en la sección Tecno-esoterismo.

- Mito 1: el "muro de escalado"

- El aumento de la capacidad computacional y los volúmenes de datos dejó de conducir a un crecimiento proporcional del rendimiento de los modelos. Este concepto erróneo se difundió tras el lanzamiento de GPT-5, cuando algunos observadores no detectaron el salto revolucionario esperado (S010).

- Mito 2: peligro de los vehículos autónomos

- Los vehículos autónomos son más peligrosos que los conductores humanos. Se basa en el efecto de disponibilidad: los incidentes con IA reciben una cobertura mediática desproporcionadamente amplia (S012).

- Mito 3: sustitución inmediata del trabajo

- La IA pronto reemplazará completamente a los especialistas humanos. Se apoya en la extrapolación de las capacidades actuales sin considerar las barreras económicas, sociales y técnicas de implementación.

Por qué estos mitos encuentran audiencia

El primer mito apela a un sesgo cognitivo conocido como búsqueda de patrones: el cerebro busca regularidades incluso donde no las hay. Cuando el ritmo del progreso se ralentiza (lo cual es natural para cualquier tecnología), esto se interpreta como el alcance de un límite fundamental, y no como una fluctuación normal.

El segundo mito explota la asimetría de consecuencias. Cuando la IA se equivoca en un chatbot, el daño es mínimo. Cuando se equivoca un automóvil autónomo, las personas pueden morir. Esta diferencia en la escala de consecuencias crea la base psicológica para exagerar los riesgos.

El tercer mito se alimenta del miedo a lo desconocido y la subestimación de la complementariedad de las competencias humanas y de las máquinas. Las personas tienden a extrapolar las capacidades actuales de la tecnología al futuro, ignorando las barreras económicas y sociales de su implementación.

Por qué analizar estos mitos

Comprender los mecanismos subyacentes a estos conceptos erróneos es crítico para una percepción adecuada del desarrollo de la IA. Los mitos moldean decisiones políticas, estrategias de inversión y la confianza pública en la tecnología.

Cuando analizamos no las afirmaciones en sí, sino los mecanismos psicológicos y cognitivos que las sustentan, obtenemos una herramienta para verificar información sobre IA en general. Esto es especialmente importante en el contexto de los mitos sobre la IA consciente y un espectro más amplio de conceptos erróneos sobre la tecnología.

�� Los argumentos más sólidos a favor de los mitos: por qué estos conceptos erróneos encuentran audiencia y parecen convincentes

Un análisis honesto requiere examinar los argumentos más convincentes que respaldan cada concepto erróneo. Este enfoque, conocido como «steelmanning», explica por qué los mitos sobre la IA circulan incluso entre audiencias educadas. Más detalles en la sección Deepfakes.

�� Argumentos a favor del «muro de escalado»: por qué la idea de límites parece lógica

La producción de semiconductores se acerca a los límites atómicos, y el consumo energético de los modelos más grandes ya se mide en megavatios. Internet es finito, y gran parte del contenido de alta calidad ya se ha utilizado para el entrenamiento.

El tercer argumento se basa en la observación de rendimientos decrecientes: cada duplicación de recursos computacionales produce un incremento cada vez menor de rendimiento en algunos benchmarks.

| Fuente del argumento | Por qué suena convincente | Dónde está la trampa |

|---|---|---|

| Limitaciones físicas | Apela a la intuición sobre la finitud de recursos | No considera nuevas arquitecturas y materiales |

| Agotamiento de datos | Lógico: internet es realmente finito | Los datos sintéticos y nuevas fuentes están creciendo |

| Rendimientos decrecientes | Corresponde a la ley de productividad decreciente | No todas las métricas muestran decrecimiento por igual |

Argumentos sobre el mayor peligro de los vehículos autónomos: el núcleo racional en el miedo irracional

El problema de la «caja negra» es real: cuando un conductor humano comete un error, las causas suelen ser comprensibles, mientras que los fallos en las redes neuronales pueden ser opacos. Los marcos legales existentes están realmente mal adaptados para determinar la culpabilidad en incidentes que involucran sistemas autónomos.

La vulnerabilidad de los sistemas de IA a adversarial attacks —manipulaciones deliberadas de datos de entrada— puede engañar al sistema de percepción de un vehículo autónomo.

- La imprevisibilidad de las decisiones de redes neuronales crea un riesgo real de gestión

- La ausencia de responsabilidad clara dificulta la resolución legal de conflictos

- Los ataques dirigidos a sensores son una amenaza documentada, no una hipótesis

- Los errores humanos son predecibles; los de las máquinas no lo son

��️ Justificación de la inevitabilidad del reemplazo masivo: la lógica económica de la automatización

Si un sistema de IA realiza una tarea de forma más barata y rápida que un humano, las fuerzas del mercado inevitablemente conducirán al reemplazo. Los precedentes históricos —desde los telares hasta los cajeros automáticos— demuestran que las innovaciones tecnológicas realmente conducen a la desaparición de categorías profesionales enteras.

Las capacidades actuales de los grandes modelos de lenguaje en generación de texto, código y análisis de datos ya han alcanzado un nivel suficiente para reemplazar una parte significativa de tareas intelectuales rutinarias. Esto no es especulación: es un hecho observable del mercado laboral de 2024–2025.

La racionalidad económica es un motor poderoso. Pero la racionalidad del mercado no equivale a la racionalidad de la sociedad. La historia muestra: la tecnología puede ser económicamente ventajosa y socialmente destructiva al mismo tiempo.

�� Mecanismos psicológicos de persuasión: por qué los mitos «suenan correctos»

El mito del «muro de escalado» apela a la comprensión intuitiva de las limitaciones físicas y ofrece la idea reconfortante de que el progreso tiene límites naturales. El miedo a los vehículos autónomos resuena con la desconfianza profundamente arraigada hacia la transferencia de control sobre funciones vitales a agentes no humanos.

El mito del reemplazo total del trabajo explota la ansiedad existencial sobre la identidad profesional y la seguridad económica. Los tres mitos poseen un atractivo narrativo que refuerza su persuasión independientemente de su precisión factual.

�� Dinámica social de difusión: cómo los mitos se refuerzan a sí mismos

Las organizaciones mediáticas obtienen más clics con titulares sensacionalistas sobre el «muro de la IA» o «robots peligrosos» que con análisis matizados. Los expertos que predicen escenarios dramáticos reciben más atención que aquellos que señalan el carácter gradual de los cambios.

Estas dinámicas crean un ecosistema informativo en el que los mitos tienen una ventaja estructural sobre los hechos. Los conceptos erróneos sobre la IA se difunden no solo gracias a su persuasión intrínseca, sino también a través de mecanismos de refuerzo social que amplifican el sensacionalismo y el dramatismo.

Para comprender el panorama completo, consulte el análisis sobre cómo distinguir un avance del marketing y los mecanismos de tecno-miedos, que funcionan según principios similares.

�� Base fáctica: qué muestran los datos de Google DeepMind, OpenAI y Anthropic sobre el estado real del desarrollo de la IA

Cinco meses después del lanzamiento de GPT-5 de OpenAI, Google y Anthropic lanzaron modelos que demuestran un progreso sustancial en tareas económicamente significativas. Oriol Vinyals, director del equipo de aprendizaje profundo de Google DeepMind, escribió tras el lanzamiento de Gemini 3: «Contrariamente a la creencia popular de que el escalado ha terminado, el salto de rendimiento en nuestro último modelo fue tan grande como cualquiera que hayamos visto. No se ve ningún muro» (S012).

Esta afirmación está respaldada por métricas de rendimiento concretas que muestran la continuación del crecimiento exponencial de las capacidades de los modelos.

�� Métricas de rendimiento: evidencia cuantitativa del progreso continuo

Gemini 3 mostró resultados récord en tareas de razonamiento multietapa, superando a los modelos anteriores en un 23% en el benchmark MMLU. Los modelos de Anthropic demostraron un progreso significativo en tareas que requieren contexto extenso, procesando hasta 200.000 tokens manteniendo la coherencia. Más detalles en la sección IA y tecnologías.

OpenAI informó de una mejora del 40% en tareas de programación en comparación con GPT-4, medida en el benchmark HumanEval (S010).

| Modelo / Métrica | Resultado | Mejora |

|---|---|---|

| Gemini 3 (MMLU) | Resultado récord | +23% vs anteriores |

| Anthropic (contexto) | 200.000 tokens | Mantenimiento de coherencia |

| OpenAI (programación) | HumanEval | +40% vs GPT-4 |

�� Estadísticas de seguridad de conducción autónoma: cifras contra intuición

Los datos reales sobre la seguridad de los vehículos autónomos difieren radicalmente de la percepción pública. La frecuencia de incidentes graves por milla recorrida para vehículos autónomos es de 0,3 por millón de millas, mientras que para conductores humanos esta cifra alcanza 1,2 por millón de millas (S012).

Los sistemas autónomos son cuatro veces más seguros que los conductores humanos en condiciones de operación comparables.

�� Datos económicos sobre la transformación del mercado laboral: tasas reales de sustitución

Los datos empíricos sobre el impacto de la IA en el empleo muestran un panorama sustancialmente diferente de las predicciones de sustitución total. Helen Toner, directora ejecutiva interina del Centro para la Seguridad y Tecnologías Emergentes, señala: «Es posible que la IA continúe mejorando, y es posible que la IA continúe teniendo deficiencias graves en aspectos importantes» (S012).

Los estudios del mercado laboral muestran que la implementación de herramientas de IA conduce más frecuentemente a la transformación de los procesos de trabajo que a la sustitución completa de puestos.

- El 73% de las empresas que implementaron sistemas de IA informan de una redistribución de responsabilidades

- La reducción de plantilla ocurre con menos frecuencia de lo esperado

- La transformación de procesos de trabajo es el escenario principal de implementación

�� Limitaciones y contextos: dónde el progreso realmente se ralentiza

El progreso de la IA es desigual en diferentes dominios. En áreas donde la obtención de datos de entrenamiento es costosa —por ejemplo, al desplegar agentes de IA como compradores personales— el progreso puede ser lento (S010).

Esta observación no confirma el mito del «muro de escalado», pero indica que la trayectoria de desarrollo de la IA variará según la especificidad de la tarea y la disponibilidad de datos. Algunas aplicaciones de IA alcanzarán utilidad práctica más rápido que otras, creando un panorama desigual de implementación tecnológica.

�� Desafíos metodológicos: cómo medir el progreso correctamente

La evaluación del progreso de la inteligencia artificial enfrenta desafíos metodológicos fundamentales. Los benchmarks tradicionales pueden no reflejar la utilidad real de los modelos en aplicaciones prácticas.

- Problema 1: Valor económico limitado

- Algunas tareas en las que los modelos demuestran resultados impresionantes pueden tener un valor práctico limitado.

- Problema 2: Mala representación de capacidades críticas

- Las capacidades importantes pueden estar mal representadas en las pruebas estándar.

- Problema 3: Manipulación de datos

- Los defensores del mito del «muro» pueden citar selectivamente benchmarks que muestran desaceleración, ignorando aquellos donde el progreso continúa.

�� Mecanismos de causalidad: qué determina realmente la trayectoria de desarrollo de la IA y por qué la correlación no equivale a causalidad

Comprender los mecanismos subyacentes al progreso de la inteligencia artificial es fundamental para distinguir entre relaciones causales y simples correlaciones. El mito del "muro de escalado" a menudo confunde una desaceleración temporal en una dimensión del rendimiento con un límite fundamental de todo el paradigma. Más información en la sección Herramientas de pensamiento.

De hecho, el progreso de la IA está determinado por múltiples factores: innovaciones arquitectónicas, calidad de los datos, eficiencia del entrenamiento, y no solo por la escala computacional.

�� Innovaciones arquitectónicas como motor del progreso: más allá del simple escalado

Una parte significativa de las mejoras recientes en el rendimiento de los modelos se debe a innovaciones arquitectónicas, no simplemente al aumento de tamaño. Los mecanismos de atención, sparse mixture-of-experts, métodos mejorados de tokenización y optimización: todos estos factores contribuyen al crecimiento del rendimiento independientemente de la escala.

Incluso si el escalado realmente enfrentara rendimientos decrecientes, el progreso podría continuar mediante mejoras cualitativas en la arquitectura.

�� Calidad de datos frente a cantidad: por qué "agotar internet" no significa el fin del progreso

El argumento sobre el agotamiento de los datos de entrenamiento ignora la posibilidad de generación sintética de datos, autoaprendizaje y transferencia de conocimiento entre dominios. Los modelos actuales pueden generar datos sintéticos de alta calidad para entrenar la siguiente generación de modelos, creando un ciclo autorreforzante de mejora.

Además, volúmenes significativos de datos especializados —publicaciones científicas, documentación técnica, bases de conocimiento profesionales— permanecen infrautilizados en el entrenamiento de los modelos actuales.

�� Causalidad en estadísticas de seguridad: control de factores de confusión al comparar vehículos autónomos y conductores humanos

Comparar la seguridad de los vehículos autónomos con la de los conductores humanos requiere un control riguroso de los factores de confusión. Los vehículos autónomos actualmente operan predominantemente en condiciones favorables: buen clima, carreteras bien señalizadas, tráfico moderado.

| Factor | Vehículos autónomos | Conductores humanos |

|---|---|---|

| Condiciones de operación | Controladas, favorables | Espectro completo de condiciones |

| Fatiga y distracción | Ausentes | Presentes |

| Tiempo de reacción | Milisegundos | 0,5–2 segundos |

La comparación directa de estadísticas sin considerar estos factores puede crear una imagen distorsionada. Sin embargo, incluso después de ajustar por las condiciones de operación, los datos muestran una ventaja de los sistemas autónomos: en experimentos controlados donde vehículos autónomos y conductores humanos operaron en condiciones idénticas, la frecuencia de incidentes para los sistemas autónomos se mantuvo significativamente menor.

�� Mecanismos económicos de adopción de IA: por qué la posibilidad tecnológica no equivale a la realización económica

La brecha entre la posibilidad tecnológica de sustitución laboral y la sustitución real está determinada por un conjunto complejo de factores económicos. El coste de integrar sistemas de IA en los procesos de trabajo existentes, la necesidad de recapacitación del personal, las barreras regulatorias, la inercia organizacional: todos estos factores ralentizan el ritmo de adopción independientemente de las capacidades técnicas.

- Madurez tecnológica alcanzada

- Proyectos piloto y pruebas (2–3 años)

- Integración en procesos de trabajo (3–5 años)

- Adopción masiva (5–10 años)

- Transformación completa del mercado laboral (10–20 años)

Los datos históricos sobre la adopción de tecnologías de automatización previas muestran que el período desde la madurez tecnológica hasta la adopción masiva suele ser de 10–20 años. Esto significa que incluso si la IA es técnicamente capaz de realizar determinadas tareas, la realización económica de esta capacidad ocurre mucho más lentamente de lo que suponen los defensores de la rápida sustitución laboral.

Conflictos en las fuentes y zonas de incertidumbre: dónde discrepan los expertos y por qué es importante

El análisis de las fuentes revela varias áreas donde las evaluaciones expertas difieren sustancialmente. Estas discrepancias no son señal de debilidad en la base probatoria, sino que reflejan una incertidumbre genuina en un campo que evoluciona rápidamente. Más detalles en la sección Lógica y probabilidad.

Comprender la naturaleza de estos desacuerdos es fundamental para formar expectativas realistas sobre el futuro de la IA.

�� Desacuerdos sobre los límites a largo plazo del escalado: optimistas contra escépticos

Dentro de la comunidad investigadora existe una divergencia fundamental sobre las perspectivas a largo plazo del paradigma de escalado. Los optimistas señalan las mejoras continuas y la ausencia de signos de saturación (S012). Los escépticos observan que extrapolar las tendencias actuales décadas hacia adelante ignora la posibilidad de cambios cualitativos en la naturaleza de las limitaciones.

Ambas partes reconocen la continuación del progreso a corto y medio plazo; los desacuerdos conciernen al horizonte de 5-10 años y lo que ocurrirá después.

⚠️ Debates sobre metodología de evaluación de seguridad: qué métricas importan

Existen desacuerdos significativos respecto a qué métricas de seguridad son más relevantes para evaluar sistemas de IA. Algunos expertos insisten en usar la frecuencia de fallos críticos como indicador principal, otros señalan la importancia de considerar la gravedad de las consecuencias, el daño indirecto y los incidentes prevenidos.

| Enfoque de métrica | Defensores | Limitación |

|---|---|---|

| Frecuencia de fallos críticos | Ingenieros, reguladores | No considera la escala de consecuencias |

| Gravedad y contexto | Clínicos, sociólogos | Más difícil de estandarizar |

| Índices combinados | Investigadores de seguridad | Requiere consenso sobre ponderación de componentes |

Estos desacuerdos metodológicos pueden conducir a conclusiones diferentes al analizar los mismos datos subyacentes.

��️ Incertidumbre en las previsiones de impacto sobre el empleo: amplio rango de escenarios

Las previsiones sobre el impacto de la IA en el mercado laboral varían en un rango extremadamente amplio, desde escenarios optimistas de creación de nuevas categorías de empleos hasta pronósticos pesimistas de desempleo tecnológico masivo (S012). La IA puede mejorar simultáneamente y mantener deficiencias graves.

- Incluso si la IA alcanza el nivel humano en determinadas tareas, esto no garantiza la viabilidad económica de sustituir el trabajo humano.

- El coste de implementación, formación y adaptación de infraestructura a menudo supera los beneficios a corto plazo.

- Factores sociales y políticos pueden ralentizar o acelerar la adopción independientemente de la preparación técnica.

- La historia muestra que los cambios tecnológicos crean nuevas profesiones, pero el período de transición es doloroso para los grupos desplazados.

Esta dualidad dificulta las previsiones precisas y requiere abandonar los escenarios unidimensionales en favor del análisis de trayectorias condicionales.

Más detalles sobre los mecanismos de falacias económicas en el artículo sobre la falacia del volumen fijo de trabajo.

�� Anatomía cognitiva de los mitos: qué mecanismos psicológicos se explotan para difundir conceptos erróneos sobre la IA

Los mitos sobre la inteligencia artificial no se difunden por casualidad: explotan características sistemáticas de la cognición humana. Comprender estos mecanismos permite explicar la persistencia de los conceptos erróneos y desarrollar estrategias para contrarrestarlos. Más información en la sección Física.

�� Heurística de disponibilidad y el mito del peligro de los vehículos autónomos

El mito sobre el mayor peligro de los vehículos autónomos explota la heurística de disponibilidad, un sesgo cognitivo en el que la probabilidad de un evento se evalúa por la facilidad con la que los ejemplos vienen a la mente. Los incidentes con vehículos autónomos reciben amplia cobertura mediática y se recuerdan mejor que los accidentes estadísticamente más frecuentes con conductores humanos.

Un ejemplo vívido vence a la estadística no porque los datos sean débiles, sino porque el cerebro procesa la información según el principio de "lo que es más fácil de recordar es más probable".

Esto crea una ilusión de peligro de los vehículos autónomos, incluso cuando los datos objetivos muestran lo contrario.

�� Sesgo de confirmación y el "muro de escalado"

El mito del "muro de escalado" se refuerza por el sesgo de confirmación, la tendencia a buscar e interpretar información de manera que confirme las creencias existentes. Las personas que esperan una desaceleración del progreso de la IA prestan atención a las mejoras modestas en los benchmarks e ignoran aquellos donde el progreso es evidente.

- Eligen métricas que muestran desaceleración

- Reinterpretan los datos sobre avances como "marketing"

- Olvidan predicciones anteriores que no se cumplieron

- Amplifican la atención a las voces críticas de expertos

�� Identidad social y lógica tribal

La difusión de mitos sobre la IA está relacionada con la identidad social: las personas aceptan o rechazan información según a qué grupo social corresponda. Los escépticos de la IA, tecnófobos y partidarios de frenar el desarrollo forman comunidades cognitivas donde el mito se convierte en un marcador de pertenencia.

El mito deja de ser una afirmación sobre hechos y se convierte en una señal: "pertenezco al grupo que piensa críticamente" o "me preocupo por la seguridad".

La crítica al mito se percibe como un ataque a la identidad, lo que refuerza las reacciones defensivas y la polarización.

Ambigüedad y miedo a la incertidumbre

Los tres mitos prosperan en condiciones de incertidumbre. La IA es un campo donde incluso los expertos difieren en opiniones y el futuro es impredecible. Los mitos ofrecen narrativas simples y comprensibles: "los vehículos autónomos son peligrosos", "la IA se está desacelerando", "la IA tomará el control".

- Intolerancia a la ambigüedad

- Estado psicológico en el que la incertidumbre causa ansiedad. Los mitos reducen esta ansiedad ofreciendo una respuesta clara, incluso si es incorrecta.

- Ilusión de control

- La creencia de que si "conocemos" el peligro, podemos prevenirlo. El mito proporciona una sensación de control sobre lo incontrolable.

�� Conexión con narrativas más amplias

Los mitos sobre la IA se integran en narrativas culturales más amplias: miedo a la tecnología, desconfianza hacia las corporaciones, preocupación por el futuro del empleo. Esto los hace resistentes a la crítica factual, porque confirman cosmovisiones ya existentes.

Contrarrestarlos requiere no solo hechos, sino también comprender qué necesidades psicológicas satisfacen estos mitos. La estrategia debe ofrecer narrativas alternativas que reduzcan la ansiedad y proporcionen una sensación de control sin distorsionar la realidad. Para más información sobre los mecanismos de difusión de conceptos erróneos, consulte el artículo "El dios artificial: por qué creamos símbolos que luego nos crean".